基于多模型融合的工業工件剩余壽命預測*

王建成 蔡延光

(廣東工業大學自動化學院,廣東 廣州 510006)

關鍵字:LightGBM;ridge;GBDT;XGBoost;模型融合;工件剩余壽命預測

0 引言

預測性維護在工業互聯網的應用中被稱為“皇冠上的明珠”,實現預測性維護的關鍵是對設備系統或核心部件的壽命進行有效預測。對設備系統或核心耗損性部件的剩余壽命進行預測,并據此對相關部件進行提前維護或更換,可減少整套設備非計劃停機時間避免整個生產現場其他正常配套設備因等待故障設備部件修復[1-2],而造成經濟損失。

工業上采集的數據集中存在較多干擾數據,而傳統線性模型的抗干擾能力弱,預測精度較低,增加了工業設備維護的成本。為此,本文提出一種雙模型的加權融合方法進行工業工件剩余壽命預測,通過4種機器學習算法及3種雙模型融合的方法,建立工業工件的剩余壽命預測模型,并進行比較分析。在一定程度上,提供了設備提前維護的數據支持,同時挖掘影響機器設備壽命的關鍵因素。

1 相關算法

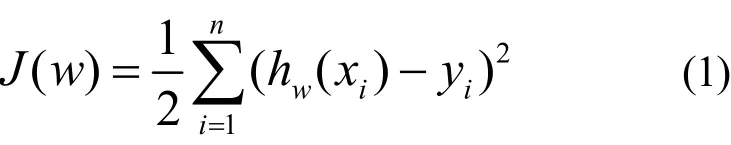

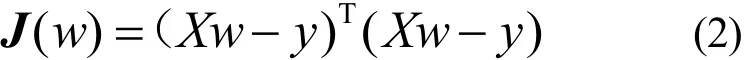

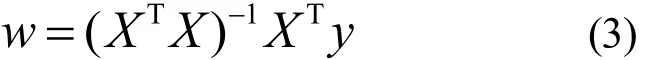

1.1 ridge算法

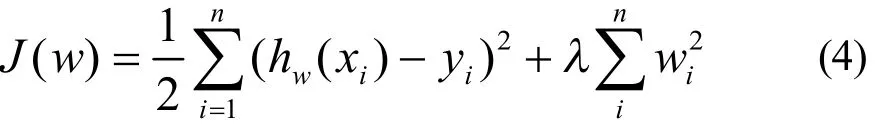

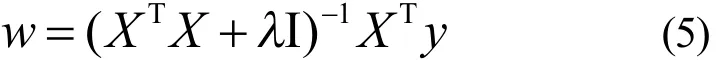

線性回歸的損失函數J(w)通常定義為

式中,xi是具有m個特征的樣本;yi為真實值;為預測值。

對式(2)w求偏導,并令可得到

為防止過擬合,學者對線性回歸進行優化,產生了ridge回歸[3]。ridge回歸在線性回歸損失函數的基礎上增加一個正則項則有

同樣對式(4)中w求偏導,并令可得到

出現過擬合時,模型幾乎完全匹配訓練集,但在測試集上效果較差,說明該模型具有低偏差高方差的特點,可能在較小的區間內波動性較大,即模型的導數值較大。模型階數和自變量值對導數影響較小,只有自變量系數較大才可能導致過擬合,所以增加正則項對大系數進行懲罰,使系數更為平滑,可緩解模型過擬合。

本文工件預測壽命樣本達90維以上,為防止模型出現過擬合,采用ridge模型作為實驗仿真對象。

1.2 GBDT 算法

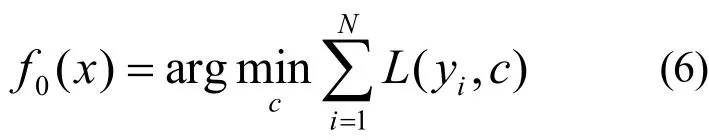

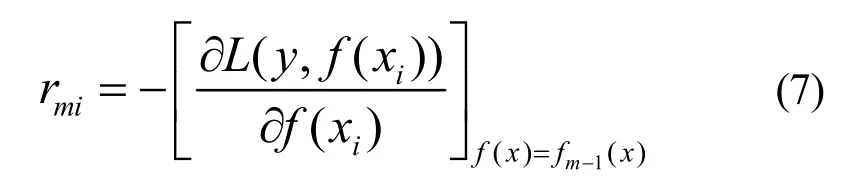

GBDT(Gradient Boosting Decision Tree)是一種迭代的決策樹算法[4,10-11],又叫 MART(Multiple Additive Regression Tree),它通過構造一組弱學習器(樹),并把多棵決策樹的結果累加起來作為最終預測輸出。該算法將決策樹與集成思想有效結合。設數據集D= {(xi,yi) :i= 1,2,… ,n,xi∈Rq,yi∈R} ,其中n為數據樣本數量,每個數據樣本有q個特征。設損失函數為L(y,f(x) ),輸出回歸樹x),GBDT算法實施具體步驟如下:

1) 初始化弱分類器,估計使損失函數極小化的一個常數值,此時樹僅有一個根結點;

2) 對迭代次數i= 1 ,2,… ,N,計算損失函數的負梯度值在當前模型的值,并將它作為殘差估計,即

對于平方損失函數,是通常所說的殘差;對于一般損失函數,是殘差的近似值。

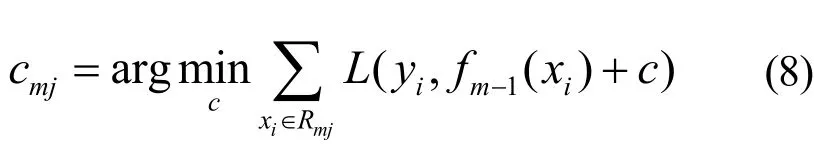

對rmi擬合一個回歸樹,得到第m棵樹的葉節點區域Rmj,j= 1 ,2,… ,J,計算

即利用線性搜索估計葉節點區域的值,使損失函數極小化。

3) 更新回歸樹

得到輸出的最終模型為

1.3 XGBoost 算法

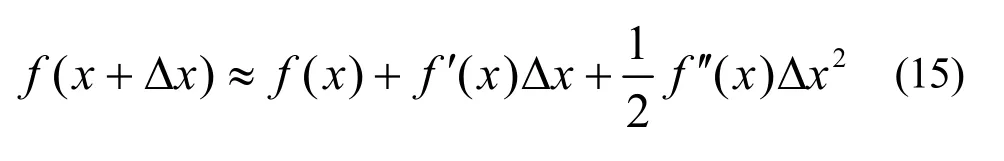

華盛頓大學陳天奇博士開發的 XGBoost(eXtreme Gradient Boosting)基于C++通過多線程實現了回歸樹的并行構建,并在原有Gradient Boosting算法的基礎上加以改進,較大地提升了模型訓練速度和預測精度。傳統的GBDT算法只利用一階的導數信息,XGBoost[5]則對損失函數做了二階的泰勒展開,并在目標函數之外加入正則項,整體求最優解,避免過擬合,提高了模型的求解效率,其步驟如下:

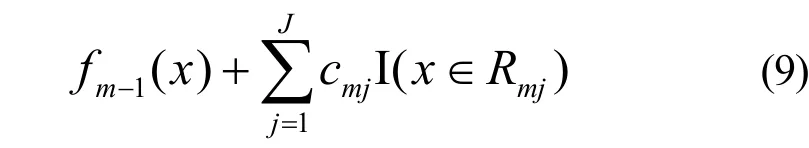

1)數據集D = {(xi,yi) :i= 1,2,… ,n,xi∈Rq,yi∈R} ,假定k(k= 1 ,2,… ,K)個回歸樹;xi為第i個數據點的特征向量;fk為一個回歸樹,F為回歸樹的集合空間,則可把一個迭代后集成的模型表示為

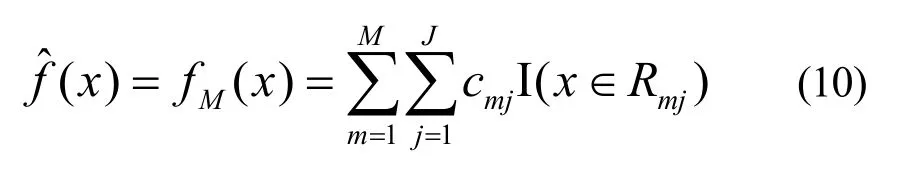

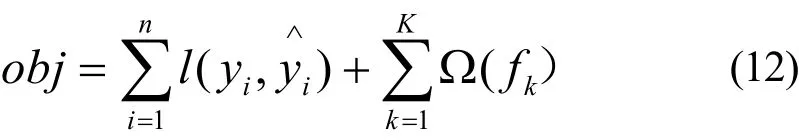

2) 目標函數為

式中,yi表示真實值;表示預測值;第一部分是訓練損失,如平方損失或Logistic Loss等;第二部分是每棵樹的復雜度之和;第k棵樹的復雜度用 Ω (fk)表示,其中T和w分別為樹葉子節點數目和葉子權重值,γ為葉子懲罰系數,λ為葉子權重懲罰系數。

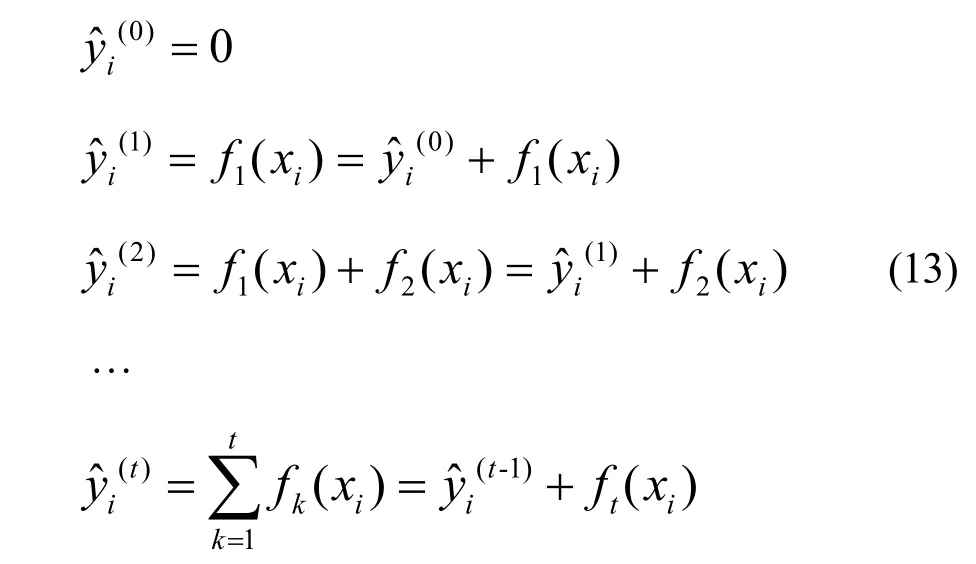

3) 采用additive training方式,即每次迭代生成一棵新的回歸樹,從而使預測值不斷逼近真實值。每次保留原來的模型不變,加入一個新的函數f到模型里,XGBoost迭代方式如下:

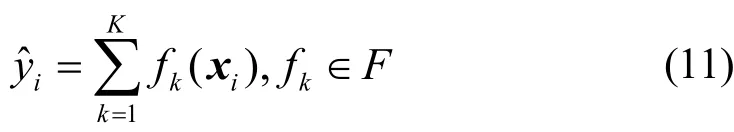

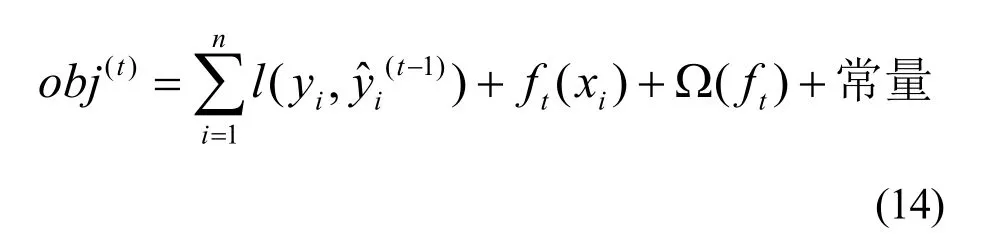

4) 將式(12)代入式(11),可得

泰勒展開一般表達式為

用泰勒展開式近似目標函數(式(14)),首先定義

那么,式(14)可得到

由式(16)可知,若移除常數項,該目標函數僅依賴每個數據點在誤差函數上的一階導數和二階導數。

1.4 LightGBM算法

LightGBM算法是微軟2015年提出的boosting框架模型[6-7],其基于傳統的GBDT引入了梯度單邊采樣和獨立特征合并技術(exclusive feature bundling,EFB)。數據通常是幾十萬維的稀疏數據,對不同維度的數據合并使一個稀疏矩陣變成稠密矩陣,獨立特征合并技術實現了互斥特征捆綁,以減少特征數量。LightGBM算法對于樹的生長采用了Leaf-wise,而不是Level-wise。Leaf-wise能夠追求更高的精度,讓更高精度的節點分裂,這樣可能產生過擬合,因此利用max_depth來控制其最大高度。LightGBM 做數據合并、Histogram Algorithm和GOSS等操作時,都有正則化作用,所以使用Leaf-wise提高精度是一個較好的選擇[11-12]。LightGBM使用histogram直方圖算法[15]替換Pre-Sorted,減少了內存消耗。

2 建模流程

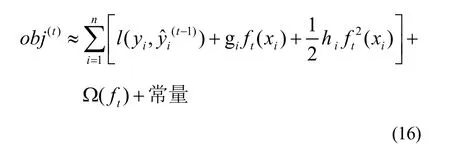

2.1 工件剩余壽命預測建模流程

工件剩余壽命預測建模流程如圖1所示,采用的訓練數據集是工件的全壽命數據。

圖1 工件剩余壽命預測建模流程

首先對工件全壽命數據進行預處理,包括異常數據刪除、缺失值數據處理和數據歸一化等;然后通過切分訓練數據集構建訓練集和測試集;最后使用python語言建立ridge模型、GBDT模型、XGBoost模型和LightGBM模型,并采用貝葉斯優化[8]進行參數自動尋優,再對XGBoost模型,LightGBM模型和GBDT模型兩兩融合,對比預測精度RMSE,確定最優預測模型。

2.2 工件全壽命數據描述及預處理

本文采用的數據源于2019工程機械核心部件壽命預測挑戰賽的數據集,其中每個文件對應一個該類部件的全壽命物聯網采樣數據,即部件從安裝到更換這段時間采樣的對應指標數據,形式為多維時間序列。字段“部件工作時長”的最大值(通常為最后一行記錄)即為該部件的實際壽命。具體特征如下:

1) 數值型字段包括:部件工作時長、累積量參數1、累積量參數2、轉速信號1、轉速信號2、壓力信號1、壓力信號2、溫度信號、流量信號和電流信號;

2) 開關量字段(0或1)包括:開關1信號、開關2信號和告警信號1;

3) 字符串型字段:設備類型。

基于一個該類部件一段時間內的物聯網采樣數據,預測該部件此后的剩余壽命。

首先對數據集的負值采用絕對值處理,刪掉具有數值極度跳躍的數據樣本;然后通過數據集切分構造特征和預測目標,本文數據集共有916個數據樣本,采用數據集切分比例依次為0.25,0.36,0.42,0.46,0.55,0.63,0.77,0.86和0.91;其次對切分得到的數據進行統計,如均值、中位數、最大值、最小值、一階差分和二階差分等;最后通過劃分和統計特征,得到94個特征和8244個數據樣本,部分特征如表1所示。

表1 數據集部分特征

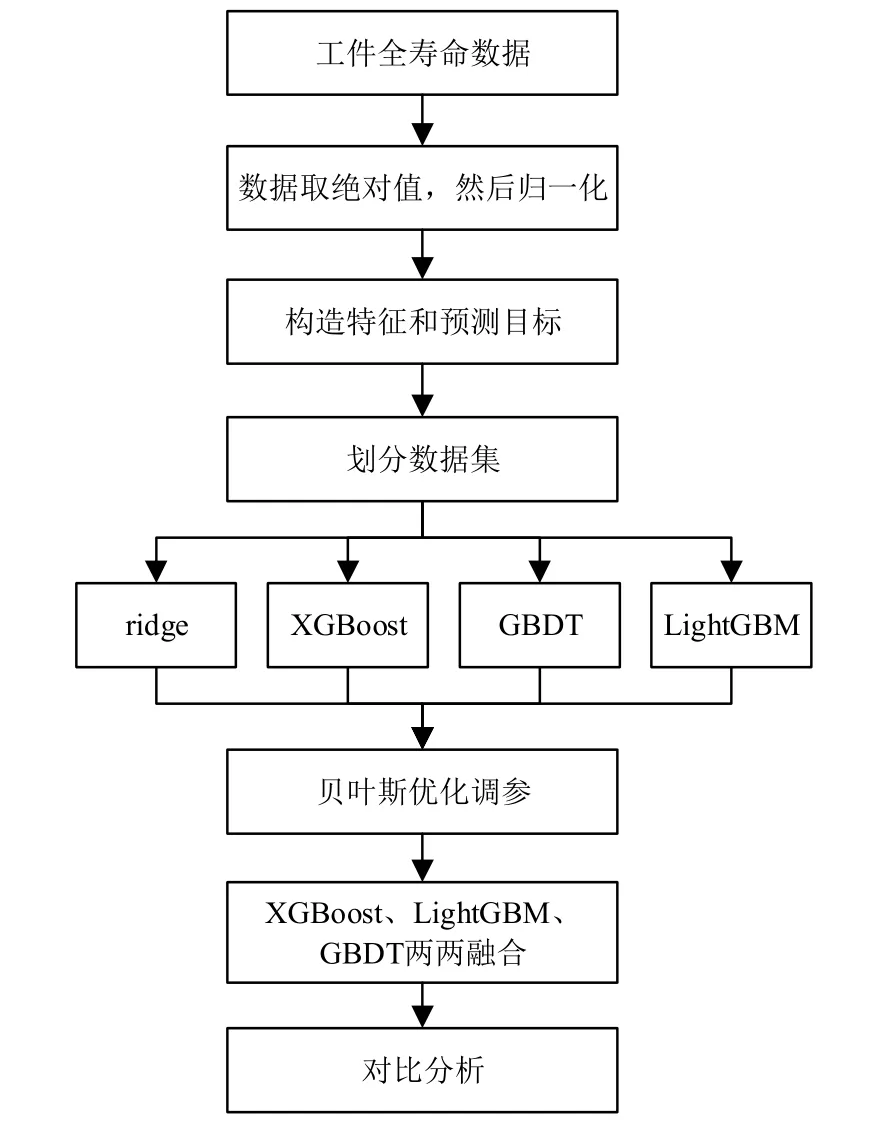

訓練集的壽命分布圖如圖2所示;歸一化的壽命分布圖如圖3所示。

由圖2、圖3可知,歸一化處理后,壽命分布圖更接近正太分布,數據分布更加合理,有利于提高模型的預測精度。

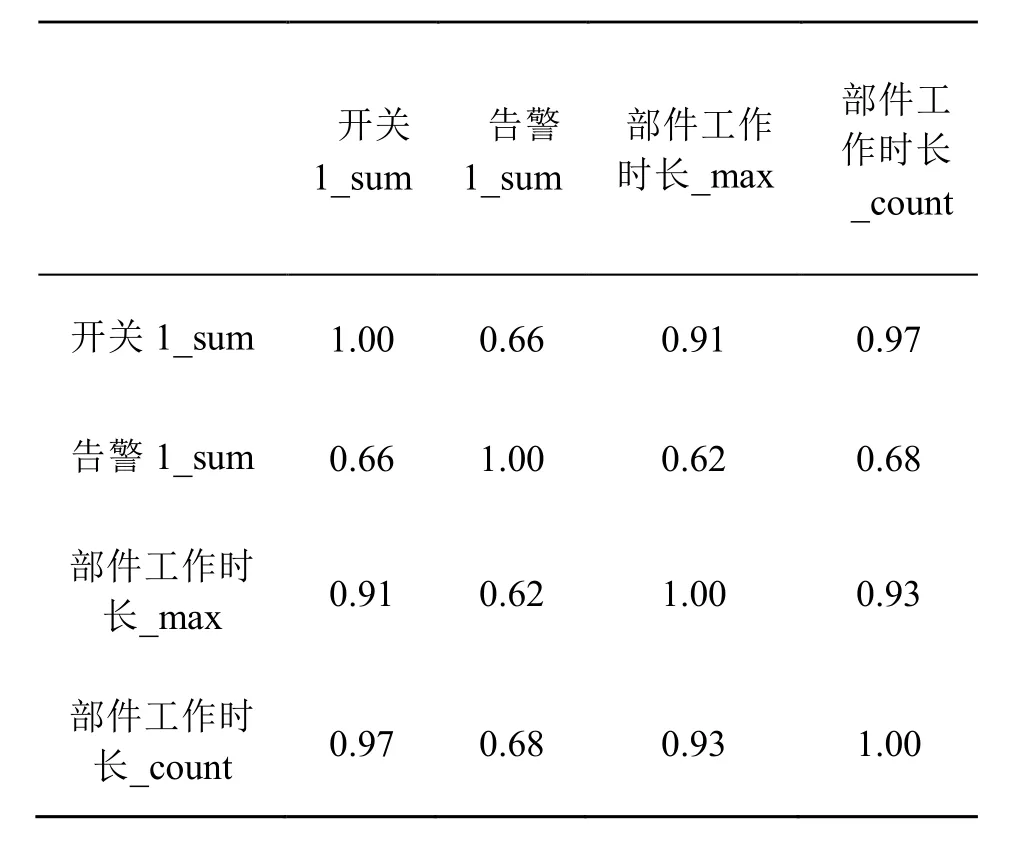

特征間的相關性可用相關系數來評估[9],相關系數的絕對值大于0.6,則確定這2個特征具有強線性相關性。將強線性相關性的特征,只保留一個特征,即可保證模型的精度和運行速度。因特征數量較多,無法全部顯示,部分特征的相關系數如表2所示。

圖2 歸一化之前的壽命分布圖

表2 部分特征的相關系數

2.3 模型評價標準

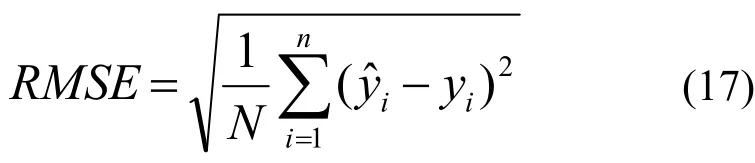

實驗仿真采用均方根誤差[14](root mean square error, RMSE)度量預測模型的精確度。RMSE值越小,表明預測越精準。

式中,n為樣本個數;為第i個樣本預測值;yi為第i個樣本真實值。

2.4 建模過程和結果分析

本文仿真環境為Intel 酷睿i7 8700 CPU,16 GB內存;操作系統為Ubuntu 16.04;采用python3.6編程語言進行建模分析;建模過程中主要使用的機器學習庫有pandas,numpy,matplotlib,joblib,tsfresh,sklearn,Multiprogressing,XGBoost和 LightGBM 等。

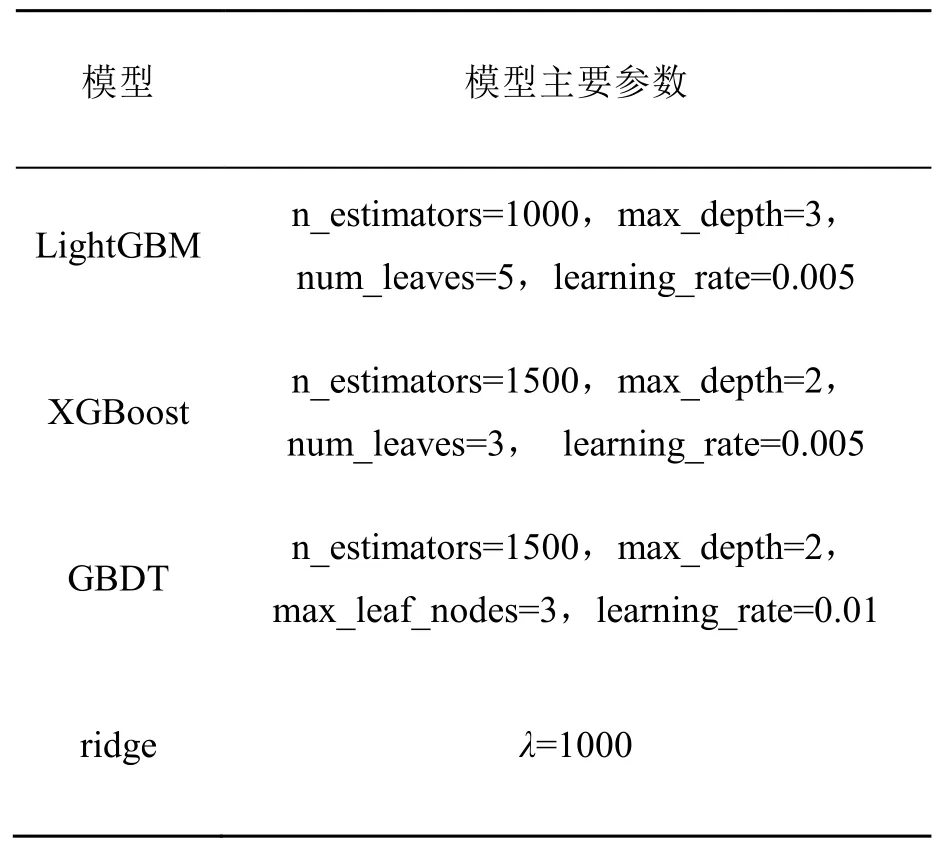

進行ridge模型、GBDT模型、XGBoost模型和LightGBM模型建模分析時,參數的選擇對模型預測結果有較大影響,因此需要對模型參數進行一定程度的調優。ridge模型回歸只需對正則項的λ進行調優;GBDT模型主要對迭代次數、學習率和樹的最大深度及最大葉子節點數4個參數進行調優[15];LightGBM模型和XGBoost模型主要對學習率、葉節點數、迭代次數以及樹的最大深度4個主要參數進行調優。本文利用貝葉斯優化進行參數調優,相比于傳統的網格搜索法,具有精度高、速度快的特點。

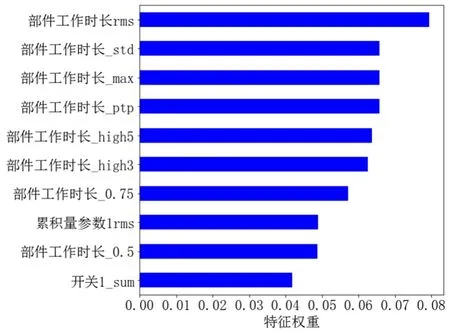

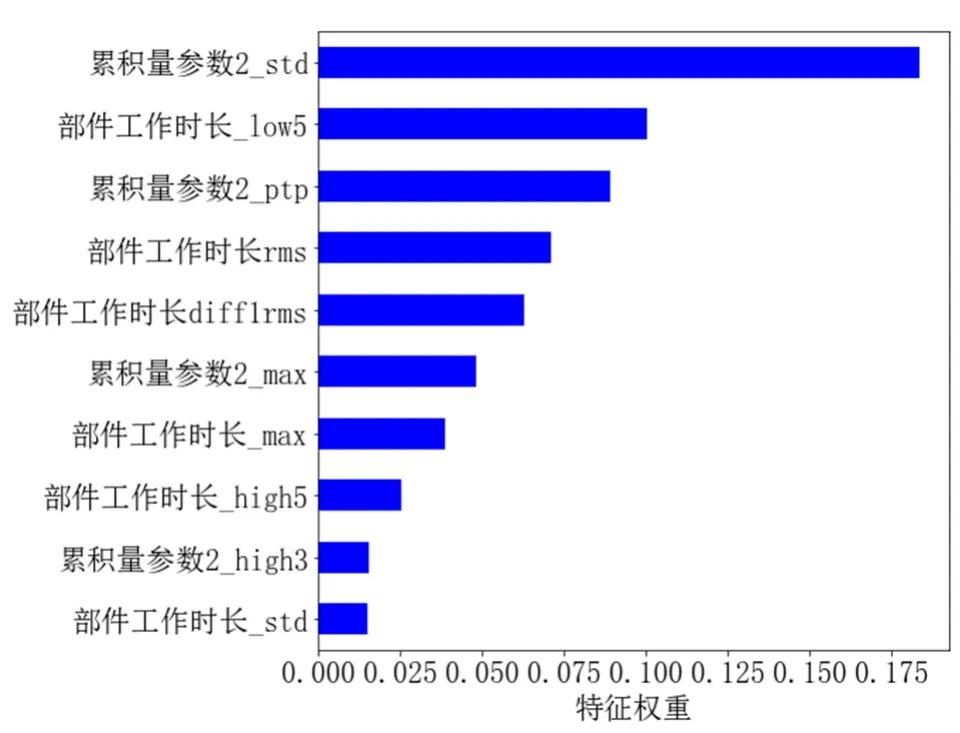

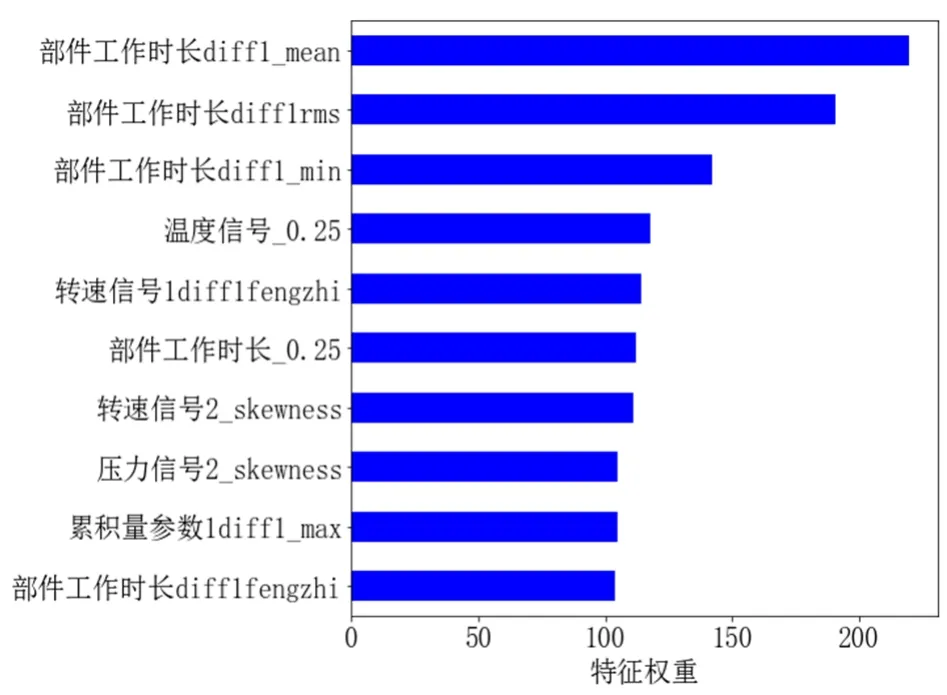

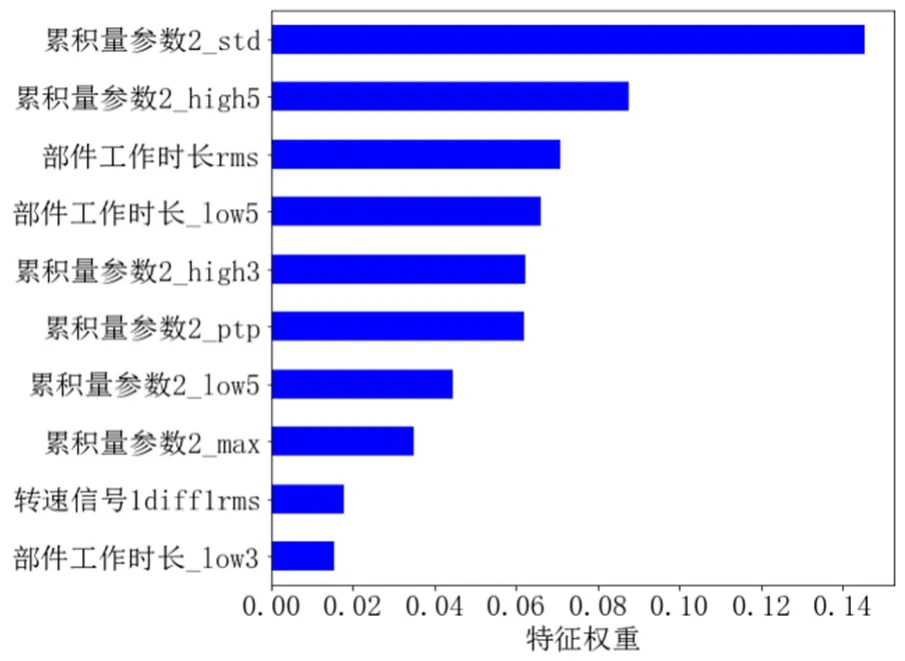

利用ridge模型、GBDT模型、LightGBM模型和XGBoost模型擬合數據,可得到各模型的特征重要性排序。ridge模型通過模型內置函數coef_輸出特征重要性;GBDT模型、LightGBM模型和XGBoost模型通過模型內置函數feature_ importances輸出特征重要性[16],如圖4所示。

圖4(a) ridge模型重要性前十的特征

圖4(b) GBDT模型重要性前十的特征

圖4(c) LightGBM模型重要性前十的特征

圖4(d) XGBoost模型重要性前十的特征

由圖5可知,4種模型選出的重要性前十的特征有一定差異,且同一模型的不同特征相對權重也有一定差異性,這種差異性體現了各個模型學習的特征具有不同的趨勢,為提高模型融合精度提供了一定依據。

利用貝葉斯優化進行參數調優時,輸入值是連續的,得到的最優參數需根據參數的物理含義進行取整,4種模型的最優參數如表3所示。

表3 模型主要參數的最優值

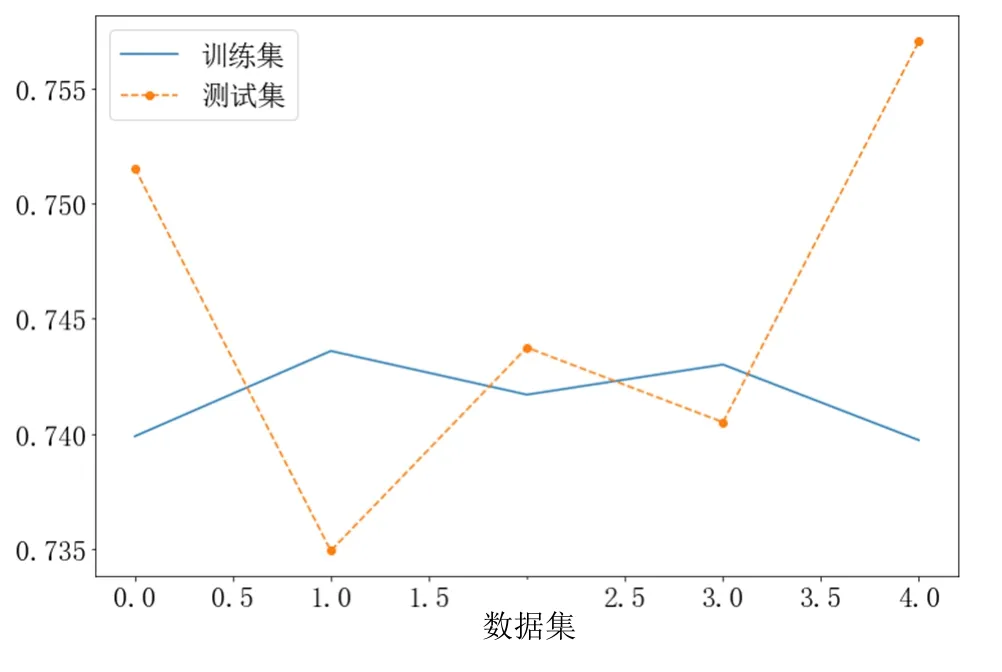

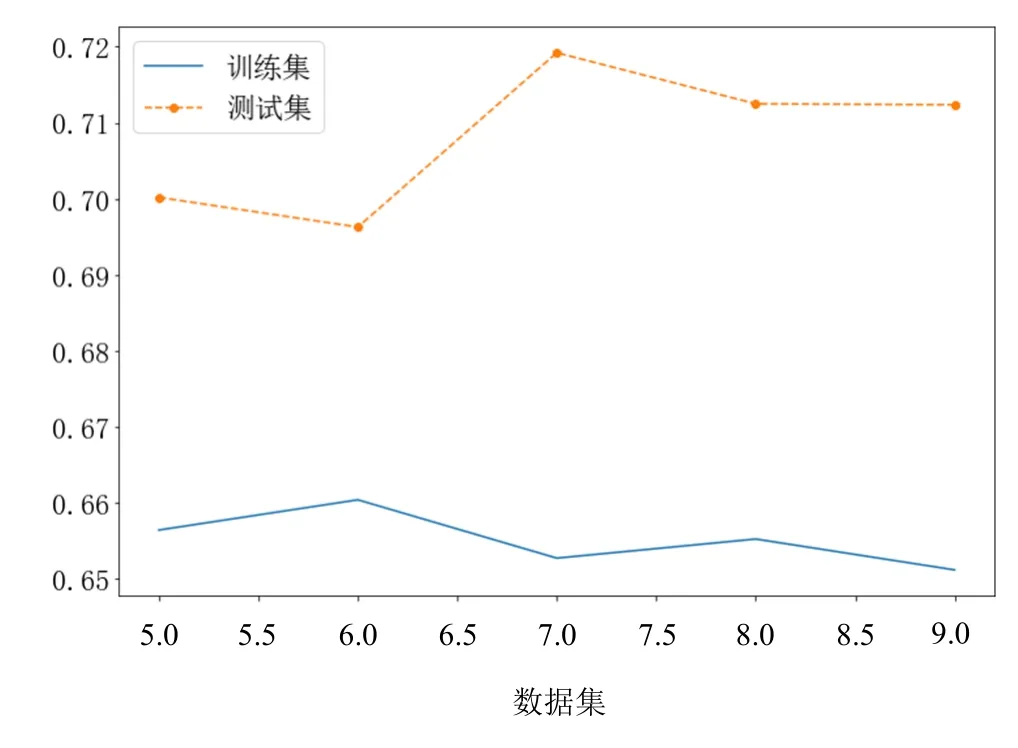

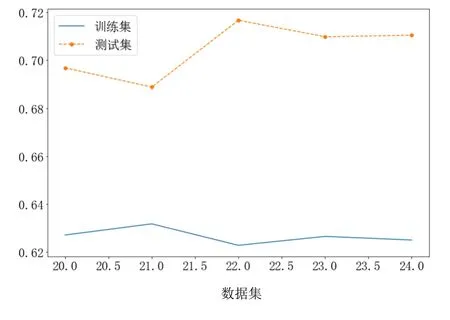

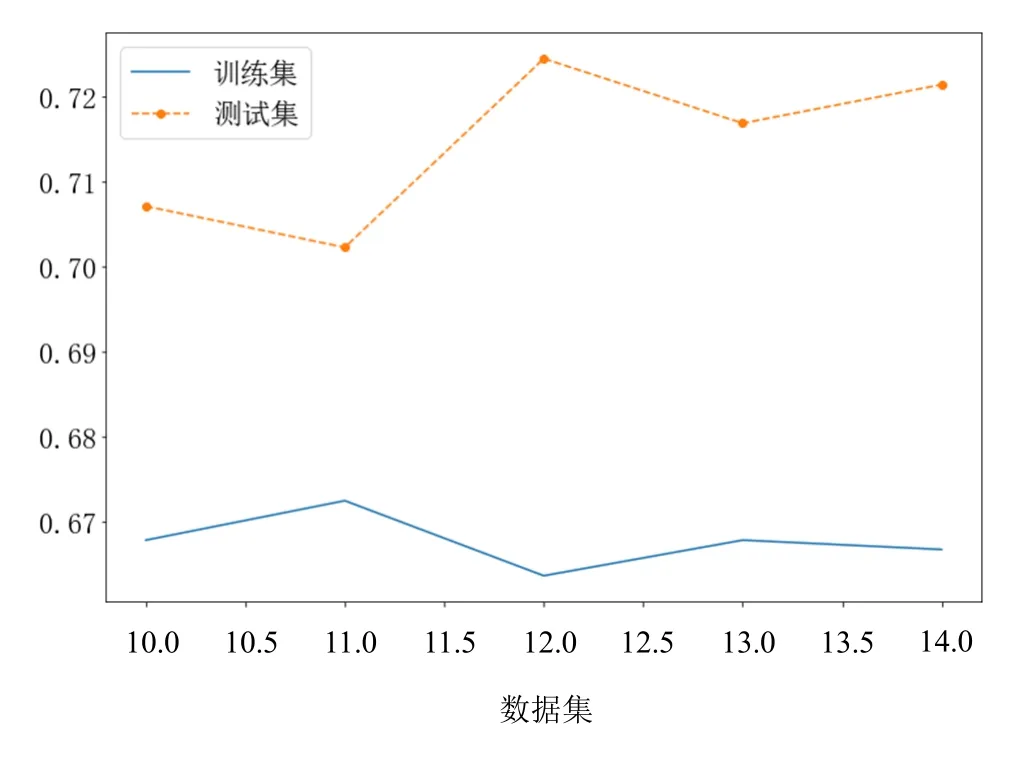

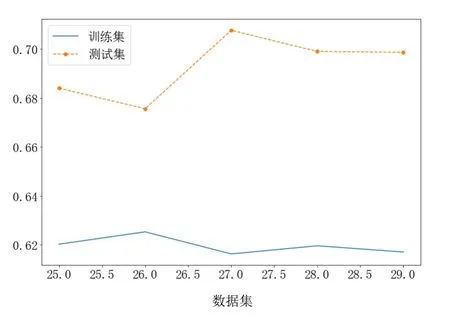

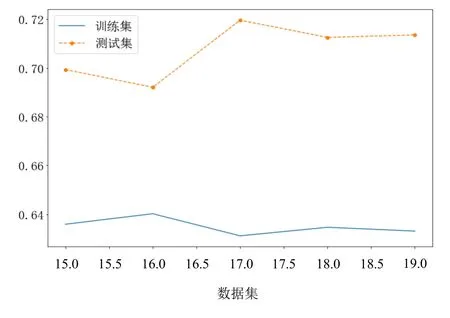

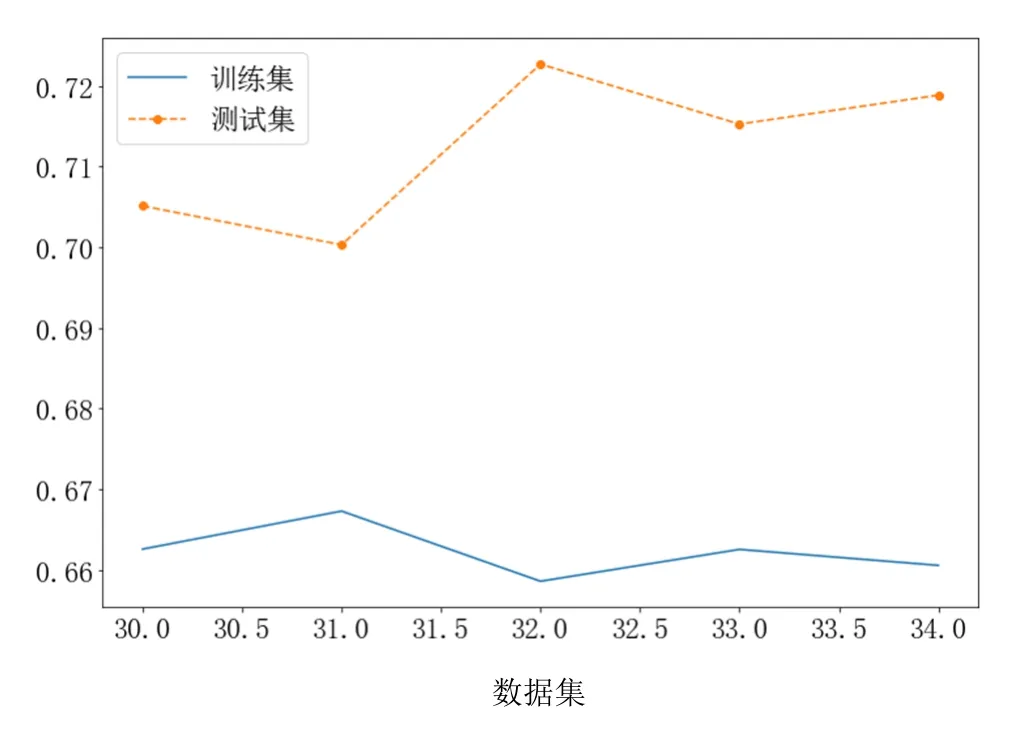

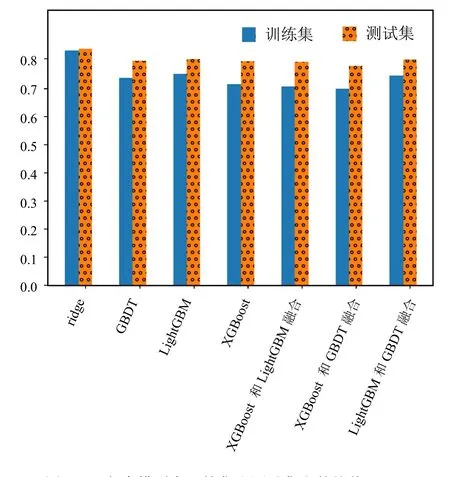

為保證算法的泛化性和實驗的可移植性,將數據集隨機抽樣5對訓練集和測試集,分別放入模型中進行訓練;然后在測試集進行預測;最后用預測值和真實值計算RMSE,訓練集和測試集的RMSE如圖5所示。

圖5(a) ridge模型預測精度RMSE

圖5(b) GBDT模型預測精度RMSE

圖5(e) XGBoost和LightGBM模型平均加權融合預測精度RMSE

圖5(c) LightGBM模型預測精度RMSE

圖5(f) XGBoost和GBDT模型平均加權融合預測精度RMSE

圖5(d) XGBoost模型預測精度RMSE

圖5(g) LightGBM和GBDT模型平均加權融合預測精度RMSE

圖5(h) 各個模型在訓練集和測試集上的均值RMSE

由表3中模型輸出特征的重要性可知,不同特征對不同模型的重要性有一定差異,如LightGBM模型最重要特征是流量信號0.25;XGBoost模型最重要特征是累積量參數 2_std;GBDT模型最重要特征是累積量參數2_std;ridge模型最重要特征是部件工作時長_std。另外,在重要性前十的特征里,LightGBM模型學習了告警1_sum,而其他模型沒有。模型學習特征上的差異性,也為提高模型融合預測精度提供了依據。

從圖5(a)、圖5(b)、圖5(c)和圖5(d)可以看出,在高噪聲環境下,3種樹模型(GBDT模型、XGBoost模型和LightGBM模型)的抗干擾性比線性模型ridge好。從RMSE評估性能上看,XGBoost模型和GBDT模型在數據集 1~數據集 5,RMSE相差不多;LightGBM模型和ridge模型的RMSE比樹模型差很多,因此本文不對ridge模型和樹模型進行融合。從圖5(e)、圖5(f)、圖5(g)和圖5(h)可以看出,樹模型的加權平均融合,可提升預測精度。在本文數據集上,XGBoost模型和GBDT模型的加權平均融合,提升效果最佳,相比于最佳單模型的XGBoost和GBDT的RMSE降低1%,這樣可較大提升設備的使用效率;XGBoost模型和LightGBM模型的加權平均融合,相比于最佳單模型的 XGBoost模型和 GBDT模型的RMSE降低了0.3%;LightGBM模型和GBDT模型的加權模型融合,相比于最佳單模型的XGBoost模型和GBDT模型的RMSE降低了0.5%,相比于單模型的LightGBM模型降低了0.2%,相比于單模型的GBDT模型降低了0.5%。

3 結語

本文使用ridge模型、XGBoost模型、LightGBM模型和GBDT模型及同時將3種樹模型進行兩兩加權平均融合預測工件的剩余壽命。從實驗仿真的效果來看,樹模型比線性ridge模型的預測精度高,可以看出樹模型的抗干擾性較強。在樹模型中,XGBoost模型和GBDT模型預測精度差不多,但比LightGBM模型預測精度高。采用模型加權平均融合的方式,對單模型來說,可提高模型的預測精度。本文XGBoost模型和 GBDT模型的融合效果較好,RMSE降低了1%;XGBoost模型和LightGBM模型融合RMSE降低了0.3%,但LightGBM模型和GBDT模型融合,RMSE降低了0.5%。因此,LightGBM模型、GBDT模型和XGBoost模型兩兩加權平均融合時,可提高工業工件剩余壽命的預測精度。