語音情感識別綜述

孫曉虎,李洪均,2,3,4

1.南通大學 信息科學技術學院,江蘇 南通226019

2.計算機軟件新技術國家重點實驗室(南京大學),南京210093

3.南通大學 智能信息技術研究中心,江蘇 南通226019

4.南通大學 通科微電子學院,江蘇 南通226019

1 引言

語音作為語言符號系統的載體,是由人的生理發聲器官發出的。語音作為語言的第一屬性,在語言中起決定性的支撐作用,不僅包含說話人所要表達的文本內容,也包含說話人所要表達的情感信息。情感與人態度中的內向感受、意向具有協調一致性,是態度在生理上一種較復雜而又穩定的評價和體驗。心理學把情感定義為人對客觀現實的一種特殊反映,是人對于客觀事物是否符合人的需要而產生的態度體驗,其本質就是人腦對于客觀事物價值的主觀反映。

語音情感識別是指通過計算機處理,以幀為單位對情感信號進行特征提取,模擬人類感知并理解人類的情感,進而推斷出語音情感類型的一種技術。其任務是從說話人的語音中提取出與情感有關的相關特征,并找出這些特征與人類情感的映射關系。1972年,Williams和Stevens發現人的情感變化對語音的基音輪廓有很大影響[1];1987 年,美國麻省理工學院的人工智能創始人Minsky 教授在The Society of Mind 一書中提出“計算機的情感能力”這一概念[2];20世紀90年代初,美國的麻省理工學院多媒體實驗室構造了一個“情感編輯器”對外界各種情感信號進行采集,用人體的生理信號、面部表情信號、語音信號等來識別各種情感,并讓機器對各種情感做出適當的反映[3];1995 年,美國MIT 媒體實驗室的Picard教授提出了情感計算的概念,并于1997年正式出版專著Affective Computing;1999 年,Moriyama 提出語音情感的線性關聯模型并將其初步應用到電子商務中[4];2003 年,Hozjan V 等研究了基于多種語言的具體情感特征的語音情感識別[5]。

國內語音情感識別研究起步相對較晚,2003 年,北京科技大學、微軟亞洲研究院以及部分大學和研究所進行了機器人的語音情感識別技術的研究;2004年以來,東南大學、江蘇大學也都啟動了語音情感方面的研究。近年來,在人工智能飛速發展的背景下[6-7],語音情感識別正逐漸成為一個新的研究熱點,Zheng 等人[8]基于有效語音的特征集和模型對情感識別的影響,提出一種多級語音情感識別的集成模型且從三方面驗證了該方法的有效性;Chen等人[9]提出一種人機交互中的兩層模糊多隨機森林算法,融合個性化和非個性化特征,對情緒社交機器人系統進行了初步的應用實驗。

本文在回顧國內外語音情感識別發展的基礎上,分別從語音情感特征、語音情感數據庫、語音情感識別算法、語音情感識別的應用以及語音情感識別的挑戰這幾個方面對其進行了總結分析,最后基于研究現狀對語音情感技術的未來發展方向進行了展望。

2 語音情感特征

根據語音情感特征具有普遍性和差異性,可將語音情感特征分為個性化情感特征和非個性化情感特征。其中,非個性化情感特征不易受說話者個人特征的影響,具有普遍性。個性化情感特征攜帶了大量的個人情感信息,具有差異性。目前,國內外對于語音情感特征種類還沒有一個統一的劃分,比較典型并且受歡迎的劃分方法是將情感特征分為基于聲學的情感特征和基于語義的情感特征。其中,基于聲學的情感特征又劃分為韻律學特征、基于譜的相關特征和音質特征。下面對這幾種常見的語言情感特征進行詳細分析。

2.1 韻律學特征

韻律特征又稱超音段特征[10],在語音學中表現為語調、音高、音長和節奏等可以被人類感知的特征。在聲學信號中,韻律特征對不同語言的語音情感識別具有較好的泛化性能,其中使用最廣泛的韻律特征是基頻、語音能量和持續時間。

基頻即基音的頻率,決定整段語音的音高,它的生理學定義是一段復雜語音中最低且通常情況下最強的頻率。基頻是由聲帶的振動產生的,其在語音變化過程中產生的基頻等值線的統計特征可作為情感特征。除此之外,基頻中還包含了大量表征語音情感的特征,在語音情感識別中起著至關重要的作用。其中自相關函數法、平均幅度差法和小波法為常用的基頻特征提取方法。語音能量又稱音強,反映了語音信號的振幅隨時間的變化強弱。振幅能量是一種重要的韻律特征,包括短時能量和平均幅度。研究表明,不同情感的聲音信號的振幅能量不盡相同,驚訝、高興等情緒會導致能量增加,而悲傷、厭惡等情緒會導致能量減少。語音持續時間是表征語音信號時間的物理量,使用最廣泛的持續時間特征有語音速率、清濁音持續時間等。文獻[11]提出了一種基于韻律特征參數的語音情感合成算法,通過對情感數據庫中生氣、無聊、悲傷和高興4 種情感的韻律參數分析,取得了78%的正確識別率;文獻[12]通過構造基于韻律段特征的多重Elman網絡模型,比使用定長語段特征相比有了較大的提高,取得了67.9%的識別率;文獻[13]將柏林情感數據庫的韻律特征和音質特征進行混合并通過多層感知器進行情感分類,取得了75.51%的識別率;文獻[14]通過識別語音/非語音區間后提取韻律特征,再進行音節分割,利用深度神經網絡對德語的Emo-DB 情感數據庫進行情感分類。雖然基于韻律學特征對語音情感識別的作用不可忽視,但其僅從時域或頻域對語音情感信息的變化進行描述,利用情感參數和區分情感的能力有限。

2.2 基于譜的相關特征

基于譜的相關特征描述了聲道形狀變化和發聲運動之間的相關性,能夠反映出信號的短時譜特性。它主要包括線性譜[15-16]和倒譜[17-18],其中線性譜包括線性預測系數、對數頻率功率系數和單邊自相關線性預測系數等;倒譜包括線性預測倒譜系數、單邊自相關線性預測倒譜系數、感知線性預測和梅爾頻率倒譜系數(Mel-Frequency Cepstrum Coefficients,MFCC)等,在倒譜中MFCC最為經典。

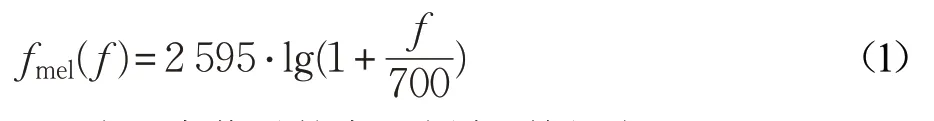

MFCC是Davis和Mermelstein于1980年提出來的,它基于人耳耳蝸和基底膜的特性,與實際頻率成非線性對應關系。

其中,f 為語音信號的實際頻率,單位為Hz。

近年來,基于譜的相關特征被廣泛地用于語音情感識別方法,文獻[19]提出了一種基于Mel 尺度濾波器并加以改進的語音情感識別方法,在用徑向基網絡作為分類器的基礎上,與傳統的MFCC 濾波器組比較,該方法的分類精度提高了6.3%。文獻[20]從心電圖中提取基于Mel-頻率倒譜系數對心臟類疾病進行自動分類,利用具有徑向核的支持向量機對時間和頻率倒譜系數特征進行分析,得到了最佳的結果。文獻[21]利用MFCC技術對說話者的快樂、悲傷和憤怒這三種情緒進行測試,測試效率為80%。語譜圖充分利用了語音信號中的低頻信息,但存在高頻信息泄露,不能充分利用上下文幀間動態信息的問題。

2.3 音質特征

音質特征用于衡量語音的純凈度、清晰度和辨識度。主要包括帶寬[22]、共振峰頻率[23]、振幅擾動[24]等。文獻[25]為提高情感識別率,提取了18 個韻律參數和59個音質參數對5男5女的4種情感進行訓練和測試。音質參數對情感識別起著有效的補充作用,文獻[26]基于最小語音質量特征,采用ANN分類器分別對2 765份英語和2 240 份印地語中的7 種不同的情緒進行分類,得到了64.8%和83.3%的識別率,表明語音的音質特征是一種有效的情感特征參數。音質特征作為一種有效的情感特征參數,聲音質量的變化與語音情感的表達有著密切的聯系,但因特征參數維度較大而導致冗余信息干擾,無法準確獲取其聲門參數,仍需進一步估算。

除上述特征外,比較典型的還有基于Teager Enger算子(TEO)的特征和多模態融合特征等。TEO 能量算子是一個非線性算子,能夠跟蹤信號的瞬時能量,可以與基頻、共振峰特征相結合形成新的語音特征。文獻[27]將EMD 分解與Teager 能量算子相結合用于語音情感識別,采用SVM 分類器對不同語音語種的語音情感進行識別,取得了很好的識別結果。文獻[28]利用Teager-MFCC(T-MFCC)特征提取技術從語音信號中識別出被強調的情緒,使用高斯混合模型對這些不同的強調情緒進行分類,與MFCC 特征提取技術相比,該方法具有更好的性能。目前,單模態情感識別具有識別率低、穩定性差等局限性。基于此問題,“多模態”這一概念于1997年被Bigün等人提出[29],并被成功地運用到情感識別領域。多模態融合的目的是通過對多種特征進行聚合,提高語音情感的識別率和魯棒性。文獻[30]為區分憤怒和開心這兩種語音情感,結合文本信息對這兩種情感進行識別,有效地解決了情感的誤判情況,提高了情感識別率。為提高傳統語音識別系統在噪聲環境下的準確性和性能,文獻[31]提出了一種新的、非傳統的多模態語音識別系統。多模態情感識別已經成為研究的熱點。

3 語音情感數據庫

語音情感數據庫作為情感特征提取與情感識別之間的關鍵環節,是實現情感識別的前提。語音情感數據庫有按照獲取途徑、應用目的、語種差異、描述模型和語音的自然度等多種劃分標準,但至今國內外還未將標準進行統一。目前,比較受歡迎的劃分方法是按照情感描述模型將其劃分為離散情感模型和維度情感模型。

3.1 離散情感模型

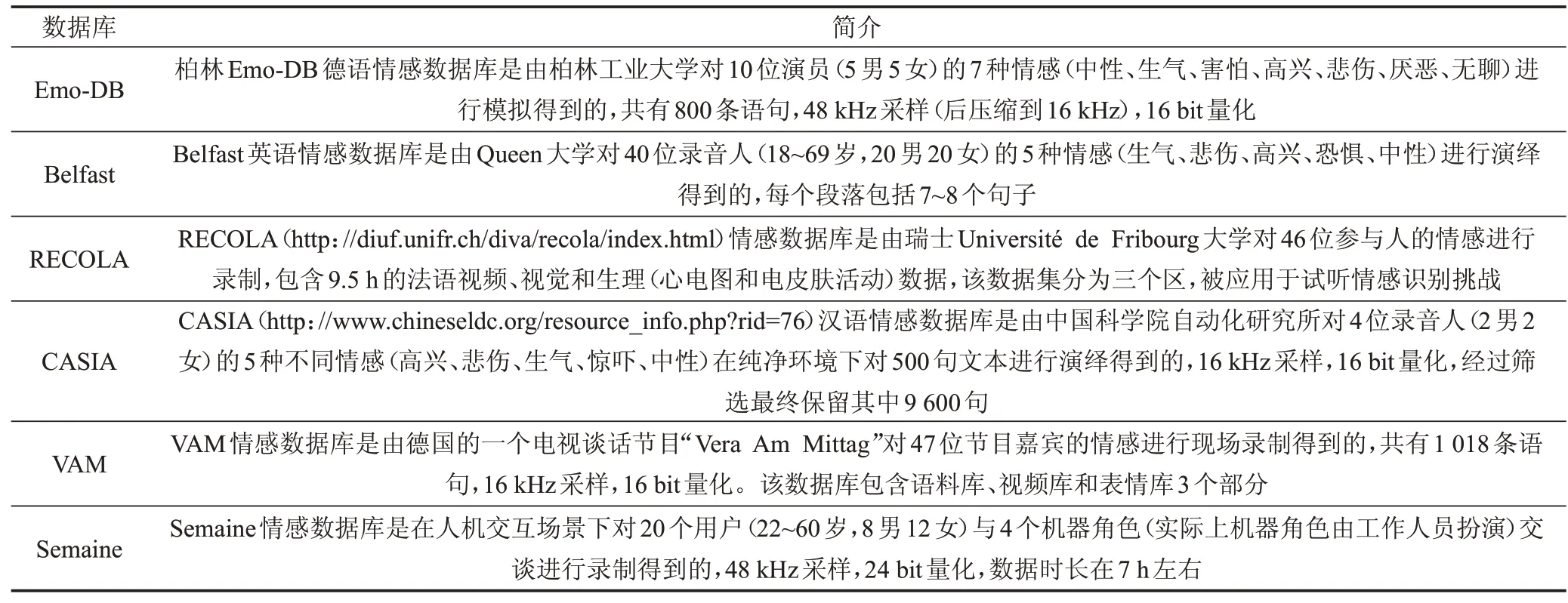

離散情感模型將情感定義為人們日常交互中常見的、離散的、特定的幾種基本情感。離散情感模型通過判斷相鄰兩幀數據或兩個不同時刻的情感變化來衡量情感的屬性。目前,離散情感數據庫主要有德語的Emo-DB[32]、英語的Belfast[33]、瑞士的RECOLA、漢語的CASIA等,如表1所示。

3.2 維度情感模型

維度情感模型將情感定義為連續情感空間中的不同坐標點,每一個空間維度都代表了不同的心理學屬性且其數值大小與其在相應維度上表現出的強度呈映射關系。維度情感模型根據維度的多少可以分別用向量和張量來表示,且不同情感狀態彼此間的相似度和差異性可以根據它們在空間中的距離來衡量。維度情感數據庫相對離散情感數據庫來說只占少數,目前存在的主要有VAM[34]、Semaine[35]等,如表1所示。

維度情感模型的代表性維度理論有一維情感模型、二維情感模型、三維情感模型和其他多維度情感模型。一維情感模型用一根實數軸來量化情感,正半軸表示快樂,負半軸表示不快樂。二維情感模型從極性和強度兩個維度區分情感,這種情感描述比較符合人們對客觀世界的基本看法。三維情感模型主要有PAD[36],其中PAD三維情感模型是當前受歡迎度較高的一種三維情感模型,能夠描述絕大多數的情感,其中P代表愉悅度,A代表喚醒度,D代表優勢度。對于多維情感模型主要有Izard四維模型、Krech四維模型和Frijda六維情感模型等。

表1 語音情感數據庫

3.3 離散-維度情感模型

離散情感模型和維度情感模型各有優劣,前者簡潔明確、容易上手,但描述能力有限;后者有更強的描述能力,但模型轉換的復雜度較高。基于此問題,為了探索離散情感模型與維度情感模型之間的聯系,文獻[37]建立了一種離散標簽與維度空間結合的漢語情感語音數據庫。該數據庫由16名說話人對文本語料進行表演錄制而得,5 376條語音樣本共包含7種情感。通過從情感的一致性、集中性、差異性以及情感識別率這四個方面來分析數據庫的情感質量。該數據庫的情感一致性較高,且情感之間具有較明顯的可區分性。

4 語音情感識別算法

語音情感識別一直是一個備受關注的研究領域。人類情感的表達是通過多種形式同時進行的,如通過脈搏、心率等難以觀測到的內在信息和語音、面部表情等易于自然觀測到的外在信息。情感計算理論的提出就是賦予計算機感知理解和表達情感的能力,以推動人機交互技術的進一步發展。情感識別算法作為語音情感識別系統中的關鍵一環,在整個系統中起著舉足輕重的作用。為提高語音情感識別的準確率和效率,科研人員在神經網絡發展(如圖1 所示)的基礎上提出了諸多優秀的算法并對其中的一些算法進行了改進。

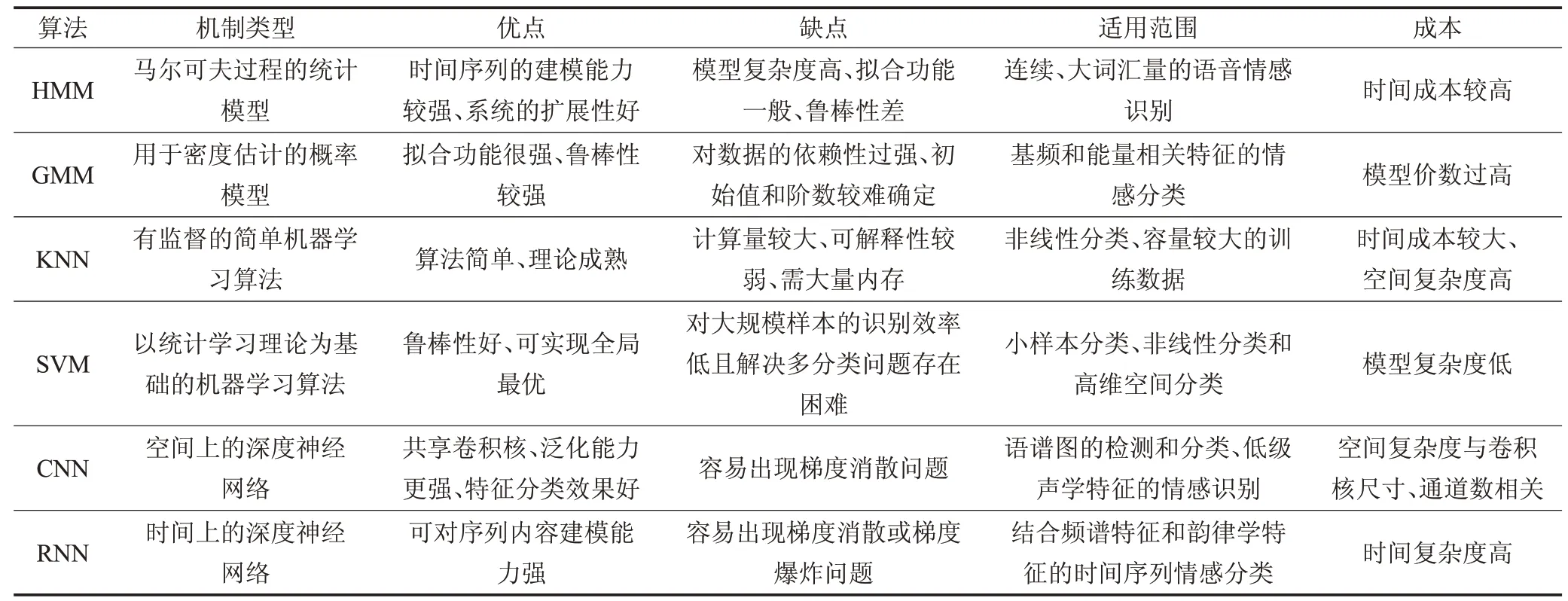

目前,語音情感識別算法根據模式識別分為模板匹配法、概率統計法和辨別分類器;還可劃分為以隱馬爾可夫模型[38](Hidden Markov Model,HMM)、高斯混合模型[39](Gaussian Mixed Model,GMM)和K 近鄰法[40](K-Nearst Neighbors,KNN)為代表的基于統計的分類器和以人工神經網絡[41]、決策樹[42]和支持向量機[43](Support Vector Machine,SVM)為代表的基于判別的分類器。本文將分別從基于傳統機器學習算法和基于深度學習算法兩個方面對語音情感識別算法進行闡述,并且對不同類型的情感識別方法綜合性能進行了總結分析,如表2所示。

圖1 神經網絡的發展示意圖

表2 不同類型的情感識別方法綜合性能分析

HMM是用來描述一個含有未知參數的馬爾可夫過程的統計模型,創立于20 世紀70 年代,并在20 世紀80年代得到了傳播和發展,目前已成功地用于語音情感識別。HMM 適合于時序序列的識別且系統的擴展性好,只需對新樣本進行訓練,但HMM對語音情感數據的擬合功能一般,受音位信息的影響較大且對鄰近情感的區分性差。針對HMM 識別語音情感的缺陷,文獻[44]提出了一種改進的HMM/RBF混合模型識別方法,將神經預測器引入HMM 計算狀態觀察概率,使得HMM 能夠有效利用幀間信息。

GMM是一種將一個事物分解為若干的基于高斯概率密度函數來描述語音特征矢量的模型,該模型已經在語音識別等領域取得了巨大的成功。GMM的優點是對語音情感數據的擬合能力較高且其魯棒性高于HMM,缺點是模型的價數過高、對訓練數據的依賴性強。基于此缺點,文獻[45]提出一種基于改進GMM 模型的語音情感識別方法,通過用矢量量化誤差值取代傳統的輸出概率值來計算模型的得分,使得建模時所需訓練數據量減少,并且識別速度有所提高。

KNN是數據挖掘分類技術中最簡單的機器學習算法之一,其核心思想是如果一個樣本在特征空間中的k個最相鄰的樣本中的大多數屬于某一個類別,則該樣本也屬于這個類別且具有這個類別上樣本的特性。文獻[46]基于KNN 比較了四種不同加權函數對情感識別率的影響,最高識別率達到81.4%。KNN 算法易于實現,較符合語音情感數據的分布特性,對語音情感數據的擬合能力較高,但其計算量較大。

SVM于1964年被提出,在20世紀90年代后得到了迅速發展并衍生出一系列改進和擴展的算法。SVM是建立在結構風險最小化準則的基礎上對數據進行二元分類的廣義線性分類器,其決策邊界是對學習樣本求解的最大邊距超平面。SVM 適合于小樣本訓練集,對語音情感數據的擬合能力較高,能較好地解決局部值問題以實現全局最優,但SVM 在多分類問題中存在不足。文獻[47]提出一種自適應的SVM增量算法,有效解決了增量數據和大規模數據問題;文獻[48]提出的基于決策樹和改進SVM 混合模型有效地避免了無界泛化誤差、分類器數目多、受限優化等問題;文獻[49]提出一種基于典型相關性分析的改進模糊支持向量機算法,解決了語音特征參數對某類情感具有不確定性的問題。

隨著深度學習的發展,科研人員將更多的注意力轉移到直接從原始數據中自動學習最佳特征的研究中。深度學習分為監督學習、半監督學習和無監督學習。大多數情感識別算法都是基于監督學習,且其典型代表算法有深度神經網絡[50](Deep Neural Network,DNN)、卷積神經網絡[51](Convolutional Neural Network,CNN)和循環神經網絡[52](Recurrent Neural Network,RNN)等。

DNN 由機器學習的神經網絡發展而來,模仿人腦的機制來解釋數據,結構是含多隱層的多層感知器,是深度學習的基礎。深度神經網絡最早被應用在語音識別領域,近年來,隨著模式識別的發展,深度神經網絡在語音情感識別方面取得了巨大的突破,并且在情感識別領域衍生出許多新的DNN框架。

CNN 是一類包含卷積計算且具有稀疏連接、參數共享和相等表示特性的前饋神經網絡,能夠按其階層結構對輸入信息進行平移不變分類,是模式識別中應用最多、最成功的一種前饋神經網絡。CNN 的研究始于20世紀80 年代,最早被廣泛應用于圖像識別領域且取得了巨大的成功。21世紀后,隨著深度學習的迅速發展以及GPU 計算能力的提升,CNN 被廣泛應用于計算機視覺、模式識別等領域,現已延伸到語音識別領域對情感進行判別。CNN有很強的泛化能力、特征分類效果好,但其容易出現梯度消散問題。文獻[53]提出一種改進的CNN的語音情感識別方法,改進了CNN訓練過程中卷積核權值的更新算法,使卷積核權值的更新算法與迭代次數相關聯,提高了卷積神經網絡的表達能力。

RNN 的研究始于20 世紀80 到90 年代,并在21 世紀發展為深度學習算法之一,具有良好的記憶性和參數共享性。除此之外,RNN 對非線性特征學習時具有一定的優勢,在處理時序數據時比CNN 有更好的表達能力,但普通的RNN 隨著時間的延長可能會出現梯度消失問題。文獻[54]采用代價敏感交叉熵損失訓練的多任務深雙向長短期記憶RNN 對這些標簽進行聯合建模,證明了提出的方法在RECOLA 數據集上實現了有競爭力的純音頻性能,并為持續的情緒識別提供了一種替代方法。

5 語音情感識別的應用

語音情感識別是一門涉及數字信號處理、數理統計、計算機學科、神經科學、心理學以及情感學等多種學科融合交叉的新興領域。隨著人工智能的興起,語音情感識別技術取得了巨大的突破且被應用到多種領域,已經走進了人們的生活。

在教育領域[55],可以通過語音情感識別系統實時掌握學生的情感狀態,利用其對情感特有的分析辨別能力,實時分析系統接收到的學生回復,及時地了解和把握學生的真實情感狀態,從而迅速做出反饋并進行調整,大大增強了課堂效果和提高了學生的學習效率。例如,傳統的授課方式無法讓教師時刻了解學生的課堂狀態,而語音情感識別系統可以通過學生在課堂回答問題時的語音情感推斷出其處于積極、自信、消極或者緊張等情感狀態并將其進行情感分類,然后教師可針對其情感狀態進行一對一的情感互動,鼓勵并促進學生進行高效的學習。文獻[56]面向本科教育進行了一次語音情感識別實驗,結果表明語音情感識別有助于激發學生的學習興趣,加深學生對知識的理解并有助于開拓學生和科研工作者的思路。目前,騰訊、百度和科大訊飛等公司都將基于情感識別的智能化教育作為其未來發展方向之一。

在醫學領域[57],面對諸多醫患之間無法溝通交流的現象,語音情感識別系統發揮了極其重要的作用。當遇到情緒波動、抗拒交談或是精神受創、難以溝通的患者,語音情感識別系統將會迅速做出反應并分析患者此刻的心理狀態,與患者進行情感的互動,平復患者的情緒;對于獨自居家的老人,語音情感系統同樣會自動識別老人的情緒波動,與其進行有效地溝通,通過精神的慰藉和力所能及的幫助,盡量為老人們營造健康的生活環境。南通市腫瘤醫院[58]設計了一種基于語音分析的腫瘤病人心理情感的判斷系統,針對不同病人的不同心理特點進行不同的護理干預以促進腫瘤病人的身心健康恢復,同時也減輕了護理人員的工作負擔。文獻[59]針對心理咨詢和性格分析進行了語音情感研究,有助于專家及時給出性格分析結果和心理咨詢建議。由此可見,無論是病患還是老人,亦或是精神障礙患者等,語音情感識別的存在,在很大程度上改善了這些問題。

在服務領域[60],許多企業、平臺、商家等,為節約成本,很早便采用了人工客服的方式。普通的人工客服只會機械性、重復性地回答客戶的問題和需求,不能做到靈活變通,從而致使部分客戶產生抵觸的情緒,導致客源的損失。而語音情感識別將會對此采取針對性的分析,當監測出客戶情緒有負面波動時,則及時切換人工客服進行協調,有效地減少了客源損失量。同樣的,語音情感識別會在適當情況下提醒服務人員,幫助其調節情緒,諸如人工客服、出租車司機、導游等,在面對蠻橫無禮的服務對象時,情緒易產生較大的波動,語音情感識別的提醒和幫助會讓其在工作減少許多沖突,從而使服務人員盡快調整恢復情緒。例如通過問卷調查或者訪談的方式不僅耗費大量的人力物力而且不一定能恢復顧客的滿意度,文獻[61]設計了一種情感服務交互系統,通過與顧客的交談及時判斷出顧客的情感狀態并及時作出適當的多元化的服務補救措施以提高客戶對服務的滿意度。除上述領域外,語音情感識別在智能娛樂[62]、電子商務[63]、汽車駕駛[64]、輔助測謊[65]和人機交互[66]等應用程序非常重要。

6 語音情感識別的挑戰

語音情感識別技術在社會發展的浪潮中不斷前行,人工智能的發展帶動著語音情感識別逐步達到更高的水平,然而同其他高端科技一樣,在到達一定階段后,語音情感識別終究是迎來了技術的“瓶頸期”。從語音情感識別的預處理階段到特征提取階段,再到情感識別階段,每個階段都面臨著一些全新的挑戰。

在預處理階段,語音情感識別系統的數據采集系統還不夠完善,帶有噪聲的語音信號會極大地改變聲學特征的分布規律且無法長期精準地對情緒狀態進行追蹤,不同性別、不同年齡的說話者以及不同的采集方式帶來的聲學變異均會對特征選擇的結果造成一定的影響。人類的情感是通過多種形式同時進行的,單模態的數據采集會影響最終的情感識別率,而多模態的數據采集又會造成維度的“爆炸式”增長,對下一步的特征提取帶來麻煩。

在特征提取階段,語音信號中含有豐富的情感信息,目前還不清楚什么種類的特征對情感的差異性最具有區分性且特征提取手段極其局限;其次,無法找到與識別目標有明確相關的、深層次的情感特征;此外,由于不同國家的文化和語言特色的差異等,情感的表達特征也不盡相同,對于樣本較少的數據集,其提取到的特征數量有限,最終導致無法達到滿意的識別效果。

在情感識別階段,同樣無法明確地找到有效的情感識別方法。除了缺乏統一規范的漢語情感語料庫,如何有效地對語言障礙、方言障礙以及遠程通話中的語音情感進行識別也是情感識別領域面臨的一大挑戰,當被觀察者意識到自己正在接受語音情感識別的實驗時,往往會因為各種因素或隱私問題,刻意調整或試圖抑制自己的真實情緒,從而在一定程度上影響識別的真實有效性。除此之外,隨著深度學習的廣泛應用,如何利用該方法對語音情感進行更加精準、系統的識別,將成為研究人員又一大關注要點和需要攻克的難題。除上面所述,缺乏一個統一、權威的語音情感數據庫的建設標準也是人機交互領域面臨的一大難題。

7 研究展望

語音情感識別經過幾十年的發展已經取得了長足的發展,但距離真正的自然人機交互還有很長的路要走。首先是高質量情感語料庫的缺乏。截止目前雖有不少語料庫被建立,但它們往往局限于某種單一語言且數量較少,并且由于情感本身的復雜性,這些語料往往質量不高。但眾所周知,一個質量和數量兼備的語料庫是語言情感識別技術研究必不可少的基礎。由此可見,無論語言情感識別技術向何處發展,建立一個經過系統整合、內容豐富且高質量的語料庫是必然要求。其次是情感識別建模的問題。由于語言符號和語言思維之間具有一種天然的不對稱性,建立一個高效合理的語言情感識別模型是研究的重點。這個模型以語料庫為基礎進行大數據式的訓練,建立一種聯通聲學特征和情感狀態的映射通路,進而實現對語料情感狀態的判斷和識別。但是由于情感的復雜性,人類對大腦的情感處理機制認識有限,尚未有一種高效可靠的情感識別模型被建立[67-69]。因而,腦學科和計算機的交融研究也就成為一種必然趨勢,沒有對人腦的高度認識就不可能有高效的情感識別建模。總之,建立系統高質量的語料庫和可靠的情感識別模式是未來語音情感識別發展的必然方向。