基于多樣化結構的輕量型卷積神經網絡設計

魏書偉 曾上游 潘兵 王新嬌

摘 ?要: 傳統的卷積神經網絡的網絡結構單一或模塊單一,網絡提取特征時都是以同一種模式持續進行,導致分類精度不夠理想,且模型參數和計算量較大。針對這一問題,提出一種使用多樣化模塊的輕量型卷積神經網絡結構Diverse?net,使用Reduce Module和Slice Module兩種卷積模塊,通過交替疊加使用兩種不同的卷積模塊來代替傳統網絡的單卷積核結構,增加網絡的深度和寬度,并在不同模塊之間加入殘差學習。使用文中搭建的卷積神經網絡Diverse?net,與其他網絡模型在GTSRB和101_food數據集上進行測試來對比網絡性能與模型大小,Diverse?net網絡模型大小減少至20.8 MB,在數據集GTSRB上識別率可達到98.72%;在數據集101_food上識別率可達到68.09%。實驗結果表明,所設計的卷積神經網絡Diverse?net在圖像分類方面性能更優,且網絡的模型較小。

關鍵詞: 卷積神經網絡; 多樣化結構; 殘差學習; 圖像預處理; 圖像分類; 測試分析

中圖分類號: TN926?34; TP391.4 ? ? ? ? ? ? ? ? 文獻標識碼: A ? ? ? ? ? ? ? ? ? ? ?文章編號: 1004?373X(2020)12?0050?05

Abstract: The network structure or module of the traditional convolution neural network is single, and the features extraction by the network is carried out in a same mode continuously, resulting in the undesirable classification accuracy and a large amount of model parameters and computations. Therefore, a lightweight convolution neural network structure Diverse?net with diversified modules is proposed, in which the two kinds of convolution modules of Reduce Module and Slice Module are used to replace the single convolution kernel structure of the traditional network by means of the alternating superposition, which increase the depth and width of the network, and add the residual learning between different modules. The convolution neural network (Diverse?net) constructed in this paper and other network models were tested on GTSRB and 101_food datasets to compare their network performances and model sizes. The Diverse?net network model is reduced to 20.8 M, and the recognition rate can reach 98.72% on GTSRB dataset, and 68.09% on 101_food dataset. The experimental results show that the designed convolutional neural network Diverse?net has better performance in image classification and smaller network model.

Keywords: convolution neural network; diversified structure; residual learning; image preprocessing; image classification; testing analysis

0 ?引 ?言

Hinton自2006年提出深度學習[1]的概念以來,深度學習已成為人工智能研究的熱點,它打破了人工智能領域發展長期停滯不前的局面,計算機硬件性能的提高和大數據時代的到來也為深度學習的發展奠定了良好的基礎。相比于傳統算法,深度學習算法在自然語言處理和圖像識別分類等方面逐漸表現出強烈的優勢,現已成為人工智能領域的頂尖算法。由深度學習引發的新一代“工業革命”,將會提高人們的生活水平和質量,改變人們的出行等生活方式,研究者已經在自動駕駛、實時語音處理等多個方面取得了重大突破,對人工智能的研究進入了一個新的階段。

卷積神經網絡(CNN)[2]是深度學習算法中重要的一部分,發展到現在為止,各種優秀的模型先后被提出,其中比較有代表性的模型為VGG[3],GoogLeNet[4],ResNet[5] 。但是這些網絡的結構或者網絡模塊比較單一,在這種情況下,網絡提取特征時都是以同一模式持續進行。故在淺層的深度卷積神經網絡中很可能沒有提取到較好的特征,而且卷積神經網絡模型一直在追求識別的成功率,隨著網絡的發展,識別精度不斷被提升,參數量也越來越多,但是龐大的網絡結構需要學習更多的參數,容易造成過擬合現象[6]。此外,網絡結構增大對網絡訓練也會造成一定困難,網絡訓練的效率較低,對計算機硬件要求過高,網絡也難以移植,如何在保證識別精度的情況下,設計輕量化的模型已成為亟待解決的問題。

本文針對于這一問題,提出一種多樣化模塊的輕量型卷積神經網絡架構Diverse?net,結合Reduce Module和Slice Module兩種卷積模塊,使用1×1卷積操作使得兩種降維模塊的首尾完美結合,網絡末端使用全局均值池化(Global Avepool)替代傳統網絡結構的全連接層,有效地降低了網絡參數,這種多樣化的輕量型的神經網絡架構可以在容量有限的硬件上運行。

1 ?基于多樣化結構的輕量型卷積神經網絡模型

1.1 ?Reduce Module

傳統的卷積神經網絡采用單條卷積層和下采樣層交替堆疊而成的模式,對特征圖進行特征提取,網絡復雜度、模型參數和計算量較大,且卷積操作只有一條通道,提取的圖像特征不充分。圖1為標準的卷積結構。

Reduce Module結構如圖2所示,其基本思路是將一個卷積層分為降維層和采樣層兩部分,并在每層后面加入了ReLu激活層[7]。降維層采用S個1×1 大小的卷積核將輸入特征圖的通道數量降低到S。采樣層使用兩組卷積通道(G1和G2)提取特征,G1使用S個3×3卷積核進行卷積;G2采用兩層3×3卷積進行卷積操作,每層3×3卷積層的卷積核個數均為S。

Reduce Module與傳統的3×3卷積結構相比參數減小,在輸入和輸出均為128張特征圖時,傳統的3×3卷積結構參數為128×3×3×128=147 456,Reduce Module的參數則為128×1×1×64+64×3×3×64+64×3×3×64+64×3×3× 64=118 784。在參數量減小的情況下,本文Reduce Module同時使用兩種尺度卷積核采樣,增加了提取特征的多樣性。

1.2 ?Slice Module

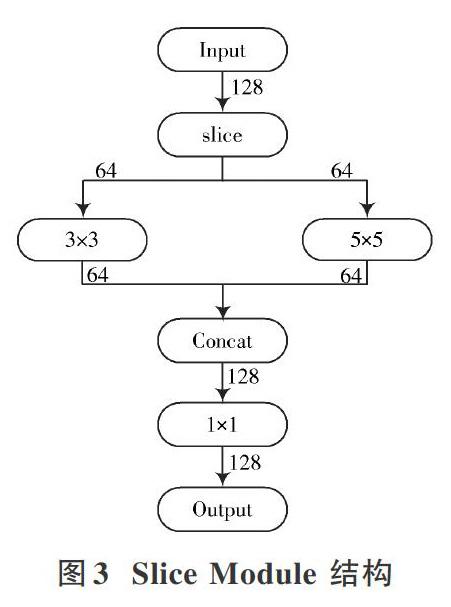

Slice Module[8]核心思想是將輸入的特征圖切分為兩部分,分別輸送給兩條卷積核大小不同的網絡支路進行卷積操作來提取特征,再經過特征圖級聯操作concat將兩條支路提取到的特征信息進行融合,最后再經過1×1卷積核整合特征圖并增加網絡的深度,同時也減少了下一級網絡輸入的參數,如圖3所示。Slice Module將輸入的128張特征圖分為2組,每組為64張特征圖,分別經過3×3和5×5兩種不同大小的卷積核進行特征提取,又經過級聯操作整合為128張特征圖,再經過1×1卷積操作后輸出,對比傳統僅使用3×3卷積核結構的參數為128×3×3×128=147 456,Slice Module卷積結構參數為64×3×3×64+64×5×5×64+128×1×1×128=155 648,基本沒有什么變化,但是同時增加了網絡的寬度和深度,提高了網絡的識別性能。

1.3 ?殘差網絡ResNet

傳統的卷積神經網絡模型通過疊加卷積層來提高網絡深度,從而提高識別精度,但是重疊卷積層太多將會引起梯度離散等問題,在反向傳播時不能有效地將梯度更新到前面的網絡層,導致前網絡層參數不能及時更新。

殘差結構如圖4所示,設模型輸入為x,經過兩層計算后的輸出為F(x),整個結構經過計算的輸出H(x),即H(x)= F(x)+x,模型計算得到的輸出H(x)傳入到下一層作為下一層的輸入。在層級結構上增加一個短接結構后,使得網絡模型的訓練效果和速度都有很大的提升,而且不會給網絡額外增加參數,當網絡模型的層數加深時,這種短接結構可以很好地解決網絡性能退化問題。本文在Reduce Module和Slice Module之間增加殘差運算,使網絡在反向傳播過程中更好地把梯度傳輸到更淺的層次中。

1.4 ?整體網絡結構

Diverse?net的整體網絡結構如圖5所示,通過兩個模塊Reduce Module和Slice Module的交替使用并配合池化層的降維操作,淺層的特征使用最大池化(Maxpool)進行下采樣,這樣能盡量多地突出顯著特征,隨著特征提取的深入,網絡提取的圖片特征更加困難,此時采用均值池化(Avepool)進行下采樣,最后使用全局均值池化(Global Avepool)加普通卷積層代替傳統網絡的全連接層,且加入了Dropout層以防止過擬合現象發生。

池化層的操作經過多次試驗發現采用Max?Max?Max?Ave(Max指最大值池化,Ave指平均池化)架構效果較好,網絡架構清晰明了,易于擴展和推廣,全局平均層沒有任何參數,因此有利于網絡的輕量化和防止過擬合現象的發生。

2 ?實 ?驗

2.1 ?圖像數據集和預處理

本實驗數據集采用目前在圖像識別方面使用相當廣泛的101_food食物數據集以及GTSRB交通標志數據集。如圖6所示,101_food數據集包括了101類食物的圖像,每類食物1 000張圖像,共計101 000張圖像。此次實驗中,將訓練集和測試集按照3∶1的比例進行分配,則為75 750張訓練圖像和25 250張測試圖像。

如圖7所示,GTSRB是一個交通標志數據集,包含43類交通標志的圖像,共計51 831張圖像。其中,包含39 209張訓練集圖像,12 432張測試集圖像。在智能駕駛方面被廣泛使用,所有數據集的圖像均在自然環境下拍攝得到,有的圖像會出現視覺傾斜、局部遮擋、低分辨率、運動模糊等現象,所以識別率很難達到100%。

圖像預處理是訓練之前對所有圖片進行數據增強,進行歸一化和去均值等操作。首先將圖像的每個像素都減去訓練圖片的平均像素值,然后將所有圖像進行cropsize隨機裁剪操作,分別截取每張圖像的左上角、左下角、右上角、右下角以及中間區域,隨機裁剪區域的大小為227×227,最后再進行水平翻轉操作,使得數據集的數量擴增10倍。

2.2 ?實驗設置

1) 實驗環境。此次實驗選用 caffe深度學習框架[9]布置網絡結構,使用 i7?6700K處理器、Ubuntu 16.04操作系統以及1080Ti的GPU顯卡進行網絡訓練與測試。

2) 參數設置。實驗在GTSRB數據集上測試時,網絡的文件配置如下:初始學習率learning rate設置為0.005,選擇使用multistep的變化方式來逐步改變學習率的大小,gamma為0.1,stepvalue設置為24 000和48 000,表示當達到這兩個迭代次數時學習率減小為原來的[110],最大迭代次數為60 000,網絡每迭代500次測試一次當前的網絡性能。在101_food數據集上測試時,除了最大迭代次數設置變為150 000和stepvalue參數設置為40 000,80 000和120 000,其余參數都和在GTSRB數據集上的配置保持一致。

2.3 ?實驗結果及分析

實驗測評采用本文Diverse?net網絡、同等深度的傳統卷積神經網絡Tra?Net和其他已發表的識別方法,在GTSRB以及101_food數據集上測試其識別性能,結果如表1所示。圖8給出了Diverse?net和Tra?Net兩種網絡在101_food訓練時測試精度的變化曲線,當達到設置的最大迭代次數15 000時,Diverse?net識別精度依然明顯高于其他方法。與傳統卷積神經網絡Tra?Net相比,Diverse?net網絡模型規模大幅度下降,且模型識別準確率提升了約12%,與其他已發表的網絡相比,Diverse?net都呈現出識別精度提高、網絡模型減小的優勢。

圖9給出了Diverse?net和Tra?Net兩種網絡在GTSRB數據集上訓練時測試精度的變化曲線。由表2和圖9可知,當達到設置的最大迭代次數60 000次時,采用Diverse?net網絡的識別精度提升到98.72%,優于其他識別方法,且網絡模型參數相比傳統網絡減少至20.1 MB。

從實驗結果可以看出,Diverse?net網絡在網絡模型較小的情況下,相比傳統卷積神經網絡Tra?Net和其他已發表的識別方法,均在兩個數據集上提高了分類精度;并且Diverse?net識別性能更優,模型較為輕量化。綜合兩個對比實驗可知:

1) Reduce Module和Slice Module交替聯合使用能有效地提升網絡性能并控制模型大小。

2) 雙通道的特征提取對整體識別率是有貢獻的。

3) 1×1卷積層的降維操作,可以有效控制網絡參數。

4) 使用全局均值池化代替傳統的全連接層可以有效地減少網絡參數。

3 ?結 ?語

本文采用Reduce Module和Slice Module兩種卷積模塊,通過交替疊加使用兩種不同的卷積模塊來代替傳統網絡的卷積模塊,設計一種使用多樣化模塊的輕量型卷積神經網絡結構Diverse?net,使用1×1卷積,增加網絡的深度和寬度,并在不同模塊之間加入了殘差學習,使用全局均值池化代替傳統的全連接層,有效地減少了網絡參數,輕量化了網絡。

雖然多樣化網絡的性能優越,但是在本文的實驗中未測試其他類型模塊疊加后的性能,由于在汲取其他網絡模塊優點的同時也有可能將其缺點也接納過來,所以在采用不同網絡模塊時應考慮其他因素對網絡的整體影響,取其精華,去其糟粕。后面的工作是在本文中Diverse?net上繼續改進,進一步測試Diverse?net在其他領域中的表現,例如目標檢測,圖像分割等,并在更大規模的數據集上進行測試和優化來比較網絡的性能優劣,進一步提升網絡性能,減少模型大小。

參考文獻

[1] HINTON G E. Reducing the dimensionality of data with neural networks [J]. Science, 2006, 313: 504.

[2] HAYKIN S, KOSKO B. Gradientbased learning applied to document recognition [M]// HAYKIN S, KOSKO B. Intelligent signal processing. Ottawa: Wiley?IEEE Press, 2001: 306?351.

[3] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large?scale image recognition [J]. Computer science, 2014, 12: 1?14.

[4] SZEGEDY C, LIU W, JIA Y Q, et al. Going deeper with convolutions [C]// IEEE Conference on Computer Vision and Pattern Recognition. Boston: IEEE, 2015: 1?9.

[5] HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition [C]// IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016: 770?778.

[6] 張順,龔怡宏,王進軍.深度卷積神經網絡的發展及其在計算機視覺領域的應用[J].計算機學報,2019,42(3):453?482.

[7] NAIR V, HINTON G E. Rectified linear units improve restricted Boltzmann machines Vinod Nair [C]// Proceedings of 2010 27th International Conference on Machine Learning. Haifa: DBLP, 2010: 17?21.

[8] 周悅,曾上游,楊遠飛,等.基于分組模塊的卷積神經網絡設計[J].微電子學與計算機,2019,36(2):68?72.

[9] JIA Y Q, SHELHAMER E, DONAHUE J, et al. Caffe: convolutional architecture for fast feature embedding [C]// 22nd ACM International Conference on Multimedia. New York: ACM, 2014: 675?678.

[10] BOSSARD L, GUILLAUMIN M, GOOL L V. Food?101?Mining discriminative components with random forests [C]// European Conference on Computer Vision. Zurich: Springer, 2014: 446?461.

[11] JAHANI H E, HABIB A H, PUIG D. An optimized convolutional neural network with bottleneck and spatial pyramid pooling layers for classification of foods [J]. Pattern recognition letters, 2018, 105: 50?58.

[12] 徐彬森,魏元周,毛光明,等.交通標志識別算法模型的研究與實現[J].軟件,2017,38(11):74?81.

[13] 韓偉,劉磊,馬偉東,等.基于極坐標分區LBP的交通標志識別方法[J].湘潭大學自科學報,2017(4):92?94.

[14] 孫偉,杜宏吉,張小瑞,等.基于CNN多層特征和ELM的交通標志識別[J].電子科技大學學報,2018(3):343?349.