利用U-net網絡的高分遙感影像建筑提取方法

張浩然,趙江洪,張曉光

(1.北京建筑大學 測繪與城市空間信息學院,北京 102616;2.現代城市測繪國家測繪地理信息局重點實驗室,北京 102616;3.建筑遺產精細重構與健康監測北京市重點實驗室,北京 102616)

0 引言

建筑物是人們必不可少的生活和活動場所。運用遙感圖像進行建筑物的目標提取作為遙感影像分割的一個分支,一直是被研究的熱點[1-2]。

高分辨率光學遙感影像具有地理紋理信息豐富、成像光譜多,重訪時間短的特點[3]。在遙感科學中,分辨率對于一張遙感影像來說是一個非常重要的評判指標,它直接關系到影像的使用價值[4]。高分辨率遙感影像的問世為遙感技術在建筑物的提取應用上提供了更好的便利條件[5]。

傳統的遙感影像建筑物提取方法對于高分辨率遙感影像的分割,會存在圖像質量與算法效果2個方面的難題[6-7]。一方面,由于科技水平的迅速提高,建筑物的設計更加新奇,致使其形狀千姿百態,影像中的建筑物輪廓更加趨于不規則,更加復雜。顯然,傳統遙感影像因其較低的分辨率已經遠遠不能滿足對現代建筑物特征及細節的表達。然而,因高空間分辨率遙感影像的分辨率顯著提高,地物的細節信息、幾何結構與紋理特征的表達變得更加豐富、顯著,使得傳統遙感影像細節表達不足的問題迎刃而解。另一方面,分辨率的提升導致了數據量的成倍增加,對于算法的高效性也提出了新的難題。高分辨率遙感影像細節豐富,直接加大了類內混合像元及陰影等因素的影響,同類地物在影像上的形態與特征可能大相徑庭;再加上建筑物和各色道路、公園、停車場等設施通常分布緊密,使得高分辨率遙感影像雖然增大了目標地物的類內差異、減小了類間差異,但是“同物異譜,同譜異物”的現象卻變得更加普遍、明顯。因此,運用傳統遙感影像分類技術進行分類常常會導致提取精度過低、邊界不完整等問題。

基于像元的分類方法的前提是需要遙感影像擁有極其豐富的光譜信息,并且影像中地物需具有異類地物光譜差異較為明顯,而同類地物差異不大的特點才能保證分類的產品滿足遙感工作需要。因此基于像元的分類方法并不適用于光譜信息不足(波段較少),且“同物異譜,同譜異物”現象明顯的高分辨率遙感影像。若僅靠像元信息進行分類,忽略地物的紋理結構等信息,勢必會導致分類精度降低,分類邊緣不完整的結果。此外,基于像元的影像分類法運算速度較慢,且極易產生噪聲。這進一步證明了基于像元的傳統分類方法并不適用于高分辨率遙感影像的分割處理。效果如圖1所示。

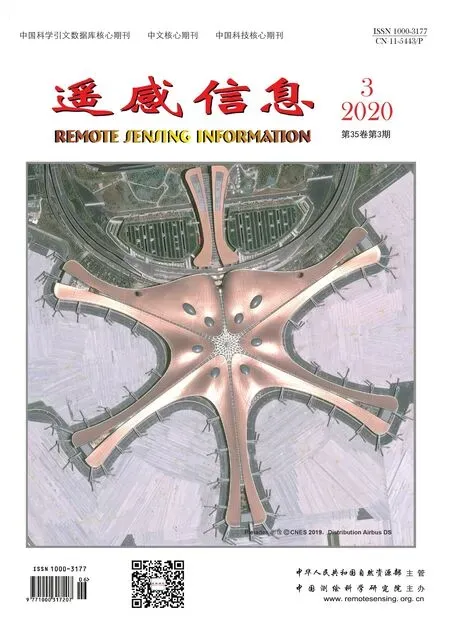

圖1 原始影像與最大似然分類法效果對比

圖1(b)為最大似然法對圖1(a)高分辨率遙感影像的分割效果,其中紅色部分為分割出的建筑物。從圖中的分割結果可以看出,建筑物與周邊地物混淆現象十分明顯。因此,基于像元的分類方法已無法適用于分割高分辨率遙感影像的工作。

面向對象分類方法中的關鍵是影像分割。較為廣泛使用的分割方法有區域分割法、多尺度分割法和基于紋理的分割法等。影像分割質量的優劣與分割方法及分割參數的選擇密不可分,這也直接決定了分割對象的形狀、數量等指標,進而對后續的分類結果產生影響。然而,目前并沒有一套通用的方法來確定分割參數。若將研究重點放在影像對象的特征表達上,越充分的特征表達就越需要人工的參與,如此一來就增加了分類的復雜程度。影像分類是利用分類器對提取的特征進行分類的步驟。較為有效的機器學習算法的分類過程中,只有有限的線性組合或非線性變換組合,不能充分學習特征向量的復雜結構信息,用于復雜、數據量大的樣本時會直接導致分類精度不高的問題。雖然也有如基于歸一化切割法(normalized cut,N-Cut)演變而來的Grab Cut算法仍被現代圖像處理工作使用,其作為一種迭代式語義分割算法,利用圖像中的紋理及顏色信息和邊界反差信息,運用少量的人機交互操作,即可得到前后背景分割效果。但該算法仍是根據圖像像素自身的低階視覺信息進行的圖像分割,沒有訓練過程,會導致在對較復雜的影像進行分割時,產生地物提取邊界不完整的問題[8],效果如圖2所示。

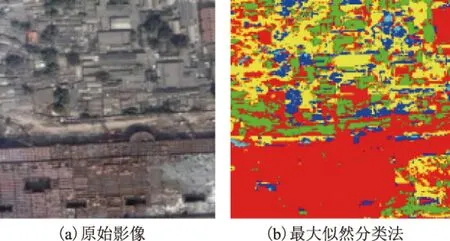

圖2 原始影像與Grab Cut法效果對比

圖2(b)為Grab Cut法對圖1(a)高分辨率遙感影像的分割效果,其中,彩色區域為被分割出的建筑物。Grab Cut法雖然可以僅介入少量的人工干預,利用圖像中的像元間差異提取建筑物,但從分割效果可以看出,其依然沒能擺脫周圍地物對分割效果的影響,分割效果仍不理想;且僅僅可以分割單一對象,雖可以通過編程解決多個對象的分割需求,但多個對象的分割就意味著更多人工的介入。因此可以得出結論,傳統的面向對象的分類方法也已經無法適用于高分辨率遙感影像的地物分割工作。

上述傳統建筑物目標提取方法中存在的問題充分說明,對于高分辨率光學遙感影像這種波段較少,分辨率高,地物類間、類內差距均易產生混淆的數據,處理的關鍵在于如何高效地表達、學習地物特征。因此,高分辨率遙感影像有必要采取更加高效、準確的方法進行分類。

深度學習是機器學習中一種基于數據表征的學習方法,數據可以使用多種方式來表示,如圖像中每個像素強度值的向量,或者成一系列邊、特定形狀的區域等可用更抽象的方式來表示[9]。深度學習的優勢是運用半監督式的特征學習和分層特征進行提取,用高效的算法來替代手工獲取的過程,節省了人力和時間,使得遙感高分辨率影像的處理變得更加高效。

深度學習中的卷積神經網絡(convolutional neural networks,CNN)[10]與全卷積網絡(fully convolutional networks,FCN)[11]分別存在會丟失像素位置信息,只能輸入固定圖像尺寸[12],跳躍層結構存在較少分割結果模糊、訓練耗時較長的問題。

U-net神經網絡是由FCN演變而來的一個語義分割網絡。其既考慮到了圖像的全局信息,又考慮到了圖片的細節信息,這使得建筑物分割工作的精度大大提升,通過將編碼器的每層結果拼接到譯碼器中以得到更好的分割結果。但由于U-net神經網絡采樣操作涉及反卷積層,雖可以將特征圖原始恢復,但影像中的建筑物特征也因此損失,造成了建筑物邊緣模糊的問題。

因此,本文引入了基于全連接條件隨機場(fully connected conditional random fields,CRFs)對U-net分割影像結果進行后處理。全連接CRFs模型以像元間關系作為參考,進一步優化分類結果,并消除攝影傾角導致的傾斜墻面影響。本文的技術路線如圖3所示。

圖3 本文技術路線

本文的重點研究內容在于:如何根據影像數據實現U-net神經網絡分割圖像及全連接CRFs處理模型進行分割后處理,并根據實驗通過更改輸入數據及調試參數等操作嘗試優化分割效果。

1 利用U-net神經網絡的高分辨率光學遙感影像建筑物提取

深度學習采用多個層次對來構成神經網絡。組成包括輸入層、隱含層、輸出層的多層網絡系統,具有優異的特征學習能力[13]。此外,基于深度學習的處理方法在模型結構上往往有多層隱層節點,相比傳統的分類方法更注重于模型結構的深度;在分類思路上,深度學習更是把特征表示存儲到一個新的空間,通過逐層變換特征使得分類更加容易實現。

1.1 實現U-net神經網絡

U-net是一個沒有全連接層的全卷積神經網絡,其輸入和輸出均為圖像[14]。U-net神經網絡是一種編碼器-譯碼器結構,只需一次訓練就可以達到很好的分割效果,且因其延用了FCN的“淺層定位,深層分割”的特點,可以保證像素位置信息不丟失。U-net共有23 個卷積層,包括3像素×3像素特征提取卷積、上采樣2像素×2像素卷積,及最終的映射1像素×1像素卷積,其處理流程如圖4所示。

圖4 U-net處理流程

本文采用的U-net模型沿用了與原作相同的結構、核函數尺寸和激活函數的卷積層。程序中所涉及的keras庫是基于Thrano和TensorFlow演變而來的深度學習庫,具有高度模塊化和可擴充性等特點,不僅支持簡易和快速的程序設計,而且支持CNN及其衍生網絡的實現,且keras庫可以實現CPU與GPU的無縫切換。運用GPU的高速圖像運算能力,進一步提升U-net神經網絡的運行速度。

1.2 樣本集大小對分割效果的影響

采用keras庫中的fit_generator函數來進行數據增強。本文嘗試了不同的訓練樣本增強參數,通過生成不同數量的增強訓練樣本,來測試樣本集的大小對U-net神經網絡分割效果的影響。

摘取幾組測試效果,如表1所示(效果圖中的紅色邊框為原始影像中實際建筑物分布情況)。從圖中可以發現,當生成的增強圖像過少時,分割效果由于過擬合的影響,受陰影和地面影響較大,導致建筑物的分割邊界不明顯;但當生成的增強圖像過多時,又導致過度分割,造成實際建筑物以外的地物也被分割成建筑物,降低了分割精準度。可以發現,當生成1 000×2張增強圖像(實際生成1 011×2張)并輸入至U-net神經網絡時,可以較為精準地分割出建筑物,且可以得到清晰的建筑物邊緣,如表1所示。

表1 對于不同增強樣本量U-net網絡分割效果

1.3 實現全連接CRFs后處理模型

全連接CRFs模型通過結合所有像素之間的關系,將相鄰像元之間進行全連接建模,引入像元顏色信息作為參考依據,并根據U-net分割的結果計算像元歸類概率。將計算概率分布圖作為一元勢能,即對每一個像素進行分類評估,并計算歸類概率。與此同時,輸入原始影像提供位置信息及色彩信息作為二元勢能,最終使得預測類的類別能量縮小至最小值,以達到最終的優化結果。其處理流程如圖5所示。

圖5 全連接CRFs模型處理過程

1.4 推理次數對全連接 CRFs模型的影響

全連接 CRFs模型中最重要的一步就是運用inference函數進行推理運算得到能量函數的數值,每增加一次推算都會將能量縮小,使分割結果更加貼近真實地物的色彩信息。然而,建筑物的色彩信息雖然可以提升建筑物的邊緣分割效果,但推算過度也很有可能導致分割結果因色彩信息干擾變大,從而造成過度分類的情況發生。

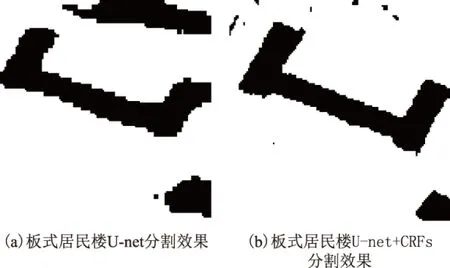

本文分別實現了從0 次推算到7 次推算的實驗,以板式居民樓的分割優化情況為例,效果如圖6、圖7所示。

圖6 原圖、推算0~1次優化效果對比

圖7 推算2~4次優化效果對比

至此,可以發現經過4 次推算已經可以達到較好的后處理效果,除U形樓的色彩信息較為復雜,南側分割效果較差以外,已經根據一定量的色彩信息優化了邊界的分割,較好地完成了分割后處理操作。

圖8為經過5~7 次推算的優化效果。可以發現,圖像受到了較多色彩信息影響而產生了過度分割的效果。

圖8 推算5~7次優化效果對比

因此,本文采用4 次推算的全連接CRFs模型對U-net神經網絡進行優化,以取得最佳后處理效果。

2 實驗及分析

綜上所述,本文采用基于U-net神經網絡的高分辨率光學遙感影像建筑物提取方法對建筑物進行分割。其總數據庫為121張512像素×512像素的高分辨率遙感影像,按照3∶1的比率將其分為訓練集和測試集,并在輸入U-net前進行數據增強,通過進行圖像扭曲,將數據集(包括圖像數據及標記數據)擴充至1 011×2張。本文的實驗結果證實了本方法,實現了建筑物的精確分割。

2.1 準備實驗

本文所使用的原始影像圖幅像素尺寸為3 072像素×3 072像素。考慮到計算機實際狀況,若將該圖像直接輸入模型中進行訓練會導致內存溢出。根據U-net網絡分割狀況以及實驗計算機的實際情況,采用像素尺寸為512像素×512像素的滑窗及相應步長,以保證滑窗之間在有重疊部分為前提下遍歷整幅影像,充分利用圖像中的特征信息。用上述思路將圖像裁剪輸出,從中選出含有建筑物的圖幅當做訓練樣本,并運用python中提供的labelme模塊標注樣本庫。

標注的過程中,由于攝影角度及遮擋等問題,建筑的底邊輪廓無法作為準確的識別特征。因此,本文以建筑物的屋頂作為采樣真值進行標注。

數據格式轉換也是非常重要的一步。由于原高分辨率遙感影像為標簽圖像文件格式(tag image file format,TIFF),支持24~256 色位圖像,但其文件過大,影響程序運行速度。無損壓縮的位圖圖形格式(portable network graphics,PNG)可以以很小的文件體積保存很多圖像細節,因此本文將TIF圖像文件格式轉換為PNG文件,在保證數據量的同時降低空間使用,以更高的效率進行數據分割。

由于在采集原始遙感影像數據時會存在來自傳感器、地形及大氣等影響,導致圖像像素明暗不均,容易影響結果輸出效果,所以需對訓練樣本庫進行輻射校正,包括輻射定標、大氣校正等操作,使得整張圖像更加清晰,明暗分布更加符合實際情況。

labelme建立的樣本庫文件的存儲格式json文件為列表以及字典格式數據,無法直接當作圖像文件輸入到U-net分割中。將json文件轉化為圖像文件的基本思路為:讀取json文件,提取json文件中點坐標信息;根據所屬圖幅、所屬多邊形進行存儲,建立與原始樣本等大的空白圖像文件;依據點坐標信息分圖幅、分圖形依次畫出掩膜,將掩膜以相應格式保存。其轉換流程如圖9所示。

圖9 json文件數據集轉換流程

2.2 運用數據增強擴充訓練數據集

由于數據集的數量與質量會直接影響到U-net神經網絡的分割效果,數量過少會導致網絡訓練過擬合,數量過多又會增加人工勞動成本,因此,將數據輸入U-net神經網絡之前,需要將訓練樣本集中的數據放入python的Image Data Generator函數中進行圖像增強。在增強的過程中,以每次運行2張的速率及256像素×256像素的圖像大小不斷產生基于原始影像及標注影像扭曲增強后的數據,防止過擬合及訓練過程過于耗時費力的問題。在此過程中,通過圖像扭曲將數據集圖像數量(包括圖像數據及標記數據)增強至1 011×2張,其中,包括圖像數據增強1 011張,標注數據增強1 011張。扭曲效果如圖10所示。

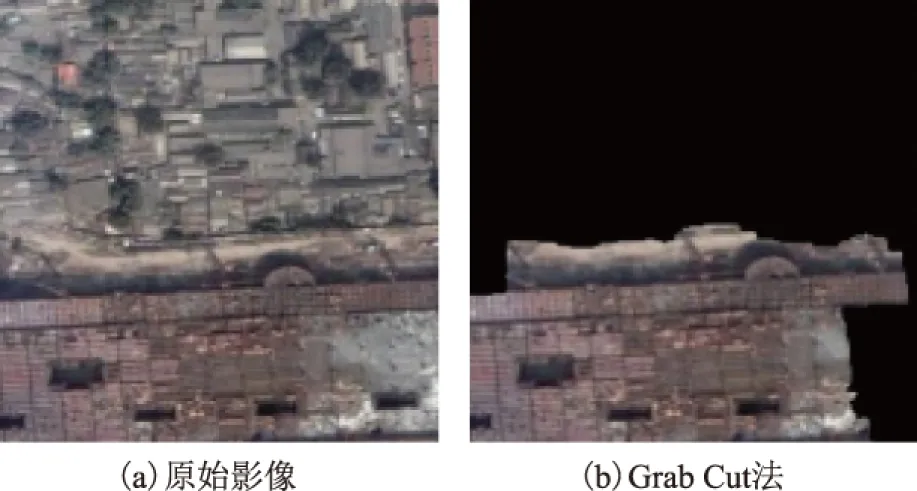

圖10 樣本扭曲效果

圖10展示了數據增強的方法,包括旋轉、縮小、放大及拉伸。

2.3 運用U-net神經網絡進行影像分割處理

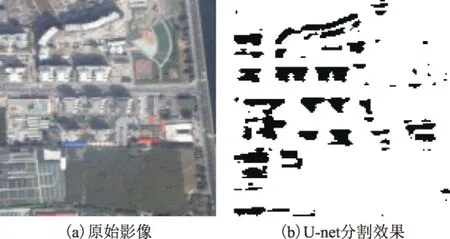

將訓練好的1 011×2張訓練集輸入至U-net神經網絡中,經上采樣及下采樣10 層卷積,完成特征提取工作。將30張測試集數據輸入網絡中進行分割,輸出相應的30張分割后影像。效果如圖11~圖14所示。可以發現,對建筑物分割效果仍存在分割邊界模糊的問題。

圖11 原始影像與U-net分割效果

圖12 板式居民樓分割效果

圖13 塔式居民樓分割效果

圖14 廠房分割效果

2.4 運用全連接CRFs模型進行影像分割結果后處理

針對U-net分割效果的不足,引入全連接CRFs模型進行分割結果優化后處理操作。全連接CRFs模型的輸入圖像格式應為:一張24 位的RGB彩色圖像,及一張24 位的掩膜圖像(通常可以為彩色,一個顏色代表一個類別。本文只對建筑物進行分割,因此只有一類掩膜代表建筑物)。

為U-net輸出的16 位分割圖像建立32位整數顏色矩陣映射,并計算出圖中類數(本文中為2類:背景及建筑物)。將映射矩陣作為一元勢能輸入,即圖像中的像元歸類概率。將原圖的坐標及顏色特征(x,y,r,g,b)作為二元勢能輸入,之后進行4 次推理,并找出每個像素最可能的類。效果如圖15~圖17所示。

圖15 板式居民樓分割效果

圖16 塔式居民樓分割效果

圖17 廠房分割效果

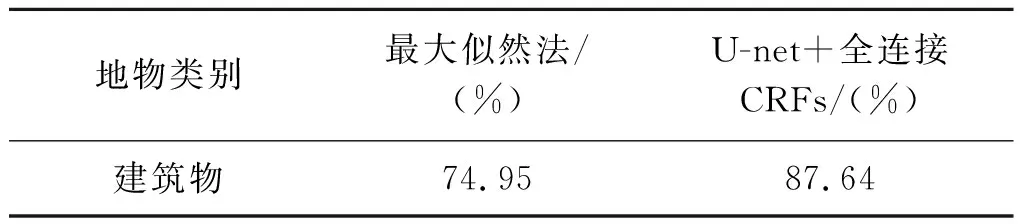

表2以板式居民樓、塔式居民樓以及廠房為例,展示了原始影像、傳統方法(以最大似然分類法為例)的分割效果、U-net神經網絡的分割效果與本文方法(U-net+全連接CRFs)的分割效果對比。

表2 原始影像與3種提取方法分割效果對比

2.5 分析精度

本文采用總體精度(overall accuracy,OA)對表2所示的結果進行分析。

表3展示了分別將2種方法與相應測試集中地物分布的對比分析結果。表中最大似然法的分割精度為直接與實際地物分布情況進行比對得出;本文方法的分割精度為分別對30張圖像的分割結果進行精度分析后,將每張圖的分割精度取平均得出。

表3 本文方法與最大似然法精度對比

本文的測試集為30張圖像(圖號從0~29),測試集的分割精度分布情況如圖18所示。

圖18 30張訓練樣本精度分布情況

通過分析數據結果可以得出,相比于傳統分割方法,本文的分割方法在高分辨率遙感影像的建筑物提取方面得到了極大的精度提升。充分表明了利用深度學習U-net神經網絡與全連接CRFs后處理模型的建筑物提取方法在高分辨率光學遙感影像建筑物語義分割方面的優勢。

3 結束語

對于傳統遙感影像的不足,本文從深度學習找到了突破口和解決方案,提出了基于深度學習的U-net神經網絡,通過調試圖像增強函數的參數找到了一種能使得本文數據達到最好分割效果的樣本增強量;并針對U-net神經網絡分割效果的不足,提出了基于全連接CRFs模型的優化方案,通過調試全連接CRFs模型的推算流程參數,以實現高效且精準的建筑物提取功能。

本文列出了相關的主要操作步驟,這些操作均有相應的程序及理論依據支持。本文的測試集均得到了很好的分割效果,平均總體精度達到了87.64%。

本文所涉及的地物為建筑物,其在城市規劃中是首要被考慮的因素。相對于運用傳統方法進行分割的效果和僅僅運用U-net神經網絡進行分割的效果,本文所提出的基于U-net神經網絡與全連接CRFs模型的語義分割方法雖然在耗時上均多于前2種方法,但其在分割精度上有了極大的提升,分割邊緣也更加清晰。

基于本文所運用到的核心方法以及實驗效果,提出2點展望。第一,本文雖運用了U-net神經網絡進對高分辨率遙感影像行了分割,但并沒有對原網絡的結構進行修改。高分辨率遙感影像若僅僅通過U-net神經網絡進行分割,會存在建筑物分割邊界模糊的問題。如何進一步優化U-net的模型結構,從而使之能更好地反映地物特征,并測試其是否能達到更好的分割精度將作為下一步研究的方向。第二,對于全連接CRFs模型推算次數較少會導致邊界分割效果較差,推算次數過多會受到圖像色彩信息影響的問題,可以繼續拓展思路。嘗試優化并運用其他后處理方法,如模糊聚類算法(fuzzy clustering methods,FCM)、馬爾科夫隨機場模型(Markov random field,MRF)等,或尋找一種可以識別邊界并基于邊界進行分割后處理的方法,以達到更精準的分割效果。