融合TLD框架的DSST實(shí)時(shí)目標(biāo)跟蹤改進(jìn)算法*

黃浩淼,張 江,張 晶,保峻嶸

(1.昆明理工大學(xué)信息工程與自動(dòng)化學(xué)院,云南 昆明 650500; 2.中國(guó)船舶集團(tuán)有限公司第七〇五研究所昆明分部,云南 昆明 650102;3.云南梟潤(rùn)科技服務(wù)有限公司,云南 昆明 650500; 4.昆明理工大學(xué)云南省人工智能重點(diǎn)實(shí)驗(yàn)室,云南 昆明 650500;5.云南省信息技術(shù)發(fā)展中心,云南 昆明 650228)

1 引言

目標(biāo)跟蹤在計(jì)算機(jī)視覺領(lǐng)域和信息物理融合系統(tǒng)(Cyber Physical Systems)的感知層中一直是研究的熱點(diǎn)。然而在快速移動(dòng)、目標(biāo)受到長(zhǎng)時(shí)間遮擋、背景雜亂等復(fù)雜場(chǎng)景下跟蹤結(jié)果仍然面臨很大的挑戰(zhàn)性。因此,眾多優(yōu)秀的判別式與生成式目標(biāo)跟蹤算法[1]相繼被推出,其中,相關(guān)濾波算法憑借速度快和循環(huán)采樣方式增加樣本豐富性,有效提高了跟蹤魯棒性和實(shí)時(shí)性,在近幾年受到研究者更多的關(guān)注。比如:引入循環(huán)矩陣和核概念的CSK(Circulant Structure of tracking-by-detection with Kernel)[2]算法,CSK通過循環(huán)對(duì)密集樣本目標(biāo)周圍的背景進(jìn)行采樣,然后分類器經(jīng)過核函數(shù)對(duì)循環(huán)移位的樣本進(jìn)行快速檢測(cè),提高跟蹤的速度。但是,由于目標(biāo)特征提取只選擇灰度特征,導(dǎo)致CSK算法在復(fù)雜情景下不能很好地表現(xiàn)目標(biāo)外觀模型,出現(xiàn)跟蹤失敗。CN算法(adaptive color attributes for real-time visual tracking)[3]根據(jù)目標(biāo)的表觀模型,經(jīng)過快速傅里葉變換與核映射得到多通道下的顏色特征信息,然后預(yù)測(cè)下一幀的目標(biāo)最大響應(yīng)位置,并使用PCA降維技術(shù)減少特征維度,提高算法的實(shí)時(shí)性,但也屏蔽了部分目標(biāo)信息,對(duì)于光照強(qiáng)度魯棒性較差。KCF(high-speed tracking with Kernelized Correlation Filters)[4]在CSK的基礎(chǔ)上,采用HOG多通道特征替換灰度特征,并通過高斯核函數(shù)簡(jiǎn)化循環(huán)矩陣傅里葉對(duì)角化計(jì)算,提高了算法的魯棒性,但對(duì)于目標(biāo)尺度發(fā)生變化的情況,容易跟蹤漂移。DSST(Discriminative Scale Space Tracking)[5]通過引入尺度濾波器,構(gòu)建33層金字塔特征向量,對(duì)目標(biāo)尺度變化進(jìn)行響應(yīng),解決目標(biāo)尺度變化問題的同時(shí)跟蹤精度也很高,但是在跟蹤快速運(yùn)動(dòng)目標(biāo)時(shí),跟蹤效果不佳。Nam等人[6]提出TCNN (Tree Convolutional Neural Network)方法,通過樹形結(jié)構(gòu)結(jié)合多個(gè)CNN來表示目標(biāo)的多種外觀模型,然后對(duì)每個(gè)模型的候選框加權(quán)平均得到目標(biāo)位置,從而適應(yīng)目標(biāo)的快速形變,但模型復(fù)雜,降低了跟蹤的實(shí)時(shí)性。Oron等人[7]提出一種對(duì)目標(biāo)區(qū)域分塊的跟蹤方法,首先對(duì)圖像目標(biāo)區(qū)域進(jìn)行分塊處理,根據(jù)像素匹配的相似性預(yù)測(cè)目標(biāo)的下一幀所在位置,提高跟蹤的精確度,但跟蹤速度很慢。火云蓮等人[8]提出一種融合多特征的相關(guān)濾波跟蹤算法,通過提取多種特征構(gòu)建目標(biāo)表觀模型,進(jìn)行降維后重新構(gòu)造特征矩陣并融合入相關(guān)濾波器,得到更精確的目標(biāo)跟蹤效果,但模型變得復(fù)雜,降低了跟蹤的實(shí)時(shí)性。陳晨等人[9]提出一種多模糊核融合的單目標(biāo)跟蹤算法,根據(jù)模糊理論改進(jìn)核函數(shù)的損失函數(shù),提高了算法在跟蹤過程中的實(shí)時(shí)性。張晶等人[10]提出一種TLD(Tracking-Learning-Detection)跟蹤框與STC(fast tracking via Spatio-Temporal Context learning)響應(yīng)位置進(jìn)行相似度聯(lián)合優(yōu)化的目標(biāo)跟蹤算法TLD-STCS,通過對(duì)上下幀圖像目標(biāo)區(qū)域相似性的判定,快速找到STC算法置信圖中置信度最大的輸出響應(yīng)值,從而得到合適的目標(biāo)框。

對(duì)于以上的相關(guān)濾波器算法在跟蹤快速運(yùn)動(dòng)目標(biāo)時(shí),濾波器都容易因?yàn)檫吔缧?yīng)導(dǎo)致跟蹤失敗,Kalal等人[11]提出了跟蹤與檢測(cè)結(jié)合的 TLD算法,該算法通過TLD檢測(cè)器篩除錯(cuò)誤樣本,避免了快速運(yùn)動(dòng)產(chǎn)生的邊界效應(yīng)影響,由一種正負(fù)樣本在線學(xué)習(xí)機(jī)制不斷優(yōu)化算法的魯棒性,但由于檢測(cè)器采用了整幀循環(huán)采樣矩形框,降低了算法的實(shí)時(shí)性。Danelljan等人[12]提出空間約束相關(guān)濾波器SRDCF(learning Spatially Regularized Correlation Filters for visual tracking),將正則化的權(quán)重系數(shù)加入濾波器,得到更大的檢測(cè)區(qū)域,從而改善邊界效應(yīng)中邊緣物體的檢測(cè),提高了目標(biāo)快速運(yùn)動(dòng)時(shí)的跟蹤魯棒性,但目標(biāo)完全遮擋時(shí)容易丟失目標(biāo)。Zhang等人[13]提出的快速壓縮跟蹤算法通過引入樸素貝葉斯函數(shù)改進(jìn)分類器,使得分類器能避免目標(biāo)區(qū)域中相似度高的背景干擾,提高對(duì)正負(fù)樣本的分類,但沒有考慮到目標(biāo)局部特征變化。Liu等人[14]提出一種前景劃分下的雙向?qū)?yōu)跟蹤方法BOTFP,通過將顏色屬性引入目標(biāo)表觀模型,然后對(duì)圖像進(jìn)行背景消除的方式解決目標(biāo)快速運(yùn)動(dòng)時(shí)特征容易丟失的問題,但目標(biāo)外觀變化時(shí)魯棒性較差。Wang等人[15]提出從圖像中提取目標(biāo)模型和背景的跟蹤方法,從圖像的置信圖中分離出目標(biāo)和背景,然后對(duì)模型中的目標(biāo)與背景同時(shí)訓(xùn)練并響應(yīng),有效地緩解了邊緣效應(yīng),但未達(dá)到實(shí)時(shí)跟蹤的效果。

在相關(guān)濾波算法中,DSST算法可以達(dá)到快速且更魯棒的跟蹤效果,但目標(biāo)快速運(yùn)動(dòng)時(shí)產(chǎn)生的邊界效應(yīng),使其不能準(zhǔn)確響應(yīng)目標(biāo)位置,從而導(dǎo)致跟蹤失敗。本文在文獻(xiàn)[5]的基礎(chǔ)上,首先使用較大尺寸的濾波器來檢測(cè)目標(biāo)區(qū)域,保留更多目標(biāo)信息,提高目標(biāo)外觀模型的可信度,在損失函數(shù)的系數(shù)上加入權(quán)重系數(shù)矩陣,對(duì)目標(biāo)檢測(cè)區(qū)域中心位置進(jìn)行集中響應(yīng),達(dá)到目標(biāo)的粗定位;目標(biāo)快速運(yùn)動(dòng)使濾波器對(duì)運(yùn)動(dòng)模型更新失敗,檢測(cè)器的在線學(xué)習(xí)機(jī)制可以重新找到目標(biāo),因此本文使用文獻(xiàn)[11]的檢測(cè)器來約束DSST算法濾波器的位置響應(yīng);目標(biāo)快速運(yùn)動(dòng)導(dǎo)致圖像模糊,產(chǎn)生邊界效應(yīng),為了減少檢測(cè)器采樣滑動(dòng)矩形框的誤差,在TLD檢測(cè)器中加入自適應(yīng)樸素貝葉斯分類器,通過分塊計(jì)算圖像特征得分,對(duì)檢測(cè)器產(chǎn)生的滑動(dòng)矩形框中背景信息與目標(biāo)進(jìn)行有效區(qū)分,得到更多包含目標(biāo)的滑動(dòng)矩形框;最后通過DSST的目標(biāo)響應(yīng)位置與TLD檢測(cè)器輸出的滑動(dòng)矩形框進(jìn)行最優(yōu)相似性匹配,平滑輸出響應(yīng),對(duì)目標(biāo)位置進(jìn)行精確定位。實(shí)驗(yàn)表明,本文算法在目標(biāo)快速運(yùn)動(dòng)情景中,通過對(duì)目標(biāo)區(qū)域中心進(jìn)行集中響應(yīng),并通過檢測(cè)器來約束濾波器的初始位置響應(yīng),提高了對(duì)目標(biāo)進(jìn)行定位的魯棒性。但是,TLD檢測(cè)器對(duì)圖像采用一種網(wǎng)格循環(huán)采樣矩形框的方法導(dǎo)致算法實(shí)時(shí)性不高。本文提出了使用DSST尺度濾波器獲得的目標(biāo)尺度對(duì)滑動(dòng)矩形框循環(huán)采樣,從而減少相關(guān)計(jì)算量,提高了算法的實(shí)時(shí)性。

2 DSST目標(biāo)跟蹤算法

DSST算法以上一幀目標(biāo)位置為中心提取S種不同尺度下的矩形樣本,然后把所有固定尺寸為M×N的樣本構(gòu)建成M×N×S的矩形圖像塊,并在這個(gè)尺寸下提取fhog特征,使用三維高斯函數(shù)構(gòu)建對(duì)應(yīng)的期望輸出g,經(jīng)過相關(guān)濾波器進(jìn)行迭代運(yùn)算,取矩形圖像塊響應(yīng)中的最大值,得到新位置和新尺度。相關(guān)濾波器使用2個(gè)相互獨(dú)立的濾波器,選擇不同維度的特征和特征種類來訓(xùn)練樣本,分別評(píng)估目標(biāo)的尺度和位置變化。

2.1 位置濾波器

首先利用二維高斯函數(shù)初始化目標(biāo)位置得到期望輸出g,以該目標(biāo)位置為中心構(gòu)建S個(gè)尺寸不同的矩形樣本,依據(jù)矩形樣本對(duì)圖像循環(huán)采集矩形圖像塊f,對(duì)圖像塊中每個(gè)像素點(diǎn)計(jì)算其一維灰度特征和27維fhog特征;將這些特征融合后乘以二維漢寧窗作為目標(biāo)位置預(yù)測(cè)輸入Z,根據(jù)濾波器響應(yīng)函數(shù)求得Z對(duì)應(yīng)的最大響應(yīng)值,即獲得目標(biāo)的新位置。為了構(gòu)造最佳的位置濾波器h,需要滿足代價(jià)函數(shù)最小:

(1)

其中,d=28為特征融合后的維度;at表示濾波器訓(xùn)練第t個(gè)矩形圖像塊的權(quán)重;上標(biāo)l表示特征的第l維;fl為矩形圖像塊第l維的特征;hl為矩形圖像塊第l維對(duì)應(yīng)的濾波器;g為樣本中目標(biāo)位置二維高斯函數(shù)輸出值;λ為正則項(xiàng)系數(shù),用于防止濾波器過擬合,樣本離目標(biāo)區(qū)域中心越遠(yuǎn),正則項(xiàng)的值越大,則訓(xùn)練濾波器影響越小。

然后利用Parseval定理將式(1)變換到頻域上求解。由于需要對(duì)矩形圖像塊中的每個(gè)像素點(diǎn)求解d×d維的線性方程,計(jì)算非常耗時(shí),為了加快算法運(yùn)行速度,得到魯棒的近似結(jié)果,使用式(2)對(duì)濾波器進(jìn)行更新:

(2)

(3)

(4)

其中,η為學(xué)習(xí)速率。在下一幀圖像中,目標(biāo)位置的定位可以通過求解位置濾波器的離散傅里葉逆變換最大響應(yīng)yt來確定,響應(yīng)函數(shù)表示如下:

(5)

2.2 尺度濾波器

位置濾波器得到目標(biāo)響應(yīng)位置后,通過一維高斯函數(shù)初始化目標(biāo)尺度得到期望輸出g。按照樣本尺度選擇原則得到包含目標(biāo)的矩形樣本,計(jì)算每個(gè)樣本中像素點(diǎn)的31維fhog特征,將樣本中提取的特征重構(gòu)為一個(gè)33層金字塔的特征向量,再乘以一維漢寧窗后作為目標(biāo)尺度預(yù)測(cè)輸入Z,根據(jù)濾波器響應(yīng)函數(shù)求得Z對(duì)應(yīng)的最大響應(yīng)值,即獲得目標(biāo)當(dāng)前的尺度。由于二維位置濾波器已經(jīng)確定P×R目標(biāo)區(qū)域的大小,再利用一維尺度濾波器評(píng)估目標(biāo)尺度。目標(biāo)樣本尺度的選擇原則為:

(6)

其中,P和R分別為目標(biāo)區(qū)域的寬和高,a=1.02為尺度因子,S=33是尺度濾波器的樣本尺度選擇層數(shù)。尺度濾波器評(píng)估目標(biāo)尺度為非線性增長(zhǎng)的指數(shù)函數(shù),可以達(dá)到接近目標(biāo)響應(yīng)位置的細(xì)檢測(cè)目的,得到更準(zhǔn)確的尺度評(píng)估結(jié)果。再根據(jù)式(5)求得尺度濾波器中最大響應(yīng)值,即可獲得目標(biāo)的尺度,然后根據(jù)式(3)和式(4)更新尺度信息。

3 改進(jìn)的目標(biāo)跟蹤算法

3.1 改進(jìn)的DSST位置濾波器

DSST算法的相關(guān)濾波器在訓(xùn)練響應(yīng)之前,依據(jù)構(gòu)建的矩形樣本對(duì)圖像循環(huán)采集矩形圖像塊f,但在目標(biāo)快速運(yùn)動(dòng)情景下,包含目標(biāo)邊緣的矩形圖像塊存在著位移邊界,導(dǎo)致濾波器不能準(zhǔn)確響應(yīng)目標(biāo)位置。文獻(xiàn)[16]通過構(gòu)建的矩形樣本加上余弦框,當(dāng)目標(biāo)處于搜索區(qū)域的邊界時(shí),弱化區(qū)域邊界背景對(duì)響應(yīng)的干擾,但這樣屏蔽背景信息,同時(shí)也弱化了目標(biāo)模型對(duì)物體信息的描述,導(dǎo)致跟蹤算法跟蹤失敗。本文使用較大尺寸的濾波器來檢測(cè)目標(biāo)區(qū)域,保留目標(biāo)更多的物體真實(shí)信息,不會(huì)忽略目標(biāo)邊緣處背景信息的檢測(cè)。由于循環(huán)采樣的矩形圖像塊中心位置不存在邊界位移問題,本文將相關(guān)濾波器的正則項(xiàng)系數(shù)λ乘以權(quán)重系數(shù)矩陣,使靠近目標(biāo)邊緣處的正則項(xiàng)系數(shù)更大,對(duì)濾波器響應(yīng)的影響更小,最后濾波器響應(yīng)集中在矩形圖像塊的中心區(qū)域,克服了邊界效應(yīng)。具體為通過一個(gè)M×N空間權(quán)重系數(shù)矩陣w來懲罰距離目標(biāo)中心比較遠(yuǎn)的矩形圖像塊。

(7)

當(dāng)目標(biāo)處的矩陣權(quán)重系數(shù)較小時(shí),背景處的矩陣權(quán)重系數(shù)較大,為了使濾波器關(guān)注目標(biāo)信息,背景處的濾波響應(yīng)結(jié)果應(yīng)當(dāng)盡量小,這是引入權(quán)重系數(shù)矩陣的目的。然后使用帕斯瓦爾定理將目標(biāo)函數(shù)變換到頻域:

(8)

(9)

其中,D(·)為對(duì)角化操作,C(·)為循環(huán)化操作。根據(jù)位置濾波器中傅里葉變換的共軛對(duì)稱特性,可以對(duì)求解過程進(jìn)行加速,因此將傅里葉變換后的實(shí)部與虛部合并為一個(gè)實(shí)數(shù),在保持2個(gè)矩陣相差結(jié)果不變的前提下,求解速度快了至少一倍。

對(duì)零頻Ω0、正頻Ω+、負(fù)頻Ω-的點(diǎn)分別將其實(shí)部和虛部的矩陣轉(zhuǎn)換為純實(shí)部數(shù)矩陣的方法,如式(10)所示:

(10)

然后對(duì)式(9)通過左乘同一變化稀疏酉矩陣B得到:

(11)

經(jīng)過向量化和塊對(duì)角化操作,將求和符號(hào)去掉簡(jiǎn)化得到改進(jìn)的濾波器,公式為:

(12)

3.2 自適應(yīng)目標(biāo)與背景區(qū)分TLD檢測(cè)器

TLD 跟蹤算法[11]由一種判別正負(fù)樣本的在線學(xué)習(xí)機(jī)制對(duì)目標(biāo)持續(xù)跟蹤,使用一對(duì)約束估計(jì)出檢測(cè)錯(cuò)誤,在因邊界效應(yīng)產(chǎn)生錯(cuò)誤樣本被有效篩除的過程中持續(xù)修正檢測(cè)器,跟蹤過程的魯棒性不斷增強(qiáng)。但是,檢測(cè)器根據(jù)設(shè)定的尺度步長(zhǎng),依次對(duì)每個(gè)視頻幀進(jìn)行全局掃描,生成大量的矩形框,這些矩形框占用了大量的計(jì)算資源,降低了檢測(cè)模塊的運(yùn)算速度。改進(jìn)的檢測(cè)器首先使用2.2節(jié)中規(guī)定的33種尺度進(jìn)行全局掃描得到矩形框,增加算法的實(shí)時(shí)性。并且為了加強(qiáng)檢測(cè)器對(duì)目標(biāo)與背景的區(qū)分能力,先對(duì)矩形框內(nèi)的圖像分塊提取特征,通過樸素貝葉斯分類器計(jì)算得分,得分高的即為輸出矩形框。針對(duì)目標(biāo)快速運(yùn)動(dòng)后導(dǎo)致圖像模糊,TLD檢測(cè)器對(duì)矩形框內(nèi)圖像塊中目標(biāo)信息進(jìn)行循環(huán)拼接,拼接過程中這些信息在拼接處并不是連續(xù)的,會(huì)產(chǎn)生邊界效應(yīng)。本文改進(jìn)的檢測(cè)器自適應(yīng)區(qū)分目標(biāo)與背景,能有效解決目標(biāo)信息在拼接處不連續(xù)的邊界效應(yīng)問題,提高檢測(cè)器的魯棒性。

Figure 1 Schematic of the improved detector圖1 改進(jìn)的檢測(cè)器示意圖

首先檢測(cè)器根據(jù)式(6)的尺度掃描產(chǎn)生n個(gè)滑動(dòng)矩形框,然后提取矩形框中目標(biāo)特征并將其代入到樸素貝葉斯分類器中,實(shí)現(xiàn)對(duì)背景信息和目標(biāo)的分類。假設(shè)正負(fù)樣本先驗(yàn)概率相同,則樸素貝葉斯分類器模型如下所示:

(13)

其中,fi為第i個(gè)矩形框;y∈{0,1}是二元變量,其值分別代表正負(fù)樣本標(biāo)簽。視頻跟蹤中目標(biāo)一般為不規(guī)則形狀,導(dǎo)致檢測(cè)器產(chǎn)生的矩形框中包含的背景信息較少,而邊緣處含有的背景信息較多,檢測(cè)器對(duì)矩形框樣本進(jìn)行分類將產(chǎn)生干擾。因此,本文提出依據(jù)網(wǎng)格均分采樣得到N×N共W塊圖像的目標(biāo)特征,從而弱化邊緣背景信息對(duì)矩形框內(nèi)特征的干擾;再將第k塊圖像的特征壓縮輸入到樸素貝葉斯分類器,計(jì)算每個(gè)圖像特征的得分,篩選出其中得分較大者,并根據(jù)距離目標(biāo)中心位置分配的權(quán)重值組成強(qiáng)檢測(cè)器。矩形框內(nèi)第k塊圖像距離矩形框中心位置越近,其圖像塊特征得分權(quán)重值越高,反之亦然,進(jìn)而弱化矩形框內(nèi)邊緣處圖像中包含的背景信息對(duì)檢測(cè)器分類的影響。第k塊圖像權(quán)重值公式如下所示:

k=1,…,W

(14)

其中,(lx,ly)為矩形框的中心位置坐標(biāo),(kx,ky)為網(wǎng)格均分中第k塊圖像的中心位置坐標(biāo)。將圖像權(quán)重值作為樸素貝葉斯分類器模型計(jì)算圖像特征得分的系數(shù),矩形框邊緣位置得到較小的圖像權(quán)重值,使圖像特征得分更低,從而弱化檢測(cè)器對(duì)矩形框分類時(shí)邊緣處背景信息的干擾。改進(jìn)后的自適應(yīng)加權(quán)樸素貝葉斯分類器模型如下所示:

(15)

其中,fki為矩形框第k塊圖像提取的第i個(gè)目標(biāo)特征。對(duì)矩形框內(nèi)網(wǎng)格均分得到的W塊圖像得分進(jìn)行加權(quán)求和,得分較大的矩形框即為跟蹤的目標(biāo)相似度高的滑動(dòng)矩形框,然后依次通過級(jí)聯(lián)分類器,將最終通過的矩形框聚類后作為檢測(cè)器輸出框。改進(jìn)的檢測(cè)器示意圖如圖1所示。

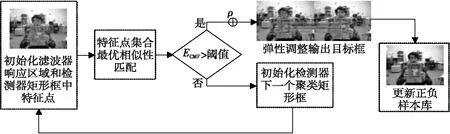

3.3 最優(yōu)相似性匹配

跟蹤過程中,檢測(cè)器通過級(jí)聯(lián)分類器產(chǎn)生大量聚類后的矩形框。本文通過圖像最優(yōu)相似性匹配關(guān)系得到與濾波器響應(yīng)的目標(biāo)位置最相似的矩形框,進(jìn)而平滑目標(biāo)位置的輸出響應(yīng)。利用該方法可約束初始響應(yīng)值,抑制跟蹤過程中的漂移現(xiàn)象。

首先對(duì)DSST響應(yīng)的目標(biāo)區(qū)域和TLD檢測(cè)器滑動(dòng)矩形框進(jìn)行初始化:Q={qj},j∈1,…,n;P={pi},i∈1,…,m,pi表示TLD檢測(cè)器矩形框內(nèi)第i個(gè)特征點(diǎn),qj表示DSST目標(biāo)響應(yīng)的區(qū)域內(nèi)第j個(gè)特征點(diǎn)。下一步,獲得跟蹤框中P與Q集合之間的特征點(diǎn)最優(yōu)匹配對(duì)。在匹配過程中,分別計(jì)算出集合Q中DSST響應(yīng)的目標(biāo)區(qū)域內(nèi)特征點(diǎn)qj與集合P中特征點(diǎn)的最近鄰匹配距離,若在P中得到的最優(yōu)匹配特征點(diǎn)為pi,則OMP(pi,qj,P,Q)為1,否則為0。

OMP(pi,qj,P,Q)=

(16)

其中,NN(pi,Q)=argmind(pi,qj)=argmin|pi-qj|2為最近鄰匹配距離。然后計(jì)算P與Q之間的最優(yōu)相似性匹配的期望:

(17)

其中,p(·)為概率分布函數(shù)。若期望大于設(shè)定閾值,則保留該匹配的矩形框,再通過權(quán)重比例系數(shù)ρ彈性調(diào)整輸出框中心位置:

XTLD-DSST=ρXTLD+(1-ρ)XDSST

(18)

其中,XTLD表示TLD檢測(cè)器矩形框的中心點(diǎn),XDSST表示DSST目標(biāo)響應(yīng)的位置中心點(diǎn)。TLD-DSST算法輸出目標(biāo)框調(diào)整過程如圖2所示。

Figure 2 TLD-DSST algorithm output target frame adjustment process diagram圖2 TLD-DSST算法輸出目標(biāo)框調(diào)整過程圖

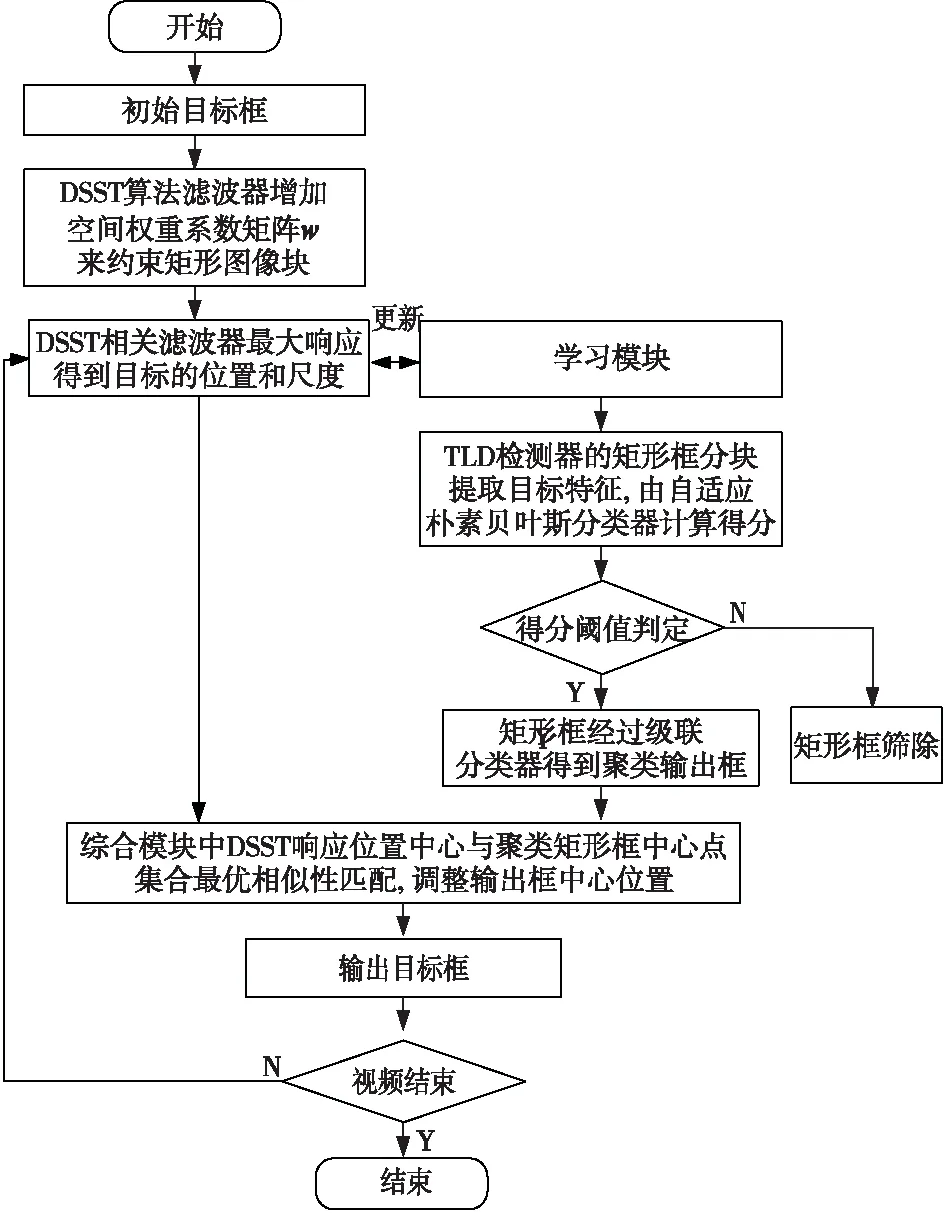

3.4 算法流程

TLD-DSST算法的流程如圖3所示。

Step1初始化目標(biāo)框。DSST算法濾波器根據(jù)3.1節(jié)增加空間權(quán)重系數(shù)矩陣w來調(diào)整距離目標(biāo)中心比較遠(yuǎn)的矩形圖像塊,對(duì)這些矩形圖像塊進(jìn)行濾波響應(yīng),最大響應(yīng)即為目標(biāo)位置和尺度。

Step2初始化TLD算法檢測(cè)器。檢測(cè)器按照DSST尺度濾波器的尺度循環(huán)采樣矩形框,并根據(jù)3.2節(jié)對(duì)矩形框進(jìn)行分塊提取目標(biāo)特征,經(jīng)由自適應(yīng)樸素貝葉斯分類器計(jì)算得分,篩除包含更多背景的矩形框;然后經(jīng)過三大級(jí)聯(lián)分類器的滑動(dòng)矩形框進(jìn)行相似度scbb和重疊度dbb計(jì)算;最后進(jìn)行聚類得到檢測(cè)器預(yù)測(cè)的矩形框集合。

Step3綜合模塊中DSST響應(yīng)的目標(biāo)位置中心點(diǎn)和TLD檢測(cè)器滑動(dòng)矩形框中心點(diǎn)集合進(jìn)行最優(yōu)相似性匹配,利用該關(guān)系約束初始響應(yīng)值,根據(jù)3.3節(jié)更新目標(biāo)的中心位置,并將其作為正樣本放入學(xué)習(xí)模塊。

Step4學(xué)習(xí)模塊通過P-N在線學(xué)習(xí)機(jī)制對(duì)檢測(cè)器中的目標(biāo)模型進(jìn)行學(xué)習(xí),并更新正負(fù)樣本庫,提高TLD檢測(cè)器的魯棒性。

Step5視頻結(jié)束則退出,反之返回Step 1跟蹤下一幀。

Figure 3 Flow chart of TLD-DSST algorithm 圖3 TLD-DSST算法流程圖

4 實(shí)驗(yàn)結(jié)果

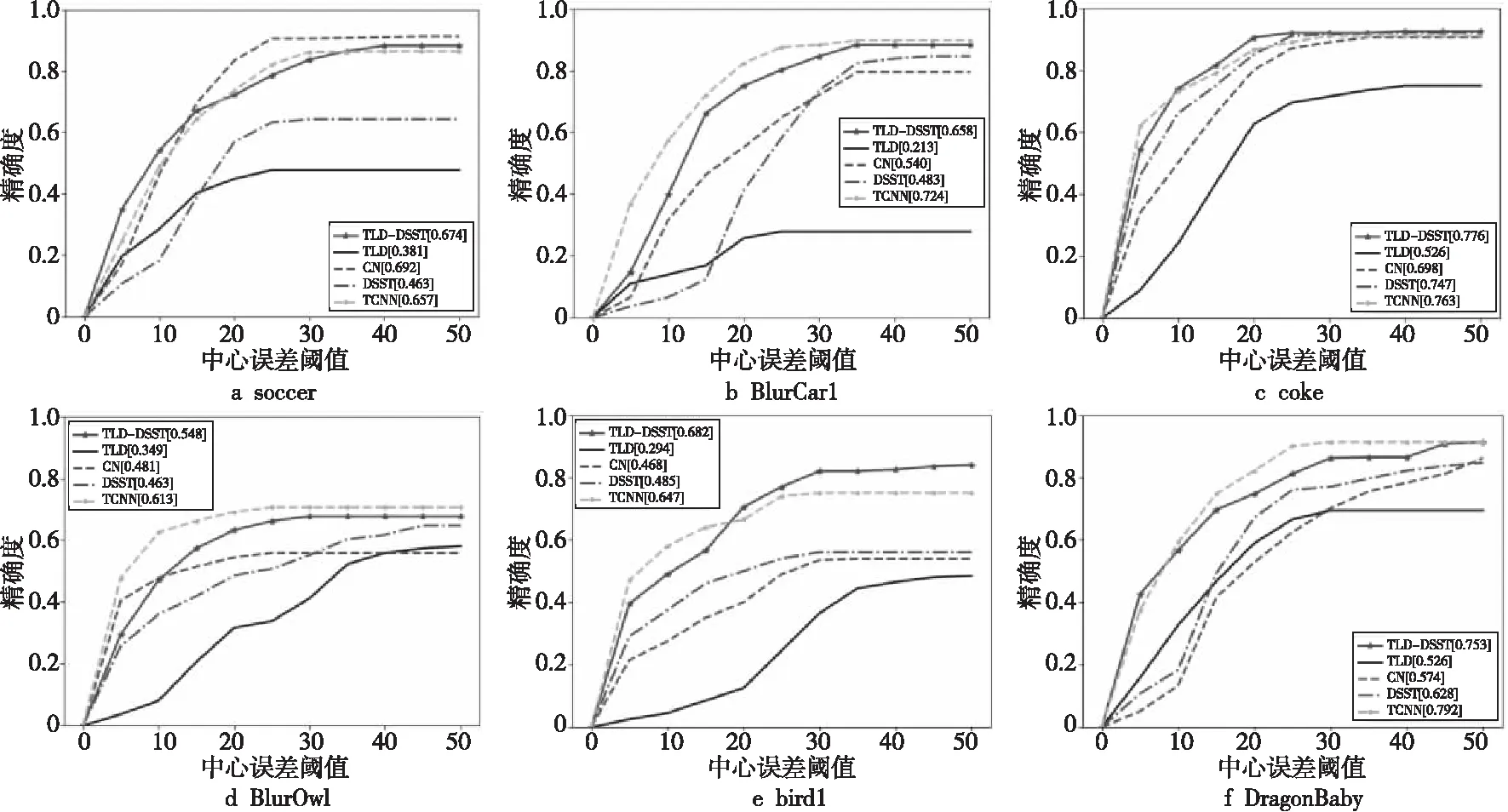

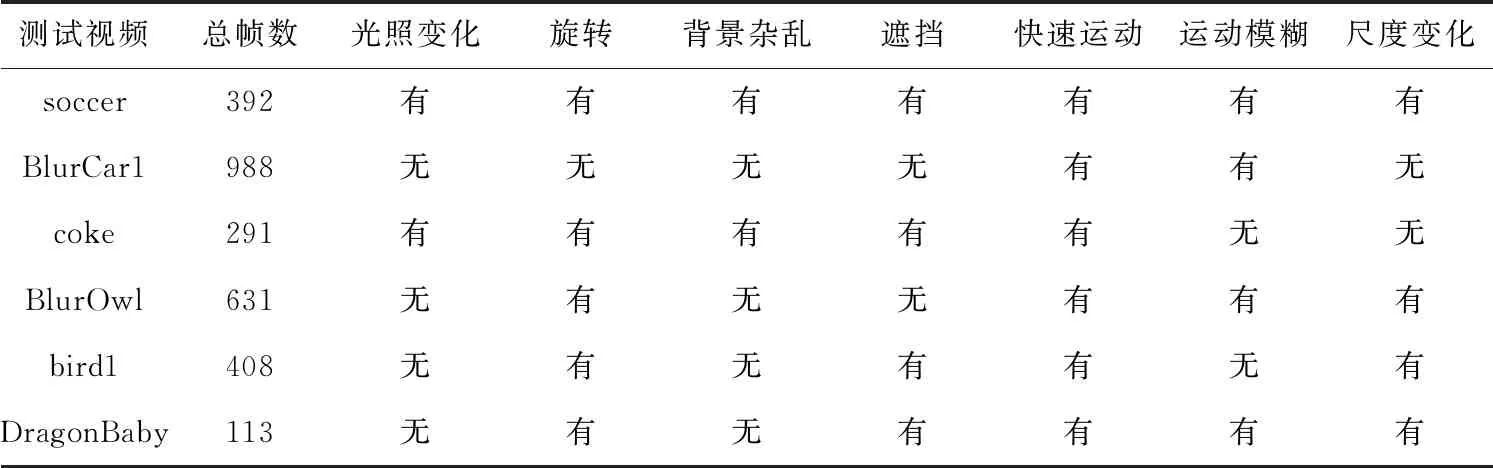

本節(jié)將TLD-DSST算法與 CN算法、TLD算法、DSST算法、TCNN算法進(jìn)行對(duì)比實(shí)驗(yàn)分析,從目標(biāo)跟蹤測(cè)試集網(wǎng)站上(http:∥www.visual-tracking.net)選擇6個(gè)實(shí)驗(yàn)測(cè)試視頻,如表1所示,共有2 823幀,實(shí)驗(yàn)測(cè)試視頻序列包括快速運(yùn)動(dòng)、背景雜亂、光照變化、旋轉(zhuǎn)、遮擋等背景環(huán)境。

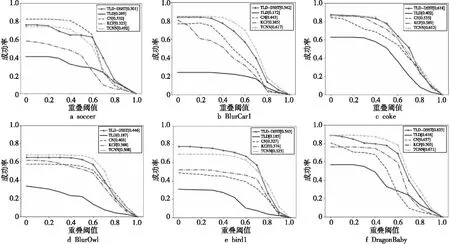

Figure 4 Accuracy of test videos圖4 測(cè)試視頻的精度圖

本文實(shí)驗(yàn)環(huán)境的處理器為Intel i5-4210 2.60 GHz,內(nèi)存為4 GB,對(duì)本文中學(xué)習(xí)速率取η= 0.085,尺度因子取a=1.02,權(quán)重比例系數(shù)取ρ= 0.75。本文算法從成功率圖、精度圖和幀率FPS3個(gè)評(píng)測(cè)標(biāo)準(zhǔn)來比較上述5種算法,使用文獻(xiàn)[17]的測(cè)試視頻中的Ground truth作為實(shí)際目標(biāo)框計(jì)算成功率圖和精度圖。其中,跟蹤算法輸出目標(biāo)框的中心位置與實(shí)際目標(biāo)框的中心位置的歐氏距離用于計(jì)算精度圖,通過計(jì)算跟蹤算法每幀的包圍框重疊度,然后將大于給定閾值的幀數(shù)除以總幀數(shù)得到成功率圖。圖4和圖5為算法精度圖與成功率圖的對(duì)比。通過對(duì)6個(gè)視頻序列的跟蹤,綜合以上3種評(píng)測(cè)標(biāo)準(zhǔn),可以看出本文算法在中心位置誤差的精度和包含框重疊度的成功率方面都優(yōu)于原先的DSST算法。接下來通過本文實(shí)驗(yàn)結(jié)果以及視頻測(cè)試序列部分截圖對(duì)5種不同的跟蹤算法進(jìn)行分析。

4.1 跟蹤結(jié)果定性分析

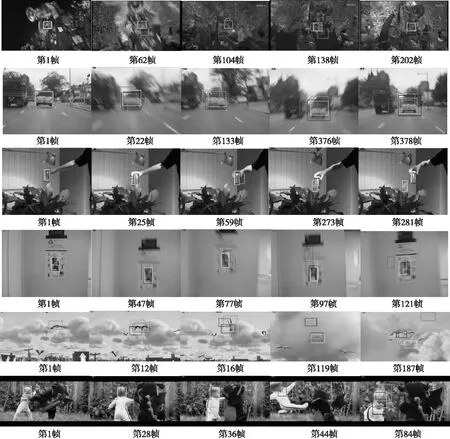

在實(shí)驗(yàn)測(cè)試視頻中,本文選擇soccer測(cè)試視頻中具有遮擋、背景雜亂、快速運(yùn)動(dòng)的情景。圖6第1部分是soccer測(cè)試視頻跟蹤結(jié)果的截圖,從#62可以看出,目標(biāo)的衣服與背景的顏色相似,在快速運(yùn)動(dòng)中,由于目標(biāo)姿態(tài)的變化產(chǎn)生邊界效應(yīng),導(dǎo)致CN算法的目標(biāo)顏色模型和DSST算法的相關(guān)濾波器模型更新受到背景信息的干擾,對(duì)目標(biāo)顏色特征和HOG特征的描述變差,影響跟蹤框準(zhǔn)確表征目標(biāo)區(qū)域,從而跟蹤框發(fā)生偏移;從#104、#138可以看出,目標(biāo)被彩帶遮擋時(shí),TLD算法、DSST算法和TCNN算法跟蹤框偏移,TLD算法由于將包含大量干擾物的區(qū)域作為正樣本在檢測(cè)器中進(jìn)行訓(xùn)練,導(dǎo)致跟蹤失敗;從#202可以看出,偏移的誤差積累后導(dǎo)致DSST算法跟蹤失敗,而TLD算法由于檢測(cè)器具備錯(cuò)誤更新機(jī)制,能對(duì)目標(biāo)進(jìn)行有效跟蹤。從以上視頻幀中可看出,本文算法明顯提高了DSST算法目標(biāo)跟蹤的魯棒性,首先分塊提取檢測(cè)器采集矩形框中目標(biāo)特征,由自適應(yīng)權(quán)重值改進(jìn)的樸素貝葉斯分類器模型計(jì)算得分,對(duì)目標(biāo)與背景信息進(jìn)行區(qū)分,通過此檢測(cè)器來平滑濾波器響應(yīng),矯正目標(biāo)中心位置。

Table 1 Test video sequences表1 測(cè)試視頻序列

Figure 5 Success rates of test videos圖5 測(cè)試視頻的成功率圖

Figure 6 Partial screenshots of video tracking sequences圖6 視頻跟蹤序列部分截圖

選擇BlurCar1測(cè)試視頻中具有快速運(yùn)動(dòng)的情景。圖6第2部分是BlurCar1測(cè)試視頻跟蹤結(jié)果的截圖,從#22、#133、#376、#378可以看出,目標(biāo)快速運(yùn)動(dòng)后圖像模糊,目標(biāo)與背景具有一定的顏色相似度,影響CN算法和DSST算法的目標(biāo)響應(yīng),導(dǎo)致跟蹤漂移;本文算法對(duì)濾波器加入權(quán)重系數(shù)矩陣,考慮到目標(biāo)區(qū)域邊緣檢測(cè),對(duì)有效信息分配高權(quán)重,得到目標(biāo)的準(zhǔn)確位置。

選擇coke測(cè)試視頻中具有光照變化、旋轉(zhuǎn)、遮擋的情景。圖6第3部分是coke測(cè)試視頻跟蹤結(jié)果的截圖,從#25可以看出,光線變強(qiáng)時(shí),影響TLD跟蹤框內(nèi)特征點(diǎn)通過光流法計(jì)算前后向誤差,導(dǎo)致特征點(diǎn)預(yù)測(cè)的跟蹤框縮小;從#273、#281可以看出,目標(biāo)發(fā)生完全遮擋后,CN算法和DSST算法對(duì)偽目標(biāo)葉子進(jìn)行濾波器訓(xùn)練并更新目標(biāo)模型,導(dǎo)致跟蹤失敗,TCNN樹狀模型根據(jù)上一幀偽目標(biāo)葉子的位置得到檢測(cè)后的候選框,導(dǎo)致跟蹤結(jié)果不魯棒。TLD算法通過檢測(cè)器的跟蹤失敗恢復(fù)機(jī)制重新找到目標(biāo)區(qū)域,同樣本文算法中檢測(cè)器通過對(duì)前幾幀圖像進(jìn)行訓(xùn)練,更新學(xué)習(xí)模塊中正負(fù)樣本庫,目標(biāo)完全遮擋再出現(xiàn)后,檢測(cè)器根據(jù)正負(fù)樣本庫篩選出包含目標(biāo)的矩形框,再通過最優(yōu)相似性匹配提高跟蹤性能。

選擇BlurOwl測(cè)試視頻中具有尺度變化、快速運(yùn)動(dòng)的情景。圖6第4部分是BlurOwl測(cè)試視頻跟蹤結(jié)果的截圖,從#47、#77、#97可以看出,目標(biāo)上下快速移動(dòng)時(shí),CN算法和DSST算法跟蹤框發(fā)生偏移,最后跟蹤失敗;從#121可以看出,目標(biāo)左右快速移動(dòng)時(shí),CN算法和DSST算法的跟蹤框跟蹤失敗,快速移動(dòng)產(chǎn)生的邊界效應(yīng)影響了CN算法和DSST算法對(duì)目標(biāo)模型的更新,引入了過多背景信息,導(dǎo)致目標(biāo)跟蹤失敗。TCNN算法通過多個(gè)CNN模型進(jìn)行權(quán)重計(jì)算候選框,可以適應(yīng)目標(biāo)的快速變換。TLD算法和本文算法可以持續(xù)跟蹤到目標(biāo),TLD算法具有檢測(cè)器可篩除邊界效應(yīng)得到的錯(cuò)誤樣本,而本文算法的檢測(cè)器能更好地區(qū)分目標(biāo)和背景,平滑濾波器的響應(yīng),得到目標(biāo)跟蹤的準(zhǔn)確位置。

選擇bird1測(cè)試視頻中具有快速運(yùn)動(dòng)、形變、遮擋的情景。圖6第5部分是bird1測(cè)試視頻跟蹤結(jié)果的截圖,從#12、#16可以看出,目標(biāo)發(fā)生形變后,翅膀的擺動(dòng)使CN算法和TLD算法跟蹤框漂移;從#119、#187可以看出,目標(biāo)被彩云完全遮擋后,CN算法和DSST算法濾波器對(duì)背景信息進(jìn)行位置響應(yīng),最后跟蹤失敗,TCNN算法通過多個(gè)模型檢測(cè)候選框,但無法確定目標(biāo)位置,最后跟蹤失敗。本文算法和TLD算法通過在線學(xué)習(xí)機(jī)制重新找到目標(biāo)區(qū)域,實(shí)現(xiàn)了對(duì)目標(biāo)的實(shí)時(shí)跟蹤。

選擇DragonBaby測(cè)試視頻中具有快速運(yùn)動(dòng)、旋轉(zhuǎn)的情景。圖6第6部分是DragonBaby測(cè)試視頻跟蹤結(jié)果的截圖,從#28、#36可以看出,目標(biāo)發(fā)生旋轉(zhuǎn)后,CN算法和DSST算法提取目標(biāo)單一的特征導(dǎo)致跟蹤框漂移;從#44、#84可以看出,目標(biāo)快速運(yùn)動(dòng)后,TCNN算法提取目標(biāo)深度特征后,通過樹狀模型避免了最近幀的過擬合,本文算法通過對(duì)目標(biāo)中心位置集中響應(yīng),并通過檢測(cè)機(jī)制平滑初始響應(yīng)位置,得到了精確的定位結(jié)果。

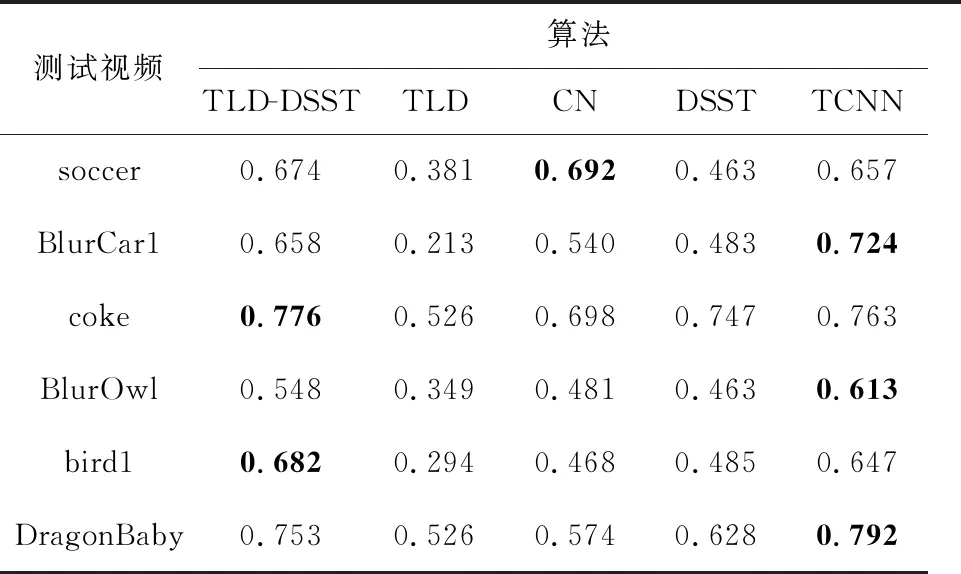

4.2 跟蹤結(jié)果定量分析

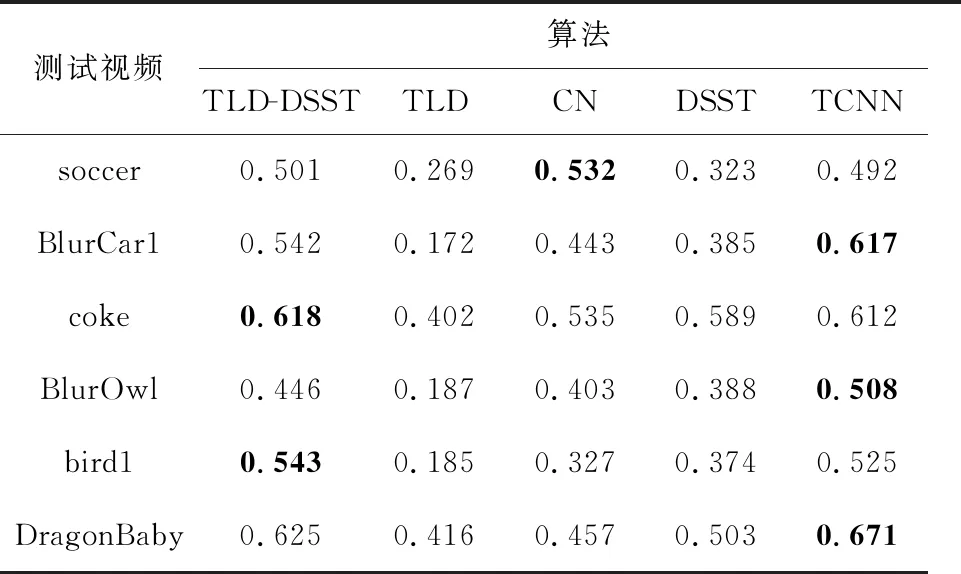

從表2和表3的soccer實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.463,成功率為0.323,本文算法分別提高了45.6%和55.1%。從圖5的soccer實(shí)驗(yàn)成功率圖得到,在重疊閾值大于0.8時(shí),本文算法比其他算法的成功率高。主要是在快速運(yùn)動(dòng)時(shí),CN算法、DSST算法和TCNN算法跟蹤框漂移,TLD算法根據(jù)檢測(cè)器調(diào)整跟蹤框輸出,本文算法通過檢測(cè)器提取目標(biāo)特征,自適應(yīng)區(qū)分矩形框內(nèi)的目標(biāo)與背景,避免了快速運(yùn)動(dòng)和背景雜亂導(dǎo)致的背景信息干擾。

從表2和表3的BlurCar1實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.483,成功率為0.385,本文算法分別提高了36.2%和40.8%。從圖4的soccer實(shí)驗(yàn)精度圖得到,在中心誤差閾值小于15時(shí),TLD算法比DSST算法的精確度高。主要是因?yàn)槌霈F(xiàn)快速運(yùn)動(dòng)時(shí),DSST算法因?yàn)檫吔缧?yīng)對(duì)邊緣進(jìn)行訓(xùn)練,導(dǎo)致跟蹤框漂移,TLD算法的檢測(cè)器篩除錯(cuò)誤樣本,通過重疊度的計(jì)算獲得矩形框,避免了邊界效應(yīng)的影響;中心誤差閾值大于15時(shí),DSST算法比TLD算法的精確度高,主要是TLD算法雖然具有檢測(cè)器的錯(cuò)誤樣本篩選機(jī)制,但是由于對(duì)視頻幀中目標(biāo)的訓(xùn)練不足,學(xué)習(xí)模塊中正負(fù)樣本庫不完善,導(dǎo)致算法的魯棒性不強(qiáng)。本文算法結(jié)合了上述2種算法的優(yōu)點(diǎn),對(duì)前期的視頻幀經(jīng)過提取HOG特征并迭代運(yùn)算得到目標(biāo)響應(yīng),將其作為正樣本更新學(xué)習(xí)模塊,學(xué)習(xí)模塊的樣本與檢測(cè)器中采樣的矩形框進(jìn)行相似度和重疊度計(jì)算,得到更準(zhǔn)確的矩形框,不斷提高算法的魯棒性。

Table 2 Average center error rate (accuracy) for five different algorithms表2 5種不同算法的平均中心誤差率(精確度)

Table 3 Average overlap ratio (success rate) of five different algorithms表3 5種不同算法的平均重疊率(成功率)

從表2和表3的coke實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.747,成功率為0.589,本文算法分別提高了3.9%和4.9%。從圖5的coke實(shí)驗(yàn)成功率圖得到,在重疊閾值大于0.8時(shí),本文算法、CN算法、DSST算法和TCNN算法都比TLD算法的成功率高。主要原因是視頻中存在光照變化導(dǎo)致TLD跟蹤框縮小,本文算法和其他3種算法通過提取目標(biāo)特征,有效地改善了光照變化對(duì)目標(biāo)跟蹤的影響。在重疊閾值小于0.8時(shí),本文算法比CN算法、DSST算法和TCNN算法的成功率高。主要原因是相關(guān)濾波算法的濾波器對(duì)葉子進(jìn)行訓(xùn)練響應(yīng),導(dǎo)致目標(biāo)跟蹤失敗,深度學(xué)習(xí)算法模型得出錯(cuò)誤的候選框,而本文算法具有檢測(cè)器的跟蹤失敗恢復(fù)機(jī)制,能重新找到目標(biāo)區(qū)域。

從表2和表3的BlurOwl實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.463,成功率為0.388,本文算法分別提高了18.4%和14.9%。從圖4的BlurOwl實(shí)驗(yàn)精度圖得到,在中心誤差閾值小于10時(shí),本文算法和TCNN算法比CN算法、DSST算法和TLD算法的精度高。主要原因是在出現(xiàn)快速移動(dòng)時(shí),邊界效應(yīng)影響了CN算法和DSST算法對(duì)目標(biāo)特征模型的更新,導(dǎo)致目標(biāo)跟蹤失敗,而本文算法擴(kuò)大濾波器的目標(biāo)檢測(cè)尺寸,增加物體有效信息的檢測(cè),避免邊界效應(yīng)中邊緣檢測(cè)的影響,并將結(jié)果作為正樣本更新學(xué)習(xí)模塊,提高了算法的魯棒性。

從表2和表3的bird1實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.485,成功率為0.374,本文算法分別提高了28.9%和31.1%。從圖4的bird1實(shí)驗(yàn)精度圖得到,在中心誤差閾值大于20時(shí),本文算法比其他算法的精度高。主要原因是在目標(biāo)完全被遮擋時(shí),其他算法對(duì)背景信息進(jìn)行錯(cuò)誤響應(yīng),導(dǎo)致目標(biāo)跟蹤失敗,而本文算法通過檢測(cè)器的在線學(xué)習(xí)機(jī)制對(duì)正負(fù)樣本的每一幀進(jìn)行學(xué)習(xí)訓(xùn)練,然后將跟蹤的樣本作為正樣本,放入目標(biāo)學(xué)習(xí)模塊中不斷優(yōu)化,從而持續(xù)跟蹤目標(biāo)。

從表2和表3的DragonBaby實(shí)驗(yàn)精確度和成功率得到,DSST算法精確度為0.628,成功率為0.503,本文算法分別提高了16.6%和19.5%。從圖4的DragonBaby實(shí)驗(yàn)精度圖得到,在中心誤差閾值小于15時(shí),本文算法、TLD算法和TCNN算法比DSST算法和CN算法的精度高,主要原因是目標(biāo)快速運(yùn)動(dòng)產(chǎn)生的邊界效應(yīng)影響了算法濾波器的位置響應(yīng),導(dǎo)致運(yùn)動(dòng)模型更新失敗,而本文算法擴(kuò)大濾波器的目標(biāo)檢測(cè)尺寸,增加物體有效信息的檢測(cè),并對(duì)目標(biāo)中心位置進(jìn)行集中響應(yīng),避免了邊界效應(yīng)中邊緣檢測(cè)的影響。

4.3 算法跟蹤速率分析

從表4得到,CN算法對(duì)提取的目標(biāo)顏色特征采用主成分降維技術(shù),跟蹤的實(shí)時(shí)性最佳,DSST算法通過將高斯核函數(shù)轉(zhuǎn)為頻域計(jì)算,并提出濾波器更新機(jī)制,從而提高了跟蹤的實(shí)時(shí)性;TCNN算法對(duì)目標(biāo)進(jìn)行多層卷積提取深度特征,并需要對(duì)每一幀進(jìn)行樹形判斷,導(dǎo)致實(shí)時(shí)性最差;TLD算法通過網(wǎng)格循環(huán)采樣矩形框,計(jì)算每個(gè)矩形框的重疊度和相似度,實(shí)時(shí)性較差;本文算法通過DSST算法中相關(guān)濾波器得到的目標(biāo)尺度采樣矩形框,從而減少檢測(cè)器多尺度循環(huán)采樣矩形框的采樣時(shí)間,因此本文算法能夠在TLD算法基礎(chǔ)上,實(shí)時(shí)性提高了2.37倍,平均幀率達(dá)到49.47 f/s,并且本文算法使用傅里葉變換的共軛對(duì)稱性使得高斯濾波過程縮短了一半時(shí)間。

Table 4 Average frame rate comparison among five different algorithms表4 5種不同算法的平均幀率對(duì)比 f/s

5 結(jié)束語

本文在TLD算法的基礎(chǔ)上提出了一種融合TLD框架的DSST實(shí)時(shí)目標(biāo)跟蹤改進(jìn)算法TLD-DSST。本文算法在相關(guān)濾波器中增加權(quán)重系數(shù)矩陣來平衡目標(biāo)中心區(qū)域,得到目標(biāo)響應(yīng)位置;然后對(duì)檢測(cè)器進(jìn)行分塊提取目標(biāo)特征,放大目標(biāo)與背景的差異度,再通過樸素貝葉斯分類器提高檢測(cè)器的分類能力;最后將檢測(cè)器聚類得到的眾多矩形框與響應(yīng)的目標(biāo)位置進(jìn)行最優(yōu)相似性匹配,根據(jù)權(quán)重彈性調(diào)整目標(biāo)輸出框的中心位置,提高了本文算法的魯棒性。同時(shí),本文通過DSST算法中尺度濾波器得到的目標(biāo)尺度采樣矩形框,對(duì)比于TLD算法使用循環(huán)采樣矩形框的方法降低了計(jì)算周期。最后通過實(shí)驗(yàn)結(jié)果表明,與對(duì)比算法相比,本文的TLD-DSST算法有最好的實(shí)時(shí)跟蹤性能,在目標(biāo)快速運(yùn)動(dòng)情景下能取得很好的效果,明顯優(yōu)于改進(jìn)的DSST算法。然而,本文算法并沒有考慮相似目標(biāo)重疊時(shí)導(dǎo)致跟蹤失敗問題,下一步的研究方向是在相似目標(biāo)發(fā)生遮擋情景中,通過卷積網(wǎng)絡(luò)提取目標(biāo)特征,提高跟蹤算法的魯棒性。