U形網絡的脊椎分割改進方法研究

梁淑芬 楊芳臣 秦傳波

摘? 要: 針對當前U?Net網絡模型以及相關卷積網絡在脊椎分割中分割邊緣精度低,對目標的識別率低等問題,提出幾種改進的語義分割網絡模型。考慮到脊椎MRI圖像中目標區域連續且集中,并存在復數微小區域,邊緣特征豐富,運用新型卷積塊替換標準卷積結構,利用多路徑思想,融入復數編解碼器結構,降低運算復雜度,提升邊緣特征提取力度,應對不同的特征提取問題。模型在SpineWeb的High anisotropy MRIs of the lower back數據集2 000張脊椎圖像上做實驗,運用訓練好的模型對同組脊椎MRI圖像作預測。實驗結果顯示,網絡模型的預測結果與提供的真值標簽在Dice系數以及Precision系數等幾項評價指標上分別達到0.891和0.894。

關鍵詞: 脊椎分割; 網絡模型; U形網絡; 結構替換; 特征提取; 圖像預測

中圖分類號: TN911.73?34? ? ? ? ? ? ? ? ? ? ? ?文獻標識碼: A? ? ? ? ? ? ? ? ? ? ? ? ?文章編號: 1004?373X(2020)21?0031?04

Improved spinal segmentation method based on U?net

LIANG Shufen, YANG Fangchen, QIN Chuanbo

(Wuyi University, Jiangmen 529020, China)

Abstract: As the current U?net models and related convolution networks have low accuracy of edge segmentation in spinal segmentation, several improved semantic segmentation network models are proposed. Since the continuity and concentration of target areas in the spine MRI (magnetic resonance imaging) images, plural small areas and rich edge features are considered, a new convolution block is used in the method to replace standard convolution structure. Several codec structures are integrated with an idea of multi?path, which can reduce the computation complexity and improve segmentation edge feature extraction to deal with different feature extraction. The experiments of 2 000 spinal images in SpineWeb′s High Anisotropy MRIs of the Lower Back dataset were carried out, using the trained model to forecast the spine MRI images in the same group. The experimental results show that the prediction results of the network model and evaluation indexes on the provided truth?value label for Dice coefficient and Precision coefficient have reached 0.891 and 0.894.

Keywords: spinal segmentation; network model; U?net; structure replacement; feature extraction; image prediction

0? 引? 言

脊柱是人體的支柱,具有負重、減震、保護及日常運動的功能。隨著人們工作生活節奏的日益加快,脊柱問題成為現代社會普遍存在、亟待解決的健康問題[1?3]。脊椎醫學影像的研究對輔助臨床診斷解決脊椎問題有重要意義,其中脊椎分割一直是醫學界的一項重要挑戰[4]。

為實現圖像的精準分割,國內外研究學者考慮諸多方法,傳統方法中邊緣檢測法[5]、基于閾值的分割法[6]、區域生長法[7?9]、基于活動輪廓的方法[10]、基于聚類的分割方法[11?12]等。但由于傳統方法分割過程繁瑣,醫學影像采集設備噪聲影響等,分割質量有限。

與傳統的圖像分割方式相比,深度卷積網絡具有自動提取特征的特點,深度學習的方法對有標簽的數據處理,尤其是語義分割領域具有顯見的優勢。文獻[13]提出的FCN(Fully Convolutional Networks)架構將神經網絡應用于端到端的圖像語義分割領域,并取得了顯著效果。文獻[14]提出的基于FCN網絡架構的語義分割方法U?Net網絡框架,通過帶標簽訓練達到較高精度的語義分割,對醫學圖像分割的發展啟發深遠。文獻[15]構成的殘差網絡降低了網絡復雜度。文獻[16]所述的Dense致密結構,通過特征融合更加緊密的快捷連接,提升了醫學圖像特征的利用率,增強了語義分割效果。結合殘差結構以及可分離卷積結構,文獻[17]提出一種卷積塊用于降低網絡復雜度,減少計算量。文獻[18]融合殘差結構與注意力機制等,提出一種雙解碼器的網絡結構,提升分割精度等。結合前述基于卷積神經網絡的分割方法,針對脊椎圖像醫學特點,提出基于U?Net架構的語義分割改進網絡,實現脊椎影像更精確的脊椎分割。

1? 方法介紹

1.1? 編解碼網絡

文獻[13]證明了經端到端、像素到像素訓練過程的卷積神經網絡優于當前語義分割中最先進技術,并通過標準卷積形成卷積塊結構,搭建出完全由卷積組成的卷積編解碼FCN網絡,其結構如圖1所示。

文獻[19]運用FCN獲得較高精度的分割結果;文獻[20]運用基于FCN的方法在林木圖像上獲得了良好的分割效果。

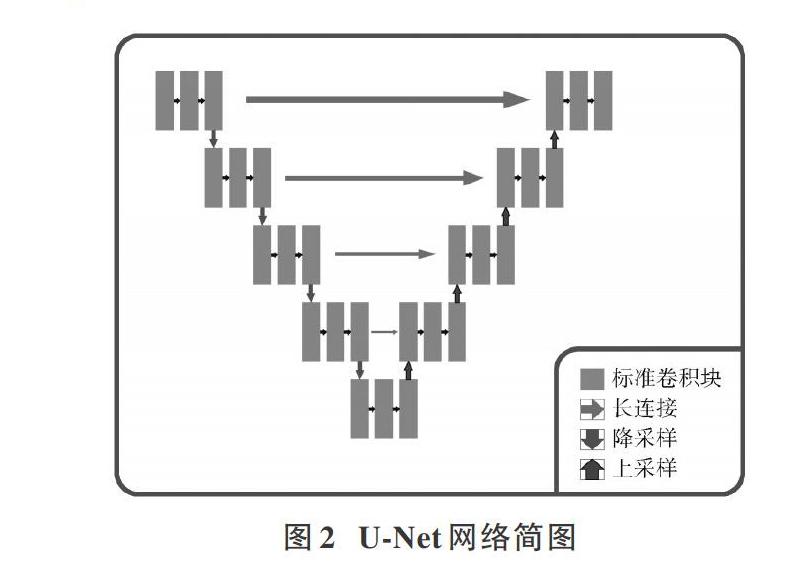

與FCN結構比較,U?Net架構則更靈活,同樣采用編?解碼器架構,通過完善網絡結構中的擴張路徑,與收縮路徑對應地逐步恢復圖像尺寸,二者共同組成一個對稱的結構,如圖2所示。

文獻[21]實現了基于U?Net的肺部影像自動分割;文獻[22]分割肺部腫瘤圖像,獲得了更精確的結果。此外還有些應用于鼻咽喉腫瘤[23]和脊椎分割[24],效果顯著。

編解碼網絡使用的帶標簽數據通常很少,經過相應預處理,就能訓練得到比較精確的分割結果,適應能力較強。但特征圖譜的維度會隨網絡深度的加深而增加,導致目標分割計算量增加。同時,圖像在收縮路徑中不斷地損失圖像細節,到擴張路徑時,也會遇到難以恢復圖像邊緣等問題阻礙。

1.2? 基于U?Net的改進網絡

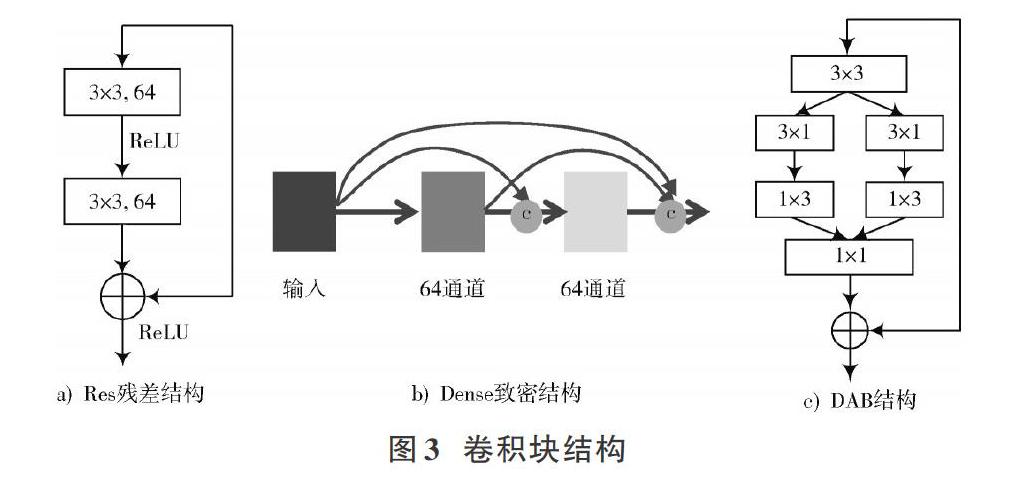

針對U?Net應用于醫學圖像分割時存在的問題,Res?U?Net(Residual U?Net)融入了文獻[15]的殘差結構,將U型網絡中普通卷積塊轉換成殘差塊。如圖3a)所示,殘差塊由標準卷積和快捷連接(Shortcut Connection)構成,可降低復雜度,減少計算量。

但殘差結構也會損失部分信息,為了穩定圖像的分割精度,并進一步降低復雜度,Dense?U?Net網絡運用文獻[16]的致密結構,如圖3b)所示。Dense結構在一定程度上緩解了神經網絡訓練過程中梯度消失的問題,同時增強了對象特征傳播,促進特征復用。

實驗表明,致密結構需有較深層的卷積塊支撐,且輸出端的特征維度比較大。文獻[17]提出一種DAB結構(Depth?wise Asymmetric Bottleneck)構成新卷積塊,使用ResNet[15]中的瓶頸結構,能在減少參數的同時穩定分割精度。

DAB結構塊如圖3c)所示,運用可分離卷積的結構思路,結合殘差網絡降低復雜度的特點,由標準卷積層、分離卷積層和1×1核卷積層組成非對稱式DAB卷積塊。

改進的網絡DAB?U?Net仍使用編?解碼器結構,將普通卷積替換為對應的DAB卷積。編碼器提取語義信息,解碼器獲取圖像細節;網絡運用密集型skip connection,通過Feature Interaction將編碼器部分的所有特征整合并傳遞到高層特征中,減緩因編碼降采樣導致的信息丟失。

運用文獻[18]提出的RIC?U?Net網絡結構,同時為更進一步利用DAB卷積塊提取的特征信息,在DAB?U?Net基礎上增加一條編碼路徑,保留跳層連接,通過新編碼器更新特征提取,補充單條編解碼路徑損失的信息。改進的網絡模型為W型結構,經過不同程度調整,先后有W1,W2和W3三個版本結構,如圖4a)所示。DAB?W?Net網絡進一步提升特征利用率。

通過增加預編碼路徑,促使網絡提前進入數據壓縮階段,形成DABN?Net網絡結構,如圖4b)所示。改進的DABN?Net網絡增加了預編碼路徑,采用標準卷積塊,初步提取特征,獲得更簡潔的數據信息后再輸入常規DAB?U?Net網絡中,強化對目標特征的提取能力,提升分割精度。

實現分割的系統流程圖如圖5所示,先對數據集作預處理,然后輸入到網絡中訓練。

以圖像尺寸為標準,對原圖和標簽集同步作縮放傾斜等隨機形變,實現數據擴增。

2? 結果與分析

2.1? 實驗材料

實驗使用SpineWeb的High anisotropy MRIs of the lower back數據集[25?26]。包含195例人體脊柱的腰椎MRI掃描圖像,其尺寸范圍在512×512~1 024×1 024之間。為方便實驗,對所選圖像進行預處理增強并規范到512×512,最后按3∶1∶1比例分配實驗。根據實際背景,實驗設備配置見表1。

2.2? 評價指標

為定量分析提出方法的分割性能,檢驗方法的分割效果,文中運用幾種常見的評價指標,包括Accuracy,Sensitivity,Specificity,Precision,[F1] Score,Jaccard Similarity以及Dice Coefficient。根據研究對象特點選擇其中五項為各方法作分割性能上的定量評估。

Sensitivity系數,又稱召回率,表示所有正像素中標注正確的像素集所占比例,衡量分割方法對正像素的識別能力。

Specificity指標,又稱真陰性率,表示所有負像素中被標注正確的像素集合所占比例,衡量分割方法對負像素的識別能力。

Precision表示精度,又稱查準率,是圖像分割精確性的度量參數,是被標注為正的像素集合中實際為正的像素集合所占比例,衡量模型對正像素點的預測能力。

Jaccard相似性系數,給定兩個集合,正負集A,B,Jaccard系數表示集合A,B之間的交集與它們之間的并集的比值。

Dice Coefficient系數為圖像中兩個目標形狀之間交集面積占總面積的比值,值越大,分割結果越好,完美重合時值為1。

2.3? 實驗結果與分析

實驗流程如圖5所示,在同一系統下使用不同網絡模型對MRI脊椎圖像進行訓練。經過后處理,將網絡預測輸出的脊椎分割結果圖像轉換為二值圖像,如圖6a)所示。

比較預測結果,顯示DABW2?Net、DABW3?Net以及DABN?Net幾個分割網絡對醫學脊椎原圖的椎骨細節描述能力更強,展現的細節更為全面,其余包括U?Net,ResU?Net等模型在實驗預測過程中,都有不同程度的信息丟失。將訓練好的模型應用于臨床數據,得到如圖6b)所示分割結果。

實驗表明,提出的改進網絡模型可以進行臨床分割,效果顯著。

如表2所示,提出的改進網絡對脊椎的分割在識別能力上有所強化,分割結果與標簽更相似。此外,通過對比原圖與標簽不難發現,人工標簽明顯存在一些誤差,導致部分模型分割指標數據稍有波動。但總體上,模型性能都略優于傳統卷積方法。

3? 結? 論

本文提出幾種改進的基于U?Net網絡模型的脊椎MRI醫學影像分割網絡模型,通過對網絡作改進,提升網絡分割精度,增加網絡深度。將預處理后的圖集輸入到改進的U型網絡模型中進行訓練,改進的網絡在分割精度方面有所提高,對比同類型算法,所需訓練樣本較少,訓練速度較快。實驗結果表明,改進的分割網絡能有效分割脊椎MRI圖像。

注:本文通訊作者為秦傳波。

參考文獻

[1] 吳旻昊,孫文超,閆飛飛,等.早發型脊柱側彎的治療研究與新進展[J].中國組織工程研究,2017,21(3):433?439.

[2] 尹慶水.脊椎相關疾病研究現狀及面臨的挑戰[J].中國骨科臨床與基礎研究雜志,2014(2):69?72.

[3] 顧菊平,程天宇,華亮,等.面向脊柱生物建模的圖像分割與配準研究綜述[J].系統仿真學報,2019,31(2):167?173.

[4] RAMU S M, RAJAPPA M, KRITHIVASAN K, et al. A novel fast medical image segmentation scheme for anatomical scans [J]. Multimedia tools and applications, 2019, 78(15): 1?32.

[5] 鈕圣虓,王盛,楊晶晶,等.完全基于邊緣信息的快速圖像分割算法[J].計算機輔助設計與圖形學學報,2016,24(11):1410?1419.

[6] 李滾,劉歡,柯善群.脊椎圖像分割與椎體信息提取的算法及應用[J].電子設計工程,2017,25(16):183?186.

[7] 肖明堯,李雄飛,張小利,等.基于多尺度的區域生長的圖像分割算法[J].吉林大學學報(工學版),2017,47(5):1591?1597.

[8] 曾鵬,王正勇,滕奇志.一種基于區域生長算法的脊椎椎體提取方法[J].科學技術與工程,2014,14(6):222?225.

[9] GAO Huilin, DOU Lihua, CHEN Wenjie, et al. The applications of image segmentation techniques in medical CT images [EB/OL]. [2011?01?26]. https://www.researchgate.net/publication/252035024.

[10] DOMINIK G, Gl?WKA P, KOTWICKI T, et al. Automatic spine tissue segmentation from MRI data based on cascade of boosted classifiers and active appearance model [EB/OL]. [2018?04?29]. https://www.ncbi.nlm.nih.gov/pmc/articles/PMC5949193/.

[11] TIAN Yuan, GUAN Tao, WANG Cheng, et al. Interactive foreground segmentation method using mean shift and graph cuts [J]. Sensor review, 2009, 29(2): 157?162.

[12] 葉偉,陶晶,陳小宇,等.一種新穎的MR脊柱圖像自動分割算法研究[J].中國醫療設備,2018,33(9):61?64.

[13] LONG J, SHELHAMER E, DARRELL T. Fully convolutional networks for semantic segmentation [J]. IEEE transactions on pattern analysis & machine intelligence, 2014, 39(4): 640?651.

[14] RONNEBERGER O, FISCHER P, BROX T. U?Net: convolutional networks for biomedical image segmentation [C]// MICCAI 2015: Medical Image Computing and Computer?Assisted Intervention. Munich, Germany: IEEE, 2015: 234?241.

[15] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition [C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas, NV, USA: IEEE, 2016: 770?778.

[16] HUANG Gao, LIU Zhuang, VAN DER MAATEN L, et al. Densely connected convolutional networks [EB/OL]. [2018?01?28]. https://www.researchgate.net/publication/319770123.

[17] LI Gen, YUN I, KIM J, et al. DABNet: depth?wise asymmetric bottleneck for real?time semantic segmentation [EB/OL]. [2019?07?26]. https://github.com/nemonameless/DABNet.

[18] ZENG Zitao, XIE Weihao, ZHANG Yunzhe, et al. RIC?Unet: an improved neural network based on Unet for nuclei segmentation in histology images [J]. IEEE access, 2019, 7: 21420?21428.

[19] 郭樹旭,馬樹志,李晶,等.基于全卷積神經網絡的肝臟CT影像分割研究[J].計算機工程與應用,2017,53(18):126?131.

[20] 黃英來,劉亞檀,任洪娥.基于全卷積神經網絡的林木圖像分割[J].計算機工程與應用,2019,55(4):219?224.

[21] 袁甜,程紅陽,陳云虹,等.基于U?Net網絡的肺部CT圖像分割算法[J].自動化與儀器儀表,2017(6):59?61.

[22] 周魯科,朱信忠.基于U?Net網絡的肺部腫瘤圖像分割算法研究[J].信息與電腦(理論版),2018(5):41?44.

[23] 潘沛克,王艷,羅勇,等.基于U?net模型的全自動鼻咽腫瘤MR圖像分割[J].計算機應用,2019,39(4):1183?1188.

[24] 劉忠利,陳光,單志勇,等.基于深度學習的脊柱CT圖像分割[J].計算機應用與軟件,2018,35(10):206?210.

[25] EGGER J, NIMSKY C, KOLB A. Robust detection and segmentation for diagnosis of vertebral diseases using routine MR images [J]. Computer graphics forum, 2015, 33(6): 190?204.

[26] EGGER J, ZUKI? D, FREISLEBEN B, et al. Segmentation of pituitary adenoma: a graph?based method vs. a balloon inflation method [J]. Computer methods and programs in biomedicine, 2013, 110(3): 268?278.

作者簡介:梁淑芬(1975—),女,廣東江門人,碩士,副教授,主要研究方向為模式識別、信號處理與通信研究等。

楊芳臣(1995—),男,江西宜春人,碩士,主要研究方向為圖像處理。

秦傳波(1982—),男,安徽宿州人,博士,講師,主要研究方向為生物特征識別、醫學影像處理。