基于Mask R-CNN的機場地面保護區航空器識別研究

楊昌其,郭睿豪,張曉磊

(中國民用航空飛行學院 空中交通管理學院,四川 廣漢 618307)

0 引言

中國民用航空局CAAC統計報告顯示[1],2019年民航運輸航空年運行架次量增長至496.6萬架次,較2018年增長5.8%。隨著運輸航空運行壓力的增加,嚴重事故征候發生11起,跑道侵入(runway incursion, RI)是運輸航空安全的重點關注部分。目前跑道監視技術成本高、人工投入大且自動化水平低,中小機場難以配備。通過合理布局攝像頭對機場地面保護區航空器實時監控,識別航空器,進行相對位置及運動狀態判斷跑道侵入,能夠有效減少跑道侵入的發生率。

目前多數文獻對航空器識別的圖像數據主要源于衛星遙感圖像,而衛星遙感圖像存在受天氣影響大、實時性差等問題,無法滿足實時監視航空器要求。實時捕捉機場內航空器圖像信息識別航空器,并判斷航空器位置,對航空器監視技術的發展具有重要意義。文獻[2]識別目標的雷達散射截面數據,基于BP(back propagation)神經網絡提取航空器目標特征,能夠對不同大小類型的飛機進行識別。文獻[3]基于Darknet-53網絡結構,改進了YOLO算法,以遠程塔臺系統捕捉到的航空器圖像為目標進行識別,證明YOLO算法可檢測遠程塔臺系統中的運動目標,但未說明在邊緣天氣下的航空器的識別效果。文獻[4]布置多攝像頭識別和追蹤航空器目標,提出一種分析航空器位置和速度的模型,通過計算判斷航空器滑行沖突,降低了航空器滑行階段的風險。文獻[5]提出一種改進的快速深度學習方法實現對航空器的目標跟蹤,并在ILSVRC2015數據集上將識別準確率提高到了59.2%。

隨著計算機計算能力的迅速提升,圖像處理和目標識別技術日新月異,其中基于卷積神經網絡(convolutional neural networks, CNN)的目標識別技術最為火熱,發展出了基于預選框識別的各類網絡結構,包括區域卷積神經網絡R-CNN (region-convolutional neural networks)[6]、快速區域卷積神經網絡Fast R-CNN[7]、更快速的區域卷積神經網絡Faster R-CNN[8]、區域全卷積網絡R-FCN(region-based fully convolutional networks)[9]等兩階段算法;另一種不需提取候選框直接使用卷積神經網絡提取目標特征,例如SSD(single shot multibox detector)[10]、YOLO(you only look once)[11]等一階段算法。兩階段算法對檢測目標的識別精度高,但同時處理速度較慢,實時性差;一階段算法處理圖像速度較快,但目標識別精度低,且目標較小時容易丟失。Mask R-CNN[12]是一種多任務訓練、兩階段神經網絡模型,其核心神經網絡使用了殘差網絡ResNet-101和特征金字塔網絡FPN(features pyramid network),較Faster R-CNN提升了目標分割精度,在處理像素級目標識別和目標分割任務時性能更強。

為滿足檢測航空器時所需的準確性和實時性,本文首次將Mask R-CNN模型應用于識別地面保護區內的航空器、車輛和人員,基于COCO數據集權重模型,建立航空器訓練樣本數據集,提升模型在檢測航空器、車輛和人員時的準確率。此外,設計跑道侵入判定邏輯電路,可根據檢測信號判斷是否發生跑道侵入。

1 Mask R-CNN目標檢測算法原理

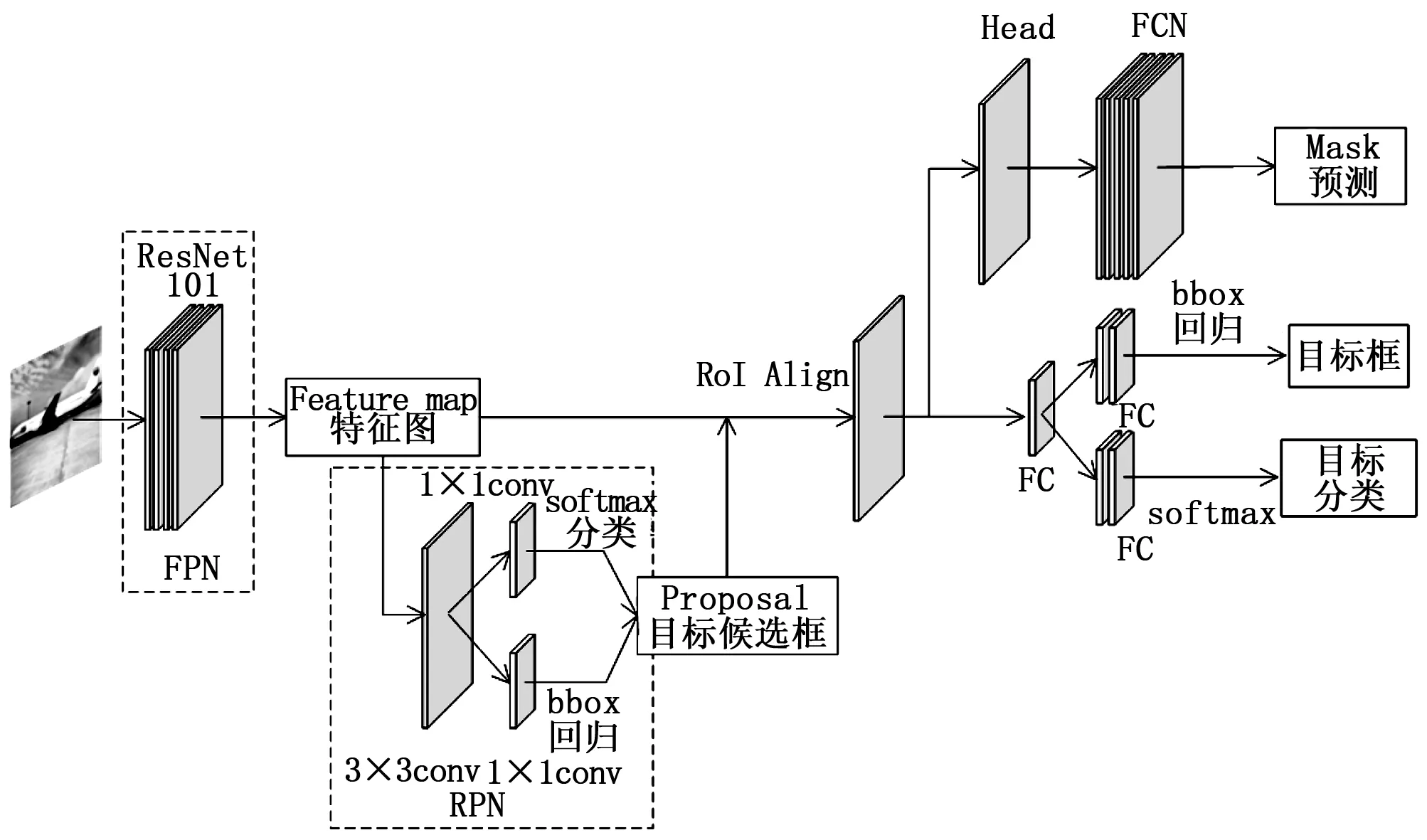

典型的Mask R-CNN模型包括:特征提取網絡、候選區域生成網絡、RoI Align、Mask預測分支和分類網絡。特征提取網絡提取全圖特征,并共享特征圖;特征圖輸入候選區域生成網絡,輸出候選框,同時修正感興趣區域RoI(region of interest)的候選框;RoI Align網絡在特征圖選取每個候選框對應特征。最后并行運行Mask預測分支網絡,通過全連接層對候選框目標進行分類,同時再次修正目標框。Mask R-CNN模型結構如圖1所示。

圖1 Mask R-CNN網絡結構圖

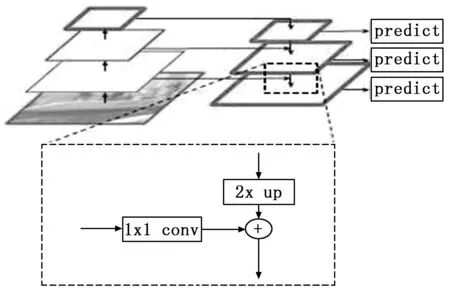

特征提取網絡FPN(feature pyramid networks)[13]是模型主干網絡,其結構是ResNet-101網絡,是輸入圖像的特征提取網絡。特征提取時對不同層別特征有不同特點:低層特征語義信息少,但目標位置精確;高層特征反之。因此,FPN設計了兩路網絡如圖2所示。一路自底向上對圖像進行下采樣,特征圖像素在特定層發生改變,其他層則不變,改變像素大小前的所有層劃為一個stage,該stage最后層特征圖作為輸出;另一路自頂向下進行上采樣,同時與第一路生成相同大小的特征圖融合。

圖2 特征提取網絡FPN結構

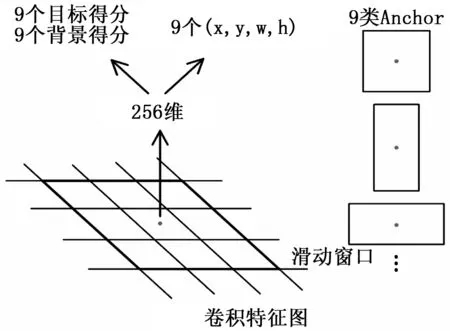

候選區域生成網絡RPN(region proposal networks)在FPN輸出的網絡特征圖上生成候選框錨,對錨進行打分判斷其為目標或背景,同時修正錨框坐標。RPN在特征圖上生成一個滑動窗口,為每個錨預設9種初始錨框。初始錨框包含三種大小(128×128, 256×256, 512×512),每種大小包含三種比例(1:1, 1:2, 2:1)。因此,大小為w×h的特征圖有w×h×k個錨,錨框種類k=9。在RPN頭部,以圖3所示結構生成f個錨。對每個錨輸出坐標回歸層和二分類層:坐標回歸層包括錨的坐標(x,y,w,h),每個錨通過回歸生成4個預測值Ax,Ay,Aw,Ah標出候選框;二分類層輸出錨的背景分數和目標分數,兩個分數均為預測值,該分數為錨與正確標注的重疊區域IoU(intersection over union)值。錨的邊框修正與4個值tx,ty,tw,th有關,tx,ty表示錨在x方向和y方向的平移量,tw,th表示長和寬的縮放量,以Gx,Gy,Gw,Gh表示標定的正確標注框,用G′x,G′y,G′w,G′h表示錨映射得到的和正確標注框最接近的回歸窗口,則可通過公式(1)~(4)平移和縮放:

(1)

(2)

(3)

(4)

式中,dx(A),dy(A),dw(A),dh(A)四種變換通過訓練得到對應權重,變換通過式(5)~(8)調整:

(5)

(6)

(7)

(8)

特征圖轉化的特征向量定義為Φ,預測值(tx,ty,tw,th),輸出dx(A),dy(A),dw(A),dh(A),w為學習參數,目標函數則可表示為式(9):

(9)

訓練RPN的損失函數為:

(10)

RPN的分類和邊框回歸分別對錨進行計算,在RPN結構尾部對兩分支輸出結果匯總,實現對錨初步去重和偏移。

圖3 RPN原理圖

RoI Align網絡對特征圖進行m倍下采樣,結果使用浮點數表示,下采樣特征圖劃分m×m個單元,單元邊界同樣使用浮點數表示。該浮點數利用雙線性插值得出像素點數值,對特征區域分類和分割。使用浮點數表示能夠確保特征對齊候選框,在像素級目標識別中減少偏移量。

Mask預測分支的結構是一個微型卷積神經網絡,輸入為目標候選區,生成28×28浮點數分辨率的Mask。訓練時將Mask縮小為28×28計算損失函數,預測時將Mask放大為RoI邊框尺寸,輸出Mask結果,每類目標有獨立的Mask。

分類網絡使用目標候選框特征圖,通過FC(full connect)層與softmax層計算目標候選框所屬類別,輸出概率向量;同時再次利用邊框回歸修正目標候選框的位置偏移量。

式(11)用Lcls表示分類層的回歸損失值,式(12)Lbox表示邊框回歸的回歸損失值,式(13)Lmask表示Mask預測分支損失函數,則Mask R-CNN的損失函數可表示為式(14):

(11)

(12)

(13)

L=Lcls+Lbox+Lmask

(14)

2 地面保護區預警

2.1 地面保護區

跑道侵入定義為:在機場中發生的任何涉及錯誤的出現或存在在用于飛機起飛和降落的地面保護區表面的飛機,車輛以及行人的事件[14]。地面保護區包括機場跑道、滑行道上跑道等待位置和跑道之間的區域、跑道中線兩側各75 m內的土面區、ILS敏感區、ILS臨界區和跑道端安全區,如圖4所示。

根據定義,防止跑道侵入即監視地面保護區內航空器、車輛與人員的相對位置關系與狀態。據FAA對涉及跑道侵入事件和嚴重事件調查分析,跑道侵入可分為以下幾種典型:

1)航空器或車輛不正確進入地面保護區;

2)撤離航空器或車輛不正確地出現在跑道保護區;

3)航空器或車輛不正確地穿越跑道;

4)連續落地、落地與起飛或起飛與落地航空器之間的間隔不滿足規定;

5)航空器著陸時沒有空中交通管制許可;

6)航空器起飛時沒有空中交通管制許可。

圖4 機場地面保護區示意圖

2.2 跑道侵入檢測模型

模型在跑道和滑行道等待線的一側安裝n個攝像頭,攝像頭檢測有效范圍內航空器位置并判斷運動狀態。攝像頭安裝間隔需保證不會有同一架航空器出現在兩個攝像頭中,同時調整攝像頭仰角防止將目標區域外的航空器捕捉進畫面對識別產生影響。模型布局如圖5所示。

圖5 攝像頭位置示意圖

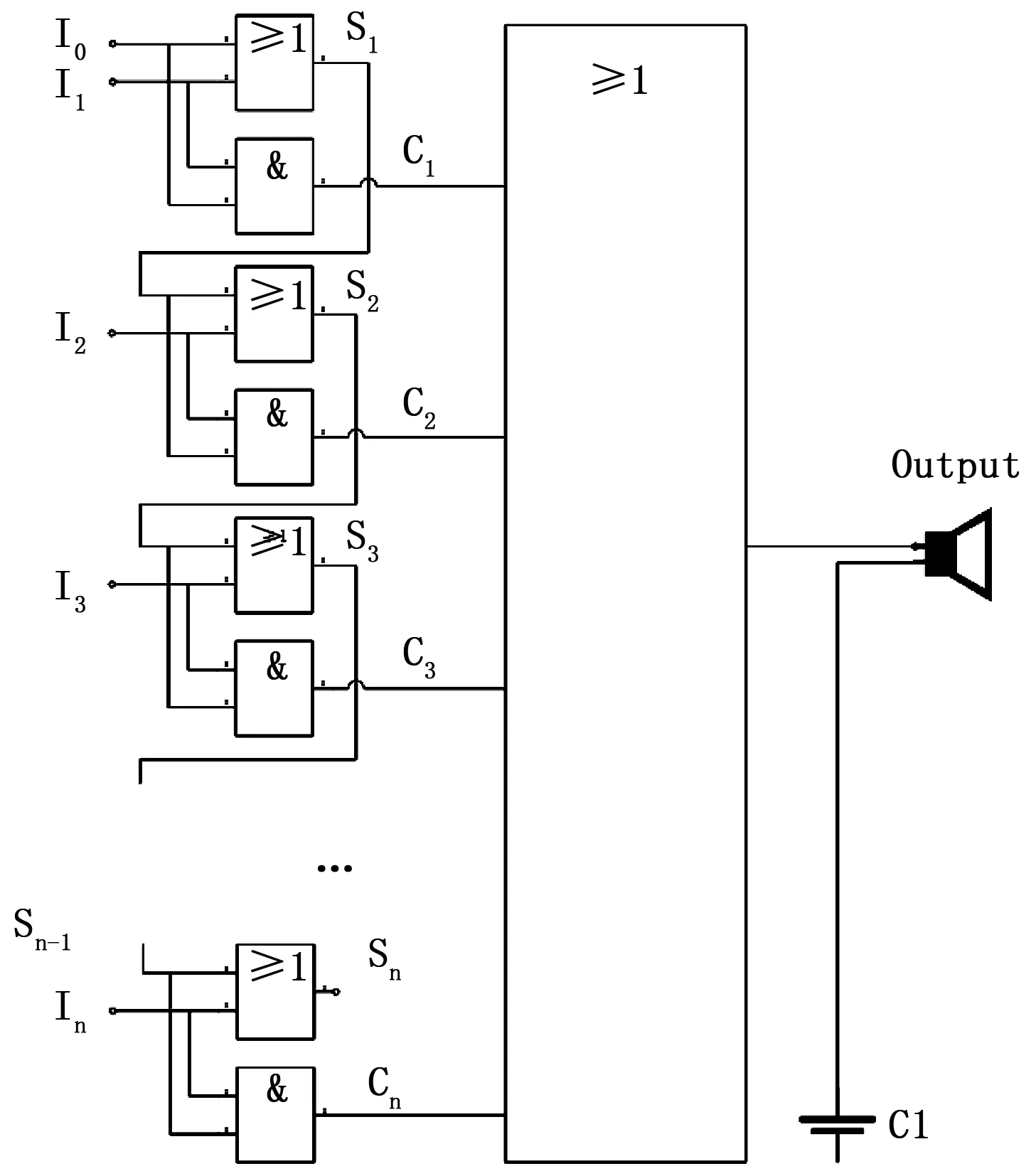

模型輸入信號為攝像頭實時檢測結果,Ii表示第i個攝像頭,若檢測到航空器處于該攝像頭檢測區域并處于運動狀態,則Ii=1;否則Ii=0。除地面保護區內航空器,獲得空管著陸許可航空器在距接地點數公里時,跑道必須為清空狀態,此時攝像頭無法捕捉空中正在著陸航空器的圖像信息。該飛機狀態需通過塔臺管理系統接口獲取航空器是否處于獲得著陸許可狀態。I0作為飛機著陸許可狀態位,連接塔臺管理系統接口,發布著陸許可時I0=1,否則為0。當攝像頭檢測信號與著陸許可信號中有兩個及以上信號為真時,判定發生跑道侵入。本研究選擇數字電路處理檢測信號,該電路使用半加器,當輸出Output=1時跑道侵入發生;Output=0時為正常狀態。邏輯電路如圖6所示。

圖6 跑道侵入信號檢測邏輯電路圖

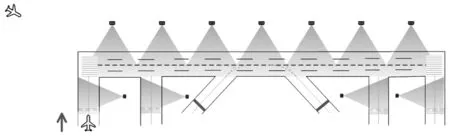

常見的跑道侵入有三種相對位置關系。第一種空管發布航空器著陸許可,跑道等待線外航空器進入地面保護區,地面飛機造成跑道侵入。該情況下著陸許可狀態信號I0=1,滑行道上第i個攝像頭檢測到航空器進入地面保護區且為運動狀態,Ii=1。如圖7所示。

圖7 穿越跑道航空器進入被著陸航空器占用的跑道

第二種當空管發布航空器起飛許可后,跑道等待線外的航空器進入地面保護區造成跑道侵入。該情況下,跑道上第i個攝像頭檢測到起飛航空器處于地面保護區內且為運動狀態,信號狀態Ii=1,同時滑行道上第j個攝像頭檢測到航空器進入地面保護區且為運動狀態,信號狀態Ij=1。如圖8所示。

圖8 穿越跑道航空器進入被起飛航空器占用的跑道

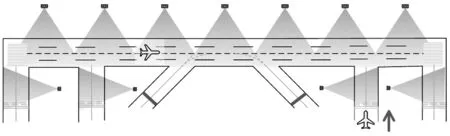

第三種當空管發布航空器穿越跑道許可后,跑道端航空器起飛或空管發布航空器著陸許可造成跑道侵入。此時,跑道上第i個攝像頭檢測到起飛航空器處于地面保護區內且為運動狀態,信號狀態Ii=1,或空管發布著陸許可I0=1,同時滑行道上第j個攝像頭檢測到航空器進入地面保護區且為運動狀態,信號狀態Ij=1。如圖9所示。

圖9 起飛/著陸航空器進入被穿越跑道航空器占用的跑道

3 實驗結果與分析

3.1 數據集與實驗環境

文獻[12]中的Mask R-CNN模型基于COCO數據集進行神經網絡訓練。但COCO數據集包含的目標種類多,且多數目標所處場景復雜,在實驗本文提出的地面保護區目標識別時效果較差。目前沒有專門用于機場地面保護區目標識別的數據集,本文自建地面保護區航空器、車輛和人員圖像數據集,該數據集主要來源于運輸機場監控視頻、民航研究所數據、中飛院空管安全研究所數據以及部分PASCAL航空器數據集。模型利用開源數據集標注工具BBox-Label-Tool對數據集中的目標物體進行標記。本文通過遷移學習,基于COCO數據集訓練權重模型建立訓練樣本數據集,訓練效率和檢測精度得到顯著提升。

本文模型使用的軟硬件具體型號如表1所示。

表1 軟硬件清單

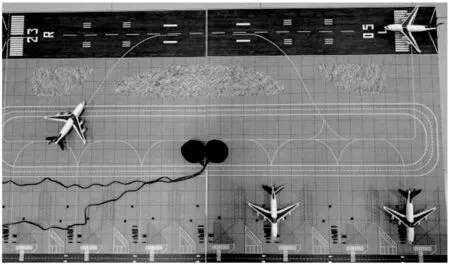

此外由于條件限制,無法得到機場許可在現場安裝攝像頭,因此在中國民航飛行學院空中交通安全管理實驗室使用1:2 000沙盤模型模擬機場環境,對模型進行測試驗證,沙盤模型如圖10所示。

圖10 1:2 000機場跑道模型

3.2 測試結果

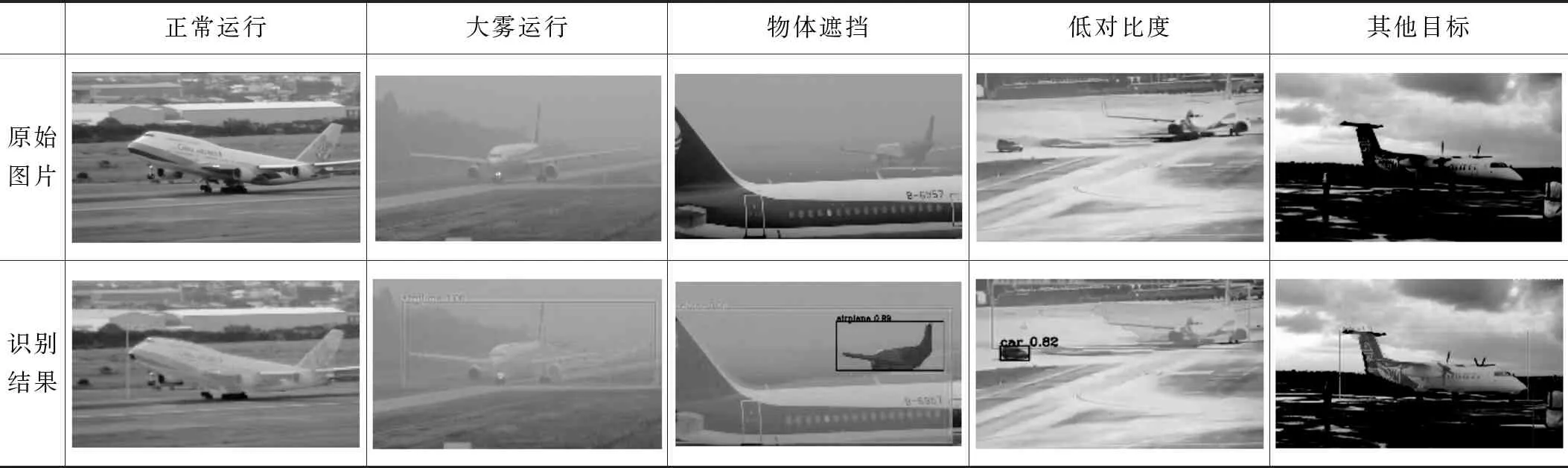

本文在準確率測試中挑選500張正樣本以及300張負樣本,樣本包括凈空條件正常時航空器正面、側面和俯視航空器的檢測效果,航空器和車輛、人員同時出現在畫面中的檢測效果,背景與航空器低對比度的檢測效果,含航空器遮擋、重疊的檢測效果和大霧天氣航空器檢測效果,部分測試的效果圖如表2所示,測試結果見表3。

表2 目標檢測測試效果

表3 測試結果準確度

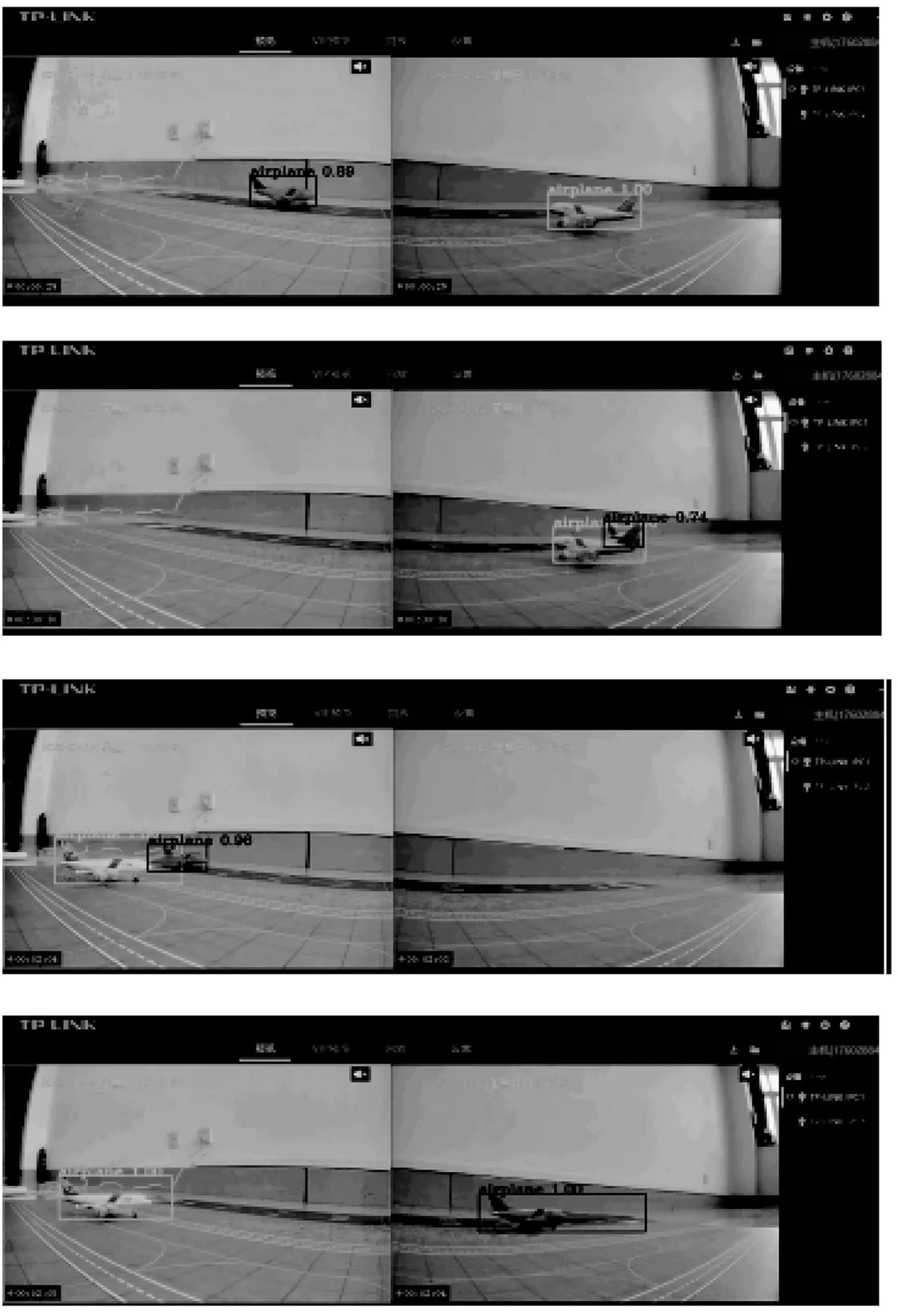

根據機場地面保護區發生跑道侵入的情況,使用航空器模型在機場沙盤模型上模擬跑道侵入場景。圖11演示了23號跑道上有航空器起飛時,另一架航空器滑過等待線進入地面保護區的情況;以及航空器穿越23號跑道時有航空器開始起飛的情況。實驗顯示,該跑道侵入檢測模型準確率可以達到95%,平均運行時間達到3.7 fps。

3.3 實驗結果分析

本實驗模擬跑道侵入實際發生狀況,演示了包括:航空器穿越被著陸航空器占用的跑道、航空器穿越被起飛航空器占用的跑道、起飛/著陸航空器使用被穿越跑道航空器占用的跑道三種情形的跑道侵入。

圖11 跑道侵入檢測效果圖

由實驗結果可知,因機場背景相較其他場景更加簡單,本文模型對凈空條件正常的場景下航空器識別效果非常精確。大霧天氣中的航空器,大霧條件高于機場最低運行能見度條件時,對航空器識別準確率影響不大。當拍攝畫面中有航空器重疊時,航空器識別效果會變差,但航空器在地面保護區正常運行時,極小概率出現同一有效檢測區域有多架航空器出現且重疊的情況,且航空器運動過程速度較快,重疊對判斷航空器發生跑道侵入的準確率影響不大。測試中發現,當航空器顏色與背景顏色對比度較低或沒有明顯顏色區分時,航空器識別準確率影響較大。通過分析訓練樣本,低對比度圖像多為攝像頭機位較高、像素低圖像較模糊情況。攝像頭機位較高,拍攝時易出現從上往下看航空器與滑行道顏色相近的情況。該情形下可通過降低攝像頭的安裝位置以及調整攝像頭仰角,避免圖像中目標與背景對比度過低的問題。本文提出的防止跑道侵入模型檢測跑道侵入事件的準確率取決于對航空器運動狀態識別準確率,目標識別的實時性基本滿足航空器實際運行要求。

綜上,本文提出的基于Mask R-CNN的航空器檢測模型能夠有效識別機場地面保護區的航空器、車輛和人員,將識別結果轉換為信號,根據信號判斷地面保護區內目標的相對位置關系和運動狀態信息,從而準確判斷跑道上是否發生了跑道侵入,由此減少機場不安全事件的發生率。

4 結束語

本文提出的方法是一種低成本、高效率的減少機場不安全事件的方法,通過遷移學習使用Mask R-CNN模型對機場地面保護區相關目標進行識別;還結合攝像頭獲取地面保護區圖像信息,提出攝像頭的布局方案,設計一種基于電信號判斷發生跑道侵入的邏輯電路方法,有效地減少機場跑道不安全事件的發生,為沒有能力配備場監設備的中小機場提供了一種低成本防跑道侵入技術方案,具有廣闊的應用前景。