基于AttentionGAN和形態學重建的TFT陣列缺陷檢測

陳煒煒, 嚴 群,2*, 姚劍敏,2

(1. 福州大學 物理與信息工程學院,福建 福州 350108;2. 晉江市博感電子科技有限公司, 福建 晉江362200)

1 引 言

隨著科技的發展,智能終端融入了我們生活的方方面面。TFT-LCD屏幕在智能終端與人的交互中扮演著重要的角色,它的顯示質量直接影響著產品的用戶體驗。因此,TFT-LCD的缺陷檢測在面板制造過程中顯得舉足輕重。

當下,絕大多數面板廠商都是通過人工來完成缺陷檢測。對于追求高產能、高利潤的面板廠商,人工檢測不僅可靠性差,耗費的時間、人力成本也大。隨著機器學習的成熟[1]及深度學習的快速發展,越來越多的神經網絡應用于工業缺陷檢測[2-3]。

基于卷積神經網絡的TFT-LCD缺陷檢測研究工作正在迅速發展中。Chen等采用4種神經網絡方法識別TFT-LCD光刻工藝中的面板缺陷[4];曾毅等利用均值差分和BP神經網絡相結合的方法進行TFT-LCD缺陷檢測[5];歐先鋒等針對TFT-LCD表面缺陷對比度低、邊緣模糊以及容易受圖像噪聲的干擾而導致難以識別的問題,建立全卷積神經網絡實現端到端的快速檢測[6];何俊杰基于傳統的圖像處理方法如閾值分割和Faster R-CNN對TFT-LCD的電子線路缺陷進行檢測[7];Ling Ma等對高分辨率圖片進行子圖片的分割后利用GoogLeNet進行缺陷的分類[8]。

目前將生成對抗網絡直接用于TFT-LCD缺陷檢測的相關工作較少,相關研究工作都是基于公開數據集圍繞異常檢測展開。Samet Akcay[9]等提出了一種半監督異常檢測,可以實現在無異常樣本的訓練下對異常樣本進行檢測,并在CIFAR10[10]、MNIST[11]等公開數據集上取得不錯的檢測效果;Zhixuan Zhao等基于生成式對抗網絡和自編碼器提出了一種僅基于正樣本訓練的新型缺陷檢測框架,于DAGM2007進行測試[12];Hu等基于DCGAN提出了一種無監督的布匹檢測方法[13]。

本文為TFT陣列缺陷檢測提供了一種新思路,利用生成式對抗網絡將圖像顯著性與缺陷檢測相結合,所用的訓練數據集無需人工標注,解決了人工標注時間及人力成本大的問題。該方法基于生成式對抗網絡最新的研究成果AttentionGAN[14-15]得到顯著性圖像[16]生成器,基于顯著性圖像依次得到顯著性最低的種子點、缺陷標記圖像、缺陷掩膜圖像,進而利用二值形態學重建[17]的區域生長方法[18]進行缺陷的分割及定位。

2 系統概述

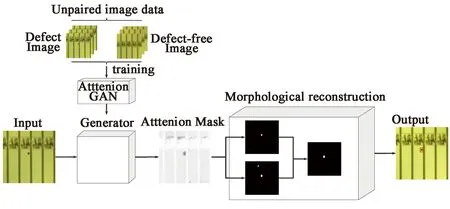

液晶面板的制程分為陣列、彩膜、成盒、模組、整機五大制程[19],本文所用數據集從陣列廠產線的AOI設備采集而來。圖1展示了本文TFT缺陷檢測方法的整體流程圖。該方法的第一步是裁剪圖像的文本區域并訓練AttentionGAN;第二步是利用訓練好的顯著性生成器生成待檢測圖片的顯著性圖。由于顯著性圖像中前景背景區分度不高會導致基于固定閾值的分割效果不佳,為了優化這個問題,第三步是在顯著性圖上尋找顯著性最低也即灰度值最小的像素點作為種子像素,基于種子像素的灰度值找到二個不同的閾值得到缺陷標記圖像與缺陷掩膜圖像,再進行二值形態學重建的區域生長,最后得到缺陷的外接矩形框。

圖1 TFT陣列缺陷檢測系統示意圖

3 基于注意力機制的生成式對抗網絡

3.1 生成式對抗網絡

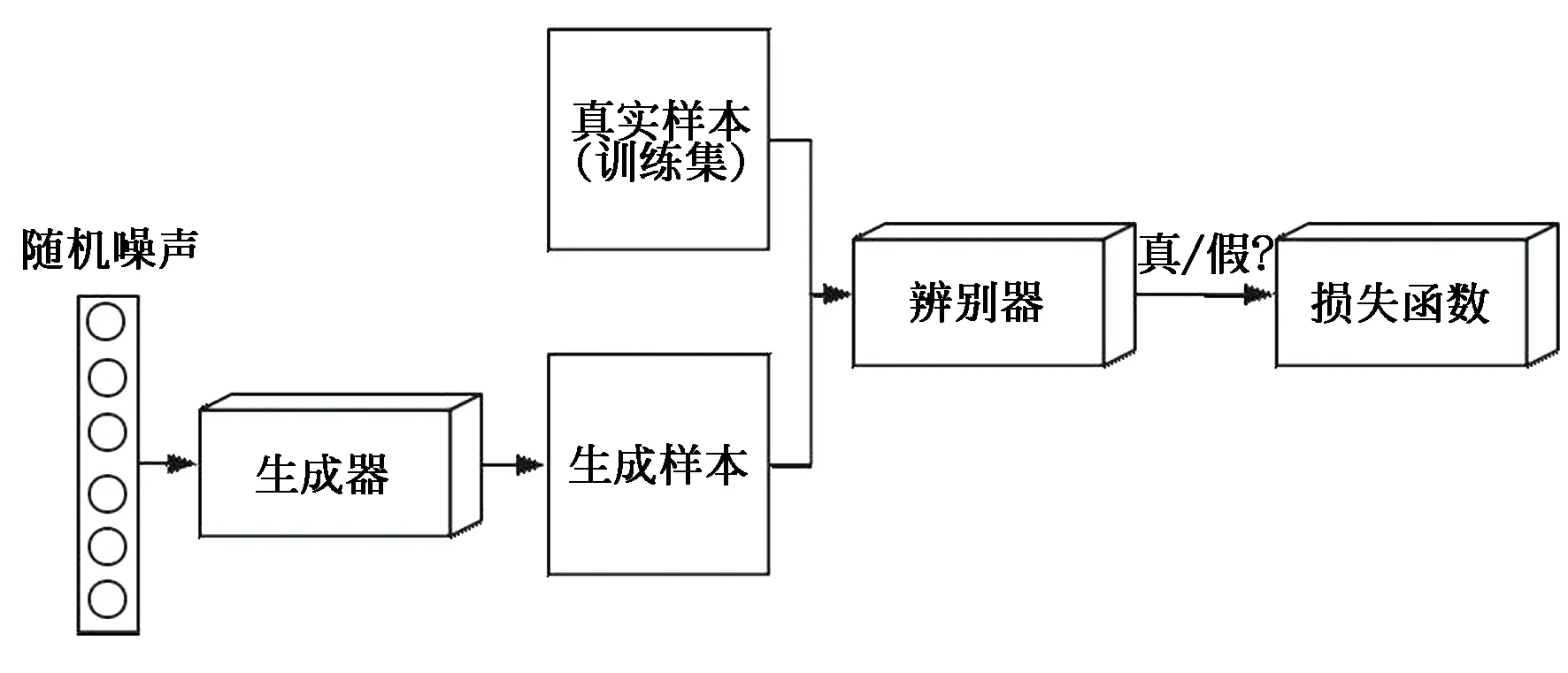

生成式對抗網絡[20](Generative adversarial Networks,GAN)是一種核心思想來源于博弈論的訓練網絡。如圖2所示,生成對抗網絡由以下兩個部分構成:生成器和辨別器。輸入隨機噪聲,生成器試圖生成能夠欺騙過判別器的偽樣本,相反地,判別器盡可能地去判別所給樣本的真實性。兩者在這樣的對抗中不斷優化生成網絡和辨別網絡。生成對抗網絡的總損失函數定義如式(1):

圖2 生成式對抗網絡

,

(1)

其中:E表示概率分布;x~pdata代表從真實樣本中的數據分布中隨機抽取x;z~pz代表從高斯噪聲的隨機分布中抽取z,其中,z為高斯噪聲;G、D分別為生成器和判別器;pdata為真實樣本的概率分布;pz為高斯噪聲的概率分布。

3.2 基于注意力機制的生成式對抗網絡

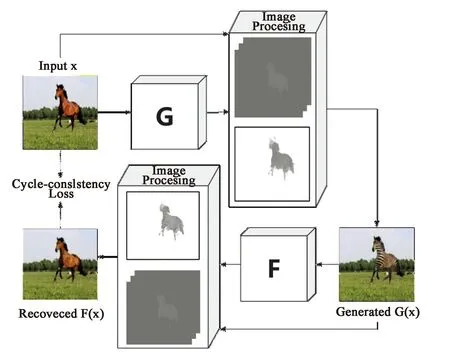

GAN廣泛應用于高分辨率圖像生成、視頻生成、圖像翻譯等領域。在圖像翻譯工作pix2pix[21]中,輸入輸出成對的數據集難以收集,后來的工作如CycleGAN[22]、DualGAN[23]、DiscoGAN[24]解決了pix2pix的痛點,不需要配對的訓練集,而只需源域的數據集合與目標域的數據集合,就能學到兩者相互的映射關系。然而這些模型很容易受到冗余圖像信息的影響,并且在圖像翻譯過程中不能很好地關注圖像最具辨別力的語義部分。ContrastGAN[25]、InstaGAN[26]、SAGAN[27]等一系列工作雖然能使網絡獲得顯著性圖,但都引入了額外的網絡或者掩膜數據。如圖3的簡化框架所示,AttentionGAN可以通過學習區分前景和背景,也即可以直接通過生成器生成顯著性圖像并進行更好的圖像翻譯工作。綜上所述,AttentionGAN的訓練集易于收集,無需人工標注,并且能很好地關注圖像中最具辨別力的語義信息——極大地簡化TFT-LCD陣列缺陷的檢測工作量,生成更優的顯著性圖像,取得更優的檢測效果。

圖3 AttentionGAN網絡模型簡化框架

AttentionGAN使用的總損失函數如式(2):

L=LGAN+λcycle×Lcycle+λid×Lid

,

(2)

其中:LGAN、Lcycle與CycleGAN[27]一致,Lid采用一致性保持損失[28]。

結合AttentionGAN論文[15]與圖3可以得知,AttentionGAN生成兩張不同的顯著性圖片,分別是前景顯著性掩膜(Foreground Attention Mask)與背景顯著性掩膜(Background Attention Mask),他們的灰度值和為1。由于背景顯著性掩膜的可視效果更好,所以實際運用中AttentionGAN生成的顯著性圖只有背景顯著性掩膜。背景顯著性掩膜中,TFT陣列背景的顯著性比缺陷高,也即TFT陣列背景的灰度值比缺陷的灰度值大。

3.3 訓練策略

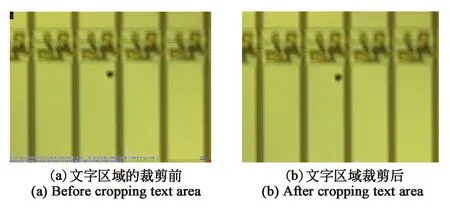

在訓練AttentionGAN之前,需要對圖像進行文字區域裁剪的預處理。如圖4所示,圖(a)為裁剪文字之前,圖(b)為裁剪文字之后。本文采用了王永城等人[29]提出的梯度計算的方法,將RGB圖像轉為灰度圖后計算垂直和水平方向的梯度值,接著根據梯度值的跳變確定圖像中文字的區域并裁剪。之所以不使用固定坐標對文字區域進行裁剪是為了提高檢測方法的通用性,不同種類的TFT產品文本區域大小不固定,采取通用的裁剪方法能使本文提出的檢測方法適配不同種類的TFT產品。

圖4 圖像預處理

訓練集分為缺陷域與非缺陷域兩部分,缺陷域圖片共1 496張,非缺陷域圖片共有1 438張。采用先縮放圖片到286×286,再從中隨機裁減出256×256送入神經網絡的圖像處理策略;設定圖片數量為8;初始學習率為0.000 2,β1=0.5,β2=0.999的Adam優化器。采用LSGAN[30]使訓練變得更穩定。訓練迭代200輪后,得到如圖5所示的顯著性圖像,其中,(a)、(b)為缺陷圖像的顯著性掩膜,(c)為無缺陷TFT的顯著性掩膜。

圖5 顯著性掩膜。 (a),(b)缺陷顯著性掩膜;(c)無缺陷顯著性掩膜。

4 基于顯著性圖的形態學重建

4.1 形態學重建

基本的數學形態學變換有膨脹、腐蝕、開運算、閉運算。膨脹運算利用結構元素對圖像進行填充;腐蝕運算利用結構元素對圖像進行收縮。直觀地說,膨脹能夠填補裂縫,腐蝕能夠消除邊界點。開運算是先腐蝕后膨脹, 它可以用來消除小物體, 擴大較小間隙;閉運算是先膨脹后腐蝕, 它可以消除狹窄的間斷,平滑邊界。膨脹、腐蝕、開運算、閉運算的數學表達如式(3)~(6)所示:

F⊕B(x,y)=max{F(x-s,y-t)+B(s,t)}

,

(3)

F?B(x,y)=min{F(x-s,y-t)+B(s,t)}

,

(4)

F°B=(F?B)⊕B

,

(5)

F·B=(F⊕B)?B

,

(6)

其中:⊕、?、°、·分別代表膨脹運算、腐蝕運算、開運算、閉運算。

形態學重建是圖像變換集中的一部分, 是一種提取圖像連通域的過程。形態學重建可以簡單理解為標記(Marker)圖像的重復膨脹,標記圖像不斷膨脹至其輪廓與掩膜(Mask)圖像相適配。形態學重建分為二值形態學重建與灰度形態學重建,本文所采用的方法為二值形態學重建。

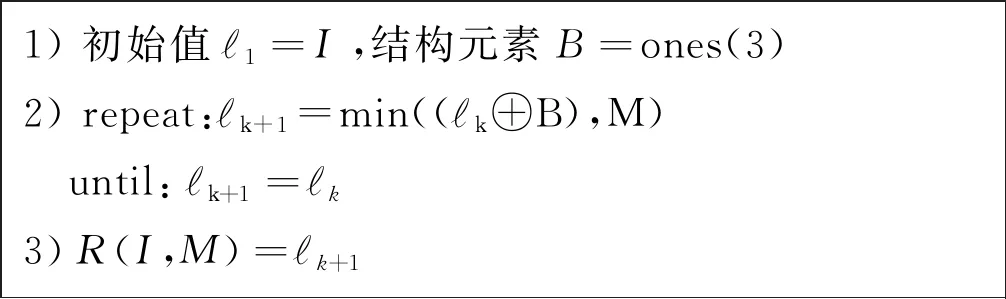

對于掩膜圖像M,標記圖像I,其中I?M,R(I,M)為根據M對I重建后的圖像。算法偽代碼表述如下:

1) 初始值?1=I,結構元素B=ones(3)2) repeat:?k+1=min((?k B),M) until:?k+1=?k3) R(I,M)=?k+1

其中,⊕為膨脹運算。

4.2 基于顯著性圖的形態學重建

理想情況下,帶有缺陷的TFT陣列的顯著性圖像都如圖5(b)所示,前景背景區分度高。實際情況下,受制于全自動光學檢測(AOI)設備采集的一手數據的圖像亮度與對比度變化,約有1/3的顯著性圖如圖5(a)、圖8(a)圖像所示,缺陷的顯著性與背景的顯著性相互干擾或者總體而言前景背景顯著性區別度不高。同時缺陷本身顏色過淡或者缺陷位于電路部件上也是導致前景背景顯著性區別度不高的主要原因。基于上述情況,提出了基于顯著性圖的形態學重建來優化前景背景顯著性區分度不高的問題。

假設顯著性圖x中缺陷區域的顯著性遠低于其他無缺陷區域,以顯著性最低的像素也即灰度值最小的像素作為種子點,得到種子像素灰度值δ1和生長像素灰度值δ2,以δ1為閾值對顯著性圖進行二值分割得到標記圖像I;以δ2結合形態學閉運算得到掩膜圖像M,其中形態學閉運算使用形狀為矩形的5×5內核矩陣。以I為初始標記點,M為區域生長準則,執行二值形態學重建R(I,M)的區域生長對缺陷進行分割,最后得到缺陷的檢測外接矩形框。種子像素灰度值δ1與生長像素灰度值δ2的定義見式(7)、(8):

δ1=min(x)+5

,

(7)

δ2=max(min(x)+20,170)

,

(8)

基于顯著掩膜的形態學重建算法流程圖如圖6所示。

圖6 形態學重建算法流程圖

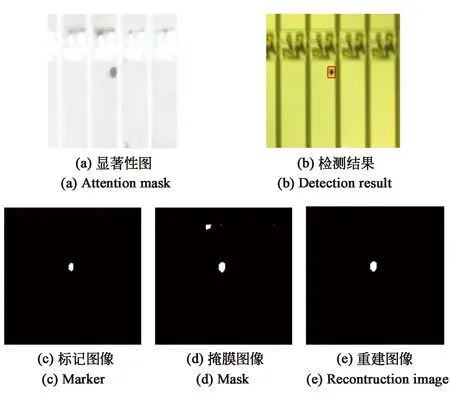

圖7將形態學重建算法的過程可視化。(a)(b)(c)(d)(e)五幅圖像分別為:顯著性圖、檢測結果圖像、以δ1為閾值的缺陷標記圖像I、以δ2為閾值的缺陷掩膜圖像M、形態學重建后的圖像。由顯著性圖(a)可以得到標記圖像(c)和掩膜圖像(d),基于(c)(d)得到形態學重建后的圖像(e),最終得到檢測結果(b)。

圖7 形態學重建算法流程可視化

5 實驗分析

5.1 評估指標

本方法對于缺陷的檢測可分為4組:缺陷圖片被正確檢出,缺陷圖片被誤檢為無缺陷圖片、無缺陷圖片被正確檢出,無缺陷圖片被誤檢為缺陷圖片,分別記為TP、FP、TN、FN。

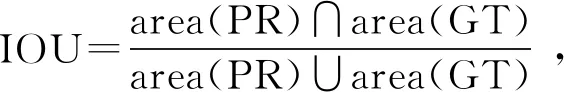

為了評價本方法的缺陷檢出能力,使用交并比(Intersection over Union, IOU)閾值為0.5的F1分數作為模型檢測及二分類性能評估標準。其中F1分數用來衡量二分類模型精確度,是模型精確率與召回率的調和平均。交并比(IOU)定義如式(9)所示:

(9)

其中:PR、GT分別為檢測模型的預測框、標注框。F1分數的定義如式(10)所示:

(10)

其中,精度(precision)與召回率(recall)定義如式(11)、(12)所示:

(11)

(12)

對于TFT-LCD陣列,面板廠商通常只關注面積占比最大的缺陷,因此用于評估的人工缺陷標注在每一張缺陷圖片上只有一個,且面積占比最大。因此當本方法檢測出多個缺陷時,取面積最大的檢測框與標注框進行交并比、F1的計算。

5.2 實驗結果

本文在處理器為Intel Xeon,顯卡為NVIDIA Tesla P100的RetHat服務器上進行了實驗。使用Python進行開發設計,其中,AttentionGAN基于Pytorch神經網絡框架。

用于測試的數據集共766張圖片,其中缺陷圖片743張,無缺陷圖片23張。在IOU閾值為0.5時,TP、TN、FP、FN分別為667,17,58,24。由此可以算出準確率為0.920,召回率為0.965,F1分數為0.942。

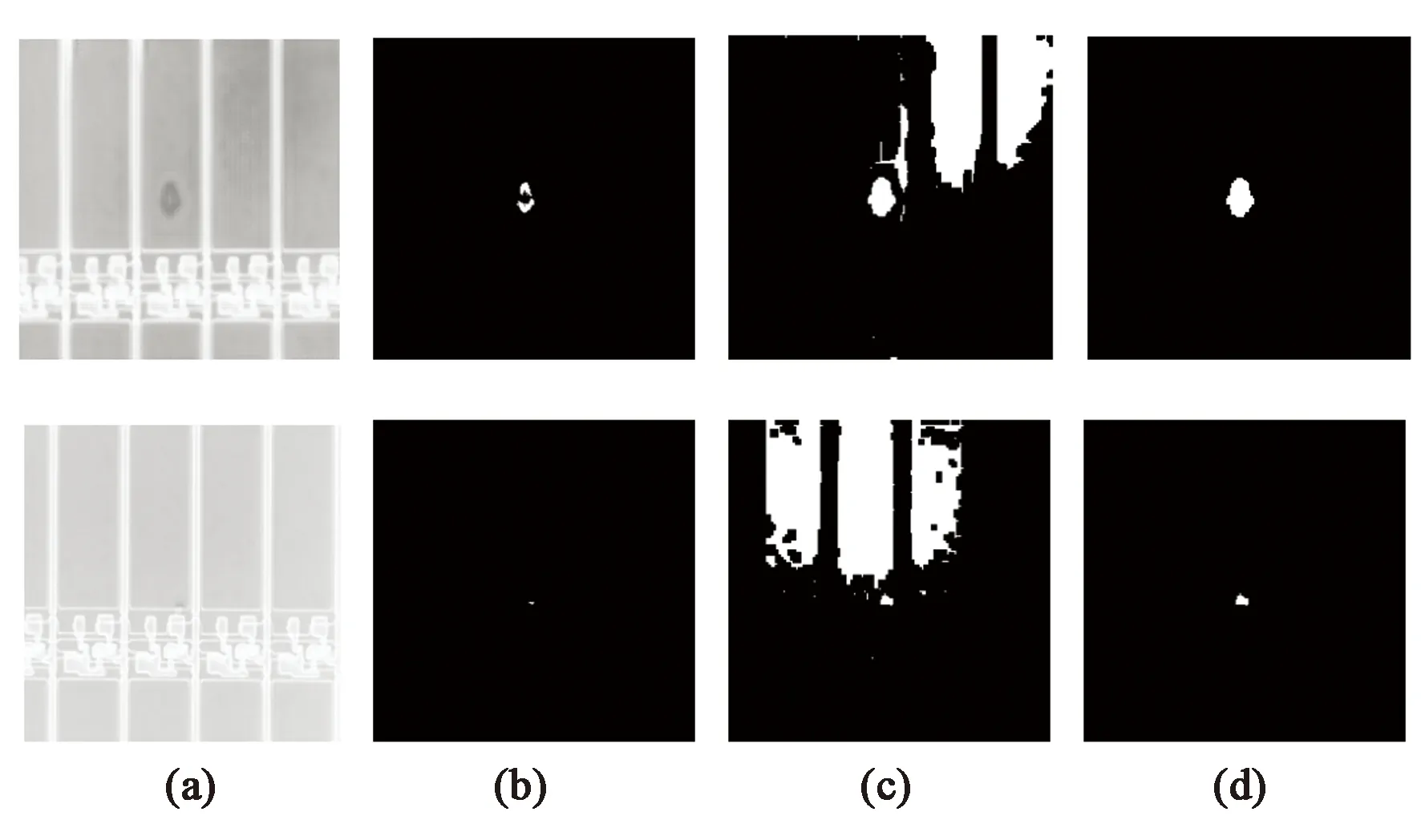

實驗表明,二值形態學重建的區域生長減小了背景與缺陷顯著性相近的缺陷圖像的誤檢率。如圖8(a)兩幅圖所示,當背景區域較深時,由AttentionGAN得到的顯著性圖像缺陷區域與非缺陷區域的顯著性相近,倘若就顯著性圖像以固定的閾值進行缺陷的分割檢測,那么得到的結果將如圖8中(b)、(c)所示,易發生欠分割或過分割。

圖8 實驗結果分析。 (a)顯著性圖;(b)以種子像素為閾值的二值圖;(c)以生長像素為閾值的分割圖;(d)形態學重建的二值圖。

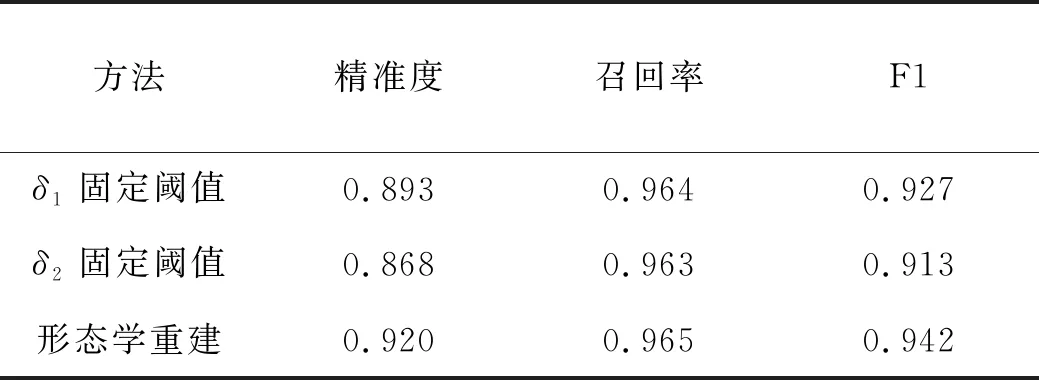

如表1所示,當只用種子像素δ1作為閾值直接進行二值分割時,精準度(Precision)只有0.893;當只用生長像素δ2作為閾值直接進行二值分割,精準度(Precision)只有0.868;當結合δ1、δ2,也即基于標記圖像與掩膜圖像進行形態學重建時,精準度(Precision)只提高了3%~6%,F1分數提高了2%~3%。

表1 不同閾值對顯著性圖像后處理的效果評估

6 結 論

本文提出了一種基于生成對抗網絡和形態學重建的TFT陣列缺陷檢測方法。其中生成式對抗網絡采用了引入注意力機制的AttentionGAN,對網絡進行訓練后,得到顯著性圖生成器,選取顯著性圖中顯著性最低的點作為種子像素,得到缺陷標記圖像、缺陷掩膜圖像后執行二值形態學重建的區域生長。值得注意的是,與通常的目標檢測卷積神經網絡不同,本文提出的方法所用的訓練集無須人工標注,解決了人工標注時間、人力成本大的問題。在交并比閾值為0.5時,能達到F1分數值為0.94的二分類結果。

在本方法的基礎上,可以繼續從以下方面展開優化工作:第一是收集更多的缺陷于電路部件區域的數據集,優化當缺陷位于TFT電路部件區域時顯著性不明顯的問題;第二是嘗試從已有的數據集中獲取能提高二值分割的先驗信息如平均灰度值等。