TargetedFool:一種實現有目標攻擊的算法

張 華,高浩然,楊興國,李文敏,高 飛,溫巧燕

(北京郵電大學 網絡與交換技術國家重點實驗室,北京 100876)

對抗樣本是指為了使分類器產生錯誤的分類結果,在原始樣本中加入輕微擾動后得到的攻擊樣本。敵手利用對抗樣本可以攻擊基于深度神經網絡的應用模型。現有的對抗攻擊按照敵手對模型的了解程度,可以分為黑盒攻擊[1-5]和白盒攻擊[6-9]。按照產生擾動的方法,可以分為基于梯度的攻擊方法、基于優化的攻擊方法和基于決策面的攻擊方法[10]。按照對抗攻擊的結果,可以分為有目標攻擊和無目標攻擊。有目標攻擊可以實現將攻擊目標擾動至特定類別,對于提供識別服務的系統構成了更大的威脅。

2014年,SZEGEDY等[11]首次提出基于L-BFGS優化算法[12]生成有目標對抗樣本的L-BFGS攻擊算法。由于采用線性搜索方法來尋找最優值,使得攻擊時間成本較高。隨后,GOODFELLOW等[6]基于梯度思想提出快速梯度符號函數法(Fast Gradient Sign Method,FGSM),能夠快速有效地生成對抗樣本。由于需要人為選擇擾動系數,使得該方法需要添加的擾動量較大。2016年,KURAKIN等[13]基于FGSM提出I-FGSM,利用迭代方式添加擾動,因此在通常情況下表現出比FGSM更強的白盒攻擊能力。2016年,PAPERNOT等[14]提出有目標的對抗攻擊方法,即JSMA,定義了輸入數據和目標類別之間距離的預測度量標準。由于在每次迭代中構建兩個敵對映射來選擇輸入特性非常耗時,因此JSMA的攻擊時間成本很高。2016年,MOOSAVI-DEZFOOLI等人[7]提出DeepFool,實現了基于梯度攻擊方式的白盒無目標對抗攻擊,通過計算圖片數據分布到決策面的最小距離,能夠較快地產生較小的擾動。2017年,MOOSAVI-DEZFOOLI等[15]基于DeepFool思想,通過計算多個距離的矢量和產生通用對抗擾動。通用對抗擾動使自然圖片被錯誤分類的可能性增高。

目前,很多機器學習平臺都具有對抗樣本工具包,例如Tensorflow[16]平臺的cleverhans[17]。DeepFool算法作為經典的對抗攻擊算法,雖然在機器學習平臺中具有廣泛的應用,但仍然缺少利用DeepFool算法思想進行有目標攻擊的研究。如何在高維空間中利用幾何關系求解擾動,并在有限的時間內實現特定的攻擊效果是本文研究的主要問題。

基于DeepFool算法思想提出TargetedFool算法,通過計算圖片數據分布到目標類別決策面的距離,能夠在較短的時間內實現有目標的對抗攻擊,并且產生的擾動人眼無法觀察到。筆者主要的貢獻如下:

(1) 基于經典對抗攻擊算法DeepFool提出TargetedFool算法,實現對DenseNet、Inception-v3、ResNet和VGG有目標對抗攻擊。

(2) 進行了廣泛的實驗比較,結果表明:筆者提出的算法在不同卷積神經網絡下都可以生成有目標的對抗樣本,在ImageNet數據集下平均魯棒性和擾動率指標均優于FGSM、IFGSM和JSMA。

(3) 分析了基于DeepFool的對抗攻擊算法無法產生有目標通用擾動的原因,發現不同圖片的決策邊界以及目標類別所在的空間不相同,相同擾動量無法將不同圖片擾動至相同的目標類別。

1 相關工作

SZEGEDY等[11]首次提出在深度神經網絡中存在對抗樣本,證明了深度神經網絡在單個單元的語義和不連續性方面都具有反直覺的特性。他們將生成對抗樣本的問題轉化為帶條件的優化問題,并且使用擬牛頓法中的L-BFGS算法[12]解決生成有目標對抗樣本的優化問題。L-BFGS攻擊采用線性搜索方法尋找最優值,搜尋過程非常耗時。

GOODFELLOW等人[6]認為神經網絡在高維空間中存在線性部分,在構造對抗樣本時應當關注擾動的方向而不是擾動的數目,擾動方向的選取根據損失函數梯度方向而定。FGSM通過最大化分類器將原始輸入分類到目標類別的概率,實現有目標對抗攻擊。由于擾動系數無法確定,FGSM產生的擾動量比較大。

KURAKIN等人[13]基于FGSM提出迭代攻擊算法,即I-FGSM。該方法用較小的步長多次應用FGSM算法生成擾動率更高的對抗樣本。與FGSM思想相同,I-FGSM最大化分類器將原始輸入分類到目標類別的概率,通過迭代的方式實現有目標對抗攻擊。

PAPERNOT等人[14]基于雅可比矩陣求出神經網絡的前向導數,構造顯著性列表用于搜索對分類結果影響最大的輸入向量,并將擾動大小限制在l0范數內。由于構造顯著性列表比較耗時,因此使用JSMA在大型數據集(例如ImageNet)上生成有目標的對抗樣本的時間成本較高。

MOOSAVI-DEZFOOLI等[7]首先分析在二元分類器下如何將原始輸入擾動至其他類別。他們使用點到直線距離公式計算出原始輸入到決策面的距離,將該距離添加到原始輸入后得到可以攻擊二元分類器的對抗樣本。多元分類器是二元分類器的擴展。針對多元分類器,他們計算原始輸入到多個決策面的距離,將最小距離添加到原始輸入后得到可以攻擊多元分類器的對抗樣本。在實際情況下,深度神經網絡的決策面具有高維非線性性質。因此,他們使用迭代方式向原始輸入添加擾動。隨后,MOOSAVI-DEZFOOLI等[15]基于DeepFool思想提出通用擾動。該方法通過計算多個原始輸入到決策面距離的矢量和得到通用擾動。利用該算法得到的擾動不僅能夠成功地擾動數據集中的大部分圖片,而且產生的擾動具有一定的泛化能力。該算法的核心在于通過多次迭代找到最小擾動,并將找到的最小擾動進行矢量和疊加,得到最終的通用擾動。

2 工作流程和符號定義

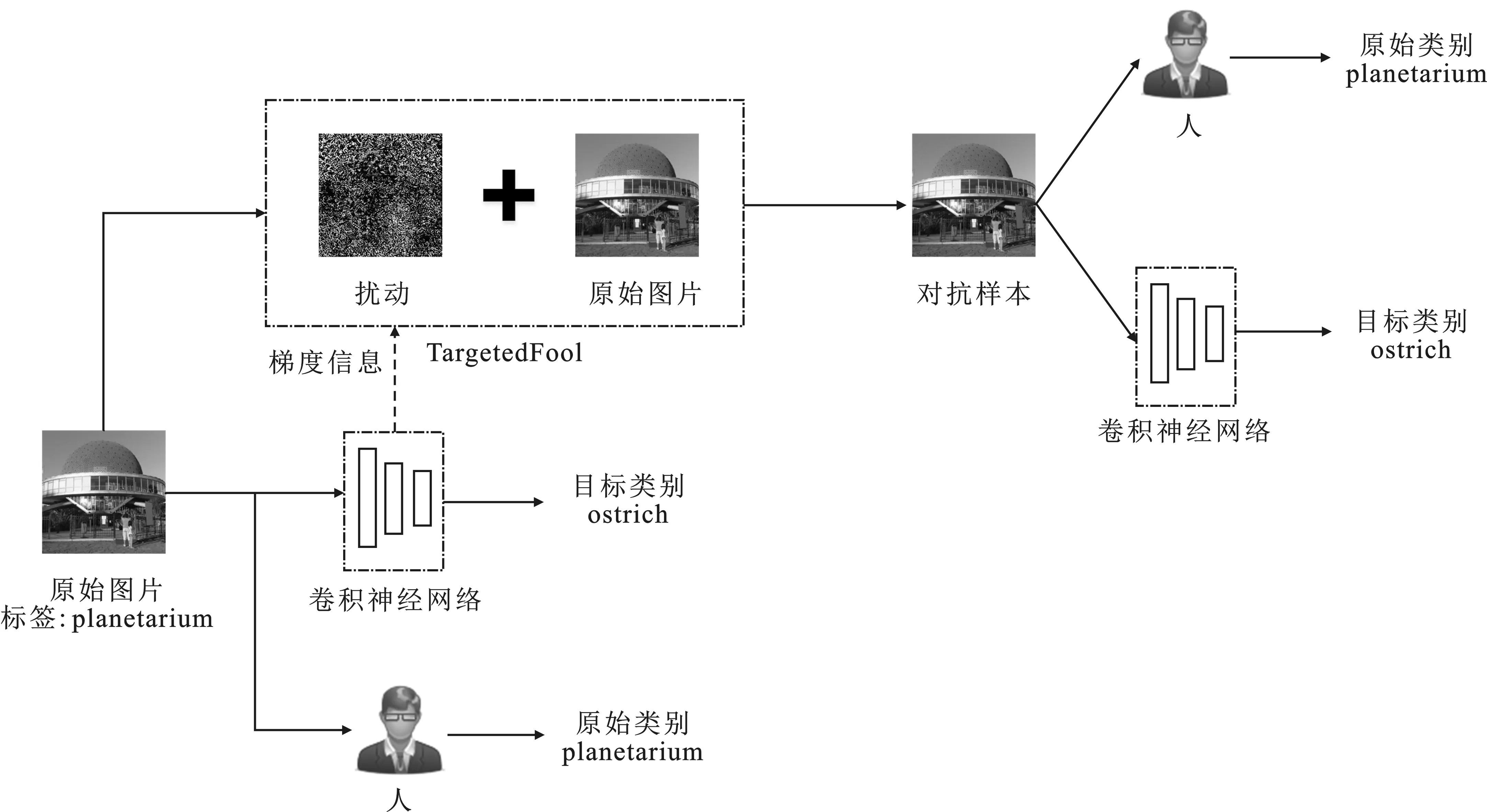

在已知模型的結構和參數下實現了有目標對抗攻擊。如圖1所示,有目標對抗攻擊根據原始圖片和梯度信息,利用TargetedFool算法產生特定的擾動,將該擾動添加到原始圖片中來生成對抗樣本,從而將卷積神經網絡對對抗樣本的分類結果擾動至目標類別。本文的攻擊目標是人對對抗樣本的分類結果仍然是原始類別,而卷積神經網絡的分類結果是目標類別。

圖1 有目標對抗攻擊過程示意圖

表1對本文所使用的符號進行了描述。該攻擊過程符號化描述如下。

表1 符號以及描述

(1)定義符號。I={i1,i2,…,in},是由原始圖片(ip,p∈[1,n])組成的集合;L={l1,l2,…,lm},是由原始標簽(lq,q∈[1,m])組成的集合;Ilk={x|f(x)=lk,x∈I},k∈[1,m],是由同一類別的圖片組成的集合。E={e1,e2,…,en},ej=ij+rj,t,j∈[1,n],集合中的每一項表示一個對抗樣本,其中rj,t是由TargetedFool算法產生的擾動。該算法的目的是使對抗樣本ej的類別為t。

(2)生成對抗樣本。ej=ij+T(ij,lt),?ij∈I和ij∈Ilk,j∈[1,n],T表示TargetedFool算法。

(3)實現攻擊。將對抗樣本輸入到卷積神經網絡中,得到lt=f(ej),其中lt是目標類別標簽。人的識別結果為lk=m(ej),其中lk是原始類別標簽,m表示人工操作。

3 TargetedFool算法

3.1 TargetedFool用于二分類

二元分類器應用廣泛,例如垃圾郵件分類識別。假定分類器f為原始輸入到原始標簽的映射,Rn→R。分類器可表示為

k(x)=sign(f(x))。

(1)

在線性情況下,設定映射函數f(x)=wTx+b,線性決策面F={x∶wTx+b=0}。基于DeepFool思想,將無目標攻擊推廣至有目標攻擊。如圖2所示,數據點x0屬于+1類別,目標屬于-1類別。由式(2)可以計算出數據點x0至線性決策面FL的最短距離r0(x0):

(2)

在實際情況中,決策面多數為非線性。如圖3所示,將r0(x0)添加到輸入數據中無法保證分類器一定產生特定的分類結果。因此需要按照式(3)迭代添加擾動:

(3)

圖2 一個線性二元分類器的對抗樣本示意圖 (實直線FL表示線性決策面)

圖3 一個非線性二元分類器的對抗樣本示意圖 (實直線FN表示真實的非線性決策面,線性決策面 FL=f(xi+f(xi)T(x-xi)為FN在xi點的線性近似)

3.2 TargetedFool用于多分類

基于二元分類器下TargetedFool算法的思路提出多元分類器下TargetedFool算法。多元分類器下存在多個決策面,因此多元分類器存在多維的分類結果。假定分類器f是原始輸入到原始標簽的映射,Rn→Rc,其中c是神經網絡輸出結果的維度。分類器由式(4)表示,其中fk(x)表示第k個分類器的輸出結果:

(4)

(1) 決策面為線性情況下生成有目標對抗樣本

設定仿射函數f(x)=WTx+b,當ft(x0+r)≥fk(x0)(x0+r)成立時,arg max(·)函數選擇最大值的自變量作為函數結果,最終的分類器結果是目標類別t。實現有目標攻擊需要滿足

(5)

其中,wt是W的第t列,表示目標類別權值。

多元分類器的決策面構成了式(6)所示的決策空間P:

(6)

當c=4,k(x0)=3時,P如圖4所示,其中目標類t為類別2,線性決策面為FLk={x:fk(x)-f3(x)}。

上述問題對應于計算數據點x0與目標決策面FL2的距離,通過計算數據點x0到目標類別決策面的距離,得到擾動:

(7)

圖4 k(x0)=3時,決策空間示意圖(實線表示線性決策面,虛線表示P的邊界)

其中,wt表示目標類別權值。數據點x0通過添加擾動r0(x0)可以使分類器產生特定的分類結果。綜上,在線性情況下找到了有目標的對抗樣本。

(2)決策面為非線性情況下生成有目標對抗樣本。

將TargetedFool算法推廣到非線性情況下。對于可微的多元分類器,需要迭代添加擾動。從圖5中可知,x0屬于類別3,目標類t屬于類別2,目標類別的非線性決策面為FNt={x:ft(x)-fk(x)(x)=0}。為了便于計算原始輸入到目標類別決策面的距離,通過計算非線性決策面FNt在點xi的線性近似,得到目標類別的線性決策面FLt={x:ft(xi)-fk(xi)xi)+ft(xi)T(x-xi)-fk(xi)(xi)T(x-xi)}。FL2是FN2在點x0的線性近似,在點x0垂直于決策面FL2方向上,FL2與FN2之間距離較大。單步添加擾動無法使數據點移動到目標決策空間,因此需要不斷迭代添加擾動,直到數據點x0移動到目標決策空間。

圖5 TargetedFool攻擊過程示意圖

使用分類器函數f(x)在點xi處的線性逼近來獲得f(xi)+f(xi)T(x-xi)。當不等式(8)成立時,分類器最終輸出類別為t。

ft(xi+ri)+ft(xi+ri)T(x-xi-ri)≥

fk(xi+ri)(xi+ri)+fk(xi+ri)(xi+ri)T(x-xi-ri) 。

(8)

通過計算數據點xi到目標類別決策面的距離得到擾動,擾動的公式如下:

(9)

TargetedFool算法通過計算原始輸入到目標類別決策面的最小距離產生擾動,因此TargetedFool算法生成的對抗樣本不僅能夠達到有目標的攻擊效果,同時擾動量也較小。在二范式下計算擾動,具體的算法設計見算法1。

算法1TargetedFool用于多分類。

輸入:圖片x,分類器f,目標類別t,有目標的對抗樣本xadv_t。

輸出:擾動r。

① 初始化x0←x,xadv_t←x,i←0。

② whilek(xi)≠tdo

③w'←ft(xi)-fk(xi)(xi)

④f′←ft(xi)-fk(xi)(xi)

⑥xi+1←xi+ri

⑦i←i+1

⑧ end while

⑨xadv_t←xi

4 實驗與結果分析

4.1 實驗設置

在典型的卷積神經網絡上測試TargetedFool算法,測試環境為:NVIDIA Corporation Gp102 [GeForce GTX 1080 Ti],測試中使用MNIST[18]、CIFAR-10[19]以及ImageNet[20]數據集。下面詳細描述不同數據集使用卷積神經網絡的具體情況。

MNIST:使用具有兩層卷積、兩層池化和兩層全連接結構的LeNet[21]卷積神經網絡。

CIFAR-10:調整了在ILSVRC 2012競賽中奪得冠軍的AlexNet[22]卷積神經網絡。

ILSVRC2012:使用Inception-v3[23]、ResNet[24]以及DenseNet[25]預訓練模型。

NIPS2017:使用Inception-v3預訓練模型。

4.2 評價指標

平均魯棒性:為了能更好地評估對抗攻擊的有效性,將DeepFool文章中提出的平均魯棒性[7]作為評估標準之一,定義為

(10)

其中,D表示測試集。在相同原始輸入和目標類別情況下,分類器的平均魯棒性越低,說明攻擊算法越有效。

擾動量:擾動的大小影響深度學習系統的運行效率,擾動量是對抗攻擊領域常用的衡量標準[26]。擾動量越多,越容易被人或檢測系統發覺。擾動量的定義如下:

r(x)=‖xadv-x‖p。

(11)

時間:算法生成對抗樣本的總耗時,時間可以作為算法運行效率的衡量標準。

4.3 實驗結果與分析

在不同卷積神經網絡下實現有目標對抗攻擊。表2展示了基于不同卷積神經網絡在ILSVRC2012驗證集上測試TargetedFool算法的效果。Top-1 error表示原始圖片在分類器下預測結果第一的類別與原始類別不同的概率。Top-5 error表示原始圖片在分類器下預測結果前五的類別與原始類別不同的概率。使用上述的評估標準對TargetedFool算法在不同卷積神經網絡下的測試結果進行評估。可以看出,TargetedFool算法能夠在平均時間0.45 s下實現對ResNet-34有目標對抗攻擊。

表2 測試結果

圖6 原始圖片的類別標簽為“husky”,目標類別標簽為“ostrich”

(6個擾動是在不同的卷積神經網絡下由TargetedFool算法生成的,這些擾動都可以將原始圖片類別標簽擾動為“ostrich”)

圖6展示了基于Pytorch環境在不同卷積神經網絡下將真實類別為“husky”圖片擾動到目標類別“ostrich”產生的擾動情況。算法通過不斷迭代直到成功將圖片擾動至目標類,因此針對不同卷積神經網絡TargetedFool算法,都可以產生相應的擾動,得到有效的有目標對抗樣本。

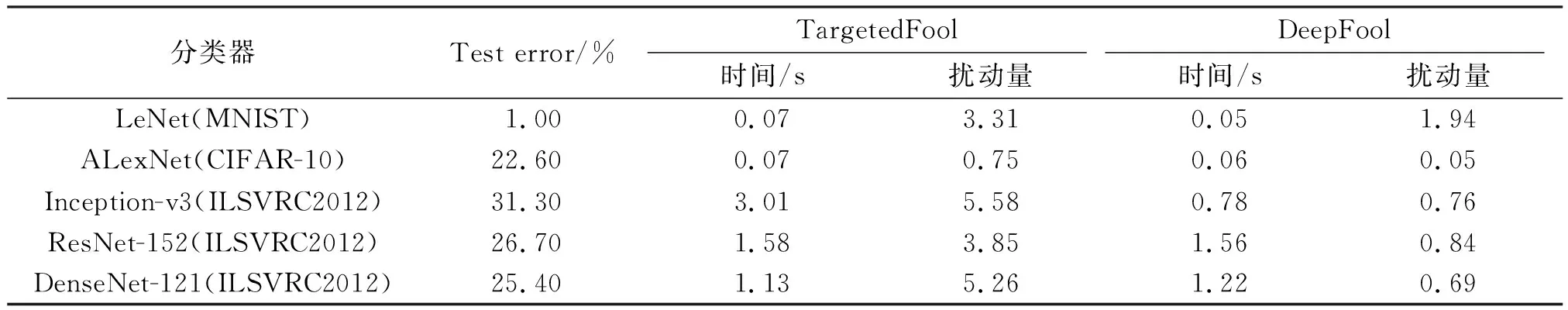

與DeepFool算法比較。表3展示了TargetedFool算法與DeepFool算法基于不同數據集和卷積神經網絡下生成對抗樣本的時間和添加到原始圖片的擾動量。TargetedFool算法和DeepFool算法生成對抗樣本的時間相近,而TargetedFool算法可以在有限時間內生成有目標的對抗樣本。盡管TargetedFool算法產生的擾動量大于DeepFool算法,人眼仍然無法識別筆者提出的算法生成的對抗樣本。

與有目標對抗攻擊算法比較。將TargetedFool算法與常用的有目標對抗攻擊算法進行比較。實驗環境:Inception-v3卷積神經網絡以及NIPS2017提供的數據集。從表4可知,FGSM在有目標攻擊下無法生成具有較高擾動率的對抗樣本,IFGSM、JSMA算法生成有目標的對抗樣本需要較長的運行時間,TargetedFool算法可以在有限時間內生成較高擾動率的對抗樣本。

表3 TargetedFool算法與DeepFool算法的比較

表4 在Inception-v3,NIPS2017,l2范式下,擾動率、時間、平均魯棒性、最大擾動系數以及 最大迭代次數(對抗樣本由FGSM,IFGSM,JSMA和TargetedFool生成)

圖7展示了不同對抗攻擊算法在Inception-v3網絡下生成的有目標對抗樣本。

圖7 在Inception-v3下使用FGSM、IFGSM-20、IFGSM-30、JSMA和TargetedFool算法生成的有目標對抗樣本

圖8 分析基于DeepFool的對抗攻擊算法 無法產生有目標通用擾動的示意圖 (F1,F2,F3分別為原始輸入X1,X2和X3的決策面,r1,r2和r3分別為原始輸入X1,X2和X3達到同樣的目標類別需要添加的擾動量)

圖7中第1列第1張原始圖片的原始類別是“long-horned beetle”,目標類別是“espresso maker”;第1列第2張原始圖片的原始類別是“espresso”,目標類別是“nail”。從圖中可知,FGSM沒有將原始圖片類別擾動到目標類別;IFGSM在迭代次數設定為30時,成功地將原始圖片類別擾動至目標類別;JSMA、TargetedFool算法生成的對抗樣本能夠達到預期效果。仔細觀察可知,IFGSM-30、JSMA生成的對抗樣本通過人眼識別可以觀察到一些擾動。

基于DeepFool的對抗性攻擊算法不能產生有目標通用對抗擾動。圖8給出了3個不同的原始輸入達到同一目標類別需要添加的擾動向量。由Fi={x:fi(x)-fk(x)(x)=0},i∈[1,3]可知,不同原始輸入的決策面不同。3個原始輸入的目標類別空間分別為A,B和C,3個原始輸入通過添加r1,r2和r3的矢量和后被移動到空間E。易知,空間E不是原始輸入X1,X2和X3的目標類別空間。綜上所述,3個不同的原始輸入添加擾動向量r1+r2+r3后能夠使分類器產生錯誤的分類,但無法達到同一目標類別。

使用ILSVRC 2012數據集在ResNet-34卷積神經網絡下進行了多組實驗。圖9給出了10個不同類別的原始圖片分別增加10個不同擾動產生的結果,其中10個不同擾動由TargetedFool將10個不同類別的原始圖片擾動到目標類別“ostrich”產生。通過觀察可以發現,將不同原始圖片擾動到目標類別“ostrich”需要添加的擾動明顯不同。通過交叉驗證發現,原始圖片添加交換后的擾動得到的樣本,有可能使分類器產生錯誤的分類,但無法將原始圖片擾動到目標類別。

5 緩解措施

針對對抗攻擊,常用的防御方法包括對抗訓練、網絡蒸餾和附加網絡方法。對抗訓練是指在訓練階段的每一步都生成對抗樣本,并將其注入到訓練集中。該方法能夠有效地提高深度神經網絡的魯棒性。對抗訓練對于單步攻擊(例如FGSM)防御效果明顯,而對于迭代攻擊的防御效果并不明顯[28]。網絡蒸餾最初的設計目的是通過將知識從一個規模較大的網絡轉移到一個規模較小的網絡,來減小深度神經網絡的規模。PAPERNOT等[29]使用網絡蒸餾來防御深度神經網絡對抗樣本。這種防御方式之所以有效,是因為深度神經網絡在訓練期間獲得的知識不僅被編碼在由網絡學習到的權重參數中,而且也被編碼在由網絡產生的概率向量中。因此,蒸餾這種方式可以從這些概率向量中提取類別知識,從而識別出樣本的真實類別。這種方式對于擾動量較小的對抗樣本,防御效果不明顯。在原有神經網絡結構下,附加生成對抗網絡(Generative Adversarial Networks,GANs)能夠有效防御對抗樣本[30]。該防御方法首先使用真實數據訓練GANs,然后通過GANs將對抗樣本的數據分布映射到真實分布。基于GANs的防御方法需要獲取真實數據訓練GANs,并且GANs訓練時間較長。筆者提出的TargetedFool算法可以實現白盒下的有目標攻擊。針對TargetedFool算法可以使用附加網絡方式進行防御,然而訓練附加網絡的時間成本較高。

圖9 實驗環境為Pytorch,ResNet-34卷積神經網絡(第1列表示原始圖片,第1行表示由第1列原始圖片擾動到目標類別“ostrich”產生的擾動,其余圖片表示原始圖片增加不同擾動后的結果(例如,第2行第3列的圖片是類別為“cougar”的原始圖片增加由類別為“white wolf”的原始圖片擾動到目標類別“ostrich”產生的擾動)

6 總 結

筆者提出了TargetedFool算法,可以實現在白盒情況下的有目標對抗攻擊。通過實驗驗證,TargetedFool在有限時間內可以達到預期攻擊效果。在ImageNet數據下的平均魯棒性和擾動率都優于FGSM、IFGSM和JSMA。通過理論和實驗分析了基于DeepFool的對抗攻擊算法無法產生有目標通用擾動的具體原因。如何提升有目標攻擊下對抗樣本的遷移性,將是后續研究的一個重要內容。