基于人工智能的課堂評價模式探究

郭曉旭

摘 要:時代和科技不斷發(fā)展,人工智能、“互聯(lián)網(wǎng)+”給教育帶來新的轉(zhuǎn)變,課堂教學(xué)評價模式也隨之帶來了新的變革。文章主要探討人工智能技術(shù)對課堂評價設(shè)計的應(yīng)用,提升教學(xué)效果,完善評價機(jī)制。

關(guān)鍵詞:多模態(tài);課堂評價;微表情識別;語音識別;動作識別

0 引言

目前,人工智技術(shù)能已經(jīng)融入人們生活的各方面,在課堂評價模式上也可以利用人工智能技術(shù)使評價模式更加全面和人性化,課堂評價可以結(jié)合人臉檢測與識別、學(xué)生肢體動作識別和語音識別。通過視頻的人臉檢測與跟蹤和微表情識別實現(xiàn)對學(xué)生學(xué)習(xí)狀態(tài)的分析,除此之外結(jié)合學(xué)生的肢體動作進(jìn)行肢體語言識別,將學(xué)生的表情狀態(tài)與肢體動作相結(jié)合評價學(xué)生學(xué)習(xí)的情況,通過語音識別輔助判斷目前課堂所處的積極狀態(tài),實現(xiàn)對學(xué)生學(xué)習(xí)狀態(tài)的分析,促進(jìn)課堂評價的全面性。

1 面部表情識別

微表情是一種持續(xù)時間非常短的表情,大多情況,很難察覺到它的存在。目前,微表情識別主要應(yīng)用于深度學(xué)習(xí)。最初,研究者[1]利用CNN從微表情視頻中提取特征,并用SVM等分類器對微表情類別進(jìn)行分類。這種結(jié)合方法與傳統(tǒng)手工提取特征相比,表現(xiàn)更好。后期,彭建國等設(shè)計了端到端的神經(jīng)網(wǎng)絡(luò),這種方法比傳統(tǒng)的方法(MDMO,F(xiàn)DM等)的識別率提升10%左右。懷謙等[2]提出用卷積層和遞歸層對微表情識別的訓(xùn)練。目前,使用預(yù)訓(xùn)練的殘差網(wǎng)絡(luò)用于微表情識別(見圖1)。

微表情數(shù)據(jù)集主要包括:芬蘭Oulu大學(xué)的SMIC(Spontaneous micro-expression corpus)和SMIC 2的兩個數(shù)據(jù)庫,中國科學(xué)院的3個數(shù)據(jù)集:CASME (Chinese Academy of Sciences micro-expression)[3]、CASME II[4] CAS(ME)2 、佛羅里達(dá)大學(xué)創(chuàng)建的USF-HD等數(shù)據(jù)庫。

2 人體動作識別

肢體動作的識別可以通過兩種方式來實現(xiàn):第一種通過穿戴設(shè)備采集行為數(shù)據(jù),這種方式因為需要設(shè)備支持因而較為昂貴;第二種是基于圖像識別對肢體動作進(jìn)行識別,目前肢體動作識別有深度學(xué)習(xí)、圖像局部特征提取等方式,圖像局部特征提取主要通過將人體動作分解為軀干移動和關(guān)節(jié)運動的方式去處理。對于基于深度學(xué)習(xí)的肢體動作識別主要有CNN網(wǎng)絡(luò)、LSTM循環(huán)神經(jīng)網(wǎng)絡(luò)和多網(wǎng)絡(luò)融合的網(wǎng)絡(luò)等去識別。

肢體動作識別主要是應(yīng)用肢體動作數(shù)據(jù)庫對模型進(jìn)行訓(xùn)練,完成動作的識別,目前公開的肢體識別數(shù)據(jù)庫主要包括Weizmann數(shù)據(jù)庫[5]、AUT交互數(shù)據(jù)集、ADL數(shù)據(jù)庫[6]、HOHA數(shù)據(jù)庫等。

3 語音識別

語音識別是將人的語言轉(zhuǎn)換為機(jī)器理解的語言,語音識別技術(shù)最初使用馬爾科夫模型-高斯混合模型(HMMGMM)作為主要框架,后期隨著深度學(xué)習(xí)的發(fā)展,DNN模型的識別效果更好,形成HMM-DNN模型,但該模型會受到多方面因素的影響,逐漸出現(xiàn)端到端的模型(End-ToEnd),該模型更加簡化,用深層網(wǎng)絡(luò)代替模塊,實現(xiàn)從聲信號直接映射到標(biāo)簽序列,簡化了語音識別模型的構(gòu)建和訓(xùn)練。

4 基于圖像識別與語音識別的課堂模式探討

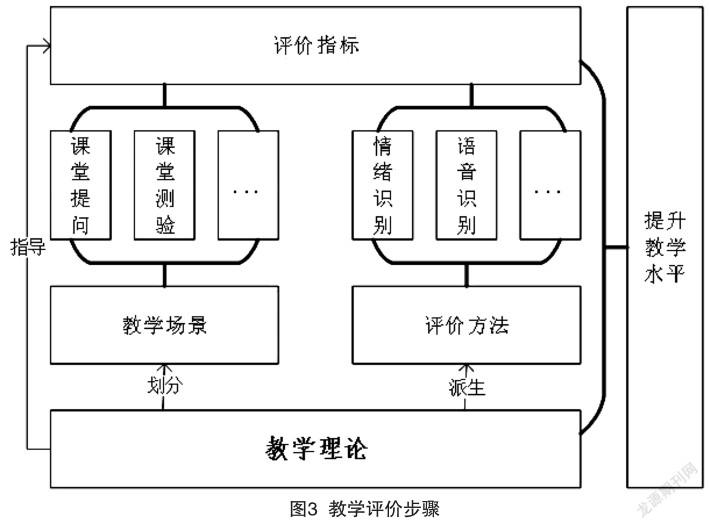

在傳統(tǒng)教學(xué)質(zhì)量評價方式中,學(xué)生學(xué)習(xí)內(nèi)容、方式、目標(biāo)被簡單地一致化,忽視學(xué)生個體的差異性[7-8],制定統(tǒng)一的標(biāo)準(zhǔn)讓大家去遵循,缺乏彈性、變通性和寬容性,在教學(xué)評價過程僅從單一層面分析教學(xué)過程,缺少評價的公平與完整性,需要從學(xué)生的面部表情、肢體動作變化和語言多個角度分析,因而本文結(jié)合語音識別、微表情識別、肢體動作識別量化、細(xì)化教學(xué)環(huán)節(jié)的評價標(biāo)準(zhǔn)去綜合評價教學(xué)過程,教學(xué)評價的過程如圖2所示,從而從多個方面提升教學(xué)質(zhì)量。如圖3所示,共分為如下步驟,分為兩個方面進(jìn)行開展,分別從圖像識別與語音識別兩個方向開展,基于課堂上的監(jiān)控系統(tǒng),采集課堂的視頻數(shù)據(jù),分別對視頻中的圖像和語音綜合地分析,語音分析學(xué)生在課堂中情況,學(xué)生在討論過程中,是否出現(xiàn)本學(xué)科內(nèi)容的關(guān)鍵詞,如果語音識別的內(nèi)容占整體比重較少的話,說明課堂的整體狀態(tài)欠佳。圖像識別學(xué)生上課實時的面部表情,判斷其上課的狀態(tài)對這3個方面建立評價考核體系,根據(jù)不同的教學(xué)階段對3個方面設(shè)置不同權(quán)重,綜合實時地評價教學(xué)過程。

4.1 數(shù)據(jù)采集

通過教室的監(jiān)控系統(tǒng)采集學(xué)生上課的情況,監(jiān)控系統(tǒng)盡量在教室的中間,對學(xué)生正面的形象可以采集得比較清晰,同時讓學(xué)生保持放松的狀態(tài),該部分也需要對課堂微表情數(shù)據(jù)進(jìn)行采集,方便對模型進(jìn)行訓(xùn)練,更適應(yīng)教學(xué)的環(huán)境和情景。

4.2 人臉檢測

教室光線環(huán)境復(fù)雜,人臉數(shù)目眾多,每一秒視頻又有很多幀圖像,這給人臉檢測與追蹤帶來了巨大的挑戰(zhàn)。人臉檢測的算法需要適用教室這個特殊的環(huán)境,并能實時有效快速地追蹤人臉是接下來進(jìn)行課堂狀態(tài)分析的重要保障,因而需要選擇適應(yīng)特定情況的算法,因為學(xué)生的臉的大小是不同的。

4.3 微表情識別

人臉表情復(fù)雜多樣,微表情又轉(zhuǎn)瞬即逝,學(xué)生課堂狀態(tài)的變化不容易被察覺,因而學(xué)生微表情的識別是關(guān)鍵部分,需要將人臉檢測與定位的人臉的圖片傳給微表情識別的模塊來完成對學(xué)生的課堂狀態(tài)進(jìn)行分析,劃分教學(xué)狀態(tài)。

4.4 學(xué)生肢體動作識別

僅從學(xué)生的面部表情評價學(xué)生的狀態(tài),過于片面,因而加入了學(xué)生的肢體動作檢測學(xué)生在課堂中的狀態(tài),運用體感技術(shù)基于人體動作作為參數(shù)去評價每一位學(xué)生的學(xué)習(xí)狀況,因為如果學(xué)生在教學(xué)的過程中,出現(xiàn)大幅度的肢體動作變化,說明這個學(xué)生的狀態(tài)不好,因而將表情與肢體動作相結(jié)合使結(jié)果更為全面,抽取更適用于課堂評價的肢體語言動作,減少檢測模板庫的冗余。

4.5 語音識別

通過視頻中的收集語音信息,對每一部分的語音進(jìn)行分析,查看語音內(nèi)容是否包含了學(xué)科內(nèi)容,根據(jù)學(xué)科內(nèi)容的相關(guān)性去分析。語音識別可以用于檢測課堂狀態(tài)的積極性,建立課程相關(guān)的語料庫。在課堂中,學(xué)生的話語中出現(xiàn)的課程相關(guān)的詞匯,說明學(xué)生處在學(xué)習(xí)的積極狀態(tài),當(dāng)課堂中出現(xiàn)大聲喧嘩且討論內(nèi)容與學(xué)習(xí)無關(guān),說明課堂處在學(xué)習(xí)的消極狀態(tài)。

4.6 評價模型

采集到多方面的數(shù)據(jù)之后,需要綜合的建立評價方式,這里需要數(shù)學(xué)和統(tǒng)計學(xué)的方法科學(xué)地統(tǒng)計,運用研究數(shù)據(jù)去統(tǒng)計跟蹤每一位學(xué)生的上課聽講狀況,將每個學(xué)生的視覺和聽覺的數(shù)據(jù)采集/整合分析,發(fā)現(xiàn)群體的問題和規(guī)律,同時找到個體差異,以及每個人學(xué)習(xí)、上課階段的差異,更好地應(yīng)用于學(xué)生上課狀況的跟蹤以及教師教學(xué)的調(diào)整,從而深化教學(xué)變革。

通過對上述數(shù)據(jù)的分析,對課堂的教學(xué)效果從實時分析學(xué)生學(xué)習(xí)狀態(tài)、階段性學(xué)生學(xué)習(xí)狀態(tài)、整節(jié)課學(xué)生的學(xué)習(xí)效果,在不同的階段實現(xiàn)對學(xué)生學(xué)習(xí)狀態(tài)分析,形成教學(xué)過程性的連續(xù)性的評價,將數(shù)據(jù)運用于教師講課水平的評價,使得每一位老師與每一位學(xué)生都保持著不可分割的聯(lián)系,激發(fā)學(xué)生的自信和課堂活躍程度,也可以通過不同的分?jǐn)?shù)對應(yīng)教學(xué)內(nèi)容查看問題與提升,同時內(nèi)容的評價給每一位老師提出建設(shè)性意見,推動實現(xiàn)智慧教室,實現(xiàn)教育信息化。

5 結(jié)語

面對當(dāng)前的教學(xué)過程評價缺少過程性評價的問題,本文利用人工智能技術(shù),將人臉識別、語音識別語音識別、肢體動作識別技術(shù)結(jié)合進(jìn)行研究,實時獲取學(xué)生的面部表情、肢體動作語音內(nèi)容進(jìn)行分析,從實時和綜合整節(jié)課/段時間的三個維度給學(xué)生打分,輔助評價機(jī)構(gòu)更加及時、準(zhǔn)確、客觀地分析評價學(xué)生和教師,對教師的教學(xué)效果給予過程性評價,對學(xué)生的學(xué)習(xí)習(xí)慣進(jìn)行實時分析,更容易發(fā)現(xiàn)問題,幫助教師對學(xué)生建立個性化的學(xué)習(xí)方式設(shè)計,精準(zhǔn)分析學(xué)生學(xué)習(xí)的狀態(tài)變化,構(gòu)建多維度的評價模型,對學(xué)生進(jìn)行多維度的分析,實現(xiàn)對學(xué)生在教學(xué)過程中情緒的變化的監(jiān)控,促進(jìn)學(xué)生的個性化發(fā)展。后續(xù)研究將會對教學(xué)過程進(jìn)一步細(xì)化,豐富評價機(jī)制。

[參考文獻(xiàn)]

[1]D PATEL, HONG X, ZHAO G. Selective deep features for micro-expression recognition[C].Mexico:International Conference on Pattern Recognition,IEEE,2017.

[2]KHOR H Q, SEE J, PHAN R, et al. Enriched Long-term Recurrent Convolutional Network for Facial Micro-Expression Recognition[C].Xi’an:IEEE International Conference on Automatic Face & Gesture Recognition,arXiv,2018.

[3]YAN W J,WU Q,LIU Y J. CASME database:A dataset of spontaneous micro-expressions collected from neutralized faces[C]. Shanghai:Proceedings of the 10th IEEE International Conference and Workshops on Automatic Face and Gesture Recognition(FG 2013),2013 .

[4]YAN W J,LI X,WANG S J. CASME II:An improved spontaneous micro- expression database and the baseline evaluation[J]. Plos One,2014(1):1-8.

[5]BLANK M,GORELICK L,SHECHTMAN E,et al.Actions as space-time shapes[C].Piscataway:Proceedings of IEEE International Conference on Computer Vision,IEEE,2005.

[6]MESSING R,PAL C,KAUTZ H.Activity recognition using the velocity histories of tracked keypoints[C].Piscataway:Proceedings of Recognition Using the Velocity International Conference on Computer Vision,2009.

[7]何祎.基于情感的課堂教學(xué)評價方法研究[D].錦州:渤海大學(xué),2015.

[8]鄭延福.本科高校教師教學(xué)質(zhì)量評價研究[D].徐州:中國礦業(yè)大學(xué),2012.

(編輯 王永超)

Research on classroom evaluation model based on artificial intelligence

Guo Xiaoxu

(Beijing Vocational College of Economics and Management, Beijing 100102, China)

Abstract:In the times and the continuous development of science and technology, artificial intelligence, “Internet+” have brought new changes to education, and the classroom teaching evaluation model has also brought new changes. This paper mainly discusses the application of artificial intelligence technology to classroom evaluation design, improving teaching effect and perfecting evaluation mechanism.

Key words:multimodal; classroom evaluation; microexpression recognition; speech recognition; action recognition