基于VGGNet-16遷移學(xué)習(xí)的男性胸肌發(fā)達(dá)程度識(shí)別模型①

(復(fù)旦大學(xué)體教部 上海 200433)

在健身、健美運(yùn)動(dòng)中,對(duì)于肌肉外形和發(fā)達(dá)程度的評(píng)價(jià),主要依靠個(gè)人主觀經(jīng)驗(yàn)判斷,對(duì)于初學(xué)者來說,這一方法缺乏一定的準(zhǔn)確性。卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks,CNN)在計(jì)算機(jī)圖像識(shí)別、分類工作上具有強(qiáng)大的優(yōu)勢(shì),利用CNN識(shí)別胸肌發(fā)達(dá)程度具有可行性[1]。

CNN在體育領(lǐng)域主要應(yīng)用于圖像識(shí)別和目標(biāo)檢測(cè),圖像識(shí)別是指利用計(jì)算機(jī)對(duì)圖像進(jìn)行處理、分析和理解,以識(shí)別各種不同模式的目標(biāo)和對(duì)象的技術(shù)[2]。例如,利用卷積神經(jīng)網(wǎng)絡(luò)對(duì)體育技術(shù)動(dòng)作關(guān)鍵環(huán)節(jié)進(jìn)行識(shí)別和特征提取,為運(yùn)動(dòng)技術(shù)識(shí)別、生物力學(xué)分析、運(yùn)動(dòng)損傷診斷等工作提供依據(jù)[3-5]。目標(biāo)檢測(cè)是一種基于目標(biāo)幾何和統(tǒng)計(jì)特征的圖像分割,可利用計(jì)算機(jī)圖像處理技術(shù)對(duì)目標(biāo)進(jìn)行實(shí)時(shí)跟蹤定位[6]。體育比賽中,識(shí)別運(yùn)動(dòng)員、球的位置和軌跡,具有重要的戰(zhàn)術(shù)利用價(jià)值[7-8]。

圖1 卷積神經(jīng)網(wǎng)絡(luò)拓?fù)浣Y(jié)構(gòu)

圖2 卷積層與卷積核

圖3 線性整流層及ReLU激活函數(shù)

圖4 池化層(Max Pooling)

VGGNet是由牛津大學(xué)計(jì)算機(jī)視覺組和Google DeepMind公司的研究員共同研發(fā)的一例經(jīng)典CNN模型,VGGNet在圖像分類、識(shí)別工作中具有較好的泛化能力,是提取圖像特征工程中較為常用的網(wǎng)絡(luò)模型[9]。該研究采用VGGNet-16遷移學(xué)習(xí)方式構(gòu)建胸肌發(fā)達(dá)程度的識(shí)別模型,探索利用計(jì)算機(jī)圖像識(shí)別技術(shù)智能化評(píng)價(jià)肌肉外形的可行性,為健身、健美愛好者提供一個(gè)方便的評(píng)價(jià)工具。

1 CNN與VGGNet-16

圖5 全連接層

圖6 VGGNet-16 的結(jié)構(gòu)圖

圖7 胸肌圖像數(shù)據(jù)集

卷積神經(jīng)網(wǎng)絡(luò)(CNN)是一種具有多層結(jié)構(gòu)的深度神經(jīng)網(wǎng)絡(luò),它是一種有監(jiān)督的學(xué)習(xí)網(wǎng)絡(luò),CNN帶有深層次卷積運(yùn)算,能夠自動(dòng)提取和學(xué)習(xí)圖像特征,運(yùn)用帶有標(biāo)簽(類別)的數(shù)據(jù)樣本對(duì)網(wǎng)絡(luò)加以訓(xùn)練,能夠逐漸形成輸入與輸出之間的映射關(guān)系,具有了對(duì)新樣本進(jìn)行預(yù)測(cè)和識(shí)別的能力[10]。CNN的一般結(jié)構(gòu)包括輸入層(Input)、卷積層(Convolutional layer)、線性整流層(Rectified Linear Units layer)、池化層(Pooling layer)、全連接層(Fully-Connected layer)和輸出層(outputs)(見圖1)。

輸入層(Input)用于數(shù)據(jù)的輸入,對(duì)于圖像分類任務(wù),輸入層是由圖像像素灰度值構(gòu)成的矩陣。

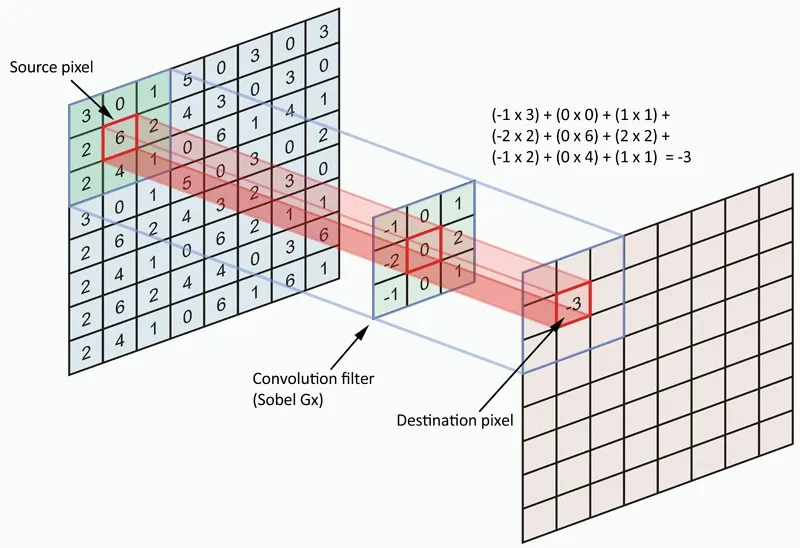

卷積層是圖像特征提取和特征映射的關(guān)鍵結(jié)構(gòu)。卷積層中包含一個(gè)m×n矩陣的卷積核,卷積核在輸入矩陣(源像素)上逐步滑動(dòng),每滑動(dòng)一步就與源像素上對(duì)應(yīng)的局部像素值相乘并相加,并映射到目標(biāo)像素值矩陣中,從而完成特征提取工作(見圖2)。

圖8 胸肌發(fā)達(dá)程度等級(jí)

圖9 圖像RGB三通道

圖10 采用VGGNet-16預(yù)訓(xùn)練模型(ImageNet)進(jìn)行遷移學(xué)習(xí)

圖11 遷移學(xué)習(xí)完成后的模型效果

線性整流層是將卷積層的輸出結(jié)果做非線性運(yùn)算,包含非線性的激勵(lì)函數(shù),常用的激勵(lì)函數(shù)有sigmoid、tanh、ReLU等(見圖3)。

池化層計(jì)算方式有最大池化和均值池化,池化層的作用是對(duì)圖像進(jìn)行降維,減小網(wǎng)絡(luò)的計(jì)算量,防止過擬合現(xiàn)象產(chǎn)生(見圖4)。

全連接層通常是一個(gè)BP神經(jīng)網(wǎng)絡(luò),在模型訓(xùn)練過程中,全連接層通過不斷調(diào)整權(quán)值,逐漸形成圖像特征與輸出目標(biāo)之間的關(guān)系映射,從而具備圖像識(shí)別能力(見圖5)。

輸出層用于最后輸出結(jié)果,對(duì)于圖像識(shí)別任務(wù),輸出層可使用softmax函數(shù)輸出對(duì)應(yīng)類別標(biāo)簽。

VGGNet是在傳統(tǒng)的CNN網(wǎng)絡(luò)上進(jìn)行了深度的增加,網(wǎng)絡(luò)層數(shù)達(dá)到16~19層,VGGNet包括VGGNet-16(見圖6)和VGGNet-19,16和19為網(wǎng)絡(luò)層數(shù)[11]。與以往的卷積網(wǎng)絡(luò)不同,VGGNet的每一個(gè)卷積層采用了多個(gè)3×3小卷積核,從而對(duì)圖像特征提取更加細(xì)致,準(zhǔn)確率大大提升。

2 胸肌發(fā)達(dá)程度識(shí)別模型VGGNet-16構(gòu)建

2.1 數(shù)據(jù)的采集與預(yù)處理

2.1.1 數(shù)據(jù)收集

通過現(xiàn)場(chǎng)拍照和網(wǎng)絡(luò)征集的方式采集不同發(fā)達(dá)程度的胸肌照片,采集對(duì)象為18~30歲的男性。要求上半身裸露的正面照,圖像光線充足、輪廓清晰、背景整潔,胸肌部分無遮擋(見圖7)。最終篩選出1500張照片建立數(shù)據(jù)集。

2.1.2 數(shù)據(jù)分級(jí)

圖12 混淆矩陣

圖13 分類錯(cuò)誤案列

將胸肌發(fā)達(dá)程度分成5個(gè)等級(jí),1~4級(jí)的胸肌發(fā)達(dá)程度依次增大,第5級(jí)為肥胖人群(見圖8)。聘請(qǐng)5名專家對(duì)1500張照片進(jìn)行逐一等級(jí)識(shí)別,定為該照片對(duì)應(yīng)的胸肌發(fā)達(dá)程度。

數(shù)據(jù)集歸類結(jié)果如表1所示。

2.1.3 訓(xùn)練集、測(cè)試集的劃分及數(shù)據(jù)集加權(quán)

劃分?jǐn)?shù)據(jù)集為訓(xùn)練集和測(cè)試集,訓(xùn)練集用于對(duì)VGGNet-16進(jìn)行訓(xùn)練,測(cè)試集在訓(xùn)練完成后對(duì)模型的準(zhǔn)確率進(jìn)行評(píng)估,測(cè)試集不參與模型訓(xùn)練過程,否則會(huì)導(dǎo)致過度擬合。數(shù)據(jù)集劃分過程中,先將數(shù)據(jù)集隨機(jī)化,使得各等級(jí)圖片在數(shù)據(jù)集中均勻分布,然后按照75%訓(xùn)練集、25%測(cè)試集的比例劃分,最終得到訓(xùn)練集和測(cè)試集數(shù)據(jù)如表2所示。

2.1.4 數(shù)據(jù)增強(qiáng)

深度學(xué)習(xí)算法需要大量的訓(xùn)練數(shù)據(jù),而該研究訓(xùn)練集僅有1125張照片,是一個(gè)極小的樣本數(shù)據(jù),容易造成模型過擬合現(xiàn)象,因此采用數(shù)據(jù)增強(qiáng)手段來增加樣本。對(duì)原始圖片進(jìn)行隨機(jī)的裁剪、旋轉(zhuǎn)、翻轉(zhuǎn)、縮放、亮度變換、模糊變換、標(biāo)準(zhǔn)化等一些列操作,人為地?cái)U(kuò)充樣本數(shù)量,從而提升模型的泛化能力。該研究采用以下數(shù)據(jù)增強(qiáng)手段(見表3)。

VGGNet-16的輸入層是一個(gè)224×224×3的矩陣,即一張寬224像素、高224像素、3通道(RGB)的圖片。經(jīng)過尺度變換后矩陣中的像素值由[0,255]縮放到[0,1]范圍內(nèi)(見圖9)。

2.2 模型的遷移學(xué)習(xí)與評(píng)估

遷移學(xué)習(xí)(Transfer Learning)是一種機(jī)器學(xué)習(xí)方法,是把源領(lǐng)域的知識(shí),遷移到目標(biāo)領(lǐng)域,使得目標(biāo)領(lǐng)域能夠取得更好的學(xué)習(xí)效果[12]。該研究采用ImageNet的VGGNet-16預(yù)訓(xùn)練模型作為源領(lǐng)域進(jìn)行遷移學(xué)習(xí),目標(biāo)領(lǐng)域?yàn)樾丶“l(fā)達(dá)程度識(shí)別。ImageNet的VGGNet-16預(yù)訓(xùn)練模型是指已經(jīng)用ImageNet數(shù)據(jù)集訓(xùn)練好的VGGNet-16模型,模型中的參數(shù)是在ImageNet圖像集上學(xué)習(xí)到的,使用預(yù)訓(xùn)練模型進(jìn)行遷移學(xué)習(xí),可以耗費(fèi)較少的資源,減少訓(xùn)練時(shí)間[12]。

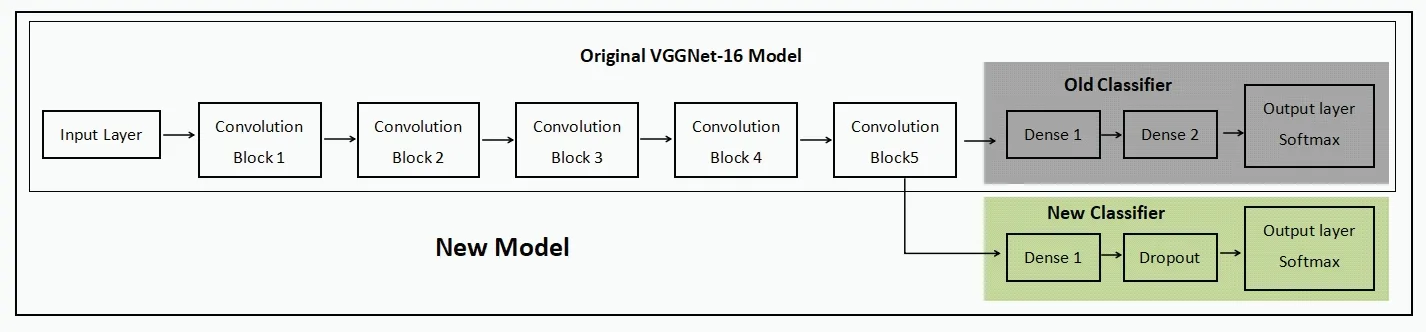

該研究借助開源人工神經(jīng)網(wǎng)絡(luò)庫Keras完成模型的構(gòu)建、訓(xùn)練與識(shí)別任務(wù),進(jìn)行遷移學(xué)習(xí)時(shí),復(fù)用原始VG GNe t-16預(yù)訓(xùn)練模型的卷積層部分(Block1~Block5),并將卷積層部分設(shè)置為不可學(xué)習(xí),而全連接層部分(Dense1、Dense2、Output Layer)替換為自己設(shè)置的全連接層(見圖10)。自設(shè)的全連接層包含一個(gè)隱藏層,神經(jīng)元個(gè)數(shù)為1024,采用ReLU激活函數(shù),隨機(jī)失活函數(shù)dropout=0.5,輸出層采用softmax分類函數(shù),損失函數(shù)采用交叉熵(crossentropy),學(xué)習(xí)率為lr=1e-5,訓(xùn)練迭代次數(shù)為30次。

圖11為模型分類效果,從圖中看到,在不斷地迭代訓(xùn)練過程中,在訓(xùn)練集上的分類準(zhǔn)確率(Training Acc)和在測(cè)試集上分類的準(zhǔn)確率(Test Acc)都在不斷上升,而在訓(xùn)練集上的損失率(Training Loss)和在測(cè)試集上的損失率(Test Loss)連續(xù)下降,在第15次迭代時(shí)逐漸達(dá)到平穩(wěn)。最終,模型在測(cè)試集上的準(zhǔn)確率達(dá)到84.0%,損失達(dá)到0.65,準(zhǔn)確率較原始的預(yù)訓(xùn)練模型有很大程度提高。

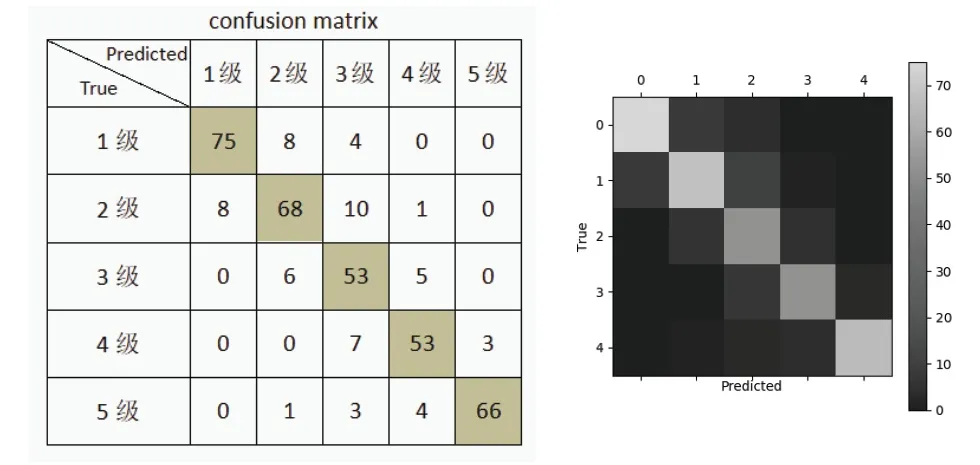

圖12是遷移學(xué)習(xí)完成后的模型在測(cè)試集上分類結(jié)果的混淆矩陣,矩陣中縱軸代表圖片真實(shí)等級(jí),橫軸代表模型識(shí)別的等級(jí)。理想情況下,矩陣中的數(shù)值分布在左上角到右下角的對(duì)角線上,即左圖中灰色區(qū)域(右圖中亮色區(qū)域),代表著預(yù)測(cè)準(zhǔn)確率達(dá)到100%。若其他區(qū)域數(shù)值不為0,說明在該類別上出現(xiàn)預(yù)測(cè)錯(cuò)誤,數(shù)值代表出現(xiàn)錯(cuò)誤的數(shù)目。例如,當(dāng)在真實(shí)等級(jí)為1級(jí)的87張圖片中,模型識(shí)別結(jié)果出現(xiàn)了12次錯(cuò)誤,其中8張圖片錯(cuò)誤的識(shí)別為2級(jí),4張圖片識(shí)別為3級(jí)。從矩陣中可見,模型對(duì)各個(gè)等級(jí)圖片的識(shí)別均有錯(cuò)誤,對(duì)角線邊緣模糊,說明模型在識(shí)別相鄰等級(jí)的圖片時(shí)容易出現(xiàn)混淆。

圖13為隨機(jī)抽取的9張預(yù)測(cè)錯(cuò)誤案列。通過觀察案例并結(jié)合混淆矩陣可得,模型對(duì)相鄰級(jí)別的圖片容易發(fā)生混淆,預(yù)測(cè)結(jié)果存在偏差,由于模型卷積層部分并沒有參與訓(xùn)練,因此可能是卷積層提取特征不全面導(dǎo)致。

2.3 模型的微調(diào)

對(duì)原始的VGGNet-16預(yù)訓(xùn)練模型(ImageNet)進(jìn)行微調(diào),開放部分卷積層。設(shè)置原始模型卷積部分Block1~Block3仍為不可學(xué)習(xí),而Block4和Block5設(shè)置為可學(xué)習(xí),使得部分卷積層為提取胸肌圖片特征而調(diào)整參數(shù)。全連接層部分(Dense1、Dense2、Output Layer)仍采用包含1024個(gè)神經(jīng)元的單隱藏層,學(xué)習(xí)率為lr=1e-5,訓(xùn)練迭代次數(shù)為30次(見圖14)。

圖14 Block4和Block5設(shè)置為可學(xué)習(xí)

圖15為進(jìn)行微調(diào)后的模型效果,從圖中看到,模型預(yù)測(cè)的準(zhǔn)確率逐漸提高,損失率逐漸下降,在第20次迭代時(shí)逐漸達(dá)到平穩(wěn)。最終,進(jìn)行微調(diào)后的模型在測(cè)試集上的準(zhǔn)確率達(dá)到95.2%,結(jié)果趨近完美,符合該研究對(duì)胸肌發(fā)達(dá)程度識(shí)別的需求。

圖15 遷移學(xué)習(xí)完成后的模型效果

圖16是對(duì)模型進(jìn)行微調(diào)后在測(cè)試集上預(yù)測(cè)結(jié)果的混淆矩陣,從圖中可見,大多數(shù)數(shù)值分布在對(duì)角線上,僅有極少數(shù)等級(jí)出現(xiàn)預(yù)測(cè)錯(cuò)誤,說明使用微調(diào)后的VGGNet-16對(duì)胸肌數(shù)據(jù)進(jìn)行遷移學(xué)習(xí),能夠很好地提取胸肌圖像特征,并能夠較為準(zhǔn)確地識(shí)別胸肌發(fā)達(dá)程度。借助Keras的相關(guān)方法可以查看模型中各個(gè)卷積層與池化層對(duì)圖像的特征提取據(jù)結(jié)果。VGGNet-16網(wǎng)絡(luò)層數(shù)達(dá)16層,隨著網(wǎng)絡(luò)的深入,圖像像素?cái)?shù)目減少,卷積核數(shù)量增加,從而提取更加細(xì)致的特征。圖17為模型對(duì)某胸肌圖片進(jìn)行識(shí)別,查看模型中第2層、第5層、第8層的卷積層對(duì)該圖片的特征提取結(jié)果,從圖中看到,模型經(jīng)過反復(fù)迭代訓(xùn)練,已經(jīng)能夠很好地適應(yīng)胸肌樣本,并成功地提取出胸肌的輪廓、顏色、紋理等特征,基于這些特征,將胸肌歸為等級(jí)3。

圖16 混淆矩陣

圖17 部分卷積層特征提取結(jié)果(部分圖片)

3 結(jié)論與建議

使用VGGNet-16預(yù)訓(xùn)練模型(ImageNet)對(duì)胸肌圖像進(jìn)行遷移學(xué)習(xí),經(jīng)過30次迭代訓(xùn)練后,模型識(shí)別胸肌發(fā)達(dá)程度的準(zhǔn)確率達(dá)到95.2%,損失達(dá)到0.0658,能夠很好地提取胸肌圖像特征,并能夠較為準(zhǔn)確地識(shí)別胸肌發(fā)達(dá)程度。

表1 各個(gè)等級(jí)胸肌圖像數(shù)量

表2 各個(gè)等級(jí)圖像數(shù)量

表3 對(duì)胸肌圖片進(jìn)行數(shù)據(jù)增強(qiáng)