基于深度學習的風機塔筒焊縫外部缺陷檢測

吳 忍,孫 淵

(上海電機學院機械學院,上海201306)

風機塔筒就是風力發電機的塔桿,主要起支撐和吸收風電機組振動的作用,為確保風機發電量的穩定可靠,風機塔筒要將風力發電機組支撐于60~100 m的高空。風機塔筒的結構型式主要有圓筒式、桁架式等,按照材料類型又可分為純鋼式、混凝土式等。目前,鋼制圓筒式塔架在國內外風電企業中應用最為廣泛。

風機塔筒的焊縫主要包括單節塔筒的內外縱縫,兩節塔筒組對后的內外環縫以及法蘭盤和筒節的拼接焊縫。目前我國的塔筒生產中主要采用風電塔筒大型焊機對塔筒進行自動化焊接,但是對于塔筒焊縫的無損檢測依然是完全依賴人工,檢測內容包括外部和內部缺陷檢測。對于外部缺陷,大多采用磁粉檢測(MT)、滲透檢測(PT)和渦流檢測(ET),但是由于風機塔筒體積龐大且焊縫分布不平,操作起來十分不便,效率不高[1]。隨著計算機技術和圖像處理技術的飛速發展,在目標檢測領域中,先后出現了數字圖像處理技術、機器學習和深度學習3種常用的檢測方法。數字圖像處理技術也就是傳統圖像處理技術,采集圖像時易受外界環境的噪聲干擾,泛化能力不強。機器學習在一定程度上能夠抵抗外界噪聲干擾,但是機器學習模型的參數設置和目標特征點都要人為設定,過分依賴經驗,因此精確度和效率無法得到保障。深度學習的出現解決了以上兩種目標檢測方法存在的問題,以卷積神經網絡(Convolution Neural Network,CNN)為基礎,出現了R-CNN、Fast R-CNN、Faster R-CNN、YOLO、SSD等多種目標檢測算法,不需要人為地進行特征提取。深度學習算法可自動進行特征提取,對目標進行檢測和分類,同時具有很高的檢測效率和準確性。

本文提出一種基于傳統圖像處理和CNN的風機塔筒焊縫缺陷檢測算法。該算法首先使用傳統圖像處理算法將工業相機采集到的焊縫圖像進行灰度化。然后對焊縫灰度圖像進行增強處理,改善圖像的視覺效果,清晰化圖像,便于計算機對圖像進行進一步處理分析。最后將圖像作為訓練好的CNN的輸入,通過CNN判斷焊縫外部是否存在缺陷。

1 傳統圖像處理

焊縫圖像的質量將會直接影響缺陷檢測的準確度。經過有效傳統處理的圖像,具有更好的缺陷特征和更高的識別度。本文將對原始焊縫圖像進行灰度化和圖像增強處理。

1.1 圖像灰度化

目前彩色圖片顏色空間包括RGB、CMY(K)、HSV和CIE-XYZ顏色空間,主流的顏色空間是RGB三通道彩色圖[2]。RGB圖像是以三維矩陣的方式存儲,訓練CNN時,需要對RGB 3種分量進行處理,將會增加網絡訓練的時間和難度,而且顏色本身容易受到光照等因素的干擾,很難提供準確的關鍵信息。因此,需要將采集到的彩色圖片灰度化,降低圖像的矩陣維數。

圖像經過灰度化之后,顏色信息丟失,但圖像的梯度信息仍然能保留下來。在焊縫的缺陷檢測中,為了識別出缺陷,最關鍵的因素是圖像的梯度,也就是圖像的邊緣信息。目前圖像灰度化的方法包括分量法、最大值法、平均值法和加權平均法。

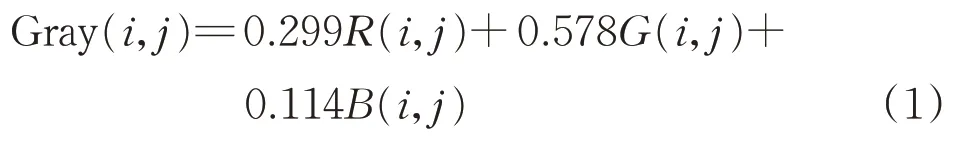

分量法是指將RGB圖像中三分量的亮度值分別作為3個灰度圖像的灰度值,根據后續的實際需求選取其中1個灰度值。最大值法是將RGB圖像中三分量亮度最大的亮度值作為灰度圖像的灰度值。平均值法是以RGB圖像三分量亮度值的平均值作為灰度圖像的灰度值。加權平均法是將三分量以不同的權值進行加權平均[3]。通常情況下,人眼對綠色最敏感,而對藍色最不敏感,對RGB圖像的三分量加權平均得到灰度圖像的灰度值為

式中:i,j為圖像中某一像素點在圖像中的位置坐標[4];R(i,j)為該像素點的紅色度值;G(i,j)為該像素點的綠色度值;B(i,j)為該像素點的藍色度值。

本文采用加權平均法對焊縫圖像進行灰度化,焊縫原圖像以及灰度化后的灰度圖像如圖1、圖2所示。

圖1 焊縫原圖

圖2 焊縫灰度圖像

1.2 圖像增強

通過圖像增強,圖像所含信息的質量和辨識度會得到有效提升,對于實驗觀察或者進一步的分析處理都十分有利。圖像的信息主要是通過某些特征傳達出來的,比如圖像的邊緣、輪廓以及對比度等。通過對這些圖像特征的突出和增強,可更好地顯示圖像的有效信息,提高圖像的使用價值。圖像增強按照作用域的不同可分為空域內處理和頻域內處理。空域內處理是直接對圖像進行處理;頻域內處理是在圖像的某個變換域內,對圖像的變換系數進行運算,再通過逆變換獲得圖像的增強效果[5]。本文采用空域內的圖像銳化方法對焊縫灰度圖像進行增強處理。

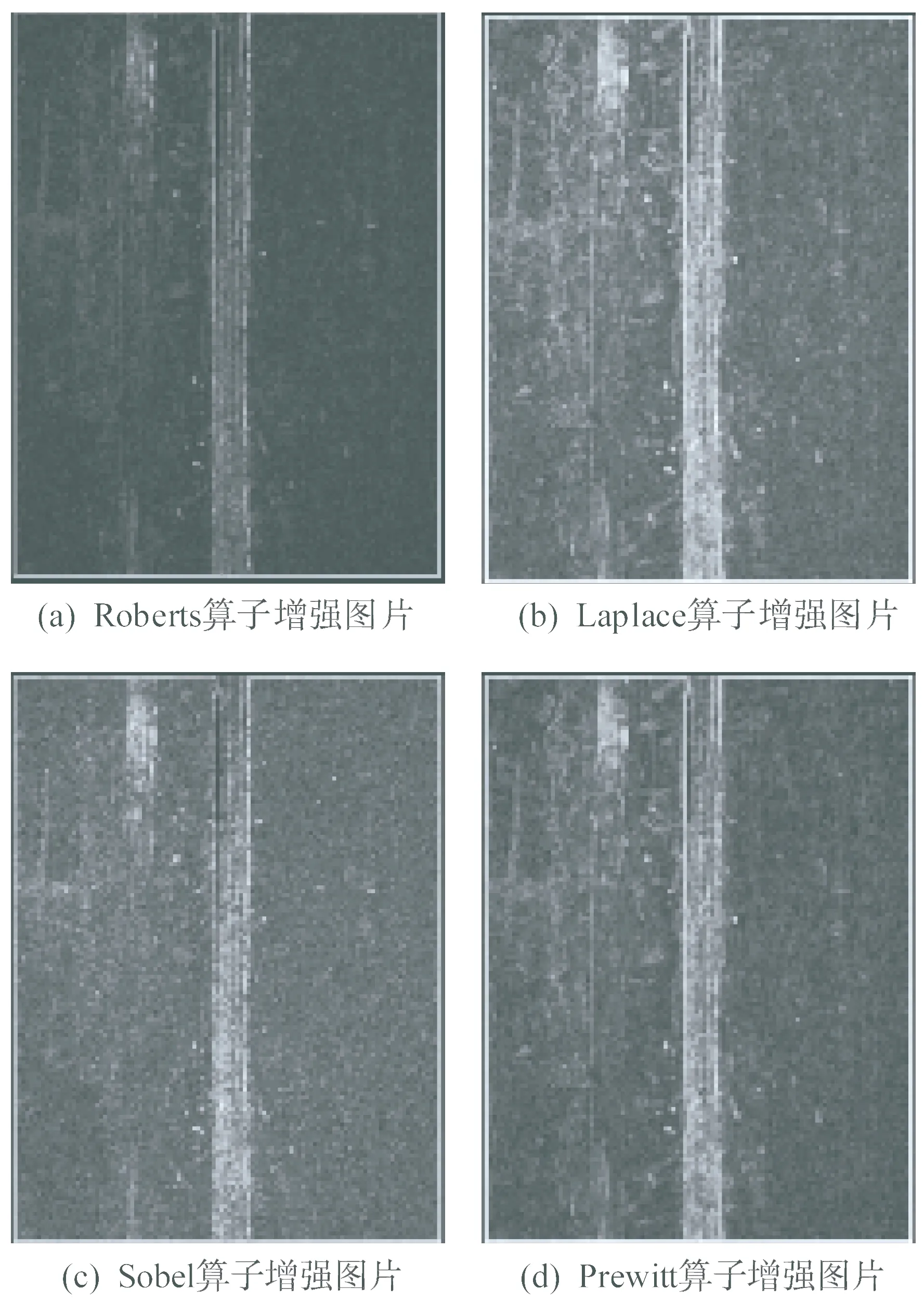

圖像銳化主要是指邊緣銳化,突出圖像中的邊緣或紋理,使圖像中的各種邊界更明顯。從數學的角度來看,銳化前的圖像相當于是被“積分”了的圖像,為了達到銳化的效果,要運用“微分”運算將被“積分”了的圖像還原。在圖像銳化的過程中,需要運用到各種邊緣檢測算子,比如Roberts算子、Sobel算子、Prewitt算子和Laplace算子等,其中前3種算子為一階邊緣算子,也屬于微分算子,Laplace算子通常作為二階邊緣算子[6]。

對于離散的圖像f(x,y),Roberts算子的灰度計算公式為

式中:Ro(i,j)為該像素點增強后的灰度值;f(i,j)、f(i+1,j+1)、f(i,j+1)、f(i+1,j)分 別為該像素點本身、右下方、右方以及正下方像素點的灰度值。

Roberts算子由兩個2階的模板組成[5]:

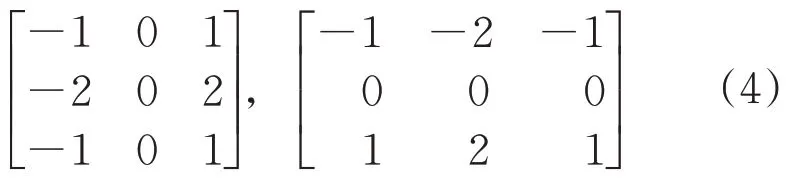

Sobel算子為兩個3×3矩陣[5]

這兩個算子分別代表圖像的水平和垂直梯度。

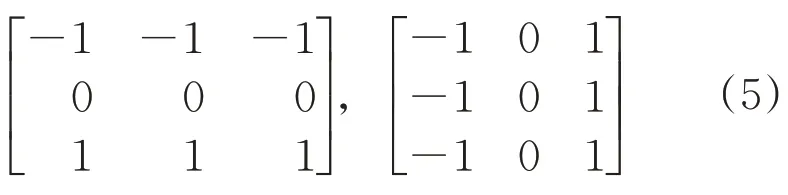

Prewitt算子大小與Sobel相同,均為3×3的算子[5]

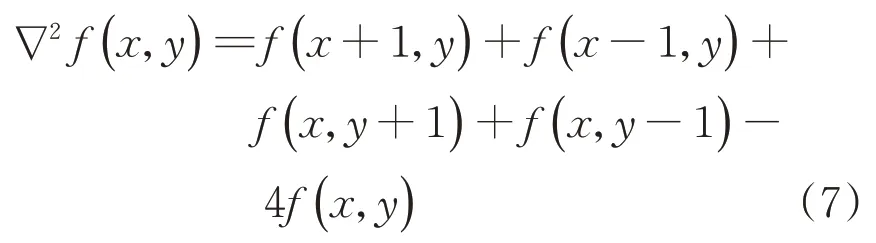

Laplace算子是一種不依賴于邊緣方向的二階微分算子,是標量而不是矢量。Laplace算子具有旋轉不變的性質,在圖像處理中經常用來提取圖像的邊緣,其表達式為

數字圖像的近似公式為[5]

在Matlab中基于以上4種算子對焊縫灰度圖像銳化后的效果如圖3所示。

由圖3可見,經過銳化后的焊縫圖像中焊縫從背景中凸顯出來,更加清晰,且基于Laplace算子銳化后的圖像相比其他3種算子的銳化效果更加優秀,不僅焊縫邊緣準確清晰,且焊縫內的特征也能有效體現出來。因此,本文選擇Laplace算子對焊縫灰度圖像進行銳化處理。

圖3 圖像增強效果

2 CNN結構

CNN和普通的神經網絡十分相似,都由大量的神經元組成。CNN是一種前饋神經網絡,其神經元可以響應一部分覆蓋范圍內的周圍單元,且CNN的默認輸入都是圖像,一個CNN包括很多層,它們的輸入是三維的,輸出也是三維的。CNN通常包含輸入層、卷積層、池化層、全連接層和輸出層,有些應用于分類問題的CNN還具有Softmax層[7]。本文采用的CNN結構如圖4所示。

圖4 CNN結構

(1)輸入層。輸入層是整個神經網絡的輸入,在進行圖像處理的CNN中,輸入層代表著輸入圖像的像素矩陣。三維矩陣可以代表一張圖片,三維矩陣的長和寬代表圖像的大小,三維矩陣的深度代表圖像的色彩深度[8]。本文輸入層的圖像均為灰度圖像,故深度為1。從輸入層開始,CNN通過不同的神經網絡結構將上一層的三維矩陣轉化為下一層的三維矩陣,直至最后的全連接層。

(2)卷積層。卷積層是CNN中最重要的部分,和傳統的全連接層不同,卷積層每個節點上的輸入只是上一層神經網絡的一小塊。卷積層的目標就是通過對神經網絡中的每一個小塊進行深入分析,進而得到圖像抽象程度更高的特征,卷積層會增加原始節點的深度。

卷積層由很多個特征映射組成,每一個特征映射都包含一個卷積核,不同的特征映射所包含的卷積核也是不同的,其所能抽取的特征類型也不同。卷積核大小要根據圖像的大小來確定,卷積核過大,會產生過擬合,太小則很難完全提取圖像的有效特征[9]。

經過卷積后圖像的WF(寬)和HF(高)分別為

式中:W、H為原圖像的寬和高;F為卷積核的大小;S為步長;P為邊界填充大小[10]。

卷積層中需要訓練的參數數量只與卷積核的大小和數量有關,同時,卷積層中同一個特征映射的所有神經元具有相同的卷積核,被稱為權值共享[11],這樣就可降低需要訓練的參數個數和訓練難度。

(3)池化層。池化層能在保留卷積層有用數據的同時,降低數據的維度,進而減少CNN的計算量,提高訓練速度。即池化層神經網絡不會減少矩陣的深度,但它可以縮小矩陣的大小[12]。經過池化操作,可將分辨率較高的圖片變為分辨率較低的圖片,進一步縮小最后全連接層中的節點個數。同時,池化操作還可防止過度擬合[13]。

(4)全連接層。經過多次卷積層和池化層處理之后,輸入的圖像信息已被抽象成信息含量更高的特征。隨著卷積層和池化層層數的增加,特征映射的數量越來越多,每一個特征映射具有的神經元數量越來越少,直至神經元的數量減少為1[14]。當每個特征平面都只有一個神經元的時候,網絡的連接變成了全連接。全連接層的每個節點都與上一層的所有節點相連,匯總提取的特征。

(5)輸出層。輸出層的神經元個數和網絡具體的任務有關,對于本文的焊縫識別來說,輸出層的個數為需要檢測的焊縫情況種類。

3 CNN的訓練和實驗

本文采用7層CNN結構,包括3層卷積層、3層池化層和1層全連接層。基于塔筒制造廠采集的300張焊縫圖片,由于單張圖片過大,而且單張圖片既包含焊縫缺陷位置,也包含焊縫正常位置,通過圖像分割將300張照片擴展為正常焊縫圖片500張,焊縫成形差和焊縫裂紋圖片各200張。由于條件的限制,現階段采集到的樣本圖片數量較少,將會影響到網絡的訓練效果。本文對圖像添加噪聲、變換缺陷所處位置等方法,將正常圖片數量擴充至1 200張,其中1 000張用于網絡訓練,200張用于網絡測試。將焊縫成形差的圖片和焊縫裂紋的圖片分別擴充至600張,各自的500張用于網絡訓練,100張作為測試集用于網絡測試。3種訓練樣本的圖片如圖5所示。

圖5 焊縫缺陷樣本

本文的數據集訓練在Win10系統下進行,處理 器 為Intel(R)Core(TM)i7-8550U,顯 卡 為GTX 1050,內存32 GB,CNN的訓練和測試都是基于Matlab中的Deep Learn Toolbox-master。

CNN在訓練過程中對網絡的學習率、Batch和迭代次數等進行調試,網絡參數的調試對于網絡測試的準確率和效率至關重要。學習率是指在優化算法中更新網絡權重的幅度大小,學習率可以恒定,也可基于動量或是自適用。過大的學習率可能會導致網絡訓練永遠無法達到要求,過小的學習率則會使網絡訓練效率變慢,有時還會出現局部最優的情況。Batch是指每次輸入CNN的圖片數量。在可控的情況下,Batch值的選擇越大越好,值越大,模型下降的方向越準,震蕩越小,但過大的Batch則會使收斂精度陷入不同的局部值。迭代次數是指模型訓練過程中遍歷數據集的次數,其會直接影響模型的分類精度[15]。根據CNN的訓練情況,最終確定學習率為0.2,Batch值為60,迭代次數為6 000。將測試集圖片輸入訓練好的CNN,測試結果準確率如表1所示。

表1 測試結果

根據測試結果可以看出,本文的CNN對于檢測識別風機塔筒焊縫是否存在焊縫成形差和裂紋缺陷具有很高的識別準確率。

4 結 語

目前風機塔筒的焊縫外部缺陷檢測主要是通過人工檢測,本文提出的基于CNN的檢測方法具有耗時短、魯棒性高的特點,經過實驗測試也具有很高的檢測準確率。在之后的研究中,需要進一步提高學習樣本的數量和樣本的多樣化,增強樣本的采集質量,優化神經網絡的結構和參數,從而提高網絡的檢測準確率。