基于改進Unet的小麥莖稈截面參數檢測

陳 燕 朱成宇 胡小春 王令強

(1.廣西大學計算機與電子信息學院, 南寧 530004; 2.廣西多媒體通信與網絡技術重點實驗室, 南寧 530004;3.廣西財經學院信息與統計學院, 南寧 530007; 4.廣西大學農學院, 南寧 530004)

0 引言

倒伏不僅嚴重影響小麥植株的正常發育,而且不利于正常的機械化收獲[1]。研究小麥的抗倒性有利于實現小麥高產、穩產和優產。作物莖稈的力學特性與其微觀結構如皮層/半徑、機械組織比例、維管束數目等密切相關[2-3]。姚金保等[4]發現小麥莖稈機械組織細胞層數、厚度,維管束數目、面積以及髓腔大小與抗倒性密切相關。SHAH等[5]研究發現,與小麥和水稻抗倒伏性最相關的性狀是株高、莖稈直徑和厚度、上下節間強度、莖粗壁以及木質素和纖維素在莖壁中的積累和穗重。馮素偉等[6]從小麥的外部形態、內部顯微結構及生理性狀等方面綜合分析了小麥莖稈的抗倒伏性,結果發現,小麥抗倒伏性與莖稈截面面積、大維管束數量成正相關關系。KONG等[7]研究發現,小麥莖強度與莖直徑、莖壁顯著相關,更厚的莖壁和節間干重增加也能幫助提高莖強度。劉唐興等[8]研究分析表明,莖稈的主莖細胞、木質部和維管束對莖稈抗倒性有重要影響。陳桂華等[9]研究得出,水稻單莖抗推力與莖粗、維管束數目呈顯著正相關。人工測量和分析相關莖稈形狀,不僅過程繁瑣,而且極易受到主觀狀態的影響。如何精確測量作物的微觀結構信息、客觀準確地獲取表型數據、從宏觀到微觀對植物進行系統展示、為農作物優質豐產研究提供可靠依據已成為研究抗倒伏機理急待解決的問題。

目前,利用圖像處理技術對作物微觀結構進行種類識別、作物分類、產量預測和品質分析等研究已成為當前作物表型組學的研究熱點[10-12]。徐勝勇等[2,13]分別基于模板匹配和扇環形區域分割完成對小麥莖稈截面參數的測量,包括小麥截面面積、截面直徑、維管束數量和面積。郝雅潔等[14]通過對小麥植株進行側拍和俯拍,再對獲得的圖像進行預處理,構建了小麥葉片面積的測量模型。左衛剛等[15]將小麥顆粒的尺寸、顏色、紋理作為特征,構建基于人工神經網絡(ANN)的多層感知機(MLP)模型,實現了對小麥籽粒的分類。許鑫等[16]提出基于Harris角點檢測和K-means聚類的分割算法對小麥苗進行識別。目前,對作物的圖像分割研究主要基于圖像RGB顏色通道及HSV通道的圖像處理技術,再通過處理后的圖像分析得到作物品種分類或作物參數與特征之間的回歸關系。卷積神經網絡(CNN)[17-19]在圖像分割上效果顯著[20]。U-Net[21]結構在醫學細胞圖像分割中取得了很好的效果。CE-Net[22]提出上下文編碼模塊,該模塊由一個多尺度的密集空洞卷積模塊和一個殘差多路徑池化模塊構成,可多角度捕獲具有高水平語義信息的特征。張慧春等[23]認為,高通量、自動化、高分辨率的植物表型信息采集平臺與分析技術對于加快植物改良和育種、提高產量和抗病蟲害能力至關重要。程曼等[24]對表型研究中的傳感器、平臺和信息分析現狀進行了整體分析和總結,提出應綜合考慮實際需求及經濟合理性進行選擇和設計。楊知等[25]利用LinkNet卷積神經網絡模型對高分辨率遙感影像進行了水體信息提取。

文獻[2]為研究小麥莖稈截面提供了很好的方法,但該方法只有在厚壁和維管束亮度顯著低于相鄰組織時才能獲得較高的檢測精確度,當厚壁和維管束的亮度接近或高于相鄰組織時,檢測精確度下降。另外,當染色過程導致的圖像之間或圖像內部色差較大時,該方法對截面和髓腔尺寸的測量誤差會增加,甚至無法對維管束的數量和面積進行識別和測量。

為解決上述問題,本文融合ResNet50和Unet深度學習網絡構建維管束和背景區域的語義分割模型Res-Unet,搭建對截面、髓腔、厚壁和背景的語義分割模型Mobile-Unet,在此基礎上,對小麥莖稈截面尺寸、髓腔尺寸和維管束面積等莖稈微觀結構的相關參數進行檢測。

1 數據集來源和標注

測試數據集來源于文獻[2],共110幅圖像,圖像分辨率為1 024像素×1 280像素。隨機選取其中的85幅作為訓練集、10幅為驗證集、15幅為測試集。首先對訓練集的樣本圖進行分析。圖1所示為其中3幅樣本圖像。從圖中可看出樣本之間的形狀、顏色和邊緣等均存在較大差異。圖1a中的圖像兩側著色不統一,左側維管束鄰近區域顏色較淺,右側維管束鄰近區域顏色較深,而且左下方的厚壁部分有殘缺。圖1d維管束整體與鄰近區域顏色差明顯,厚壁無明顯殘缺,是便于處理和提取特征的樣本類型。圖1g右下部分的維管束較模糊,左上側的厚壁存在缺失。此外,樣本之間的通道數也存在差異。因此使用傳統的圖像處理方法對小麥莖稈截面顯微圖像相關參數的識別存在一定的局限性[2,14]。

使用Labelme工具分別對維管束和截面進行標注。對物體逐點標注形成分割圖像(標簽)并生成json文件;對json文件轉換后得到維管束標注圖和區域標注圖。在維管束的標注圖中,單幅截面圖的維管束分布較均勻,但每個截面的形狀存在較大差異;而且與厚壁距離較近的維管束尺寸偏小,容易與厚壁部分混淆。在厚壁、髓腔和截面的標注圖中,厚壁部分與相鄰組織區分度較低,有時還存在厚壁缺失的情況。因此,對維管束、厚壁等的像素級精確分割難度較大;而且難以用區域劃分對所有樣本圖像進行有效識別。

2 網絡結構設計

參數檢測的網絡模型由兩部分組成。由于維管束和背景區分難度較大,因此一部分是由提取特征能力較強的ResNet50作為骨干網絡并與Unet融合而成的Res-Unet網絡模型,用于對小麥莖稈截面顯微圖像的維管束進行像素級識別,可保證丟失較少的精度;另一部分是由輕量級網絡模型MobileNet和Unet融合而成的Mobile-Unet網絡模型,用于檢測、分割小麥截面中的厚壁、髓腔等區域,可提高模型分割的速度。

2.1 Res-Unet網絡模型

Res-Unet的基礎卷積塊主要借鑒殘差模塊思想,ResNet50的基本殘差單元由恒等塊和卷積塊構成,可極大緩解深層網絡梯度消失的問題[23]。Res-Unet網絡結構如圖2所示,分為編碼器(虛線左側)和解碼器(虛線右側)兩部分。編碼器對輸入圖像進行下采樣,捕捉輸入圖像的上下文信息,提取圖像的分層語義信息特征,如輪廓、邊緣、紋理、尺寸和顏色等;解碼器使用反卷積進行上采樣保證對特征的精確定位;此外,編碼器同時直接將特征信息傳遞到同高度的解碼器部分,提供更精細的特征,如梯度信息等。

Res-Unet網絡模型通過將編碼器和解碼器對應的特征圖進行拼接,能夠用淺層網絡保存較好的細節位置信息輔助分割。輸入圖像為小麥截面顯微結構的彩色圖像,輸出為將維管束和背景分割后的圖像。其中維管束區域為紅色,背景區域為黑色,最終實現對維管束的精確分割。

如圖2所示,網絡各部分的工作過程如下:

(1)編碼部分。輸入圖像首先經過一個卷積核為7×7、步長為2的卷積層和一個最大值池化層,將圖像尺寸縮小至原始圖像的1/4,通道數增至64,用于提取維管束的紋理和邊緣等淺層特征;然后第1個卷積塊和2個恒等塊不改變圖像尺寸,僅增加通道數,使7×7卷積層和池化層提取的淺層特征更準確;后續的每一個卷積塊均將圖像尺寸縮減至卷積前的一半,卷積塊和恒等塊進一步幫助提取維管束的特征,直至圖像尺寸縮減至輸入圖像的1/16,通道數達到1 024。

(2)解碼部分。每次上采樣操作后經過一個3×3的卷積層,不斷提取維管束的深層特征,再與同高度的解碼器輸出進行通道合并操作,對整體特征進行整合,幫助對維管束精確識別;保證輸入前后通道數不變,不引入額外計算參數,最終輸出維管束和背景分割后圖像。

2.2 Mobile-Unet網絡模型

Mobile-Unet使用深度可分離卷積(Depth-wise separable convolution,DSC)將標準卷積分解為空間卷積(Depthwise convolution,DC)和通道卷積(Pointwise convolution,PC),模型如圖3所示。DC是逐通道的卷積,一個卷積核負責一個通道;PC是采用1×1卷積核的普通卷積。DSC先用DC對不同輸入通道分別進行卷積,然后再用PC將上面的輸出進行整合,這樣可保持模型性能的前提下降低模型大小,同時提升模型速度。DC和PC關系為

(1)

式中K——DC的卷積核尺寸

N——輸入特征圖數量

O——輸出特征圖數量

Mobile-Unet實現流程為:首先輸入圖像經過一個3×3卷積層并做批標準化,然后經過ReLU激活函數增加非線性能力;第1個DC步長設置為1,將通道數增加至64;第2個DC是下采樣操作,步長設置為2,該操作完成后圖像長寬均減少一半、通道數增至128,可提取較深層的特征;每次下采樣后的首個DC與第1個DC類似;后續DC與第2個DC類似,不斷進行下采樣操作,直到圖像尺寸變為7×7、通道數為512,完成圖像的下采樣操作。解碼部分與Res-Unet類似,也是上采樣操作后與解碼部分做通道合并操作,輸出分割截面、厚壁、髓腔和背景的分割圖像。

3 實驗與分析

實驗硬件環境為i5 6300HQ 2.3 GHz、16 GB內存、NVIDIA GeForce GT965M顯卡,操作系統為Windows 10專業版,編程語言為 Python 3.6,深度學習框架為Tensorlow 1.15.0和Keras 2.2.5。

3.1 模型訓練

模型訓練的圖像預處理主要是對原始圖像進行圖像增強;對圖像數據分別采用去均值化和歸一化的預處理。在訓練時設置模型初始權重和損失函數,并選定模型使用的優化器。

3.1.1圖像增強

由于分割數據集數量較少,而且維管束分割中正負樣本極不均衡,因此需對原始數據集進行圖像增強處理,以擴充訓練數據集的圖像數量。圖像增強操作包括隨機翻轉、高斯模糊、仿射變換、圖像截取和填充等[27]。由設計的網絡模型對每幅圖以一定概率隨機選擇其中一種或幾種操作實現圖像增強[27]。圖4為圖像增強效果圖,圖4a為原圖隨機實施圖像增強操作后的樣例圖。圖4b為進行水平翻轉、多頻噪聲掩膜、高斯模糊和仿射變換4種操作后的效果圖;圖4c為進行中值模糊和對比度變化操作后的效果圖;圖4d為進行水平翻轉和浮雕效果操作后的效果圖;圖4e為進行水平翻轉、垂直翻轉、均值模糊和灰度化操作后的效果圖;圖4f為進行仿射變換、像素點隨機去除和隨機截取與填充操作后的效果圖。

3.1.2圖像數據預處理

圖像數據預處理主要用于減少圖像變形對模型的影響和減少模型擬合的時間。

采用去均值化方法對維管束參數測量的圖像數據預處理。去均值化主要有兩個作用:一是移除圖像平均亮度、降低圖像亮度,在不影響判斷物體位置的前提下突顯各樣本的特征;二是降低輸入值,以避免在反向傳播時出現梯度爆炸的問題。去均值化的具體操作是:指定在ImageNet訓練數據集的平均像素值來實現與圖像數據生成器相同的效果,R、G、B通道分別減去103.939、116.779、123.68,移除圖像中的相同部分,凸顯圖像特征,完成數據特征標準化。部分樣例圖去均值化前后的效果如圖5所示。從圖5可見,降低圖像亮度后維管束的特征更明顯、更清晰可見。

采用歸一化方法對測量截面、厚壁和髓腔參數進行圖像預處理,使各個特征的尺度控制在相同的范圍內,便于找到最優解、提升精度。歸一化計算公式為

(2)

式中xmin——特征最小值

xmax——特征最大值

x——處理前像素值

x*——處理后像素值

3.1.3參數配置

由于本文使用小樣本數據集,因此通過遷移學習的共享參數方式,將在大規模數據集(ImageNet)上訓練好的ResNet50網絡權重應用到小麥莖稈截面切片圖像的訓練模型上,不僅可縮短訓練模型的時間,還可獲得更好的測試結果、預防過擬合。

選擇交叉熵損失函數作為兩個分割模型的損失函數進行訓練,損失函數Loss計算公式為

(3)

式中n——樣本數量

yi——第i個樣本真實值

損失函數用于衡量模型預測效果,表現為預測數據與實際數據的差距程度。

3.1.4優化器

使用的模型優化器Adadelta不需要人工設置學習率,每維均有單獨的動態學習率,而且對超參數不敏感,還能減小梯度下降算法的計算量。此外,Adadelta對于大梯度、噪聲和不同結構具有魯棒性。迭代公式為

(4)

式中 Δx——更新量

g——梯度

RMS——均方根

gt——第t次迭代的梯度

3.2 評估指標

參照文獻[2]使用均方根誤差(RMSE)和平均相對誤差(MRE)分析參數測量指標的精度。但實驗過程中發現存在MRE和RMSE的評估效果良好、檢測誤差較大的情況。因此本文增加了精確率(Precision)、召回率(Recall)、F1值(F1-score)、平均交并比(Mean intersection over union,mIoU)作為評價指標。目的是在像素級考慮測量結果的準確性和有效性,作為評價維管束、髓腔、厚壁和截面分割效果的依據。

3.3 維管束特征提取

維管束特征的提取是通過Res-Unet模型實現,可極大減少圖像之間的色差對測試結果的影響,有助于完整地提取維管束的淺層特征和深層特征,從而將維管束與相鄰組織進行精確分割。但由于手工切片的染色操作原因,有些圖像中存在微小的噪點,造成對該類圖像的維管束誤判。因此依據所有識別為維管束的面積作為判斷依據,獲取面積平均值,并將面積小于平均值30%的點判定為噪點并刪除。

存在噪點的樣例如圖6所示。從圖6中可見,用綠色標出的4個點是極微小的噪點,如果不去除,會造成錯誤地把噪點識別為維管束,從而影響相關參數的計算。通過去噪的操作后,可消除此類噪點的影響,從而保證Res-Unet模型對圖像中每個像素進行準確分類,為后續維管束相關參數計算提供可靠的依據。

維管束特征提取的部分測試結果圖如圖7所示。從圖中可看出,即使圖7a和圖7c在顏色和亮度上存在較大差異,而且圖7a中維管束和周圍組織區分不明顯,但從圖7b和圖7d的分割結果看,Res-Unet模型對維管束的位置、尺寸和數量的檢測性能表現良好,預測結果較準確。

3.4 實驗結果分析

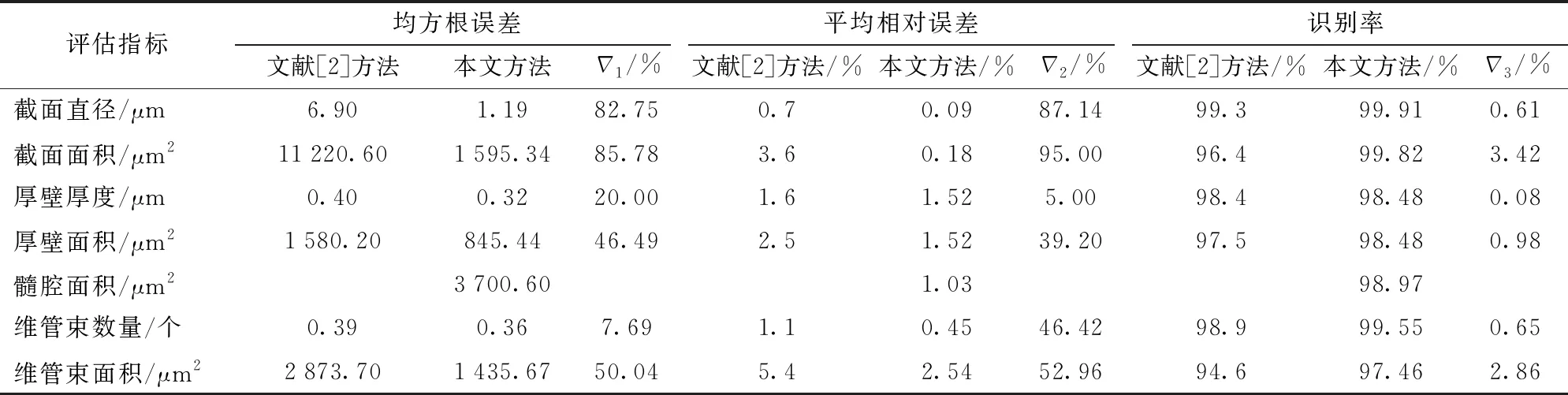

首先通過截面直徑、面積等7個參數的均方根誤差(RMSE)和平均相對誤差(MRE)分析各指標的精度;再通過厚壁、髓腔等4個參數的精確率、召回率、F1值和平均交并比來評價模型。實驗結果表明,15幅測試圖像的截面直徑、截面面積、髓腔面積、維管束數量和面積的檢測時間為324 s,即平均每幅圖像測試時間為21.6 s。

3.4.1RMSE和MRE結果分析

(5)

(6)

表1 兩種方法的測試結果

3.4.2精確率、召回率、F1值和平均交并比結果分析

Mobile-Unet網絡的實驗結果如表2所示。其中,髓腔尺寸和截面尺寸的精確率、召回率和F1值的效果最好,均不小于98.50%,平均交并比稍低,為91.90%。說明Mobile-Unet網絡對染色后的截面細胞與背景色差十分敏感,大大降低了厚壁陰影誤差和背景噪聲的影響,從而保證了髓腔和截面在精確率、召回率、F1值和平均交并比獲得較高的數值。

表2 網絡在小麥數據集的精度結果

由于手工操作導致切片染色不均勻,截面的薄壁組織特征與維管束特征十分相似,容易導致維管束附近的像素點可能被檢測為正例(維管束),而維管束被檢測為負例(背景),從而影響維管束的識別精度。Res-Unet網絡針對維管束識別精確率、召回率和F1值都不小于87.29%,平均交并比為89.48%,說明Res-Unet網絡具有良好的性能。

從表2可得,本文網絡性能良好,可準確獲取小麥莖稈機械組織相關參數。

4 結論

(1)本文方法可用于高通量輸出小麥莖稈截面顯微結構中的維管束面積、數量、截面尺寸和髓腔尺寸等主要參數的獲取。

(2)與文獻[2]相比,本文方法所獲得參數的均方根誤差和平均相對誤差均有較明顯的降低。RMSE減小百分比最大為85.78%、最小為7.69%,MRE減小百分比最大為95.00%、最小為5.00%,識別率也得到了提高,提高幅度最高為3.42個百分點、最低為0.08個百分點。

(3)厚壁、髓腔、截面和維管束的精確率、召回率、F1值和平均交并比均不小于86.78%,其中厚壁精確率最小,為86.78%,最高的是截面精確率,為99.56%。

(4)本文方法可對小麥莖稈的微觀結構參數進行實時測量,每幅圖像平均測試時間僅為21.6 s。