融媒直播云平臺的設計研究

羅列異

(浙江廣播電視集團新藍網(wǎng),浙江 杭州 310000)

0 引言

5G時代的來臨,依托移動網(wǎng)高速低延時的傳輸能力、云計算彈性伸縮的擴展能力、音視頻超高清實時編碼能力以及AR/VR人工智能無限想象力,5G+4K/8K、5G+VR等多種創(chuàng)新性技術形態(tài)應運而生。2020年在新冠肺炎疫情的催生下,直播教育、直播帶貨、遠程視頻辦公等云直播產業(yè)更是異軍突起,直播已從傳統(tǒng)廣電行業(yè)迅速拓展到社交、教育、旅游、購物等多個領域。

1 系統(tǒng)架構

傳統(tǒng)廣播電視直播借助于演播室導播切換臺,對攝像機、轉播車等專業(yè)攝錄設備采集的視音頻信號進行導播切換、特技處理后播出。為了滿足多樣化的直播體驗,在直播中借助于虛擬演播室或利用大屏技術及前置虛擬技術,實現(xiàn)AR/VR沉浸化的虛擬體驗。

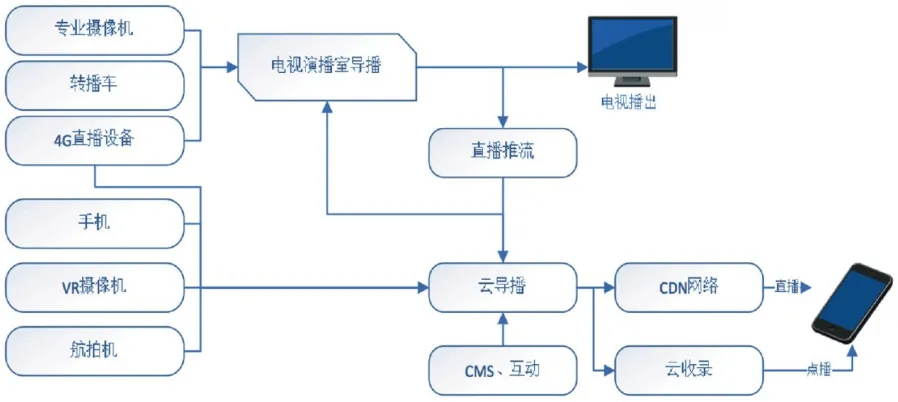

融媒直播云平臺由云直播、云導播、云編輯、云收錄、短視頻制剪、AR/VR人工智能處理等直播功能模塊構成,構建采、編、錄、發(fā)、播一站式、全鏈路、全方位的直播能力,并提供延時、墊播、轉碼等相關各類輔助工具。如圖1所示。

圖1 網(wǎng)絡直播流程圖

融媒直播云平臺具有以下特點:

(1)融合多場景:滿足傳統(tǒng)廣電直播和網(wǎng)絡直播的融合應用場景,實現(xiàn)融媒跨域直播。網(wǎng)絡直播信號能提供給演播室進行電視互動直播,電視直播信號能通過編碼推流提供網(wǎng)絡直播。

(2)兼容多協(xié)議:兼容傳統(tǒng)攝錄設備推流、4G/5G直播設備以及手機、VR設備、無人機航拍等網(wǎng)絡直播設備源,適配多協(xié)議的流格式和碼率,提供不間斷的HLS/RTMP流媒體直播服務,滿足手機、電腦端直播播放的要求。

(3)智能化處理:通過人工智能技術和服務,搭建起智能化的業(yè)務生產和應用場景模型,實現(xiàn)AR/VR、語音識別、人臉場景識別等常規(guī)業(yè)務難以實現(xiàn)的能力。

2 研發(fā)實現(xiàn)

融媒直播云平臺核心是實現(xiàn)直播流傳輸編碼、導播合成切換以及解碼播放技術。

2.1 導播技術

為了做到幀精度的導播切換,編碼傳輸?shù)囊曇纛l流經過解封裝、解碼兩套流程解出視音頻幀,輸入給導播切換的核心過濾器。過濾器不僅能實現(xiàn)對各路輸入流的無縫切換,同時還能夠疊加輔助信息,如字幕、臺標等信息,最終經過編碼、封裝后輸出。

在導播算法模型設計上,切換精度和碼流格式是實現(xiàn)關鍵。首先,對多路音視頻源進行歸一化處理,轉換為統(tǒng)一的分辨率和碼率,并歸一化時間戳、解碼時序和播出線程,保障了多路視音頻源在解封裝解碼切換時的整體一致性,達到幀精度。切換是人與系統(tǒng)交互的過程,播出線程會實時從在播音頻和視頻的幀隊伍中取出音視頻幀壓入播出PGM隊列中,然后輸出給處理單元進行視頻變換,最后編碼、封裝合成后播出。

過濾器單元除了導播切換功能外,還具有特技能力,實現(xiàn)對輸入幀變換功能,視頻翻轉,旋轉,縮放等。過濾器核心采用了libavfilter庫。過濾器使用有過濾鏈Filterchain和過濾圖Filtergraph兩種方式,前者適合單鏈條一對一視音頻處理流程,后者適合于overlay等多對一,多對多的復雜視音頻處理。

2.2 解碼播放技術

解碼播放技術難點是解決好音視頻的時序問題,處理好聲畫同步。正常編碼時視頻數(shù)據(jù)和音頻輸出是交替寫入的,解碼時音視頻可以同步解碼。為了提高編碼效率,引入雙向預測內插編碼幀(Bframe)。FFmpeg在AVFrame幀結構定義上加入PTS和DTS兩個字段[2]。PTS定義解碼后的視頻幀顯示的時間戳,而DTS定義了視頻流送入解碼器解碼的時間戳。考慮到音頻沒有B幀,解碼時序單一,在音視頻同步播放算法中以音頻為基準,視頻同步到音頻時間。播放流程啟動四個線程[1]:

(1)時間線程:提供系統(tǒng)統(tǒng)一的時鐘,控制系統(tǒng)播放時間的精確運行。

(2)解封裝解碼線程:為各路音視頻源解碼、解封裝為視頻幀和音頻幀,裝入各自隊列。

(3)音頻渲染流程:按序把音頻幀送入聲卡播放,提取音頻流PTS,并動態(tài)更新系統(tǒng)當前播放時間。

(4)視頻渲染線程:按序取出視頻幀,提取PTS時間。設定門限為±1/2fps,如果PST在播放區(qū)間內則進行視頻幀渲染,如果PTS超出播放區(qū)間則降低播放速率,反之進行丟幀處理。

3 融合人工智能

借助了人工智能能力,通過機器學習和深度學習,建立起更具智能的直播云平臺業(yè)務場景模型,滿足常規(guī)業(yè)務無法實現(xiàn)或難以實現(xiàn)的能力,讓云平臺更智慧、更省心、更懂你。

3.1 語音識別和實時字幕

國內科大訊飛、百度、騰訊等主流云服務商的語音技術識別率均已經達到95%以上。AI云服務商提供實時語音服務首次識別延時1s左右,根據(jù)語義環(huán)境最終識別在4s左右,識別率高,能較好地滿足直播業(yè)務需求,并為現(xiàn)場直播提供實時字幕,提升直播效果。

主流實時語音字幕能力實時性要求強,客戶端邊上傳,服務端邊識別。對音頻幀實時發(fā)送給AI服務商,同時接收進程實時獲取轉義文字內容,本地進行分句后輸出字幕內容,通過在線包裝合成,疊加到直播視頻上。

3.2 場景和人臉識別

人物識別在直播應用中有著極其廣泛的應用。比如直播人物字幕流程,當關鍵人物進入畫面后,手動拍出提前準備好關鍵人物字幕條,傳統(tǒng)方式無法實現(xiàn)突發(fā)事件及無法預測場景。通過人工智能技術,建立可能出現(xiàn)的關鍵人物庫,通過臉部識別技術自動識別人物,并自動輸出人物字幕條。建立面部識別庫,一類基于Dlib、dnn為主流的離線識別,另一類是百度、騰訊、訊飛為主流的在線識別。以離線識別庫為例,對比Dlib使用卷積神經網(wǎng)絡(CNN)和方向梯度直方圖(HOG),CNN方法準確度高,但速度慢,而HOG方法速度快,但準確性有所下降。啟動GPU cuda加速能力后CNN計算時間大大縮小,HOG和CNN時間相仿。

3.3 實時短視頻制作

直播目的為了更好、更快地傳播熱點內容的聚焦和時效性,直播中需要快速提取熱點和亮點內容制成短視頻,通過App或者社交媒體快速傳播,如果采用傳統(tǒng)手動流程,往往耗時耗力。

借助于轉語音能力,文字內容與視頻內容的位置是對應的,選擇所需文字內容就能夠確定視頻片段的出入點,實現(xiàn)基于文字內容的人工智能快速拆條。

借助于人物識別能力,可以準確獲得焦點人物出現(xiàn)的時間,實現(xiàn)基于人物的人工智能拆條。后臺根據(jù)焦點人物在鏡頭中出現(xiàn)的準確時間點,快速生成短視頻。

4 應用實踐

融媒直播云平臺不僅適用于活動、電商、游戲等直播場景外,人工智能+云端直播方式也賦予了更廣泛、更新穎的應用場景及業(yè)務模式。

(1)云綜藝錄制/直播:新冠肺炎疫情對直播產業(yè)催生了不少創(chuàng)新應用。伴隨5G技術的成熟,云綜藝真正實現(xiàn)了多地多機位互動的錄制直播,參與錄制節(jié)目的嘉賓無需到演播室現(xiàn)場,只需通過視頻設備和云綜藝軟件就可以實現(xiàn)跨越空間的互動演繹。

(2)VR直播:特指環(huán)視VR直播,以相機為中心向周圍拍攝[3];利用VR攝像機拍攝,然后編碼推流直播。觀眾佩戴VR眼鏡可以720度環(huán)視,有著身臨其境的臨場感,更具感染力和真實感。以往,VR直播無法突破的原因是帶寬、實時高清編碼以及VR眼鏡。5G+8K技術突破了網(wǎng)速和畫質的限制,讓VR直播產業(yè)化發(fā)展掃清了障礙。VR演唱會、VR云觀賽、VR云旅游等均為VR直播的典型應用。

(3)子彈時間:指環(huán)物VR直播,以被拍攝物為中心,相機環(huán)繞被攝物拍攝[3]。采用時間凝結技術,現(xiàn)場布置一套有若干臺與被拍攝物在同一聚焦平面上,但彼此時間碼同步,可以依次觸發(fā)的攝像機組成的360度環(huán)繞拍攝制作系統(tǒng),用戶不需要戴眼鏡就能觀看到運動或靜止中的人或物不同視角的瞬間,整體效果炫酷完美[4]。典型應用為競技類體育賽事、舞蹈演唱會等場合。

(4)直播帶貨:近年來直播帶貨異軍突起,開辟了直播及短視頻變現(xiàn)盈利的新途徑。通過直播手段重構“人、貨、場”三要素,具有強互動性、社交性和高轉化率。為了提高商品到消費者觸達率,調動購買熱情,借助VR直播模式,提供沉浸式購物體驗,如臨現(xiàn)場,讓直播與消費完美結合。

5 結束語

融合了人工智能的能力,直播系統(tǒng)更智能、更高效、更人性化,同時也會加速直播產業(yè)業(yè)務形態(tài)和模式的創(chuàng)新發(fā)展,催生業(yè)務向更具有創(chuàng)新性的領域發(fā)展。