一種基于GoogLeNet卷積神經(jīng)網(wǎng)絡(luò)的木節(jié)缺陷識別方法

高明宇 倪海明 張博洋 陳劍峰 戚大偉 牟洪波

摘 要:為了能夠?qū)δ竟?jié)缺陷進行準(zhǔn)確識別,減少木材的浪費,本研究在Pytorch深度學(xué)習(xí)框架的基礎(chǔ)上,提出一種基于GoogLeNet卷積神經(jīng)網(wǎng)絡(luò)的木節(jié)缺陷識別方法。該方法利用GoogLeNet網(wǎng)絡(luò)對朽節(jié)、干節(jié)和死節(jié)等7種云杉木節(jié)缺陷的RGB圖像進行自動提取特征,不需要對圖像進行預(yù)處理,即可實現(xiàn)分類識別,采用全局平均池化的方法來代替全連接層,減少網(wǎng)絡(luò)的參量。同時為了防止網(wǎng)絡(luò)的過擬合,在網(wǎng)絡(luò)中使用Dropout機制。實驗結(jié)果表明,利用該卷積神經(jīng)網(wǎng)絡(luò)對7種木節(jié)缺陷的識別率可以達到95.42%,在木節(jié)缺陷圖像處理中,GoogLeNet模型能準(zhǔn)確有效地識別木節(jié)缺陷。

關(guān)鍵詞:卷積神經(jīng)網(wǎng)絡(luò);GoogLeNet;木節(jié)缺陷圖像;缺陷識別

中圖分類號:S781.1; TP312??? 文獻標(biāo)識碼:A?? 文章編號:1006-8023(2021)04-0066-05

A Method for Recognizing Wood Knots Defects Based on GoogLeNet

Convolutional Neural Network

GAO Mingyu, NI Haiming, ZHANG Boyang, CHEN Jianfeng, QI Dawei* , MU Hongbo*

(College of Science, Northeast Forestry University, Harbin 150040, China)

Abstract:In order to recognize the knots accurately and reduce the waste of wood, a method of recognizing the knots based on GoogLeNet convolution neural network based on the deep learning framework of Pytorch was proposed in this paper. This method used GoogLeNet network to extract features automatically from RGB images of seven kinds of spruce knots, such as decayed knots, dry knots and encased knots et al, so that classification and recognition can be realized without image preprocessing. Global average pooling was used to replace the fully connected layer, and the network parameters can be reduced. At the same time, in order to prevent over-fitting, Dropout mechanism was used in the network. The experimental results showed that, the recognition accuracy of seven kinds of knot defects using the convolutional neural network can reach 95.42%, and the GoogLeNet can identify the knots accurately and effectively in the image processing of wood knot defects.

Keywords:Convolutional neural network; GoogLeNet; wood knot defect image; defect recognition

收稿日期:2021-03-12

基金項目:中央高校基本科研業(yè)務(wù)費專項資金資助項目(2572020BC07);國家自然科學(xué)基金項目(31570712)

第一作者簡介:高明宇,碩士研究生。研究方向為圖像處理與模式識別。E-mail: gmy0523@foxmail.com

*通信作者:戚大偉,博士,教授。研究方向為生物圖像信息處理與識別。E-mail: qidw9806@126.com

*并列通信作者:牟洪波,博士,副教授。研究方向為生物圖像信息處理與識別。E-mail: mhb-506@163.com

引文格式:高明宇,倪海明,張博洋,等. 一種基于GoogLeNet卷積神經(jīng)網(wǎng)絡(luò)的木節(jié)缺陷識別方法[J].森林工程,2021,37(4):66-70.

GAO M Y, NI H W, ZHANG B Y, et al. A method for recognizing wood knots defects based on GoogLeNet convolutional neural network [J]. Forest Engineering,2021,37(4):66-70.

0 引言

森林資源作為地球生態(tài)的一部分,具有不可替代性[1]。木材缺陷的分類識別對于有效降低森林資源的消耗,提高木材加工業(yè)的自動化水平具有潛在的意義。

數(shù)字圖像處理與人工智能算法相結(jié)合是木節(jié)缺陷檢測與分類的常用方法。在深度學(xué)習(xí)被廣泛使用之前,基于固定特征提取的分類識別技術(shù)一直受到廣泛的應(yīng)用。這些方法主要有Hu不變矩(Hu moment invariants)[2]、梯度直方圖特征 (Histogram of Oriented Gradient,HOG)[3-4]、局部二值特征(Local Binary Pattern,LBP)[4]、灰度共生矩陣(Gray-level Co-occurrence Matrix,GLCM)[5]和尺度不變特征(Scale-invariant feature transform,SIFT)[6]等。盡管這些方法在計算機硬件性能不強的情況下,具有精準(zhǔn)度高、資源利用率低等優(yōu)點,但是這些方法通常需要人為的方式進行設(shè)計和提取,大大降低了識別的效率,不利于將成果向?qū)嶋H應(yīng)用轉(zhuǎn)化。卷積神經(jīng)網(wǎng)絡(luò)由于其具有自學(xué)習(xí)的能力,可以通過大量的數(shù)據(jù)進行訓(xùn)練,從而自動提取到圖像中的特征。同時由于當(dāng)前計算機硬件的提升,卷積神經(jīng)網(wǎng)絡(luò)可以更快速地進行訓(xùn)練,極大地提高了自動化識別的效率。

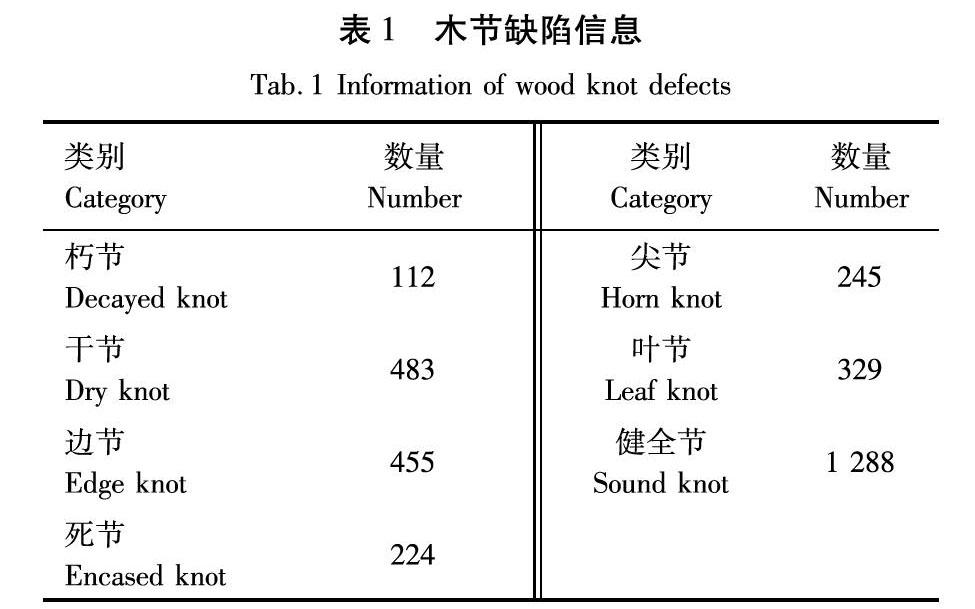

因此,本研究提出了一種基于Pytorch網(wǎng)絡(luò)框架和GoogLeNet卷積神經(jīng)網(wǎng)絡(luò)的木節(jié)識別方法,以朽節(jié)(decayed knot)、干節(jié)(dry knot)、邊節(jié)(edge knot)、死節(jié)(encased knot)、尖節(jié)(horn knot)、葉節(jié)(leaf knot)和健全節(jié)(sound knot)的圖像作為數(shù)據(jù)集,對7種木節(jié)進行自動識別分類研究。

1 圖像數(shù)據(jù)采集和處理

1.1 圖像數(shù)據(jù)采集

實驗數(shù)據(jù)集由芬蘭奧盧大學(xué)電機系計算機實驗室提供[7-9],數(shù)據(jù)集中包括朽節(jié)、干節(jié)、邊節(jié)、死節(jié)、尖節(jié)、葉節(jié)和健全節(jié),其中木節(jié)缺陷的RGB圖像共3 136個,具體木節(jié)缺陷圖片信息見表1。

1.2 圖像預(yù)處理

由于所獲取的木節(jié)圖像的分辨率不同,同時為了計算機的CPU計算速度和顯卡的可承受數(shù)據(jù)量,需要對數(shù)據(jù)集的圖像統(tǒng)一縮小為85×85像素。木節(jié)缺陷數(shù)據(jù)集按6∶2∶2的比例分為訓(xùn)練集、驗證集和測試集,分別包括1 885幅訓(xùn)練圖像、636幅驗證圖像和615幅測試圖像。

2 網(wǎng)絡(luò)結(jié)構(gòu)及訓(xùn)練

2.1 GoogLeNet

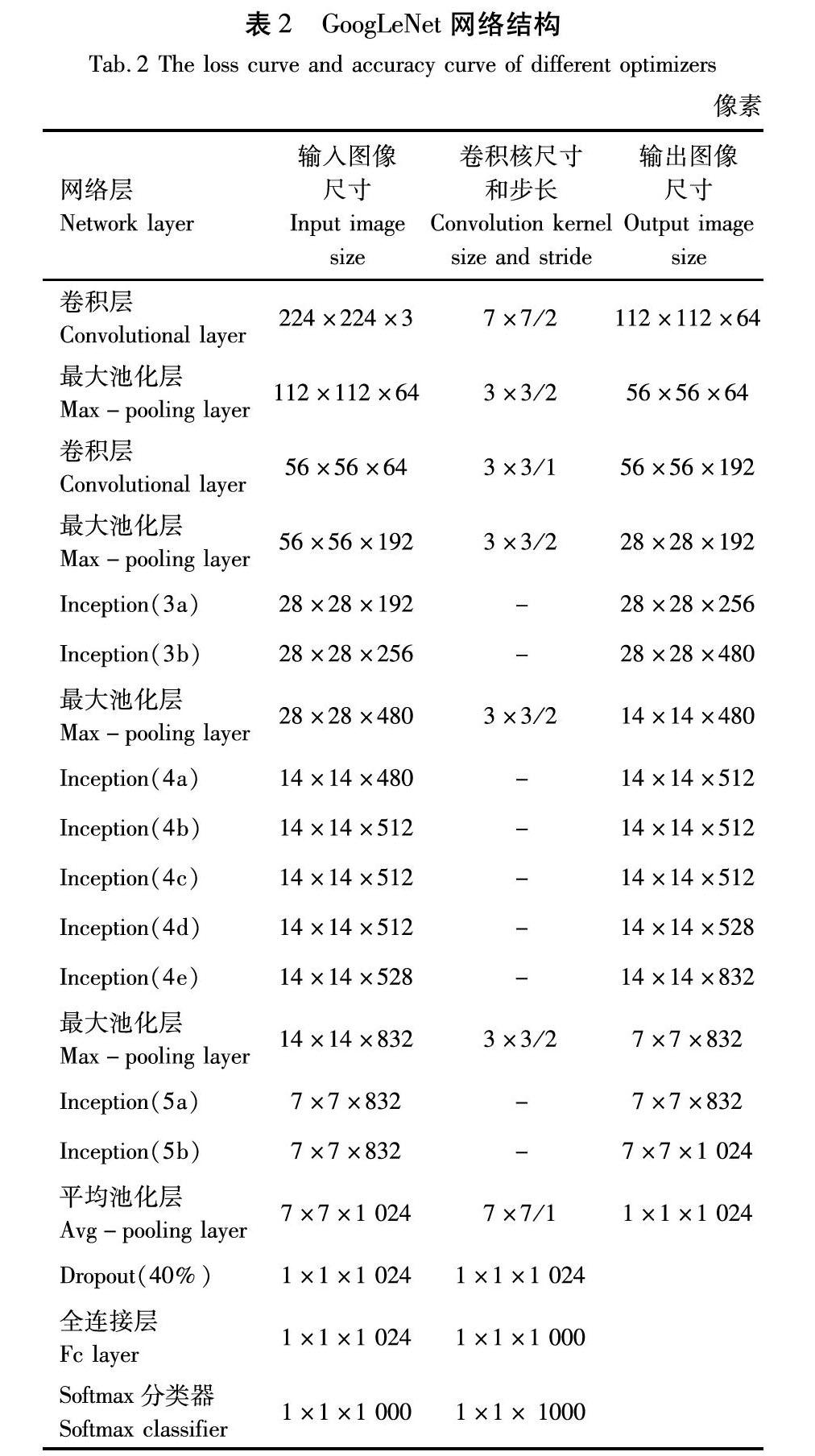

GoogLeNet是谷歌公司在2014年提出的一種深度學(xué)習(xí)結(jié)構(gòu)[10]。為了解決之前的網(wǎng)絡(luò)(如AlexNet等)由于網(wǎng)絡(luò)層數(shù)增加而導(dǎo)致的過擬合、梯度消失和梯度爆炸等問題,GoogLeNet采用了一種全新的Inception結(jié)構(gòu),可以更高效地利用計算資源,在相同的計算量下能提取到更多的特征,從而提升訓(xùn)練結(jié)果。本文采用GoogLeNet網(wǎng)絡(luò),實現(xiàn)對7種木節(jié)缺陷圖像的分類識別。

表2給出了GoogLeNet的網(wǎng)絡(luò)結(jié)構(gòu)和參數(shù)。木節(jié)缺陷圖像輸入網(wǎng)絡(luò)后,首先經(jīng)過卷積層、最大池化層和Inception層后,可以提取出圖像的特征,通過訓(xùn)練,特征圖被壓縮成一維向量,最后使用softmax函數(shù)進行分類。

2.2 激活函數(shù)

為了實現(xiàn)網(wǎng)絡(luò)的非線性化,本實驗采用了收斂速度快、求梯度簡單的ReLU (Rectified Linear Unit)激活函數(shù)[11-13],公式為:

f(x)=max(0,x)。(1)

式中:x為輸入。

與傳統(tǒng)的激活函數(shù)相比,ReLU在梯度下降和反向傳播上具有更高的效率。ReLU是非飽和激活函數(shù),因此當(dāng)數(shù)值過大或過小時,導(dǎo)數(shù)不會接近于0,可以避免梯度消失。同時,由于小于0部分為0,大于0部分才有值,所以可以減少過擬合。

2.3 優(yōu)化算法

Adam是一種基于訓(xùn)練數(shù)據(jù)的迭代更新神經(jīng)網(wǎng)絡(luò)權(quán)重的一階優(yōu)化算法,用來替代傳統(tǒng)隨機梯度下降(SGD)過程。Adam算法計算效率高,對內(nèi)存的需求少,超參數(shù)通常不需要較大的調(diào)整,非常適合數(shù)據(jù)或參數(shù)較大的問題[14-18]。

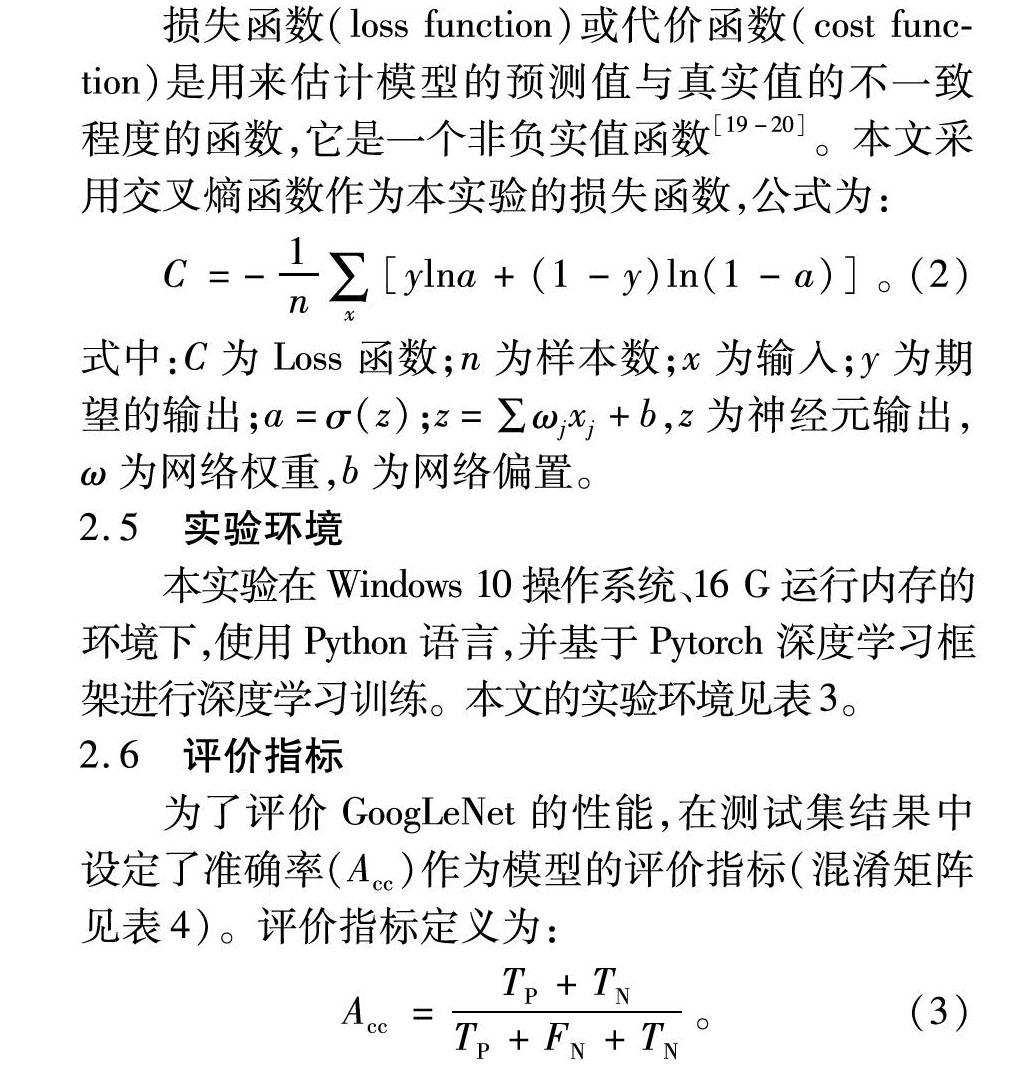

2.4 損失函數(shù)

損失函數(shù)(loss function)或代價函數(shù)(cost function)是用來估計模型的預(yù)測值與真實值的不一致程度的函數(shù),它是一個非負實值函數(shù)[19-20]。本文采用交叉熵函數(shù)作為本實驗的損失函數(shù),公式為:

C=-1n∑x[ylna+(1-y)ln(1-a)] 。 (2)

式中:C為Loss函數(shù);n為樣本數(shù);x為輸入;y為期望的輸出;a=σ(z);z=∑ωjxj+b,z為神經(jīng)元輸出,ω為網(wǎng)絡(luò)權(quán)重,b為網(wǎng)絡(luò)偏置。

2.5 實驗環(huán)境

本實驗在Windows 10操作系統(tǒng)、16 G運行內(nèi)存的環(huán)境下,使用Python語言,并基于Pytorch深度學(xué)習(xí)框架進行深度學(xué)習(xí)訓(xùn)練。本文的實驗環(huán)境見表3。

2.6 評價指標(biāo)

為了評價GoogLeNet的性能,在測試集結(jié)果中設(shè)定了準(zhǔn)確率(Acc)作為模型的評價指標(biāo)(混淆矩陣見表4)。評價指標(biāo)定義為:

Acc=TP+TNTP+FN+TN。 (3)

式中:Acc為準(zhǔn)確率;TP為將正樣本預(yù)測為正樣本;FP為將負樣本預(yù)測為正樣本;FN為將正樣本預(yù)測為負樣本;TN為將負樣本預(yù)測為負樣本。

3 結(jié)果及分析

實驗的結(jié)果如圖1所示。其中,圖1(a)表示訓(xùn)練結(jié)果,圖1(b)表示測試結(jié)果。橫坐標(biāo)代表迭代次數(shù),縱坐標(biāo)代表準(zhǔn)確率。經(jīng)過300次的迭代訓(xùn)練,訓(xùn)練集的損失值約為0.20,驗證集的準(zhǔn)確率為98.28%。

經(jīng)計算,GoogLeNet在測試集的Acc為95.42%,從而看出,GoogLeNet在木節(jié)缺陷識別方面具有較高的準(zhǔn)確率,這意味著GoogLeNet可以準(zhǔn)確快速地識別收集到的木節(jié)缺陷。

優(yōu)化算法對模型的性能至關(guān)重要。本文采用Adam優(yōu)化算法對GoogLeNet網(wǎng)絡(luò)進行了訓(xùn)練,并將其與SGD(隨機梯度下降)和Adagrad進行了比較。圖2為這3種優(yōu)化算法的訓(xùn)練過程,其學(xué)習(xí)率為3×10-4。結(jié)果表明,采用Adam算法的模型具有最快的收斂速度。從圖2的損失曲線可以看出,Adam算法收斂速度快,Adam和Adamax具有相近的收斂速度和識準(zhǔn)確率,但是Adamax的識別性能和Adam比仍有一定的差距,同時Adam比SGD和Adagrad算法具有更強的穩(wěn)定性。

圖3為在實際應(yīng)用中的識別結(jié)果。其中方框中為識別的缺陷,旁邊為識別種類和概率。由圖3可以看出,本文的方法(GoogLeNet)具有較好的準(zhǔn)確率,因此在木節(jié)缺陷識別方面具有一定的實用價值。

4 結(jié)論

本文基于Pytorch網(wǎng)絡(luò)框架,提出了一種基于GoogLeNet卷積神經(jīng)網(wǎng)絡(luò)的木節(jié)缺陷圖像識別方法。通過GoogLeNet網(wǎng)絡(luò)提取木節(jié)缺陷圖像特征,減少了人工提取特征所需的時間,與傳統(tǒng)的需要人工提取特征的神經(jīng)網(wǎng)絡(luò)模型相比,本方法在木節(jié)缺陷數(shù)據(jù)集上可以達到較高的識別精度。基于以上分析,GoogLeNet在木材無損檢測和缺陷識別方面具有潛在的應(yīng)用價值。

【參 考 文 獻】

[1]劉旭升,張曉麗.森林植被遙感分類研究進展與對策[J].林業(yè)資源管理,2004,33(1):61-64.

LIU X S, ZHANG X L. Research advances and countermeasures of remote sensing classification of forest vegetation[J]. Forest Resources Management, 2004, 33(1): 61-64.

[2]MU H B, QI D W. Pattern recognition of wood defects types based on hu invariant moments[C]//2009 2nd International Congress on Image and Signal Processing. October 17-19, 2009, Tianjin, China. IEEE, 2009: 1-5.

[3]DALAL N, TRIGGS B. Histograms of oriented gradients for human detection[C]//2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR05). June 20-25, 2005, San Diego, CA, USA. IEEE, 2005: 886-893.

[4]WANG X Y, HAN T X, YAN S C. An HOG-LBP human detector with partial occlusion handling[C]//2009 IEEE 12th International Conference on Computer Vision. September 29 - October 2, 2009, Kyoto, Japan. IEEE, 2009: 32-39.

[5]MOHANAIAH P, SATHYANARAYANA P, GURUKUMAR L. Image texture feature extraction using GLCM approach[J]. International Journal of Scientific & Research Publication, 2013, 3(5): 1-5.

[6]TAREEN S A K, SALEEM Z. A comparative analysis of sift, surf, kaze, akaze, orb, and brisk[C]//2018 International Conference on Computing, Mathematics and Engineering Technologies (iCoMET). March 3-4, 2018, Sukkur, Pakistan. IEEE, 2018: 1-10.

[7]KAUPPINEN H, SILVN O. A color vision approach for grading lumber[C]// The 9th Scandinavian Conference on Image Analysis: Theory and Applications of Image Analysis II. 1995: 367-379.

[8]SILVN O, KAUPPINEN H. Recent developments in wood inspection[J]. International Journal of Pattern Recognition and Artificial Intelligence, 1996, 10(1): 83-95.

[9]KAUPPINEN H, SILVEN O. The effect of illumination variations on color-based wood defect classification[C]//Proceedings of 13th International Conference on Pattern Recognition. August 25-29, 1996, Vienna, Austria. IEEE, 1996: 828-832.

[10]曹富奎,白天,許曉瓏.基于公路監(jiān)控視頻的車輛檢測和分類[J].計算機系統(tǒng)應(yīng)用,2020,29(10):267-273.

CAO F K, BAI T, XU X L. Vehicle detection and classification based on highway monitoring video[J]. Computer Systems & Applications, 2020, 29(10): 267-273.

[11]張有健,陳晨,王再見.深度學(xué)習(xí)算法的激活函數(shù)研究[J].無線電通信技術(shù),2021,47(1):115-120.

ZHANG Y J, CHEN C, WANG Z J. Research on activation function of deep learning algorithm[J]. Radio Communications Technology, 2021, 47(1): 115-120.

[12]劉忠偉,戚大偉.基于卷積神經(jīng)網(wǎng)絡(luò)的樹種識別研究[J].森林工程,2020,36(1):33-38.

LIU Z W, QI D W. Study on tree species identification based on convolution neural network[J]. Forest Engineering, 2020, 36(1):33-38.

[13]李佳欣,趙鵬,方薇,等.基于深度學(xué)習(xí)的多角度遙感影像云檢測方法[J].大氣與環(huán)境光學(xué)學(xué)報,2020,15(5):380-392.

LI J X, ZHAO P, FANG W, et al. Cloud detection of multi-angle remote sensing image based on deep learning[J]. Journal of Atmospheric and Environmental Optics, 2020, 15(5): 380-392.

[14]田睿,孟海東.基于Adam優(yōu)化算法的深度神經(jīng)網(wǎng)絡(luò)巖爆預(yù)測模型[J].礦業(yè)研究與開發(fā),2020,40(11):40-46.

TIAN R, MENG H D. Rockburst prediction model of deep neural network based on Adam optimization algorithm[J]. Mining Research and Development, 2020, 40(11): 40-46.

[15]閆壯壯,閆學(xué)慧,石嘉,等.基于深度學(xué)習(xí)的大豆豆莢類別識別研究[J].作物學(xué)報,2020,46(11):1771-1779.

YAN Z Z, YAN X H, SHI J, et al. Classification of soybean pods using deep learning[J]. Acta Agronomica Sinica, 2020, 46(11): 1771-1779.

[16]田佳鷺,鄧立國.基于改進VGG16的猴子圖像分類方法[J].信息技術(shù)與網(wǎng)絡(luò)安全,2020,39(5):6-11.

TIAN J L, DENG L G. Monkey image classification method based on improved VGG16[J]. Information Technology and Network Security, 2020, 39(5): 6-11.

[17]賴菲,羅廷芳,丁銳,等.圖像處理技術(shù)在木材表面缺陷檢測中的應(yīng)用[J].林業(yè)機械與木工設(shè)備,2021,49(2):16-21.

LAI F, LUO Y F, DING R, et al. Application of image processing technology to wood surface defect detection[J]. Forestry Machinery & Woodworking Equipment, 2021, 49(2):16-21.

[18]潘世豪,程玉柱,許正昊,等.基于分形理論的樹皮圖像特征提取方法[J].林業(yè)機械與木工設(shè)備,2019,47(2):7-11.

PAN S H, CHENG Y Z, XU Z H, et al. Feature extraction method of bark images based on the fractal theory[J]. Forestry Machinery & Woodworking Equipment, 2019, 47(2):7-11.

[19]趙鵬超,戚大偉.基于卷積神經(jīng)網(wǎng)絡(luò)和樹葉紋理的樹種識別研究[J].森林工程,2018,34(1):56-59.

ZHAO P C, QI D W. Study on tree species identification based on convolution neural network and leaf texture[J]. Forest Engineering, 2018, 34(1): 56-59.

[20]朱泓宇,謝超.基于可逆卷積神經(jīng)網(wǎng)絡(luò)的圖像超分辨率重建方法[J].林業(yè)機械與木工設(shè)備,2021,49(3):20-25.

ZHU H Y, XIE C. Image super-resolution reconstruction method based on invertible convolutional neural networks[J]. Forestry Machinery & Woodworking Equipment, 2021, 49(3):20-25.