改進YOLOv3的道路場景目標檢測方法

豆世豪

摘要:目標檢測作為計算機視覺領域研究的重點之一,被廣泛應用于自動駕駛、視頻監控、醫療等領域。為了解決傳統目標檢測在實際應用過程中檢測速度過慢以及檢測精度不高等問題,本文提出一種改進的YOLO v3算法。首先,對于先驗框位置使用K-means++算法進行提取,加快收斂速度;在YOLO v3特征提取部分引入SPP模塊,實現局部特征和全局特征的融合,豐富特征圖的最終表達能力;實驗結果表明,改進后的YOLO v3方法在平均速度和平均精度方面分別提升了1.07%和2.02%,能夠提升目標檢測的實際效果。

關鍵詞:目標檢測;YOLO v3;K-means++;空間金字塔池化

中圖分類號:TP18? ? ? 文獻標識碼:A

文章編號:1009-3044(2021)23-0094-03

1 引言

隨著深度學習的不斷發展,目標檢測建立在卷積神經網絡的基礎上,取得了顯著成效。在2012年的ImageNet大賽上AlexNet網絡被提出之后,越來越多更深的神經網絡不斷出現,開啟了計算機視覺技術的革命。至今,基于CNN的目標檢測方法主要分為兩類:分別是基于區域提取的方法和基于回歸的方法[1]。第一種是兩步檢測網絡,該類算法將目標檢測分為兩步,精確度較高但是檢測速度較慢,不能滿足實時性要求,代表方法有R-CNN、Fast R-CNN、Faster R-CNN等。第二種是單步檢測網絡,對目標的位置以及類別預測只需一步,主要包括SSD、YOLO等[2]方法。該類算法的檢測速度有很大提升,但檢測精度有所下降。之后的YOLO系列算法不斷改進,在保證檢測速度的同時兼顧準確率,保證整體的使用效果[3]。本文以YOLO v3為基礎,利用K-means++算法計算出適用于目標的錨框,然后借鑒SPP-net網絡的思想,將SPP模塊應用到YOLO v3網絡中,能夠結合卷積特征融合機制對多層級卷積特征進行融合豐富了卷積特征的表達能力,最終提高目標的檢測效果。

2 YOLO v3網絡

2.1 特征提取網絡Darknet-53

從YOLO v1到YOLO v3,每一代性能的提升都與骨干網絡backbone有關。YOLO v3是在YOLO v2的基礎上進行改進,骨干網絡由原來的DarkNet-19變為DarkNet-53,然后利用特征金字塔網絡結構實現了多尺度檢測,提高對不同大小目標的檢測精度。分類方法使用logistic代替了softmax,解決了不能對多標簽目標預測的問題。DarkNet-53[4]由若干網絡1×1和3×3的卷積核組成,每個卷積層之后加入一個批量歸一化層和一個Leaky Relu激活函數,共同構成一個的基本卷積單元DBL,如圖1(a)所示。此外,Dark Net-53融合了殘差網絡(Res Net),YOLO v3網絡中共有5個殘差塊,每個殘差塊由若干殘差單元構成,其中每個殘差單元由兩個DBL和殘差操作組成,如圖1(b)所示。

與YOLOv2相比,YOLOv3有多處改變。首先,DarkNet-53取消最大池化層,使用步長為2的卷積進行下采樣縮小特征圖的尺寸,可以減少目標信息的丟失,有利于小目標的檢測。其次,通常網絡結構越深表達特征越好,但容易出現不收斂的情況,殘差結構的使用使得網絡結構在很深的情況下依然保持收斂,保證模型持續訓練獲得更好的檢測效果。最后,通過將網絡的中間層和后面某一層的上采樣進行張亮拼接,實現多尺度特征融合[5]。

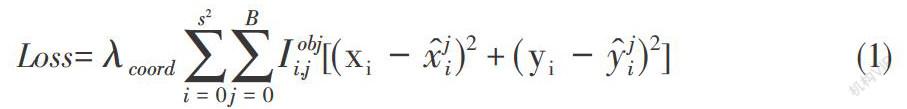

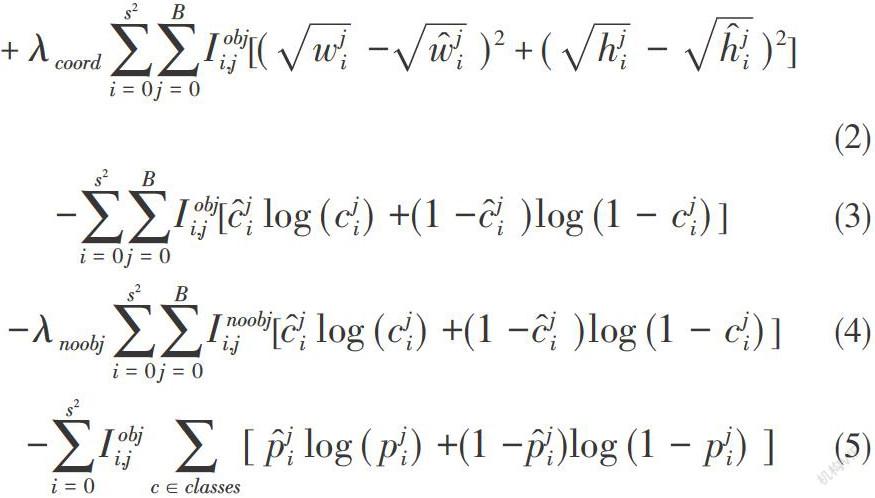

2.2 損失函數

YOLOv3網絡損失函數由三部分組成,分別為定位損失、置信度損失和分類損失[6]。損失函數公式如下:

3 改進的YOLO v3網絡

3.1 Anchor Box聚類算法改進

網絡模型通過學習訓練不斷調整Anchor Box的大小,而合適的初始化邊界框尺寸的選擇能夠提升網絡訓練的速度。YOLOv3和YOLOv2一樣,使用K-means算法選取先驗框尺寸,該方法存在一定的不足。初始點位的選擇會影響收斂的快慢,而K-means算法需要事先指定點的個數且位置隨機,最終導致局部最優而非全局最優。因此,使用K-means++算法對初始點位的選取進行改進,盡可能使聚類點之間保持最大距離[7]。該算法的實現過程如下:第一步,隨機選擇一個點作為第一個聚類中心。第二步,計算出剩余的每一個樣本與最近的聚類點的最短距離,接著計算出每個樣本成為下一個聚類中心的概率并選出下一個聚類中心。第三步,重復步驟二直至選出k個聚類點。使用K-means++算法能夠降低收斂需要的迭代次數,加快了收斂的速度。

3.2 加強網絡的特征提取功能

大多數網絡結構中,最后一層是全連接層,該層要求的特征數是固定的,這就要求輸入的圖片尺寸大小也是固定的。需要對不同尺寸的圖片進行裁剪、縮放、拉伸等操作使圖片滿足輸入的要求,這會使圖片失真,進而影響檢測精度。最初為了解決圖像失真問題,提出SPP模塊。在YOLOv3網絡結構中引入SPP模塊,可以對不同尺寸的輸入圖片實現相同大小的輸出,因此能夠避免這一問題。SPP模塊共由四個并行的分支組成,分別是卷積核大小為5×5、9×9、13×13,步長為1的最大池化下采樣和一個輸入到輸出的跳躍連接,其模塊結構如下圖2所示。最后將四個分支特征圖連接起來傳到下一層網絡中,依次通過1×1和3×3的卷積核再次進行融合,從而實現了不同尺度的特征融合[8]。

借鑒空間金字塔的思想,通過SPP模塊實現了局部特征和全局特征特征圖級別的融合,因此空間金字塔池化結構中最大的池化核大小要盡可能地接近或者等于需要池化的特征圖的大小。加入SPP模塊之后,豐富了卷積特征的表達能力,有利于檢測圖片中存在大小差異較大的目標,尤其是對于YOLOv3一般針對的復雜多目標圖像,能夠提高平均精度值(mAP)。改進后的YOLOv3網絡結構如下圖3所示。