基于深度學(xué)習(xí)和組織病理圖像的癌癥分類研究進(jìn)展

顏 銳,陳麗萌,李錦濤,任 菲

1中國(guó)科學(xué)院計(jì)算技術(shù)研究所, 北京 1001902中國(guó)科學(xué)院大學(xué),北京 1000493中國(guó)醫(yī)學(xué)科學(xué)院 北京協(xié)和醫(yī)學(xué)院 北京協(xié)和醫(yī)院腎內(nèi)科,北京 100730

受人口老齡化、環(huán)境污染、不良生活習(xí)慣和膳食結(jié)構(gòu)變化等因素的影響,癌癥已成為全世界共同面臨的重大公共健康問(wèn)題[1]。作為癌癥診斷的 “金標(biāo)準(zhǔn)”,病理診斷的準(zhǔn)確性和及時(shí)性直接影響患者治療方案的選擇和預(yù)后。在傳統(tǒng)病理診斷流程中,病理醫(yī)生在顯微鏡下直接對(duì)病理切片進(jìn)行鏡檢,然后根據(jù)經(jīng)驗(yàn)獨(dú)立作出病理診斷。隨著全切片掃描圖像 (whole slide images,WSI)技術(shù)的快速發(fā)展,病理切片的數(shù)字化給病理醫(yī)生帶來(lái)了諸多好處,如無(wú)須再通過(guò)顯微鏡觀察病理切片,而是可以通過(guò)屏幕更加方便快捷地反復(fù)觀看和定量分析病理圖像。WSI的推廣應(yīng)用,促使病理學(xué)進(jìn)入了新的發(fā)展階段。

當(dāng)然,病理學(xué)的發(fā)展目前仍然面臨巨大挑戰(zhàn)。首先,世界上普遍缺乏病理學(xué)家,而這一問(wèn)題在我國(guó)尤為突出,2018年,我國(guó)有執(zhí)照的病理科醫(yī)生僅10 000余人,缺口達(dá)90%[2];其次,病理診斷是否正確完全取決于病理醫(yī)生的專業(yè)知識(shí)和診斷經(jīng)驗(yàn),受個(gè)人主觀因素的影響,診斷結(jié)果往往并不一致。面對(duì)上述挑戰(zhàn),迫切需要開(kāi)發(fā)客觀且準(zhǔn)確的病理圖像分析方法。在所有病理圖像分析任務(wù)中,最重要的是分類任務(wù),其是細(xì)胞核定位[3]、有絲分裂檢測(cè)[4]、腺體分割[5]、病理圖像檢索[6]等深入研究的基石。

在自然圖像和醫(yī)學(xué)影像領(lǐng)域,基于深度學(xué)習(xí)的圖像分類方法已取得顯著成效[7],但由于病理WSI存在分辨率極高、病理特征差異細(xì)微、細(xì)胞重疊、顏色分布不均勻等特點(diǎn),WSI自動(dòng)分類一直缺乏突破性進(jìn)展。近年來(lái),一些創(chuàng)新性的方法不斷涌現(xiàn),使得基于病理圖像的自動(dòng)癌癥分類成為可能。本文從病理圖像分類常用的4種深度學(xué)習(xí)方法入手,對(duì)基于深度學(xué)習(xí)和組織病理圖像的癌癥分類(包括分級(jí))研究進(jìn)行回顧和總結(jié),并對(duì)該領(lǐng)域未來(lái)發(fā)展進(jìn)行展望。

1 常用的病理圖像分類深度學(xué)習(xí)方法

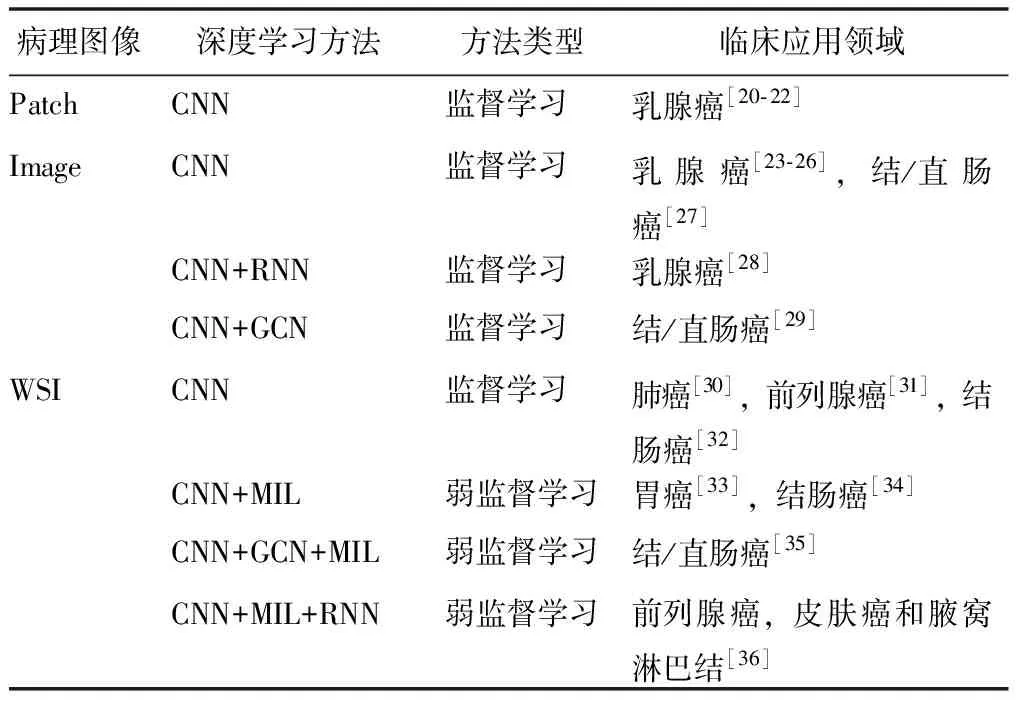

對(duì)于病理圖像,一般較易獲得WSI對(duì)應(yīng)的分類標(biāo)簽(診斷結(jié)果)。一張幾萬(wàn)×幾萬(wàn)像素的WSI對(duì)應(yīng)一個(gè)分類標(biāo)簽,切分WSI可得到幾萬(wàn)張幾百×幾百像素的圖像小塊(Patch),即幾萬(wàn)張Patch對(duì)應(yīng)一個(gè)分類標(biāo)簽,此為典型的弱監(jiān)督學(xué)習(xí)場(chǎng)景。而某些醫(yī)學(xué)問(wèn)題需根據(jù)先驗(yàn)知識(shí)對(duì)病理圖像的特定區(qū)域(比如癌癥區(qū)域)先進(jìn)行標(biāo)注,這種標(biāo)注可以是對(duì)Patch的逐個(gè)標(biāo)注,也可以是描繪感興趣區(qū)域的輪廓。實(shí)際處理時(shí),對(duì)感興趣區(qū)域輪廓的標(biāo)注亦轉(zhuǎn)換為對(duì)Patch的逐個(gè)標(biāo)注,即一張Patch對(duì)應(yīng)一個(gè)分類標(biāo)簽,此為典型的監(jiān)督學(xué)習(xí)場(chǎng)景。病理圖像分類常用的監(jiān)督學(xué)習(xí)和弱監(jiān)督學(xué)習(xí)方法包括:卷積神經(jīng)網(wǎng)絡(luò)(convolutional neural network, CNN)、循環(huán)神經(jīng)網(wǎng)絡(luò)(recurrent neural network, RNN)、圖卷積神經(jīng)網(wǎng)絡(luò)(graph convolutional network, GCN)和多示例學(xué)習(xí)(multiple instance learning, MIL)。

1.1 CNN

CNN是計(jì)算機(jī)視覺(jué)領(lǐng)域使用最廣泛的深度學(xué)習(xí)方法。傳統(tǒng)的全連接神經(jīng)網(wǎng)絡(luò)直接應(yīng)用于圖像任務(wù)會(huì)導(dǎo)致一些問(wèn)題,比如圖像展開(kāi)成向量后空間信息的丟失以及全連接參數(shù)量巨大導(dǎo)致的過(guò)擬合現(xiàn)象。CNN針對(duì)此類問(wèn)題在局部感受野、權(quán)值共享、卷積和池化操作等方面采取了新的改進(jìn)機(jī)制,在分類、檢測(cè)、分割、檢索、生成和去噪等任務(wù)上均取得了顯著效果[8]。常見(jiàn)的用于圖像分類的CNN包括VGG[9]、ResNet[10]、GoogLeNet[11]、DenseNet[12]、Xception[13]、MobileNet[14]等。在現(xiàn)有的硬件和算法條件下,直接采用CNN對(duì)WSI進(jìn)行處理并不可行,但可將對(duì)WSI的處理問(wèn)題分解為對(duì)Patch的處理子問(wèn)題,從而適用常規(guī)的CNN方法。

1.2 RNN

RNN主要用于處理和預(yù)測(cè)序列數(shù)據(jù),其最重要的變體之一是長(zhǎng)短時(shí)記憶網(wǎng)絡(luò)(long short term memory,LSTM)。LSTM 單元之間相互連接形成有向循環(huán),從而創(chuàng)建了網(wǎng)絡(luò)的內(nèi)部狀態(tài),使網(wǎng)絡(luò)能夠記住遠(yuǎn)處輸入,解決了數(shù)據(jù)之間的長(zhǎng)期依賴問(wèn)題[15]。由于WSI分辨率極高,故往往將WSI切分成Patch后再進(jìn)行處理,這導(dǎo)致切分后Patch之間的近鄰關(guān)系或拓?fù)浣Y(jié)構(gòu)部分丟失,而RNN及其變體的優(yōu)勢(shì)正好彌補(bǔ)了這一缺點(diǎn)。RNN在進(jìn)行WSI分析前,一般先采用CNN提取Patch的特征表示向量,然后基于特征表示向量再使用RNN進(jìn)行融合,二者可共同進(jìn)行端到端訓(xùn)練,也可分為兩階段進(jìn)行訓(xùn)練。

1.3 GCN

GCN在具有空間拓?fù)浣Y(jié)構(gòu)的圖數(shù)據(jù)方面存在巨大優(yōu)勢(shì),如交通網(wǎng)絡(luò)、蛋白質(zhì)相互作用網(wǎng)絡(luò)、社交網(wǎng)絡(luò)、文獻(xiàn)引用網(wǎng)絡(luò)等[16]。GCN可以處理節(jié)點(diǎn)級(jí)別的任務(wù)和圖級(jí)別的任務(wù),其中節(jié)點(diǎn)級(jí)別的任務(wù)包括節(jié)點(diǎn)分類、鏈路預(yù)測(cè)等;圖級(jí)別的任務(wù)包括圖分類、圖生成等。現(xiàn)有的GCN主要分為譜方法和空間方法兩類,譜方法利用圖上傅里葉變換和卷積定理從譜域定義圖卷積,空間方法則通過(guò)在節(jié)點(diǎn)域定義節(jié)點(diǎn)相關(guān)性實(shí)現(xiàn)圖卷積。對(duì)于WSI,切分出的Patch之間具有各種空間拓?fù)浣Y(jié)構(gòu),這和組織結(jié)構(gòu)的復(fù)雜性及癌癥的異質(zhì)性有關(guān)。將Patch作為圖的頂點(diǎn),然后根據(jù)Patch之間的距離構(gòu)建圖的邊,即可將WSI轉(zhuǎn)換為圖結(jié)構(gòu)的數(shù)據(jù),從而利用GCN對(duì)WSI進(jìn)行圖級(jí)別和節(jié)點(diǎn)級(jí)別的分析。

1.4 MIL

MIL是一種弱監(jiān)督學(xué)習(xí)方法[17-18],通過(guò)對(duì)包(包有標(biāo)簽,示例無(wú)標(biāo)簽)的學(xué)習(xí)建立MIL模型,并將該模型應(yīng)用于未知包的預(yù)測(cè)。既往MIL在圖像上的應(yīng)用僅是把圖像小塊向量化作為示例,并未與CNN結(jié)合起來(lái)。自2018年起,Ilse等[19]提出的基于注意力的深度MIL將MIL與CNN有效結(jié)合,為MIL在圖像領(lǐng)域的應(yīng)用揭開(kāi)了新的序幕。對(duì)于WSI分類問(wèn)題,雖然獲取像素級(jí)別的人工標(biāo)注非常困難且價(jià)格昂貴,但WSI級(jí)別的分類標(biāo)簽較易獲取。一張幾萬(wàn)×幾萬(wàn)像素的WSI,即幾萬(wàn)張Patch,對(duì)應(yīng)一個(gè)分類標(biāo)簽,此場(chǎng)景正好與MIL的適用場(chǎng)景相吻合。

上述4種常用的深度學(xué)習(xí)方法已應(yīng)用于乳腺癌、結(jié)/直腸癌、肺癌、前列腺癌等多個(gè)領(lǐng)域的病理圖像分類(表1)。

表1 4種常用的深度學(xué)習(xí)方法的臨床應(yīng)用

2 癌癥分類

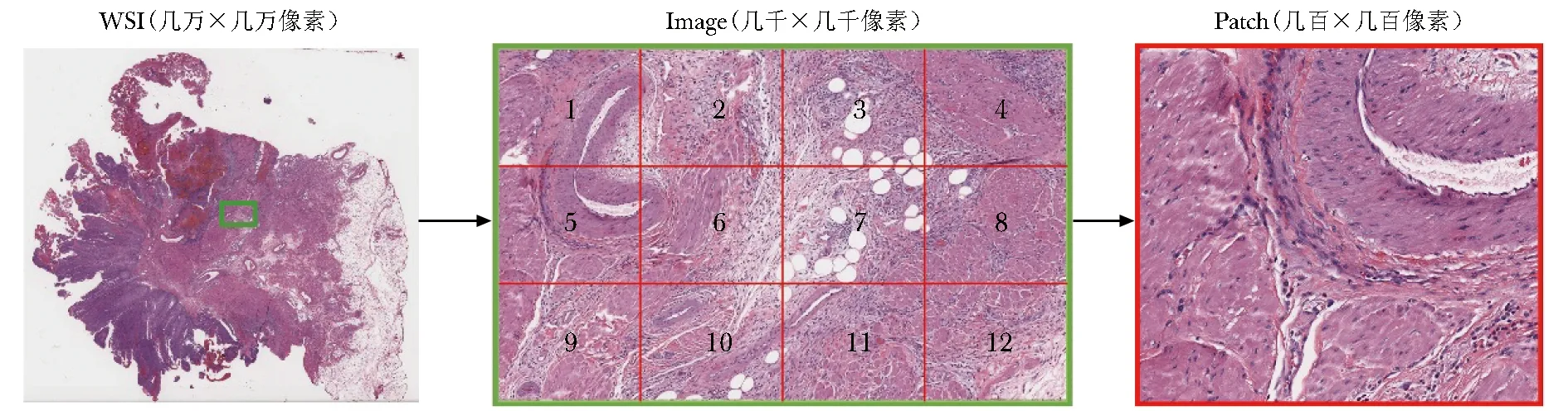

準(zhǔn)確的癌癥分類可以幫助醫(yī)生對(duì)患者的治療作出整體規(guī)劃,同時(shí)評(píng)估患者預(yù)后。根據(jù)研究成果出現(xiàn)的時(shí)間順序,下文逐一介紹基于Patch(幾百×幾百像素)、Image(幾千×幾千像素)和WSI(幾萬(wàn)×幾萬(wàn)像素)的癌癥分類相關(guān)研究進(jìn)展。3種不同尺度病理圖像示例見(jiàn)圖1。

圖1 不同尺度病理圖像示意圖

2.1 基于Patch的癌癥分類

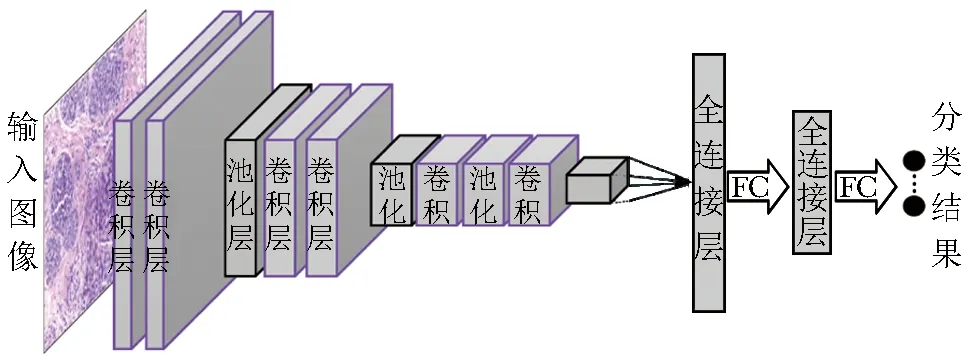

基于深度學(xué)習(xí)和病理圖像的癌癥分類始于Patch分類,其一般方法框架如圖2所示。Spanhol等[37]于2016年公開(kāi)了乳腺癌良/惡性二分類的病理圖像數(shù)據(jù)集BreaKHis。在此數(shù)據(jù)集的基礎(chǔ)上,Spanhol等[20]利用AlexNet網(wǎng)絡(luò)和多種融合策略進(jìn)行Patch分類,分類準(zhǔn)確度比傳統(tǒng)機(jī)器學(xué)習(xí)算法提高了6%。Bayramoglu等[21]在BreaKHis數(shù)據(jù)集基礎(chǔ)上使用了不依賴于圖像放大倍數(shù)的深度學(xué)習(xí)方法,Patch分類準(zhǔn)確度約為83%。Araújo等[22]進(jìn)一步考慮了乳腺癌病理圖像的四分類(正常組織、良性組織、原位癌和浸潤(rùn)性癌)問(wèn)題,先利用CNN提取Patch的特征,然后利用支持向量機(jī)(support vector machine,SVM)算法對(duì)特征進(jìn)行分類,該團(tuán)隊(duì)在構(gòu)建的乳腺癌分類數(shù)據(jù)集基礎(chǔ)上,Patch平均分類準(zhǔn)確度為77.8%。

圖2 基于深度學(xué)習(xí)的病理圖像(Patch)分類方法的典型框架

2.2 基于Image的癌癥分類

基于Image的癌癥分類研究是從Patch到WSI的重要過(guò)渡。如果簡(jiǎn)單地將高分辨率的圖像壓縮為低分辨率的圖像,則不可避免地會(huì)丟失大量有用的圖像信息,導(dǎo)致較差的分類效果。目前,基于Image的癌癥分類算法采用了大致相同的研究思路:首先將Image切分成大小相等的Patch,然后采用CNN對(duì)每張Patch進(jìn)行分類,最后將一整張Image的所有Patch分類結(jié)果整合在一起以確定最后的Image分類結(jié)果。總的來(lái)說(shuō),基于深度學(xué)習(xí)的Image病理圖像分類方法按時(shí)間順序的演變路徑總結(jié)如下:(1)CNN + 多數(shù)投票法; (2)CNN + SVM; (3)CNN + 遷移學(xué)習(xí) + 多數(shù)投票法或SVM; (4)CNN + 遷移學(xué)習(xí) + Patch捆綁 + 多數(shù)投票法或SVM。其中,SVM也可以是其他傳統(tǒng)的有監(jiān)督的機(jī)器學(xué)習(xí)分類算法。

基于Image的癌癥分類研究是從ICIAR2018國(guó)際挑戰(zhàn)賽[38]中的乳腺癌分類任務(wù)開(kāi)始流行的。ICIAR2018公開(kāi)數(shù)據(jù)集的病理圖像分辨率為2048×1536像素,圍繞此數(shù)據(jù)集相繼開(kāi)展了多項(xiàng)Image分類算法研究。Vesal等[23]使用基于遷移學(xué)習(xí)的GoogLeNet和ResNet預(yù)訓(xùn)練模型,首先對(duì)Image的每個(gè)Patch進(jìn)行分類,再使用多數(shù)投票法得到Image的分類結(jié)果。Vang等[24]提出先使用GoogLeNet進(jìn)行Patch分類,然后通過(guò)包含多數(shù)投票、梯度增強(qiáng)機(jī)和邏輯回歸的集成融合框架進(jìn)行Image分類。Rakhlin等[25]使用了一種稱為深度卷積特征表示的方法,首先對(duì)病理圖像進(jìn)行通用網(wǎng)絡(luò)編碼,得到低維的稀疏描述符,然后用梯度增強(qiáng)樹(shù)進(jìn)行分類。Yan等[26]先將一張Image切分為大小相等的12張Patch,采用ResNet提取12個(gè)特征向量代表這12張Patch,然后將其中位置相鄰的Patch綁定在一起進(jìn)行分類,最后通過(guò)對(duì)綁定的Patch分類結(jié)果進(jìn)行多數(shù)投票決定癌癥分類類別。上述方法均是基于Patch得到最終的Image分類結(jié)果,要么直接采用多數(shù)投票法和傳統(tǒng)的機(jī)器學(xué)習(xí)分類器,要么僅集成Patch之間的短距離空間關(guān)系,卻忽略了Patch之間的長(zhǎng)距離空間關(guān)系的重要作用。針對(duì)這一問(wèn)題,本研究團(tuán)隊(duì)提出了一種混合神經(jīng)網(wǎng)絡(luò)算法以同時(shí)保留Patch之間長(zhǎng)、短距離空間關(guān)系,該方法首先將高分辨率的Image切分成Patch,然后利用一種通過(guò) CNN 提取圖像的多級(jí)特征的方法得到 Patch 的特征表示,最后利用雙向LSTM融合Patch的特征表示進(jìn)行Image分類,整體框架如圖3所示[28]。研究結(jié)果表明,對(duì)于乳腺癌四分類任務(wù),該方法獲得了91.3%的平均準(zhǔn)確度。

圖3 基于深度學(xué)習(xí)的病理圖像(Image)分類方法的典型框架[28]

2.3 基于WSI的癌癥分類

相較于Patch和Image分類,WSI分類面臨的挑戰(zhàn)更加艱巨,如分辨率極高、標(biāo)注不足等。這些難點(diǎn)導(dǎo)致WSI雖然包含更多的信息量,但分類效果并不如Patch和Image好,為應(yīng)對(duì)此類挑戰(zhàn),研究者進(jìn)行了大量探索。例如,為將肺的WSI分為正常、肺腺癌或鱗狀細(xì)胞癌3類,Coudray等[39]先對(duì)WSI進(jìn)行簡(jiǎn)單的預(yù)處理,然后開(kāi)發(fā)了基于遷移學(xué)習(xí)的InceptionV3分類模型對(duì)Patch進(jìn)行分類,最后對(duì)Patch的分類結(jié)果進(jìn)行多數(shù)投票,或?qū)atch的分類概率進(jìn)行平均,從而得到WSI的分類結(jié)果;整個(gè)模型的受試者工作特征曲線下面積(area under the curve,AUC)為0.97,顯著高于既往模型,且高于病理學(xué)家的分類準(zhǔn)確度。Adnan等[40]利用GCN進(jìn)行WSI分類,并將WSI的特征表示學(xué)習(xí)過(guò)程分為2個(gè)階段進(jìn)行:首先從WSI中采樣重要的Patch并將其建模為全連接的圖,然后通過(guò)GCN將此圖轉(zhuǎn)換為向量表示即WSI的特征表示;研究者從The Cancer Genome Atlas(TCGA)數(shù)據(jù)集中收集了1026張肺癌WSI,結(jié)果表明該方法能夠很好地區(qū)分肺腺癌和肺鱗狀細(xì)胞癌2種肺癌亞型,準(zhǔn)確度為88.8%,AUC為0.89。

像素級(jí)的WSI標(biāo)注代價(jià)昂貴,越來(lái)越多的研究者嘗試采用弱監(jiān)督學(xué)習(xí)進(jìn)行WSI分類。Chikontwe等[34]提出了一種可以同時(shí)學(xué)習(xí)示例級(jí)嵌入和包級(jí)嵌入的MIL框架用于WSI分類,且其提出的中心損失函數(shù)可在嵌入空間中最小化類內(nèi)距離,該方法在2個(gè)結(jié)/直腸癌病理圖像數(shù)據(jù)集上分別取得了92.31%和98.72%的分類準(zhǔn)確度。Campanella等[36]采用僅需病理報(bào)告中的診斷結(jié)果作為標(biāo)注的MIL方法進(jìn)行WSI分類,具體流程:首先在Patch層面采用CNN和MIL進(jìn)行訓(xùn)練,從而得到WSI中的Patch分類概率,然后基于概率大小篩選Patch,利用RNN融合選出的Patch從而得到WSI分類結(jié)果。這項(xiàng)研究收集了來(lái)自15 187例患者的44 732張WSI。基于前列腺癌、基底細(xì)胞癌和乳腺癌轉(zhuǎn)移至腋窩淋巴結(jié)的WSI測(cè)試數(shù)據(jù)集得出的AUC均高于0.98。該方法的臨床應(yīng)用將使病理科醫(yī)生在保證100%靈敏度的前提下篩除65%~75%的WSI,從而將精力集中于重要病例的診斷上。Chen等[32]也使用弱監(jiān)督學(xué)習(xí)的方法進(jìn)行了WSI分類,與常用的弱監(jiān)督學(xué)習(xí)方法MIL不同的是,其僅在CNN的基礎(chǔ)上通過(guò)提出修正的交叉熵?fù)p失函數(shù)和上界轉(zhuǎn)換損失函數(shù)進(jìn)行WSI的弱監(jiān)督分類,使得在僅有WSI標(biāo)簽進(jìn)行模型訓(xùn)練的情況下,Patch的分類結(jié)果可以達(dá)到病理學(xué)家的水平。Wang等[30]同樣使用弱監(jiān)督學(xué)習(xí)方法進(jìn)行了肺癌四分類(腺癌、鱗狀細(xì)胞癌、小細(xì)胞肺癌和正常組織),同時(shí)指出少量的粗注釋有助于進(jìn)一步提高WSI分類的準(zhǔn)確度。該方法首先利用基于Patch的全卷積神經(jīng)網(wǎng)絡(luò)來(lái)選擇有區(qū)分性的塊,然后采用不同的Block特征選擇方法和特征聚合策略,得到WSI的全局描述子,最后將全局描述子輸入隨機(jī)森林算法從而得到WSI分類結(jié)果,整體框架如圖4所示。Wang等[33]提出了胃部WSI三分類(正常、異型增生和癌癥)的重校準(zhǔn)MIL框架,該框架首先利用CNN網(wǎng)絡(luò)選擇出每張WSI中有區(qū)分性的示例,然后僅根據(jù)這些示例訓(xùn)練重校準(zhǔn)MIL框架,使其能夠捕獲示例間的依存關(guān)系,并根據(jù)從融合特征中學(xué)習(xí)的重要性系數(shù)重新校準(zhǔn)示例特征。

圖4 基于深度學(xué)習(xí)的病理圖像(WSI)分類方法的典型框架[30]

3 癌癥分級(jí)

癌癥分級(jí)屬于細(xì)粒度分類任務(wù),不同分級(jí)的病理圖像之間差別非常細(xì)微,僅采用一般的深度學(xué)習(xí)方法無(wú)法勝任此類任務(wù)。因此,針對(duì)不同的癌癥分級(jí)任務(wù),研究者設(shè)計(jì)了不同網(wǎng)絡(luò)結(jié)構(gòu)和方法框架。本研究團(tuán)隊(duì)提出了可在端到端學(xué)習(xí)過(guò)程中集中注意力于細(xì)胞核相關(guān)特征的網(wǎng)絡(luò)(NANet)進(jìn)行乳腺癌分級(jí)[27]。NANet包含兩個(gè)分支:主干分支用來(lái)提取病理圖像的特征表示,細(xì)胞核分支用來(lái)提取細(xì)胞核相關(guān)的特征表示,通過(guò)NANet中的“指導(dǎo)”模塊,在不同卷積層中重點(diǎn)關(guān)注細(xì)胞核相關(guān)的特征。“指導(dǎo)”模塊在端到端的學(xué)習(xí)中起到了一種類似于注意力機(jī)制的作用,從而使得網(wǎng)絡(luò)整體上學(xué)習(xí)到更加細(xì)粒度且更具代表性的特征表示以進(jìn)行乳腺癌分級(jí)。當(dāng)前的結(jié)/直腸癌分級(jí)方法僅利用了Patch信息,而通過(guò)評(píng)估細(xì)胞水平的信息以及腺體的形態(tài)考量整個(gè)組織的微環(huán)境非常重要,為克服目前這一分級(jí)方法的不足,Zhou等[29]提出了一種新的細(xì)胞圖卷積神經(jīng)網(wǎng)絡(luò)(CGC-Net)。CGC-Net將Image轉(zhuǎn)換為圖,其中每個(gè)節(jié)點(diǎn)用原始病理圖像中的一個(gè)細(xì)胞核表示,節(jié)點(diǎn)之間的邊(細(xì)胞相互作用)用節(jié)點(diǎn)相似性表示,結(jié)果表明,相較于傳統(tǒng)基于Patch的方法,將Image建模為圖可有效處理更大像素的Image(約為Patch的16倍),并可對(duì)復(fù)雜的組織微環(huán)境進(jìn)行建模。Nagpal等[31]提出了用于前列腺活檢標(biāo)本全掃描圖像的格里森分級(jí)深度學(xué)習(xí)系統(tǒng),該系統(tǒng)包括兩個(gè)階段:第一階段采用通過(guò)神經(jīng)網(wǎng)絡(luò)搜索技術(shù)得到的CNN對(duì)WSI中每個(gè)Patch進(jìn)行分類,第二階段采用支持向量機(jī)和從結(jié)果熱圖中提取的特征進(jìn)行整體等級(jí)組的分類,其分級(jí)效果與亞病理專家的診斷能力一致。Raju等[35]綜合利用了GCN和基于注意力機(jī)制的MIL,構(gòu)建了結(jié)/直腸癌TNM分級(jí)系統(tǒng)。具體方法:首先從WSI中隨機(jī)選取一些Patch,并采用基于紋理的方法提取這些Patch的特征表示;然后基于Patch構(gòu)建出一系列的圖以保留Patch之間的空間關(guān)系,并將這些圖作為后續(xù)的基于注意力機(jī)制的MIL的示例。該方法分類準(zhǔn)確度為81.1%,顯著高于目前最好的結(jié)/直腸癌TNM分級(jí)方法。

4 展望

基于深度學(xué)習(xí)和組織病理圖像的癌癥分類研究為計(jì)算機(jī)輔助診斷及預(yù)后預(yù)測(cè)提供了新的模式,但目前仍無(wú)法在臨床上廣泛應(yīng)用。筆者通過(guò)分析其中原因,提出如下亟需解決的問(wèn)題和未來(lái)可能的發(fā)展方向。

首先,WSI最大的特點(diǎn)是分辨率極高,簡(jiǎn)單地把深度學(xué)習(xí)領(lǐng)域?qū)ψ匀粓D像分析的方法遷移過(guò)來(lái)應(yīng)用是不夠的。需研究專門針對(duì)WSI的深度學(xué)習(xí)研究框架,如果對(duì)WSI的分類也可以實(shí)現(xiàn)端到端的學(xué)習(xí)和推斷,未來(lái)則可能得到更好的WSI分類效果。

其次,與自然圖像動(dòng)輒百萬(wàn)張的標(biāo)注相比,病理圖像的標(biāo)注(特別是像素級(jí)標(biāo)注)困難且價(jià)格高昂。針對(duì)這一問(wèn)題,一方面可從弱監(jiān)督算法方面緩解標(biāo)注缺乏的問(wèn)題,另一方面需要投入更大的力量去構(gòu)建足夠大的基準(zhǔn)數(shù)據(jù)集。

再次,目前關(guān)于WSI的大多數(shù)研究集中于設(shè)計(jì)更加高效的網(wǎng)絡(luò)模型,這樣單方面的研究存在很大的局限性。針對(duì)超高分辨率圖像的深度學(xué)習(xí)方法研究,需從網(wǎng)絡(luò)模型優(yōu)化和并行計(jì)算等不同角度同時(shí)展開(kāi)。

最后,目前對(duì)病理圖像的研究和醫(yī)院中其他模態(tài)數(shù)據(jù)的研究是割裂的。應(yīng)融合多組學(xué)、影像、檢查檢驗(yàn)、電子病歷等一切可用的不同模態(tài)的數(shù)據(jù)進(jìn)行癌癥分類研究,從而更好地輔助診斷和預(yù)后預(yù)測(cè)。

作者貢獻(xiàn):顏銳、陳麗萌、李錦濤、任菲負(fù)責(zé)論文選題構(gòu)思和校對(duì);顏銳、任菲負(fù)責(zé)文獻(xiàn)收集,論文撰寫(xiě)、修訂。

利益沖突:無(wú)