嵌入通道注意力的YOLOv4火災(zāi)煙霧檢測(cè)模型

謝書翰, 張文柱, 程 鵬, 楊子軒

(西安建筑科技大學(xué) 信息與控制工程學(xué)院,陜西 西安710048)

1 引 言

隨著經(jīng)濟(jì)的發(fā)展,大型場(chǎng)景的火災(zāi)檢測(cè)任務(wù)越發(fā)重要,而傳統(tǒng)火災(zāi)檢測(cè)環(huán)節(jié)中傳感器的檢測(cè)能力較差,檢測(cè)環(huán)節(jié)易受各種干擾因素的影響,從而使檢測(cè)的準(zhǔn)確率較低[1]。隨著圖像、視頻處理技術(shù)的迅猛發(fā)展,各種基于圖像、視頻處理技術(shù)的煙霧檢測(cè)算法被提出,在各種大型空間火災(zāi)檢測(cè)任務(wù)中效果顯著。煙霧先于火焰的發(fā)生而發(fā)生,且煙霧具有比火焰更強(qiáng)的擴(kuò)散性,攝像頭更加容易捕捉到煙霧圖像,所以煙霧檢測(cè)在火災(zāi)檢測(cè)任務(wù)中顯得格外重要。

目前,傳統(tǒng)基于圖像、視頻的火災(zāi)煙霧檢測(cè)算法主要是根據(jù)煙霧的形狀、色彩、紋理、湍流、飄動(dòng)等特征進(jìn)行火災(zāi)煙霧識(shí)別,研究者通過研究煙霧的一種或多種特征,使用各種不同的分類算法進(jìn)行火災(zāi)煙霧識(shí)別。Genovese等人[2]研究煙霧在YUV空間的顏色特性,得到煙霧檢測(cè)算法,但是對(duì)于擴(kuò)散緩慢的煙霧以及復(fù)雜背景的煙霧視頻效果不佳。Sedlák V等人[3]研究了煙霧的運(yùn)動(dòng)特性、煙霧的顏色、面積增長率和運(yùn)動(dòng)方向,通過多特征進(jìn)行分類識(shí)別,但是該方法小區(qū)域煙霧以及擴(kuò)散不明顯的煙霧區(qū)域檢測(cè)效果較差。Gubbi等人[4]提出一種結(jié)合小波變換的檢測(cè)煙霧方法,利用小波分解得到子帶圖像,提取出幾十種煙霧特征。李紅娣等人[5]通過圖像金字塔和池化操作,提取LOBP和EOH直方圖,得到煙霧特征矢量,最后放入支持向量機(jī)進(jìn)行訓(xùn)練得到火災(zāi)煙霧識(shí)別模型。

這些算法從煙霧的本質(zhì)特征進(jìn)行研究,通過提取煙霧的一種或者多種特征進(jìn)行煙霧識(shí)別。對(duì)于煙霧區(qū)域較大、背景單一的煙霧視頻圖像,傳統(tǒng)的視頻煙霧檢測(cè)效果較好,但是火災(zāi)初期以及遠(yuǎn)距離火災(zāi)煙霧視頻圖像,煙霧區(qū)域往往較小,此時(shí)檢測(cè)效果較差,出現(xiàn)漏檢情況嚴(yán)重,而且不能在多場(chǎng)景任務(wù)中應(yīng)用。

隨著卷積神經(jīng)網(wǎng)絡(luò)CNN的發(fā)展,針對(duì)上述問題,Zhang等人[6]和張倩等人[7]利用Faster R-CNN對(duì)煙霧圖像進(jìn)行煙霧的識(shí)別。Frizz等人[8]和李鵬等人[9]使用卷積神經(jīng)網(wǎng)絡(luò)作為特征提取器,得到煙霧檢測(cè)模型,較傳統(tǒng)特征提取手段有著更佳的性能。富雅捷等人[10]通過選擇性搜索法獲取候選區(qū)域,將候選區(qū)域經(jīng)過CNN網(wǎng)絡(luò)得到高層特征,最后放入支持向量機(jī)訓(xùn)練,得到煙霧檢測(cè)模型。馮路佳等人[11]提出了MD_CNN 煙霧檢測(cè)模型,通過背景差分法得到運(yùn)動(dòng)目標(biāo)區(qū)域,將運(yùn)動(dòng)目標(biāo)區(qū)域放入CNN網(wǎng)絡(luò)進(jìn)行分類,最后得到煙霧區(qū)域。劉麗娟等人[12]利用SSD對(duì)煙霧圖像進(jìn)行識(shí)別。

在火災(zāi)煙霧檢測(cè)這一特定的領(lǐng)域,使用深度學(xué)習(xí)方法的研究和數(shù)據(jù)集相對(duì)較少。本文提出一種改進(jìn)的YOLOv4[13]的火災(zāi)煙霧檢測(cè)算法,在YOLOv4的基礎(chǔ)上嵌入通道注意力,以提高網(wǎng)絡(luò)預(yù)測(cè)頭的特征提取能力;使用K-means聚類獲取更符合火災(zāi)煙霧檢測(cè)的候選框尺寸;根據(jù)火災(zāi)煙霧檢測(cè)這一二分類場(chǎng)景,精簡了損失函數(shù);訓(xùn)練階段引入隨機(jī)擦除和標(biāo)簽平滑,以降低過擬合風(fēng)險(xiǎn)。實(shí)驗(yàn)結(jié)果表明,該算法能夠在多場(chǎng)景精準(zhǔn)實(shí)現(xiàn)火災(zāi)煙霧檢測(cè)。

2 本文算法

2.1 YOLOv4實(shí)時(shí)目標(biāo)檢測(cè)框架

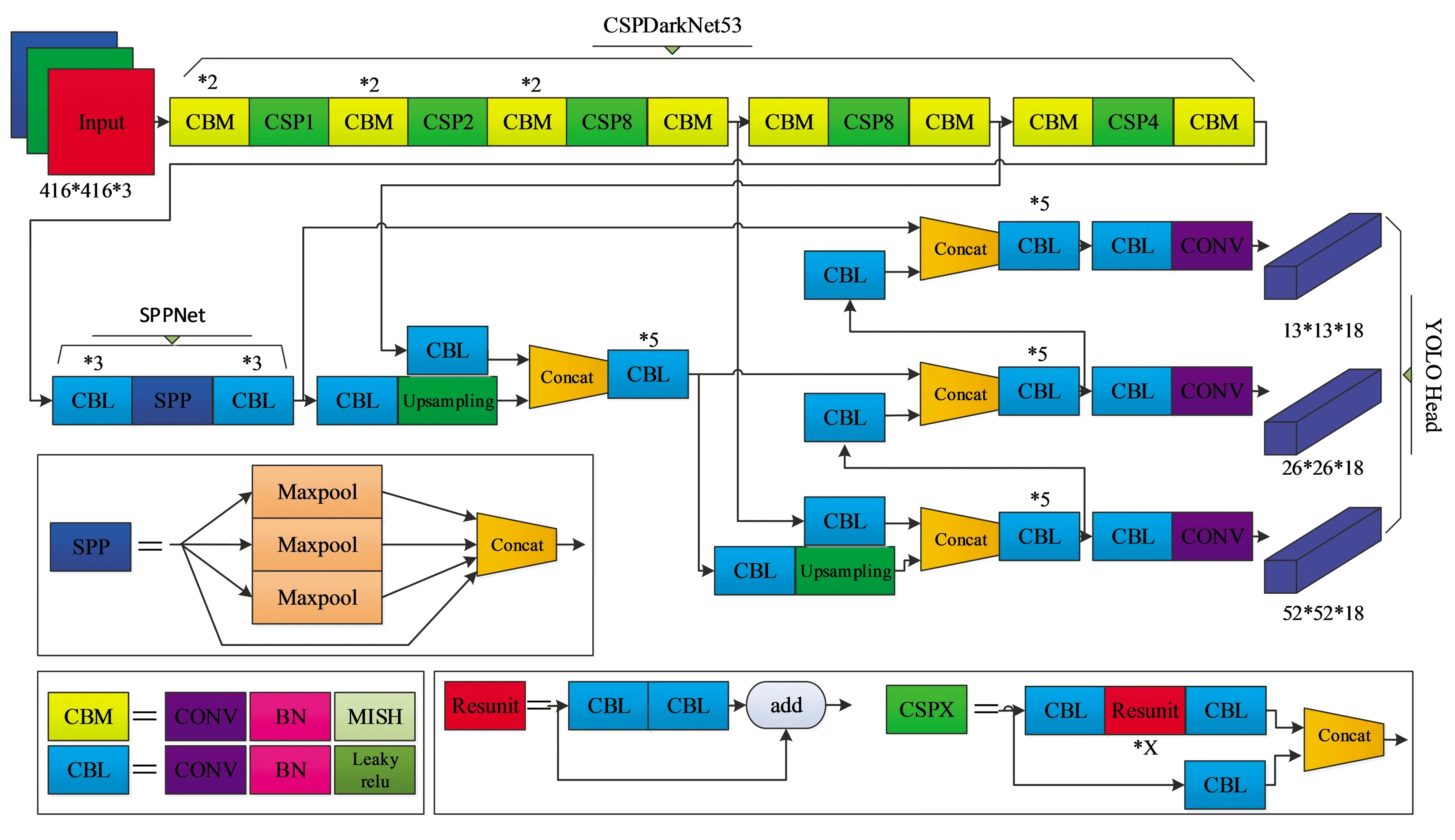

YOLOv4是一種端到端的實(shí)時(shí)目標(biāo)檢測(cè)框架,由YOLOv3[14]改進(jìn)而來,YOLOv4模型見圖1。YOLOv4主要包含 CSPDarkNet53 特征提取主干網(wǎng)絡(luò)、SPPNet(Spatial Pyramid Pooling Network)、PANet(Path Aggregation Network)多尺度預(yù)測(cè)網(wǎng)絡(luò)以及網(wǎng)絡(luò)預(yù)測(cè)頭(YOLO Head)。其中CSPDarknet53由5個(gè)大殘差塊組成,這5個(gè)大殘差塊包含的小殘差單元個(gè)數(shù)分別為1,2,8,8,4,也即是兩個(gè)CBM卷積模塊和一個(gè)CSPX卷積模塊共同構(gòu)成一個(gè)大殘差塊。在CSPDarknet53的最后一個(gè)特征層輸出之后加入SPPNet,分別利用4個(gè)不同尺度的最大池化進(jìn)行處理,最大池化的池化核大小分別為13×13,9×9,5×5,1×1(1×1表示無處理),這種池化操作能夠在幾乎不增加模型的推理時(shí)間的情況下提高模型的推理能力。PANet由上采樣和下采樣兩部分構(gòu)成,充分利用了特征融合。

YOLOv4有3個(gè)網(wǎng)絡(luò)預(yù)測(cè)頭,3個(gè)網(wǎng)絡(luò)預(yù)測(cè)頭輸出的形狀分別為(13,13,18),(26,26,18),(52,52,18)。最后一個(gè)維度為18,是因?yàn)樵摍z測(cè)算法基于火災(zāi)煙霧數(shù)據(jù)集,僅識(shí)別火災(zāi)煙霧一個(gè)類別,而YOLOv4針對(duì)每一個(gè)網(wǎng)絡(luò)預(yù)測(cè)頭存在3個(gè)先驗(yàn)框,每個(gè)先驗(yàn)框占據(jù)6維信息。

圖1 YOLOV4 網(wǎng)絡(luò)結(jié)構(gòu)圖Fig.1 YOLOV4 network structure diagram

2.2 候選框改進(jìn)

網(wǎng)絡(luò)預(yù)測(cè)頭中候選框尺寸的設(shè)置是十分重要的,選擇符合煙霧大小特征的候選框尺寸可以有助于煙霧預(yù)測(cè)框位置的回歸,故在火災(zāi)煙霧檢測(cè)任務(wù)中對(duì)候選框尺寸進(jìn)行改進(jìn)。

本文使用K均值聚類(K-means)為火災(zāi)煙霧數(shù)據(jù)集生成新的候選框尺寸,本文算法的輸入火災(zāi)煙霧圖像尺寸為416×416,使用K-means對(duì)416×416的火災(zāi)煙霧圖像生成的9個(gè)新的候選框尺寸分別為12×16,19×36,40×28,36×75,76×55,72×146,142×110,192×243,362×322。

2.3 網(wǎng)絡(luò)預(yù)測(cè)頭改進(jìn)

2.3.1 通道注意力

在每個(gè)卷積過程中,一些復(fù)雜的干擾信息不可避免地會(huì)分布在某些通道上,導(dǎo)致網(wǎng)絡(luò)性能降低。注意力機(jī)制在神經(jīng)網(wǎng)絡(luò)中得到了廣泛的使用[15-16],隨著對(duì)通道注意力機(jī)制的深入研究,調(diào)整各通道信息的通道權(quán)重,對(duì)各通道信息賦予不同的權(quán)值,根據(jù)權(quán)值大小對(duì)通道信息進(jìn)行篩選,這樣能有效緩解干擾信息的影響。通道注意力的典型代表是SENet(Squeeze-and-Excitation Networks)[17]。 如圖2所示。

圖2 通道注意力Fig.2 Channel attention

圖2中,輸入特征圖X,X有C個(gè)通道,每個(gè)通道空間大小為H×W,對(duì)每個(gè)通道進(jìn)行全局平均池化,則通道權(quán)重Z的計(jì)算公式如式(1)所示:

(1)

其中輸出Z是長度為C的一維數(shù)組,表示壓縮通道得到的權(quán)重;(i,j)表示在大小為H×W的特征圖上橫縱坐標(biāo)分別為i和j的點(diǎn)。

然后使用激活函數(shù)對(duì)各通道權(quán)重進(jìn)行相關(guān)程度建模。公式如下:

SC=Fex(Z,W)=Sigmoid(W2×ReLU(W1,Z)),

(2)

其中:SC的維度是1×1×C,SC對(duì)應(yīng)生成的通道注意力權(quán)重。通道注意力權(quán)值是需要經(jīng)過前面這些全連階層和非線性學(xué)習(xí)得到的;W1的維度是C/r×C,W2的維度是C×C/r,r為放縮系數(shù),這是由兩個(gè)全連接層組成。

最后對(duì)輸入通道進(jìn)行加權(quán)調(diào)整,通道注意力加權(quán)公式為:

(3)

SENet可以嵌入任意卷積層中,假若每個(gè)卷積層都嵌入SENet會(huì)帶來巨大的參數(shù)量,SENet的參數(shù)數(shù)目公式如下:

(4)

其中:N為參數(shù)數(shù)目,n為嵌入SENet的次數(shù),參數(shù)數(shù)目主要來自于放置的兩個(gè)全連接層,所以C和r以及n決定了給網(wǎng)絡(luò)帶來的參數(shù)大小。

SENet帶來的參數(shù)量決定了SENet只能在某些卷積層使用。在特征提取主干網(wǎng)絡(luò)上加入SENet,可以提升特征提取主干網(wǎng)絡(luò)對(duì)圖像特征的提取,如文獻(xiàn)[18-19]取得了不錯(cuò)的結(jié)果。本文算法的特征提取主干網(wǎng)絡(luò)為CSPDarkNet53,CSPDarkNet53結(jié)構(gòu)比較龐大,特征提取能力就火災(zāi)煙霧圖像而言已經(jīng)足夠,不適宜嵌入SENet。

2.3.2 嵌入通道注意力

本文在網(wǎng)絡(luò)預(yù)測(cè)頭嵌入SENet,這樣做主要有兩個(gè)優(yōu)點(diǎn):第一,減輕干擾信息的干擾,提升了網(wǎng)絡(luò)預(yù)測(cè)頭對(duì)特征信息的提取能力,從而提升了整個(gè)網(wǎng)絡(luò)的性能;第二,帶來了極小的參數(shù)量,僅為網(wǎng)絡(luò)增加了3MB的參數(shù)量。

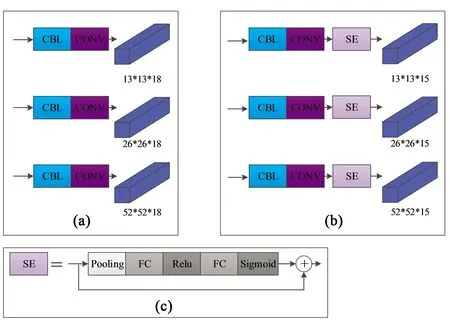

圖3 算法改進(jìn)前后對(duì)比。(a)改進(jìn)前;(b)改進(jìn)后;(c)SENet。Fig.3 Comparison of algorithm before and after improvement. (a) Before improvement; (b)After improvement; (c) SEnet.

本文在網(wǎng)絡(luò)預(yù)測(cè)頭嵌入SENet,如圖3所示。在3個(gè)CONV卷積操作后面加入SENet,圖3(c)為SENet的結(jié)構(gòu)。由上文知,第一個(gè)FC層的神經(jīng)元個(gè)數(shù)為C/r,第二個(gè)FC層神經(jīng)元個(gè)數(shù)為C,縮放系數(shù)r一般取2,4,8,16,SENet的效果會(huì)隨著縮放系數(shù)r的增大而變?nèi)酰s放系數(shù)r的增大會(huì)降低參數(shù)量,由于本文在網(wǎng)絡(luò)預(yù)測(cè)頭嵌入SENet,參數(shù)量是非常小的,所以縮放系數(shù)r取2是比較合理的。

2.4 損失函數(shù)改進(jìn)

YOLOv4的損失函數(shù)如下:

L=Lcoord+Liou+Lclass,

(5)

其中:L為總損失函數(shù);Lcoord為置信度損失函數(shù),回歸是否存在物體信息;Liou為框損失函數(shù),回歸位置信息;Lclass為分類損失函數(shù),回歸類別信息。

火災(zāi)煙霧數(shù)據(jù)集,僅存在火災(zāi)煙霧一類,是二分類問題,所以Lcoord和Lclass是存在計(jì)算冗余的,本文采用式(6)作為損失函數(shù)。

L=Lcoord+Liou,

(6)

改進(jìn)后的損失函數(shù)去掉了分類損失函數(shù),精簡了損失函數(shù)的構(gòu)成以提升網(wǎng)絡(luò)的收斂速度和抗干擾性。

故3個(gè)網(wǎng)絡(luò)預(yù)測(cè)頭輸出的形狀分別從(13,13,18),(26,26,18),(26,26,18)變?yōu)?13,13,15),(26,26,15),(26,26,15),如圖3所示。

3 實(shí)驗(yàn)設(shè)計(jì)

3.1 火災(zāi)煙霧數(shù)據(jù)集

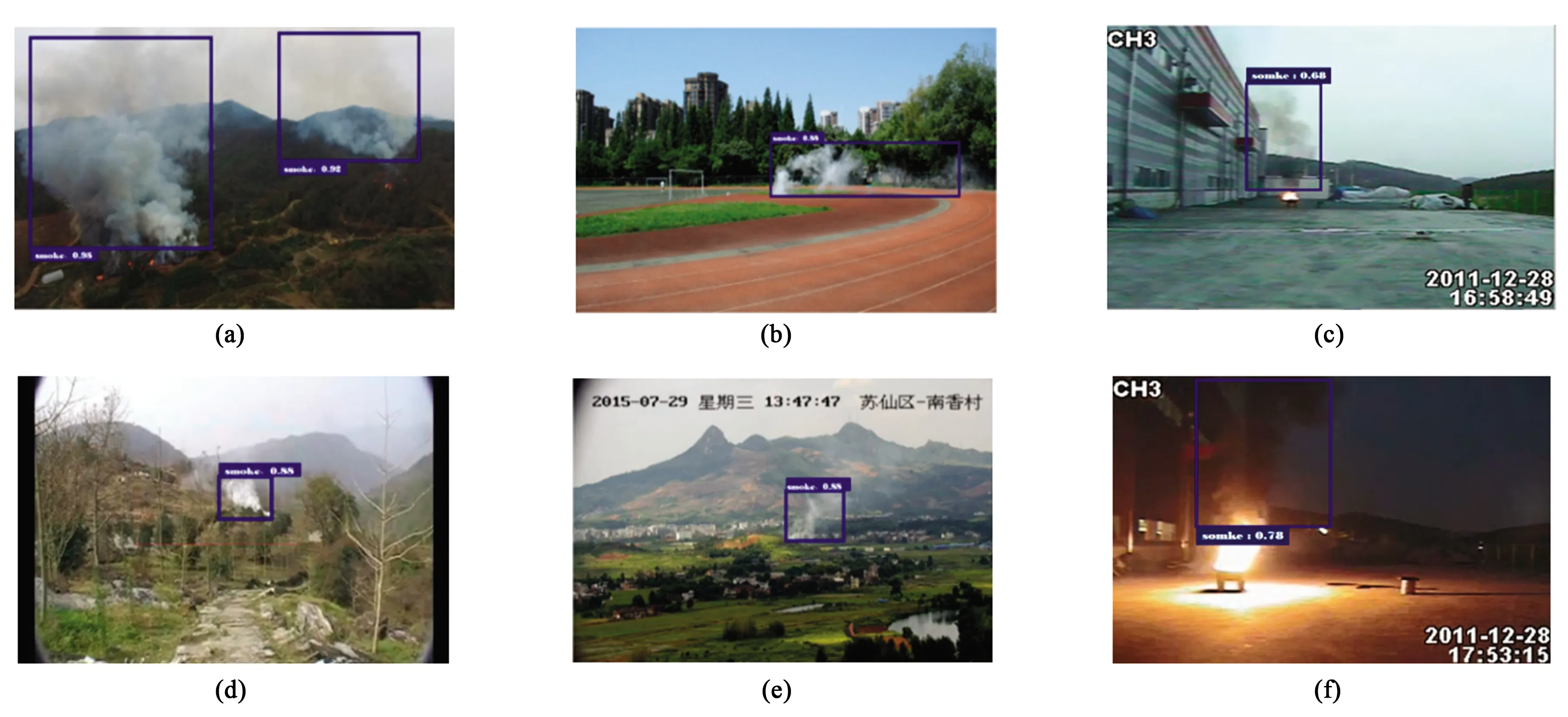

本文除了主動(dòng)在網(wǎng)上爬取火災(zāi)煙霧圖像,還采用了目前煙霧檢測(cè)方向較為認(rèn)可的中國科學(xué)院大學(xué)火災(zāi)重點(diǎn)實(shí)驗(yàn)室、韓國啟明大學(xué)和土耳其比爾肯大學(xué)的煙霧視頻數(shù)據(jù),這些數(shù)據(jù)大多為avi格式的視頻數(shù)據(jù),本文將視頻數(shù)據(jù)一幀一幀地制作成圖片數(shù)據(jù)加以使用。這些火災(zāi)煙霧圖像包含遠(yuǎn)景、近景、夜晚以及背景干擾因素較多的煙霧圖像,以此火災(zāi)煙霧數(shù)據(jù)集作為證明本文算法有效性的證據(jù)。部分火災(zāi)煙霧如圖4所示。

圖4 部分真實(shí)火災(zāi)煙霧圖像Fig.4 Part of the real fire smoke images

3.2 實(shí)驗(yàn)環(huán)境

本文實(shí)驗(yàn)環(huán)境為:NVIDIA GeForce RTX 1660,64 位Win10操作系統(tǒng)。編程語言為Python,深度學(xué)習(xí)框架為Keras。

本文對(duì)于主干網(wǎng)絡(luò)CSPDarkNet53使用ImageNet大型數(shù)據(jù)集下分類任務(wù)的預(yù)訓(xùn)模型,可以加快網(wǎng)絡(luò)收斂速度。根據(jù)文獻(xiàn)[13]實(shí)驗(yàn)結(jié)論指出訓(xùn)練階段分兩階段進(jìn)行會(huì)有更好效果,第一階段凍結(jié)主干網(wǎng)絡(luò)CSPDarkNet53網(wǎng)絡(luò)參數(shù),調(diào)整非主干網(wǎng)絡(luò)參數(shù),優(yōu)化器使用Adam,此階段是粗調(diào)階段,最大學(xué)習(xí)率應(yīng)設(shè)置得比第二階段要大,設(shè)置為0.001,Batch size根據(jù)顯卡的性能,由于只調(diào)整非主干網(wǎng)絡(luò)參數(shù),故可以設(shè)置為8,訓(xùn)練20個(gè)epoch;第二階段釋放主干網(wǎng)絡(luò)CSPDarkNet53網(wǎng)絡(luò)參數(shù),優(yōu)化器使用Adam,此階段是微調(diào)階段,最大學(xué)習(xí)率設(shè)置得比第一階段要小,設(shè)置為0.000 1,Batch size根據(jù)顯卡的性能,由于調(diào)整整個(gè)網(wǎng)絡(luò)參數(shù),故設(shè)置為2。

3.3 數(shù)據(jù)增強(qiáng)

在目標(biāo)檢測(cè)中,為了防止檢測(cè)模型過擬合現(xiàn)象的出現(xiàn),提升算法性能,需要輸入足夠的訓(xùn)練數(shù)據(jù)。現(xiàn)實(shí)中無法滿足足夠的訓(xùn)練數(shù)據(jù),此時(shí)就要對(duì)數(shù)據(jù)集進(jìn)行數(shù)據(jù)增強(qiáng)操作,以彌補(bǔ)數(shù)據(jù)量小帶來的缺點(diǎn)。

本文采用了圖像翻轉(zhuǎn)、放縮、隨機(jī)擦除等數(shù)據(jù)增強(qiáng)方法以彌補(bǔ)數(shù)據(jù)量小帶來的缺點(diǎn),從而降低過擬合風(fēng)險(xiǎn)。

放縮:圖像有75%的概率進(jìn)行隨機(jī)比例的寬高放縮。

翻轉(zhuǎn):圖像有75%的概率進(jìn)行左右、上下翻轉(zhuǎn)。

隨機(jī)擦除:隨機(jī)擦除在目標(biāo)檢測(cè)中得到大量應(yīng)用,均取得不錯(cuò)的效果[20-21]。訓(xùn)練時(shí),隨機(jī)擦除方法會(huì)在原圖隨機(jī)選擇一個(gè)矩形區(qū)域,將該區(qū)域的像素替換為隨機(jī)值。這個(gè)過程中,參與訓(xùn)練的圖片會(huì)做不同程度的遮擋,這樣可以降低過擬合的風(fēng)險(xiǎn)并提高模型的魯棒性。

圖5 實(shí)驗(yàn)檢測(cè)效果。(a)大區(qū)域煙霧;(b)中區(qū)域煙霧;(c)白天煙霧;(d)小區(qū)域煙霧且與背景相似;(e)小區(qū)域煙霧且煙霧不明顯;(f)夜晚煙霧。Fig.5 Experimental detection effect. (a) Smoke in a large area; (b) Smoke in a medium area; (c) Daytime smoke; (d) Smoke in a small area and similar to the background; (e) Smoke in a small area and smoke is not obvious;(f) Night smoke.

4 實(shí)驗(yàn)結(jié)果及分析

4.1 評(píng)價(jià)指標(biāo)

本 文 通 過 訓(xùn) 練 后 模 型 檢 測(cè) 的 準(zhǔn) 確 率(Precision)、召回率 (Recall)、調(diào)和平均值(Harmonic mean)、每秒檢測(cè)幀數(shù)FPS(Frames Per Second)以及模型大小(Size)作為參考進(jìn)行對(duì)比,準(zhǔn) 確 率、召回率和調(diào)和平均值由式(7)~(9)計(jì)算所得。

(7)

(8)

(9)

式(7)~式(9)中:P為準(zhǔn)確率;R為召回率;H為調(diào)和平均值,調(diào)和平均值綜合了準(zhǔn)確率和召回率,調(diào)和平均值越大,算法性能越好;TP為真正例;FP為假正例;FN為假負(fù)例。

4.2 實(shí)驗(yàn)結(jié)果

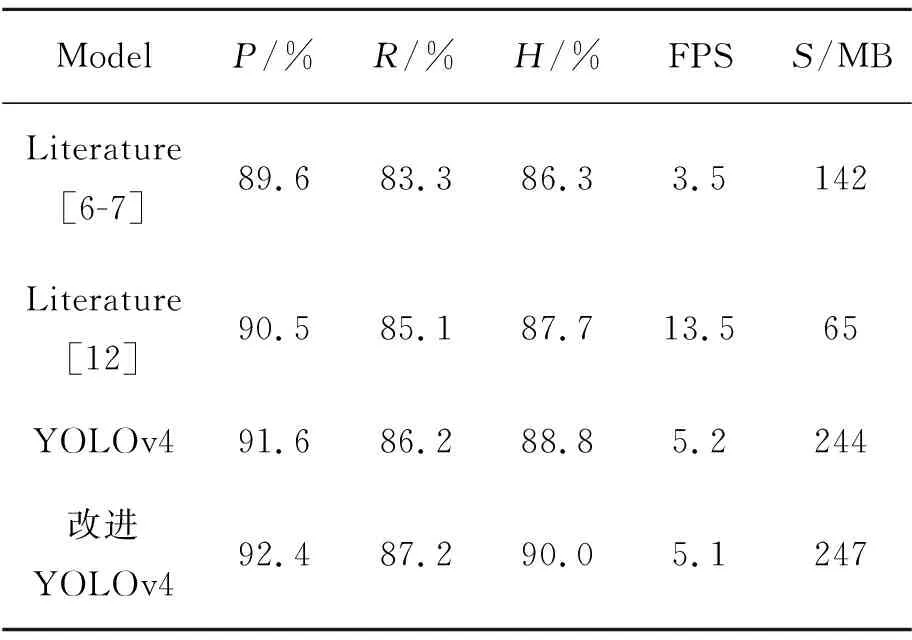

YOLOv4與SE-YOLOv4的檢測(cè)結(jié)果對(duì)比如表1所示,實(shí)驗(yàn)結(jié)果表明,SE-YOLOv4網(wǎng)絡(luò)模型僅犧牲了0.1幀/s的代價(jià),準(zhǔn)確率和召回率分別提高了0.9%,1.5%。

為了進(jìn)一步驗(yàn)證本文模型在火災(zāi)煙霧檢測(cè)上的有效性,本文對(duì)比了文獻(xiàn)[6-7]提出的Faster R-CNN的煙霧檢測(cè)模型以及文獻(xiàn)[12]提出的SSD煙霧檢測(cè)模型,檢測(cè)結(jié)果對(duì)比見表1。

由表1可以看出,本文的火災(zāi)檢測(cè)模型在準(zhǔn)確率和召回率中有大幅度的提高,較文獻(xiàn)[6-7]無論從精度和速度都有較大提升;較于文獻(xiàn)[12]在準(zhǔn)確率和召回率領(lǐng)先了1.9%,2.1%,在FPS落后了8.4幀/s的速度。

FPS的高低往往由模型的參數(shù)量所決定,一般情況下參數(shù)量越小,計(jì)算量則越小,檢測(cè)速度就越快。文獻(xiàn)[12]的FPS如此之高,是因?yàn)槲墨I(xiàn)[12]是基于SSD煙霧檢測(cè)模型,SSD網(wǎng)絡(luò)結(jié)構(gòu)精簡、參數(shù)量少,其網(wǎng)絡(luò)結(jié)構(gòu)擁有多尺度分類器,能較好地兼顧提取大、小目標(biāo)。文獻(xiàn)[12]又將SSD的主干特征提取網(wǎng)絡(luò)VGG16改進(jìn)為MobileNetV2,整個(gè)模型的計(jì)算量和參數(shù)量有明顯的下降,并且MobileNetV2作為主干特征提取網(wǎng)絡(luò)優(yōu)于VGG16。本文煙霧檢測(cè)模型的參數(shù)量是文獻(xiàn)[12]煙霧檢測(cè)模型參數(shù)量的近4倍,但是文獻(xiàn)[12]煙霧檢測(cè)模型結(jié)構(gòu)精簡、參數(shù)量少,不可避免地性能達(dá)不到最優(yōu)。

表1 其他煙霧檢測(cè)模型與本文模型對(duì)比Tab.1 Comparison of results between other fire smoke detection models and this model

實(shí)驗(yàn)結(jié)果表明,本文模型具有一定的優(yōu)越性。本文基于YOLOv4的煙霧檢測(cè)具備良好的泛化能力,擁有高的準(zhǔn)確率和召回率,適于多場(chǎng)景火災(zāi)煙霧檢測(cè),特別是在小區(qū)域火災(zāi)煙霧圖像上也有良好表現(xiàn)。

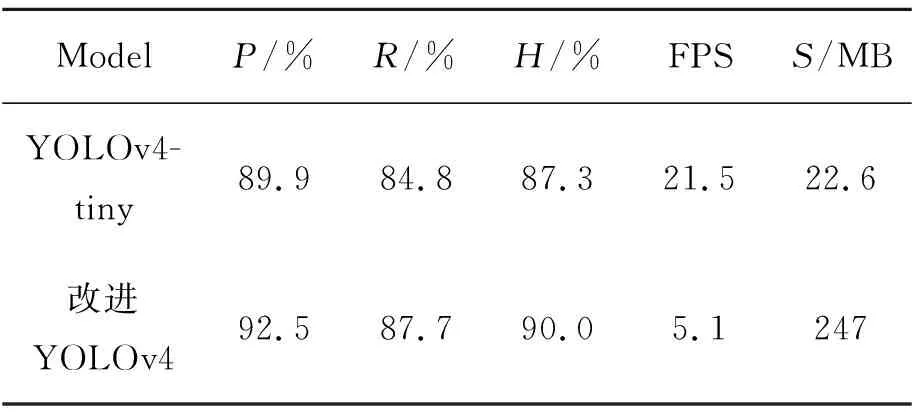

4.3 YOLOv4-tiny

YOLOv4-tiny是YOLOv4輕量化的網(wǎng)絡(luò)架構(gòu),本文對(duì)YOLOv4-tiny進(jìn)行了實(shí)驗(yàn)對(duì)比,如表2所示。

YOLOv4-tiny是在YOLOv4的基礎(chǔ)上所輕量化的算法,主干特征提取網(wǎng)絡(luò)進(jìn)行了精簡;多尺度預(yù)測(cè)由3個(gè)降為2個(gè),候選框則從9個(gè)降為4個(gè);不使用PANet作為特征融合,改為使用傳統(tǒng)的FPN進(jìn)行特征融合等。極大地精簡了網(wǎng)絡(luò)結(jié)構(gòu)和減少了參數(shù)量以及計(jì)算量。在精度上雖然有所降低,但在速度上遠(yuǎn)超本文算法以及文獻(xiàn)[12]中的檢測(cè)算法,這給優(yōu)化本文模型帶來了思路,為之后如何平衡檢測(cè)精度和檢測(cè)速度帶來方向。

表2 YOLOv4-tiny與本文模型對(duì)比Tab.2 Comparison of detection results between YOLOv4-tiny and this model

5 結(jié) 論

本文在 YOLOv4的基礎(chǔ)上嵌入SENet,明顯提高了算法在多場(chǎng)景火災(zāi)煙霧檢測(cè)上的性能;使用K-means聚類算法得到更加貼近火災(zāi)煙霧數(shù)據(jù)集的候選框尺寸;引入翻轉(zhuǎn)和隨機(jī)擦除等數(shù)據(jù)增強(qiáng)手段降低過擬合風(fēng)險(xiǎn);在二分類的基礎(chǔ)上,精簡了損失函數(shù),提高了網(wǎng)絡(luò)的抗干擾能力。

實(shí)驗(yàn)結(jié)果表明,本文改進(jìn)后的方法與同類火災(zāi)檢測(cè)算法相比,在準(zhǔn)確度和速度上都具有良好的表現(xiàn),在數(shù)據(jù)集上達(dá)到了 92.5%的準(zhǔn)確率,87.7%的召回率,平均檢測(cè)速度達(dá) 5.1幀/s;但在平均檢測(cè)速度上還有很大的進(jìn)步空間,在之后的工作中可以在不犧牲性能的情況下,減小模型大小,以提高平均檢測(cè)速度。火災(zāi)煙霧數(shù)據(jù)可以繼續(xù)得到擴(kuò)展,增加更多的火災(zāi)煙霧場(chǎng)景,提高火災(zāi)煙霧數(shù)據(jù)質(zhì)量。