超尺度自導注意力網絡的遙感船舶識別

陳會偉,劉樹美,劉培學,公茂法

(1.青島黃海學院 智能制造學院,山東 青島 266427;2.山東科技大學 電氣與自動化工程學院,山東 青島 266427)

0 概述

隨著遙感傳感器的快速發展,高空間分辨率遙感圖像可以為目標物體提供更詳細、更多樣的幾何結構描述[1]及豐富的細節和空間結構信息。但由于物體尺度變化的復雜性,遙感目標的識別仍然存在巨大挑戰。

截止目前,國內外研究人員設計了諸多算法以檢測和識別遙感圖像中不同類型的物體[2-3]。早期的多尺度目標檢測識別算法多基于人工參與的特征設計,如DALAL[4]、LOWE[5]等利用多尺度滑動窗口生成不同尺度的圖像塊,分別通過手工制作的HOG(Histogram of Oriented Gradient)和SIFT(Scale-Invariant Feature Transform)等特征描述符提取特征,并將提取的特征輸入支持向量機(SVM)或條件隨機場(CRF)中進行分類識別。TAO 等[6]利用改進的SIFT匹配策略對機場中的目標物體進行檢測。XIAO等[7]利用HOG 的旋轉不變性檢測遙感圖像中的飛機、汽車等大型目標。雖然手工制作的特征在特定的目標識別任務中表現良好,但其通用性和魯棒性較差[1],且特征的設計耗時較長。

隨著深度學習模型在自然語言處理、圖像分割等領域的廣泛應用,深度學習技術被研究人員應用于多尺度遙感目標識別和檢測任務中以減少人工參與特征設計帶來的誤差[8]。如HAN 等[9]使用Fast-RCNN 檢測高分辨率遙感圖像中地理空間目標。CHEN 等[10]結合轉移學習方法,利用單一結構CNN 和有限的訓練樣本以實現飛機識別。DENG 等[11]采用級聯整流線性單元(ReLU)和inception 模塊的CNN 來捕獲圖像多尺度特征,并通過多個中間層生成類目標區域。ZHONG 等[12]提出一種位置敏感平衡(Position-Sensitive Balancing,PSB)框架,有效解決特征提取中的平移不變性。DING 等[13]采用密集卷積網絡(Dene Convolution Networks)、多尺度表示和多種改進方案以增強VGG-16 的特征提取能力,提高了檢測精度。WANG 等[14]提出一種多尺度的視覺注意網絡以捕獲多尺度空間的上下文語義,并突出目標區域的特征。

雖然上述的多尺度目標檢測方法提高了目標檢測或識別的精度,但這些多尺度結構多是建立在單一結構的卷積層上,受到卷積層數的限制且缺乏豐富的接收域,導致捕獲的多尺度特征難以對極端尺度變化的目標對象進行建模,影響高空間分辨率遙感圖像中超大和極小目標的識別精度。但是,如果僅通過疊加單一結構的卷積層來增強特征提取能力,就會隨著網絡層數的增加而出現擬合和梯度消失、爆炸等問題。

為緩解高空間分辨率遙感圖像中目標對象的極端尺度變化問題,本文提出一種超尺度自導注意力網 絡(Hyper-Scale Self-Guided Attention Networks,HSSGAN)的目標識別框架。該網絡在卷積層中構建多個輕量級多尺度結構,從多個卷積子空間組中捕獲豐富的多尺度特征,根據組之間的連接將多尺度特征進行組合,形成極端尺度特征,即小尺度和超尺度特征。利用自導注意力網絡逐層細化極端特征圖,在極端尺度的局部和全局語義之間建立長期依賴關系,并解決冗余信息的重復使用問題以提高遙感圖像中目標船舶的識別精度。

1 超尺度自導注意力網絡的識別框架

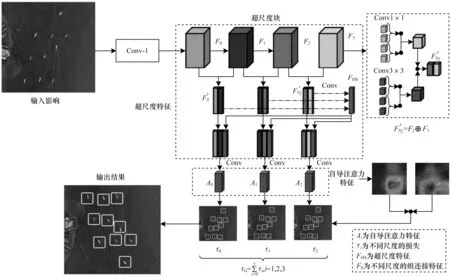

高空間分辨率遙感圖像中目標物體的結構通常在尺度、紋理和形狀上變化較大,且容易表現出類內和類間多樣性。而傳統卷積神經網絡的接受域有限,產生的局部特征難以對超尺度的目標物體進行詳細描述。為解決這些問題,提出一種超尺度自導注意力網絡的遙感船舶識別框架,利用超尺度子空間組捕獲目標船舶的局部和全局語義,并逐步細化超尺度特征圖,自適應地建立長期依賴關系,濾除冗余信息以提高識別精度。HSSGAN 的網絡結構如圖1 所示。

圖1 HSSGAN 的網絡結構Fig.1 Network structure of HSSGAN

在圖1 中,Conv1×1 表示卷積核大小為1×1,Conv3×3 表示卷積核大小為3×3。該超尺度自導注意力的遙感船舶識別框架主要包含超尺度特征提取模塊和自導注意力模塊2 個部分。超尺度特征提取模塊主要被用于提取船舶目標的不同尺度特征,其中包括極小尺度和超大尺度。而自導注意力模塊主要由通道注意力和位置注意力2 個模塊組成,被應用于不同尺度的特征中以實現不同尺度特征的逐步細化、去除冗余信息、增強相關特征的表征能力,使特征對不同類型的目標具有更優異的區分能力。

1.1 超尺度塊

超尺度塊[15]是由多個不同尺度的卷積層通過組連接構成的輕量級子空間模塊,能夠增強超尺度特征的表示能力。與傳統卷積層通過提取多尺度特征以增強表征能力[16-17]不同,組連接為2 個卷積層中組特性之間的連接,通過實現層間信息復用使該2 層能獲得更多細節信息。在卷積接收域有限的情況下,此方法可提高同尺度卷積特征的利用率,并增加層間細節信息的傳遞。

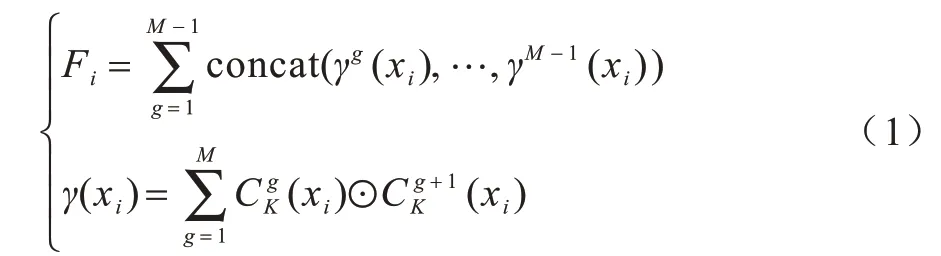

假設 初始輸入為xi,且xi?{x1,x2,…,xn},經過不同尺度的單一卷積層可得到CK(xi),其中:K為卷積核的大小,且滿足K=1,3,5,7。組連接復合函數為γ(·),尺度特征Fi?{F1,F2,…,Fn},尺度塊內的組連接計算如式(1)所示:

其中:M表示同尺度卷積塊數量;⊙表示點積拼接;concat(·)表示簡單拼接。

在不增加卷積層接收域的情況下,捕獲的卷積特征按照組連接方式可提高特征的復用率,彌補有限接收域帶來的局限性。繼續對不同尺度卷積層捕獲特征Fi并使用組連接方式,可得到超尺度的特征圖FHS,計算公式如式(2)所示:

其中:F′(xi)表示不同尺度的組連接特征。

由于相鄰尺度組之間具有很強的關聯性,對其進行組連接能有效增強特征的表征能力,且可實現不同尺度信息組之間的互補,有利于遙感目標的準確定位。

1.2 自導注意力模塊

超尺度塊雖然能有效捕獲目標船舶的超尺度信息,但是對圖像進行編碼時,容易忽略超端尺度上的細節信息以及重復使用不相關的冗余信息,導致相關信息的表征效果弱化。為解決此問題,引入自導注意力網絡(Self-Guided Attention),對這些超尺度特征進行逐步細化有助于編碼局部和全局語義,從而自適應地在局部和全局語義之間建立長期依賴關系,通過消除冗余信息以突出相關信息對目標船舶的表征。由于低層級特征包含大量的紋理細節信息,因此將超尺度特征FHS與不同尺度特征相結合,使不同尺度特征映射的低層信息和高層語義相互補充,并將其輸入到自導注意力模塊中,能生成細化的注意力特征AS。計算公式如式(3)所示:

自導注意力模塊由位置注意力(Position Attention,PA)[18-19]和通道注意力[20](Channel Attention,CA)構成,位置注意力能獲得豐富的上下文表示,而通道注意力可被看作是特定類的響應,能加強不同語義信息之間的關聯性。

設輸入到注意力的特征圖為F?RC×W×H,其中:C表示通道維度;W表示寬維度;H表示高維度。

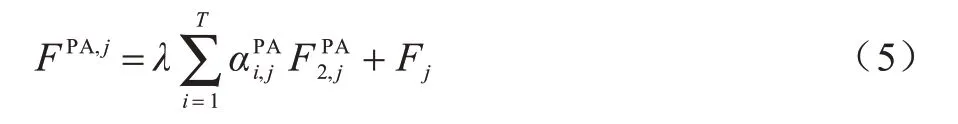

PA 是特征圖F經過卷積塊傳遞并重構生成新的特征圖,利用上述同樣操作得到的過程,2 個特征圖的空間注意力系數如式(4)所示:

通過位置注意力,進一步聚合了超尺度特征圖的全局上下文語義。

通過CA 增加了超尺度特征對不同類之間差異性的區分能力。

由于自導注意力模塊被應用在多個超尺度特征圖上,因此自導損失為多個模塊的損失之和,定義為τG,如式(8)所示:

其中:τi表示不同超尺度注意力圖的引導損失。通過自導注意力模塊,可對超尺度的特征圖進行逐步細化,在局部和全局語義之間建立長期依賴關系,并增強不同類之間特征圖的差異性。

2 實驗結果與分析

2.1 數據來源和評價指標

該數據集由Kaggle提供,共4 000張80像素×80像素的RGB 高空間分辨率遙感圖像,其中1 000 張為有船舶圖像,3 000 張無船舶圖像。為驗證本文所提HSSGAN 方法的可行性,對原始數據集進行了旋轉、平移等增強處理,并將數據集隨機劃分為訓練集、驗證集和測試集。其中,20%的圖像用于訓練,并從中隨機抽取其中10%進行5 倍交叉驗證。剩余80%的圖像用于測試。

為進一步驗證該方法的正確性,采用精準率(Precision,P)、召回率(Recall,R)和F1-Score 值(F1)等多種評測指標進行驗證。計算公式如式(9)所示:

其中:TTP表示真陽性,即正確識別數;FFP表示假陽性,即錯誤識別次數;FFN表示假陰性。

2.2 實驗參數設置

使用Adam 優化函數對網絡進行訓練,學習率為0.000 5,批處理設置為64,迭代次數為250 次。為證明超尺度模塊的有效性,對不同超尺度塊的識別效果進行了驗證,即設置為Hyper-1、Hyper-2、Hyper-3和Hyper-4。

為驗證所提HSSGAN 方法的優越性,與如下相關方法進行了比較。

1)HSF-Net[21]。該方法稱之為嵌入深度多尺度特征的光學遙感船舶檢測,主要是將不同尺度的特征映射到同一尺度空間,并使用端對端網絡進行訓練檢測。

2)CF-SDN[22]。該方法為提高特征的表征能力,融合了不同層次的特征,由粗到精的對船舶進行了檢測。

3)TP-FCN[23]。該方法主要對不同深度的層分配不同任務,深層提供檢測功能,淺層補充捕獲特征信息,以實現精確定位,可有效緩解精確定位與特征表征能力之間的權衡問題。

2.3 結果分析

2.3.1 不同超尺度塊間的比較

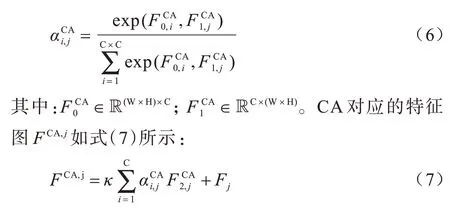

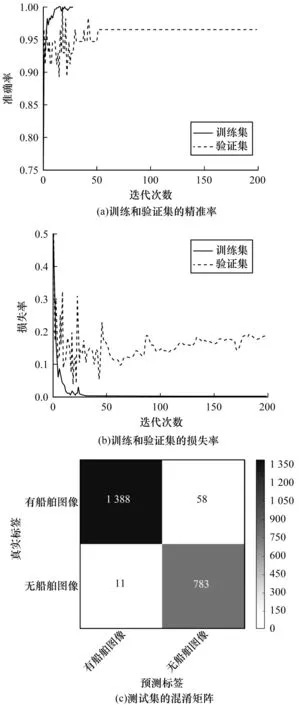

為驗證本文所提HSSGAN 方法的有效性,使用不同超尺度塊在Kaggle 實驗數據集上進行測試驗證。實驗結果如表1 所示,其中:Hyper-1 表示1 個超尺度塊;Hyper-2 表示2 個超尺度塊;Hyper-3 表 示3 個超尺度塊,即本文所提HSSGAN 方法;Hyper-4表示4 個超尺度塊,以此順推。

表1 不同超尺度塊的實驗結果Table 1 Experimental results of different super-scale blocks

從表1 中可看出,隨著超尺度塊的增加,識別精度也隨之增加。而當超尺度塊為4,即Hyper-4 時,識別精度開始下降,其F1 值為0.939 58。而Hyper-11的識別精度最低為0.869 18,因為較少的超尺度塊不能有效地捕獲遙感船舶的細節信息,且不能獲得足量的判別特征,導致影響船舶的識別精度。當超尺度塊足夠多時,可能會增加冗余信息的使用率及增加網絡參數量,導致網絡出現擬合現象,從而使識別精度下降。

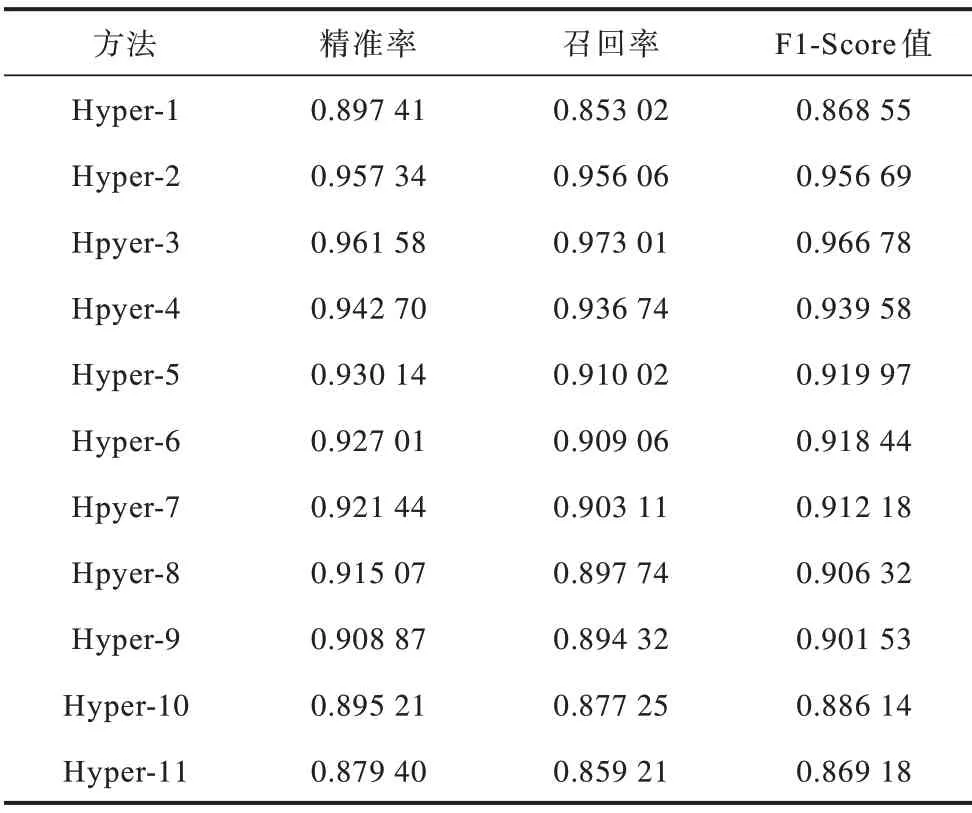

HSSGAN 方法迭代200 次的精準率、損失率和混淆矩陣如圖2 所示。圖2(a)表示訓練和驗證集的準確率(Accuracy);圖2(b)表示訓練和驗證集的損失率;圖2(c)表示測試集的混淆矩陣。

圖2 HSSGAN 的精準率、損失率和混淆矩陣Fig.2 Accuracy rate,obfuscation matrix and loss rate of HSSGAN

從圖2 中可看出,隨著迭代次數的增加,精準率先增加然后處于穩定狀態,損失率則下降一定程度后處于穩定狀態。

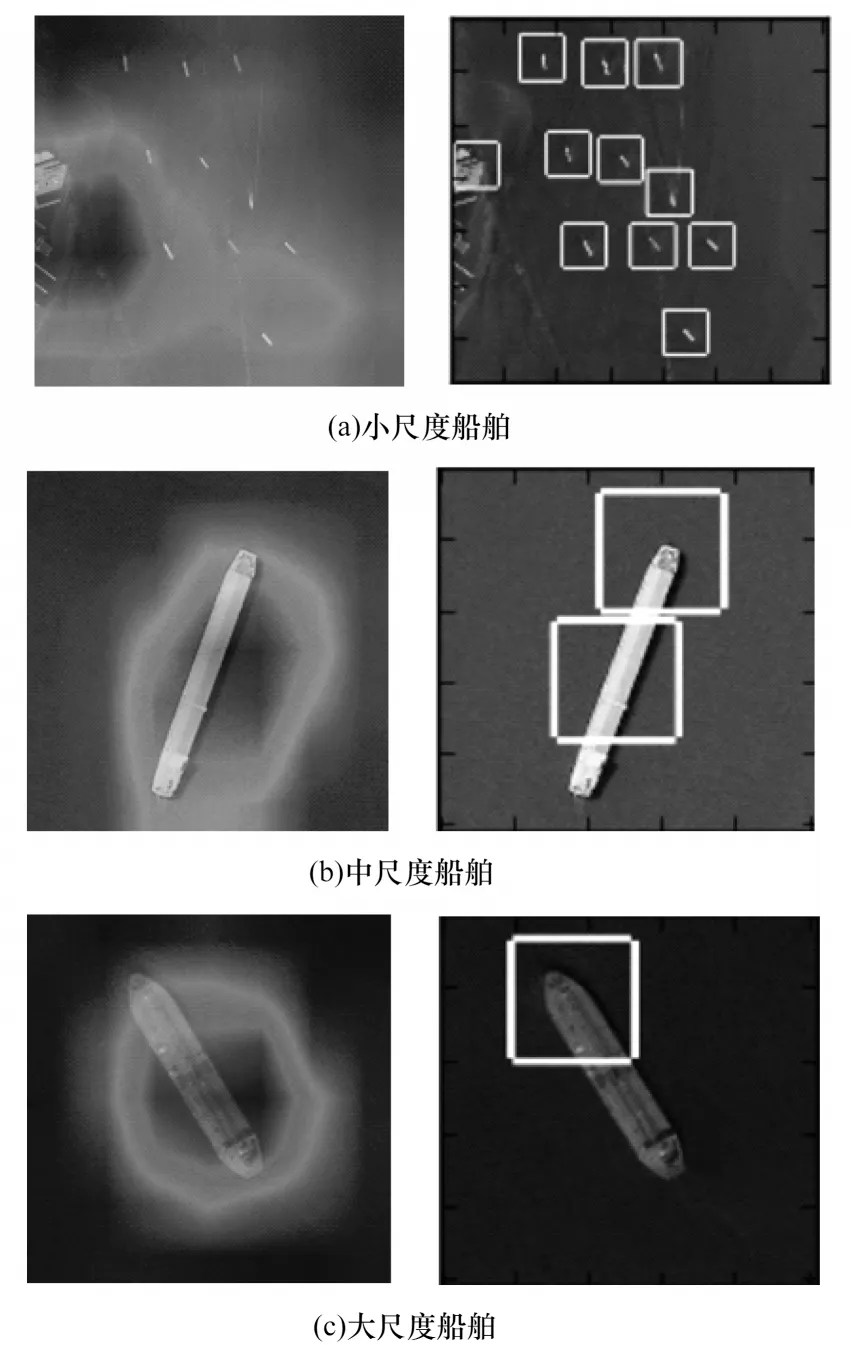

HSSGAN 方法對不同尺度船舶的檢測效果如圖3所示。圖3(a)~圖3(c)的左部分為自導注意力對不同尺度變化船舶的熱力圖,右部分為識別結果。

圖3 不同尺度的識別效果Fig.3 Recognition effects of different scales

由圖3 可看出,超尺度塊能有效獲取遙感船舶的超尺度特征,即對極端尺度的船舶特征具有較強的敏感性,特別是對尺度較小的船舶,如圖3(a)所示。這是因為超尺度塊捕獲了遙感船舶的高層語義,同時也融合了低層級信息。

自導注意力網絡可對超尺度塊的特征圖逐步細化,并在局部和全局語義間建立長期依賴關系,同時進一步豐富上下文語義,強調相關特征的關聯。該功能尤其對尺度較大的遙感船舶非常明顯,如圖3(b)和圖3(c)所示。

2.3.2 與相關方法的比較

為驗證HSSGAN 方法的優越性,與相關方法進行了對比,實驗結果如表2 所示。

表2 與相關方法對比的實驗結果Table 2 Experimental results compared with relevant methods

從表2 中可以看出,本文所提方法HSSGAN 在精準率、召回率和F1-Score 值上均取得最優效果,分別為0.961 58、0.973 01 和0.966 78。這是因為超尺度塊有效捕獲了遙感船舶的超尺度特征,從多個尺度對目標船舶進行了描述,同時自導注意力網絡使這些特征更加精細,讓相關特征受到了更多關注。

相比于TP-FCN 方法,CF-SDN 和HSF-Net 方法的識別效果更好,F1-Score 值分別提高了0.095 81 和0.117 34。因為這2 種方法都采用了多尺度策略,從不同尺度對圖像中的目標對象進行了描述,對比結果也證明了多尺度策略的有效性。

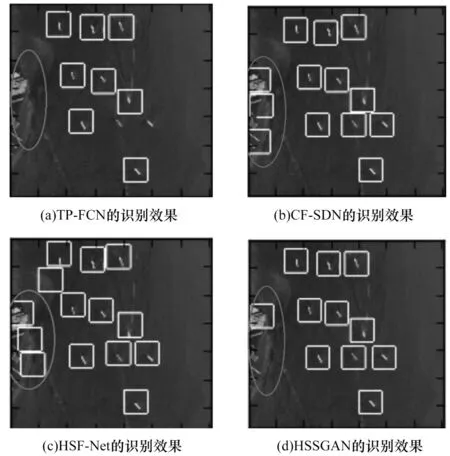

在小尺度上的識別效果如圖4 所示,其中橢圓形圈表示該區域內無船舶。

圖4 不同方法在小尺度上的識別效果Fig.4 Recognition effects of different methods on a small scale

由圖4 可知,TP-FCN 方法雖然對橢圓形圈內的目標進行了精準識別,但對水中船舶的辨識度有待提高。CF-SDN 和HSF-Ne 方法將紅色圈內的其他目標誤識別成船舶,但對水上目標進行了正確識別。

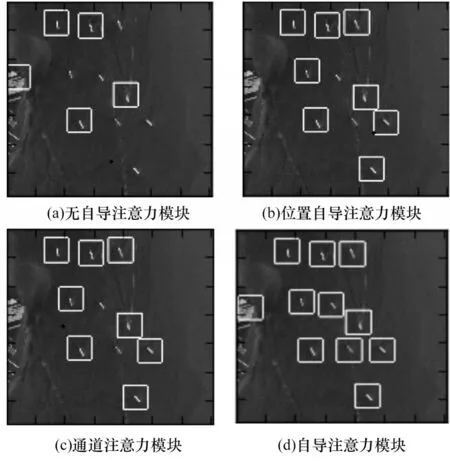

2.3.3 自導注意力模塊的研究

為驗證自導注意力網絡對識別效果的影響,針對自導注意力網絡進行了消融實驗測試,結果如表3 所示,其中:Non-guided 表示無自導注意力模塊;PA-guided 表示只使用了位置注意力模塊;CA-guided 表示只使用了通道注意力模塊;加粗字體表示最大值。

表3 自導注意力模塊的消融實驗結果Table 3 Ablation results of self-directed attention module

從表3 中可以看出,無自導注意力模塊的F1-Score值僅為0.942 20,識別效果最差。盡管位置注意力模塊對船舶的識別效果有所提高,但通道注意力模塊的識別效果要稍強于位置注意力模塊,這證明在該數據集上通道注意力模塊的貢獻要高于空間注意力模塊(PAguided),即在船舶識別過程中,增加超尺度特征在類間的差異性能更好地提高識別效果,識別效果的可視化如圖5 所示。

圖5 識別效果的可視化Fig.5 Visualization of the recognition effect

由圖5 可知,圖5(b)和圖5(c)給出的識別效果一樣,這是因為通道注意力模塊的F1 值僅比位置注意力模塊提高了0.004 44,這進一步說明了兩者共同使用的增強效果要高于單個組件,即所提的自導注意力模塊細化的特征圖更好地聚合了局部和全局語義。

3 結束語

本文設計超尺度自導注意力識別框架,采用超尺度的子空間組捕獲遙感船舶的超尺度特征和不同層級的結構信息,使用自導注意力模塊逐步聚合相關的上下文語義及濾除冗余信息,增加特征在不同類之間的差異性,并突出相關信息的表征能力。實驗結果表明,所提模型在定量和定性上均優于HSF-Net、CF-SDN、TD-FCN 等其他相關方法。