基于深度學習在醫(yī)學圖像的分類與診斷綜述

闞明陽

(河北地質大學信息工程學院,河北 石家莊 050031)

0 引言

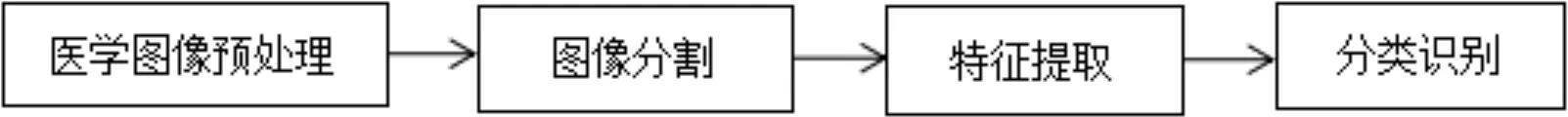

深度學習因“整個程序都是可訓練的”特性,成為現(xiàn)階段使用最為廣泛的模式識別方法。現(xiàn)在深度學習框架的三大基礎結構網絡為:卷積神經網絡、深度置信網絡、堆疊自動編碼器。我們生活中常見的醫(yī)學圖像主要為:CT(計算機斷層掃描),X光片,B超等。醫(yī)學圖形的獲取可能涉及患者的隱私等問題,醫(yī)學圖像的處理涉及圖像處理技術,模式識別技術,機器學習等多方面內容[1]。利用深度學習框架將這些信息有效地進行發(fā)掘,查找出其中隱藏的醫(yī)學信息和規(guī)律,必然能夠有效地為早期疾病的檢測和治療提供保障[2]。

圖1 基于深度學習的醫(yī)學圖像分析流程圖Fig.1 flow chart of medical image analysis based on deep learning

1 深度學習在醫(yī)學圖像領域主要的算法

1.1 卷積神經網絡(CNN)

卷積神經網絡于1998年被LeCun等人設計,并于2012年imageNet圖片識別大賽中摘得桂冠,此后逐漸被人們所重視。卷積神經網絡模型由輸入層、卷積層、池化層、全連接層和輸出層構成。目前經典的CNN網絡模型包括GoogleNet、LeNet模型和VGG模型等。其中VGG模型是深層網絡模型,其具有訓練時間長,識別準確率高等特點。使用CNN模型訓練時,通常會改進CNN網絡模型,例如3D-CNN模型能夠對運動物體識別,可以在空間和時間維度中進行特征的提取[3]。現(xiàn)代醫(yī)學影像技術是利用現(xiàn)代高性能的成像硬件設備,對人體某個部位進行生理結構信息和病變信息的掃描[3],在 CNN網絡中的全連接層換成卷積層則變成全卷積網絡(FCN),從而實現(xiàn)對語義級圖像進行分類。

1.2 深度置信網絡

深度置信網絡(DBN)是由多層神經元構成的,這些神經元又分為顯性神經元和隱性神經元(以下簡稱顯元和隱元)。顯元用于接受輸入,隱元用于提取特征。因此隱元也有個別名,叫特征檢測器,最頂上的兩層間的連接是無向的,組成聯(lián)合內存。較低的其他層之間有連接上下的有向連接[5]。最底層代表了數(shù)據向量,每一個神經元代表數(shù)據向量的一維。DBN的組成元件是受限玻爾茲曼機[6]。訓練DBN的過程是一層一層地進行的。在每一層中,用數(shù)據向量來推斷隱層,再把這一隱層當作下一層(高一層)的數(shù)據向量,當預訓練完成后,網絡會獲得一個較好的網絡初始值,但這不是最優(yōu)的。再采用有標簽數(shù)據去訓練網絡,誤差自頂而下傳播,一般采用梯度下降法對網絡進行微調[7]。現(xiàn)階段深度置信網絡主要應用于圖像處理方面。

2 卷積神經網絡與深度置信網絡的歷程

1995年,卷積神經網絡首次應用到醫(yī)學圖像的分析中。LeNet程序的面世使得卷積神經網絡首次應用到現(xiàn)實生活中,其首要任務是手寫文字的識別工作[8]。其整體評價標準與屏一膠影像完全不同[9]。近幾年隨著深度學習[10]的出現(xiàn)而形成一個新的感念,對大量的輸入圖像通過特定的網絡結構以及訓練方法學習出有意義的特征表示,而后開發(fā)的金字塔卷積神經網絡(PCNN)對圖像進行處理和分析。由于計算機視覺ResNet網絡結構的出現(xiàn),將卷積神經網絡真正推入一個新臺階[11],相關深度模型的使用取得了巨大的進步[12]。2006年Science雜志提出了深度信念網絡的概念,利用貪心策略逐層訓練由限制玻爾茲曼機組成的深層架構;PCD學習算法的提出促進了深度信念網絡的發(fā)展[13];卷積深度信念網絡(CDBN),是一個分級生成模型,可以擴展到現(xiàn)實的圖像大小,可以對全尺寸圖像執(zhí)行分層(自下而上和自頂向下)推理;稀疏深度信念網(SDBN)開發(fā)后主要用于圖像處理[14];隨后,增強深層信念網絡(BDBN)出現(xiàn),用在統(tǒng)一的循環(huán)框架中迭代的執(zhí)行三個訓練階段。

3 醫(yī)學圖像的特點

我們日常生活中常見的醫(yī)學圖像主要為:CT圖像,磁共振影像,B超等。利用已經確診的病例信息和當前醫(yī)生的臨床診斷經驗以及當前患者的病例信息,能夠快速的幫助醫(yī)生診斷病情[15]。現(xiàn)代醫(yī)學圖像由于新技術的加入具有以下特點[16]:(1)醫(yī)學影像成像質量較差[17],在CT,MRI超聲影像中,存在噪聲嚴重,分辨率低,灰度對比度不足等。(2)醫(yī)學影像數(shù)據量少[18],在臨床研究中,由于每一個病例得到的對應影像數(shù)據只有一組,因此在訓練深度學習模型時的訓練數(shù)據較少,在日常醫(yī)療圖片的整理中發(fā)現(xiàn),不同醫(yī)院,科室和設備的拍攝角度和方式的不同也影響最終訓練模型的效果。(3)醫(yī)學影像大多數(shù)具有多種模態(tài)[19],與自然圖像的傳統(tǒng)網絡結構相比,多模態(tài)的存在需要我們在設計網絡時充分考慮到各個模態(tài)影像特征的提取方法以及不同模態(tài)之間特征信息的融合方式。因此,醫(yī)學圖像分割任務難度遠大于自然圖像分割任務。

3.1 深度學習算法在醫(yī)學圖像領域的應用現(xiàn)狀

由于人工分析醫(yī)學圖像不僅用時長,且容易受到專業(yè)醫(yī)生的限制,培養(yǎng)一名合格的醫(yī)學圖像分析的專業(yè)人員需要消耗大量的時間成本。因而利用人工智能進行醫(yī)學圖像的識別逐漸進入人們的視野。1966年,美國學者提出了“計算機輔助診斷”的概念。1972年,由于CT圖像的臨床應用,開創(chuàng)了數(shù)字化醫(yī)學影像的先河。1993年,ACR-NEMA詳細規(guī)定了醫(yī)學影像及其相關信息的傳輸標準。近年來,由于深度學習可以學習到圖像中的復雜特征,其在醫(yī)學圖像分析中得到了廣泛的應用,主要包括三方面:疾病檢測、醫(yī)學圖像病變部位的識別與分析、醫(yī)學圖像建模和分析[20]。在使用深度信念網絡組成過程中,利用深度生成模型來降低輸入圖像的維度,以實現(xiàn)128×128×128分辨率的3D醫(yī)學圖像的訓練,在深度信念網絡學習低維腦體積檢測與人口統(tǒng)計學和疾病參數(shù)相關的變異模式方面有較強的優(yōu)勢[21]。

4 疾病檢測

疾病檢測是指利用深度學習技術分析人群是否患有某種疾病或患有某種疾病的程度,從而為實現(xiàn)疾病的治療提供理論支持,實現(xiàn)早發(fā)現(xiàn)早治療的理想目標。

4.1 肝病檢查階段

為提高醫(yī)學圖像診斷的準確性,人們現(xiàn)在對醫(yī)學圖像的質量要求越來越高,然而由于醫(yī)學成像系統(tǒng)的不穩(wěn)定等原因,導致醫(yī)學圖像的質量有所下降[22]。深度學習在肝癌檢查方面具有十分出色的表現(xiàn),美國加州灣舊金山的Enlitic公司成功研發(fā)出基于卷積神經網絡的惡性腫瘤檢查系統(tǒng)[23]。此系統(tǒng)通過訓練大量的帶有惡性腫瘤標簽的 CT圖像,通過圖像識別技術來判斷是否存在惡性腫瘤,尤其在肝癌識別率中機器識別的準確率是專業(yè)醫(yī)生數(shù)倍以上。

深度信念網絡,對醫(yī)學圖像進行自動分割,將深度學習和水平集合結合在一起,用于心臟左心室的心臟電磁共振數(shù)據的自動分割,產生一種需要較小訓練集的方法,并產生了準確的分割結果。

4.2 肺部圖像識別和分析

在識別肺結節(jié)病變組織方面,構建卷積神經網絡,將原始的 CT肺部圖像進行訓練,結果可證明即便是不對圖像進行預處理也可以直接識別肺結節(jié)病變位置[24]。在肺部其他病變檢查方面,使用卷積神經網絡訓練 CT肺血管造影圖像輔助肺栓塞的檢查,此方法與傳統(tǒng)方法相比具有較大優(yōu)勢[25]。

4.3 根據病理特征對病變圖像識別

現(xiàn)代醫(yī)學圖像處理系統(tǒng)可以利用深度信念網絡訓練頭骨CT圖像的分類,將大腦結構和MRI圖像結合來識別患者病癥。經過大量實驗證明,此方法可以提高HD病的識別準確率。通過深自動編碼器模型來識別病理圖像上的癌細胞,識別率高達90%以上。通過大量研究論文可以了解到,最近年來深度學習已經應用到醫(yī)學影像分析的各個方面[26]。特別是在圖像分類中深度學習技術表現(xiàn)突出。其中圖像分類主要應用包括:顯像/檢測分類和病變期分類,深度學習還能自動檢測圖像內的異常或可疑區(qū)域,幫助醫(yī)生對病變區(qū)域進行定位。圖像分割通過識別目標的輪廓或內部的像素空間,從而減少圖像中需要分析的領域,使深度學習相關的方法得以廣泛應用。卷積神經網絡成為現(xiàn)代醫(yī)學成像分析的首選方法。過去的實踐中,深度學習應用于醫(yī)學圖像分類的過程中面臨的最大問題就是缺乏大量的訓練集,而現(xiàn)在隨著科學技術的發(fā)展,越來越多的公共數(shù)據集變得可用[27]。未來,在相對標準的卷積神經網絡架構中可以看到大量的數(shù)據集,運用深度學習模型對其訓練能取得優(yōu)異的結果。最后,因為患者的檔案多存于醫(yī)院中,處于對患者隱私的保護,使得一些數(shù)據難以做到公開和獲取。

5 結論

近年來,隨著人工智能技術的飛速發(fā)展,運用不斷深化成熟的深度學習模型對醫(yī)學圖像進行分割、特征提取以及分類的技術日益成熟,醫(yī)學圖像信息的挖掘與開發(fā)不再拘泥于簡單的單一算法,而是運用卷積神經網絡或結合堆疊自動編碼器對大量醫(yī)學圖像數(shù)據集進行訓練后,可實現(xiàn)對單一病理切片達到9成以上的識別精度。圖像分割的準確性,基于CNN對肝臟腫瘤自動分割,將手工提取特征與自動學習特征的腫瘤分割統(tǒng)計結果進行對比,得出運用CNN自動學習的特征用于腫瘤分割效果更好、準確性更高;將深度學習模型與傳統(tǒng)算法相比,能提高輔助判斷系統(tǒng)的準確率,靈敏度和特異度。對醫(yī)學影像中的分割通常以病灶區(qū)域和整體器官作為目標進行專業(yè)性分割,同時利用分割結果輔助臨床醫(yī)生進行后續(xù)的診斷與治療。盡管深度學習在醫(yī)學圖像分割技術中起到舉足輕重的作用,但深度學習分割網絡仍然存在著以下不足之處:(1)訓練時間過長。目前需要深度學習模型解決的問題日益復雜,需要模型參數(shù)增加。訓練時間增長,所以改良算法,提高訓練速度,減少訓練時間是十分必要的[28]。(2)對無標記數(shù)據添加標簽。無標記數(shù)據的迅速增加需要更新自動添加標簽技術,依賴人工逐一將其打上標簽已經不能適應現(xiàn)代信息社會的發(fā)展[29]。(3)使用深度學習算法訓練醫(yī)學圖像時,對計算機的硬件要求較高,并要求有較多的醫(yī)學圖像,在訓練圖像數(shù)據時,耗時較長,這些都是需要今后解決的問題。