內外部梯度聯合約束的圖像超分辨率重建方法

姜紅濤,孫 京,謝 成,賴少川,沈煥鋒,3

(1.中國石化銷售股份有限公司華南分公司,廣州 510130;2.武漢大學資源與環境科學學院,武漢 430079;3.地球空間信息技術協同創新中心,武漢 430079)

0 概述

圖像分辨率是度量圖像質量最為重要的指標之一,圖像分辨率越高,能夠觀察到的細節越多[1]。由于醫學圖像處理[2]、遙感衛星偵察[3]、視頻監控應用[4]及其他許多領域的實際需要,人們對圖像質量的要求越來越高。然而,由于獲取圖像時的外部條件和圖像系統的限制,在圖像的成像、傳輸、存儲過程中,會產生模糊、畸形和噪聲等降質情況。通過改進光學技術和圖像傳感器來提升分辨率,需要花費較高的經濟成本,而且圖像質量的提高也存在極限[1]。圖像超分辨率重建通過對多幅具有互補信息的低分辨率圖像進行處理,重構出一幅或多幅高分辨率圖像[5],可以有效克服現有圖像系統的固有分辨率限制,提升圖像應用能力[6]。

根據輸入低分辨率圖像的數量,超分辨率重建方法分為單幅超分辨率重建和多幅超分辨率重建兩大類。多幅超分辨率重建技術由TSAI等[7]于1984 年提出,其利用多幅具有亞像素位移的圖像提高空間分辨率的頻率域。之后,一些學者在此基礎上進行了改進和發展[8-10]。目前,國內外學者已經構建了多個空域處理的框架[11-13],其中,基于最大后驗估計(MAP)的方法引入正則化理論[13-15],能夠有效、靈活地在解空間添加先驗約束條件[16],成為當前研究的主流框架模型。然而,在很多實際應用中,利用有限數量的先驗參數模型很難獲得大量自然圖像的各種特征,同時,由于缺乏足夠數量的低分辨率退化圖像,重建過程中所能夠利用的幀間互補信息有限,多幅超分辨率重建技術存在缺少高頻細節信息的缺點。

單幅超分辨率重建可以分為基于插值的方法[17]、基于重建的方法[18]和基于學習的方法[19]。目前,基于學習的方法在單幅超分辨率重建的研究上取得了很大的成功,DONG 等[20]構建了三層卷積神經網絡SRCNN,并構造一個端到端的重建網絡,但這種淺層的深度網絡結構,重建的結果完全依賴于學習的特征,缺乏高頻細節。為獲得更好的超分性能,KIM 等[21]在SRCNN 的基礎上,在CNN 訓練中加入了殘差和遞歸結構,以便在單幅超分辨率重建中可以有效訓練深層神經網絡結構。針對基于學習超分辨率重建存在邊緣信息丟失、易產生視覺偽影等問題,謝珍珠等[22]提出基于邊緣增強的深層網絡結構用于圖像的超分辨率重建。然而,這些方法的結果依賴于訓練數據與測試數據的相似性,結果并不可信,而且僅使用外部先驗可能會產生一些偽影。

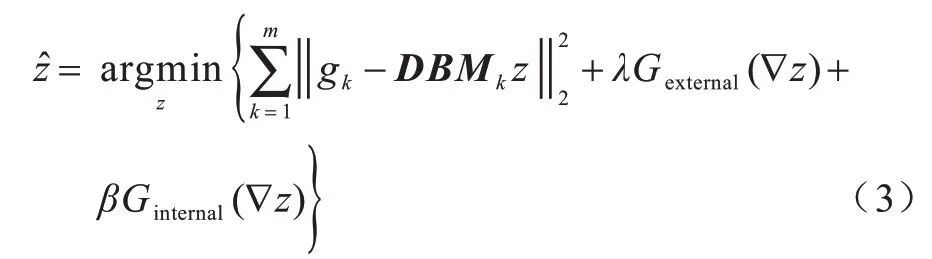

綜上所述,將多幅超分和單幅超分相結合是進一步提高超分辨率性能的有效途徑[23-24]。本文提出一種結合內外部梯度先驗的圖像超分辨率重建方法。集成深度學習方法的外部梯度先驗和?0范數的內部梯度、亮度聯合約束先驗,利用大量外部數據訓練深度卷積神經網絡,學習低分-高分圖像塊之間的隱射關系,得到初始的高分辨率梯度圖,作為外部梯度約束先驗,同時構建?0范數的梯度與亮度聯合約束作為重建方法的內部梯度約束先驗,通過聯合利用外部梯度先驗和內部梯度先驗的互補優勢,減少重建結果中可能存在的噪聲與偽影效果,增強重建圖像的高頻空間細節信息。

1 內外部梯度聯合約束超分辨率模型

在超分辨率重建過程中,低分辨率觀測圖像可以看作是由高分辨率場景經過一系列的降質過程(包括幾何運動、光學模糊、降采樣以及附加噪聲等)產生[5]。現實環境中的低分辨率序列圖像在獲取過程中經歷的模糊程度大致相同,可以得到如下圖像觀測模型:

其中:z表示重建圖像;gk表示輸入的某一幅低分辨率圖像(k為圖像編號,k=1,2,…,m);Mk、B、D和nk分別表示幾何運動矩陣、模糊矩陣、亞采樣矩陣和附加噪聲。當k=1 時,此觀測模型可以用于單幅超分辨率重建任務。

基于圖像觀測模型,由于低分辨率圖像中包含的信息不足以求解高分辨率圖像,超分辨率重建被證明是一個不適定反問題[25]。而正則化項包含高分解的先驗信息,可以補償丟失的高頻細節,因此,有必要在模型中引入特定的正則化項以獲得穩定解。本文采用基于最大后驗估計(MAP)的超分辨率重建方法,對上述病態問題進行有效的正則化約束,轉化成如下能量泛函最優化問題,通過最小化目標函數來獲得最優的高分圖像:

本文基于最大后驗估計框架,提出一種結合內外部梯度先驗的圖像超分辨率重建方法。通過聯合利用外部梯度先驗和內部梯度先驗的互補優勢,借助高分梯度信息來重建高分辨率圖像。模型表達式如式(3)所示:

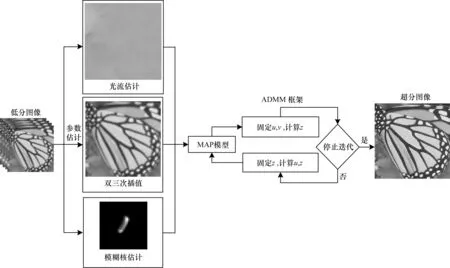

其中:Gexternal(?z)為基于深度學習的外部梯度先驗;Ginternal(?z)為來自圖像本身的梯度先驗;λ和β是正則化參數。本文超分辨率重建主要分為如圖1 所示的2 個階段:首先利用網絡學習低分-高分圖像塊對之間的映射關系,通過輸入網絡的低分插值圖來獲得相應的高分圖像,從而得到初步的高分梯度圖,構造變分模型中的外部梯度約束先驗;其次通過構造?0范數的梯度與亮度聯合約束作為內部梯度約束先驗。在重建模型中同時加入內外部梯度先驗進行模型約束,減少重建結果中可能存在的噪聲與偽影,以獲得最優的超分辨率結果。

圖1 本文方法重建流程Fig.1 Reconstruction procedure of the proposed method

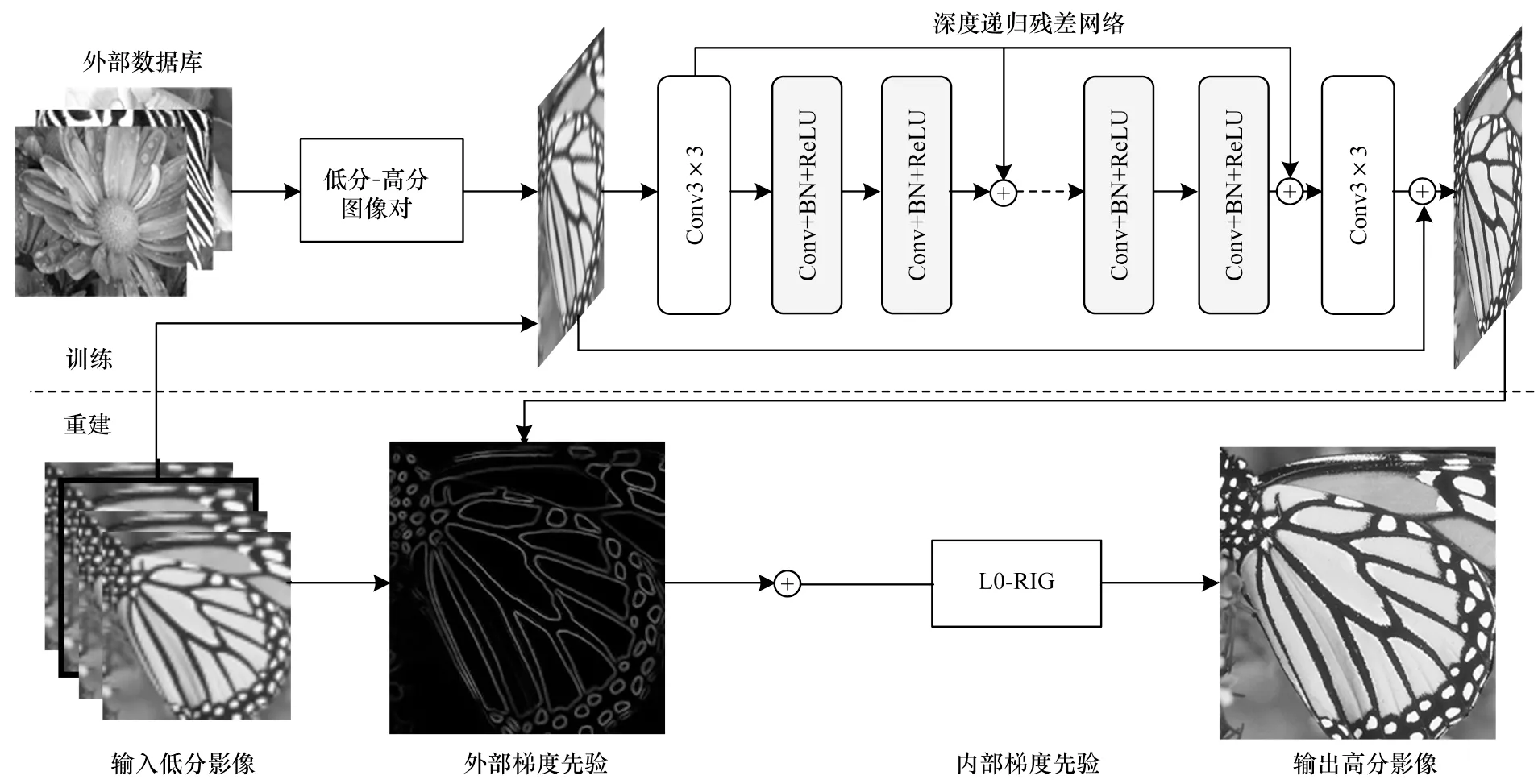

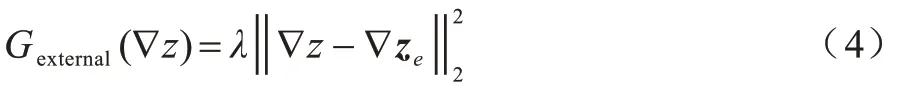

1.1 基于深度學習網絡的外部梯度先驗

梯度域在一定程度上有效地反映了自然圖像的高頻細節和邊緣信息,對于外部梯度先驗,可以用式(4)表示:

其中:ze表示通過殘差卷積神經網絡得到的初步高分辨率圖像;?ze=(?x ze,?y ze)為理想高分辨率圖像的梯度向量;?x ze為?ze的水平分量;?y ze為?ze的垂直分量。本文采用非線性深度神經網絡學習低分樣本與對應高分樣本的映射關系,對于圖像梯度的計算,需要分別從水平和垂直方向進行估算,所以得到的外部梯度先驗為:

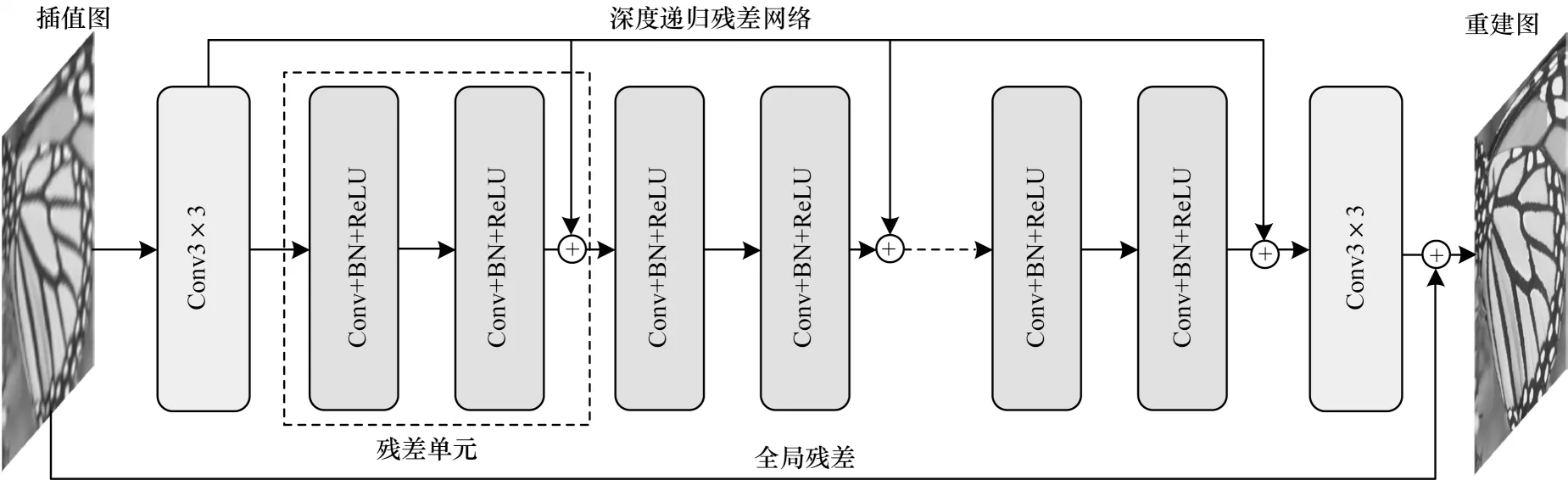

利用深度網絡估計的初步高分辨率圖像的梯度,分別在水平和垂直方向進行梯度約束,λ1和λ2分別表示水平和垂直方向外部梯度先驗約束的參數。在本文中,采用基于深度遞歸殘差網絡(DRRN)方法[26],將多個殘差單元堆積在一起,如圖2 所示,在整體網絡結構中,將全局殘差學習和遞歸網絡相結合,通過利用全局和局部相結合的殘差學習結構降低訓練深層網絡的難度,同時加入遞歸學習結構用于在增加網絡深度的同時控制模型參數規模。

圖2 基于深度遞歸殘差網絡的超分辨率重建Fig.2 Super-resolution reconstruction based on deep recursive residual network

在本文的深度遞歸殘差網絡中,使用291 幅圖像構造訓練數據集,其中91 幅圖像來自YANG 等[27]提出的稀疏編碼超分辨率重建方法,200 幅圖像來自BSD 數據集[28]。為豐富圖像訓練集,更好地提取圖像特征,提高數據集的泛化能力,對291 幅圖像的訓練數據集進行數據增強,主要包括圖像的翻轉和旋轉,其中圖像旋轉的角度為90°、180°、270°,翻轉方式為水平翻轉。對于每個原始圖像,在訓練數據集中有7 個額外增強版本,同時將訓練圖像分割為64×64 大小的圖像塊,并考慮訓練時間和存儲復雜性,將圖像分割的步長設置為17。在本文的DRRN 網絡結構模型中疊加25 個局部殘差單元塊,用卷積層重建插值圖和高分辨率圖像之間的殘差,通過大量的外部訓練數據得到遞歸殘差網絡的模型參數。深度遞歸殘差網絡學習到的映射關系可以作為外部梯度先驗的獲取途徑,利用網絡學習低分-高分圖像塊之間的映射關系,在測試階段利用學習的映射關系獲得相應的高分圖像,從而得到初步的高分梯度圖,作為變分模型中的外部梯度約束先驗。

1.2 聯合先驗約束的重建方法

在MAP 圖像超分辨率重建模型中,常用的先驗模型有拉普拉斯先驗、TV 先驗、馬爾科夫隨機場先驗等,但由于亮度先驗是基于獨立像素而不是相鄰像素的差值,在圖像恢復中引入了嚴重的噪聲和偽影,而梯度先驗是基于相鄰像素之間的差異,使得恢復后的圖像具有較少的偽影[29]。本文為有效保留紋理細節信息,提高重建圖像質量,在多幅圖像超分辨率重建中采用了亮度和梯度聯合約束先驗,構建的?0范數亮度與梯度聯合約束先驗模型如下:

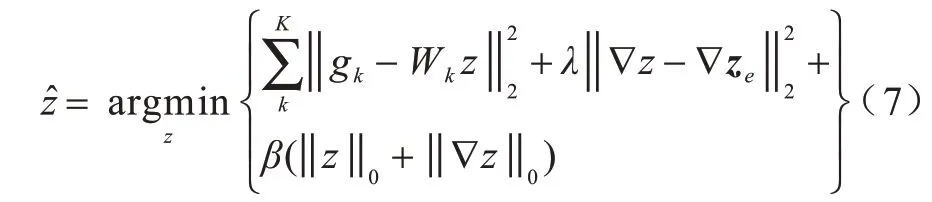

利用光流估計方法[30]獲得運動位移參數m,采用盲去模糊的方法[29]進行模糊核k估計,根據求得的運動位移m和模糊核k,構建對應的運動矩陣M和模糊矩陣B,因此,通過引入聯合先驗約束模型,令Wk=DBMk,將式(4)和式(6)代入式(3),最終所需求解的能量泛函如下:

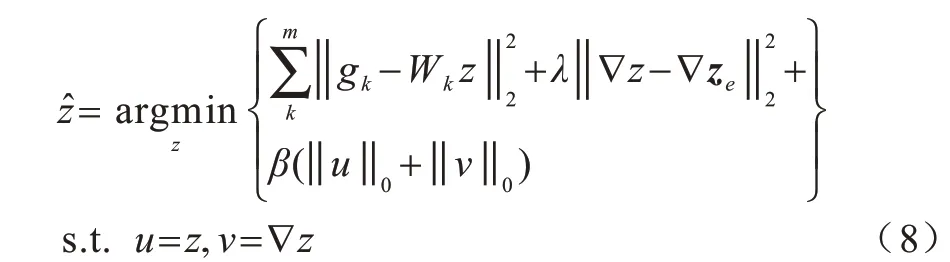

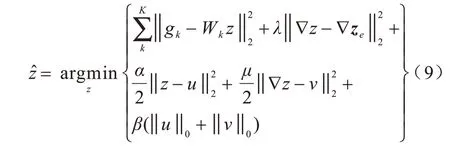

重建模型中存在?0范數的先驗項,因此,通過交替方向乘子算法的凸集優化方法[31],添加輔助變量,將非線性優化轉換為求解增廣拉格朗日函數的問題。對于本文的重建模型,通過引入與z和?z相對應的輔助變量u和v,目標函數可以改寫為:

利用增廣拉格朗日的方法,將式(8)轉為無約束的優化問題:

其 中:α和μ是懲罰函數的懲罰參數。固 定z、u和v3 個變量中的2 個來求解另一個,通過對這3 個變量進行循環交替迭代求解,直到過程收斂。最后可以得到重建后的重建圖像z。

2 實驗與結果分析

本文針對的實驗對象是自然圖像,將通過模擬實驗來驗證本文所采用方法對于自然圖像信息重建的有效性,并分別用雙三次內插法、自適應自回歸(ASAR)方法[32]、深度遞歸殘差網絡(DRRN)方法[26]、亮度-梯度聯合約束(L0RIG)方法[33]和本文方法對實驗圖像進行重建實驗,比較分析本文方法的重建效果。實驗以多幀序列圖像中的參考圖像作為DRRN 的輸入圖像,輸出得到初步的高分辨率圖像ze,從而得到聯合重建模型中的外部梯度先驗。將多幀序列圖像輸入到聯合重建模型中,結合內外部梯度先驗約束信息,重建得到一幅高分辨率圖像作為最后的重建結果,重建模型如圖3 所示。

圖3 內外部梯度聯合約束超分辨率重建模型Fig.3 External and internal gradient joint constraint super-resolution reconstruction model

2.1 模擬序列圖像實驗

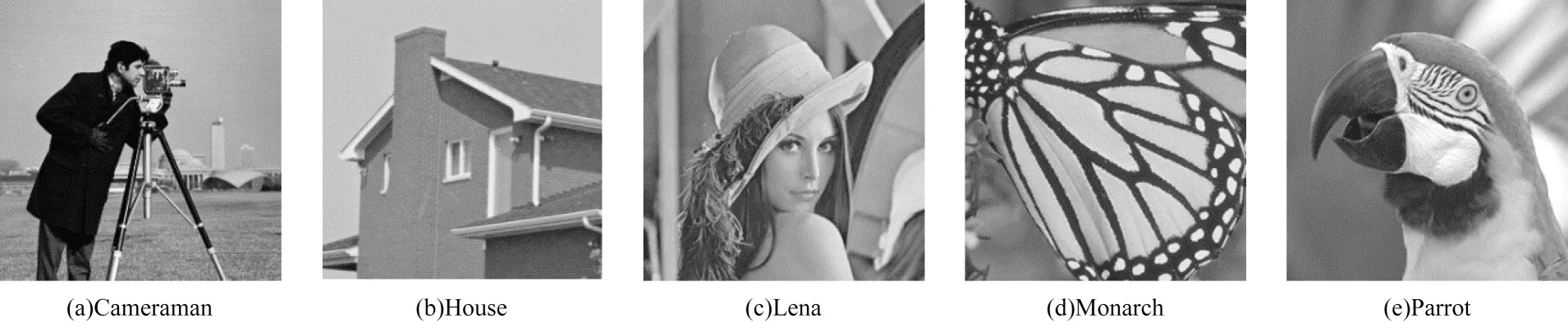

實驗中的圖像如圖4 所示。對于每一幅原高分辨率圖像,根據式(1)的圖像觀測模型,可以得到4 幅具有0.5 個像素位移的模擬圖像。模糊函數采用支持域為7×7、方差為1 的高斯模糊;通過隔像素取平均的方法對降質圖像進行降采樣,采樣因子設為2;最后每組圖像得到4 幅低分辨率圖像,在實驗中將使用這5 組圖像進行實驗。為評估重建圖像的質量,采用峰值信噪比(Peak Signal to Noise Ratio,PSNR)和結構相似性(Structure Similarity,SSIM)指數作為的評價標準,PSNR 和SSIM 值越大,表示重建結果越理想。

圖4 超分辨率模擬實驗圖像Fig.4 Super-resolution simulation experiment image

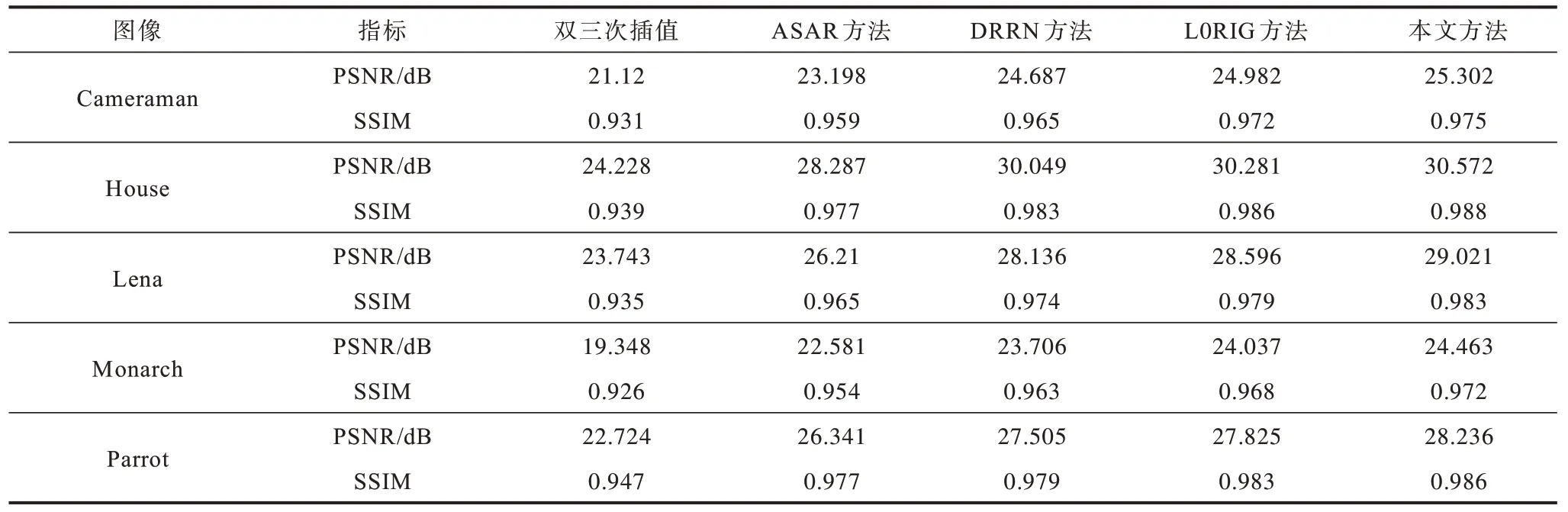

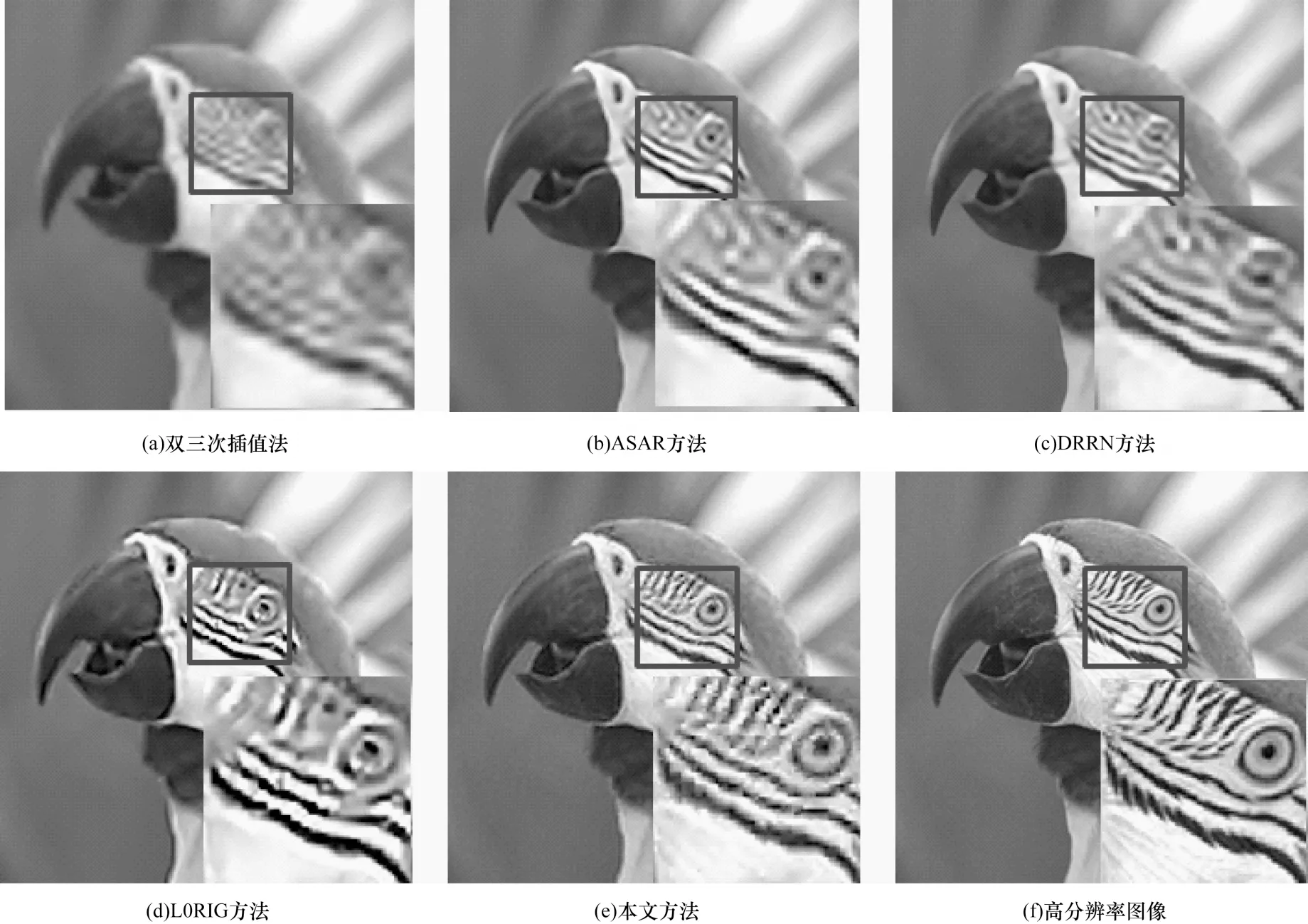

在模擬序列圖像實驗中,將本文聯合重建方法與三次內插法、ASAR 方法[32]、DRRN 方法[26]、L0RIG方法[33]處理的結果進行對比分析。以圖4 中的圖像作為模擬實驗數據,圖5 和圖6 給出了不同超分辨率方法的重建結果,矩形顯示了重建圖像的放大區域,以比較不同方法的定性性能,表1 為定量評價指標PSNR 和SSIM 的結果。在視覺效果上,相比其他4 種對比方法,本文方法能夠提供更多的高頻細節信息,有效減少噪聲和偽影。而ASAR 方法[32]的重建結果性能最差,缺少對高頻信息的恢復。DRRN 方法[26]的重建結果噪聲去除性能最好,但有些邊緣被過度平滑,在圖5(c)中,將Lean 圖像重建結果中選擇的區域放大后的圖像顯示,DRRN 方法[26]由于振環偽影效應導致Lean 圖像的眼睛區域存在錯誤重建。L0RIG 方法[33]的結果中明顯存在多處不理想的邊緣偽影,雖然能夠恢復一些丟失的細節,但不能抑制圖像上的噪聲。從圖5 顯示的放大區域可以清晰辨別內外梯度先驗聯合約束的方法,在超分辨率過程中對圖像細節信息的恢復能力要遠勝于其他幾種超分辨率重建方法,能夠獲得更好的定量指標。

表1 不同重建方法的定量結果比較Table 1 Quantitative results comparison for different reconstruction methods

圖5 Lena 在不同方法下的重建結果對比Fig.5 Comparison of reconstruction results of Lena under different methods

圖6 Parrot 在不同方法下的重建結果對比Fig.6 Comparison of reconstruction results of Parrot under different methods

表1 給出了實驗中具體的PSNR 和SSIM 評價指標結果,根據PSNR 和SSIM 兩種客觀評價指標,在對Monarch 圖像的實驗中,ASAR方法[32]的PSNR值為22.581 dB,DRRN方法[26]的PSNR值為23.706 dB,L0RIG 方法[33]的PSNR 值為24.037 dB,本文方法的PSNR 值為25.763 dB。定量結果表明了本文方法有效提高了超分辨率重建性能,通過結合深度學習的外部梯度先驗和?0范數的內部梯度、亮度聯合約束先驗,在保留低頻內容的同時恢復高頻細節,在噪聲去除和邊緣保護上能達到較好的平衡效果,并且在圖像的細節信息恢復上性能更加顯著。

2.2 真實序列圖像實驗

本文展示了兩組真實實驗,文本和磁盤的真實圖像灰度序列是多維信號處理研究組(MDSP)基準數據集[34]的一部分。在真實實驗中,無法用PSNR 和SSIM等指標定量地比較不同超分辨率方法的重建結果,本文采用主觀評價的方法對圖像質量進行評價。將序列圖像的中間幀作為本次重構的參考圖像幀,將圖7(a)和圖8(a)選為參考圖像。圖7(b)和圖8(b)為雙三次內插結果,圖7(c)和圖8(c)為ASAR 方法[32]重建結果,圖7(d)和圖8(d)為DRRN 方法[26]重建結果,圖7(e)和圖8(e)為L0RIG 方法[33]重建結果,圖7(f)和圖8(f)為本文方法重建結果。

圖7 Text 在不同方法下的真實圖像重建結果對比Fig.7 Comparison real image reconstruction results of Text under different methods

圖8 Disk 在不同方法下的真實圖像重建結果對比Fig.8 Real image reconstruction results of Disk under different methods

為了更好地進行視覺比較,將圖7 和圖8 中部分方框區域分別進行放大顯示,該方法還能較好地保留真實圖像中的細節信息,表明超分辨圖像具有較好的視覺質量。從對比結果可以看出,本文算法和亮度-梯度聯合方法都能得到比三次卷積內插結果質量更好的高分辨率圖像,同時,本文算法在視覺上明顯優于ASAR 方法[32]和DRRN 方法[26],重建結果有效的減少圖像中存在的模糊和噪聲,增強圖像的細節信息,能更清晰地重建出圖像上的文字等細節。

3 結束語

本文提出一種基于內外部梯度先驗聯合約束的圖像超分辨率重建方法,利用深度學習的外部梯度先驗和?0范數的內部梯度、亮度聯合約束先驗的互補優勢,增強圖像的先驗信息,借助高分辨率的梯度信息重建超分辨率圖像,從而增強重建結果的高頻空間細節信息,抑制噪聲與偽影。在模擬和真實序列圖像上的實驗結果表明,本文方法能夠提高圖像重建精度,減少模糊和噪聲,增強圖像中的細節信息。本文引入梯度結構并與利用內外部圖像的先驗信息相結合,增強重建圖像的幾何結構,下一步嘗試將模型重建的結果作為神經網絡結構的先驗約束,以生成具有豐富紋理細節的重建圖像。