基于計算機視覺的自動駕駛行人檢測專利技術綜述

李朋原

隨著汽車電子化和高級輔助駕駛技術的快速發展,自動駕駛作為輔助駕駛技術的高級階段,儼然成為未來解決交通出行的重要方式,已成為全球范圍內一個新的技術研究熱點和重點。汽車行業是一個特殊行業,涉及乘客及行人安全,任何事故都是不可接受的,所以對于安全性、可靠性有著近乎苛刻的要求。

在自動駕駛領域,無人駕駛車輛必須具備通過車載傳感器檢測行人是否存在及其位置的能力,以實現進一步的決策。一旦檢測錯誤則會造成傷亡,后果嚴重,所以對于行人檢測的準確性要求極高。而行人檢測這一核心技術受到很多因素的影響,如行人姿態變化、衣著打扮各異、遮擋問題、運動隨機、室外天氣光線因素變化等,這些因素都會影響到行人檢測技術的準確性乃至可行性。使用高精度的傳感器有利于算法結果準確,但高精度的傳感器非常昂貴(如激光雷達)。成本和精度無法兼得,這種矛盾在過去一直很難解決。使用廉價的攝像機獲取圖像,通過處理圖像來檢測到行人的位置以及運動趨勢,從而取代雷達,壓縮成本,該過程就是行人檢測技術。

自動駕駛中的行人檢測使用搭載在車輛中的攝像設備來獲得行車的圖像數據,進而從圖像或者序列當中測算出是否存在行人,同時給出精確的定位。行人檢測面臨的是一個開放的環境,要考慮不同的路況、天氣和光線變化,對算法的魯棒性提出了很高的要求,而實時性是系統必須滿足的要求,因此系統的魯棒性和實時性構成了一個矛盾。為了解決這種矛盾,現有的行人檢測系統一般包括兩個模塊:圖像分割和目標識別。圖像分割的目的是從圖像中提取可能包含行人的窗口區域作進一步驗證,以避免窮盡搜索,提高系統的速度。目標識別是行人檢測系統的核心,它對得到的分割區域進行驗證,以判斷其中是否包含行人,其性能決定了整個系統可以達到的精度和魯棒性①賈慧星,章毓晉. 車輛輔助駕駛系統中基于計算機視覺的行人檢測研究綜述[J]. 自動化學報,2007,33(1):7.。

傳統的行人檢測技術主要依賴于圖像處理技術。近些年來,深度學習技術興起,典型的如卷積神經網絡目前廣泛應用于各類圖像處理中,非常適用于行人檢測。深度學習技術帶來的高準確性促進了無人駕駛車輛系統在行人檢測等多個核心領域的發展。

本文對自動駕駛中的行人檢測相關專利技術文獻進行了統計分析,并梳理了行人檢測技術的主要發展脈絡。

一、專利態勢分析

本文在專利檢索與服務系統(Patent Search and Service System,簡稱“S 系統”)中進行檢索,以中國專利文摘數據庫(CNABS)和外文虛擬文摘數據庫(VEN)中的專利申請為基礎進行數據篩選和數據分析。鑒于本文主要研究自動駕駛中行人檢測技術的發展,主要采用關鍵詞的方式檢索得到,其中在CNABS 庫中主要采用“自動駕駛”“智能駕駛”“無人駕駛”“行人檢測”“行人識別”等關鍵詞進行檢索,在VEN 數據庫主要采用“person+or pedestrian+or human or people or individ+”等表示行人,采用“detect+or predict+or identif+”等表示檢測含義,采用“automatic driving or autonomous driving” 等 表 示自動駕駛,檢索截至2021 年12 月31 日公開的專利申請,僅保留發明專利申請,并進行了專利去重、去噪。

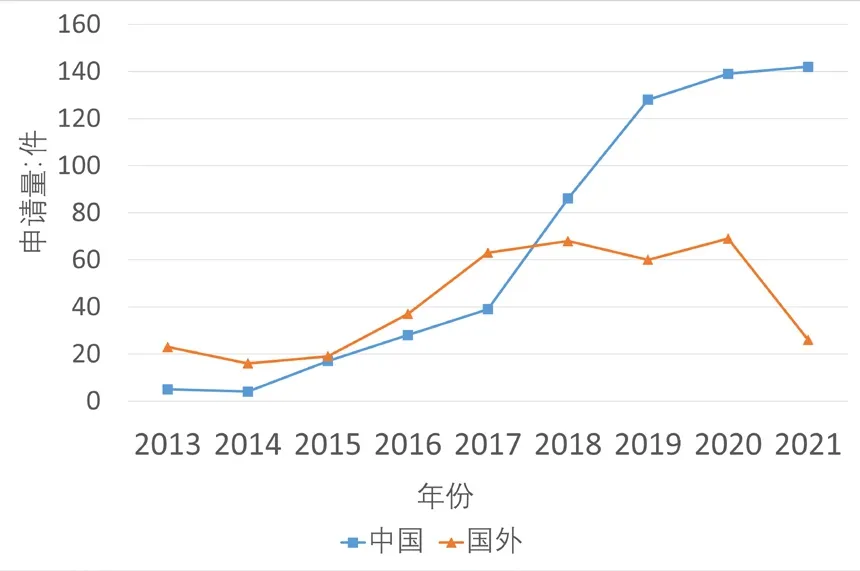

(一)申請趨勢

圖1 展示了近幾年行人檢測領域專利申請的趨勢。從圖中可以看到,在2015 年之前,國內外的申請量均沒有大幅增加,一直保持平穩的少量申請狀態,2016 年開始申請量有了較大的增幅,2018 年開始國內的申請量實現了對國外申請的反超。在2016年以前,行人檢測技術主要依賴于提取圖像的底層特征,并且自動駕駛領域其他相關技術也不夠成熟,發展速度較慢,申請量維持在一個較為平穩的低量狀態。2016 年以后,隨著自動駕駛相關技術的不斷完善,深度學習的方法也成功應用于行人檢測等領域,帶來了一股新的技術風潮,專利申請量逐漸攀升。

圖1 國內外申請趨勢圖

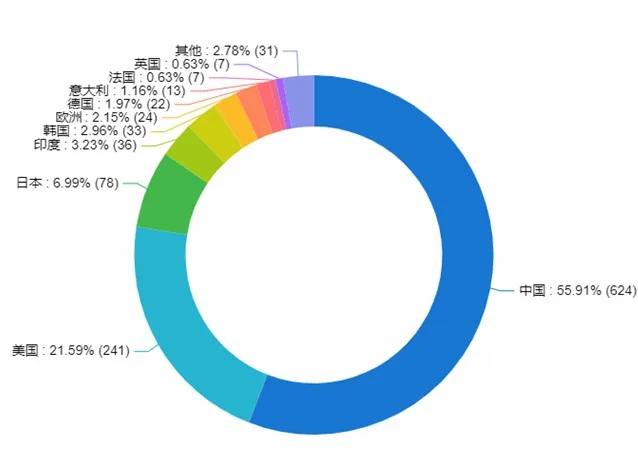

(二)技術來源國/地區

圖2 展示了自動駕駛行人檢測領域申請人在全球范圍內的地域分布情況。可以看到,申請量最高的區域是中、美、日,總共占據約85%的申請量,其中,我國的申請量超過了全球的一半。這得益于我國眾多車企、新興車企在自動駕駛方面的積極投入,以及我國對高新產業的支持。美國擁有眾多老牌車企,對自動駕駛的研究起步較早,也擁有接近全球四分之一的申請量。除此之外,專利五大國中的日、韓申請量也名列前茅。

圖2 全球申請人所屬國家/地區分布圖

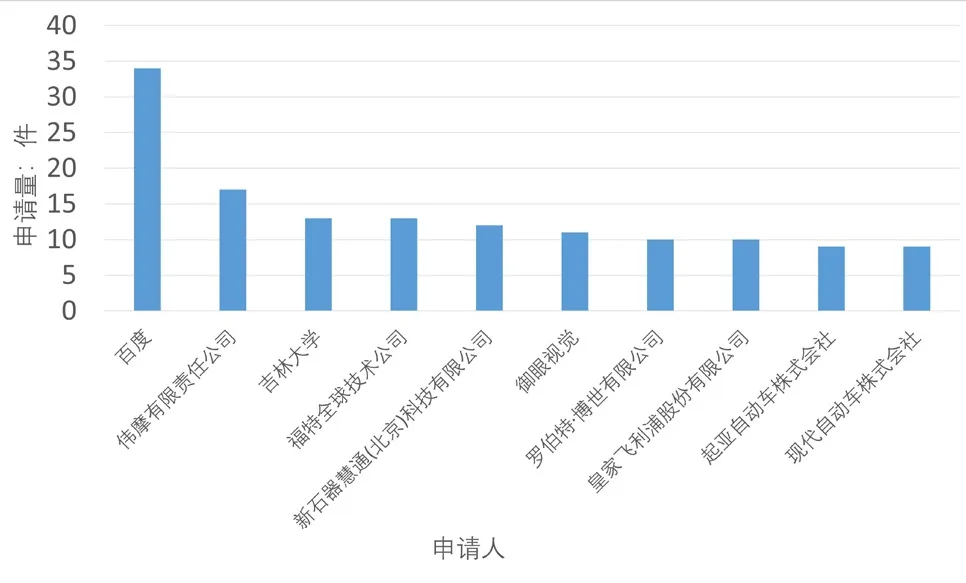

(三)主要申請人

圖3 展示了自動駕駛行人檢測領域排名前10 的重要申請人,我國占據三位。其中百度〔合并了旗下子公司和分公司,由百度在線網絡技術(北京)有限公司、百度(美國)有限責任公司、北京百度網訊科技有限公司、阿波羅智能技術(北京)有限公司、阿波羅智聯(北京)科技有限公司合并而成〕位列榜首。排名靠前的企業單位依次為百度、偉摩〔Waymo LLC,為Alphabet(Google 母公司)旗下的子公司,美國〕、福特全球技術公司(美國)、新石器慧通(北京)科技有限公司、御眼視覺(MobileEye,以色列自動駕駛創業公司)、羅伯特·博世有限公司(Bosch,德國)、皇家飛利浦股份有限公司(英國)、起亞自動車株式會社(韓國)、現代自動車株式會社(韓國)、UATC LLC(Uber,美國)、華為技術有限公司、重慶長安汽車股份有限公司、寶馬股份公司(德國)、豐田自動車株式會社(日本)。可以看出,全球前10 位的重要申請人除吉林大學外,均屬于頭部車企(5 家)和近些年入局自動駕駛的新型車企和創業企業(4 家)。而吉林大學與百度等自動駕駛公司聯系密切,也擁有多個自動駕駛測試實驗室,是在自動駕駛投入眾多科研力量的國內高校。在前10 位之外,還有許多企業例如寶馬、豐田、長安等緊隨其后。總的來說,各國企業在行人檢測領域的專利布局競爭非常激烈,呈現多元發展的態勢。

圖3 全球部分重要申請人

二、技術構成及典型專利

行人檢測的技術構成主要可以分為兩個部分,即圖像分割和目標識別。圖像分割技術的目的是分割出整體圖像中的感興趣區(Regions of Interest),從而避免對整個圖像進行識別,提高系統的檢測速度。圖像分割技術可以分為閾值分割法、邊緣檢測法以及語義分割三種分割方法。閾值分割法是使用圖像灰度特征進行灰度計算,進而與閾值進行對比來完成分割。邊緣檢測則是尋找出圖像的灰度、顏色、肌理等圖像特點忽然改變的地方,從而將其作為圖像邊緣進行分割。語義分割則是利用卷積神經網絡對復雜環境進行分割,分割的依據是有效的上下文 消息。

目標識別是行人檢測中的核心技術,可以分為特征提取和分類器構造兩大步驟。通過先驗知識建立的底層特征提取配合分類器進行行人檢測是傳統的主流方案。特征提取的目的是降低數據的維數,得到能反映模式本質屬性的特征,方便后面的分類;分類器設計的目的是得到一個計算復雜度較低,并且推廣性較好的分類器。按照目標識別中提取的特征類型,可以將其分為兩大類:一類是提取的特征為傳統圖像底層特征,例如顏色、紋理和梯度等基本的圖像特征;另一類是由深度學習提取的特征②張新鈺,高洪波,趙建輝,等. 基于深度學習的自動駕駛技術綜述[J]. 清華大學學報(自然科學版),2018,058(004):438-444.,指的是通過機器學習的方法,從大量的行人樣本中獲取的行人特征表示。主流分類器的構造方法是基于統計分類的,主要可以分為兩類,分別是基于支持向量機(Support Vector Machine,SVM)的方法和基于Boosting 技術的方法。各個分類器都有其優缺點,在目前的行人檢測技術中,沒有一種絕對優秀的分類工具。使用線性函數的SVM 模型的訓練和預測時間較快,而 Boosting技術和訓練時間則很長,準確性高。目前尚無統一的平臺來驗證到底哪個分類器性能最優。

(一)基于底層特征提取的自動駕駛中的行人檢測技術

本小節主要討論基于底層特征提取的行人檢測。在眾多應用于行人檢測的底層特征中,最成功且主流的特征為2005 年提出的方向梯度直方圖(Histogram of Oriented Gradient,HOG)特征③Dalal N,Triggs B. Histograms of riented gradients for human detection[C]// Proceeding of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition. IEEE,2005.1:886-893.,其通過檢測人的圖形,得出人的水平和豎直的梯度幅值及像素點的梯度角。使用梯度幅值來對梯度角展開加權,勾勒出圖像的局部梯度幅值以及相應的方向,再基于梯度特征對特征向量歸一化。HOG 特征建立在密集的網絡計算中,可以讓不同的塊相互重疊,所以對光照的偏移和位置的移動有很大的容差性,讓行人檢測中的魯棒性得到很好的滿足,可以很好地表現出人體的特征。

2011 年的專利申請CN102096803A 采用ROI 閾值法進行圖像分割,選擇HOG 特征作為底層特征。利用SVM 分類器判斷每一個區域的HOG 特征是否可以匹配為行人樣本HOG 特征,是非常典型且主流的傳統行人檢測方式。2012 年的專利申請CN1026096 86A 在HOG、SVM 的基礎上,對圖像分割方法進行改進,提出了一種基于運動信息和形狀先驗的圖割方法,降低了誤檢率。2014 年的專利申請CN1038863 08A 則是聚焦于對分類器進行改進,使用聚合通道特征和軟級聯分類器獲得了更好的分類效果。2019 年的專利申請CN109886086A 是在選用HOG 特征的基礎上對分類器進行了改進,使用Adaboost 算法集成三個SVM 弱分類器獲得了強分類器。

除了采用主流的HOG 特征外,很多專利申請也選取了其他的底層特征:

1.CSS 特征:2014 年的專利申請CN104537647A除了HOG 特征外,還選取了顏色自相似特征(Color Self-Similarity,CSS),將深度學習模型和分類器聯合起來,將待檢測圖像的特征向量作為將深度學習模型的輸入數據,進而得到深度學習模型的隱層節點的狀態值,最后將最后一層隱層節點的狀態值作為分類器的輸入,得到分類結果。

2.LBP 特征:2014 年的專利申請CN104091157A,提出了一種HOG 與紋理特征局部二值模式(Local Binary Patterns,LBP)融合的行人檢測方法,采用多特征融合的方法,融合LBP 紋理特征,與SVM 分類器相結合,在提高HOG-LBP 識別率的同時,降低了訓練和檢測的時間,且能很好地處理行人遮擋問題。2016 年的專利申請CN105741324A 使用光流法檢測出所有移動目標后,提取HSV 顏色特征和LBP 紋理特征,使用SVM 作為分類器進行特征分類,并且在完成行人檢測的基礎上還進一步追蹤了行人的運動。

3.ICF 特征:2016 年的專利申請CN105975921A使用積分通道特征(Integral Channel Features,ICF)。ICF 計算出包含LUV(色度和色差)、梯度幅值、HOG 特征,并將其順次連接構成積分通道特征,并且引入了一種利用偏最小二乘法的評分機制用于特征選擇。2018 年的專利申請CN108694356A 在ICF 的基礎上引入了粒子群算法,通過粒子群優化(Particle Swarm Optimization,PSO)算法在搜索圖像中能快速收斂到概率得分較高的區域,提升了檢測的效率。2019 年的專利申請WO2019203921A1 則是采用了ICF 特征配合卷積神經網絡分類器的架構方式進行行人檢測。該申請在分類時使用了兩個卷積神經網絡,添加了第二個卷積神經網絡對候選目標區域進行分類以試圖獲得更好的分類精度和效果。

4.ACF 特 征:2016 年 的 專 利 申 請CN1057608 58A,在ICF 特征的基礎之上又提出了更為高效的聚合通道特征(Aggregated Channel Features,ACF)作為底層特征,利用Haar-like 模板對其進行濾波提取Haar-like 中間層特征作為目標特征,結合Adaboost 分類器,利用級聯分類的思想進行行人檢測。同為2016 年的專利申請CN105975929A 除采用了以ACF 特征為底層特征外,還使用卷積神經元網絡分類器對前期標定的每個位置做進一步篩選,最后使用卷積神經網絡作為分類器進行了 分類。

5.CENTRIST 特征:2015 年的專利申請CN1073 16320A 使用中心變換直方圖特征(Census Transform Histogram,CENTRIST)配合SVM 作為分類型完成了行人檢測。2017 年的專利申請CN104835182A 采用了CENTRIST 特征,為了使CENTRIST 特征更好地描述行人,將訓練正樣本做了針對性的處理,使用多個SVM 分類器組成非線性SVM 進行行人檢測,并結合CT 變換加載了GPU 加速檢測算法,提高了檢測速度。2020 年的專利申請CN111332288A 除了采用CENTRIST 之外,還應用擴展卡爾曼濾波器(Extended Kalman Filter,EKF)對行人位置進行了預測,檢測行人具有的實時性,提高了事故預警準確率。

雖然基于底層特征的傳統手動特征提取方法在早些年間得到了廣泛應用,并在原有基礎上取得了一些改進,但在近年來的行人檢測發展中難以取得令人滿意的提升。

(二)基于深度學習的行人檢測

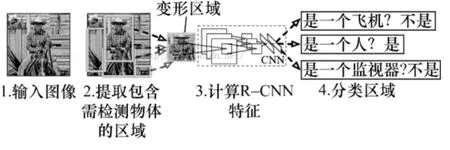

基于底層特征的傳統手動特征提取方法已經有了很好的表現,能夠應用到很多商業領域。但是深度學習在行人檢測領域的表現和潛力,顯然要遠遠好于傳統方法,因為其能對原始圖像數據進行學習,通過算法提取出更好的特征。基于深度學習的行人檢測方法具備極高的準確率和魯棒性。主流的深度學習的行人檢測方法可以分為兩類:一類是以區域卷積神經網絡(R-CNN)、快速區域卷積神經網絡(Fast R-CNN)、高速區域卷積神經網絡(Faster R-CNN)為代表的基于候選框的方法。其中,R-CNN 模型曾達到最高準確率,引領了后期分類網絡與卷積神經網絡框架的發展④Girshick R,Donahue J,Darrell T,et al. Rich feature hierarchies for accurate object detection and semantic segmentation. [C] // Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE,2014:580-587.,具體的實現步驟如圖4 所示。

圖4 R-CNN模型實現檢測的主要步驟

另一類是以YOLO(You Only Look Once)、輕量級目標檢測(Single Shot MultiBox Detector,SSD)為代表的基于回歸的方法。SSD 開啟了利用深度學習也可以實現實時檢測的先河,將目標檢測作為回歸問題,核心思想是在多尺度特征圖上直接進行分類和回歸,避免了Faster R-CNN 等方法中提取多個目標候選框特征的過程,因而大大提升了檢測速度。YOLO的全稱You Only Look Once,指只需要瀏覽一次就可以識別出圖中物體的類別和位置。YOLO 將物體檢測作為一個回歸問題進行求解,輸入圖像經過一次計算,便能得到圖像中所有物體的位置和其所屬類別及相應的置信概率。因為只需要看一次,YOLO 被稱為Region-free 方法,其不需要提前找到可能存在目標的Region,即不需要進行圖像分割,而前文所提到的需要圖像分割的方法也被稱為Region-based 方法。

在卷積神經網絡興起后,就陸續有相關申請人將其應用到行人檢測中。2016 年的專利申請CN1065 99773A、US20170206426A1、US20170270374A1 等多個專利都利用多個卷積神經網絡完成了行人檢測。其中,專利申請CN106599773A 將共享性深度學習網絡作為一種提取特征的手段,該手段在處理多任務學習時,比傳統的卷積神經網絡具有更小更精的優勢,不僅繼承了原有網絡中的權值共享,同時還共享了部分網絡結構和模型,不僅保留了單層網絡的準確率,還大大減少了計算成本,在多任務學習上具有明顯的速度優勢。

還有許多專利,在卷積神經網絡模型的基礎上,從不同的角度進行了改良,試圖獲得更好的檢測效果。

例如從卷積神經網絡的結構進行改良。2018 年的專利申請CN108960074A,融合了卷積神經網絡中的多重卷積特征,在網絡結構加入了反卷積層并使用了新的損失函數,增強了對小尺寸行人目標的檢測效果。同年,專利申請CN108805070A 使用了18 層卷積神經網絡進行行人特征學習,得到了較快的檢測速度,還提出了面向嵌入式終端的優化策略,進一步縮小了網絡規模和算法復雜度,適用于高級輔助駕駛(ADAS)的功能應用。2019 年的專利申請CN110020 688A,在卷積神經網絡的基礎上,構建了判別網絡和掩碼網絡,可以選擇出對于遮擋下的行人目標更為有效的卷積特征,提高了對遮擋行人的檢測效果。2020年的專利申請CN111626198A,在卷積神經網絡中加入長短期記憶網絡關聯時空上下文信息預測行人運動軌跡,并且加入了對抗網絡來預測行人軌跡。2021年的專利申請CN112435503A,在卷積神經網絡組合長短期記憶網絡的基礎上,利用動態貝葉斯網絡,以人車距離、車輛行駛速度、行人身體朝向等作為觀測變量,并融合行人注意力狀態特征,實現多時序下行人穿行或避讓意圖的預測。

例如從訓練數據的角度對方案進行修改。2018年的專利申請CN108376235A 使用數據擴增方法擴增圖像數據并訓練卷積神經網絡模型,使用其檢測得到所述待檢測圖像的車輛和行人信息。2020 年的專利申請CN112446436A,通過生成對抗網絡對模糊的輸入圖像進行處理,然后使用卷積神經網絡完成行人檢測,解決了因車體抖動使相機采集到的圖像模糊導致判斷結果不準確的問題。2021 年的專利申請CN1141 20439A 除了使用圖像外,還使用了非圖像特征,通過神經網絡模型融合視覺特征信息和非視覺特征信息,來識別出行人的行為意圖和軌跡。

例如針對特定情況下的行人檢測構建針對性的模型。2019 年的專利申請CN110781744A,將多個卷積層得到的卷積特征圖進行特征融合,這種策略同時兼顧了淺層特征豐富的細節信息和深層特征抽象的語義信息,豐富了小尺度行人的特征,有助于提高對于小尺度行人的分類。

CNN 區域卷積神經網絡模型掀起了在行人檢測領域應用深度學習的熱潮。2016 年的專利申請US20 17124415A1,提出了一種通過使用R-CNN 來檢測室外場景中的汽車、行人和騎行者的實現方法。該方法包括通過利用子類別信息的區域提議網絡(Region Proposal Networks,RPN)從圖像生成對象區域提議,以及通過同時執行對象類別分類、子類別分類和邊界框回歸的對象檢測網絡(Object Detection Network,ODN)對對象區域提議進行分類和細化。2018 年的專利申請CN109492576A 使用R-CNN 模型完成了自動駕駛中的行人檢測,通過對人像和人像中的指定部位檢測,框出人像及人像的指定部位,形成成對的標注框,從而更好地標識一個對象,實現了有效地對多目標的檢測,解決了行人遮擋時導致不能識別到部分被遮擋的行人問題,也提高了行人檢測的精度。

2017 年的專利申請CN107944390A、2018 年的專利申請CN107463892A,均將目標檢測深度模型Faster R-CNN 應用到行人檢測領域中。其中,CN107 944390A 通過機動車頂部的相機獲取兩幅魚眼圖像,對兩幅魚眼圖像進行誤差矯正,其次將兩幅圖像合成為一幅球面圖像,再將球面圖像上的點投影到全景圖像上得到全景圖像,最后將全景圖像采用Faster R-CNN 網絡,在全景圖像上提出車輛周圍的車輛、人、圖標信息,進一步根據圖像塊像素大小計算車距、離人的距離,同時能檢測路標等,能標定出車和人的方位信息。CN107463892A 則是結合行人周圍的上下文信息輸入特征分類器,結合Faster R-CNN 中深度特征提取模型VGG16 的多級特征,將高層粗糙的特征與低層精細的特征組合到一起,使得特征包含更加豐富的信息,能夠更好地檢測小尺寸行人。2020年的專利申請CN111832515A 也使用了Faster R-CNN模型,有效消除人群中未被遮擋人對被遮擋人的檢測識別干擾,大幅提升密集人群中行人檢測的召回率和平均精度,從而精確識別視線范圍內行人的位置及數量。2021 年的專利申請CN113361491A,則是在Faster R-CNN 的基礎上進行了改進,采用SE Net 結構改進神經網絡卷積模塊,增強無人駕駛汽車對道路行人動作的預測能力。2021 年的專利申請CN1142 02743A 同樣是對Faster R-CNN 模型作出了改進,對Faster R-CNN 模型中的主干特征提取網絡ResNet-50進行了改進,用可變形卷積V2 代替ResNet-50 最后兩層中的傳統卷積,同時在最后兩層中添加空間注意力機制,提升了模型的魯棒性和準確性。

根據前文所述,除了基于卷積神經網絡以及其延伸模型R-CNN,Faster R-CNN 等以外,基于回歸的YOLO、SSD 模型也是常見的行人檢測模型。

2018 年的專利申請DE102018104270A1、2019年的專利申請CN110674687A 均使用SSD 模型完成了行人檢測。2018 年的專利申請CN109670405A 則是在SSD 特征提取網絡上進行相應修改,增加SSD 特征提取網絡的復雜度,提高其特征提取能力,在提高模型特征提取能力的同時不會導致模型檢測速度的大幅度下降。2021 年的專利申請CN111488795A 采用一種融合光流的Deep SORT 行人跟蹤算法,在卡爾曼濾波的線性預測部分融合基于光流的目標運動信息,使得預測的邊界框能夠更加貼近行人的外觀,并且利用基于Track-by-Detection 策略改進了SSD 算法,提高了檢測的實時性。

2016 年的專利申請US9760806B1B1 利用了YOLO 進行行人檢測,其將YOLO 的卷積層連接到一循環神經網絡(Recurrent Neural Network,RUN)的長短期記憶(Long Short-Term Memory,LSTM),實現實時目標檢測和跟蹤的目的,并且提出了一種可以改進卡爾曼濾波器性能的跟蹤方法,公開了基于有效距離測量的驗證步驟,特別提高了在ADAS 系統中的目標檢測的性能。2018 年的專利申請CN109241814A,使用人工劃分的行人檢測場景圖片對YOLO 神經網絡進行學習,從而使YOLO 神經網絡能夠進行行人檢測。2018 年專利申請 CN108985186A 使用了改進的YOLO模型YOLO V2,針對行人檢測調整YOLO V2 網絡結構,并通過初始候選框的選擇、OHEM 方法這些訓練策略以及標定框先驗的篩選策略,提高了算法的精度和檢測的速度。2020 年的專利申請CN111739053A,基于YOLO V3 檢測出的行人后,采用在Re-id 上訓練的淺層深度學習網絡提取行人的表觀特征,以及采用卡爾曼濾波進行行人運動的預測,最后結合表觀相似度和運動相似度來聯合度量行人軌跡與行人檢測之間的親和度,通過KM 匹配算法實現檢測的行人與已有軌跡的一個關聯,進而更新軌跡信息,得到每個行人在新的一幀中的相應位置。2021 年的專利申請CN 113158766A,利用YOLO V3 和人體3D 姿態重構模型,實現交通環境下人體動作的識別,用于捕獲行人意圖,可有效識別復雜交通場景下行人的動作。

三、結語

基于底層特征提取的自動駕駛中的行人檢測技術由于其提取的底層特征為單一特征,故而檢測速度快,但是只從梯度或紋理等某單一方面來描述特征,判別力較差。而在基于深度學習的行人檢測中,深度神經網絡在特征的提取上不需要人工標注底層特征,它能夠自動提取特征,無需人工操作,有以往的技術不可比擬的優勢,但是,若樣本集不具代表性,則無法選擇出好的特征。從現有技術目前的問題出發,可以推測出技術的發展趨勢:

1.數據庫和測試方法的標準化。深度學習模型的效果很大程度上取決于訓練樣本的質量,許多研究使用的數據集無法很好地代表實際場景,實際場景獲取的視頻或圖像往往會存在低分辨率、光照嚴重不足等問題,行人檢測目前沒有一個統一的測試數據和測試標準,研究還處于探索階段,建立一個公共的數據庫和標準的測試方法是該領域的一個重要任務。

2.更加完善的深度學習模型。從卷積神經網絡,到區域神經網絡,再到區域神經網絡的改進型,從YOLO 到YOLO V2、YOLO V3,深度學習的模型呈現一個不斷完善的過程,在將來一定也會涌現出很多優秀的檢測模型可以應用到行人檢測中。

3.底層特征的改進。隨著圖像處理技術的發展,應用到行人檢測的特征從HOG 特征發展到融合了HOG 特征的ICF、ACF 特征等,底層特征的代表性越好,檢測的準確率也就越高。因此,選取更為合適的底層特征,是行人檢測改進的方向之一。

4.分類器的改進。當前常用的分類設備有SVM、基于Boosting 方法的AdaBoost 和神經網絡等等。但是用單一的分類工具檢測的誤報率很高,精確度低,速度偏慢,適應性不足,現有的一些串聯或并聯組合現有分類器的分類工具都僅能夠解決部分問題,依舊存在缺陷。因此,研究出較為全面的分類器,是行人檢測發展方向之一。

5.提高訓練速度。在神經網絡的發展中,行人檢測工具獲得了高速的發展,檢測的精準度獲得了大幅度提高,而訓練所需時間也隨深度學習參數變多的同時增加。如何在不降低檢測精度的同時,提高訓練速度成為未來的研究重點。

專家點評

該篇文章圍繞“自動駕駛”這一新領域,針對自動駕駛中行人檢測領域的專利申請和保護現狀進行了較為全面的分析,梳理了行人檢測的主要分類,著重分析了上述領域相關專利在全球的申請態勢、地域分布、主要申請人等,向讀者呈現了自動駕駛過程中行人檢測的技術發展脈絡和關鍵技術等,并對行人檢測領域未來的研究熱點進行了合理預期和闡述。

審核人:鄒斌

國家知識產權局專利局電學發明審查部商業方法處處長