一種裸眼3D 顯示中的多視點校正方案

李寧馳,于迅博,高 鑫,顏玢玢,桑新柱,溫旭東,徐 斌

(北京郵電大學 電子工程學院,北京100876)

1 引 言

我們身處在一個三維世界之中,當我們通過雙眼觀察周圍的景物時,不僅會接收到物體表面發出的顏色和光強信息,還可以獲取物體的空間深度信息,幫助我們理解物體的大小、遠近、位置關系。然而,傳統的平面顯示設備只能顯示三維場景中某個側面的二維投影圖像,丟失了三維場景的深度信息,嚴重影響了人們對三維空間信息的獲取、處理和表達。裸眼三維顯示技術可以為觀看者再現具有空間深度信息的立體圖像,而且觀看者無需佩戴任何助視設備。因此,裸眼3D 顯示技術被認為是未來顯示領域的重要發展方向[1-6]。光柵立體顯示技術是目前運用較廣泛的裸眼3D 顯示技術之一,能夠提供清晰的顯示效果和立體感,受到了各國研究人員和企業的廣泛關注[25]。

光柵立體顯示器的基本原理是將多視點圖進行合成編碼,并加載到顯示器上顯示,通過柱透鏡光柵的折射在空間中形成不同的視點顯示區域,觀察者左右眼處在不同視點區域內時,將看到具有立體效果的圖像[7-9]。多視點采集為光柵立體顯示器提供了顯示內容,是光柵立體顯示的關鍵一步。多視點采集的關鍵在于采集位置要匹配顯示器視點分布,否則會出現錯誤顯示。傳統多視點采集方案包括真實采集[11]和虛擬采集兩種[10],這兩種方案均通過搭建均勻相機陣列對場景進行采集。經研究發現,由于柱透鏡光柵存在畸變,光柵立體顯示器構建的視點實際上呈不均勻分布,這種分布和傳統的均勻采集方案發生沖突,顯示器空間視點將會被填充錯誤的視差圖像,導致視點圖像偏移、透視關系錯誤等問題,影響最終觀看質量。因此,本文提出一種針對裸眼3D 中多視點圖像的校正方案,使采集視點匹配顯示器視點分布,并填充正確視點圖像,對提升光柵立體顯示器觀看效果是尤為必要的。

利用相鄰視點生成對應位置的虛擬視點是校正的關鍵一步。基于深度信息的渲染(DIBR)[12-14]是目前比較主流的虛擬視點生成方法,該算法通過深度和RGB 圖像、通過3D 扭曲(3D warping)生成虛擬視點,有著計算速度快、算法輕便等優勢,但生成效果存在空洞、重疊和偽影問題[13],不適用于光柵立體顯示的內容生成[10]。神經網絡光場(NeRF)[15]使用神經網絡表征針對場景的光線采樣,以隱函數的方式計算新視圖,NeRF 可以合成復雜場景的高質量虛擬視點,但存在網絡復雜、渲染速度慢、訓練時間長等問題,不適用于動態光柵立體顯示器的視點合成。光流記錄了時變或相鄰視點圖像中模式運動速度,包含了目標相對運動的信息[16-19],可以通過前后幀的光流經過后向扭曲(Backward warping)預測時序中間幀。光流法在保證計算速度的同時的渲染效果同樣可觀,被廣泛的運用于視頻插幀中[19-22],受光流插幀的啟發,本文提出了一種基于光流預測的中間視點合成模塊,該模塊調用RAFT 光流預測網絡[18]和一個融合校正網絡組成,以有效的生成相鄰視點間任意位置的高質量中間視點。

針對均勻采集的多視點圖像與顯示器視點分布不匹配的問題,本文在不改變顯示器硬件配置的前提下,提出了一種視點篩選算法和中間視點生成網絡,以生成正確位置拍攝的虛擬視點,使之匹配顯示器視點分布:輸入均勻采集的一組多視點圖像陣列和顯示器相關參數,利用視點篩選算法計算出正確空間視點位置分布,指導光流預測網絡生成雙向光流,并經融合校正網絡進行光流校正,以提高中間光流生成質量,通過后向扭曲生成對應位置的虛擬視點圖像,經合成編碼后在光柵立體顯示器上顯示。實驗表明,該校正方案有效地解決了傳統采集和顯示器視點不匹配的問題,校正后的視點為顯示器視點填充了正確的視差圖,提升了觀看質量。

2 基本原理

2.1 光柵立體顯示器和多視點圖像采集

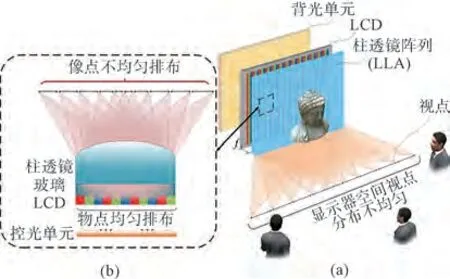

多視點圖像采集為光柵立體顯示器提供了顯示內容,是光柵立體顯示的關鍵一環,相機采集間距、采集距離等參數和光柵立體顯示器硬件參數是否匹配直接決定了最后的觀看質量[10]。傳統多視點采集分為虛擬場景和真實場景采集兩種,這兩種方案都是通過搭建均勻相機陣列實現采集。在理想條件下,視差圖經多視點編碼后經過柱透鏡光柵被均勻偏折在空間中,所以只要根據顯示器參數設置好采集間隔進行均勻采集,采集視點圖像位置和空間視點位置就會正確貼合,并填充正確的視點圖。但實驗分析證明,如圖1(b)所示,因為柱透鏡光柵存在畸變,均勻排布的物點在經過透鏡后,像點呈中間密集兩邊稀疏的分布狀態,進而導致最終空間視點分布并不是均勻的(圖1(a)),而是和理想分布存在某種非線性映射關系。這就和理想狀態下推算的均勻采集參數產生矛盾,某些角度的視點沒有被填充正確的視差圖,進而導致視點圖像錯位、透視關系不正確等問題,使觀看者無法在視點位置上看到正確的視點圖像,降低了觀看效果。

圖1 均勻采集和空間視點分布示意圖。(a)光柵立體顯示器的視點采集和顯示;(b)真實透鏡下的視點分布。Fig.1 Schematic diagram of uniform acquisition and spatial viewpoint distribution.(a)Viewpoint acquisition and display of auto stereo display;(b)View distribution under the real lenses.

因此,本文提出一種基于軟件實現的多視點圖像校正方案:針對均勻采集的多視點圖像進行校正,利用視點間相關性預測出對應位置的多視點圖像,使之能夠正確匹配顯示器視點分布,提高觀看效果。

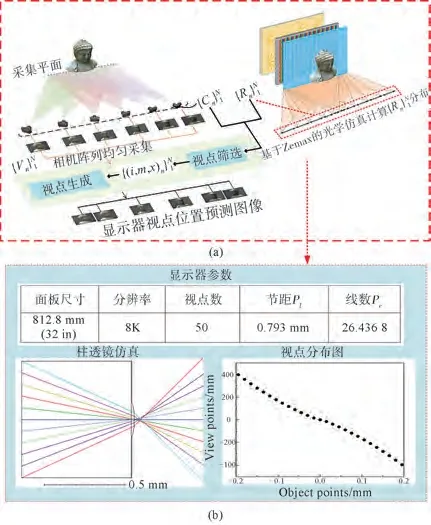

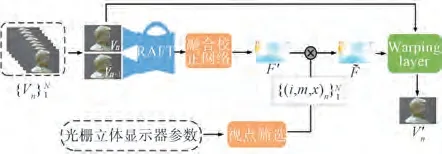

多視點采集校正方案如圖2 所示。本文以812.8 mm(32 in)8K 分辨率的光柵立體顯示器為例;首先基于傳統的均勻采集方案采集待校正的多視點圖像陣列,設均勻采集位置為,根據光柵立體顯示器的特定光學參數基于Zemax 光學仿真軟件計算出空間視點的實際分布(圖2(b))。本方案設計了一種配套的視點篩選算法(算法細節將在2.3 節中詳細介紹),本算法計算了相對于的插幀指導序列,以指導視點生成模塊預測對應位置的多視點圖像,其中,視點生成模塊流程如圖3 所示:首先基于RAFT 光流預測網絡計算出相鄰視點間的光流F,輸入本文設計的融合校正網絡進行光流校正優化,得到校正光流F’,結合上文的通過后向扭曲得到相應位置的虛擬視點V'n,組成針對位置采集的多視點陣列,校正工作完成。

圖2 多視點采集校正原理。(a)多視點采集校正方案;(b)基于Zemax 的視點分布計算。Fig.2 Principle of multi-view acquisition and correction.(a)Multi-view acquisition and correction scheme;(b)Viewpoint distribution calculation based on Zemax.

圖3 視點生成模塊流程圖Fig.3 Flow chart of the viewpoint generation module

2.2 基于光流法的虛擬視點生成網絡

2.2.1 網絡結構分析

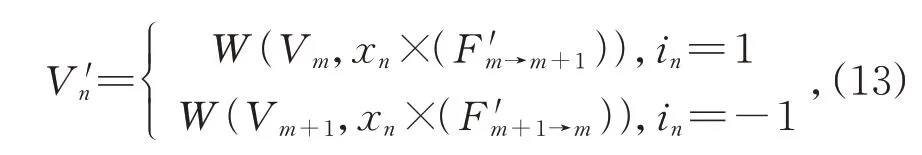

給定兩個相鄰視點Vm、Vm+1和一個插值系數x∈(0,1),我們的目標是結合x預測水平方向上指定位置的中間視點V'n,一個可靠的中間視點預測網絡是至關重要的一部分,為了做到這一點,該網絡不僅要學會匹配Vm、Vm+1的相似像素點,還需學會解釋匹配點之間的運動路徑。受中間視頻幀插值[21-22]研究進展的啟發,我們提出基于光流法和后向扭曲操作生成中間虛擬視點。

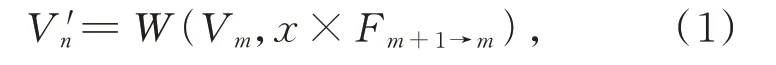

相 鄰 視 點 間 的 光 流Fm→m+1、Fm+1→m記 錄 了像素點相對其他視點的位移矢量,假設我們已經確定了雙向光流,在不考慮遮擋關系時,X=x處的中間視點可以表示為:

或者

其中,W(·)表示后向扭曲計算函數,它應用單映性變換和雙線性插值來實現,并且是可微的。

為了得到光流Fm→m+1、Fm+1→m,我們采用了RAFT 光流預測網絡[19]作為初始光流提取模塊,該網絡設計了特征匹配和獨特的內容提取網絡作為特征提取模塊,并直接計算預測視圖和原圖間所有像素之間的矢量距離搭建代價聚合體(Cost Volumn),無需人工設定搜索范圍,這大大提高了光流預測的精確性和魯棒性,最后引入凸上采樣(Convex Upsampling)的方法生成高分辨率光流,訓練時通過一個循環單元迭代地更新一個流場,該方案在光流估計領域取得了顯著的突破。

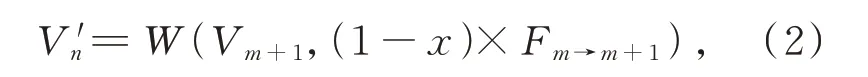

由于缺乏中間視點的監督,和遮擋關系的影響,單純的使用RAFT 網絡預測中間視點通常在接近x=0 和x=1 的位置上表現良好,在其他位置的預測效果得不到保障,且會在紋理突變的邊緣區域產生偽影和殘缺[19-20]。在Super SloMo 以及RIFE 等光流插幀網絡[20-21]的啟發下,我們提出了一種針對雙向光流的融合校正網絡來保證中間視點的預測質量,其網絡結構如圖4 所示。

圖4 光流融合校正網絡結構Fig.4 Optical-flow fusion-corrected network structure

首先利用RAFT 光流預測網絡計算出Vm、Vm+1的雙向光流,依次輸入共享參數的融合校正網絡。鑒于U-Net 網絡在視點生成及優化上有很可觀的表現[26],我們的融合網絡由U-Net 改進而來:采用最新提出的ConvNext 模塊[23]作為特征提取層,該模塊在圖像分割、特征提取等計算機視覺任務上表現出了強于Transformer 的計算能力,并保持了CNN 的計算速度;細節提取模塊由不同大小卷積核的卷積層構成,主要負責在兼顧輪廓信息的同時提取細節特征,以解決光流在物體邊緣預測不準確的問題;最后經反卷積和跳躍連接得到最終的輸出的校正光流F'm→m+1、F'm+1→m。

2.2.2 訓練

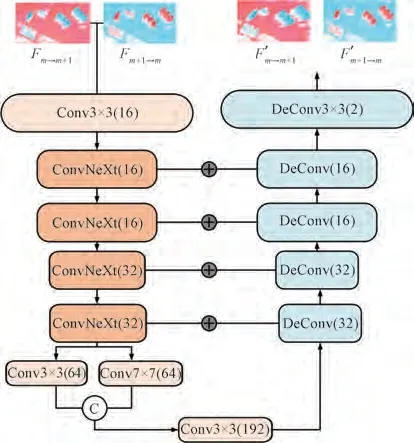

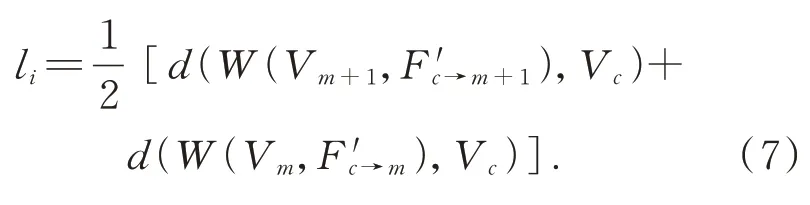

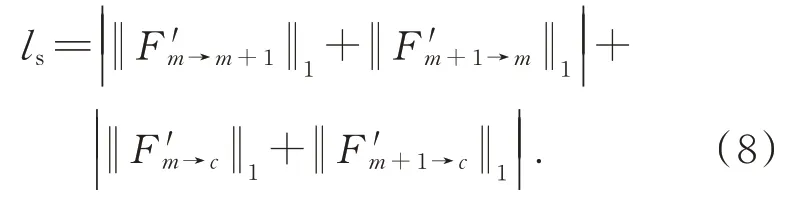

給定輸入圖像Vm、Vm+1,RAFT 光流預測網絡的采用自監督訓練方式,拍攝中間視點Vc為融合校正網絡的監督。將RAFT 網絡的輸出Fm→m+1、Fm+1→m輸 入 融 合 校 正 網 絡,最 終 輸 出是 校正光流,經過后向扭曲操 作后 得 到 預 測 中 間 視 點),我們最終的損失函數是種損失函數的線性組合:

loss=λflf+λili+λsls, (3)

其中:光流預測損失函數lf表征了來自RAFT 的光流F和校正光流F'的自監督損失,可以約束兩個網絡更加精準地求解雙向光流:

lb=d(W(Vm+1,Fm→m+1),Vm)+

d(W(Vm,Fm+1→m),Vm+1) , (4)

l'b=d(W(Vm+1,Fm→m+1),Vm)+

d(W(Vm,Fm+1→m),Vm+1), (5)

lf=lb+l'b, (6)

其中,d(·,·)表示像素間的損失(Pixel-wised loss)。插值損失li表征了校正光流對中間視點的預測準確度:

最后,我們添加了一個平滑度損失項ls[24],以鼓勵相鄰的像素具有相似的流值,并加速網絡收斂:

設置經驗性權重λf=0.8、λi=0.4、λs=1,我們的網絡的每個組成部分都是可微的,因此,我們的中間視點生成網絡可以進行端到端訓練。

2.3 多視點篩選算法

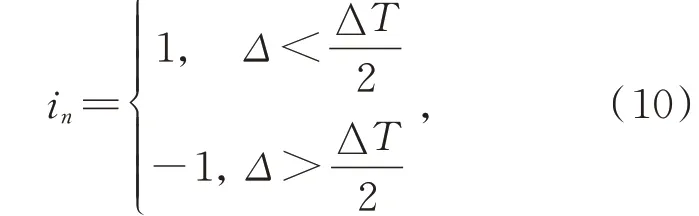

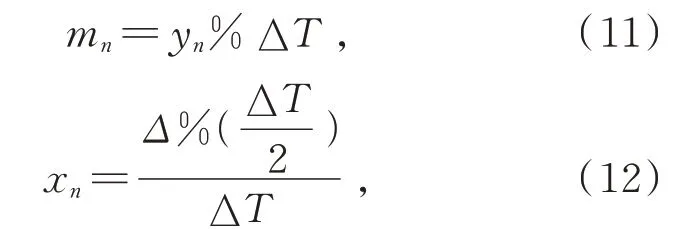

根據光柵立體顯示器的實際視點分布,我們提出了一種多視點篩選算法,本算法的目的是求得均勻采集視點到顯示器視點位置的映射關系,以指導虛擬視點生成模塊生成位于的虛擬視點,并將映射關系量化為插幀指導序列{(i,m,x,其中:

m:m表示距離真實采集點最近且小于真實采集點序號的均勻視點序號,真實采集點將位于(m,m+1)之間,i和m的設置可以保證由最近的兩個相鄰視點生成,保證了生成質量;

i:i∈{-1,1},i表示采用的光流方向,當i=1時,取間正向光流,反 之 則 取反向光流

x:x表 示 插 值 系 數,x∈(0,1),它 指 導間的光流生成對應位置x=xn的中間虛擬視點。

首先利用光學仿真計算針對特定的光柵立體顯示器的光學參數在最佳觀看距離處仿真出顯示器空間視點分布,設Vn的y坐標為yn、真實分布Rn的坐標為,均勻采集間隔為ΔT則有:

Δ=ynfmod ΔT, (9)

3 實驗結果

3.1 基于光流法的虛擬視點生成測試

為了結合實際應用場景,驗證本文提出的利用基于光流法的視點生成的有效性,我們分別選用了若干組真實、虛擬場景多視點圖像作為對視點生成模塊的測試集,選用兩組分辨率為960×540、視差角為6°的視差圖送入訓練好的網絡做插值預測,單視點平均生成時間為34 ms。

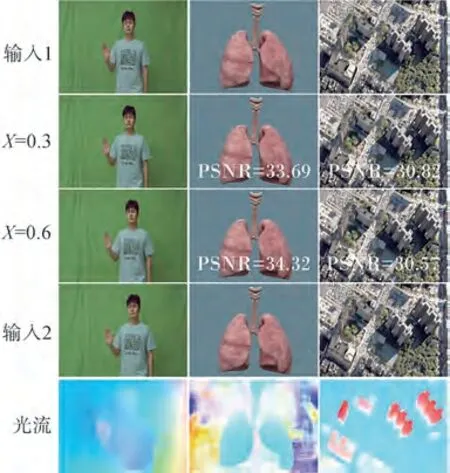

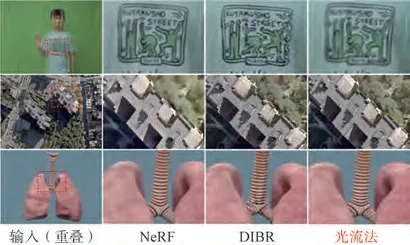

圖5 分別展示了插值系數X為0.3、0.6 的針對真實、虛擬模型拍攝的中間視點預測以及對應光流圖,針對虛擬場景預測的PSNR指標平均值在30 以上。圖6 展示了本視點生成方案和NeRF[15]、DIBR[14]方案的對比效果。NeRF 生成視點的平均PSNR 為31.75,傳統DIBR 生成視點的平均PSNR 為25.73,本方案生成質量明顯優于傳統的DIBR 視點生成方案,與NeRF 生成質量相當,但因傳統NeRF 重建了整個場景信息,導致訓練時間較長,對于現實單一場景需要8 h訓練時間,相比光流法難以應用于動態場景重建。以上對比表示基于光流法的虛擬視點生成方案可以有效、快速地生成任意位置的高質量中間視點,可以用于多視點圖片的校正工作。

圖5 中間視點生成效果Fig.5 Mid-viewpoint generates effect

圖6 不同視點生成方案的生成效果Fig.6 Generation effects of different viewpoints genera tion schemes

3.2 顯示效果測試

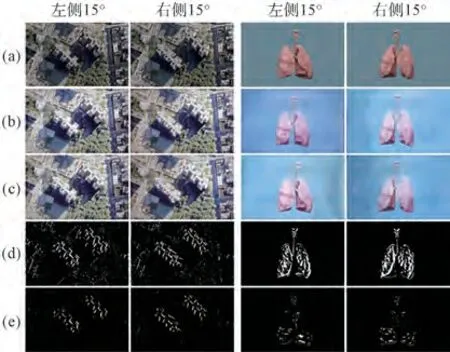

將均勻采集后的多視點圖像陣列編碼后分別加載到本實驗室的光柵立體顯示器上顯示,分別在顯示器左右15°放置單反相機拍照記錄,最終顯示效果如圖7 所示。圖7(a)行的4 幅圖片是實驗的參考圖片,分別表示針對模型的左右15°采集效果;圖7(b)中圖片展示了均勻采集的多視點圖片未經校正的顯示效果,由于采集視點和真實的空間視點分布不匹配,可以看出與參考圖片有明顯的角度偏差,產生了視點圖片錯位的現象;圖7(c)展示了校正后的顯示圖像。為了更直觀準確地表達校正效果,本文計算了顯示圖和參考圖之間的差值圖及PSNR。為了減小拍攝時雜光的影響,本文對顯示圖和參考圖進行濾波去噪后再進行相關計算。其中,樓房場景下的修正前后的平均PSNR 分別為23.34、28.65,內臟場景下的平均PSNR 分別為25.64、30.21,校正后的顯示效果優于校正前。將參考圖片圖7(a)與顯示圖像圖7(b)、圖7(c)分別做相減處理。為了更清晰地表示圖像間輪廓間的區別,在相減處理后需進行二值化處理,得到圖7(d)、(e)。通過圖7(d)、圖7(e)和PSNR 對比可以看出,傳統采集方案的顯示效果存在明顯的視點圖像偏移,而校正后的視點圖像分布比校正前更加貼近顯示器視點位置,視點錯位現象得到優化。上述實驗說明,針對光柵立體顯示,本文的多視點校正方案可以有效解決傳統采集和顯示器視點不匹配的問題,校正后的視點為顯示器視點填充了正確的視差圖,提升了觀看質量。

圖7 顯示效果對比圖。(a)特定位置采集效果;(b)校正前特定角度顯示圖像;(c)校正后特定角度顯示圖像;(d)圖6(a)和圖6(b)間的差值圖;(e)圖6(a)和圖6(c)間的差值圖。Fig.7 Display effect comparison diagram. (a)Acquisition effect of specific location;(b)Display image at specific angle before correction;(c)Display image at specific angle after correction;(d)Difference between Fig. 6(a)and Fig. 6(b);(e)Difference between Fig. 6(a)and Fig.6(c).

4 結 論

在裸眼3D 顯示系統中,由于柱透鏡存在像差,使顯示器空間視點呈不均勻分布,存在空間視點分布和采集視點分布不匹配的現象,導致視點圖像錯位,透視關系不正確等問題,最終影響觀看效果。

本文針對上述問題提出了一種多視點校正方案,旨在將均勻采集的多視點圖像校正為符合觀看角度的新圖像陣列,以提高光柵立體顯示效果。該校正方案包括視點篩選算法和中間視點生成模塊,通過光學仿真出真實空間視點分布,利用視點篩選算法指導光流法生成正確位置的中間視點陣列,使校正圖像匹配真實的空間視點位置。經過實驗驗證,該方法有效校正了原本存在的空間視點分布和采集分布不匹配的問題,明顯地提升了觀看效果。