基于相關濾波器的雷達單擴展目標跟蹤

李冬冬 范紅旗 王麗萍 蒯楊柳

摘 要:?????? 在傳統的雷達目標跟蹤算法中,目標通常作為點目標來進行跟蹤濾波。隨著雷達傳感器分辨率的不斷提高,一個目標可占據多個分辨單元,雷達可以提供高分辨率的觀測結果。當目標變成擴展目標時,由于單個目標多個量測的產生,基于傳統點目標假設的目標跟蹤算法無法實現對擴展目標的穩定跟蹤。本文基于計算機視覺領域的相關濾波算法提出了一種雷達單擴展目標跟蹤算法。該算法首先對雷達回波數據進行歸一化, 從而得到可視化的雷達距離-方位向圖像,然后將該圖像從極坐標系轉換到笛卡爾坐標系,最后利用相關濾波器對擴展目標的外觀進行精細化的在線學習, 并基于濾波器響應圖實現目標跟蹤。基于實測數據的實驗結果表明,該算法可以得到每個時刻目標的位置和長度信息,和傳統跟蹤濾波算法相比具有更加準確和魯棒的跟蹤性能。

關鍵詞:???? 時敏目標; 相關濾波算法; 濾波器響應; 擴展目標; 在線學習; 目標跟蹤; 雷達

中圖分類號:???? TJ760; TN958

文獻標識碼:??? A

文章編號:???? 1673-5048(2022)02-0019-05

DOI:10.12132/ISSN.1673-5048.2020.0249

0 引? 言

雷達在軍事和民用上均有重要應用,常用于檢測和跟蹤感興趣區域內的移動目標,如空中飛機和海面艦船等[1]。傳統的雷達通常將目標假設為一個點目標(最小可分辨單元)[2-4]。隨著雷達分辨率的不斷提高,感興趣區域內的目標由點目標變為一個點群即擴展目標。傳統跟蹤濾波算法(如卡爾曼濾波)通常在預處理階段將目標進行聚類并提取中心點作為目標的實際位置。這種假設對于遠距離探測是合理的,因為目標的回波強度通常強于背景雜波,且回波信息較為集中。對于近距離探測和高分辨率雷達探測,目標占據多個分辨單元,目標的回波由同一個目標不同區域的回波構成,因而目標從一個點目標變為一個擴展目標。因此,傳統的跟蹤濾波算法將目標視為點目標,忽略了擴展目標的實際形狀信息,從而導致目標狀態估計的不穩定,進而出現跟蹤漂移。

為了精確跟蹤目標,擴展目標跟蹤(Extended Object Tracking, EOT) 算法被提出用于處理高分辨雷達目標數據[5-6]。擴展目標跟蹤可同時估計目標的中心點位置和目標的形狀。通常,構成擴展目標的離散點被擬合成一個預先定義的形狀(如矩形和橢圓)。和點目標跟蹤模型相比,擴展目標跟蹤算法考慮了目標的輪廓信息,因而具有更強的準確性。但是,當擴展目標被遮擋或發生航跡交會時,形狀擬合會產生誤差,擴展目標跟蹤算法無法準確定位目標的位置。不準確的目標定位會進一步引起錯誤的目標關聯,從而產生跟蹤漂移。

受到計算機視覺領域跟蹤算法[7-8]的啟發,本文提出了基于相關濾波器[9-14]的雷達單擴展目標跟蹤算法。和傳統的基于輪廓模型的擴展目標跟蹤算法相比,基于相關濾波器的擴展目標跟蹤算法將擴展目標假設為一個矩形目標,同時將矩形區域內目標回波強度作為擴展目標的外觀特征。和傳統的基于運動模型的跟蹤濾波算法相比,相關濾波器更關注于目標的外觀信息,也就是目標的回波強度。在跟蹤過程中,目標的回波強度會隨著目標和雷達的距離變化而不斷發生變化,目標的矩形框也會隨著目標在極坐標系的運動而不斷發生旋轉。 相關濾波器可以利用在線學習不斷適應變化的目標外觀。 基于在線學習得到的判別式濾波器, 可以將跟蹤擴展目標和背景雜波以及其他臨近擴展目標區分開, 從而實現穩定的目標跟蹤。同時,相關濾波器可以利用傅里葉變化將空域內的模板匹配轉換為頻域內的點乘計算,代碼執行效率高,算法實時性強。故本文提出一個基于相關濾波器的雷達單擴展目標跟蹤框架,主要貢獻如下:

(1) 提出了一種雷達數據預處理方法。該方法對雷達數據進行歸一化,并生成可視的雷達距離-方位向圖像。距離-方位向圖像從極坐標被變換為笛卡爾坐標系,從而一定程度上消除目標外觀的旋轉變化。

(2) 提出了基于背景上下文相關濾波器的雷達單擴展目標跟蹤算法。該算法利用雷達圖像的回波強度作為灰度信息并提取外觀特征,從而在線訓練相關濾波器系數并實現穩定跟蹤。

(3) 基于開源的X波段海用雷達實際觀測數據,對本文提出的雷達單擴展目標跟蹤算法進行評估。實驗證明所提跟蹤算法在整段觀測數據中能夠對5個觀測目標實現穩定跟蹤。

1 相關濾波器數學原理

本文采用計算機視覺領域中的一個基于相關濾波器的跟蹤算法對雷達擴展目標進行跟蹤。這里采用背景上下文相關濾波器(Background Aware Correlation Filters, BACF)[14]對擴展目標進行跟蹤。

傳統的基于標準相關濾波器的視覺跟蹤算法具有較高的準確性和速度,但搜索區域較小且容易受到邊界效應的影響而發生漂移。BACF解決了邊界效應的影響并擴展了搜索區域。給定當前時刻雷達圖像上以目標為中心的圖像切片,BACF從切片上提取高維外觀特征。通過對高維特征進行循環移位,可以得到大量循環移位樣本。BACF通過回歸優化可以得到一個和樣本相同大小的多通道相關濾波器f。假設前景目標樣本為x,對應的標簽為y,BACF可以通過訓練得到一個多通道相關濾波器f。假設xl表示樣本x的第l維特征。相關濾波器f可以通過求解式(1)中的優化目標得到:

ε(f)=∑dl=1xl*(p·fl)-y22+λf22(1)

式中: *為循環卷積運算; ·為點積運算; p為施加在特征x上的矩形掩模; y為高斯標簽; λ為正則化參數。

為了利用傅里葉變換加速求解速度,式(1)可以轉換到頻域內求解:

ε(f, g)=∑dl=1xl*gl-y22+λf22

s.t. gl=p·fl(2)

式(2)可以利用ADMM算法求解,詳細內容參見文獻[14]。

基于相關濾波器的原理,雷達圖像中目標跟蹤的基本流程如圖1所示。

2 雷達單擴展目標跟蹤框架

針對X波段海用雷達實測回波數據,基于相關濾波器提出了整套艦船目標跟蹤的數據處理框架。

2.1 雷達數據可視化

采用文獻[15]中位于宜昌市長江岸邊的X波段船用雷達于2013年8月8日采集的實驗數據,雷達視野如圖2所示。雷達的具體參數如表1所示。

采集的雷達數據共460幀,時長20 min。由于BACF算法的輸入是灰度值為0~255的圖像,需要對雷達數據

進行預處理,從而得到可視化的雷達圖像。處理方法為

I1=256·I0-min(I0)max(I0)-min(I0) (3)

式中: I0為原始的雷達數據; I1為歸一化后的雷達圖像,如圖3所示。

2.2 坐標系轉換

基于相關濾波器的視覺跟蹤算法一般將目標假設為一個與橫軸和縱軸平行的矩形框。因此,當艦船等狹長型目標發生大角度旋轉時,目標矩形框無法完全包圍目標輪廓,導致目標跟蹤失敗。雷達距離-方位向圖像處于極坐標系中,所以沿直線運動的動態目標軌跡經常會變成圓弧,導致目標發生大角度平面旋轉。

為消除由極坐標系帶來的目標旋轉問題,可將雷達圖像從極坐標系轉換為笛卡爾坐標系。假設雷達在極坐標系中的距離-方位向圖像為p(r, θ),期望得到的笛卡爾坐標系為q(x, y)。通過平面幾何理論,可以得到如下坐標轉換公式:

x=rcosθy=rsinθ? (4)

對式(4)進行坐標反算,可以得到:

r=x2+y2θ=arctanyx? (5)

利用式(5),可以對笛卡爾坐標系下圖像q(x, y)的任意像素點(x, y)在距離-方位向圖像p(r, θ)上進行像素映射,從而得到笛卡爾坐標系下的雷達圖像,如圖4所示。

2.3 雷達單擴展目標跟蹤

在對雷達單擴展目標進行跟蹤時,給定包含目標的矩形框,在目標的背景區域添加3倍的padding區域作為目標樣本。為提高對目標外觀的表征能力,將目標樣本(雷達回波強度圖像)中提取的高維HOG特征作為真實訓練樣本x。

利用訓練樣本x,可以基于BACF算法得到相關濾波器f。假設z表示從下一幀圖片中提取到的特征圖,代表這幀圖片所有位置分類器分數的響應圖可以通過卷積操作的性質得到:

Sf(z)=F-1∑dl=1z^l·f^l(6)

式中: F-1表示傅里葉的逆變換,其響應最大的位置即為這幀圖片預測的中心位置。

和其他基于相關濾波器的跟蹤算法相同,本文采用了一種在線更新的策略,以提高跟蹤算法對目標外觀變化(航向、尺度、回波強度)的魯棒性。假如目標在第t幀的訓練樣本為z(t),采用線性插值對訓練樣本進行在線更新,即

z(t)=(1-η)z(t-1)+ηz(t)(7)

式中: η是線性插值系數,代表在線更新的速率。

3 實驗及分析

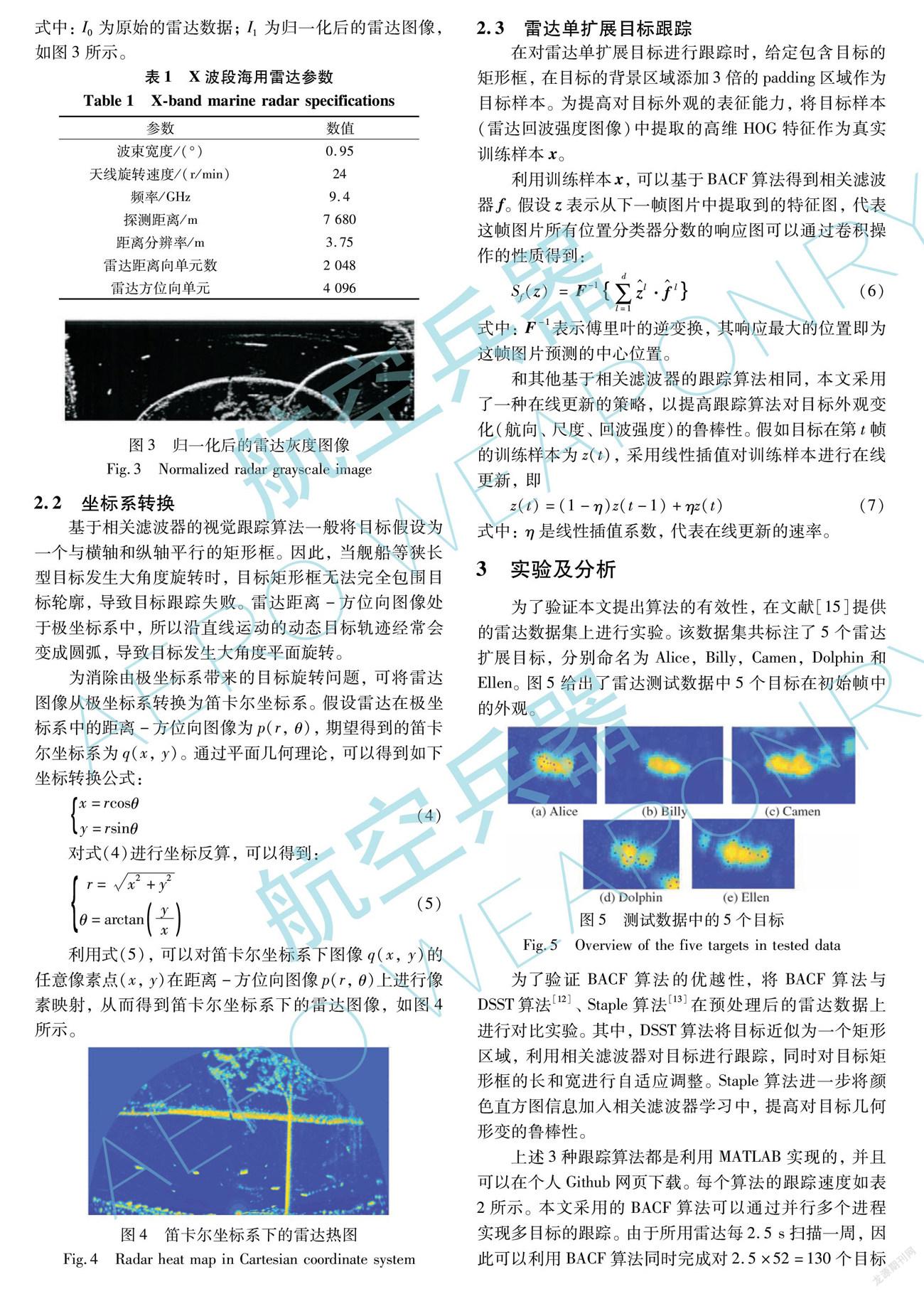

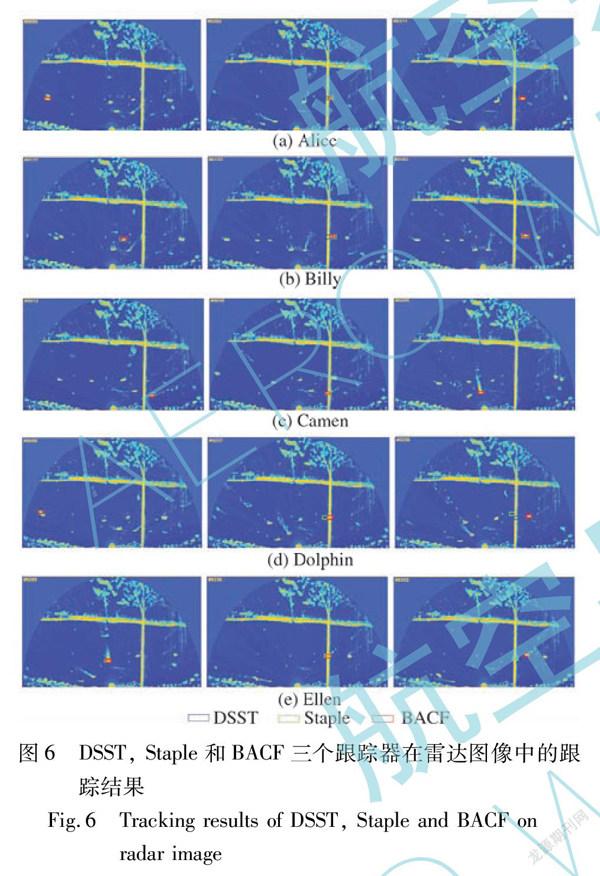

為了驗證本文提出算法的有效性,在文獻[15]提供的雷達數據集上進行實驗。該數據集共標注了5個雷達擴展目標,分別命名為Alice, Billy, Camen, Dolphin和Ellen。圖5給出了雷達測試數據中5個目標在初始幀中的外觀。

為了驗證BACF算法的優越性,將BACF算法與DSST算法[12]、Staple算法[13]在預處理后的雷達數據上進行對比實驗。其中,DSST算法將目標近似為一個矩形區域,利用相關濾波器對目標進行跟蹤,同時對目標矩形框的長和寬進行自適應調整。Staple算法進一步將顏色直方圖信息加入相關濾波器學習中,提高對目標幾何形變的魯棒性。

上述3種跟蹤算法都是利用MATLAB實現的,并且可以在個人Github網頁下載。每個算法的跟蹤速度如表2所示。本文采用的BACF算法可以通過并行多個進程實現多目標的跟蹤。由于所用雷達每2.5 s掃描一周,因此可以利用BACF算法同時完成對2.5×52=130個目標的實時跟蹤。

然后,分別在文獻[15]中的五段數據(Alice,Billy,Camen,Dolphin,Ellen)上對DSST,Staple和BACF三個算法進行對比,跟蹤結果如圖6所示。

在Alice中,被跟蹤目標和背景中相鄰目標在99幀發生重疊效應,3個算法均沒有受到干擾,保持準確跟蹤。在302幀中,被跟蹤目標穿越橋梁時被遮擋,DSST算法發生跟蹤漂移,Staple和BACF保持準確跟蹤。

在Billy中,目標在第1幀到117幀之間發生旋轉和外觀變化,3個算法均能保持準確跟蹤。在第153幀中,被跟蹤目標穿越橋梁時,DSST算法發生跟蹤漂移,而Staple和BACF均能夠保持準確跟蹤。

在Camen中,目標在第59幀穿越橋梁發生遮擋,3個算法都沒有丟失目標。在后續時刻中,目標不斷接近雷達從而回波不斷增強,使外觀發生劇烈變化,3個算法都能夠保持準確跟蹤。

在Dolphin中,在第88幀,被跟蹤目標與背景中臨近目標發生交會,3個算法均沒有受到干擾。 在第237幀中,被跟蹤目標穿越橋梁發生遮擋,DSST和Staple算法發生跟蹤漂移。在第256幀中,當目標遠離橋梁時,DSST和Staple算法完全丟失目標,BACF算法仍然能夠準確跟蹤目標。

在Ellen中,從初始幀到285幀,目標距離雷達的距離不斷減小,回波強度不斷增強,目標外觀發生劇烈變化,但3個算法都能夠保持準確跟蹤。在第336幀中,目標穿越橋梁時發生遮擋,Staple算法發生跟蹤漂移并逐漸丟失目標。DSST和BACF算法能夠保持準確跟蹤。

可以看到,在數據集的5段數據中,BACF算法均能夠對目標保持準確跟蹤,同時對目標的雷達回波強度變化和背景中的干擾和遮擋具有較強的魯棒性。

4 結? 論

本文針對X波段雷達實測回波數據,尤其是對于擴展目標跟蹤難度大的問題,提出了基于相關濾波器的雷達單擴展目標跟蹤算法。該算法通過對雷達回波數據進行歸一化將雷達目標跟蹤轉換為視頻目標跟蹤問題,然后將極坐標下的距離-方位向圖像轉換為笛卡爾坐標系下的圖像,從而消除目標在曲線航跡中的旋轉問題。最后利用相關濾波器在線學習目標的外觀變化,并實現魯棒的目標跟蹤。與其他跟蹤算法進行實驗比較,本文提出的雷達擴展單目標跟蹤算法更加準確,魯棒性更強,且可以實時運行。在下一步的工作中,將建立一個X波段雷達圖像跟蹤數據集并對海面目標進行標注,從而對雷達擴展目標跟蹤算法進行定量評估。

參考文獻:

[1] 劉本源, 宋志勇, 范紅旗. 聚焦、檢測、跟蹤、再聚焦: 基于經典跟蹤前檢測框架的實時小目標檢測技術[J]. 航空兵器, 2019, 26(6): 10-16.

Liu Benyuan, Song Zhiyong, Fan Hongqi. Focus, Detect, Track and Re-Focus: A Dim Target Detection Technique Using the Classical Detect before Track Architecture[J]. Aero Weaponry, 2019, 26(6): 10-16.(in Chinese)

[2] 王錚, 韓寶玲. 基于交互多模型的粒子濾波導引頭機動目標檢測技術研究[J]. 航空兵器, 2020, 27(1): 26-32.

Wang Zheng, Han Baoling. Research on Maneuvering Target Tracking Technology for Seeker Based on Particle Filter of Interacting Multiple Model[J]. Aero Weaponry, 2020, 27(1): 26-32.(in Chinese)

[3] 李云坤, 陳偉, 曹旭東. 粒子濾波檢測前跟蹤算法的粒子比優化方法研究[J]. 航空兵器, 2017(5): 25-30.

Li Yunkun, Chen Wei, Cao Xudong. Particle Ratio Optimization of Particle Filter Track-before-Detect Algorithm[J]. Aero Weaponry, 2017(5): 25-30.(in Chinese)

[4] 廖雪陽, 任宏光, 章惠君. 基于重采樣粒子濾波的目標跟蹤算法研究[J]. 航空兵器, 2016(5): 25-28.

Liao Xueyang, Ren Hongguang, Zhang Huijun. Research on Target Tracking Method Based on the Resampling Particle Filter[J]. Aero Weaponry, 2016(5): 25-28.(in Chinese)

[5] Vermaak J, Ikoma N, Godsill S J. A Sequential Monte Carlo Framework for Extended Object Tracking[J]. IEE Proceedings-Radar, Sonar and Navigation, 2005, 152(5): 353.

[6] 回丙偉, 宋志勇, 王琦, 等. 空中弱小目標檢測跟蹤測試基準[J]. 航空兵器, 2019, 26(6): 56-59.

Hui Bingwei, Song Zhiyong, Wang Qi, et al. A Benchmark for Dim or Small Aircraft Targets Detection and Tracking[J]. Aero Weaponry, 2019, 26(6): 56-59.(in Chinese)

[7] 管皓, 薛向陽, 安志勇. 在線單目標視頻跟蹤算法綜述[J]. 小型微型計算機系統, 2017, 38(1): 147-153.

Guan Hao, Xue Xiangyang, An Zhiyong. Survey of Video Object Tracking[J]. Journal of Chinese Computer Systems, 2017, 38(1): 147-153.(in Chinese)

[8] Yilmaz A, Javed O, Shah M. Object Tracking[J]. ACM Computing Surveys, 2006, 38(4): 13.

[9] Bolme D S, Beveridge J R, Draper B A, et al. Visual Object Tracking Using Adaptive Correlation Filters[C]∥IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2010: 2544-2550.

[10] Henriques J F, Caseiro R, Martins P, et al. Exploiting the Circulant Structure of Tracking-by-Detection with Kernels[C]∥Computer Vision-ECCV, 2012: 702-715.

[11] Henriques J F, Caseiro R, Martins P, et al. High-Speed Tracking with Kernelized Correlation Filters[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(3): 583-596.

[12] Danelljan M, Hger G, Khan F S, et al. Discriminative Scale Space Tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(8): 1561-1575.

[13] Bertinetto L, Valmadre J, Golodetz S, et al. Staple: Complementary Learners for Real-Time Tracking[C]∥IEEE Conference on Computer Vision and Pattern Recognition (CVPR),2016: 1401-1409.

[14] Galoogahi H K, Fagg A, Lucey S. Learning Background-Aware Correlation Filters for Visual Tracking[C]∥IEEE International Conference on Computer Vision (ICCV), 2017: 1144-1152.

[15] Zhou Y, Wang T, Hu R H, et al. Multiple Kernelized Correlation Filters (MKCF) for Extended Object Tracking Using X-Band Marine Radar Data[J]. IEEE Transactions on Signal Processing, 2019, 67(14): 3676-3688.

Radar Single Extended Object Tracking Based on Correlation Filter

Li Dongdong1, Fan Hongqi1, Wang Liping1, Kuai Yangliu2*

(1. College of Electronic Science and Technology, National University of Defense Technology, Changsha 410073, China;

2. Mechanical Service Center for Vocational Education, National University of Defense Technology, Changsha 410073, China)

Abstract: In traditional radar object tracking algorithms, targets are regarded as points in tracking filtering algorithms. With higher resolution in range and azimuth directions, a target can occupy multiple resolution units, so radars can obtain high-resolution observation results. When point targets turn into extended objects, the traditional point target tracking filtering algorithms can hardly achieve stable tracking to the extended object due to the increasing complexity in data association. In this paper, a radar single extended object tracking algorithm is proposed based on correlation filtering algorithm in the computer vision field. This algorithm normalizes radar echoes to get the visual radar range-azimuth image firstly. Then,this image is transformed into the Cartesian coordinate system from the polar coordinate system. At last, the target appearance of the extended object are online learned by the correlation filter to realize the target tracking based on filtering response diagram. Real data based experimental results demonstrate that this algorithm can obtain the object location and size in each frame. Compared with traditional filtering algorithms, this algorithm is more accurate and robust.

Key words:? time-sensitive target; correlation filtering algorithm; filter response;extended object; online learning; target tracking; radar