基于神經網絡的洗手動作識別方法

【關鍵詞】洗手動作識別;目標檢測;注意力機制;編解碼結構

【中圖分類號】Q189 【文獻標識碼】A 【文章編號】2026-5328(2022)03--01

1 引言

中華人民共和國衛生部[1]在2020年發布了《醫務人員手衛生規范》,它規定了醫務人員洗手方法和外科沖洗手消毒方法。在臨床環境中引入手衛生依從性的智能化檢測方式是十分必要的。2020年2月,邢政等人[2]發明一種洗手監測裝置,該裝置使用傳感器檢測到手部后,執行洗手響應,記錄使用者的信息并上傳至終端。2020年5月,杉村由花等人[3]研發出一種基于視頻的通用行為分析系統Actlyzer,該系統無需大量訓練數據,可以快速進行部署,同年被擴展應用于洗手動作識別。Llorca D F等人[4]提出了基于支持向量機的洗手識別系統,該系統使用顏色和運動分析進行手部區域分割,以雙手相連或分開這兩種狀態判斷使用者是否在洗手。本文對ResNet34網絡進行改進,提出了一種洗手動作實時識別方法。

2 洗手動作識別

2.1洗手動作識別模型

本文在編碼階段以ResNet34網絡為基礎,結合卷積塊注意力模塊進行改進,本文網絡模型包括編碼器、解碼器和分類器三部分。編碼器由提取網絡由改進后的殘差結構構成。解碼器由平均池化層、Dropout層和全連接層構成。平均池化層和全連接層對特征圖進行下采樣,減少網絡模型的計算量,Dropout層對上一層參數進行隨機丟棄,增加網絡的健壯性。分類器采用SoftMax分類算法,對網絡模型識別的準確性進行調整,輸出識別結果。

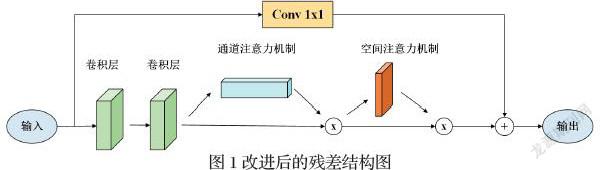

2.2 殘差結構改進方式

Woo S等人[5]提出的卷積塊注意力模塊是一種結構簡單、性能優異的注意力機制,由通道注意力模塊和空間注意力模塊構成。

He K等人[6]提出了殘差學習網絡,它改變了神經網絡越深,學習效果越好的觀念,該網絡使得網絡層能根據其輸入來學習殘差函數而非原始函數,基本組成單元是殘差結構。該結構由自上而下進行卷積運算的主分支與卷積核為1×1的捷徑分支兩部分構成,捷徑分支只改變特征圖維度,不改變特征圖的尺寸。當輸入殘差結構的特征圖F維度為256時,卷積運算不對特征圖F的維度進行擴展處理,只是將運算結果的輸出維度設置為512。

改進后的殘差結構結構圖如圖1所示。CBAM模塊的位置在主分支與捷徑分支進行和運算之前,卷積核為3×3的網絡層之后。該結構由自上而下進行卷積運算的主分支與不進行卷積運算的次分支兩部分構成。次分支在反向傳播的計算中不參與主分支的權重路徑,這使得主分支的權重參數與沒有過經過梯度衰減的權重相加,可以達到抑制過擬合的效果。在殘差結構中加入CBAM,可以對模型參數進行微調,使特征圖中的重要信息在通道和空間維度上被網絡關注。

3.1 實驗環境與評價指標

本文設計的洗手動作識別方法在Windows10系統下搭建,硬件平臺配置如下:CPU為Intel(R) Core(TM) i7-7700K,內存為32GB;GPU為NVIDIA GTX1080TI;2K網絡攝像頭;顯示器:Lenovo LT2024wA。

洗手動作識別的本質是一個分類問題,因此本文采用了準確率(Acc)、洗手動作的平均查準率(Pavg)、平均查全率(Ravg)、平均特異度(Specificityavg)、平均調和平均數(F1avg)和參數量(N)為評價標準。準確率(Acc)表示分類模型正確分類樣本類型的能力。

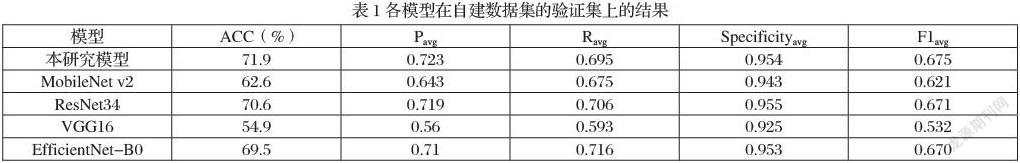

3.2 算法對比與分析

本文選取的ResNet、Vgg、MobileNet V2和EfficientNet模型與本文提出的洗手動作識別模型做對比,各個模型采用相同的數據處理方式和硬件條件進行訓練。實驗結果如表1所示。表中,Acc表示各個模型在數據集中的準確率; Pavg表示洗手動作的平均查準率;Ravg表示平均查全率;Specificityavg表示平均特異度;F1avg表示調和平均數的平均值。

各個模型在本文數據集上的實驗結果如表1所示,在準確率ACC和調和平均數F1avg方面,ResNet34的準確率高于深層網絡VGG16、MobileNet v2,略高于EfficientNet-B0網絡。由于本文數據集的訓練樣本小,深層網絡模型的結構過于復雜,訓練時的過擬合現象較為嚴重,在訓練效果上反而不如網絡層數較少的ResNet34,但是相對于只有18層的ResNet18網絡,其結構過于簡單又不能較好的擬合特征信息,因此ResNet34達到了最好的效果。本文模型準確率為71.9%,各洗手動作查準率與查全率的調和平均數的平均值為0.675,比EfficientNet-B0、MobileNet v2、VGG16、ResNet34、模型提高了2.4%、9.3%、17%、1.3%。

本文以洗手動作為研究對象,對ResNet34進行改進,將其應用于洗手動作識別任務中。實驗結果表明,這種神經網絡模型的性能優于其他識別網絡。本文提出的模型參數量較原網絡,參數量有所增加,這使得模型在時間效率上有著較大的優化空間;受數據集樣本數量的限制,后期訓練時過擬合問題對識別準確率依然有著較大影響,這兩方面有待進一步的優化。

參考文獻:

中華人民共和國衛生部. 醫務人員手衛生規范:WS/T313—2019[J].中華醫院感染學雜志,2020,30(05):796-800.

邢政,謝迎春. 洗手監測方法、洗手監測裝置及電子設備. CN110796836A[P],2020-02-14.

杉村由花, 內田大輔, 鈴木源太, 等. 映像から人の様々な行動を認識する 「行動分析技術 Actlyzer」[C]//人工知能學會全國大會論文集 第 34 回全國大會 (2020). 東京都: 人工知能學會, 2020: 4Rin157-4Rin157.

Llorca D F, Parra I, Sotelo M á, et al. A vision-based system for automatic hand washing quality assessment[J]. Machine Vision and Applications, 2011, 22(2): 219-234.

Woo S, Park J, Lee J Y, et al. Cbam: Convolutional block attention module[C]//Proceedings of the European conference on computer vision (ECCV). Munich: ECCV, 2018: 3-19.

He K, Zhang X, Ren S, et al. Deep residual learning for image recognition[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. New York: IEEE, 2016: 770-778.

作者簡介:胡志明(1995—),男,漢族,沈陽工業大學信息科學與工程學院碩士,主要研究方向為智能信息處理,遼寧省凌源市人。