坐標并行注意力下密集空洞卷積的脈絡(luò)膜分割

劉 渝,夏源祥,萬永菁

(華東理工大學信息科學與工程學院, 上海 200237)

脈絡(luò)膜[1]位于視網(wǎng)膜下方,上接視網(wǎng)膜色素上皮細胞(RPE)層,下接脈絡(luò)膜鞏膜分界面(CSI)。脈絡(luò)膜的病變與許多疾病相關(guān),如近視眼、黃斑病變、年齡相關(guān)性黃斑病變等。通過計算脈絡(luò)膜厚度、脈絡(luò)膜血管指數(shù),以及觀察結(jié)構(gòu)變化來了解眼組織變化和功能異常[2]。隨著光學斷層掃描圖像(Optical Coherence Tomography,OCT)技術(shù)的發(fā)展,觀察脈絡(luò)膜的結(jié)構(gòu)變得容易,但是對脈絡(luò)膜的厚度測量以及脈絡(luò)膜血管指數(shù)的計算還需要醫(yī)生先手動分割,整個過程耗時耗力,因此研究準確自動分割脈絡(luò)膜的方法對提升眼科疾病診斷的效率具有重要意義。

隨著卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)的發(fā)展,深度學習方法在醫(yī)學圖像分割領(lǐng)域得到廣泛應(yīng)用。2015 年Long 等[3]在CNN 的基礎(chǔ)上,提出了一種全新的網(wǎng)絡(luò)結(jié)構(gòu)即全卷積神經(jīng)網(wǎng)絡(luò)(Fully Convolutional Network, FCN)。該網(wǎng)絡(luò)將卷積神經(jīng)網(wǎng)絡(luò)中最后的全連接層替換成卷積層實現(xiàn)每一個像素的分類,以達到圖像分割的結(jié)果。在此基礎(chǔ)上,Ronneberger 等[4]提出一種U 型結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò)(U-Net),中間使用跳躍連接融合深層和淺層的圖像特征,結(jié)構(gòu)由一個編碼器和一個解碼器構(gòu)成。U-Net結(jié)構(gòu)簡單,在模糊邊界和區(qū)域也能取得很好的效果,基于改進U-Net 模型的OCT 圖像分割方法已經(jīng)被許多研究人員采用。Oktay 等[5]在U-Net 模型中引入注意門機制,提升了模型對前景像素的敏感性。Gu 等[6]提出融合了密集空洞卷積模塊和殘差多池化模塊的語義分割模型(CE-Net),使用U 型結(jié)構(gòu)實現(xiàn)編解碼,在醫(yī)學圖像分割領(lǐng)域得了很好的效果。Cheng 等[7]在U-Net 的編碼器部分加入了殘差細化模塊,同時引入通道注意力機制,很好地利用了高層語義信息,在952 張OCT 圖像脈絡(luò)膜分割中Dice 系數(shù)達到了85%。Mao 等[8]也基于U-Net 網(wǎng)絡(luò)融合改進的注意力機制,提高了脈絡(luò)膜分割的準確率。但這類方法沒有很好地利用脈絡(luò)膜的空間依賴關(guān)系,導致分割區(qū)域可能錯誤,邊緣分割精度不夠,同時在獲取脈絡(luò)膜的高級語義信息以及模型的優(yōu)化上仍有提升空間。

基于以上研究,本文提出了一種端到端的脈絡(luò)膜分割編解碼網(wǎng)絡(luò)模型。本文模型的主干編碼結(jié)構(gòu)是基于預(yù)訓練過的殘差分類模型:ResNet-34[9],這樣的編碼結(jié)構(gòu)能充分獲得脈絡(luò)膜語義信息、加快模型收斂以及防止梯度消失。在跳躍連接處設(shè)計了一種平行的橋結(jié)構(gòu),橋結(jié)構(gòu)包含兩個模塊,分別是坐標并行注意力模塊(Coordinate Parallel Attention, CPA)和密集空洞卷積模塊(Dense Atrous Convolution, DAC)。DAC 提取多感受野特征,CPA 模塊抑制跳躍連接時復制淺層特征產(chǎn)生的語義噪聲,經(jīng)過橋結(jié)構(gòu)的特征圖在解碼層進行融合。為使模型分割時對OCT 圖像中脈絡(luò)膜整體結(jié)構(gòu)給與關(guān)注度,本文還引入一種混合損失函數(shù),混合損失函數(shù)從像素級、結(jié)構(gòu)級、整體級監(jiān)督訓練本文提出的模型。在分割具有不同特點的脈絡(luò)膜的場景時,本文設(shè)計的模型表現(xiàn)均優(yōu)于其他常見的醫(yī)學圖像分割模型。

1 本文模型結(jié)構(gòu)及原理

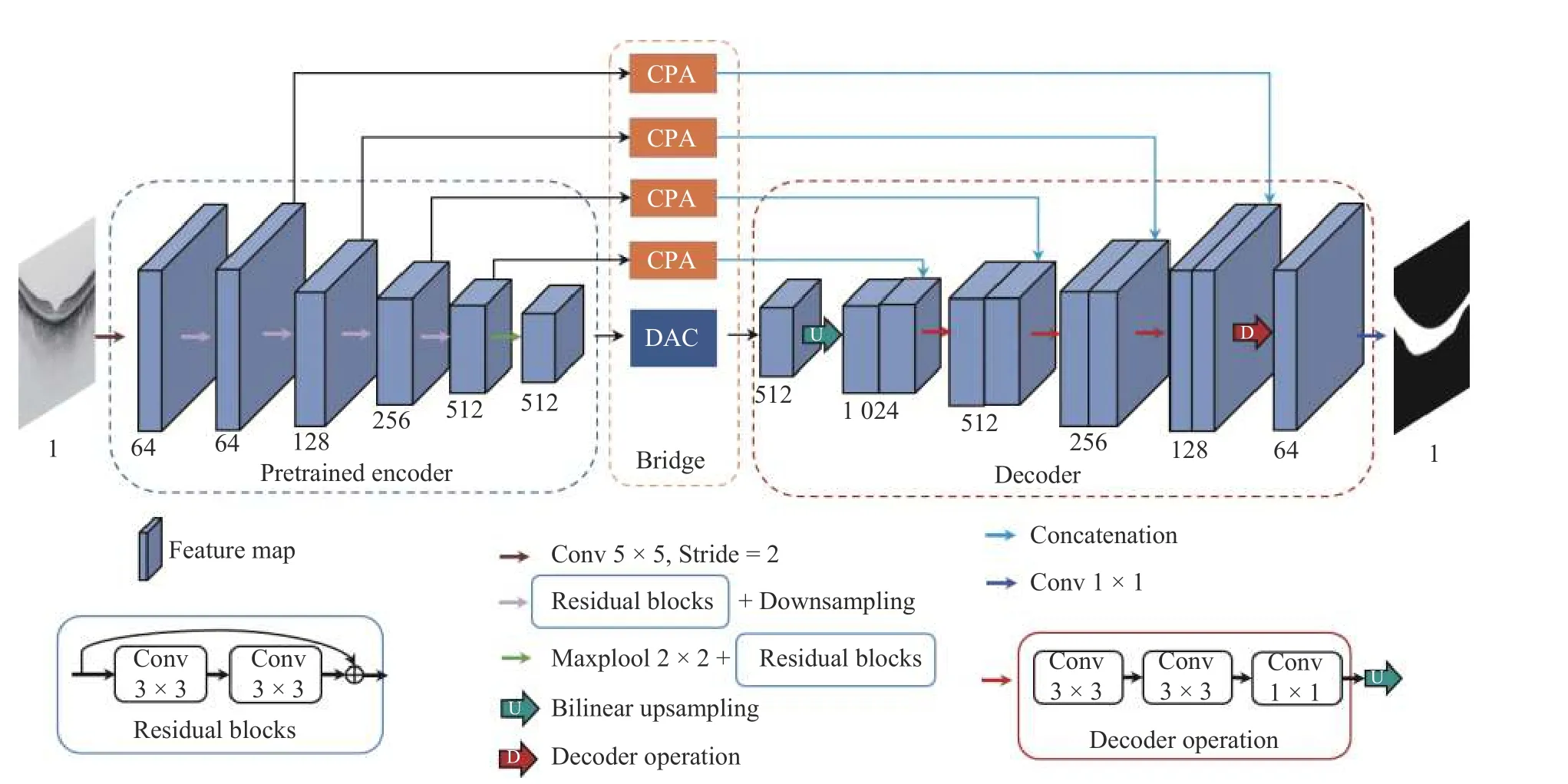

本文模型主要由3 部分構(gòu)成:編碼結(jié)構(gòu)、解碼結(jié)構(gòu)和橋結(jié)構(gòu)。整體結(jié)構(gòu)如圖1 所示。

經(jīng)典的U-Net 和改進的U-Net 都采用特征拼接的編解碼結(jié)構(gòu),優(yōu)點是能聚合淺層細節(jié)和深層特征信息,本文也采用了類似思想,但在編解碼階段和跳躍連接處進行了改進。本文選擇已經(jīng)在ImageNet[10]數(shù)據(jù)集上預(yù)訓練過的ResNet-34 分類網(wǎng)絡(luò)作為特征提取的主干編碼結(jié)構(gòu),以此更好地提取特征圖語義信息。利用預(yù)訓練模型的優(yōu)勢是當預(yù)訓練模型遷移到新任務(wù)時,計算機能以較少的調(diào)整參數(shù)快速實現(xiàn)模型的優(yōu)化。本文保留了ResNet-34 的4 個特征提取模塊,同時去除了最后的平均池化層和全連接層。ResNet-34 特征提取模塊包含的殘差塊的個數(shù)由淺入深分別為3、4、6、3,每個殘差塊的結(jié)構(gòu)如圖1左下角所示。殘差塊中的殘差連接能有效防止模型梯度消失。另外,本文使用步長為2 的5×5 的卷積替換ResNet-34 開始輸入時步長為2 的7×7 卷積層以及3×3 最大值池化層,目的是為了讓特征圖在第2 個編碼層之前能保持尺寸不變,在編碼早期能包含更多細節(jié)信息。但這樣的操作縮小了模型整體感受野,為了彌補,在編碼結(jié)構(gòu)的最后一層添加了2×2 的最大值池化層以及3 個級聯(lián)的殘差塊。

為了抑制跳躍連接時淺層特征圖直接復制到解碼層所包含的噪聲信息,同時在深層獲得更多全局語義信息,本文在跳躍連接處提出了坐標并行注意力模塊,引入了一種密集空洞卷積模塊。兩個模塊在跳躍連接處并行處理特征圖,形成了一種橋結(jié)構(gòu),這種橋結(jié)構(gòu)如同一個關(guān)卡,能有效捕捉高級語義信息同時抑制淺層噪聲。

為了能快速有效地還原高分辨率特征圖直至輸出,抑制由于空洞卷積和反卷積造成的棋盤效應(yīng),本文采用文獻[11]所類似的解碼操作,如圖1右下角所示。采用雙線性插值的方式進行上采樣,并采用兩個3×3 和一個1×1 的卷積壓縮通道數(shù)量,調(diào)整通道之間權(quán)重。

圖1 脈絡(luò)膜分割模型圖Fig.1 Proposed model of choroid segmentation

2 橋結(jié)構(gòu)及損失函數(shù)

2.1 CPA 注意力模塊

注意力機制可有效提高基于卷積神經(jīng)網(wǎng)絡(luò)任務(wù)的性能,能放大感興趣的區(qū)域,忽略其他無用噪聲,讓網(wǎng)絡(luò)模型只關(guān)注對結(jié)果提升有益的部分。文獻[12]提出坐標注意力(Coordinate Attention, CA)模塊能很好地利用一維平均池化的方式聚合特征圖兩個坐標的相關(guān)信息,被證明非常適用于圖像分割領(lǐng)域,但在特征提取上還有改進空間。

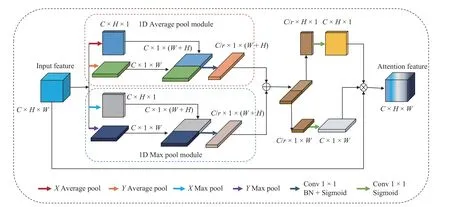

基于CA 模塊,本文提出了CPA 坐標并行注意力模塊,在CA 模塊基礎(chǔ)上融合并行的一維最大值池化操作來提取重要特征信息。平均值池化能關(guān)注顯著性目標的中間區(qū)域,而最大值池化則可以關(guān)注變化明顯的邊緣區(qū)域,對于脈絡(luò)膜這一類圖像邊緣模糊的醫(yī)學組織來說,模型需要在邊緣分配更多的注意力。并行的一維最大值池化不會大幅增加模型的參數(shù)量,卻能提高模型的性能。CPA 注意力模塊的結(jié)構(gòu)如圖2 所示,其中r表示壓縮率,是超參數(shù),它的作用是控制卷積濾波器的參數(shù)量,能靈活控制注意力模塊的大小。

圖2 CPA 注意力模塊Fig.2 CPA attention block

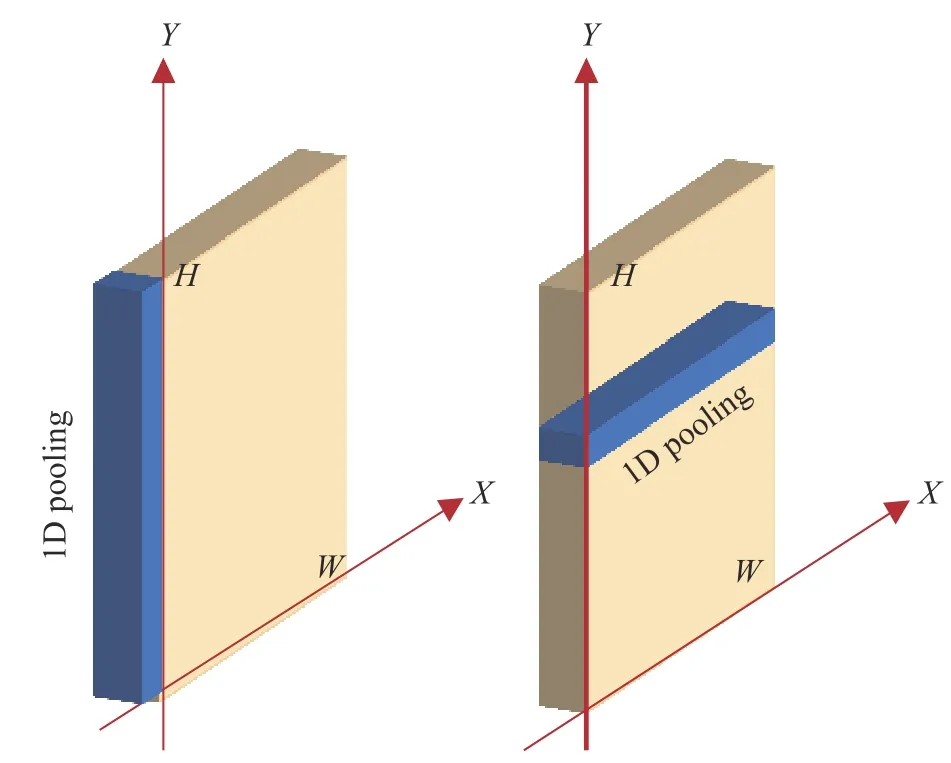

CPA 注意力模塊先對輸入X(X∈RC×H×W,表示特征圖,C、H、W分別表示特征圖的通道數(shù)、高、寬)進行兩個并行的一維池化操作并融合,然后將提取出來的包含坐標注意力的兩個特征向量與原輸入相乘,實現(xiàn)注意力的標定。池化的方式為一維平均池化和一維最大值池化。并行的池化方法又分為兩個方向,分別是沿著X軸方向(即沿著寬度方向)做池化和沿著Y軸方向(即沿著高度方向)做池化。特征圖沿著X、Y軸兩個方向的一維池化示意圖如圖3所示。

圖3 兩個方向的一維池化操作示意圖Fig.3 1D pooling operation in two directions

然后,分別對一維最大值池化和一維平均值池化后得出的特征圖進行轉(zhuǎn)置拼接、1×1 卷積操作、批量歸一化操作(Batch Normalization, BN)、非線性激活操作。轉(zhuǎn)置拼接簡化計算,1×1 卷積操作實現(xiàn)特征信息的通道壓縮和解壓縮。卷積之后經(jīng)過歸一化和非線性激活,可以使模型增加非線性擬合能力。

以一維最大值池化后的特征圖舉例,公式如式(1)所示:

其中:σ 表示sigmoid 激活函數(shù)。Conv1表示1×1 卷積,maxzH和 maxzW表示沿著特征圖高度和寬度方向進行一維最大池化后得出的特征圖,[·;·] 表示轉(zhuǎn)置后沿著空間維度拼接。

接著,沿著空間維度相同位置的元素相加,融合一維最大值池化和一維平均值池化后的特征信息:

式中:Fmax∈R(C/r)×(W+H),F(xiàn)avg∈R(C/r)×(W+H),F(xiàn)∈R(C/r)×(W+H),F(xiàn)avg表示經(jīng)過一維平均池化后的中間特征圖;將融合后的特征圖F沿著空間維度拆成兩個特征向量,F(xiàn)H∈R(C/r)×H,FW∈R(C/r)×W分別表示跟H相關(guān)和W相關(guān),即兩個坐標位置相關(guān)的兩個特征張量。

將生成的兩個特征張量利用1×1 卷積的方式轉(zhuǎn)換成原始通道大小:

最后,將原始特征圖與兩種注意力權(quán)重加權(quán)生成注意力圖,第c通道的注意力重標定輸出特征圖的公式如下:

經(jīng)過CPA 注意力模塊的特征圖,既包含了沿著Y軸方向的空間層次信息,也包含了沿著X軸方向的坐標位置信息。相比于CA 模塊,并行的一維最大值池化模塊提取特征邊緣信息,更能捕獲邊緣模糊情況下有用的特征。

2.2 密集空洞卷積模塊

醫(yī)學上脈絡(luò)膜的下邊界圓滑,但OCT 成像中下邊界模糊區(qū)域比較大,導致視覺上部分邊界缺失。在比較小的感受野下模型無法感受脈絡(luò)膜下邊界的語義特征,因此擴大模型感受野是非常有必要的。目前擴大模型感受野通常采用擴大卷積核或者增加小卷積核的層數(shù)的方法,但這樣會增加模型參數(shù)量,并且導致感受野的范圍比較固定。

空洞卷積[13]的提出是為了在不增加參數(shù)量的情況下擴大模型的感受野。空洞卷積濾波器沿著標準卷積核的空間維度填充0 作為空洞,當空洞卷積的空洞率為1 時,就成為了標準卷積,空洞卷積中等效卷積核的計算公式如式(6)所示:

式中:C表示等效卷積核大小;d表示空洞率;f表示標準卷積濾波器大小。

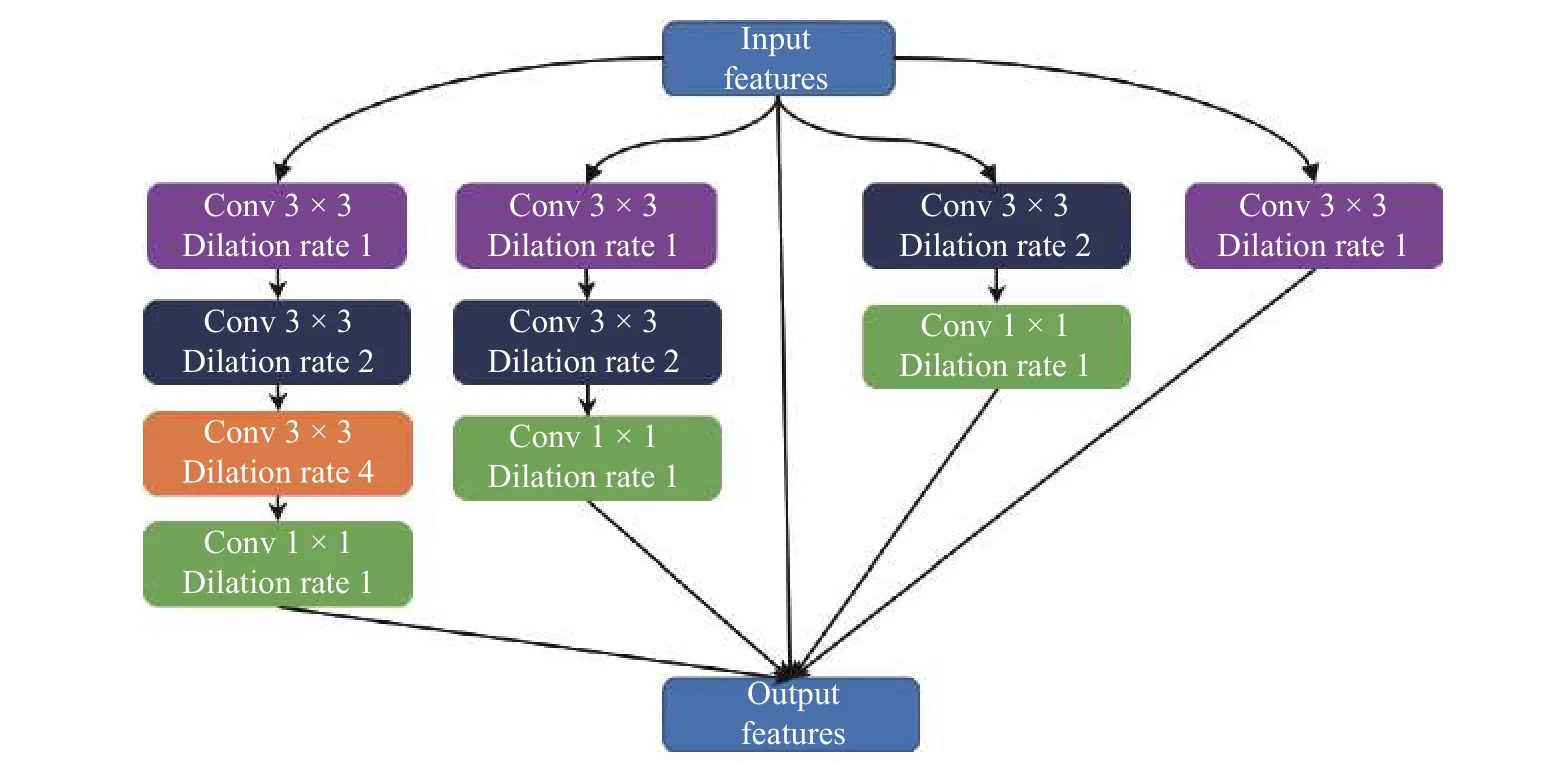

為了靈活擴大模型感受野,在空洞卷積的基礎(chǔ)上,本文引入了DAC[6]。如圖4 所示,DAC 模塊包含4 個分支,靈感來源于Inception 模型[14],每個分支分別從不同的感受野去捕捉特征圖信息,在本文模型深度足夠的情況下,級聯(lián)的空洞卷積分支加寬了本文模型。在每個空洞卷積分支的最后利用1×1 的卷積對特征圖線性激活,最后與原始輸入特征圖相加,該思想來源于ResNet 中的殘差連接,能有效防止梯度爆炸和消失。

圖4 DAC 模塊Fig.4 DAC block

原始的DAC 模塊的空洞率分別是1、1、3、5,每個分支獲得的感受野是3、7、9、19。本文考慮了多個并行的空洞卷積模塊會導致棋盤效應(yīng),采用文獻[15]中的空洞卷積設(shè)置建議,將空洞率調(diào)整為1、1、2、4。在DAC 模塊多個尺度的感受野作用下,能提取脈絡(luò)膜模糊區(qū)域跟其他區(qū)域的上下文依賴。采用padding 填0 的方式,使空洞卷積后的特征圖尺寸不變,經(jīng)過空洞卷積后特征圖的尺寸計算公式如下:

其中:O為輸出特征圖尺寸;n表示輸入特征圖尺寸;p表示填零層數(shù);s表示卷積步長。

2.3 混合損失函數(shù)

本文引入了一種新的混合損失函數(shù)[16]替換常用的二值交叉熵損失函數(shù)。混合損失函數(shù)由3 種損失函數(shù)相加,分別從分割結(jié)果和標簽的像素級相似度、結(jié)構(gòu)級相似度、整體圖形相似度來監(jiān)督訓練模型。整體的loss 函數(shù)計算如式(8)所示:

其中:lbce代表二值交叉熵(Binary Cross Entropy,BCE)損失函數(shù);lssim代表結(jié)構(gòu)相似性(Structural Similarity, SSIM)損失函數(shù);liou代表交并比(Intersection of Union, IoU)損失函數(shù)。

BCE 損失函數(shù)的公式如下:

其中:N表示一張圖里像素的總數(shù)目;yi∈{0,1} 表示原始圖像中的標簽;pi表示像素點的預(yù)測概率。

SSIM 損失函數(shù)的公式如下:

其中:x、y表示從標簽圖和預(yù)測圖中截取的大小為N×N的小μx、塊μy與分別表示x、y的均值與x、y的方差;表σx示yx 和y 的協(xié)方差。ε1、ε2是為了避免分母為0 而設(shè)置的常數(shù)。

IoU 損失函數(shù)公式如下:

其中:y(i,j)∈{0,1} ,表示脈絡(luò)膜的標簽;p(i,j) 表示預(yù)測輸出的概率圖。

實驗中SSIM 損失函數(shù)截取塊設(shè)置的大小為11,常數(shù)設(shè)置為0.000 1,參數(shù)設(shè)置基于文獻[16]的研究。

3 實驗設(shè)置與結(jié)果分析

3.1 數(shù)據(jù)集

本文采用的數(shù)據(jù)集來自上海市第一人民醫(yī)院眼科。OCT 圖像通過設(shè)備Topcon DRI OCT-1 采集得到,每個B-scans 的分辨率大小為992×1 024。數(shù)據(jù)集樣本量一共1 644 張,按照約8∶2 的方式隨機抽取1 392 張樣本用作訓練集,252 張樣本用作測試集,每張樣本的分割金標準是在上海市第一人民醫(yī)院眼科專業(yè)醫(yī)生的嚴格指導下標注完成。

3.2 實驗設(shè)置

實驗使用基于GPU 的Windows10 系統(tǒng)計算機來訓練模型,GPU 顯卡型號為NVIDIA Quadro P4000,顯存為8 GB。本文利用Pytorch 0.4.0 作為開源深度學習框架。由于計算機中顯卡的存儲和計算資源有限,在訓練前,OCT 圖片先經(jīng)過縮小,成為輸入大小為1×248×256 的灰度圖像,再進行網(wǎng)絡(luò)模型訓練和測試。實驗采用Adam 優(yōu)化器訓練,學習率設(shè)為0.001,一階矩估計的指數(shù)衰減率為0.9,二階矩估計的指數(shù)衰減率為0.999。Batch Size 設(shè)為6,一共訓練100 輪。實驗中CPA 注意力模塊中的壓縮率r設(shè)置為8。

3.3 評價指標

實驗采用靈敏度(Sensitivity, Sen)、F1 分數(shù)、Jaccard 相似度(Jaccard Similarity, JS)、Dice 系數(shù)(Dice Coefficient, Dice)作為評價指標,計算公式如下:

實驗對預(yù)測的分割結(jié)果進行了二值化,因為是二分類的圖像分割,將輸出的概率圖中值大于0.5 的設(shè)定為1,其余為0。二值化之后,TP 表示預(yù)測為脈絡(luò)膜區(qū)域,實際也是脈絡(luò)膜區(qū)域;FN 表示預(yù)測為背景區(qū)域,實際上是脈絡(luò)膜區(qū)域;FP 表示預(yù)測為脈絡(luò)膜區(qū)域,實際上是背景區(qū)域。SR 表示分割后的結(jié)果,GT 表示輸入標簽。

3.4 實驗設(shè)計與結(jié)果分析

本文方法的有效性通過以下幾個方面的對比來驗證:CPA 對比CA 的實驗;本文模型的各個模塊消融實驗;3 種損失函數(shù)組合下的消融實驗;不同模型的對比實驗。

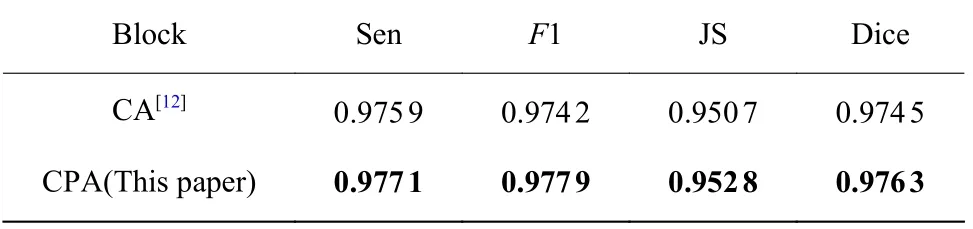

本文改進的CPA 注意力模塊相較于CA 注意力模塊,融合了并行一維最大池化后的注意力信息,為了證明并行一維最大池化操作的有效性,本文進行了CPA 模塊和CA 模塊的對比實驗,實驗中的其他部分保持不變。在測試集上進行了驗證,實驗結(jié)果如表1 所示,證明了本文提出的并行一維最大值池化操作對分割性能有較大提升,以及坐標并行注意力機制在脈絡(luò)膜分割任務(wù)中的有效性。

表1 CPA 模塊和CA 模塊對比Table 1 Comparison of CPA block and CA block

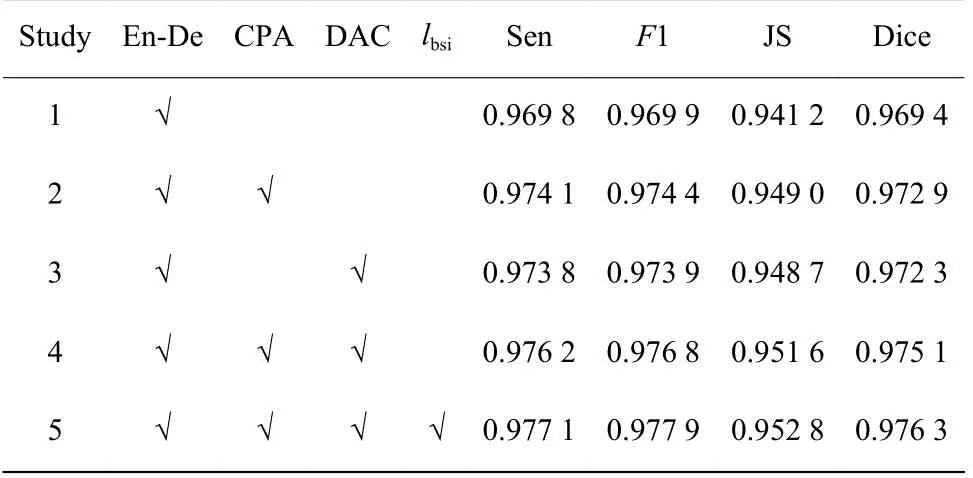

為了充分了解各模塊的有效性,本文將去除橋結(jié)構(gòu)以后的主干編解碼結(jié)構(gòu)(En-De)作為基線模型,對CPA 模塊和DAC 模塊以及混合損失函數(shù)lbsi進行消融實驗,對于沒有使用混合損失函數(shù)的消融實驗部分采用二值交叉熵損失函數(shù)訓練模型。實驗結(jié)果如表2 所示。從表2 可以看出,分別加入CPA 模塊和DAC 模塊對模型性能提升顯著,CPA 模塊相比于DAC 模塊對模型提升要大一點。但兩者同時加入相比單獨加入時對模型提升最大。CPA 模塊抑制淺層特征中的噪聲信息,DAC 模塊輔助提取深層語義信息,并且在訓練過程中引入注意力機制對空洞卷積的參數(shù)形成了監(jiān)督,有利于模型在多感受野上的特征提取。雖然模型采用混合損失函數(shù)的貢獻比不上CPA 模塊和DAC 模塊,但是也在精細化分割和脈絡(luò)膜結(jié)構(gòu)保持上對模型訓練形成了促進作用。

表2 模塊消融實驗結(jié)果對比Table 2 Comparison of ablation study by block

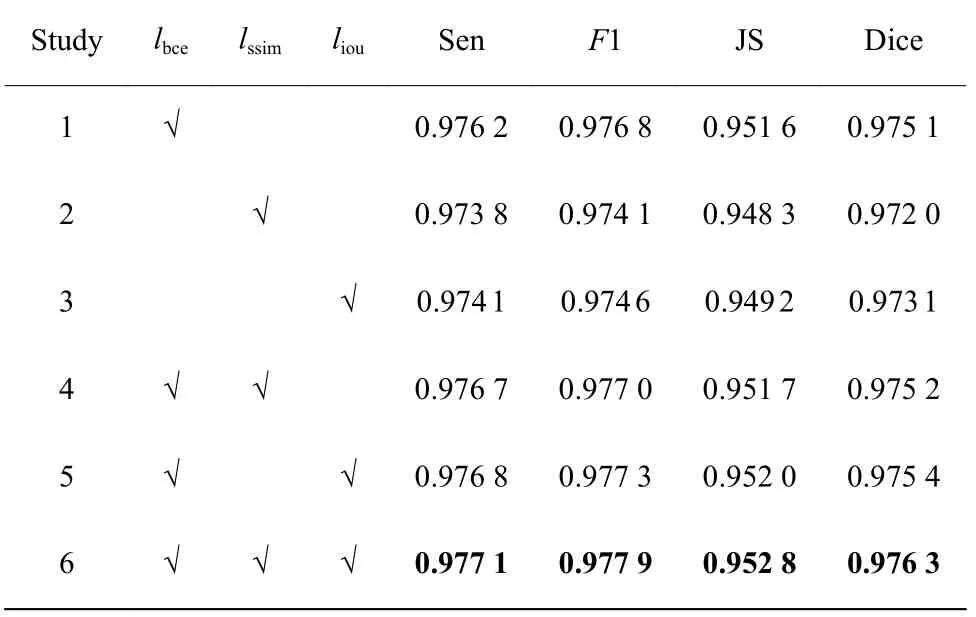

為了證明本文引入的損失函數(shù)組合在脈絡(luò)膜分割任務(wù)上的有效性,本文分析了3 種損失函數(shù)不同組合下對實驗結(jié)果的影響,損失函數(shù)的消融實驗結(jié)果對比如表3 所示。

表3 結(jié)果表明可以單獨使用BCE 損失函數(shù)的性能比單獨使用另外兩種損失函數(shù)時的性能要好,這是傳統(tǒng)BCE 損失函數(shù)在密集像素分類任務(wù)的優(yōu)勢,但如果再結(jié)合SSIM 損失函數(shù)以及IoU 損失函數(shù),模型將進一步優(yōu)化,說明混合損失函數(shù)能較好地提高模型性能。

表3 損失函數(shù)消融實驗結(jié)果對比Table 3 Comparison of ablation study by loss

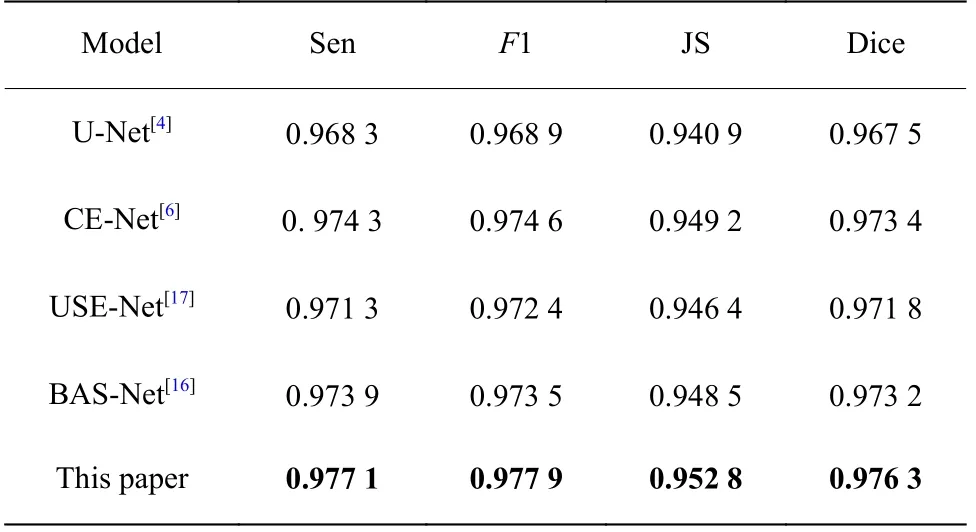

本文還對比了其他論文中出現(xiàn)的網(wǎng)絡(luò)模型,包括U-Net、CE-Net、BAS-Net[16],USE-Net[17],其中CENet 在U-Net 基礎(chǔ)上提出密集空洞卷積塊和殘差多核池化模塊來捕獲多尺度、多感受野信息。USE-Net在UNet 的跳躍連接處引入了SE 注意力模塊[18]。BAS-Net 在編解碼后增加殘差細化模塊并利用混合損失函數(shù)進行訓練。不同模型的實驗結(jié)果對比如表4 所示。

表4 不同模型結(jié)果對比Table 4 Comparison of different model results

表4 結(jié)果表明,本文提出的脈絡(luò)膜分割模型在JS 相似度上達到了0.952 8,Dice 系數(shù)達到了0.976 3,相比于CE-Net 分別提升了0.0036 和0.0029;同樣地,在靈敏度和F1 分數(shù)方面,本文模型也均高于其他模型,證明了本文模型的有效性。

選擇了不同模型的4 種具有代表性的OCT 脈絡(luò)膜圖像來對比分割效果,如圖5 所示,從上到下分別是正常的脈絡(luò)膜圖像、邊界模糊的脈絡(luò)膜圖像、成像包含大量噪聲的圖像以及脈絡(luò)膜結(jié)構(gòu)不完整的圖像。可以看出U-Net 表現(xiàn)最差,因為其編解碼碼結(jié)構(gòu)簡單,且跳躍連接引入了淺層語義信息中的無關(guān)噪聲信息,所以對包含有噪聲的輸入圖像的處理能力是最弱的;USE-Net 雖然引入注意力機制,但是對于下邊界模糊情形處理不佳;CE-Net 和BAS-Net 表現(xiàn)稍好,但整體分割出的脈絡(luò)膜的結(jié)構(gòu)還不是最好,邊緣不夠圓滑,而且偶爾有預(yù)測出離群點的情況出現(xiàn)。總體而言,本文提出的方法脈絡(luò)膜邊界清晰圓滑、整體結(jié)構(gòu)最接近金標準。

圖5 分割效果對比Fig.5 Comparison of segmentation results

4 結(jié)束語

針對U-Net 類型網(wǎng)絡(luò)分割脈絡(luò)膜時提取高級特征不足,在跳躍連接不加處理時導致引入噪聲,感受野不夠大的問題,本文提出了一種新的端到端的脈絡(luò)膜分割模型。該模型基于ResNet-34 作為主干網(wǎng)絡(luò)進行特征編碼,能有效防止模型出現(xiàn)梯度消失。本文設(shè)計了一種橋結(jié)構(gòu),包含兩個模塊,分別是坐標并行注意力模塊和密集空洞卷積模塊。特征在淺層經(jīng)過編碼后輸入到坐標并行模塊,提取有效信息,抑制噪聲,特征在深層經(jīng)過編碼后,經(jīng)過密集空洞卷積模塊提取多尺度的感受野信息,然后在解碼層通過跳躍連接的方式進行融合。在模型訓練時,采用混合損失函數(shù),提高模型對醫(yī)學組織結(jié)構(gòu)的關(guān)注度,通過這些方式解決脈絡(luò)膜分割難點問題。實驗結(jié)果表明,本文提出的方法相較于現(xiàn)有的幾種常見分割方法表現(xiàn)更好,表明了本文方法的有效性。但本文提出的模型只在OCT 脈絡(luò)膜分割應(yīng)用上得到驗證,本文的后續(xù)工作重點是提高模型的泛化能力,對其他的OCT 圖像也能進行同構(gòu)遷移學習訓練。