基于改進YOLOv5的試劑卡印刷缺陷檢測算法

劉國慶,方成剛,黃德軍,龍超

基于改進YOLOv5的試劑卡印刷缺陷檢測算法

劉國慶1,方成剛1*,黃德軍2,龍超1

(1.南京工業(yè)大學 機械與動力工程學院,南京 211800;2.南京紫城工程設計有限公司,南京 211800)

針對試劑卡生產企業(yè)采用人工分選印刷缺陷的試劑卡存在效率低、成本高、易漏檢的問題,提出一種基于深度神經(jīng)網(wǎng)絡YOLOv5s的改進試劑卡印刷缺陷檢測算法YOLOv5s-EF。通過圖像預處理算法獲得高質量的缺陷圖像數(shù)據(jù)集,在YOLOv5s的主干特征提取網(wǎng)絡中添加高效通道注意力(Efficient Channel Attention, ECA)機制,增強特征圖中重要特征的表示能力;引入焦點損失函數(shù)(Focal Loss)來緩解正負樣本不均衡的影響;結合印刷區(qū)域的定位結果,二次精確定位并構建方位特征向量,提出一種特征向量相似度匹配方法。實驗結果表明,本文提出的試劑卡印刷缺陷檢測算法在測試集上的檢測平均準確度可以達到97.3%,速度為22.6幀/s。相較于其他網(wǎng)絡模型,本文提出的方法可以實現(xiàn)對多種印刷缺陷的識別與定位,模型具有較好的檢測速度和魯棒性,有利于提高企業(yè)生產的智能化水平。

缺陷檢測;YOLOv5s;深度學習;高效通道注意力機制;焦點損失函數(shù)

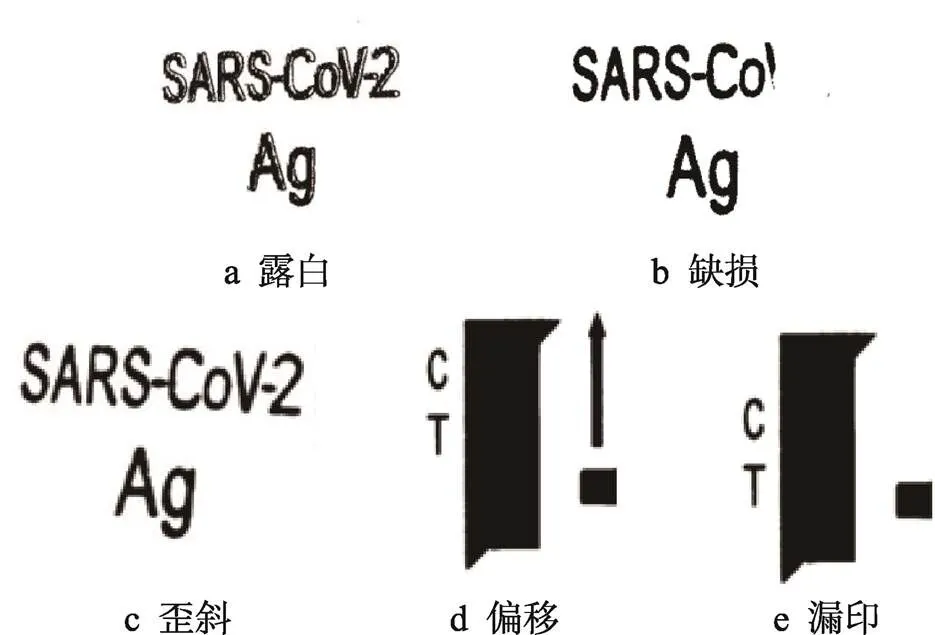

檢測試劑卡是一種醫(yī)療產品,因其操作簡單,非專業(yè)醫(yī)療技術人員也能輕松掌握,同時可為患者提供快速的檢測服務,得到了廣泛應用。檢測試劑卡可分為上蓋、底蓋、試劑條三部分。盡管在生產過程中有完整成熟的工藝流程,且有專業(yè)技術人員進行把控,但在大批量生產時由于現(xiàn)有工藝的限制,印刷標志仍可能會出現(xiàn)露白、缺損、漏印、偏移、歪斜等缺陷,進而影響試劑卡的正常使用,甚至造成檢測結果錯誤等嚴重影響。

基于機器視覺的缺陷檢測方法因穩(wěn)定性高、不受人為因素干擾等優(yōu)點被廣泛應用于印刷缺陷檢測領域。常用的圖像缺陷檢測算法主要有圖像差分法、歸一化互相關系數(shù)法、直方圖分析法[1]。但這些方法對灰度變化、旋轉、形變以及遮擋等影響因素比較敏感,且不易對缺陷直接定位,具有一定的局限性。很多學者因此提出了不同的方法,胡方尚等[2]將二叉決策樹與向量支持機相結合,采用改進的多類分類算法實現(xiàn)印刷缺陷的準確識別,但其對檢測精度要求高,對難分割的缺陷檢出率較低。馮秋歌等[3]通過提取SIFT特征點,并設計濾波算子的方法,對印刷字符出現(xiàn)的漏印、字符缺失、污漬進行檢測,但算法魯棒性較差,無法識別更加復雜的缺陷。

近年來,由于計算機硬件技術的不斷發(fā)展,使得深度學習等神經(jīng)網(wǎng)絡技術在圖像處理、目標檢測領域有了迅速的發(fā)展,基于深度學習的圖像識別已經(jīng)廣泛應用于缺陷檢測等領域。以區(qū)域卷積神經(jīng)網(wǎng)絡(Regions with CNN Features,R-CNN)[4]、Fast R-CNN、Faster R-CNN等算法為代表的兩階段算法(Two-Stage)),以YOLO(You Only Look Once)系列[5-7]、單激發(fā)多盒檢測器(Single-Shot MultiBox Detector SSD)、RetinaNet等算法為代表的單階段算法(One-Stage)在缺陷檢測領域都得到了廣泛應用。

周瑋等[8]利用濾波抑噪等方法對采集圖像進行預處理,結合YOLOv3與AlexNet網(wǎng)絡實現(xiàn)了對包裝袋字符噴碼缺陷的定位與識別,但模型復雜計算量較大。Feng等[9]將可見光圖像分割與紅外圖像故障定位相結合,使用YOLOv5與殘差神經(jīng)網(wǎng)絡(ResNet)實現(xiàn)了對大型光伏電站中光伏組件缺陷的快速檢測,準確率達到95%。王恩芝等[10]在YOLOv5的主干網(wǎng)絡上添加卷積注意力模塊,并結合自適應空間特征融合的方法增強網(wǎng)絡的特征融合能力,在紡織品表面的缺陷檢測中達到98.8%的精度。但該算法嚴重依賴大量有明顯差異的樣本,對樣本集較少的情況,其魯棒性較差。

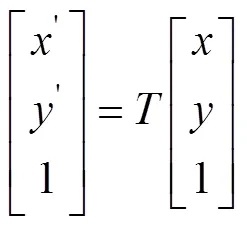

本文研究的試劑卡缺陷可分為形狀缺陷和位置缺陷。露白、缺損、漏印等形狀缺陷由改進的YOLOv5s網(wǎng)絡直接檢出,網(wǎng)絡輸出結果結合后續(xù)圖像處理算法對偏移、歪斜等位置缺陷進行檢測。試劑卡的露白缺陷特征細小而隱蔽,且容易受到光照變化的影響而與正常圖像混淆。樣本數(shù)量少導致的數(shù)據(jù)樣本不均衡等原因使得原始YOLOv5算法對露白缺陷檢出率不高,精度以及速度無法達到現(xiàn)代化生產線的檢測要求。為了解決上述問題,本文提出一種針對試劑卡印刷缺陷的檢測算法,在YOLOv5s中引入Focal Loss損失函數(shù),并嵌入ECA機制使得網(wǎng)絡更加關注缺陷目標的特征,進一步加速收斂并提升性能。針對YOLO系列目標檢測算法無法識別目標位置和角度偏移的問題,設計一種可以對試劑卡的形狀與位置缺陷進行檢測的算法。

1 預處理

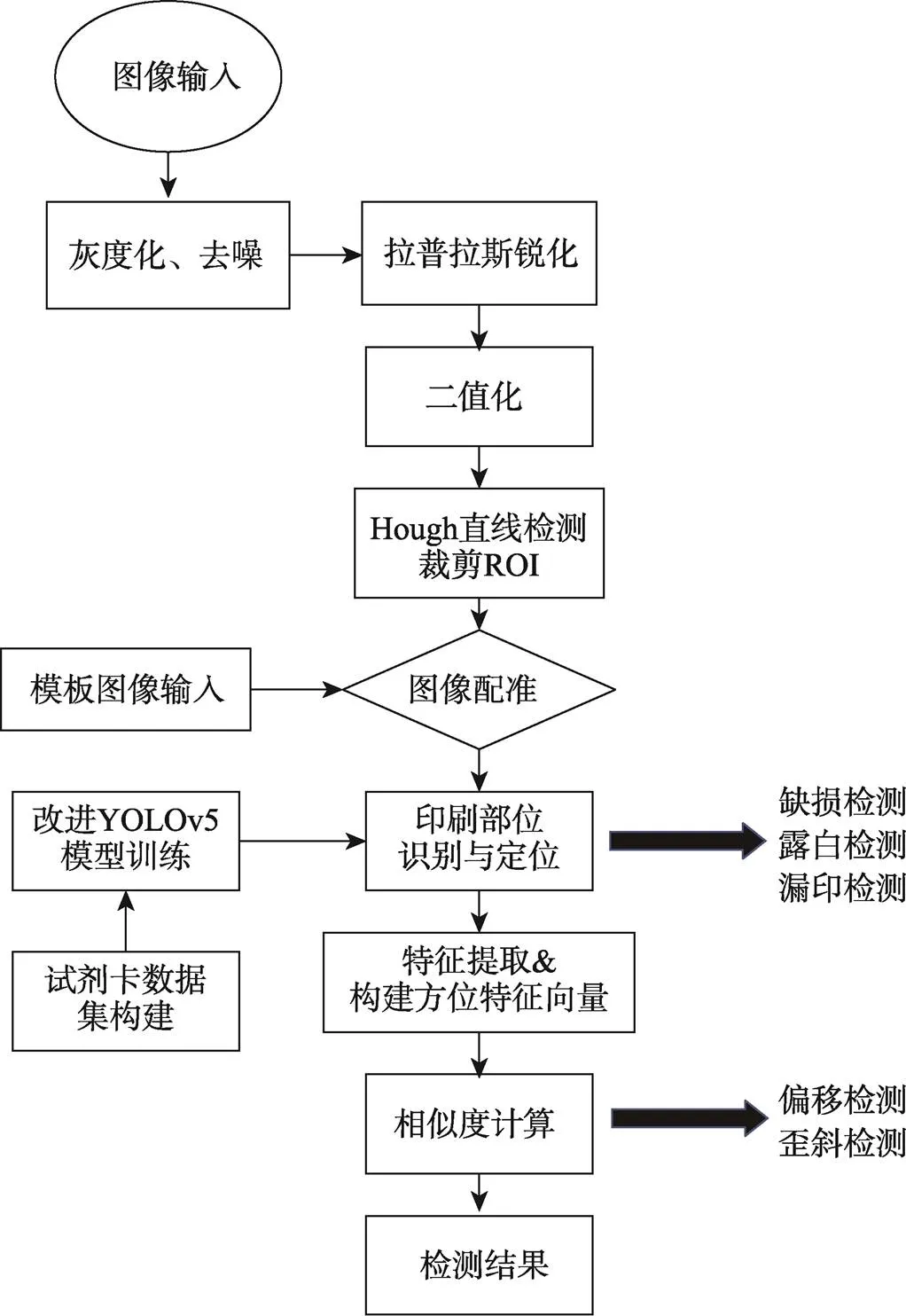

本文算法流程如圖1所示,由工業(yè)相機采集試劑卡圖像后需要經(jīng)過預處理,以增強目標特征。在與模板圖像配準后制作缺陷數(shù)據(jù)集訓練改進的YOLOv5s網(wǎng)絡模型,通過該模型對缺損、露白、漏印3種缺陷進行識別,同時輸出印刷區(qū)域坐標信息。利用圖像處理算法精確定位印刷字符的位置,并構建方位特征向量,通過相似度計算判定是否有偏移和歪斜缺陷,從而實現(xiàn)對試劑卡常見缺陷的快速檢測。

圖1 本文算法流程

1.1 圖像增強

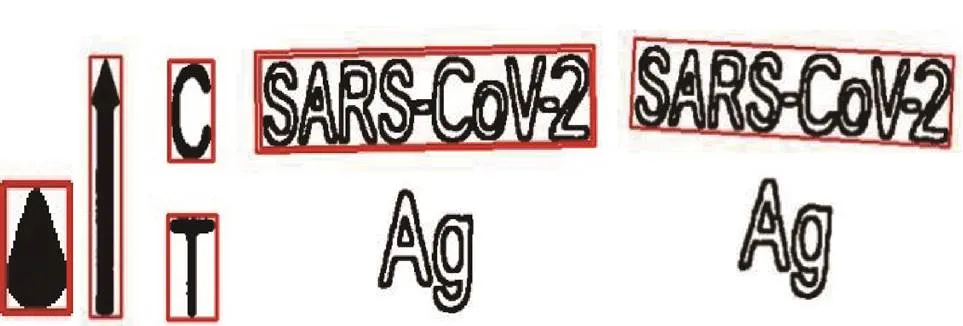

工業(yè)相機直接采集的圖像由于工廠環(huán)境復雜、光照變化大等因素易引起噪聲和圖像模糊。為了使露白缺陷更易被檢出,需要對圖像進行增強處理突出缺陷特征。首先選擇中值濾波的方法去除噪聲的干擾。然后進行圖像銳化以突出灰度的過渡部分,增強圖像邊緣信息提高對比度。對圖像采用二值化處理方法,考慮到光照變化,因此選用最大類間方差法(OTSU)。未經(jīng)拉普拉斯銳化的露白特征明顯少于銳化后的圖像,最后通過Hough直線檢測進行傾斜校正,并提取試劑卡ROI。各類試劑卡缺陷部分圖像具體如圖2所示。

圖2 試劑卡缺陷分類示意圖

1.2 圖像配準

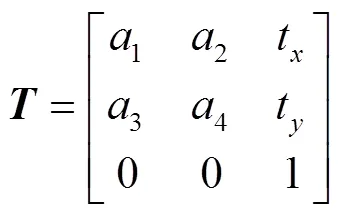

在試劑卡圖像的實際采集過程中,由于攝像機的機械振動、傳感器噪聲等因素,導致獲取的圖像與標準模板存在一定差異[11]。為了降低這種差異,避免對后續(xù)方位特征向量的提取造成不良影響,有必要將待檢測圖像與標準模板進行圖像配準。

配準過程中首先使用ORB(Oriented FAST and Rotated BRIEF)算法提取2幅圖像的特征點,保留最匹配的特征點并計算描述子。然后通過漢明距離(Hamming Distance)度量2個特征點描述子的相似度。最后通過暴力匹配法(Brute Force)篩選漢明距離滿足要求的特征點,建立匹配特征對。采用隨機抽樣一致(Random Sample Consensus,RANSAC)算法剔除誤匹配點對,優(yōu)化后的特征點對如圖3a所示。選擇3對最優(yōu)匹配的特征點計算校正待測圖像的單應性矩陣。

通過式(2)進行仿射變換,將待檢測圖像變換到標準圖像的坐標系上實現(xiàn)圖像的配準。配準前后圖像如圖3b、c所示。

圖3 配準結果

Fig.3 Registration results

2 改進YOLOv5算法

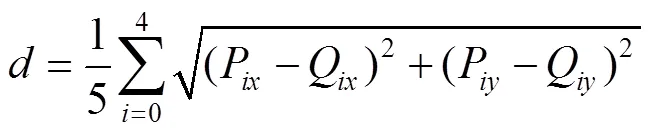

2.1 網(wǎng)絡結構

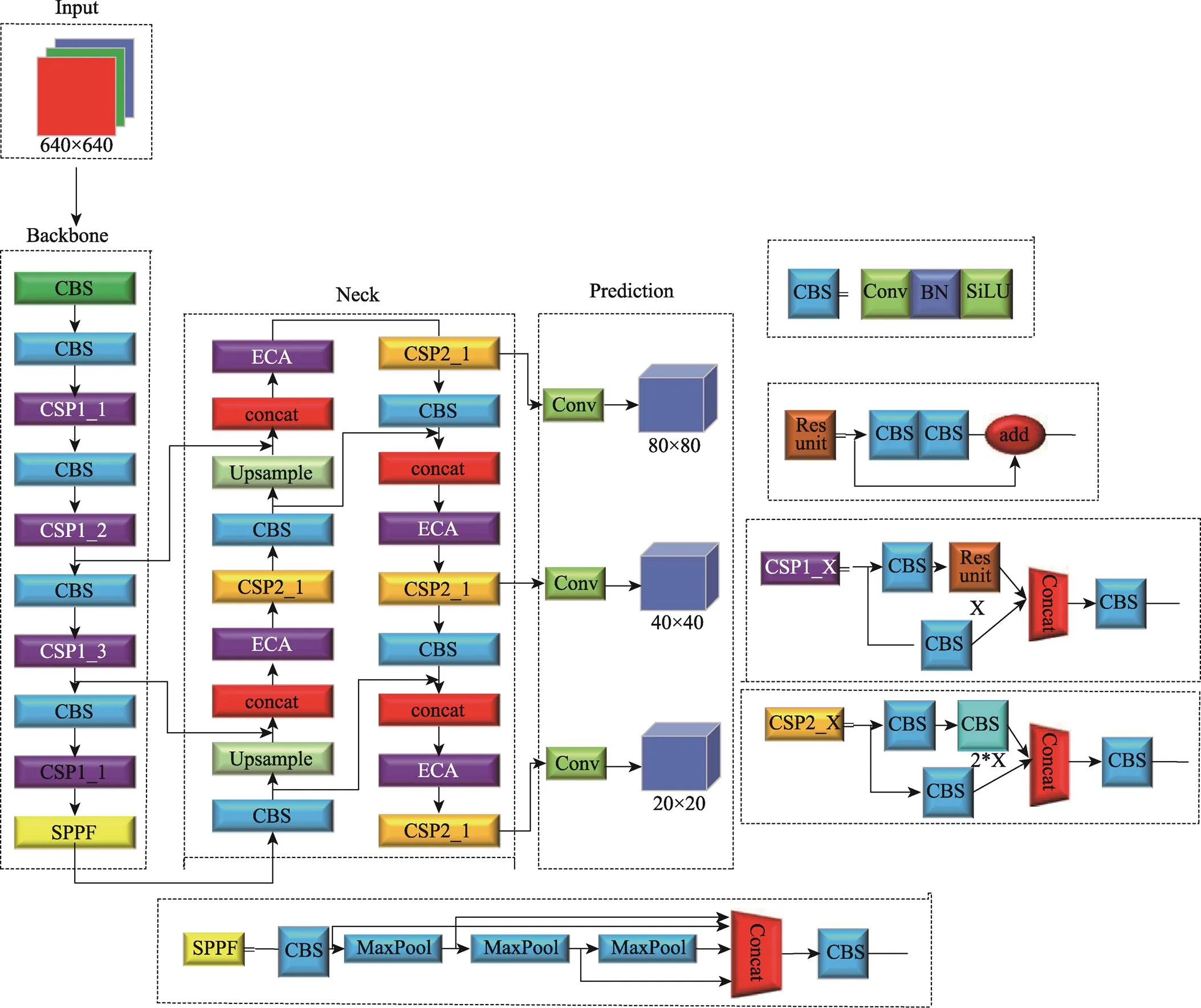

YOLO(You Only Look Once)系列算法的核心思想是將目標的邊界框、置信度和類別視為數(shù)值回歸的問題。YOLOv5算法的網(wǎng)絡結構包括輸入、Backbone主干網(wǎng)絡、Neck網(wǎng)絡和Head預測頭部[12]。本文擬提出一種實現(xiàn)模型輕量化的設計方法,在保證檢測精度的同時,盡可能減少模型大小和計算量,因此選擇YOLOv5s進行改進。Backbone主干網(wǎng)絡將原先使用的Focus模塊替換為6×6大小的卷積層,在得到同等大小下采樣特征圖的同時降低了浮點運算量。采用SPPF模塊代替原先的空間金字塔池化(Spatial Pyramid Pooling,SPP),將并行的最大池化層改為串行,縮小了卷積核的大小,顯著提高了運行速度。結合跨階段局部網(wǎng)絡(Cross Stage Partial Network,CSPNet),從同一個特征圖中提取不同尺度的特征,提高檢測精度。隨后的特征金字塔網(wǎng)絡(feature Pyramid Network,F(xiàn)PN)將高層特征通過下采樣的方式向下傳遞,路徑聚合網(wǎng)絡(Path Aggregation Network,PAN)將低層特征向上傳遞,兩者特征在傳遞過程中不斷融合,從而增強網(wǎng)絡的特征提取能力[13]。Head預測頭部輸出預測邊界框,并使用非極大值抑制(Non-Maximum Suppression,NMS)去除冗余框,得到最終檢測目標的邊界框。

2.2 改進損失函數(shù)

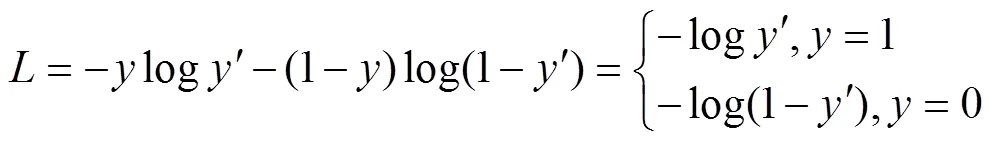

YOLOv5s的損失函數(shù)由置信度損失(Confidence Loss,obj)、分類損失(Classification Loss,cls)和邊框回歸損失(Bounding Box Regression Loss,box)三部分組成。使用二元交叉熵作為置信度和分類的損失函數(shù)[14],交叉熵損失定義如下:

式中:為交叉熵損失,正樣本時=1,負樣本時=0;為激活函數(shù)的輸出,0<<1。

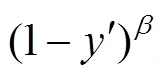

YOLOv5s在進行目標檢測時會生成大量的先驗框,但只有少數(shù)區(qū)域包含檢測目標,這些大量產生在圖片背景區(qū)域的先驗框會導致正負樣本不均勻。在交叉熵損失計算中,每個訓練樣本的權重是相等的,大量負樣本會提高網(wǎng)絡計算量并使檢測精度下降。為此本文引入焦點損失函數(shù)(Focal Loss)代替置信度損失,通過降低易分類樣本的權重,使模型更專注于困難樣本[15],F(xiàn)ocal Loss的計算見式(4)。

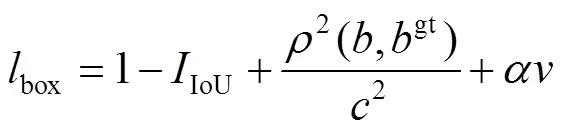

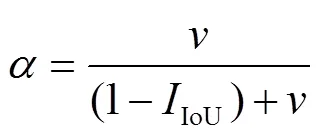

本文選擇CIoU_Loss[16]作為邊框回歸損失,綜合考慮了預測框與真實框之間的重疊率、中心點距離、長寬比,加速了網(wǎng)絡的收斂,并得到更高的回歸定位精度,有效提高了缺陷目標在遮擋情況下的檢出率。其公式如下:

2.3 ECA注意力機制

通道注意力更加注重各個通道的相關性對網(wǎng)絡的影響,并可在網(wǎng)絡訓練的不斷迭代中獲得不同通道的權重系數(shù),從而提高目標特征的權重。SE(Squeeze-Excitation)模塊[17]是一種常用的通道注意力機制,但其先降維再升維的操作不利于捕獲不同通道之間的關系,且結構復雜帶來較重的計算負擔。Wang等[18]在改進SE模塊的基礎上提出了ECA(Efficient Channel Attention)模塊,其核心思想是不降維的局部跨通道交互策略以及自適應確定一維卷積核的大小,降低復雜度的同時帶來性能的提升。

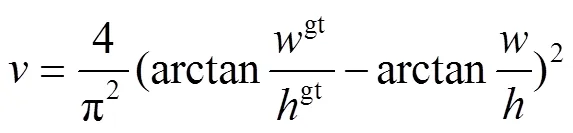

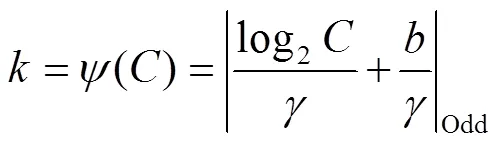

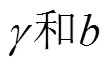

ECA模塊首先對輸入特征圖進行全局平均池化(Global Average Pooling, GAP),獲得未降維的特征;再通過大小為的一維卷積核獲取跨通道交互信息;最后使用sigmoid函數(shù)生成各通道的權重占比,將原始輸入特征與通道權重結合從而加強露白、缺損的特征,其結構如圖4所示。ECA模塊用一維卷積操作代替全連接層,避免了對特征通道的壓縮,卷積核的大小代表了局部跨通道交互的覆蓋率,根據(jù)網(wǎng)絡結構的變化自適應改變,如式(8)所示。

本文將ECA模塊嵌入PAN結構中的concat之后,對融合后的不同尺度特征圖進行重要特征的加強,以獲得更高的缺陷目標檢出率。改進后的YOLOv5s-EF算法框架如圖5所示。

圖5 改進的YOLOv5s網(wǎng)絡結構

3 印刷缺陷識別

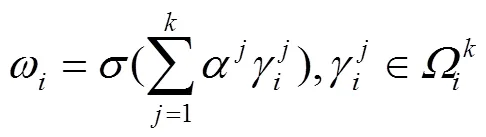

3.1 特征提取與構建特征向量

待檢測圖像在送入YOLOv5s-EF網(wǎng)絡之前已進行配準校正。由于網(wǎng)絡輸出的印刷區(qū)域定位框是一個只能表示大致位置的水平矩形,無法檢出位置缺陷。所以需要在定位框的基礎上進行二次精準定位,并提取方位特征向量,將其與標準模板進行相似度判定,從而判斷是否存在偏移和歪斜缺陷。具體流程如下:

1)印刷區(qū)域定位框裁剪。根據(jù)YOLOv5s-EF給出的定位框位置信息,對圖像相應位置進行裁剪。

2)二次精確定位。對于連通域完整的水滴和箭頭標志圖像塊,用Canny算子提取輪廓邊緣,檢測到輪廓后使用cv.minAreaRect函數(shù)獲得連通域的最小外接矩形,從而實現(xiàn)精確定位。對于2塊字符彼此獨立的區(qū)域,則采用形態(tài)學梯度運算中的基本梯度并進行膨脹處理,最后計算最小外接矩形。二次定位的結果如圖6所示。

圖6 二次定位結果

3.2 缺陷檢測

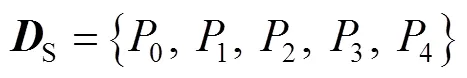

待檢測圖像的露白、缺損、漏印缺陷可由YOLOv5s-EF網(wǎng)絡直接檢出,偏移、歪斜缺陷可以在提取印刷區(qū)域方位特征向量后,將其與標準模板的方位向量進行比較,判斷的具體方法如下。

1)偏移缺陷。計算最小外接矩形4個頂點和中心點與標準模板中對應點的平均距離。如果平均距離超過閾值,則認為存在偏移缺陷。計算式見式(10)。

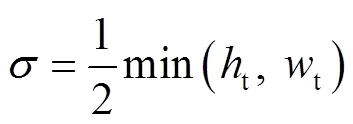

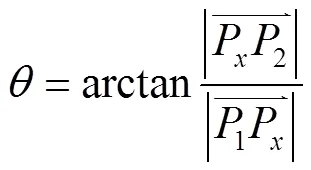

式中:P、P為待測圖像上印刷區(qū)域方位特征向量點的橫縱坐標;Q、Q為標準模板圖像上相應點的坐標;t、t為最小外接矩形的高和寬。

式中:1、2、P的坐標分別為(1,1)、(2,2)、(2,1)。

4 實驗與結果分析

4.1 實驗平臺

本文采用自制試劑卡缺陷數(shù)據(jù)集進行訓練,搭建OpenCV深度學習平臺,處理器為AMD Ryzen 7 5800H,32 G運行內存,顯卡為NVIDIA GEFORCE RTX3060。試劑卡缺陷檢測模型在PyTorch框架下構建,開發(fā)環(huán)境為python 3.8,opencv版本為4.5.1.48。

4.2 數(shù)據(jù)集與模型訓練

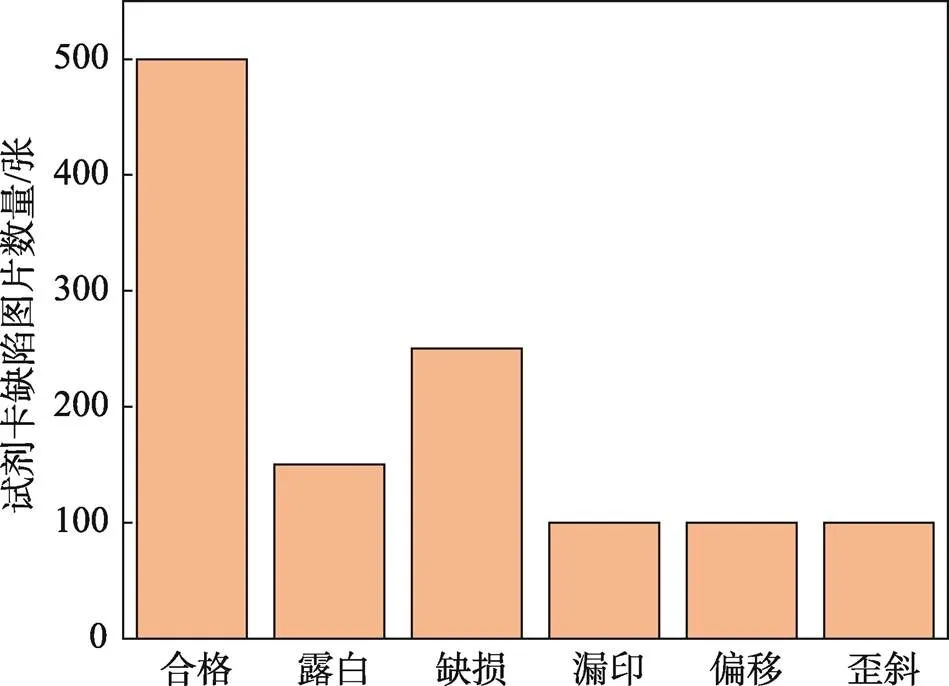

本文數(shù)據(jù)集來自現(xiàn)場拍攝,選用西安維視公司生產的MV-EM510M/C型CCD相機,最高分辨率為2 456×2 058。采集包括無缺陷、字符露白、缺損,印刷偏移、歪斜、漏印等5種常見的缺陷圖像共1 200張,各類試劑卡缺陷種類的數(shù)量分布如圖7所示。針對數(shù)據(jù)量不足的問題,采用平移、旋轉、對比度調節(jié)等方法對數(shù)據(jù)集進行擴充[19],擴充后的數(shù)據(jù)集共有4 800張圖像,將其按照6∶2∶2的比例劃分為訓練集、驗證集、測試集進行模型訓練。輸入圖像大小為640×640,訓練中優(yōu)化器使用隨機梯度下降,訓練批次為32,動量為0.937,權重衰減系數(shù)為0.000 5。初始學習率為0.01,并采用Warm-up的方法預熱,最后采用余弦退火算法更新學習率,訓練迭代次數(shù)為200。

圖7 數(shù)據(jù)集種類及其數(shù)量分布

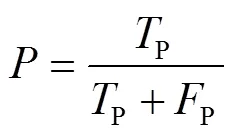

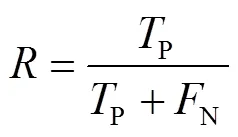

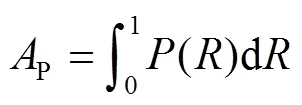

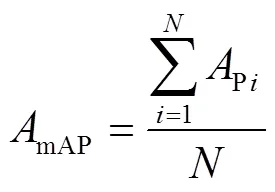

4.3 評價指標

為了驗證YOLOv5s-EF的性能,本文采用深度學習常用評價指標,如平均精度(Average Precision,P)、平均精度均值(mean Average Precision,mAP)和檢測速度等。P指P-R曲線的面積,mAP的值則是通過所有類別的P求均值得到,計算方法如式(15)、(16)所示[20]。

4.4 實驗結果

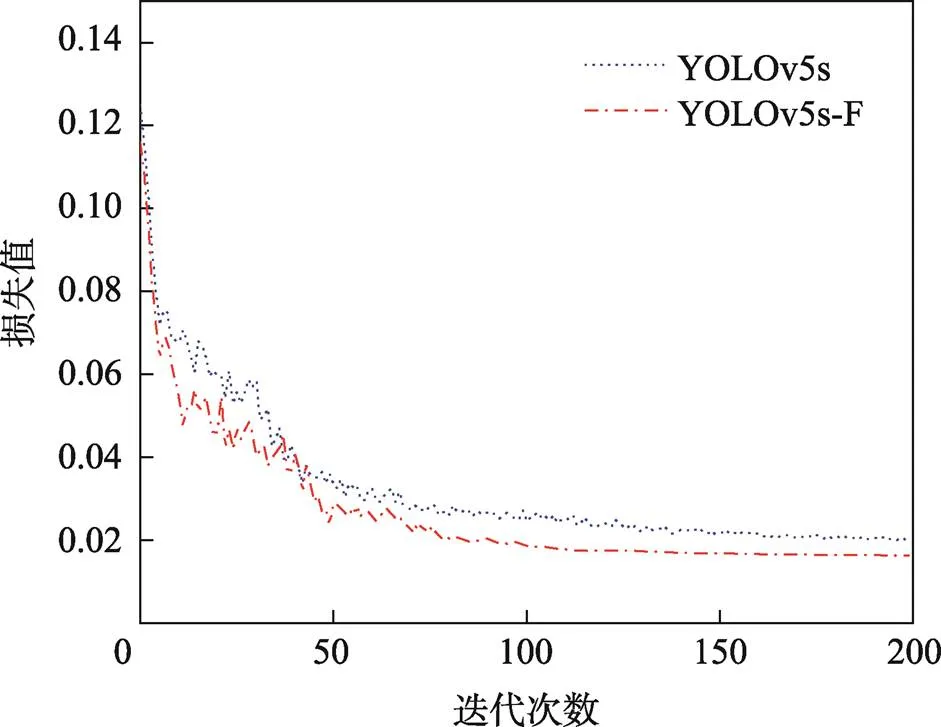

為了驗證在損失函數(shù)中引入Focal Loss能否加速網(wǎng)絡的收斂,使用改進前后的網(wǎng)絡在相同數(shù)據(jù)集上進行訓練。訓練過程中損失變化如圖8所示,其中點線為原始YOLOv5s的損失,虛線為引入Focal Loss后的損失變化情況。由圖8可以看出,前50輪損失值下降較快,隨后逐漸趨于平緩;在引入焦損函數(shù)代替置信度和分類損失后,在各輪都獲得了更低的損失值,同時相較原始模型更快收斂,最終損失值穩(wěn)定在0.016左右,訓練過程均未出現(xiàn)過擬合現(xiàn)象。

圖8 改進前后損失曲線

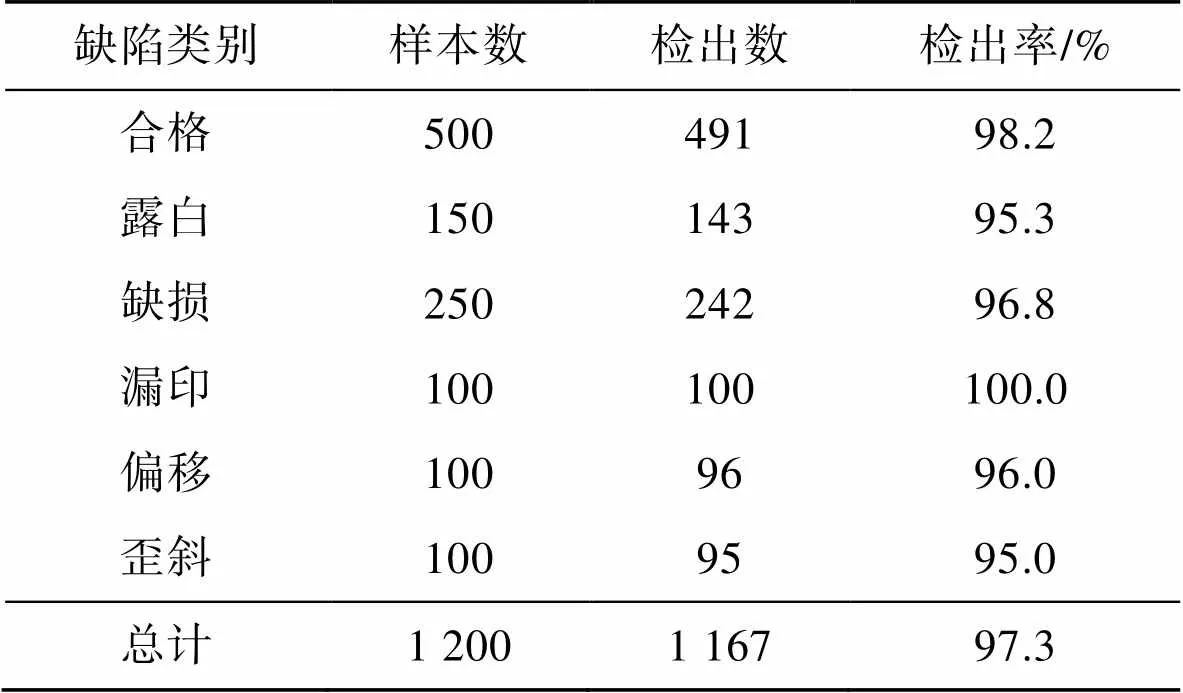

為了驗證本文提出的試劑卡缺陷檢測算法的性能,對原始數(shù)據(jù)集中的1 200張圖像進行重復實驗,并統(tǒng)計各類缺陷的檢出率,如表1所示。

表1 本文算法對各類缺陷檢測性能統(tǒng)計

Tab.1 Performance statistics of various defects detected by the present algorithm

由表1可以看出,本文算法在測試集上的總檢出率可以達到97.3%,各類缺陷的檢出率均可達到96%以上,表現(xiàn)出較好的穩(wěn)定性,可以滿足當前對試劑卡印刷缺陷的檢測要求。YOLOv5s-EF網(wǎng)絡結合位置缺陷檢測算法完整檢測一張圖片的速度平均值為22.6幀/s,滿足實時性要求。

圖9為YOLOv5s-EF在測試集上的缺陷檢測結果。由圖9可以看出,模型對各印刷區(qū)域的檢測效果較好,其中露白(Loubai)和缺損(Defect)缺陷的置信度均超過0.9。對露白特征較少的缺陷也能精準的識別,可見ECA注意力機制的添加有效增強了模型對缺陷細小特征的提取能力,以及與正常字符的區(qū)分能力。

圖9 改進YOLOv5s實驗結果

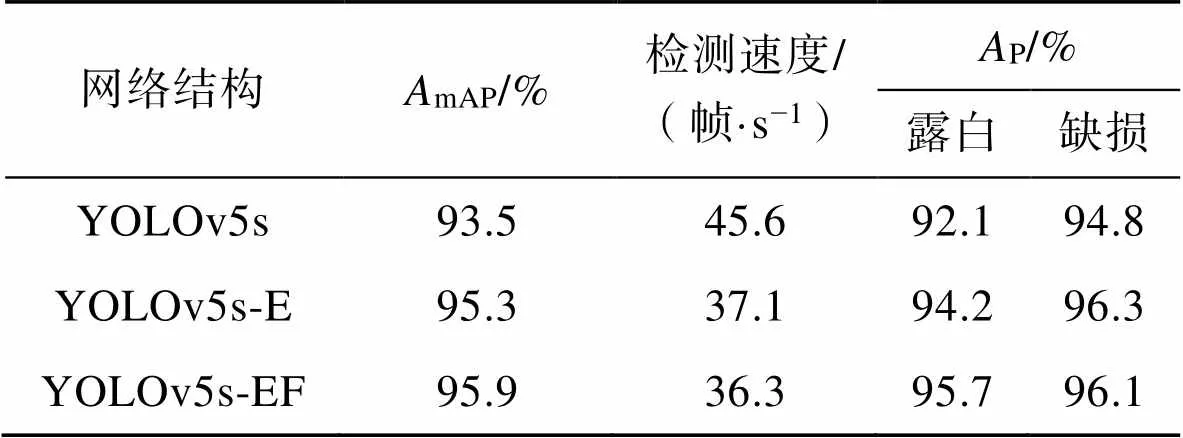

4.5 實驗對比分析

為驗證添加注意力機制和引入Focal Loss損失函數(shù)對檢測結果的影響,本文在實驗中設置原始網(wǎng)絡結構+交叉熵損失函數(shù)(YOLOv5s)、添加ECA注意力機制+交叉熵損失函數(shù)(YOLOv5s-E)、添加ECA注意力機制+Focal loss損失函數(shù)(YOLOv5s-EF)3組實驗進行對比,對比結果如表2所示。

表2 不同模型的檢測性能對比

Tab.2 Comparison of detection performance of different models

添加ECA注意力機制后,mAP由93.5%增加到95.3%,增加了1.8%。其中露白缺陷的檢測效果提升較大,露白的P提升了2.1%,缺損的AP值也提升了1.5%。主要是因為露白缺陷受光照變化影響較大、特征不顯著等使得原始算法易將其誤判為正常圖像。高效通道注意力機制的添加使得網(wǎng)絡更加關注特征圖中通道位置上的關鍵信息,更好地提取缺陷特征,從而提高了檢測的準確率。同時也導致檢測速度降低了8.5幀/s,但仍然滿足實時性的要求。使用Focal Loss代替交叉熵損失函數(shù)后mAP值進一步增加到95.9%,增加了0.6%;露白的P提高了1.5%。可見因子有效平衡了正負樣本的權重,因子則減少了易分類樣本的損失,使模型更加專注于學習難分類樣本。缺損的p略有下降,主要原因是數(shù)據(jù)集中缺損樣本的數(shù)量較多,特征較露白缺陷更易識別,引入Focal loss后其損失權重占比有所下降。綜上,引入Focal Loss更有利于提高模型檢測精度,加速網(wǎng)絡收斂。

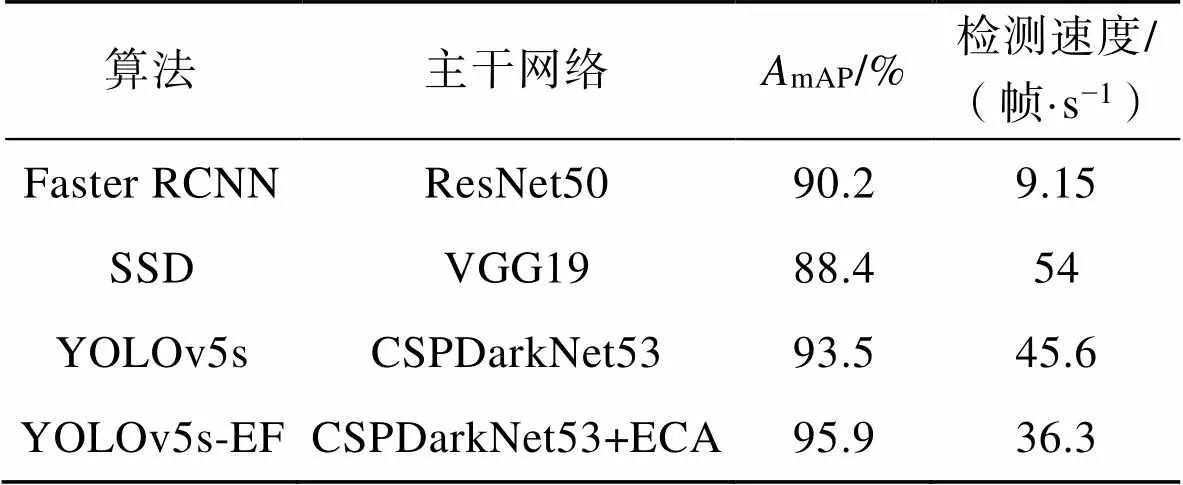

表3對比分析了當前主流的目標檢測算法與本文算法在試劑卡表面缺陷數(shù)據(jù)集上的性能。在包括了合格、露白、缺損共900張圖像上,用平均精度均值以及檢測速度來衡量各算法的性能。

表3 改進YOLOv5s與其他目標檢測模型性能比較結果

Tab.3 Performance comparison results of improved YOLOv5s and other target detection models

由表3可知,在同樣的測試集上,YOLOv5s-EF的平均精度為95.9%,比Faster RCNN、SSD、YOLOv5s算法分別提高了5.7%、7.5%、2.4%,檢測精度為各算法中最高。從檢測速度看,YOLOv5s-EF平均每秒可以檢測36.3張圖片,因其添加了ECA注意力機制,增加了算法的部分計算量,使其較YOLOv5s算法降低了9.3幀/s。雖然幀率有所降低,但mAP提高了2.4%。YOLOv5s-EF較Faster RCNN提升了27.15幀/s,而較SSD則有所降低,但其檢測精度更高。綜上,本文提出的改進算法能獲得很好的檢測精度、平均精度均值,滿足試劑卡缺陷檢測對精度的要求,同時在檢測時間上仍有較大優(yōu)勢。

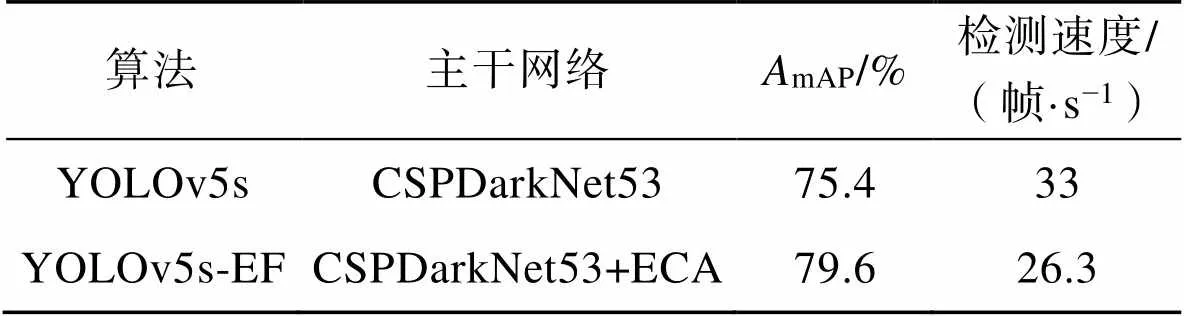

為了進一步驗證YOLOv5s-EF的穩(wěn)定性,采用PASCAL VOC 2007數(shù)據(jù)集對改進模型進行訓練。數(shù)據(jù)集共9 963張圖片,包含20個種類。在相同實驗環(huán)境下使用改進前后的算法進行實驗,檢測性能數(shù)據(jù)如表4所示。從表4可以看出,所提方法的mAP較原始算法的提高了4.2%。ECA注意力機制的添加增強了網(wǎng)絡的檢測能力,同時檢測速度有所下降,客觀反映了所提算法具有較好的泛化性和穩(wěn)定性。

表4 實驗對比結果

Tab.4 Experimental comparison results

5 結語

針對生產線上試劑卡露白等缺陷的特征細小而隱蔽,難以在復雜環(huán)境下進行高精度檢測的問題,提出一種試劑卡缺陷檢測算法。該方法在原YOLOv5s模型的基礎上,通過嵌入ECA注意力機制,使網(wǎng)絡更加關注目標特征,以獲得更高的缺陷目標檢出率;采用Focal loss代替原有的置信度損失函數(shù)來緩解正負樣本不平衡的問題,加速網(wǎng)絡的收斂。本文算法在測試集上的總檢出率可以達到97.3%,速度為22.6幀/s,表現(xiàn)出較好的穩(wěn)定性,實現(xiàn)了多類試劑卡缺陷的高精度快速檢測。下一步將圍繞如何將試劑卡缺陷檢測算法部署在工控機上,并對模型進行進一步的剪枝和性能改進,以實現(xiàn)生產線上試劑卡缺陷的實時檢測。

[1] 胡宜笑. 印刷品缺陷檢測研究與應用[D]. 長沙: 湖南大學, 2020: 27-28.

HU Yi-xiao. Research and Application of Printing Defect Detection[D]. Changsha: Hunan University, 2020: 27-28.

[2] 胡方尚, 郭慧. 基于改進多類支持向量機的印刷缺陷檢測[J]. 華東理工大學學報(自然科學版), 2017, 43(1): 143-148.

HU Fang-shang, GUO Hui. Printing Defects Inspection Based on Improved Multi-Class Support Vector Machine[J]. Journal of East China University of Science and Technology (Natural Science Edition), 2017, 43(1): 143-148.

[3] 馮秋歌, 吳祿慎, 王曉輝. 基于視覺的印刷字符缺陷自動檢測方法[J]. 南昌大學學報(工科版), 2018, 40(4): 385-389.

FENG Qiu-ge, WU Lu-shen, WANG Xiao-hui. Design of Automatic Printing Character Defects Detection System Based on Machine Vision[J]. Journal of Nanchang University (Engineering & Technology), 2018, 40(4): 385-389.

[4] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich Feature Hierarchies for Accurate Object Detection and Semantic Segmentation[C]// 2014 IEEE Conference on Computer Vision and Pattern Recognition, 2014: 580-587.

[5] REDMON J, DIVVALA S, GIRSHICK R, et al. You only Look Once: Unified, Real-Time Object Detection[C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, 2016: 779-788.

[6] REDMON J, FARHADI A. YOLO9000: Better, Faster, Stronger[C]// 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops, Honolulu, 2017: 6517-6525.

[7] REDMON J, FARHADI A. YOLOv3: An Incremental Improvement[EB/OL]. 2018: arXiv: 1804.02767. https:// arxiv.org/abs/1804.02767

[8] 周瑋, 門耀華, 辛立剛. 基于機器視覺的柔性包裝袋噴碼缺陷檢測研究[J]. 包裝工程, 2022, 43(9): 249-256.

ZHOU Wei, MEN Yao-hua, XIN Li-gang. Inspection of Coding Defects in Flexible Packaging Bags Based on Machine Vision[J]. Packaging Engineering, 2022, 43(9): 249-256.

[9] FENG Hong, JIE Song, HANG Meng, et al. A Novel Framework on Intelligent Detection for Module Defects of PV Plant Combining the Visible and Infrared Images[J]. Solar Energy, 2022, 236: 406-416.

[10] 王恩芝, 張團善, 劉亞. 基于改進Yolo v5的織物缺陷檢測方法[J]. 輕工機械, 2022, 40(2): 54-60.

WANG En-zhi, ZHANG Tuan-shan, LIU Ya. Fabric Defect Detection Method Based on Improved Yolo V5[J]. Light Industry Machinery, 2022, 40(2): 54-60.

[11] 胡方尚, 郭慧, 邢金鵬, 等. 基于印刷缺陷檢測的圖像配準方法研究[J]. 光學技術, 2017, 43(1): 16-21.

HU Fang-shang, GUO Hui, XING Jin-peng, et al. Image Registration Based on Label Printing Defect Detection[J]. Optical Technique, 2017, 43(1): 16-21.

[12] 楊其晟, 李文寬, 楊曉峰, 等. 改進YOLOv5的蘋果花生長狀態(tài)檢測方法[J]. 計算機工程與應用, 2022, 58(4): 237-246.

YANG Qi-sheng, LI Wen-kuan, YANG Xiao-feng, et al. Improved YOLOv5 Method for Detecting Growth Status of Apple Flowers[J]. Computer Engineering and Applications, 2022, 58(4): 237-246.

[13] 于娟, 羅舜. 基于YOLOv5的違章建筑檢測方法[J]. 計算機工程與應用, 2021, 57(20): 236-244.

YU Juan, LUO Shun. Detection Method of Illegal Building Based on YOLOv5[J]. Computer Engineering and Applications, 2021, 57(20): 236-244.

[14] 李志軍, 楊圣慧, 史德帥, 等. 基于輕量化改進 YOLOv5 的蘋果樹產量測定方法[J]. 智慧農業(yè)(中英文), 2021(2): 100-114.

LI Zhi-jun, YANG Sheng-hui, SHI De-shuai, et al. Yield Estimation Method of Apple Tree Based on Improved Lightweight YOLOv5[J]. Smart Agriculture, 2021(2): 100-114.

[15] YING Zhi-ping, LIN Zhong-tao, WU Zhen-yu, et al. A Modified-YOLOv5s Model for Detection of Wire Braided Hose Defects[J]. Measurement, 2022, 190: 406-416.

[16] ZHENG Zhao-hui, WANG Ping, REN Dong-wei, et al. Enhancing Geometric Factors in Model Learning and Inference for Object Detection and Instance Segmentation[J]. IEEE Transactions on Cybernetics, 2021, 26(8): 1-13.

[17] HU J, SHEN L, SUN G. Squeeze-and-Excitation Networks[C]// USA: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018.

[18] WANG Q L, WU B G, ZHU P F, et al. ECA-Net: Efficient Channel Attention for Deep Convolutional Neural Networks[C]// 2020 IEEE CVF Conference on Computer Vision and Pattern Recognition (CVPR), Piscataway, 2020: 11531-11539.

[19] 周宇杰, 徐善永, 黃友銳, 等. 基于改進YOLOv4的輸送帶損傷檢測方法[J]. 工礦自動化, 2021, 47(11): 61-65.

ZHOU Yu-jie, XU Shan-yong, HUANG You-rui, et al. Conveyor Belt Damage Detection Method Based on Improved YOLOv4[J]. Industry and Mine Automation, 2021, 47(11): 61-65.

[20] 王靜, 孫紫雲(yún), 郭蘋, 等. 改進YOLOv5的白細胞檢測算法[J]. 計算機工程與應用, 2022, 58(4): 134-142.

WANG Jing, SUN Zi-yun, GUO Ping, et al. Improved Leukocyte Detection Algorithm of YOLOv5[J]. Computer Engineering and Applications, 2022, 58(4): 134-142.

Reagent Card Printing Defect Detection Algorithm Based on Improved YOLOv5

LIU Guo-qing1, FANG Cheng-gang1*, HUANG De-jun2, LONG Chao1

(1. School of Mechanical and Power Engineering, Nanjing Tech University, Nanjing 211800, China; 2. Nanjing Zicheng Engineering Design Co., Ltd., Nanjing 211800, China)

The work aims to propose an improved reagent card printing defect detection algorithm YOLOv5s-EF based on deep neural network YOLOv5s to solve the problems of low efficiency, high cost and easy to miss detection in manual sorting of reagent cards with printing defects in reagent card manufacturers. High-quality defect image data sets were obtained by image preprocessing algorithm. Efficient Channel Attention (ECA) mechanism was added to the backbone feature extraction network of YOLOv5s to enhance the representation ability of important features in feature maps. Focal loss function was introduced to alleviate the influence of imbalance between positive and negative samples. Combined with the positioning results of the printing area, a method of similarity matching of feature vectors was proposed, which was based on the quadratic accurate positioning and the construction of azimuth feature vectors. The experimental results showed that the average detection accuracy of the reagent card printing defect detection algorithm proposed in this paper could reach 97.3% and the speed was 22.6 FPS on the test set. Compared with other network models, it can identify and locate various printing defects. The model has good detection speed and robustness, which is beneficial to improve the intelligent level of enterprise production.

defect detection; YOLOv5s; deep learning; ECA mechanism; focal loss function

TP391

A

1001-3563(2023)17-0197-09

10.19554/j.cnki.1001-3563.2023.17.024

2022-12-30

責任編輯:曾鈺嬋