基于混合策略的指針式儀表刻度識別方法

徐紅武,趙海月,樊玉平,李雅芹

(國電南京自動化股份有限公司,南京 210031)

0 引言

隨著電力系統變電站、發電廠等電力基礎實施數字化、智能化改造的推進,一些具備通信協議的智能指針儀表已經被較好地接入了變電站和發電廠的監控系統中。然而仍然有一些指針儀表不具備軟通信接口,在變電站、發電廠的日常運維中需要運維人員定期通過手動抄表的方式獲取這些指針儀表的讀數值。近年來,隨著人工智能特別是深度學習技術的進步,基于人工智能的目標檢測技術獲得了空前的成功。基于深度學習的指針儀表識別技術已經被成功應用于變電站的指針儀表讀數識別,該技術的運用減輕了運維人員的工作負擔,提升了變電站的智能化水平。利用該技術可以比較準確地識別出指針儀表的表盤并且識別出指針儀表的指針位置,但是需要對特定的指針儀表進行大量的模型訓練。由于該方法實現項目落地需要人工智能開發工程師事前進行大量的模型訓練準備工作,項目實施的人力成本高,不易于在變電站和發電廠進行推廣應用。

基于人工智能深度學習的目標檢測算法可分為單階段和兩階段兩大類。兩階段目標檢測算法主要有RCNN[1]、Fast RCNN[2]、Faster RCNN[3]、SPPNet等,該算法主要先生成候選框,然后對每個候選框進行分類回歸,該算法運行時間較長,但檢測精度較高。單階段目標檢測算法主要有YOLO[4]、SSD[5-7]等網絡模型,該算法運行速度快,但檢測精度稍差一些。文獻[8]中采用Faster RCNN 實現了電力機房巡檢機器人的指針式儀表識別。文獻[9]所述的遷移學習技術提高了模型訓練的效率,但實際應用中仍然需要對特定的指針儀表進行大量的模型訓練。文獻[10]對比分析了YOLOv4、Tiny-YOLOv4、Fast-RCNN 等目標檢測算法,并采用Tiny-YOLOv4 網絡進行指針儀表識別。

本文結合當前先進的YOLOv5 網絡模型,將深度學習神經網絡僅用于指針儀表盤的識別,預訓練的網絡模型具有通用性的特點,針對特定的現場環境,不需要對模型進行特定的再訓練。基于神經網絡的識別結果調整攝像機的焦距,從復雜環境中分割出指針儀表盤;在此基礎上通過尺度不變特征轉換算法(Scale Invariant Feature Transform,SIFT)將待檢測圖片與指針儀表盤模板圖片進行匹配校準;采用霍夫變換算法識別出指針直線并計算出其傾角,最終通過指針刻度與指針傾角的關系計算出指針儀表讀數。

1 算法總體設計

本文融合深度學習技術與尺度不變特征變換算法,充分發揮各算法的優勢,達到無需針對具體環境進行模型再訓練,只需在預訓練模型的基礎上即可準確識別出各種儀表表盤的目的。該算法能克服光照、視角變化等因素的影響,較準確地讀出指針儀表盤的讀數。采用深度學習技術,在僅進行預訓練的情況下,就可以準確定位表盤,以適應不同形狀、大小的表盤,無需根據現場的具體儀表盤進行模型的再訓練,實現一次訓練,多次應用的目的。采用SFIT 算法,可以在定位表盤的基礎上,與指針儀表標準模板庫進行比較,自動校準表盤方位和角度,并識別出表盤的指針,計算出指針的角度,最終計算出指針的刻度值。具體算法流程如圖1所示。

圖1 文中所提算法流程

2 基于YOLO網絡的指針儀表盤檢測

YOLO 網絡主要由CSP-Darknet53、CSP-PAN、SPPF等網絡模塊組成,是一種端到端的單階段深度學習卷積神經網絡,該網絡在保證目標檢測精度的前提下具有運行速度快的特點。基于YOLO 的網絡模型被廣泛應用于目標快速檢測領域,已經取得了較好的實際效果[11-15]。

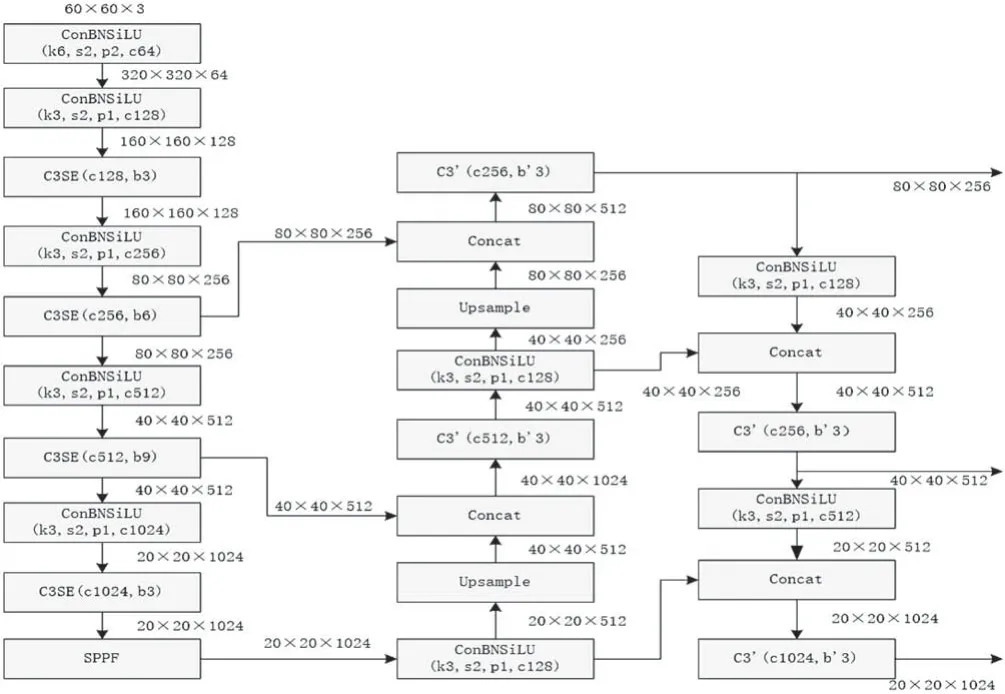

2.1 YOLO網絡模型

YOLO 深度學習網絡是一種單階段目標檢測算法,其基本網絡結構由Backbone主干網絡、Neck網絡、Head網絡3 個部分組成。其中,Backbone 主干網絡負責目標檢測物體特征信息的提取;Neck 網絡對特征信息進行多維度融合,提升檢測網絡的魯棒性;Head 網絡用來輸出待檢測的目標物體信息。本文在CSP-Darknet53 主干網絡的C3網絡單元中增加注意力機制,使其對指針儀表盤特征更敏感,有利于及時檢測出指針儀表盤。改進后的CSP-Darknet53 網絡具體由P1、P2、C3SE、C3’等模塊組成。其中,P1 是一個通道為64,填充為2,步長為2,卷積核為6 的卷積層;P2 是一個通道為128,填充為1,步長為2,卷積核為3 的卷積層;P1、P2 主要作用是實現特征的初步提取,并將采樣值調整到合適的通道大小及特征尺寸,為輸入C3SE 模塊準備好數據;C3SE、C3’是對特征信息進一步處理的主要模塊,其主要區別為瓶頸層是否增加了輸入端與輸出端的直連相加操作并且是否具備通道注意力機制,C3SE網絡的瓶頸層增加了輸入端與輸出端的直連相加操作,并具有通道注意力機制;而C3’網絡的瓶頸層輸入端與輸出端不直接相連,且不具備通道注意力機制。Neck網絡由SPPF空間金字塔池化網絡、CSP-PAN網絡組成。SPPF空間金字塔池化模塊,將任意大小的特征圖轉換成固定大小的特征向量,實現局部特征和全局特征的融合;CSP-PAN 主要由C3’模塊、上采樣模塊、卷積模塊等構成,實現了對小目標、中目標、大目標物體的融合檢測。具體網絡結構如圖2所示。

圖2 網絡結構

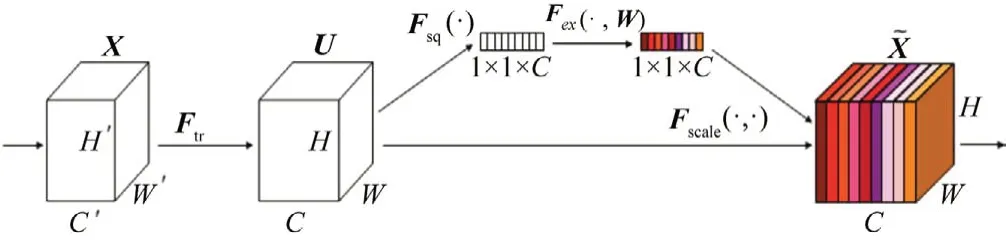

2.2 通道注意力模塊

為提高卷積神經網絡識別物體的能力,近年來注意力機制已經被越來越多地應用于計算機視覺領域。文獻[16-17]通過在卷積神經網絡中加入CBMA[18]注意力模塊,獲得了較好的識別效果。CBMA 注意力機制同時對通道注意力和空間注意力進行評分,模塊結構稍顯復雜。由于本文僅需要識別表盤,且識別物體一般都比較大,不會像吸煙檢測這樣檢測很小的物體,采用更簡潔的只關注通道注意力評分的SEnet[19]模塊。

SEnet 注意力模塊的網絡結構如圖3 所示,主要由壓縮操作、激發操作、縮放操作等步驟構成。將SEnet 加在Backbone 主干網絡中,用于學習通道間的相關性,篩選出針對通道的注意力。它通過對卷積后的特征圖進行全局平均池化處理,得到一個和通道數一樣的一維向量作為每個通道的評價分數,然后將該分數分別施加到對應的通道上。壓縮操作如式(1)所示、激發操作如式(2)所示、縮放操作如式(3)所示。

圖3 SEnet網絡結構

式中:H、W分別為特征信息的高、寬;un為第n個通道的特征。

式中:Z為輸入特定描述符;W為通道權重;δ為ReLU激活函數;σ為Sigmoid激活函數。

式中:U為所有通道的特征。

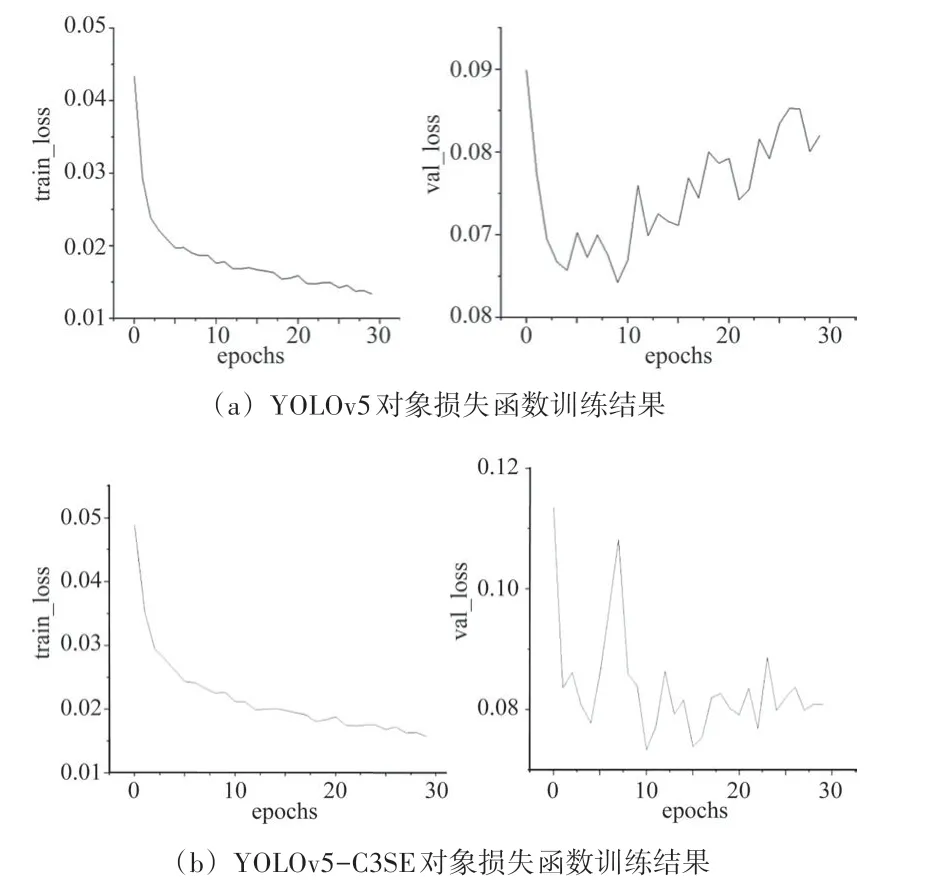

2.3 網絡訓練結果

本文分別對改進前和改進后的網絡,采用大樣本和小樣本兩種方法進行相同次數的訓練。結果表明:在大樣本情況下,未增加通道注意力機制的網絡模型過早發生了過擬合情況,其驗證對象損失函數過早出現了到達最低點后緩慢上升的情況;增加通道注意力機制的網絡模型顯示在同樣的訓練次數下,網絡模型還未出現過擬合情況,其訓練精度可隨訓練次數的增加而繼續獲得提升。大樣本訓練情況下,YOLOv5、YOLOv5-C3SE 對象損失函數訓練結果如圖4所示。

圖4 網絡訓練結果

3 指針儀表讀數識別

3.1 SIFT特征提取算法

本文選用SIFT[20]作為特征提取方法,SIFT 廣泛應用于物體辨別、機器人地圖感知與導航、影像拼接、3D 模型建立、手勢識別、影像追蹤等技術領域。該算法對旋轉、尺度縮放、亮度變化保持不變性,對視角變化、噪聲等也存在一定程度的穩定性;該算法信息量豐富,適用于在海量特征數據中進行快速、準確的特征匹配;該算法具有多量性特點,即使少數幾個物體也可以產生大量的SIFT 特征向量。該方法首先構建高斯金字塔,以表示連續尺度空間。高斯金字塔由多組金字塔組成,每組金字塔的尺度不同,每組金字塔內有多層構成,每層的平滑程度不同。高斯金字塔的組數n與原圖像分辨率(M,N)和頂層圖像分辨率(Mt,Nt)有關:

根據高斯金字塔,進行高斯模糊,建立連續尺度空間L(x,y,σ):

式中:σ為尺度空間因子,是高斯正態分布的標準差,其值反映了圖像被模糊的程度,其值越大圖像越模糊,對應的尺度也就越大;I(x,y)為圖形坐標(x,y)處的灰度值;G(x,y,σ)為高斯函數:

式中:(x0,y0)為高斯函數的中心點坐標,對于m×n尺度的二維模板,則x0=m∕2,y0=n∕2。

計算同一組中相鄰層圖形的高斯差分空間D(x,y,σ):

根據高斯差分空間D(x,y,σ)尋找極值點作為SIFT 特征提取算法的特征點,以該特征點為中心,計算區域內像素點的梯度向量幅度m(x,y)和方向θ(x,y):

在完成關鍵點的梯度計算后,通過幅值m(x,y)和相角θ(x,y)并使用梯度直方圖統計鄰域內像素的梯度和方向。獲取128 維的關鍵點特征向量,對其進行歸一化處理。設得到的描述子向量為H(h1,h2,…,h128),歸一化的特征向量為L(l1,l2,…,l128),則歸一化向量li:

得到歸一化特征向量后,采用余弦相識度計算方法,與標準模板的特征向量進行比較:

式中:x、y為需要比對的特征向量

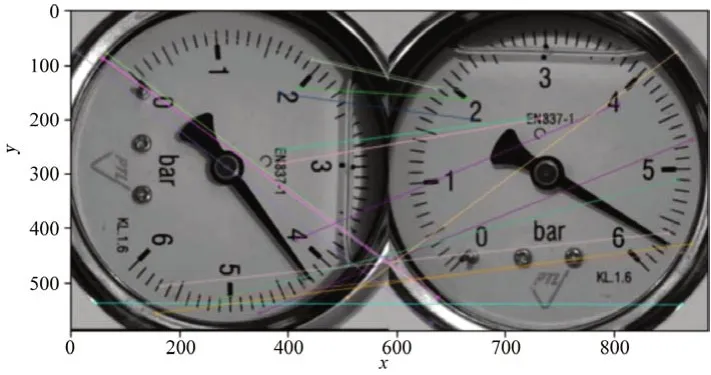

采用SIFT 特征提取算法,可以把現場攝像機拍攝到的任意角度、方位的儀表表盤圖與表盤模板庫中的標準表盤進行特征匹配,并根據標準表盤對攝像機拍攝到的角度、方位不正的表盤進行校準,方便進行表盤指針讀數計算。圖5 所示為目標檢測算法檢測分割出的表盤與表盤模板庫中的標準表盤進行SIFT 特征點匹配的實驗結果。由圖可知,即便攝像機拍攝到的目標表盤方位、角度不對,但只要在表盤模板庫中有該種表盤型號的標準模板,根據SIFT 算法,仍然可以將表盤的特征點識別出來,并對其進行正視校準。

圖5 特征點匹配結果

3.2 基于霍夫變換提取指針直線

霍夫變換指明了笛卡爾坐標系中的一條直線,對應于霍夫空間中的一個點。為了便于描述垂直于X軸的直線,本文采用極坐標的形式來描述笛卡爾坐標系的直線:

式中:ρ為坐標原點垂直于直線的距離;θ為該距離與x軸的夾角。假設一個圖像大小為m×n,則對這個m×n大小的圖像的每個像素點,根據式(12)計算其0~180°的ρ,統計哪個θ下ρ值相同的數量最多,記錄并尋找出(ρ,θ)值,代入式(12)即可找出指針所在的直線。由于現場攝像機拍攝到的圖片質量參差不齊,實際應用霍夫變換原理提取指針的過程往往會出現如圖6(a)所示的只能提取到指針的某一部分多段線段長度,并且指針兩側邊緣都有可能提取到直線。遇到這種情況,為了提高可靠性,避免誤判,一般選擇提取到的線段多的那側的線段構成的直線作為指針的指向。對于提取到的指針指向的線段可用L(x1,y1,x2,y2)表示,其中(x1,y1)表示線段的起點坐標值,(x2,y2)表示線段的終點坐標值。首先通過計算其斜率k=可以把指針邊緣兩側的線段區分開,然后再通過比較線段數多的那側的線段起始點的橫坐標x值大小,可以取出x值最小和x值最大的坐標點,將找到的兩個點作為擬合提取到的直線的兩個端點,即可提取到比較完整的指針直線,如圖6(b)所示。

圖6 霍夫變換提取指針直線

3.3 指針儀表讀數計算方法

指針儀表讀數的計算方法,歸根到底就是要計算指針的角度與表盤刻度的關系。文獻[21]中利用差影法提取指針信息,根據指針傾斜角度與表盤刻度的關系計算出指針刻度值。本文把表盤分成4個象限,根據每個象限和指針刻度的關系,分別根據式(12)~(15)計算出指針的刻度值。

假設指針刻度范圍為G,指針刻度范圍對應的角度范圍為θ0,以表盤中心點為圓點,把表盤與X軸相交的左刻度值x0作為配置參數供工程配置人員輸入。

當識別的指針在第一象限時,指針表盤刻度計算方法為:

當識別的指針在第二象限時,指針表盤刻度計算方法為:

當識別出指針在第三象限時,指針表盤刻度計算方法為:

當識別的指針在第四象限時,指針表盤刻度計算方法為:

如圖7所示指針儀表讀數,程序檢測出指針在第一象限,并且計算出其傾角為為35°,則根據式(12),指針刻度為4.3。

4 實驗結果與分析

本課題研究的硬件環境:聯想電腦QiTianM530-A051,無GPU,主機主頻3.6 GHz,內存24 GB;軟件環境:Windows 64位操作系統,Python版本為3.7.13。

4.1 實驗情況說明

為驗證注意力機制對YOLOv5網絡的影響,準備了大樣本和小樣本兩套數據。大樣本訓練集6 000張圖片,驗證集500張圖片。小樣本訓練集800張圖片,驗證集40張圖片。大小樣本均采用LabelImg軟件對檢測目標進行標注。實驗結果表明經過大樣本數據訓練后獲得的預訓練模型,對指針式儀表的表盤的識別具有普遍的適應性,可以準確地定位出指針式儀表的表盤,在不需要識別指針式儀表指針位置的情況下,無需針對特定場合對模型進行再訓練。

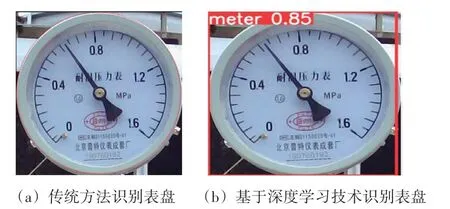

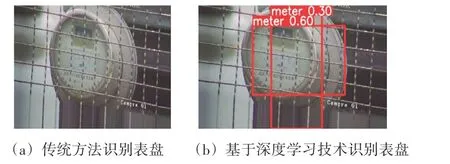

4.2 儀表盤檢測靈敏度對比

實驗結果表明在圖片質量較好的情況下,采用傳統的OpenCV 方法和采用基于深度學習技術的卷積神經網絡的方法均能準確地識別出指針式儀表的表盤。在圖片質量不好和有遮擋的情況下,采用深度學習神經網絡的方法比傳統的OpenCV 方法更容易檢測出指針儀表的表盤。在圖片清晰、有遮擋情況下,分別利用傳統方法和基于深度學習技術的方法識別表盤結果如圖8~9所示。

圖7 指針儀表讀數

圖8 圖片清晰情況下識別表盤

圖9 有遮擋情況下識別表盤

4.3 推理時間對比

增加注意力機制后,YOLOv5-C3SE 的推理時間為1.181 4 s,比沒有增加注意力機制的YOLOV5 推理時間1.432 7 s更短,單張圖片的推理時間可以節約251.3 ms。

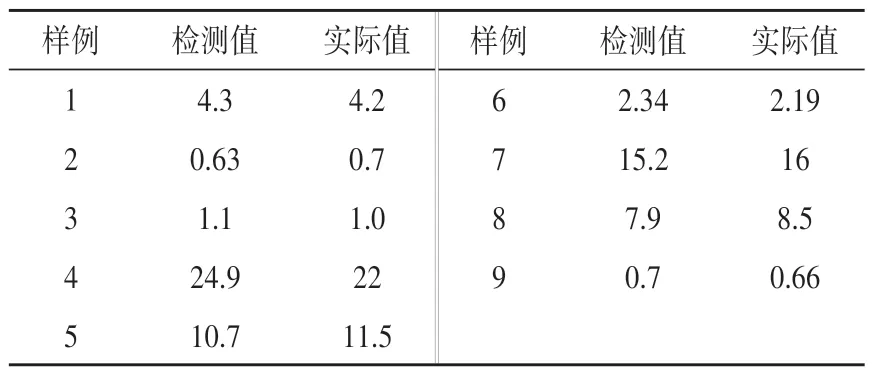

4.4 指針刻度讀數識別精度統計

針對本文中的指針儀表刻度識別方法,進行10 余種型號指針表盤指針讀數識別實驗,結果如表1 所示,讀數平均精度約0.93,基本符合發電廠對指針儀表讀數圖像識別精度的要求。

表1 檢測結果

本文融合了傳統的圖像分析方法和人工智能深度學習技術,既發揮了人工智能深度學習技術識別表盤更靈敏的優點,又采用傳統的方法來識別儀表的指針,使得算法的適應性獲得了顯著的提升。但本文中采用的SIFT算法在圖片質量不好的情況下存在待測圖片與指針儀表標準模板庫中的圖片匹配不成功的情況,后期將繼續進行相關研究,提升模型匹配效果。

5 結束語

針對近年來廣泛采用深度學習技術進行指針式儀表刻度識別需要對每個項目單獨進行模型的再訓練,項目的工程實施成本高,不易于大批量推廣應用的問題,提出了基于混合策略的指針式儀表刻度識別方法。該算法僅采用深度學習技術識別指針式儀表的表盤,在檢測出指針式儀表表盤后采用尺度不變特征轉換和霍夫變換算法來識別指針式儀表的指針。算法在精度上可以滿足發電廠的實際使用需要,且在卷積神經網絡僅進行預訓練的基礎上,就可以準確識別出儀表的表盤,無需針對具體的項目再進行卷積神經網絡模型的再訓練,克服了每個工程現場需要進行特定模型訓練和部署的麻煩,簡化了深度學習卷積神經網絡模型訓練,該方法具有普遍通用性,提高了項目的工程化水平。