生成式人工智能技術原理及其教育適用性考證

苗逢春

生成式人工智能技術原理及其教育適用性考證

苗逢春1,2

(1.北京師范大學 互聯網教育智能技術及應用國家工程實驗室,北京 1000875;2.聯合國教科文組織總部 教育信息化與人工智能教育部門,法國巴黎 75007)

作為對聯合國教科文組織發布的《生成式人工智能教育與研究應用指南》進行系列解讀的第一篇,文章著重對生成式人工智能技術原理進行追本溯源的辨析并考證其教育適用性。生成式人工智能是可跨人類思維表征符號加工和生成新內容的人工智能技術,但其并不理解語義和真實世界的技術局限會限制其變革教育的潛力。壟斷性基礎模型已引發數字基礎設施升級的安全憂患并存在投射西方價值觀和語言文化偏見的風險,故研發自主可控的基礎模型和更具適用性的教育基礎模型是生成式人工智能教育應用的安全底線。生成式人工智能主要以成人應用互聯網產生的數據作為訓練用數據,其基于聊天的內容服務方式不適合未成年人,應設置獨立聊天的年齡下限。從教育內容提供的視域考證,基于廣而雜數據集訓練并采取付費內容服務模式的人工智能生成內容作為主要的教育內容獲取來源,存在既不符合技術設計初衷也不符合教學目的的悖論。而從教學育人過程的視域考證,生成式人工智能輸出內容可用自動化的“內容預制菜”明喻其惰化學習主體通過解構內容實現知識建構和技能獲得的反智風險。課程內容制作、雙基學習、特殊學習需求、高階思維和探究實踐,是設計主體適應和學科適用的生成式人工智能教學應用的主要情境與脈絡。

生成式人工智能;ChatGPT;人類思維符號表征;價值觀及語言偏見;教育適用性;基礎模型

引言

自2022年11月美國開放人工智能研究中心(OpenAI Artificial Intelligence Research Center INC,簡稱“OpenAI”)發布第三代聊天生成式預訓練轉換模型(Chat Generative Pre-trained Transformers,ChatGPT,下文簡稱“ChatGPT”)——ChatGPT-3以來,人工智能開發商便開始炒作關于生成式人工智能(Generative Artificial Intelligence,GenAI)教育潛力的激進觀點,學術界也跟風式地持續涌現關于其教育應用模式或引發教育變革的理論假設。為確保在教育中有目的、有組織地合法、有效應用生成式人工智能,亟需矯正“技術躍遷焦慮”驅動、忽視實然新技術性能和技術局限的人為理論造魅及其對政策的誤導,并回歸技術與教育的應然互動關系來論證其教育價值。為此,聯合國教科文組織于2023年9月發布《生成式人工智能教育與研究應用指南》(下文簡稱《指南》)[1]。作為生成式人工智能在教育領域的第一個全球性指導文件,《指南》力圖從以下五個層面考證其教育寓意:①可能威脅教育作為公共產品屬性的基本爭議。作為技術起點,《指南》首先概要敘述了生成式人工智能的工作原理并辨析了其技術局限,總結和剖析了該技術可能引發的八個主要法律和倫理憂患。②確保可信教育人工智能的治理規則。《指南》以“以人為本的人工智能應用原則”為指導,基于對全球人工智能治理現狀的調研和分析,提出了各國制定生成式人工智能管理辦法的路線圖和具體管理建議,尤其倡議各國應考慮設置未成年獨立使用ChatGPT等聊天平臺的年齡下限。③教育管制與應用政策。《指南》詳細闡述了在教育領域合法、有效應用生成式人工智能技術的政策要件和實施策略。④教育實踐應用的設計與評估。因循優先管制、確保包容、引導應用的隱含邏輯,《指南》提出“人類主導、主體適用的互動性應用”的生成式人工智能教育實踐應用框架,建議從科學研究及研究性學習助理、協同課程制作、雙基教學助理、可計算的技能操作診斷、特殊學習需求等生成式人工智能具有明顯技術潛能的領域,審慎論證生成式人工智能的應用場景。⑤對學習過程、學習結果及其評估等的深遠影響。《指南》倡議各國追蹤研判并反思生成式人工智能對學習目標與評價、知識產權、學生思維、心智發展等的長遠影響,據此制定中長期應對措施。

本研究是對《指南》進行解讀的第一篇,重點結合生成式人工智能的工作原理,考證其教育應用的安全性、價值觀投射、未成年人獨立聊天的風險,并辯證分析其在支持教育內容提供、教學過程實施等方面的適用性和變革潛能,以期探索更有針對性的管理和應用策略。

一 生成式人工智能的基本性能:對人類思維符號表征系統的模式識別與內容生成

在以文本、圖像和視頻制作為產品輸出的商業領域,已投入使用的ChatGPT對于生產力的提升效果顯著。哈佛商學院對律師、咨詢等行業中ChatGPT應用效果的調查結果顯示,ChatGPT可提高12.2%的文本生產力,文本加工的質量提升了40%[2]。但文本、圖像和視頻加工產品在教育領域屬于初始的內容輸入,而絕非教學目的,甚至不是教學過程的重點。因此,諸多關于生成式人工智能會對教育產生根本性變革的假說,多屬于既脫離技術原理又無視教育目標和過程的無端推測。深入辨析生成式人工智能的技術原理、已有的技術邊界和可能的技術發展路向,并從教學育人目標和過程出發考證其適用性,是理性判斷其教育價值的邏輯基點。

1 從處理人類思維符號表征系統的角度理解生成式人工智能

(1)生成式人工智能的定義

《指南》從人工智能對人類思維表征符號系統的模擬角度,對“生成式人工智能”進行了定義:生成式人工智能是根據人類借助思維符號表征系統表達的提示(Prompts)自動生成內容的人工智能技術。不同于僅能對已有網頁進行搜索排序或單純地對現有內容進行提取和重新編排的數字技術,生成式人工智能可以生產先前并不存在的新內容。生成式人工智能技術允許用文字、語音等格式呈現提示或提供圖形圖像、視頻、軟件代碼等參考范例,然后以論文或報告、聲音、圖像、繪畫、視頻、軟件代碼等各類符號表征呈現輸出的內容。生成式人工智能的核心技術是生成式預訓練轉換模型,這是一種利用從互聯網網頁、社交媒體對話和其他在線媒體中收集的數據進行訓練的內容生成深度學習模型。生成式人工智能雖然可以生產新內容,但不能理解文本背后隱含的現實世界中的物體、物體之間的關系和社會關系,因而不能形成新的觀點或應對現實世界復雜挑戰的解決方案。此外,盡管生成式人工智能具有內容輸出的流暢性、相對于提示要求的內容輸出針對性等特點,但當前仍不能被信任為可生成準確、可靠內容的技術。即便是ChatGPT也在用戶協議中聲明:盡管諸如ChatGPT的工具可生成看似合理的答案,但不能被視為可依據的準確答案(詳見https://chat.openai.com)。生成式人工智能輸出中的錯誤很難被那些對相關查詢和聊天主題缺乏牢固知識基礎的用戶察覺,對尚未掌握足夠事實性知識的未成年人用戶來說此問題尤為嚴重。為此,OpenAI等生成式人工智能提供商建議:在高厲害關系領域,包括面向未成年人講授事實性知識的教育領域,應該慎用或不用ChatGPT等并非基于專業數據培訓的生成式人工智能平臺。

(2)生成式人工智能對人類思維符號表征系統的模式識別與內容生成

在近期生成式人工智能的諸多突破性技術中,真正引發深思的是該技術看似逐步具備了處理人類思維所采用的全部表征符號的性能。人類常用的符號表征有口頭或書面語言呈現的自然語言、圖形圖像(包括抽象圖形、照片或視頻、圖像、繪畫等)、音樂和軟件代碼等。生成式人工智能技術支持人類借助自己慣常使用的各類符號表征來呈現提示或提供參考范例,然后通過生成式預訓練轉換模型,以人類無法覺察其延遲的運算速度,用論文、報告、演示文稿、聲音、圖像、繪畫、視頻、數字或數值、軟件代碼等各類符號,表征呈現其生產的內容、答案或建議。

在接受輸入提示方面,ChatGPT-3和ChatGPT-3.5僅限于文本輸入,而ChatGPT-4接受用戶在文本輸入的基礎上同時使用語音和圖像呈現混合提示,在“文生文”的基礎上實現了“圖(含視頻)生文”“文生圖(含視頻)”等跨符號表征的功能,并支持在提示和響應中混合使用計算機代碼。2023年9月,OpenAI發布人工智能圖像合成模型的測試版本DALL?E 3,其以ChatGPT為基礎,支持用戶通過提示工程(Prompt Engineering)逐步展開復雜的描述,再根據描述自動生成圖像,展現了通過自然語言對話生成圖像的能力。ChatGPT-4也獲得了可為靜止圖像或錄像自動生產字幕、對圖像中的元素進行分類識別并分析圖像中的文本內容、解釋圖像傳承的藝術模因(Memes)、對同時含有文本和圖像的文件進行總結提煉等技術性能。

除了ChatGPT系列產品,2023年初谷歌公司發布“詩人”(Bard,詳見https://bard.google.com)大語言模型,可實現與互聯網保持實時鏈接,并為其輸出的響應提供即時更新的信息;隨后,又發布了多模態大模型“雙子座”(Gemini),能夠理解和生成文本、計算機代碼,并能夠識別和生成圖像,是與ChatGPT-4性能對標的基礎模型。元宇宙公司(下文簡稱“Meta公司”)的大語言模型“羊駝”(Alpaca,詳見https://crfm.stanford.edu/2023/03/13/alpaca.html),致力于解決大語言模型輸出中的錯誤信息、社會刻板印象和有害語言問題。“Meta大語言人工智能模型”(也稱Llama大模型,詳見https://ai.facebook.com/blog/large-language-model-llama-meta-ai)則是基于更小的超算能力和較少的訓練資源,來探索新型生成式人工智能開發模式的前沿嘗試。

由于生成式人工智能在技術性能、技術集成的深度和綜合性等方面已超越單純的大語言模型,有研究者認為“大語言模型”已不再適合概括生成式人工智能技術的全部內涵,故提出用生成式人工智能“基礎模型”(Foundation Models)的概念代替大語言模型[3]。生成式人工智能最近的技術進展也為人工智能上下游垂直技術研發提供了具有突破性的基礎模型,并觸發了人工智能芯片、超算能力、數據分析和表達、模型優化等各核心技術領域的競爭。圍繞生成式人工智能基礎模型新涌現的“卡脖子”關鍵技術集群,將是自主可控數字技術研發的必爭領域。

2 生成式人工智能的技術原理

(1)生成式人工智能的基本工作原理

①文本生成式人工智能的基本工作原理。文本生成式人工智能使用人工神經網絡技術中的通用文本轉換器,通常又被稱為“大語言模型”(Large Language Model),但大語言模型不能被用來概括圖像生成式人工智能,也不能用來統稱生成式人工智能的所有門類。經過訓練的生成式預訓練轉換器可通過以下步驟,根據人類用戶的提示指令生成文本或輸出其支持的其他格式:第1步,提示指令被分解為文本的最小單位或基本元素字節(Token),然后輸入到生成式預訓練轉換器中。第2步,轉換器通過統計模型預測組合為連貫反應的最可能的詞語或句子,具體流程是轉換器先從訓練用大數據模型中確認單詞或短語的語言模式,之后轉換器借助這些語言模式預測特定單詞或短語在特定語境中出現的概率,最后基于概率預測,轉換器在其反饋中預測后續最有可能的單詞或短語。第3步,預測產生的單詞或短語轉化為可閱讀的文本(或可理解的聲音)。第4步,可理解的文本或聲音經過“護欄技術”(Guardrails)處理,過濾掉不良輸出(如明顯違法或違反已知倫理法規的內容等)。第5步,重復第2步至第4步,直到完成一個完整的響應(即達到字節數的最高限度或預先設定的響應停止基準)。第6步,產生的響應采用后處理技術進一步加工,通過格式編排、添加標點及其他語言增強方法(如模擬人類可能應用的語氣詞“是的”“當然”“對不起”等),來提高其可閱讀性或可理解性。

文本生成式人工智能模型為需要內容處理和表達的各領域提供了基礎性自動化內容加工工具,并已引發了內容加工行業的生產方式變革。例如,微軟的文字處理、電子表格、演示文稿制作等辦公套件,已實現內嵌ChatGPT的軟件升級。再如,谷歌在Chrome瀏覽器內嵌“文案寫作人工智能”(Compose AI)模型,支持寫作中的語句自動完成和文章生成;內嵌于PDF軟件的“PDF聊天”(ChatPDF,詳見https://www.chatpdf.com)可對PDF格式文件內的文本、圖表等進行識別和加工,并自動總結文件的要點,開展基于文本的問答對話。

生成式人工智能借助概率對文本上下文進行模式識別,根據句法規則生成文本內容,但它并不理解語言的語義(Semantics),與人類理解自然語言并基于對語言的理解借助各類符號表征進行溝通和問題解決的能力相去甚遠。同時,生成式人工智能不能借助句法理解文本和圖像等背后真實世界中的物體和復雜的社會關系,盡管它可以為人類的知識發現提供文獻綜述和數據計算的支持,但其自身不能發現新知識。囿于現有技術局限,生成式人工智能技術無法為解決現實世界中的復雜挑戰提供創新型解決方案,也不能做出社會價值判斷或價值觀引導。這一技術局限制約了生成式人工智能較為獨立地引導復雜知識學習和問題解決的導學性能,進而限制了其變革教育的潛能。

②圖像及音樂生成式人工智能的基本工作原理。圖像及音樂生成式人工智能采用不同的人工神經網絡技術——“生成對抗網絡”(Generative Adversarial Networks,GANs),可與變分自動編碼器合并使用。GANs由兩個對抗器組成,即生成器(Generator)和判別器(Discriminator)。以圖像生成對抗網絡為例,生成器會根據提示對圖像要素組合模式進行識別并生成一個隨機圖像,判別器會對比生成圖像與真實圖像的擬合度。隨后,生成器會根據判別器的對比結果調整其使用的復雜參數,以生成更優化的圖像。在預訓練中,該過程會被重復千百次,以保證生成器創作出判別器難以判斷與提示預期存在差異的圖像。例如,如果用數千張關于某地的風景照片訓練一個生成對抗器,其創作的關于該地的非真實圖像將幾乎無法被識別為假圖片。與此類似,如果用某種風格、某個音樂家或某一歌名的不同音樂數據集訓練生成對抗器,其創作的新音樂將能復制原始音樂的復雜音樂特征。

圖像生成式人工智能亦多被ChatGPT的相關技術模型所壟斷,如“達利?E 2”(DALL?E 2,詳見https://openai.com/product/dall-e-2),這是OpenAI的圖像生成人工智能工具,在此基礎上還衍生出了“蠟筆”(Craiyon,詳見https://www.craiyon.com)平臺。此外,“途中”(Midjourney,詳見https://www.midjourney.com)綜合了DALL?E和穩定擴散模型(Stable Diffusion Model),而“夜間咖啡館”(NightCafe,詳見https://creator.nightcafe.studio)、“圖像沖擊波”(Photosonic,詳見https://writesonic.com/photosonic-ai-art-generator)、“攝影師”(Fotor,詳見https://www.fotor.com/features/ai-image-generator)等也都采用了DALL?E 2平臺。

視頻生成式人工智能基礎模型除了ChatGPT-4,還有“膠質云平臺”(GliaCloud,詳見https://www.gliacloud.com),此平臺可從新聞內容、社交媒體發帖、現場運動賽事、統計數據中生成視頻。此外,“圖像工廠”(Pictory,詳見https://pictory.ai)和“跑道”(Runway,詳見https://runwayml.com)也都可從文字中生成或編輯加工具有專業品質的視頻。

音樂生成式基礎模型或平臺包括:“人工智能虛擬藝術家”(Aiva,詳見https://www.aiva.ai),可自動創作個性化的原聲音帶;“爆音”(Boomy,詳見https://boomy.com)、“聲音玩家”(Soundraw,詳見https://soundraw.io)、“變聲器”(Voicemod,詳見https://www.voicemod.net/text-to-song)等,都是可支持零音樂創作基礎的用戶用文本自動生成歌曲的平臺。

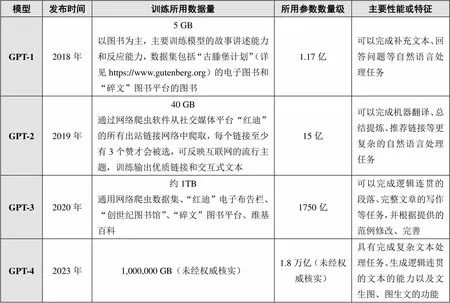

表1 OpenAI各版本GPT的訓練用數據集和參數

(2)生成式人工智能的模型架構、預訓練用數據量和參數的迭代升級

每一個新版本的生成式預訓練轉化器均在先前版本的基礎上對人工智能架構、訓練方法等進行綜合的迭代優化,所使用的預訓練數據集數量和所采用的參數也呈爆炸式增長。其中,參數是人工神經網絡系統中決定該系統如何加工輸入和產生輸出的數值。參數通過訓練中的數據界定,對模型中的知識和技能進行編碼。參數決定預訓練轉化器的性能和應用表現,故而對預訓練轉換技術來說至關重要。一般而言,參數越多,能處理的數據和做出的表達越復雜。GPT使用了萬億數量級的參數,支持其處理復雜任務、生成邏輯連貫的文本的能力(具體如表1所示)。生成式人工智能架構和訓練方法的迭代優化、預訓練用數據集和數以億計的參數處理,都依賴于超算能力的同步加速提升。2012年以來,用于生成式人工智能模型訓練的算力的翻倍周期為3~4個月,其算力翻倍速度打破了預測計算機計算能力每兩年翻一倍的“摩爾定律”[4]。

(3)現有壟斷性生成式人工智能系統的訓練用數據集來源和語言分布

上述處于壟斷地位的生成式人工智能模型的訓練用數據集主要來源于互聯網網頁的“爬取”信息、社交媒體對話信息、在線圖書館圖書資料和互聯網百科類平臺的百科內容。根據OpenAI公開的資料和第三方統計,ChatGPT-3實際使用的訓練用文本數據(即語料)不到1000GB,即1TB左右[5]。主要的數據來源有:互聯網“通用網絡爬蟲數據集”(Common Crawl,詳見https://commoncrawl.org),約占數據總量的61.75%;“紅迪”(Reddit,詳見https://www.reddit.com)電子布告欄,約占18.86%;“創世紀圖書館”(Library Genesis,詳見https://librarygenesis.net)的圖書,約占8.1%;“碎文”(Smashwords,詳見https://www.smashwords.com/)圖書平臺的圖書,約占7.8%;維基百科,約占3.49%。

與此同時,目前壟斷性生成式人工智能模型的訓練用數據集以美國及其歐洲結盟國家的語言為主。在ChatGPT公布的訓練數據集語言分布中,英語語料占比高達92.64708%,其次是法語(占比1.81853%)、德語(占比1.46937%),而漢語語料占比僅為0.09905%[6]。針對這一問題,后續發布的大語言模型開發商宣稱將致力于提高訓練用數據集的語言代表性,但整體上仍無法改變英語及西方結盟國家語言占絕對優勢的現狀。例如,在自稱致力于提升大語言模型語言多樣性的Meta公司開發的Llama 2語料中,英語占比雖有所下降,但仍占89.7%;其他占比排前15的語言幾乎沒有改變;漢語語料略有提高,占0.13%[7]。

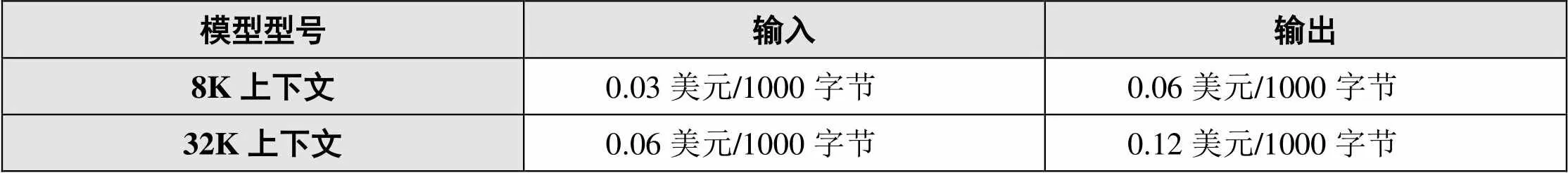

(4)現有壟斷生成式人工智能平臺的內容服務收費

字節通常被用作生成式人工智能收費服務的計價單位。1字節大概等于0.75個英文單詞,而一個簡體的中文漢字大概等于1.2~3字節或平均相當于2.7字節。以ChatGPT的定價為例,OpenAI細分出實用的產品變型并根據變型分類定價。每個產品變型通過可支持用戶輸入、輸出的上下文長度(即提示輸入的字節限制、內容生成的字節限制)進行劃分,其中4K上下文最多允許4,096字節,而16K上下文最多允許16,384字節。OpenAI以GPT-3.5增強版作為起點服務平臺,其服務定價如表2所示。而ChatGPT-4支持更長的上下文長度,其中型號為32K的產品的字節輸入、輸出長度均可達32,768字節,可支持對輸入、輸出性能要求較高的二級開發商和個體用戶處理范圍更寬泛的文件,并在對話中保持篇幅更長的上下文理解能力,但服務價格大幅提高,其服務定價如表3所示。

表3 GPT-4的服務定價

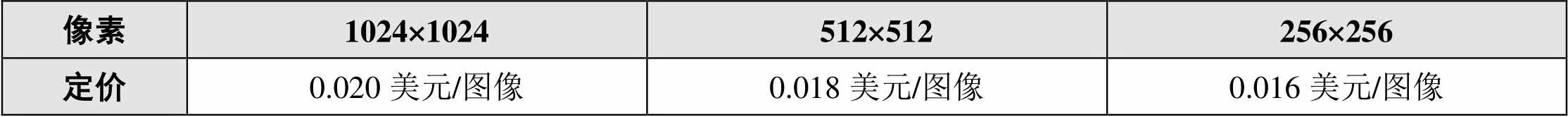

OpenAI的圖像和音樂等平臺根據生成圖像的分辨率或像素劃分服務類型,并以圖像為單元收費。DALL?E的圖像生產服務收費標準如表4所示。

表4 DALL?E的圖像生產服務收費標準

二 已有壟斷性生成式人工智能平臺教育應用的安全和價值觀風險

美國OpenAI、谷歌、Meta公司的壟斷性基礎模型已被廣泛應用,并已被內嵌為數字基礎設施的有機組成部分,將對包括教育在內的各領域數字安全產生廣泛而長遠的影響。考證壟斷性生成式人工智能平臺對數字安全性、價值觀等方面的深遠影響,是討論其教育應用的安全底線。

1 壟斷性生成式人工智能平臺的數字安全控制和價值觀投射

(1)壟斷性基礎模型的數字安全威脅

現有壟斷性基礎模型引發的數字基礎設施升級,從某種意義上也將是對其他國家數字安全威脅的升級。生成式人工智能已被互聯網搜索引擎、瀏覽器等在線數據控制性基礎設施采納為內嵌模型,并已引發數字基礎設施的升級。例如,谷歌公司的Chrome瀏覽器內嵌了多種生成式人工智能功能,主要包括:①“網絡聊天GPT”(WebChatGPT,詳見https://tools.zmo.ai/webchatgpt),可將ChatGPT與互聯網連接以獲取更準確、更及時的對話信息;②“智慧合一”(Wiseone,詳見https://wiseone.io),可協助閱讀過程中相關信息的實時查詢;③“人工智能個人助理團隊”(TeamSmart AI,詳見https://www.teamsmart.ai),可綜合調用ChatGPT-4、谷歌PaLM 2的Bison版本、Meta公司的Llama 2版本和其他大型基礎模型。這些內嵌的生成式人工智能服務會要求用戶提供電子郵件、社交賬號等信息,并且會誘導用戶在提示工程中開放社交賬號中的文本、圖像、視頻等信息。由此,生成式人工智能即成為控制網絡安全和個人網絡隱私、主導網絡流量的最底層數字基礎設施的重要節點。失去基礎模型的自主可控權,就意味著失去國家網絡安全和公民數據保護的主動權。自2018年中美貿易沖突以來,美國隨時可用維護國家安全的借口,針對其管轄范圍內的核心技術對中國采取強制封鎖和禁用措施。在此歷史背景下,ChatGPT等美國的壟斷性生成式人工智能平臺在中國的應用,不具備技術可達性和數字安全的底線保障。

(2)生成式人工智能不理解價值觀,但會投射價值觀

當前,在壟斷性生成式人工智能模型的訓練用數據集的語言分布中,英語及美國主要歐洲結盟國家的語言占絕大多數。生成式人工智能并不能理解人類的價值觀,但在訓練轉換器的過程中,如果訓練用數據集的擁有者持有某種價值觀,那么與該價值觀相符的詞匯和句法等便會被更多次地重復,從而被轉換器識別為標準的文本模式而在其輸出過程中得到強化并作為標準答案輸出。這些被技術強化的、隱含某種價值觀的語句,會被用戶解讀并生成與價值觀關聯的意義。盡管壓制其他價值觀和文化標準或許并非生成式人工智能的設計初衷,但對未被納入預訓練數據集的語言來說,其相關的語言范式、文化觀念無法在轉換器得到確認和重復。因此,主要基于美歐語料的基礎模型對該領域的壟斷客觀上會借助文本、圖像、視頻等內容產品的掩蓋,以難以察覺且難以抵制的方式更集中地投射“價值觀和文化標準答案”,潛移默化地對處于語言文化風格和價值觀成長期的青少年進行價值觀滲透,并導致弱勢群體數字殖民的升級[8]。

2 確保生成式人工智能教育應用的安全性

(1)強化對面向境內提供服務的跨國生成式人工智能提供商的管理

2023年7月,我國國家互聯網信息辦公室聯合多部門公布《生成式人工智能服務管理暫行辦法》(下文簡稱《辦法》)[9],明確了轄域內服務適用的治理范疇界定,即“用生成式人工智能技術向中華人民共和國境內公眾提供生成文本、圖片、音頻、視頻等內容的服務”都應該接受本《辦法》的管理;同時,明確規定提供和使用生成式人工智能服務應“堅持社會主義核心價值觀”,并強調要“在算法設計、訓練數據選擇、模型生成和優化、提供服務等過程中,采取有效措施防止產生民族、信仰、國別……等歧視”。鑒于生成式人工智能的價值觀投射具有極高的隱蔽性,目前可預見的監控方法主要有兩個:一是要求向境內提供服務的生成式人工智能平臺體現轄域內主要語言在訓練語料中的代表性,考慮設置中文在訓練語料中的占比下限;二是監管部門和用戶合作,對生成式人工智能輸出內容投射的價值觀進行監控,“建立健全投訴、舉報機制”,一旦“發現違法內容的,應當及時采取停止生成、停止傳輸、消除等處置措施,采取模型優化訓練等措施進行整改。”

(2)優先基礎模型的自主可控研發和基于開源技術的國際合作

應對目前壟斷性生成式人工智能平臺引發的數字安全升級,中國應鼓勵和支持產權自主、安全可控的核心基礎模型的技術研發,評估與預判已有壟斷性基礎模型引發的底層數字基礎設施升級帶來的安全隱患,并制定安全可控的自主數字基礎設施升級方案。盡管百度的“文心一言”、阿里巴巴的“通義千問”以及其他的中國自主可控大語言模型在模型架構、訓練用數據集和參數規模、模型的性能及其成熟程度等方面,均與上述壟斷性基礎模型存在代際差距,但基于本國數據集和本土技術團隊的基礎模型研發是實現產權自主、安全自控的唯一戰略選擇。同時,要倡導和支持基于開源技術的國際合作,通過知識共享提升技術研發能力,并探索構建優質數據和超級計算資源共享的機制,以對抗現有基礎模型開發的壟斷。在開源生成式人工智能領域,較為成熟和有影響力的是HuggingFace社團開發的“擁抱聊天”大語言模型(Hugging Chat,詳見https://huggingface.co/chat),該社團倡導研發和訓練的倫理合規性、透明性,并強調其用于模型訓練的數據全部開源。另外,“開源助手”平臺(Open Assistant,詳見https://open-assistant.io)提供大量的開源模型、數據等,支持技術專業知識豐富的人士合作開發產權可控的大語言模型。

(3)支持基于本國課程標準的教育基礎模型開發

在超前研發產權自主的核心基礎模型的同時,應同步布局各關鍵專業領域自主可控基礎模型研發的新賽道。教育基礎模型或教育生成式預訓練轉換器(EdGPT)是基于本國審核批準的課程標準和教材內容數據、數字化教育管理和教學過程數據訓練的生成式預訓練轉化器,可最大程度地確保生成式人工智能智能教育應用的價值觀與語言文化自主。目前,已推出實測或實用版本的教育基礎模型主要有“數學GPT”(MathGPT,詳見https://www.mathgpt.com)和“默林大腦”(Merlyn Mind,詳見https://www.merlyn.org)。從本質上來說,教育專用模型是放棄基于海量互聯網數據訓練出的大模型所具有的寬域內容輸出這一教育低相關性技術特性,轉而追求用小而專的教育數據訓練更安全、更去除價值觀偏見的轉化器以輸出更符合教學需求的精準內容和對話響應。教育專用模型能在多大程度上將生成式人工智能的最新技術進展降維應用到教育領域、教育專用模型的底層技術組合和架構設計等能在多大程度上實現學科專業知識“理解力”方面的升維突破,將是考察教育大模型性能和應用效果的重要指標。與此同時,教育基礎模型的功能設計還需要界定內嵌主體適用的基本教學法與保護真實師生互動之間的邊界,預防教育基礎模型成為預設教學方法和流程甚至取代師生互動活動的“教學過程預制工具”。

三 生成式人工智能的年齡適用性和教學適用性

超越目前壟斷性基礎模型的安全性和適用性的范疇,生成式人工智能作為通用性的技術,也存在自身的技術性能有限并受人機互動邊界的限制。從用戶年齡、教學內容提供的需求、教學過程的特點等角度考證生成式人工智能的適用性,是發揮其教學育人潛力、規避風險的前提。

1 “聊天式”內容服務的年齡適用性

①未成年人借助生成式人工智能平臺聊天的風險。未成年人借助現有的通用生成式人工智能平臺聊天的年齡適用性,是考證中小學階段生成式人工智能教育應用的法律和倫理前提。從上述預訓練用數據來源的考證可以看出:現有的通用生成式人工智能模型將未經選擇的成年人應用互聯網過程中產生的數據作為主要的訓練用語料,以支持成年人聊天式的內容服務為目的而開發。道德判斷能力和社會行事能力均未達到自我保護下限的未成年人在與這些預訓練模型的一對一聊天互動中,不可避免地會面臨諸多風險,包括曝光于輸出響應中的不適內容、借助未成年人肖像的“深偽”數字圖像合成和網絡傳播、通過聊天互動對未成年人的行為操控等。

②未成年人獨立使用生成式人工智能平臺聊天的年齡下限。鑒于可預判的獨立聊天風險和生成式人工智能技術在生成不準確內容等方面的不確定影響,聯合國教科文組織在《指南》中建議各國政府對未成年人在無成年人監督下使用生成式人工智能平臺的獨立聊天設置年齡下限。參考已有的未成年人獨立使用社交媒體聊天的相關法律[10][11][12],《指南》建議獨立使用生成式人工智能平臺聊天的年齡下限設置為13歲,并考慮16歲的更嚴格年齡限制。在我國,《生成式人工智能服務管理暫行辦法》提出生成式人工智能“提供者應當明確并公開其服務的適用人群”,并要求“采取有效措施防范未成年人用戶過度依賴或者沉迷生成式人工智能服務”[13]。相關監管部門應在此基礎上,考慮進一步明確未成年人在無成人監督下與生成式人工智能聊天平臺獨立聊天的年齡下限。

2 生成式人工智能用于教育內容獲取的悖論

(1)生成式人工智能的商業內容產品輸出不具備公共教育內容輸入的直接適用性

在商業領域,生成式人工智能提供商面向商業客戶開發并提供文案、圖像、繪畫、視頻和音樂等產品服務,然后按服務質量和數量收費的服務模式無可厚非。但是,內容收費服務模式與知識屬于公眾領域、教育提供屬于公益范疇的基本共識相悖。故而,這種以輸出商業內容產品為目的的技術,也不具備直接用作教育內容輸入的適用性。可能的解決方案包括開發和采用更具可承受性的本土教育生成式人工智能模型、政府集體購買現有平臺的使用權限并作為教育技術方案的一部分供學校和師生免費使用等方式,為教育系統提供可承受的生成式教育內容。而生成式人工智能在教育內容提供方面的適用性或適用的范圍,是一個更值得深入考證的悖論。

(2)生成式教育內容獲取悖論

生成式人工智能在內容生成方面取得的技術進展,引發了該技術可為教育提供教材和教師之外的第三方對話式知識獲取來源的邏輯聯想,也產生了可通過生成式人工智能解決貧困地區教育內容供給不足的假設,并引發了該技術會對知識的獲取和生成方式乃至教學互動過程產生革命性影響的預測[14]。基于對生成式人工智能技術原理的追溯,這些假設似乎存在多重悖論。

①技術設計“目的與用途”間的悖論:生成式人工智能技術的設計初衷,是服務于專業文案創作者、視覺效果設計者、法律服務或咨詢機構等。生成式人工智能平臺文本輸出中的少許錯誤或其他符號表征作品的缺陷,均可被具備高度鑒別能力的專業人員識別,并通過對話式的提示工程逐步剔除,最終輸出符合預期的作品。但學生尤其是低學段學生往往缺乏鞏固的事實性知識、專業領域知識、鑒別內容準確性的能力以逐步遞推的提示工程所需的元認知能力,不是生成式人工智能技術設計的直接目標人群,因此直接使用生成式人工智能的輸出作為學生尤其是低學段學生的主要學習內容來源也不符合其設計初衷。

②教師天然知識與“機器瓶裝內容”之間的選擇悖論:預訓練模型采用的訓練數據是人類教師知識儲備的數千萬倍,但人類教師的知識是由人理解、由人輸出的天然知識,其與學生的互動也是由人負責、由人隨時動態更正和更新的天然人際互動過程。預訓練模型的內容可用預先封裝的“瓶裝內容”來比喻,受其技術原理的局限,這種瓶裝知識廣度有余但準確度和人文互動不足。盡管谷歌、OpenAI等公司已將其大模型接入搜索引擎以支持即時信息和驗證,試圖打開“瓶裝內容”的“瓶蓋”。但如果忽視教師的天然知識及其對注意力、情緒等非智力因素的把控,而過分重視不理解語義和真實世界的機器內容,那么將陷入教學內容獲取主渠道的悖論。

③借助生成式人工智能面向貧困地區提供教學內容的預算悖論:針對教育內容和優質師資匱乏的貧困地區、通過生成式人工智能平臺支持學生內容獲取的主張,從邏輯上是一種“用更不可承受的方案解決固有資源匱乏問題”的悖論。生成式人工智能的部署和日常性可持續應用對數字設備和寬帶網普及率、學生數字技能等方面的數字準備狀態要求極高,缺乏經費提高生/師比的國家和地區不具備這些需要充足經費且數十年積累才能達到的數字化準備狀態。同時,越是在低收入國家和地區,個體用戶需承受的互聯網數據流量費用在其平均收入中的占比越高。據國際電信聯合會統計,非洲地區國家2022年的互聯網數據流量費用占平均國民收入的5%左右,低收入國家的互聯網數據流量費用占平均國民收入的9.3%[15]。在低收入地區的師生及家長已無力承擔現有通用互聯網數據流量費用的前提下,要求師生再承擔額外費用不具有可行性。

3 “內容預制菜”應用于教學過程的反智隱憂

生成式人工智能根據人類用戶的提示,在對各類素材進行模式識別基礎上輸出的文本、圖像、音樂、視頻等作品可稱為“內容預制菜”。“內容預制菜”既可作為最終成果,也可作為半成品供進一步編輯、完善。生成式人工智能基礎模型在商業領域的迅速普及,引發了“內容預制菜”商業模式在教育界的機械模仿。然而,學習主體在對確信的學習內容進行解構的基礎上,開展主體能動的知識建構、技能獲得和價值觀養成,是實現內容的教育價值的根基。通過機器對訓練用數據進行解構(即模式識別),在此基礎上建構的“內容預制菜”反映的是對學生內容解構的替代邏輯。盲目強調“內容預制菜”的教育變革價值,可能會引發多層面的反智隱憂。

①內容幻象引發基礎知識幻象。在內容輸出過程中,生成式人工智能平臺會生成關于客觀事實和學科知識的“一本正經”的錯誤或者說是內容幻象。如果缺乏成人或教師的及時糾錯,缺乏事實性知識和學習知識基礎的低學段學生會基于人工智能幻象形成基礎知識幻象。

②“內容預制菜”引發智力活動惰化。“內容預制菜”在商業領域可提高內容生產效率和質量。但在教育領域,內容更多地被用作教學講解和學生理解的信息或知識輸入,以培養人的智力、能力和價值觀為主要目的。生成式人工智能對內容解構和建構的自動化替代,會剝奪學生尤其是低學段學生有目的地獲取內容、有意識地從內容中解讀意義、進行知識理解或形成技能的認知過程。處于智力和能力成長期的未成年學生如果長期無批判、去原理解讀地復制“內容預制菜”并以此作為學習結果提交,會存在智力發展弱化(Intellectual Enfeeblement)的風險。

③與不理解世界的人工智能的對話可能引發導學反智。現有的壟斷性生成式人工智能系統并不能理解文本或圖像背后的真實世界,導致其在指導復雜知識的建構、結構不良問題的解決、通過觀察的經驗獲取等方面均具有明顯的技術劣勢。如果缺乏對此技術局限的理解,忽視教師引導的作用而過分依賴生成式人工智能聊天平臺對學生開展導學,將限制學生與現實世界互動中的經驗獲取、復雜問題解決能力的培養和價值觀的養成。

總之,應明確在生成式人工智能教育應用過程中師生主體主觀能動性的不可替代性,明確學生的復雜知識理解與建構、開放性問題解決、與真實世界的互動等尚屬于人工智能技術不能也不應替代的人類主體性教學的邊界。同時,要防止用不理解世界的生成式人工智能技術來取代教師輔助、引導學生高水平思維培養和開放式學習的理論假設或實踐模式。

四 基于教學育人需求解鎖技術潛能的生成式人工智能應用模式探索

在具體的教學過程中,生成式人工智能在基于模式識別的新內容生成、貫通表征符號的文圖轉換、參考提示標準的擬合度評判、提煉文圖要點的發散性聚合等方面具有較為明顯的優勢。解鎖生成式人工智能的技術潛能,應先鎖定教學育人的現實困境和發展需求,由此確認具有教育適用性的人機協作方案或研發可“解鎖”教學方式變革的創新實踐“密鑰”。對此,《指南》倡導構建“人類主導、主體適用的互動性應用”的生成式人工智能教學應用設計框架。在此基礎上,本研究建議將課程內容制作、雙基學習、特殊學習需求、高階思維、探究實踐等宏觀教學需求作為教學設計的主要情境和脈絡,并據此設計和實施適用于不同年齡和學習能力、不同學習領域需求的中觀課程與微觀教學,以超越內容過剩的人工智能教育應用現狀。

1 支持包容性課程資源制作的“轉換器”:手腳增強的“人頭馬模式”

人工智能與教育中人類主體的關系不應是簡單的競爭和替代,更不應是在已有數字化基礎上增加的額外數字系統負擔,而應從基礎性支持工具層面貫通或升級數字化工具,在課程資源開發、行政管理等場域成為與人類智能共生和全教學過程融合的減負增智工具。

生成式人工智能在教育領域與人類智能共生的應用模式之一是“人頭馬”模式,即借助生成式人工智能跨符號表征的內容“轉換器”性能,充當人類內容加工的增強型“手腳”,而人類專注于價值觀判斷、高水平思維和創造性活動。該模式已涌現的實踐應用場景主要是支持廣域課程資源開發和數字教材拓展的人機協作:生成式人工智能支持教育數字圖書館、教材庫、師生自創內容庫的自動化搜索與內容生成,并支持自動添加音視頻字幕、基于文本或視頻生成手語解說、基于文本生產視頻等跨符號表征的內容自動化加工,然后由人類審核確認并分享,實現包容性課程資源開發、拓展性數字教材支持等方面的人機互補。例如,為教師提供免費開源課程資源的英國“橡果學院”,通過生成式人工智能將課程內容轉錄為視頻并添加手語解說,然后由課程專家審核驗證,以確保人類主體的全過程決策(詳見https://www.thenational.academy);再如,韓國政府已宣布將在中小學各科電子教材中內嵌生成式人工智能技術(詳見https://news.kbs.co.kr/news/pc/view/view.do?ncd=7695671),該計劃將于2025年秋季全面推廣,其設計的功能之一,是通過生成式人工智能支持師生實現更智能化的課程資源檢索和格式轉換、教學流程中的實時問答、學習結果的多媒體作品制作等。

2 支持基本技能形成性評價與反饋的“判別器”:教學助理數字孿生模式

教育教學作為一種復雜的形成性社會關系實踐,并非在各個環節都需要實現個別化——其中最需要個別化的環節,是學生在練習基本技能過程中的形成性正誤判別和糾正。生成式人工智能可依據人類提供的標準,實現對可計算的技能表現結果的擬合度匹配和判別,并提供形成性評價與反饋。對此,可以挖掘生成式人工智能迅速而強大的“判別器”潛力,構建部分實現教學助理功能的生成式教學助理數字孿生模式。在教育領域,可計算的技能表現包括人類的語言發音與拼寫、計算機代碼、基礎性藝術學習中的基本藝術作品等。利用生成式人工智能,可以實現教師自身無法承擔的、針對學生基本技能學習表現的一對一自動判別和個別化分析性反饋。2023年,哈佛大學采用ChatGPT支持其“計算機基礎”課程的編碼教學[16],但該前瞻性探索不能被夸大為“哈佛大學用ChatGPT取代教師教計算機編程”:ChatGPT僅被用于幫助有堅實計算機知識技能基礎的大學生理解編程語句中的重點和難點,通過對話方式判別和解釋學生在學習過程中出現的代碼錯誤,并提供改進代碼編寫的建議等。

但是,開展基本技能訓練的教學助理數字孿生模式還遠遠不能支持語言領域的綜合語言應用能力和跨文化理解力、計算機領域的高級編程能力和計算思維、藝術領域的藝術想象力等高階能力的培養。另外,此模式對學生已有的知識技能基礎、自我監控和調整學習進展的元認知能力和自我監控能力都有較高的要求。因此,教學助理數字孿生模式更適合高校、中高等職業教育及成人學習者。

3 支持主體認知和探究的內容“增壓器”:從內容富裕到探究富裕的研究助理模式

生成式人工智能支持下內容生成過程的高度自動化和生成結果的難以判別性,將倒逼課程與評價目標從“內容富裕”轉為“探究富裕”。生成式人工智能合成的內容既無法被教師識別,也難以通過識別軟件判別。如果教學目標局限于事實性知識的記憶且評價僅考察事實性知識的表達,學生就極易通過技術合成的內容應付作業和評價,導致生成式人工智能作弊的泛濫。

生成式人工智能在教學領域的潛在優勢不是支持事實性知識的獲取,而在于為探究性學習提供人類信息加工能力所無法觸達的發散思維視角和文獻綜述廣度,并通過對內容的濃縮綜述和對數據的“增壓”處理提升高水平思維和探究活動的效率。對此,可以挖掘基于生成式人工智能的探究性活動“增壓器”潛力,探索研究助理模式或研究性學習助理模式。一個成人開發者借助生成式人工智能對話支持自我定制天氣預報軟件開發的實例(詳見https://medium.com/@liorelgali),展示了生成式人工智能技術在創意激發、已有工具的綜述和優缺點分析、專題研究、方案對比和功能取舍、自我思維局限挑戰等方面的探究性“增壓”價值。從科學發現的視域分析,人工智能基礎模型在數據搜集、挖掘、計算等方面的突破,為人類提供了繼觀察、實驗、推理之后的第四類科學發現范式——“基于人工智能的科學發現”(AI for Science)[17],使生成式人工智能研究助理模式在嚴謹的科學研究領域也有了巨大的應用空間。

需要注意的是,研究助理模式中的探究動機不可能通過技術的供給自動觸發,而必須由課程與評價目標的調整和人類教師的教學設計激發引導,并最終由學生自主自導。應對生成式人工智能作弊風險的挑戰,應允許學生借助技術替代一定低水平的內容處理,以從機械、重復中適度釋放無意義的時間消耗。同時,通過評價目標調整和教學設計,引導學生將“剩余學習時間”更多地用于探究性學習。此外,研究助理模式中的認知過程也應由人類主導,設計師生與技術協作互動的探究活動,確保學習主體進行了具身認知與協作探究。尤其要注意發揮人類在有意義的問題界定、聚合思維、問題解決方法的頓悟等方面的優勢,并與生成式人工智能的發散性內容綜述和報告生成互補,實現人機智力的相互增強。

五 結語

考證生成式人工智能的教育適用性,不能局限于從已有教育體系的固有教育目標出發進行單向論證。近七八年來,人工智能已展現出通過任務單元的自動化來替代已有工作崗位、創造新崗位、打破現有工作技能培養格局的顛覆能力。生成式人工智能對工作崗位的顛覆已始于文稿創作、圖像制作、音視頻加工等行業[18],但其對工作崗位及其技能預期的沖擊不會僅限于此。盡管生成式人工智能不應撼動教育的基本心智能力培養、價值觀樹立等育人目標,但其對工作技能更新與課程教學目標調適的即時沖擊和長遠影響已成為各國需共同面對的基礎性課題。

生成式人工智能雖仍有較大的迭代創新空間,但現有的模型不理解語義和真實世界的技術局限會限制其變革教育的潛能,并模糊了教學過程中相對獨立地引導復雜知識建構和問題解決的人際互動邊界。從“傳道、授業、解惑”的教育價值底線出發,可將生成式人工智能技術的適用性概述如下:目前該技術具有較強的一對一“解惑”能力,但應首先確保學生獨立聊天的年齡限制和平臺的價值觀去偏;經由教育數據訓練的基礎模型會獲得一定的個別化“授業”能力,但目前僅限于對學習結果表現具有可計算性的有限“學業”領域,這就需要警惕人工智能內容輸出對學生內部認知過程的替代和惰化;在目前及可預見的未來,人工智能技術不但不具備“傳道”的育人適用性,而且在數字安全、價值觀誤導、學習過程反智等方面已顯現出反育人的威脅。對此,在討論生成式人工智能是否可以為教學育人的種種問題提供“新答案”之前,必須先辨析和防范其造成的“新問題”。

[1][10]Miao F C, Wayne H. Guidance for generative AI in education and research[M]. Paris: UNESCO, 2023:1-38.

[2]Dell’Acqua F. Navigating the jagged technological frontier: Field experimental evidence of the effects of AI on knowledge worker productivity and quality[OL].

[3]Bommasani R, Hudson D A, Adeli E, et al. On the opportunities and risks of foundation models[OL].

[4]Stanford University. Artificial intelligence index report[OL].

[5][6]Thompson A D. Contents of GPT-3 the pile v1[OL].

[7]Touvron H, Martin L, Stone K, et al. Llama 2: Open foundation and fine-tuned chat models[OL].

[8]苗逢春.數字文明變局中的教育數字化轉型[J].電化教育研究,2023,(2):47-63、91.

[9][13]中國網信網.生成式人工智能服務管理暫行辦法[OL].

[11]Federal Trade Commission. Children’s online privacy protection act of 1998[OL].

[12]European Union. General data protection regulation[OL].

[14]David B A, Ansah L O. Education in the era of generative AI: Understanding the potential benefits of ChatGPT in promoting teaching and learning[J]. Journal of AI, 2023,(7):52-62.

[15]United Nations. A global digital compact: An open, free and secure digital future for All[R]. New York: UN, 2023:4.

[16]Coffey L. Harvard taps AI to help teach computer science course[OL].

[17]Wang H, Fu T, Du Y. et al. Scientific discovery in the age of artificial intelligence[J]. Nature, 2023,620:47-60.

[18]Frey C B, Osborne M. Generative AI and the future of work: A reappraisal[J]. Brown Journal of World Affairs, 2023:1-12.

Examination of the Technique Principle of Generative AI and Its Educational Applicability

MIAO Feng-chun1,2

The paper is the first edition of a series of interpretative articles on the Guidance for Generative Artificial Intelligence(GenAI) in education and research released by UNESCO, focusing on the tracking of the technique principle behind GenAI and the examination of its educational applicability. GenAI is a category of AI technology that can produce new content across symbolic representations used by human thinking, but its technological limitation of not being able to understand semantics of text will reduce its potential in transforming education. As foundation models, GenAI has triggered the upgrading of monopolized digital infrastructure and generated threats on digital security and it risks to project the linguistic and cultural bias held by western people whose data were used to train GPT models. The development of self-automatic GenAI models, especially EdGPT, is threshold for the secure and trustable use of GenAI in education. Based on the datasets generated by adults’ application of the Internet used to train GPT models, the chatbots-based service is not appropriate for independent use by children, and national regulatory agencies should set up the age restriction for children’s independent conversations with GenAI chatbots. From the perspective of provision of education content, the use of the service of generative content priced by tokens as main sources of education content is a paradox that is not supported by the original design of GenAI and the main aims of education. From the processes of learning and values fostering, an allegory of “automatic prefabricated content dishes” helps reveal that the unconscious use of outputs of GenAI risks of enfeeblement through reducing human agency in deconstructing content in order to construct knowledge and develop skills. The co-creation of inclusive curricular content, foundational learning, learners with special needs, and higher-order thinking as well as inquiry practices are the main contextual criteria to design human-agent and pedagogy-proper interactive use of GenAI in teaching and learning.

GenAI; ChatGPT; symbolic representations of human thinking; biases in values and linguistic biases; educational applicability; foundation model

G40-057

A

1009—8097(2023)11—0005—14

10.3969/j.issn.1009-8097.2023.11.001

苗逢春,北京師范大學研究員,聯合國教科文組織總部部門主任,研究方向為人工智能與教育、數字學習政策、未來數字學校,郵箱為f.miao@unesco.org。

2023年8月28日

編輯:小米