習題內外表示異質融合的知識追蹤模型

張凱 付姿姿 紀濤

摘 要:現有知識追蹤研究大多使用習題蘊涵的知識點等內隱信息或歷史交互數據等外顯信息建模習題表示,沒有注意到內外信息的異質性特征,缺乏對習題內外信息的異質融合。針對上述問題,提出了融合內外異質信息的知識追蹤模型。首先,基于知識點等內隱信息,計算歷史知識點與當前知識點之間的相關程度,刻畫歷史知識點對當前知識點的影響,建模習題的內隱表示;其次,基于交互數據等外顯信息,計算歷史習題與當前習題之間的相關程度,獲取歷史習題對當前習題的影響,建模習題的外顯表示;再次,基于上述習題的內外表示,使用通道注意力機制融合得到習題的內外異質表示,從而預測學習者的作答表現。為了驗證提出模型的性能和有效性,選取了四個相關的基線模型,在三個真實數據集上進行了對比實驗。實驗結果表明:在性能方面,提出的模型在多個評價指標上均取得較好的效果;在有效性方面,消融實驗證明了提出的模型可以更好地根據內外信息建模習題表示;在應用方面,設計智慧學習環境證明了提出的模型在實際教學場景中的可用性。

關鍵詞:知識追蹤; 習題表示; 通道注意力機制; 異質融合

中圖分類號:TP391?? 文獻標志碼:A

文章編號:1001-3695(2024)03-017-0764-08

doi:10.19734/j.issn.1001-3695.2023.07.0308

Knowledge tracing via heterogeneous fusion ofexercises internal and external representations

Zhang Kai, Fu Zizi, Ji Tao

(School of Computer Science, Yangtze University, Jingzhou Hubei 434023, China)

Abstract:Most of the existing knowledge tracing research use implicit information such as concepts contained in exercises or explicit information such as historical interaction data to model exercises,they dont pay attention to the heterogeneity of internal and external information, and lack heterogeneous fusion of internal and external information. To address these issues, this paper proposed a knowledge tracing model that integrated heterogeneous internal and external information. Firstly, this model calculated the relevance between historical concepts and current concepts based on implicit information like concepts, depicted the influence of historical concepts on the current ones and modeled the exercises implicit representation. Secondly,it computed the relevance between historical exercises and current exercises by explicit information like interaction data, captured the impact of historical exercises on the current ones and established the exercises explicit representation. Furthermore, this paper utilized the channel attention mechanism on the aforementioned internal and external exercises representation, and achieved a fusion of heterogeneous information to create the exercises heterogeneous representation, enabling the prediction of learners performance. To validate the performance and effectiveness of the proposed model, this paper conducted comparative experiments on three real-world datasets using four relevant baseline models. The experimental results demonstrate that the proposed model achieves superior performance on multiple evaluation metrics. Additionally, ablation experiments confirm the effectiveness of the proposed model in better modeling exercise representations by incorporating both internal and external information. In the terms of applications, it designed a smart learning environment to prove the advantages of the proposed model in actual teaching scenarios.

Key words:knowledge tracing; exercises representation; channel attention; heterogeneous fusion

0 引言

知識追蹤以學習者與習題的交互記錄為輸入,通過刻畫習題及其知識點的信息,探索歷史習題對當前習題的作用來增強習題表示,建模學習者的知識狀態,最終預測學習者未來的答題表現。隨著在線教育平臺,如edX、Courersa和學堂在線等的廣泛應用,為知識追蹤模型提供了海量的交互數據,從而可以自動追蹤學習者動態變化的知識狀態,為個性化教學提供依據[1~6]。

習題的表示是知識追蹤領域關注的焦點,現有的研究主要從兩個方面來刻畫習題:a)通過描述習題及其知識點蘊涵的信息,聚合得到習題的表示,這種信息屬于習題的內隱信息;b)捕獲歷史交互數據對當前習題的影響,以此增強習題表示,這種信息屬于習題的外顯信息。然而上述兩種方法均只從習題的內隱信息或外顯信息單方面考慮,忽略了這兩種信息的異質性特征,沒有實現習題內外信息的融合協同。

基于這種研究現狀,為了更好地刻畫習題,提出了習題內外表示異質融合的知識追蹤模型。首先,根據習題及其知識點的內隱信息,建模基于內隱信息的習題表示;其次,利用學習者與習題的歷史交互數據計算歷史習題對當前習題的影響,建模基于外顯信息的習題表示;再次,根據上述兩種習題表示,建模習題內外表示異質融合的過程,推導出習題的內外融合表示;最后計算知識狀態,預測學習者未來的答題表現。

1 相關工作

1.1 基于內隱信息的習題表示

表示習題所用到的內隱信息一般包括習題和知識點的編號、習題文本信息以及習題內部知識點之間的相互關系等。DKT[7]是深度學習模型在知識追蹤領域的首次應用,它利用獨熱編碼的方法表示習題編號。與DKT類似的還有DEKT[8]、S-GRU-R[9]和ATCKT[10]等,它們把習題描述成嵌入向量,每個嵌入向量包含了對應習題的編號信息。另外,EERNN[11]定義了一個雙向LSTM網絡來提取習題文本信息,以此獲取習題的表示。這些模型都是通過建模習題的編號、文本信息等來描述習題,沒有具體從知識點的角度細化習題的表示。針對這一問題,DKVMN[12]利用靜態矩陣存儲知識點編號,通過歸一化計算不同知識點的權重,以此計算出習題的表示,這種方法用知識點編號等信息來建模習題。與該方法相似的還有MSKT[13]和EKT[14]等。更進一步地, ContextKT[15]設計QR矩陣,包含習題和知識點的上下文信息,得到習題的表示。CRKT[16]以知識點的內涵表示為基礎,根據知識點間的相似性,利用圖神經網絡建模知識點間的關系,以此表示習題。IDKT[17]結合上下文信息構建知識點-習題的關系圖,利用圖注意力網絡聚合知識點之間的相互關系得到增強的習題表示。DGMN[18]用圖卷積神經網絡捕獲知識點之間的作用關系,進而利用知識點來描述習題。

上述模型主要通過習題的內隱信息來表示習題,這種方式以習題和知識點為基礎,從不同的角度建模了內隱信息在習題表示中的各種作用,取得了不錯的效果。但也把表示習題的信息局限在了內隱信息的范疇,沒有考慮到學習者與習題的交互數據等外顯信息對習題表示的影響。

1.2 基于外顯信息的習題表示

表示習題所用到的外顯信息一般包括學習者作答習題的正誤情況等交互數據、學習者嘗試作答次數和請求提示次數等學習行為數據以及歷史習題與當前習題之間的影響等。TCN-KT[19]根據學習者與習題的交互數據計算遺忘參數,融入習題的表示,利用卷積神經網絡聚合時間窗口內歷史習題對當前習題的影響,增強了習題的表示。與這種方法類似的還有F-TCKT[20],它利用歷史交互數據,引入三個遺忘因素來建模習題的表示。更進一步地,NKTF-DKT[21]通過人工標注的方式,為習題表示引入了難度特征;AKTHE[22]從學習者與習題的交互數據中計算出習題的難度和區分度等外顯信息,以此構建異構圖,利用注意力機制對每個歷史習題分配權重,得到更有表征能力的習題表示;DKT-DSC[23]結合學習者的作答記錄計算出學習者能力,以此更新習題表示;DSCMN[24]利用學習者與習題間的交互信息區分習題的難度并將學生能力動態分類,得到更有表征能力的習題表示;KTCR [25]利用Q矩陣得到知識點的上下文信息,結合學習行為數據建模習題的表示;QRAKT[26]通過歷史交互數據計算出習題之間的相似性,建模習題的關系矩陣,從而建模習題的表示;DKTS[27]構建習題關系圖,從歷史交互數據中捕獲習題之間的相似關系,聚合得到習題的表示;RKT[28]結合習題的上下文以及學習者與習題的交互數據,計算習題之間的作用關系,以此得到習題的表示。

上述模型都是通過習題的外顯信息建模習題的表示,這種方法建模了外顯信息對習題表示的不同作用,但僅考慮了時間窗口內固定長度的歷史習題序列,無法從全局的角度建模所有歷史習題對當前習題的直接影響。綜上所述,當前的研究利用習題的內外信息從兩個方面建模習題的表示。然而,在根據知識點等內隱信息刻畫習題時,未能注意到相同知識點在不同習題表示中的不同作用。在根據交互數據等外顯信息刻畫習題時,僅考慮了時間窗口內的數據,沒有從全局建模歷史習題對當前習題的直接影響。更重要的是,分別基于內隱信息和外顯信息得到的習題表示具有異質性差異,上述研究沒有建模習題內外信息融合協同的過程,無法形成融合協同的習題表示。

為了更準確地建模習題的表示,利用習題的內隱信息和外顯信息等刻畫習題的內外表示,消弭內外表示的異質性差異,融合得到更具表征能力的習題表示。主要工作包括:a)以習題、知識點及知識點間的相互關系等內隱信息為基礎,建模習題的內隱表示;b)根據學習者與習題的交互數據等外顯信息計算歷史習題與當前習題之間的相關程度,建模歷史習題對當前習題的影響,聚合刻畫習題的外顯表示;c)建模上述兩種習題表示的融合過程,利用通道注意力機制提取權重,實現習題內外信息的異質性協同,得到習題的內外融合表示,并結合答題結果結合,建模知識狀態,從而預測學習者的未來表現。

2 習題內外表示異質融合的知識追蹤模型

2.1 提出的思想

在知識追蹤模型中,習題的表示受其蘊涵知識點等內隱信息的影響,例如包含不同知識點的習題,在表示上會存在區別。另一方面,習題的表示也受到學習者與習題的交互數據等外顯信息的影響,例如已作答的習題會影響未來相似習題的表示。已有研究分別基于內隱信息和外顯信息刻畫了習題的表示,但尚未注意到這兩種表示的異質性特征,無法實現習題內外信息異質性協同表示。

綜上所述,為了準確地描述習題,本文提出了習題內外表示異質融合的知識追蹤模型。a)根據習題、知識點以及知識點間的相互關系獲取習題的內隱表示;b)根據交互數據建模歷史習題對當前習題的影響,獲取習題的外顯表示;c)通過對上述兩種習題表示的融合,實現內外異質信息的協同,獲取習題的內外融合表示;d)利用自注意力機制建模不同時刻的知識狀態,計算歷史作用到當前的融合知識狀態。整體模型架構如圖1所示。

2.2 問題定義

設知識點的總數為M,任一知識點可以表示為cp,其中p的取值為1≤p≤M。設習題的總數為N,學習者作答的第t個題目可以表示為qt∈Euclid ExtraaBpN×1,其中t的取值為1≤t≤T,T表示某次學習過程交互習題的總數。rt={0,1}表示習題qt作答的結果,0表示作答錯誤,1表示作答正確,(qt,rt)是學習者與習題的交互數據。lt表示習題qt作答完成的時刻。

2.3 基于內隱信息的習題表示

習題的表示會受其蘊涵知識點的影響,并且不同的知識點之間也會存在作用關系,這些作用關系通過改變知識點,進而改變包含知識點的習題,最終影響習題的表示。為了建模上述過程,首先計算知識點的嵌入表示,其次建模歷史知識點對當前知識點的影響,最后根據上述知識點及其作用關系等內隱信息聚合得到習題的內隱表示。

3 實驗與分析

3.1 實現方法

HFER-KT模型以知識點、習題、習題的作答結果和習題的作答時間等為輸入,以當前習題的預測結果為輸出,具體實驗步驟如下:

a)建模習題的內隱表示。對數據集中的全體知識點進行編碼并映射成嵌入向量,利用皮爾森相關系數計算知識點之間的相關程度,建模知識點之間的影響,得到習題的內隱表示qIt。

b)建模習題的外顯表示。對數據集中的全體習題進行編碼,通過對數據集中的交互記錄進行統計,計算得到習題之間的相關程度,建模習題之間的影響,得到習題的外顯表示qEt。

c)建模習題的內外融合表示。定義習題的內隱表示矩陣XI和習題的外顯表示矩陣XE,利用通道注意力計算習題內外表示的權重,通過卷積網絡提取特征得到習題內外融合表示矩陣XIE,矩陣中的每一列代表對應時刻的作答習題的內外融合表示。

d)建模知識狀態。把不同時刻的學習者的答題結果映射成零向量,結合習題的內外融合表示,通過注意力機制建模知識狀態ht。

e)預測結果。將知識狀態與習題的內外融合表示結合,輸出預測結果yt。

3.2 數據集

本節使用三個在知識追蹤領域常用的真實數據集進行對比實驗,具體介紹如下:

a)ASSISTments2009(Assist09)[29]。該數據集是2009—2010年由在線教育平臺ASSISTments收集而來的。因其存在較多重復數據的問題,后續又發布了更新版本,去除了重復的數據,使用的是更新版數據集。

b)Statics2011(Statics11)[30]。該數據集來源于某大學的工程力學課程,該類習題一般包括多個知識點。相較于其他數據集而言,Statics11包含相對較少的習題,習題中每個知識點都作為單獨的標簽。

c)Junyi Academy(Junyi)[31]。該數據集源于2015年Junyi學院的交互日志,包含了25萬名學習者的超過2 500萬交互記錄,是目前數據量最大的數據集。

表1從習題、學習者和交互記錄數量三個方面描述了數據集的基本信息。

3.3 基線模型

為了展示HFER-KT模型的性能,從使用內隱信息或外顯信息的角度選取了四個基線模型,分別是ATCKT、DKVMN、QRAKT、RKT。ATCKT模型嵌入表示習題編號,習題編號屬于內隱信息,但是它沒有考慮習題蘊涵的知識點等內隱信息,也未能建模外顯信息對習題表示的影響;DKVMN模型首次使用靜態矩陣存儲知識點編號,以此來表示習題,知識點編號屬于內隱信息,該模型開辟了用知識點表示習題的新方法,但尚未注意交互數據等外顯信息對習題表示的影響;QRAKT模型通過計算習題嵌入向量之間的相似性,得到習題的關系矩陣Q,歷史習題與當前習題的作用關系屬于外顯信息,但該模型沒有考慮到習題的知識點及其作用關系等內隱信息對習題表示的影響;RKT模型利用學習者與習題的交互數據和習題的文本信息計算習題之間的相似程度,習題的交互數據屬于外顯信息,習題的文本信息屬于內隱信息,但該模型沒有融合習題內外信息之間的異質性差異。

3.4 實驗環境

實驗的運行環境配置如表2所示,具體包含了主要的軟硬件配置基本情況。

3.5 性能對比實驗

本文使用AUC(area under ROC curve)、準確率(Acc)和精確率(precision)作為評價指標,通過與上述基線模型的對比來驗證HFER-KT模型的性能。其中:AUC是指ROC曲線下面積,表示模型在預測過程中真實答對率(預測答對且實際答對)大于虛假答對率(預測答對但實際答錯)的概率,取值為[0.5,1],AUC的值越大,說明模型預測性能越好;Acc表示模型預測正確的樣本個數(預測答對實際答對與預測答錯實際答錯的樣本個數之和)占所有樣本個數的比值,Acc的值越大,說明模型預測正確的概率越高;precision表示模型預測答對的樣本個數與總答對樣本個數的比值,precision的值越大,說明作答結果為對時模型預測的準確率越高。

圖2是本文HFER-KT模型與四個基線模型在三個真實數據集上的AUC結果對比。

根據圖2展示的實驗結果可以看出,HFER-KT模型在三個數據集上的AUC均表現較好,對比第二名ATCKT模型,在三個數據集中分別提高了0.023%、1.96%和2.32%。分析呈現出這種結果的可能原因是:ATCKT模型根據習題的編號等嵌入表示習題,使用的信息較為單一,缺乏建模交互數據等外顯信息對習題表示的影響,從而導致該模型的預測性能略低于HFER-KT模型。與ATCKT模型不同的是,HFER-KT模型不僅使用了知識點等內隱信息描述習題,也把交互數據等外顯信息納入建模范疇,融合推導出更具表征能力的習題表示,從而取得了更好的實驗結果,說明了HFER-KT模型的有效性。

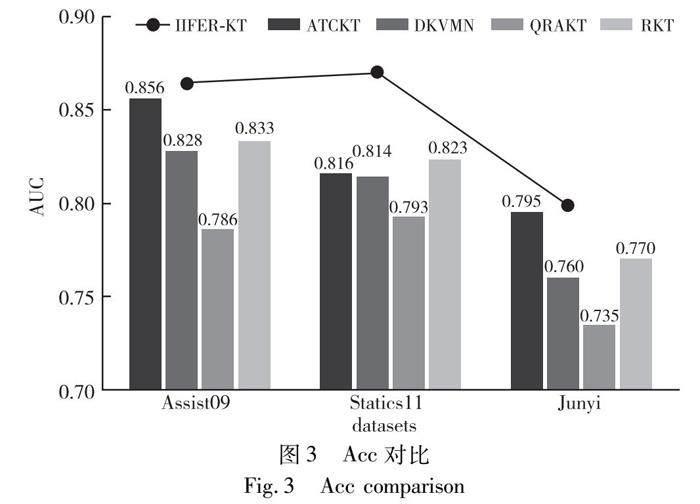

圖3是本文HFER-KT模型與四個基線模型在三個真實數據集上的Acc結果對比。

根據圖3展示的實驗結果可以看出,HFER-KT模型在三個數據集上的Acc均取得了一定的優勢。其中,在Statics11數據集上的表現最好,與第二名RKT模型對比,Acc提高了4.74%。出現這種結果的主要原因可能是:RKT模型利用習題的內隱信息和外顯信息建模習題的表示,但沒有注意到這兩種信息的異質性特征,缺少建模習題內外信息協同融合的過程,導致習題的表示不夠全面,從而表現出實驗結果欠佳。HFER-KT模型分別描述了習題內外異質信息對習題表示的作用,并實現了內外異質信息的協同,融合得到新的習題表示。上述實驗結果可以驗證該建模方法的有效性。

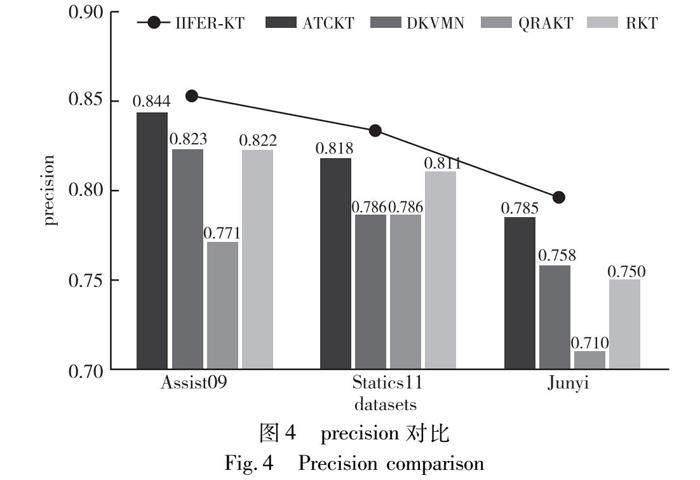

圖4是本文HFER-KT模型與四個基線模型在三個真實數據集上的precision結果對比。

根據圖4的實驗結果可以看出,HFER-KT模型在三個數據集中的precision均取得了更好的結果,與第二名ATCKT模型對比,本文模型在三個數據集中的precision分別要高出0.09%、1.55%和1.14%。說明HFER-KT模型的預測性能略優于對比模型。可以看出在Junyi數據集上,所有模型的precision均有不同程度的降低,分析造成這種結果的原因是Junyi數據集龐大的數據量造成的誤差。

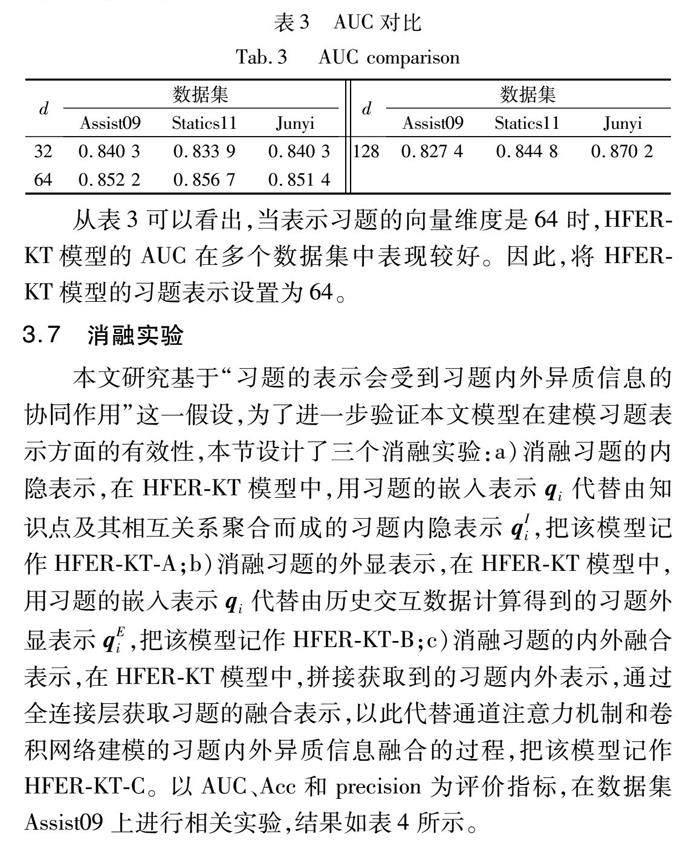

3.6 參數對比實驗

參數設置是影響模型訓練效率以及預測準確率的重要因素,為了進一步確定HFER-KT模型的最佳參數,設計了參數對比實驗。具體如下:分別把習題表示的維度設置為32,64,128,對比不同維度的情況下HFER-KT模型的最佳AUC,實驗結果如表3所示。

從表3可以看出,當表示習題的向量維度是64時,HFER-KT模型的AUC在多個數據集中表現較好。因此,將HFER-KT模型的習題表示設置為64。

3.7 消融實驗

本文研究基于“習題的表示會受到習題內外異質信息的協同作用”這一假設,為了進一步驗證本文模型在建模習題表示方面的有效性,本節設計了三個消融實驗:a)消融習題的內隱表示,在HFER-KT模型中,用習題的嵌入表示qi代替由知識點及其相互關系聚合而成的習題內隱表示qIi,把該模型記作HFER-KT-A;b)消融習題的外顯表示,在HFER-KT模型中,用習題的嵌入表示qi代替由歷史交互數據計算得到的習題外顯表示qEi,把該模型記作HFER-KT-B;c)消融習題的內外融合表示,在HFER-KT模型中,拼接獲取到的習題內外表示,通過全連接層獲取習題的融合表示,以此代替通道注意力機制和卷積網絡建模的習題內外異質信息融合的過程,把該模型記作HFER-KT-C。以AUC、Acc和precision為評價指標,在數據集Assist09上進行相關實驗,結果如表4所示。

從表4可以看出,在Assist09數據集中,HFER-KT模型的AUC、Acc和precision均取得了最好的結果。另外,HFER-KT-A模型的性能數據與HFER-KT模型相差最大,分析其原因可能是:HFER-KT-A模型沒有描述知識點及其作用關系對習題表示的影響,導致獲取的習題表示缺乏表征能力,從而影響模型的性能。這驗證了內隱信息會作用于習題表示的假設。HFER-KT-B模型的性能略好于HFER-KT-A模型,但依舊不及HFER-KT模型,其原因可能是:HFER-KT-B模型忽略了學習者與習題的交互數據對習題表示的作用,只建模了基于內隱信息的習題表示,從而導致模型性能不佳。這驗證了外顯信息會作用于習題表示的假設。最后,HFER-KT-C模型的性能也次于HFER-KT模型,其原因可能是:該模型僅利用全連層計算了習題的融合表示,建模習題內隱和外顯信息異質融合的方式欠妥,導致模型的性能不佳。這驗證了利用通道注意力機制和卷積神經網絡建模協同融合習題內外信息,建模習題內外異質融合表示的有效性。

3.8 表示質量對比實驗

模型的表示質量是指模型的預測結果與實際應用結果之間的差異。例如,A模型通過某個真實數據集訓練后,測試顯示具有良好的預測性能。現將A模型應用于實際教學環境中,該模型預測有80%的學生能夠答對B習題,但實際情況顯示只有60%的學生能作答正確。這顯然與真實情況相差較大,說明A模型的表示質量欠佳,不能很好地適用于實際環境。一般使用模型的預測概率與真實概率之間的差值來衡量模型的表示質量,預測概率與真實概率之間的差值越小,說明模型更能貼合實際情況。

從表5的結果可以看出,不論真實概率較低還是較高,HFER-KT模型與真實概率之間的差值都最小,這表明了HFER-KT模型的表示質量更好,具有更穩定的性能,更為貼合實際情況。其次,ATCKT模型的差值表現僅次于HFER-KT模型,分析原因可能是ATCKT模型嵌入表示了習題編號,但沒有建模交互數據等外顯習題對習題表示的影響。實驗結果驗證了HFER-KT模型協同融合習題內外異質信息,建模習題內外異質融合表示的有效性。

3.9 模型的應用

為了檢驗本文HFER-KT模型在實際教學場景中的有效性,設計開發了“學習數據與認知模型雙驅動的跨模態多尺度自適應智慧教學環境 (CMA-ITE)”。該智慧教學環境包含習題、知識點等多模態內隱信息,也包含學習者答題記錄和學習行為數據等多模態外顯信息,建模多時空尺度的學習者認知功能來完成對學習者知識狀態的判斷和預測;同時,集成了選取的若干基線模型,便于在實際教學環境中對比分析各個模型的效果并進行差異評估。智慧教學環境的部分功能如圖5和6所示。

智慧教學環境包含4 151名學習者和110個知識點,保存了不同學習者與習題的交互記錄,并對這些記錄進行處理,將80%用作訓練集,20%用作測試集,得到各個模型的平均預測準確率,具體結果如表6所示。

從表6可以看出,HFER-KT模型相較于只利用內隱信息建模習題表示的ATCKT和DKVMN模型,在實際應用中呈現出一定的優勢,與只利用外顯信息建模習題表示的QRAKT模型相比,更是具有明顯的優勢。RKT模型雖然使用了內隱信息和外顯信息,但沒有建模內外信息異質融合的過程,因此在實際應用中的效果與本文HFER-KT模型相比略有不足。上述實驗結果驗證了HFER-KT模型通過習題內外信息建模內外信息異質融合表示的有效性。

4 結束語

本文提出了一個習題內外表示異質融合的知識追蹤模型,用于解決現存知識追蹤模型未曾綜合建模習題內外異質信息的問題。HFER-KT模型分別根據習題的內隱信息和外顯信息計算出習題的兩種表示,并利用通道注意力機制和卷積神經網絡融合上述兩種表示的異質性特征,完成了對不同信息的協同融合。該模型在三個真實數據集上與四個基線模型進行對比,多個實驗結果表明,本文模型在性能和訓練效率方面具有一定的優勢,同時驗證了模型在協同建模習題的內外信息方面的有效性。未來的研究工作將進一步挖掘習題的表示及其作用關系對知識追蹤模型的影響。

參考文獻:

[1]張暖, 江波. 學習者知識追蹤研究進展綜述[J]. 計算機科學, 2021,48(4): 213-222. (Zhang Nuan, Jiang Bo. Review progress of learner knowledge tracing[J]. Computer Science, 2021,48(4): 213-222.)

[2]劉鐵園, 陳威, 常亮, 等. 基于深度學習的知識追蹤研究進展[J]. 計算機研究與發展, 2021,59(1): 81-104. (Liu Tieyuan, Chen Wei, Chang Liang, et al. Research advances in the knowledge tracing based on deep learning[J]. Journal of Computer Research and Development, 2021,59(1): 81-104.)

[3]梁琨, 任依夢, 尚余虎, 等. 深度學習驅動的知識追蹤研究進展綜述[J]. 計算機工程與應用, 2021,57(21): 41-58. (Liang Kun, Ren Yimeng, Shang Yuhu, et al. Review of knowledge tracing preprocessing based on deep learning[J]. Computer Engineering and Applications, 2021,57(21): 41-58.)

[4]李菲茗, 葉艷偉, 李曉菲, 等. 知識追蹤模型在教育領域的應用: 2008—2017年相關研究的綜述[J]. 中國遠程教育, 2019(7): 86-91. (Li Feiming, Ye Yanwei, Li Xiaofei, et al. Application of knowledge tracing models in education: a review of relevant research from 2008 to 2017[J]. Distance Education in China, 2019(7): 86-91.)

[5]盧宇, 王德亮, 章志, 等. 智能導學系統中的知識追蹤建模綜述[J]. 現代教育技術, 2021,31(11): 87-95. (Lu Yu, Wang De-liang, Zhang Zhi, et al. A review of knowledge tracing modeling in intelligent tutoring systems[J]. Modern Educational Technology, 2021,31(11): 87-95.)

[6]曾凡智, 許露倩, 周燕, 等. 面向智慧教育的知識追蹤模型研究綜述[J]. 計算機科學與探索, 2022,16(8): 1742-1763. (Zeng Fanzhi, Xu Luqian, Zhou Yan, et al.Review of knowledge tracing model for intelligent education[J]. Journal of Frontiers of Computer Science and Technology, 2022,16(8): 1742-1763.)

[7]Piech C, Bassen J, Huang J, et al. Deep knowledge tracing[C]//Proc of the 28th International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2015: 505-513.

[8]熊余, 張健, 王盈, 等. 基于深度學習的演化知識追蹤模型[J]. 電化教育研究, 2022,43(11): 23-30. (Xiong Yu, Zhang Jian, Wang Ying, et al. An evolutionary knowledge tracing model based on deep learning[J]. e-Education Research, 2022,43(11): 23-30.)

[9]黃彩蝶, 王昕萍, 陳良育, 等. 基于堆疊門控循環單元殘差網絡的知識追蹤模型研究[J].華東師范大學學報:自然科學版, 2022(6): 68-78. (Huang Caidie, Wang Xinping, Cheng Liangyu, et al. Research on a knowledge tracing model based on the stacked gated recurrent unit residual network[J]. Journal of East China Normal University: Natural Science, 2022(6): 68-78.)

[10]邵小萌, 張猛. 融合注意力機制的時間卷積知識追蹤模型[J]. 計算機應用, 2023,43(2): 343-348. (Shao Xiaomeng, Zhang Meng. Temporal convolutional knowledge tracing model with attention mechanism[J]. Journal of Computer Applications, 2023,43(2): 343-348.)

[11]Su Yu, Liu Qingwen, Liu Qi, et al. Exercise-enhanced sequential modeling for student performance prediction[C]//Proc of the 32nd AAAI Conference on Artificial Intelligence and the 30th Innovative Applications of Artificial Intelligence Conference and the 8th AAAI Symposium on Educational Advances in Artificial Intelligence. Palo Alto, CA: AAAI Press, 2018: 2435-2443.

[12]Zhang Jiani, Shi Xingjian, King I, et al. Dynamic key-value memory networks for knowledge tracing[C]//Proc of the 26th International Conference on World Wide Web. New York:ACM Press, 2017: 765-774.

[13]宗曉萍, 陶澤澤. 基于掌握速度的知識追蹤模型[J]. 計算機工程與應用, 2021,57(6): 117-123. (Zong Xiaoping, Tao Zeze. Knowledge tracing model based on mastery speed[J]. Computer Engineering and Application, 2021,57(6): 117-123.)

[14]Liu Qi, Huang Zhenya, Yin Yu, et al. EKT: exercise-aware know-ledge tracing for student performance prediction[J]. IEEE Trans on Knowledge and Data Engineering, 2021,33(1): 100-115.

[15]Yu Minghe, Li Fan, Liu Hengyu, et al. ContextKT: a context-based method for knowledge tracing[J]. Applied Sciences, 2022,12(17): 8822.

[16]張凱, 劉月, 覃正楚, 等. 概念表示增強的知識追蹤模型[J]. 計算機應用研究, 2022,39(11): 3309-3314. (Zhang Kai, Liu Yue, Qin Zhengchu, et al. Concept representation enhanced knowledge tracing[J]. Application Research of Computers, 2022,39(11): 3309-3314.)

[17]劉坤佳, 李欣奕, 唐九陽, 等. 可解釋深度知識追蹤模型[J]. 計算機研究與發展, 2021,58(12): 2618-2629. (Liu Kunjia, Li Xinyi, Tang Jiuyang, et al. Interpretable deep knowledge tracing[J]. Journal of Computer Research and Development, 2021,58(12): 2618-2629.)

[18]Abdelrahman G, Wang Qing. Deep graph memory networks for forgetting-robust knowledge tracing[J]. IEEE Trans on Knowledge and Data Engineering, 2022,35(8): 7844-7855.

[19]王璨, 劉朝暉, 王蓓, 等. TCN-KT:個人基礎與遺忘融合的時間卷積知識追蹤模型[J]. 計算機應用研究, 2022,39(5): 1496-1500. (Wang Can, Liu Zhaohui, Wang Bei, et al. TCN-KT:temporal convolutional knowledge tracking model based on fusion of personal basis and forgetting[J]. Application Research of Computers, 2022, 39(5): 1496-1500.)

[20]張鵬, 文磊. F-TCKT:融合遺忘因素的深度時序卷積知識追蹤模型[J]. 計算機應用研究, 2023,40(4): 1070-1074. (Zhang Peng, Wen Lei. F-TCKT: deep temporal convolutional knowledge tracking model with forgetting factors[J]. Application Research of Computers, 2023,40(4): 1070-1074.)

[21]魏思, 沈雙宏, 黃振亞, 等. 融合通用題目表征學習的神經知識追蹤方法研究[J].中文信息學報, 2022,36(4): 146-155. (Wei Si, Shen Shuanghong, Huang Zhenya, et al. Integrating general exercises representation learning into neural knowledge tracing[J]. Journal of Chinses Information Processing, 2022,36(4):146-155.)

[22]Zhang Nan, Du Ye, Deng Ke, et al. Attention-based knowledge tracing with heterogeneous information network embedding[C]//Proc of the 13th International Conference on Knowledge Science, Engineering and Management. Cham: Springer, 2020: 95-103.

[23]Minn S, Yu Yi, Desmarais M C, et al. Deep knowledge tracing and dynamic student classification for knowledge tracing[C]//Proc of IEEE International Conference on Data Mining. Piscataway, NJ: IEEE Press, 2018: 1182-1187.

[24]Minn S, Desmarais M C, Zhu Feida, et al. Dynamic student classification on memory networks for knowledge tracing[C]//Proc of the 23rd Pacific-Asia Conference on Advances in Knowledge Discovery and Data Mining. Cham: Springer, 2019: 163-174.

[25]王文濤, 馬慧芳, 舒躍育, 等. 基于上下文表示的知識追蹤方法[J]. 計算機工程與科學, 2022,44(9): 1693-1701. (Ma Wentao, Ma Huifang, Shu Yueyu, et al. Knowledge tracing based on contextualized representation[J]. Computer Engineering & Science, 2022,44(9): 1693-1701.)

[26]Li Lingqin, Wang Zhifeng. Calibrated Q-matrix-enhanced deep know-ledge tracing with relational attention mechanism[J].Applied Scien-ces, 2023,13(4): 2541.

[27]Wang Zhiwei, Feng Xiaoqin, Tang Jijiang, et al. Deep knowledge tracing with side information[C]//Proc of the 20th International Conference on Artificial Intelligence in Education. Charm: Springer, 2019: 303-308.

[28]Pandey S, Srivastava J. RKT: relation-aware self-attention for know-ledge tracing[C]//Proc of the 29th ACM International Conference on Information & Knowledge Management. New York: ACM Press, 2020: 1205-1214.

[29]Feng Mingyu, Heffernan N, Koedinger K. Addressing the assessment challenge with an online system that tutors as it assesses[J]. User Modeling and User-Adapted Interaction, 2009,19(8): 243-266.

[30]Koedinger K R, Baker R S J, Cunningham K, et al. A data repository for the EDM community: the PSLC DataShop[M]//Handbook of Educational Data Mining. Boca Raton, FL: CRC Press, 2010: 43-56.

[31]Chang H S, Hsu H J, Chen K T. Modeling exercise relationships in e-learning: a unified approach[EB/OL]. (2019-09-28). https://homepage.iis.sinica.edu.tw/~swc/pub/elearning_exercise_relationship.html.