基于語序知識的雙通道圖卷積網絡方面級情感分析

黃俊 劉洋 王慶鳳 陳立偉 邱家林 黎茂鋒

摘 要:當前大多數基于圖卷積網絡的方面級情感分析方法利用文本的句法知識、語義知識、情感知識構建文本依賴,但少有研究利用文本語序知識構建文本依賴,導致圖卷積網絡不能有效地利用文本語序知識引導方面項學習上下文情感信息,從而限制了其性能。針對上述問題,提出基于語序知識的雙通道圖卷積網絡(dual-channel graph convolutional network with word-order knowledge,WKDGCN)模型,該模型由語序圖卷積網絡(word-order graph convolutional network,WoGCN)和情感知識結合語義知識增強的句法圖卷積網絡(sentiment and attention-enhanced graph convolutional network,SAGCN)組成。具體地,WoGCN基于文本的語序知識構建圖卷積網絡,由文本的語序依賴引導方面項特征學習上下文情感信息;SAGCN利用SenticNet中的情感知識結合注意力機制增強句法依賴,利用增強后的句法依賴構建圖卷積網絡,以此引導方面項特征學習上下文情感信息;最后融合兩個圖卷積網絡的特征用于情感分類。此外,設計了一種權重分配策略,在放大方面項權重的同時保持上下文權重一致,避免錯誤的計算方面項特征與重要特征的語義相關性。在多個公開數據集上的實驗結果表明,所提方法優于對比模型。

關鍵詞:方面級情感分析; 語序知識; 情感信息; 注意力機制; 句法依賴; 圖卷積神經網絡

中圖分類號:TP391?? 文獻標志碼:A

文章編號:1001-3695(2024)03-019-0779-07

doi:10.19734/j.issn.1001-3695.2023.07.0310

Dual-channel graph convolutional network with word-orderknowledge for aspect-based sentiment analysis

Huang Jun, Liu Yang, Wang Qingfeng, Chen Liwei, Qiu Jialin, Li Maofeng

(School of Computer Science & Technology, Southwest University of Science & Technology, Mianyang Sichuan 621010, China)

Abstract:At present, most of the aspect-based sentiment analysis methods based on graph convolutional network use the syntactic knowledge, semantic knowledge and sentiment knowledge of text to construct text dependency, but few studies have made use of text word-order knowledge to build text dependency.As a result, graph convolutional networks cant effectively use text word order knowledge to guide aspects to learn contextual sentiment information, thus limiting its performance. Aiming at the above problems, this paper proposed an aspect-based sentiment analysis model of dual-channel graph convolutional network with word-order knowledge(WKDGCN), which consisted of WoGCN and SAGCN. Specifically, WoGCN constructed a graph convolutional network based on the word-order knowledge of text, and learned contextual sentiment information by re-lying on the characteristics of the guiding aspect of the text word order. SAGCN used the sentiment knowledge in SenticNet combined with the attention mechanism to enhance syntactic dependence, and used the enhanced syntactic dependence to construct a graph convolutional network,so as to guide the aspect features to learn contextual emotional information. Finally,it fused the features of two graph convolutional networks for sentiment classification. In addition,it designed a weight allocation strategy to keep the context weights consistent while amplifying the weights of the terms to avoid erroneous calculation of the semantic correlation between the features of the terms and the important features. Experimental results on several public data sets show that the proposed method is superior to the comparison models.

Key words:aspect-based sentiment analysis; word-order knowledge; sentiment information; attention mechanism; syntactic dependence; graph convolutional network

0 引言

在Web 2.0的時代背景下,社交媒體每時每刻都在產生大量帶有情感極性的文本信息,為了挖掘其中的有益價值,情感分析、意見挖掘等[1]逐漸成為自然語言處理(natural language processing,NLP)領域的熱門研究話題。方面級情感分析(aspect-based sentiment analysis,ABSA)能夠對文本中特定方面項的情感極性進行預測,而非單純預測整條文本的情感極性,所以其又被稱為細粒度的情感分析。以“The food is good, but the service is terrible.”為例,文本中有“food”和“service”兩個方面項,對應的意見項分別是“good”和“terrible”,ABSA任務的目標就是建立方面項與意見項之間的聯系,從而判斷出兩個方面項的情感極性分別為正向和負向。

當前,大多數基于圖卷積網絡的方面級情感分析利用文本的句法知識、語義知識、情感知識構建文本依賴[2~6],但是目前利用語序知識構建文本依賴的研究尚有不足,導致圖卷積網絡不能有效地利用文本的語序知識引導方面項學習上下文情感信息,從而影響模型在ABSA任務上的性能,并且融合蘊涵多種文本知識的特征能有效提升模型的性能[3,4]。為有效融合文本的語序特征以增強模型的分類性能,本文提出基于語序知識的雙通道圖卷積網絡(WKDGCN)方面級情感分析模型。

WKDGCN由語序圖卷積網絡(WoGCN)和句法增強圖卷積網絡(SAGCN)組成。首先,利用文本的語序知識構建文本語序依賴,并基于語序依賴構建圖卷積網絡WoGCN通道;其次,結合SenticNet中的情感知識和注意力機制增強句法依賴,并基于增強的句法依賴構建圖卷積網絡SAGCN通道;最后融合兩個通道的特征用于情感分類。此外,為避免錯誤的計算方面項特征與重要特征的語義相關性,設計了一種權重分配策略,該策略在放大方面項權重的同時保持上下文權重一致。最終在多個公開數據集上的實驗結果表明,本文WKDGCN模型相較于對比模型在ABSA任務上性能更優。

本文主要貢獻總結如下:a)提出一種基于文本語序知識的文本依賴構建方法;b)構建WKDGCN模型,其由WoGCN與SAGCN組成,WoGCN利用文本的語序知識引導方面項聚合上下文情感信息,SAGCN利用SenticNet中的情感知識結合注意力機制增強句法依賴,將文本的語義知識和情感知識融入到句法依賴中;c)設計了一種權重分配策略,在放大方面項權重的同時保持上下文權重一致,避免模型錯誤的計算方面項特征與重要特征的語義相關性。

1 相關工作

方面級情感分析的概念由Thet等人[7]在2010年明確提出。早期受限于硬件條件,大多數研究建立在傳統機器學習算法的基礎上,如在最大熵、支持向量機等經典機器學習模型的基礎上結合情感詞典、依賴信息等對情感進行分類[8]。這些方法需要投入較大的人力成本和時間成本,隨著硬件設備的改良與升級,深度學習得到良好的應用環境,大大降低了人力成本與時間成本,深度學習逐漸成為主流研究方法。

循環神經網絡(recurrent neural network,RNN) [9]擅長處理有序列特性的數據,因此在NLP領域得到了廣泛應用,長短時記憶網絡(long short term memory,LSTM)[10]和門控循環單元(gated recurrent unit,GRU)[11]是RNN的兩個有效變體,兩者在傳統RNN的基礎上引入門控機制,有效克服了傳統RNN梯度爆炸和梯度彌散的問題。Tang等人[12]提出TD-LSTM、TC-LSTM兩個改進模型用于方面級情感分析,整合了方面項與上下文的相互關聯信息,取得了比標準LSTM更好的效果。最近在ABSA任務上也有許多利用注意力機制捕捉上下文語義相關性特征[13]而開展的工作。Wang等人[14]提出基于注意力機制的長短時記憶網絡ATAE-LSTM,用于方面級情感分析。Tan等人[15]提出帶有雙注意力機制的多標簽分類模型,提升了模型對帶有沖突意見的方面項情感分類性能。另外,Devlin等人[16]提出的基于注意力機制的BERT預訓練模型也一度刷新了NLP領域的各大任務成果。Sun等人[17]提出構造NLI_B、NLI_M、QA_B、QA_M四種輔助句,再微調BERT模型,從句子對分類的角度考慮ABSA任務,取得了良好效果。Xu等人[18]針對ABSA任務提出了一種基于BERT的后訓練微調方式,提升了BERT預訓練模型在微調ABSA任務上的性能。循環神經網絡以及注意力機制能有效建模文本的上下文信息,但其不能有效利用外部的文本依賴信息。

而利用文本依賴有助于建立方面項與上下文之間的聯系,以此引導方面項學習上下文情感信息。遵循這一思路,基于圖數據的圖卷積網絡被廣泛應用于ABSA任務。Lu等人[19]設計了一種星形圖,并提出基于節點和基于文檔的分類方法,用于情感分析并取得了良好效果; Liang等人[20]提出依賴關系嵌入式圖卷積網絡DREGCN,并設計了一個有效的消息傳遞機制以充分利用語法知識,在ABSA任務上取得了良好成果;趙振等人[21]提出基于關系交互的圖注意力網絡模型,使用一個新的擴展注意力來引導信息從方面項的句法上下文傳播到方面項本身;Pang等人[22]通過句法依賴樹和多頭注意力機制分別生成句法依賴圖和語義圖,并提出一種動態多通道圖卷積網絡DM-GCN來有效地從生成的圖中學習相關信息;Tang等人[23]利用依賴關系標簽構建語法感知潛在圖,并設計了一個情感細化策略引導網絡捕捉重要的情感線索;楊春霞等人[24]提出基于注意力與雙通道的模型TCCM,實現了通道內信息的殘差互補,有效結合了句法與語義關聯信息;Li等人[25]提出一種雙圖卷積神經網絡DualGCN,同時對語法知識和語義知識進行學習,并提出了正交正則化器和差分正則化器鼓勵句法知識和語義知識相互感知學習;Xing等人[26]提出DigNet模型,設計了一種局部全局交互圖,結合句法圖和語義圖,實現圖知識有益交互。

雖然以上基于文本句法知識、語義知識、情感知識構建圖神經網絡的方法在ABSA任務上取得了良好效果,但它們缺乏對基于語序知識構建圖卷積網絡的研究。為探究文本語序知識對模型性能的影響,本文提出基于語序知識的雙通道圖卷積網絡方面級情感分析模型。

2 WKDGCN模型構建

本文模型的網絡結構如圖1所示,主要由四個部分組成:

a)詞嵌入與BiLSTM層。輸入序列文本,輸出富含上下文情感信息的文本詞向量矩陣表示H。

b)雙通道圖卷積網絡。基于文本的語序依賴以及注意力機制結合情感知識增強句法依賴分別構建WoGCN與SAGCN,再輸出融合兩個通道輸出的文本特征hGCN。

c)權重分配策略。基于方面項的局部特征和聚合多種文本知識的方面項特征進行注意力計算,在上下文特征權重保持一致的情況下放大方面項權重。

d)輸出模塊。將經過步驟c)得到的權重反饋到BiLSTM中,以輸出最終的文本特征用于分類。

2.1 詞嵌入與BiLSTM層

詞嵌入與BiLSTM層的目的是獲取用于訓練模型的詞向量表示與富含上下文情感信息的文本特征。實現方法如下:

首先,使用GloVe[27]將文本S={W1,…,Wa+1,…,Wa+m,…,Wn}映射為300維的詞向量矩陣E={e1,…,ea+1,…,ea+m,…,en},其中n表示文本S的長度,en是Wn的詞向量表示,然后經過BiLSTM訓練詞向量矩陣E得到文本隱藏向量表示H={h1,…,ha+1,…,ha+m,…,hn}。

2.2 雙通道圖卷積網絡構建

本文WKDGCN由基于語序依賴的WoGCN與基于注意力機制與情感知識增強的句法依賴的SAGCN組成,接下來將逐步實現WKDGCN的構建。

2.2.1 語序圖卷積網絡WoGCN構建

WoGCN是基于文本語序依賴構建的圖卷積網絡,其核心是構建語序依賴,文本的語序由單詞的語序與單詞之間的相對語序構成。其中,單詞的語序表示如式(1)所示。

3 實驗

3.1 實驗數據集

本文選擇Twitter、restaurant14(簡寫為Rest14)、laptop14(簡寫為Lap14)和restaurant16(簡寫為Rest16)四個公開數據集作為實驗數據集。數據集由正、中、負三種情感極性數據組成。每個樣本由一條文本評論、一個或多個單詞組成的方面項以及對應的意見項組成。數據集信息如表2所示。

3.2 對比模型

ATAE-LSTM:使用BiLSTM來捕捉上下文信息,并使用方面項特征和注意力機制,將方面詞與上下文信息相結合。

IAN:使用BiLSTM來編碼句子中的上下文信息,并使用交互式注意力機制建模方面詞和上下文之間的關系,以捕捉方面詞對情感的影響。RAM:使用多頭注意力機制計算方面詞和上下文單詞之間的關系,并使用記憶網絡來學習句子的詞嵌入表示。

MGAN:提出多粒度注意力機制以及方面對齊損失來學習方面項與上下文之間的詞級交互。

TNet:該模型在CNN和BiLSTM之間添加了一個組件來生成方面項的特征,并使用CNN提取BiLSTM的文本特征。

AEN-GloVe:該模型使用了GloVe預訓練詞向量來表示單詞,使用卷積神經網絡(CNN)來提取方面詞信息,并使用雙向LSTM來編碼上下文信息。

ASGCN:該模型首次提出了使用圖卷積神經網絡GCN來學習用于ABSA任務的特定方面項表示。

CDT:該模型利用BiLSTM學習句子的特征表示,然后使用GCN來增強從BiLSTM中學習到的特征。

BiGCN:該模型使用雙層交互式圖卷積神經網絡來建模方面詞和上下文單詞之間的交互關系,以便更好地捕捉方面詞對情感的影響。

kumaGCN:使用潛在的圖結構來補充句法特征。

R-GAT:提出了一種面向方面項的依賴樹結構,然后使用關系圖注意網絡GAT對面向方面項的依賴樹進行編碼。

DGEDT:設計了一個雙向轉換結構,以相互增強的方式融合句法依賴知識和具有豐富上下文信息知識。IMA:提出一個基于交互矩陣和全局注意力機制模型,以提高模型性能。

CPA-SA:設計了兩個不對稱的上下文權重函數來調整方面項的權重。

本文選擇的對比模型包括從2016—2022年的經典基線模型,其中ATAE-LSTM、IAN、RAM、MGAN、TNet、AEN-GloVe、IMA、CPA-SA僅考慮文本的上下文語義信息, ASGCN、CDT、BiGCN、kumaGCN、R-GAT、DGEDT在上下文語義信息的基礎上加入了文本的結構信息。

3.3 實驗環境與參數設置

本文網絡模型基于PyTorch深度學習框架搭建,模型具體訓練環境如表3所示。

為了防止模型出現過擬合的情況,本文模型在BiLSTM層與圖卷積層設置了不同的dropout值,具體參數設置如表4所示。

3.4 評價指標

為便于與模型對比,選擇ABSA任務通用評價指標準確率accuracy和宏平均Macro-F1來評價本文模型的性能,表5中分別用Acc和F1代指。

3.5 實驗結果與分析

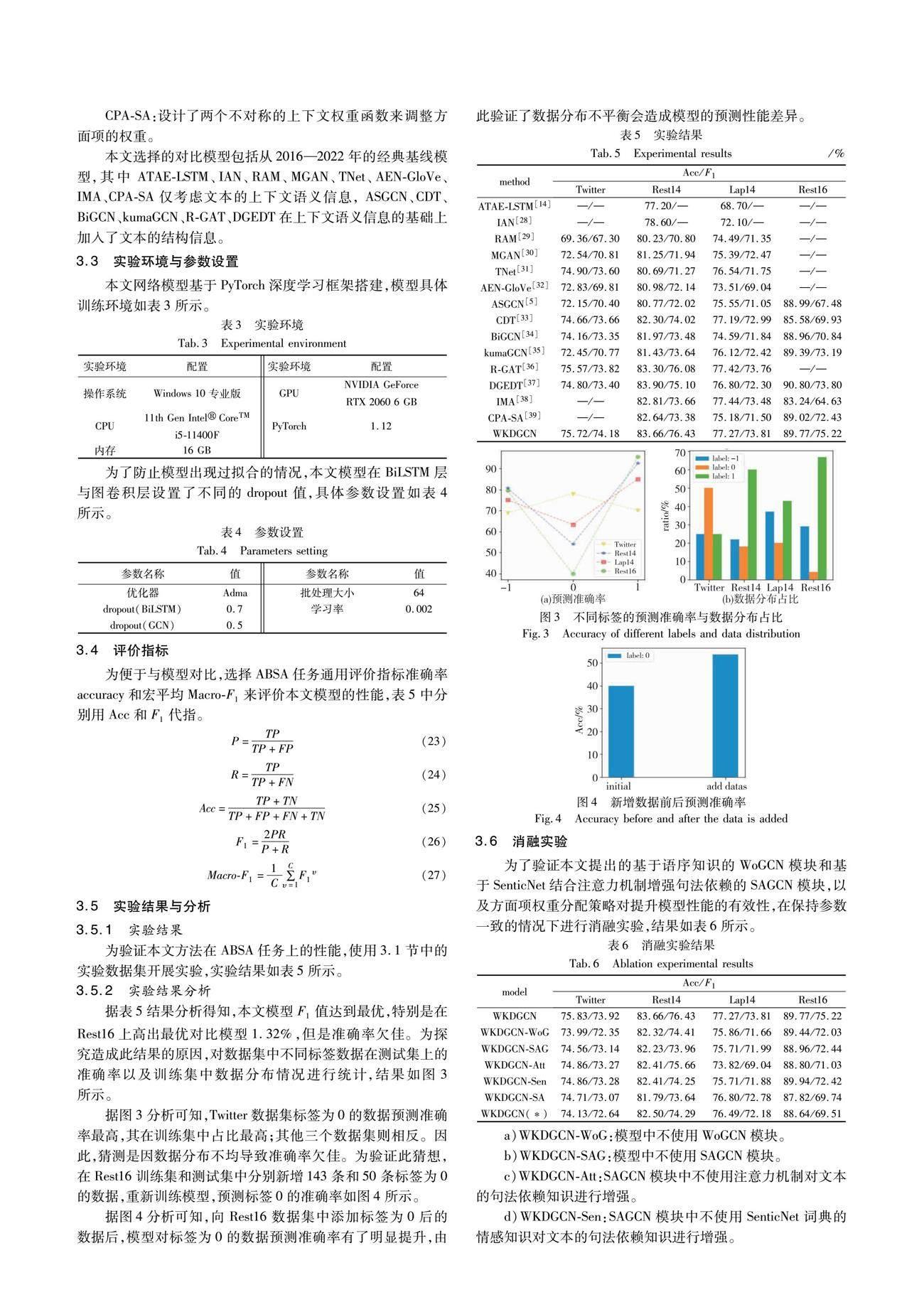

3.5.1 實驗結果

為驗證本文方法在ABSA任務上的性能,使用3.1節中的實驗數據集開展實驗,實驗結果如表5所示。

3.5.2 實驗結果分析

據表5結果分析得知,本文模型F1值達到最優,特別是在Rest16上高出最優對比模型1.32%,但是準確率欠佳。為探究造成此結果的原因,對數據集中不同標簽數據在測試集上的準確率以及訓練集中數據分布情況進行統計,結果如圖3所示。

據圖3分析可知,Twitter數據集標簽為0的數據預測準確率最高,其在訓練集中占比最高;其他三個數據集則相反。因此,猜測是因數據分布不均導致準確率欠佳。為驗證此猜想,在Rest16訓練集和測試集中分別新增143條和50條標簽為0的數據,重新訓練模型,預測標簽0的準確率如圖4所示。

據圖4分析可知,向Rest16數據集中添加標簽為0后的數據后,模型對標簽為0的數據預測準確率有了明顯提升,由此驗證了數據分布不平衡會造成模型的預測性能差異。

3.6 消融實驗

為了驗證本文提出的基于語序知識的WoGCN模塊和基于SenticNet結合注意力機制增強句法依賴的SAGCN模塊,以及方面項權重分配策略對提升模型性能的有效性,在保持參數一致的情況下進行消融實驗,結果如表6所示。

a)WKDGCN-WoG:模型中不使用WoGCN模塊。

b)WKDGCN-SAG:模型中不使用SAGCN模塊。

c)WKDGCN-Att:SAGCN模塊中不使用注意力機制對文本的句法依賴知識進行增強。

d)WKDGCN-Sen:SAGCN模塊中不使用SenticNet詞典的情感知識對文本的句法依賴知識進行增強。

e)WKDGCN-SA:SAGCN模塊中不使用注意力機制和SenticNet詞典的情感知識對文本的句法依賴知識進行增強,僅使用文本句法依賴。

f)WKDGCN(*):模型中不使用本文提出的權重分配策略。

綜上,在移除本文模塊的情況下,模型的性能均有明顯下降,從而印證了本文方法對提升模型性能的有效性。

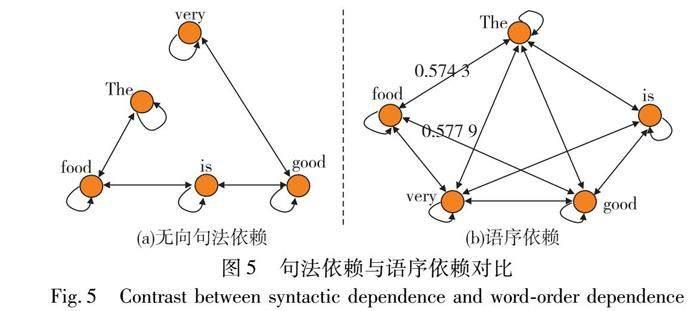

3.7 案例分析

為了更好地分析本文提出的基于語序知識構建的文本依賴對情感分析結果的影響,以“The food is very good”為例進行分析。“food”是該樣例的方面項,“good”是表達其情感極性的意見項,據圖2可知方面項“food”與意見項“good”沒有直接的聯系,導致GCN不能直接將意見項的情感信息聚合到方面項,進而增大了模型錯誤分類情感極性的概率,而使用本文提出的基于語序知識構建文本依賴的方法能夠直接在方面項“food”與表達其情感極性的意見項“good”之間建立聯系,并且能根據式(3)計算出不同詞組之間的依賴程度(例如詞組“The-food”和詞組“food-good”之間的依賴程度分別是0.574 3和0.577 9),使得GCN能直接將意見項的情感信息聚合到意見項,從而增強模型的性能。兩者對比如圖5所示。

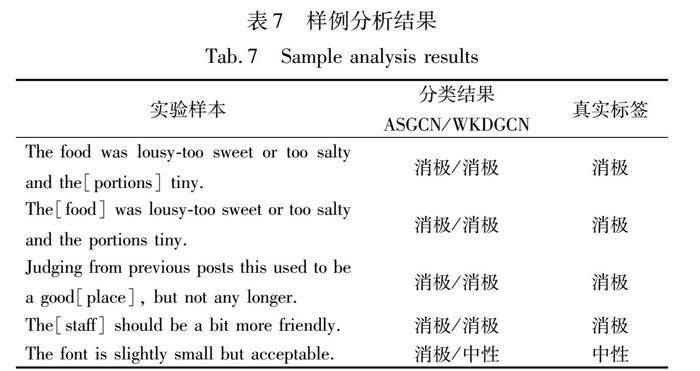

最后,使用五條數據在僅基于句法知識的圖卷積網絡模型ASGCN[5]與本文提出的基于語序知識雙通道圖卷積網絡WKDGCN模型上驗證模型的性能,結果如表7所示。

從表7可以看出,文本中無論是有多個方面項還是單個方面項,本文模型依靠語序依賴都能夠捕捉到正確的意見項,相比于對比模型具有更高的可靠性。

使用Twitter評論數據集、關于飯店的評論數據集Rest14和Rest16以及筆記本電腦評論數據集Lap14進行實驗,本文模型均有不俗表現,說明模型適用于多種領域類型的文本數據,因此該模型可以擴展應用到各行各業的數據上,為各個行業的運營情況作出針對性的指導,具有較大的應用前景。比如:根據電商產品評論分析出用戶對商品具體某些方面的情感極性傾向,進而分析出用戶對產品的購買欲,以便商家根據情感傾向制定相應的營銷策略;根據人們對某熱點事件的網絡評論分析出人們對事件某些方面的情感關注點,以便相關部門正確預測由事件引導的輿論走向并制定出相應的政策等。

4 結束語

本文提出基于語序知識構建文本依賴,并基于語序依賴構建雙通道圖卷積網絡模型WKDGCN用于方面級情感分析,模型由基于語序依賴的WoGCN模塊與情感知識結合注意力機制增強的句法圖卷積網絡SAGCN模塊組成。此外,設計了一種權重分配策略,在放大方面項權重的同時保持上下文權重一致,避免方面項錯誤的計算與重要特征的語義相關性,最終在Twitter、Rest14、Lap14、Rest16四個公開數據集上取得了較對比模型更好的效果。同時消融實驗的結果與分析也驗證了本文方法的有效性。

雖然本文方法在ABSA任務上取得了不錯的效果,但在特征融合策略上的工作仍有欠缺;另外,模型的泛化性還有待提升,對預測效果不好的數據類型可以使用過采樣、數據增強等方式提升模型在這些類型數據上的泛化性能。以后工作可以圍繞這兩個方面繼續開展,以提升模型的性能。

參考文獻:

[1]Liu Bing, Zhang Lei. A survey of opinion mining and sentiment analysis[M]//Aggarwal C C, Zhai Chengxiang. Mining Text Data. Boston, MA: Springer, 2012: 415-463.

[2]Yu Chengze, Wu Taiqiang, Li Jiayi, et al. SynGen: a syntactic plug-and-play module for generative aspect-based sentiment analysis[C]//Proc of IEEE International Conference on Acoustics, Speech and Signal Processing. Piscataway, NJ: IEEE Press, 2023: 1-5.

[3]李帥, 徐彬, 韓祎珂, 等. SS-GCN: 情感增強和句法增強的方面級情感分析模型[J]. 計算機科學, 2023,50(3): 3-11. (Li Shuai, Xu Bin, Han Yike, et al. SS-GCN: aspect-based sentiment analysis model with affective enhancement and syntactic enhancement[J]. Computer Science, 2023,50(3): 3-11.)

[4]Liang Bin, Su Hang, Gui Lin, et al. Aspect-based sentiment analysis via affective knowledge enhanced graph convolutional networks[J]. Knowledge-Based Systems, 2022,235: 107643.

[5]Zhang Chen, Li Qiuchi, Song Dawei. Aspect-based sentiment classification with aspect-specific graph convolutional networks[EB/OL]. (2019-10-13). https://arxiv.org/abs/1909.03477.

[6]陽影, 張凡, 李天瑞. 基于情感知識的雙通道圖卷積網絡的方面級情感分析[J]. 計算機科學, 2023,50(5): 230-237. (Yang Ying, Zhang Fan, Li Tianrui. Aspect-based sentiment analysis based on dual-channel graph convolutional network with sentiment know-ledge[J]. Computer Science, 2023,50(5): 230-237.)

[7]Thet T T, Na J C, Khoo C S G. Aspect-based sentiment analysis of movie reviews on discussion boards[J]. Journal of Information Science, 2010,36(6): 823-848.

[8]Wiebe J, Wilson T, Cardie C. Annotating expressions of opinions and emotions in language[J]. Language Resources and Evaluation, 2005,39: 165-210.

[9]Zaremba W, Sutskever I, Vinyals O. Recurrent neural network regularization[EB/OL]. (2015-02-19). https://arxiv.org/abs/1409.2329.

[10]Hochreiter S, Schmidhuber J. Long short-term memory[J]. Neural Computation, 1997,9(8): 1735-1780.

[11]Dey R, Salem F M. Gate-variants of gated recurrent unit(GRU) neural networks[C]//Proc of the 60th International Midwest Symposium on Circuits and Systems. Piscataway, NJ: IEEE Press, 2017: 1597-1600.

[12]Tang Duyu, Qin Bing, Feng Xiaocheng, et al. Effective LSTMs for target-dependent sentiment classification[EB/OL]. (2016-09-29). https://arxiv.org/abs/1512.01100.

[13]Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need [EB/OL]. (2023-08-02). https://arxiv.org/abs/1706.03762.

[14]Wang Yequan, Huang Minlie, Zhu Xiaoyan, et al. Attention-based LSTM for aspect-level sentiment classification[C]//Proc of Confe-rence on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2016: 606-615.

[15]Tan Xingwei, Cai Yi, Zhu Changxi. Recognizing conflict opinions in aspect-level sentiment classification with dual attention networks[C]//Proc of Conference on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2019: 3426-3431.

[16]Devlin J, Chang M W, Lee K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[EB/OL]. (2019-05-24). https://arxiv.org/abs/1810.04805.

[17]Sun Chi, Huang Luyao, Qiu Xipeng. Utilizing BERT for aspect-based sentiment analysis via constructing auxiliary sentence[EB/OL]. (2019-03-22). https://arxiv.org/abs/1903.09588.

[18]Xu Hu, Liu Bing, Shu Lei, et al. BERT post-training for review reading comprehension and aspect-based sentiment analysis[EB/OL]. (2019-05-04). https://arxiv.org/abs/1904.02232.

[19]Lu Haonan, Huang S H, Ye Tian, et al. Graph star net for genera-lized multi-task learning [EB/OL]. (2019-06-21). https://arxiv.org/abs/1906.12330.

[20]Liang Yunlong, Meng Fandong, Zhang Jinchao, et al. A dependency syntactic knowledge augmented interactive architecture for end-to-end aspect-based sentiment analysis[J]. Neurocomputing, 2021, 454: 291-302.

[21]趙振, 朱振方, 王文玲. 基于關系特征交互的方面級情感分類方法[J]. 計算機技術與發展, 2023,33(3): 187-193. (Zhao Zhen, Zhu Zhenfang, Wang Wenling. An aspect-level sentiment classification method based on relational feature interaction[J]. Computer Technology and Development, 2023,33(3): 187-193.)

[22]Pang Shiguan, Xue Yun, Yan Zehao, et al. Dynamic and multi-channel graph convolutional networks for aspect-based sentiment analysis[C]//Proc of Findings of the Association for Computational Linguistics. Stroudsburg, PA: Association for Computational Linguistics, 2021: 2627-2636.

[23]Tang Siyu, Chai Heyan, Yao Ziyi, et al. Affective knowledge enhanced multiple-graph fusion networks for aspect-based sentiment analysis[C]//Proc of Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computatio-nal Linguistics, 2022: 5352-5362.

[24]楊春霞, 徐奔, 桂強, 等. 基于注意力與雙通道網絡的方面級情感分析[J]. 南京信息工程大學學報: 自然科學版, 2023,15(1): 42-50. (Yang Chunxia, Xu Ben, Gui Qiang, et al. Aspect-based sentiment analysis based on attention and dual-channel network[J]. Journal of Nanjing University Science & Technology: Natural Science Edition, 2023, 15(1): 42-50.)

[25]Li Ruifan, Chen Hao, Feng Fangxiang, et al. Dual graph convolutional networks for aspect-based sentiment analysis[C]//Proc of the 59th Annual Meeting of the Association for Computational Linguistics and the 11th International Joint Conference on Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2021: 6319-6329.

[26]Xing Bowen, Tsang I. DigNet: digging clues from local-global interactive graph for aspect-level sentiment classification[EB/OL]. (2022-05-02). https://arxiv.org/abs/2201.00989.

[27]Pennington J, Socher R, Manning C D. GloVe: global vectors for word representation[C]//Proc of Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2014: 1532-1543.

[28]Ma Dehong, Li Sujian, Zhang Xiaodong, et al. Interactive attention networks for aspect-level sentiment classification[C]//Proc of the 26th International Joint Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2017: 4068-4074.

[29]Chen Peng, Sun Zhongqian, Bing Lidong, et al. Recurrent attention network on memory for aspect sentiment analysis[C]//Proc of Confe-rence on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2017: 452-461.

[30]Fan Feifan, Feng Yansong, Zhao Dongyan. Multi-grained attention network for aspect-level sentiment classification[C]//Proc of Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2018: 3433-3442.

[31]Li Xin, Bing Lidong, Lam W, et al. Transformation networks for target-oriented sentiment classification[C]//Proc of the 56th Annual Meeting of the Association for Computational Linguistics. Stroudsburg, PA: Association for Computational Linguistics, 2018: 946-956.

[32]Song Youwei, Wang Jiahai, Jiang Tao, et al. Targeted sentiment classification with attentional encoder network[C]//Proc of International Conference on Artificial Neural Networks. Berlin: Springer, 2019: 93-103.

[33]Sun Kai, Zhang Richong, Mensah S, et al. Aspect-level sentiment analysis via convolution over dependency tree[C]//Proc of Confe-rence on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2019: 5679-5688.

[34]Zhang Mi, Qian Tieyun. Convolution over hierarchical syntactic and lexical graphs for aspect level sentiment analysis[C]/Proc of Confe-rence on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2020: 3540-3549.

[35]Chen Chenhua, Teng Zhiyang, Zhang Yue. Inducing target-specific latent structures for aspect sentiment classification[C]//Proc of Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA: Association for Computational Linguistics, 2020: 5596-5607.

[36]Wang Kai, Shen Weizhou, Yang Yunyi, et al. Relational graph attention network for aspect-based sentiment analysis[EB/OL]. (2020-04-26). https://arxiv.org/abs/2004.12362.

[37]Tang Hao, Ji Donghong, Li Chenliang, et al. Dependency graph enhanced dual-transformer structure for aspect-based sentiment classification[C]//Proc of the 58th Annual Meeting of the Association for Computational Linguistics. Stroudsburg, PA: Association for Computational Linguistics, 2020: 6578-6588.

[38]Wang Xiaodi, Pan Xiaoge, Yang Tian, et al. Aspect-based sentiment analysis using interaction matrix and global attention neural network[J]. The Computer Journal, 2023, 66(5): 1167-1183.

[39]Huang Bo, Guo Ruyan, Zhu Yimin, et al. Aspect-level sentiment analysis with aspect-specific context position information[J]. Know-ledge-Based Systems, 2022, 243(C): 108473.