漸進式分組狩獵的灰狼優化算法及其工程應用

袁鈺婷 高岳林 左汶鷺

摘 要:針對灰狼優化算法(GWO)在求解復雜優化問題時存在后期收斂速度慢、易陷入局部最優的不足,提出了一種漸進式分組狩獵的灰狼優化算法(PGGWO)。首先,設計了非線性多收斂因子以增強全局勘探能力、避免局部最優;其次,提出了漸進式位置更新策略,該策略引入長鼻浣熊的包圍策略和動態權重因子,前者在提高收斂精度和速度的同時避免局部最優,后者則動態地提升算法的收斂速度及全局尋優性能;最后,通過與標準GWO、4個GWO先進變體以及4個競爭力較強的新型進化算法對比,驗證了PGGWO的有效性和先進性。在24個Benchmark函數和3個實際工程優化問題上的實驗結果表明,PGGWO在收斂精度和收斂速度上具有明顯優勢,并且對約束優化問題也是有效的。

關鍵詞:灰狼優化算法;漸進式分組狩獵;多收斂因子;動態權重因子;工程約束優化

中圖分類號:TP301.6?? 文獻標志碼:A??? 文章編號:1001-3695(2024)05-019-1409-11

doi: 10.19734/j.issn.1001-3695.2023.10.0449

Grey wolf optimization algorithm based on progressive grouping

hunting mechanism and its engineering applications

Abstract:Focus on the shortcomings of the GWO in solving complex optimization problems, such as slow convergence speed and easy to fall into local optimum, this paper proposed a grey wolf optimization algorithm based on progressive grouping hunting mechanism(PGGWO). Firstly, it designed the nonlinear multi convergence factors to enhance the global exploration ability and avoid local optimum. Secondly, it proposed a progressive location update strategy. The strategy introduced the encirclement strategy of coati and dynamic weight factors, the former avoided local optimum while improving convergence accuracy and speed, the latter dynamically improved the convergence speed and global optimization performance of the algorithm. Finally, through comparing with GWO, 4 advanced GWO variants and 4 new with strong competitiveness, the experiment verifies the effectiveness and advancement of PGGWO. The experimental results on 24 Benchmark functions and 3 practical engineering optimization problems show that PGGWO has obvious advantages in convergence accuracy and convergence speed, and is also effective for constrained optimization problems.

Key words:grey wolf optimizer(GWO); progressive grouping hunting; multi convergence factor; dynamic weighting factor; engineering constrained optimization

0 引言

近年來,優化技術已被廣泛應用于工程設計[1]、金融工程[2]、信息科學[3]和經濟管理[4]等領域。然而,全局優化問題模型通常具有強非線性、復雜、高維的搜索空間,基于梯度信息的傳統優化方法難以有效求解,因此不再適用。在過去的半個世紀里,群智能優化算法因其原理簡單、實現容易、能以較大概率收斂到問題最優解等特點,在優化領域中被廣泛應用[5]。常見的群智能優化算法有遺傳算法(genetic algorithm,GA)[6]、粒子群優化算法(particle swarm optimization,PSO)[7]、差分進化算法(differential evolution,DE)[8]、生物地理學優化算法(biogeo-graphy-based optimization,BBO)[9]、灰狼優化算法(GWO)[10]和白鯨優化算法(beluga whale optimization,BWO)[11]等。雖然群智能優化算法不能保證在所有情況下都能得到最優解,但是它們能夠在可接受的時間內提供合理的解[12],如非確定性多項式時間(NP-hard)問題[13]。盡管群智能優化算法由于參數少且通用性好而得到了廣泛的應用,但其避免局部最優的能力仍然不足[14]。此外,隨著現實世界優化問題日益趨向高維、復雜和多樣化發展,經典的群智能優化算法難以有效求解高維優化問題。

GWO是由澳大利亞學者Mirjalili等人[10]依據自然界中灰狼種群嚴格的社會等級機制和狩獵行為提出的。首先,灰狼種群被劃分為四個社會等級;其次,灰狼種群根據前三等級灰狼前一次迭代的位置進行更新。按照此過程不斷循環進行位置移動,直至找到合適的獵物。GWO具有全局勘探能力強、調節參數少、原理簡單、容易實現等優點。在單峰和多模態無約束基準函數的情況下,GWO的尋優性能明顯優于GA、PSO和DE等,在未知的搜索空間中具有較為高效的性能。當對復合函數進行測試時,它能夠高度避免局部最優。因此,研究發現GWO更適合解決現實世界的問題[15]。但是從GWO本身的進化機制來看,該算法在解決某些優化問題時仍存在后期收斂速度慢、易陷入局部最優的不足[16]。針對這些不足,國內外學者對其進行了改進,主要包括對灰狼種群初始化、算法參數、搜索機制進行改進和設計新的混合算法兩方面。

王敏等人[17]利用反向學習策略產生初始灰狼種群以維持群體多樣性,并對當前最優灰狼個體進行變異操作以減少算法出現早熟收斂的可能性,但生成反向種群的過程會增加不必要的計算量,且變異操作會出現將原本優秀的個體變差的可能性。Yu等人[18]則對此加以改善,以跳躍率Jr對部分個體生成反向解,并擇優組成初始種群。Chen等人[19]通過隨機添加自適應權重和搜索策略增強全局勘探能力,然而其收斂速度和精度需要提高。隨后,Mafarja等人[20]提出了多種勘探與開發策略,增強了GWO算法的全局搜索和局部搜索能力,但劃分多個階段并使用其他算子將顯著增加計算成本。Wang等人[21]提出了一種自適應平衡的GWO尋找高維分類的最佳特征子集,該算法采用自適應方法提高了算法的全局勘探能力。在算法融合上,劉紫燕等人[22]提出了一種基于雜交策略的自適應GWO,通過引進遺傳雜交策略和蝠鲼覓食策略,有效提升了算法的收斂精度及全局尋優性能。李全耀等人[23]結合教與學優化算法(teaching-learning-based optimization, TLBO)[24]和PSO加快了算法的收斂速度,但其全局勘探能力仍有待加強。謝少鵬等人[25]針對GWO存在的局部搜索精度差的問題,從初始種群、收斂因子等方面著手,改善GWO的局部搜索能力及收斂速度,但其全局尋優性能有待提高。

雖然許多研究在一定程度上改善了GWO的性能,但在求解復雜多峰函數和某些工程應用時,后期收斂速度慢、易陷入局部最優的問題依然存在。

針對以上問題,本文提出了一種漸進式分組狩獵的灰狼優化算法(grey wolf optimization algorithm based on progressive grouping hunting mechanism, PGGWO)。

與現有文獻相比,本文的貢獻和主要創新點包括:a)設計非線性多收斂因子策略以模擬灰狼種群的包圍與狩獵過程,避免局部最優;b)提出了一種漸進式位置更新策略,將灰狼種群分為兩組,第一組灰狼學習長鼻浣熊的包圍策略,另一組灰狼則遵循不同的學習率,動態地向獵物逼近,使得算法在提高收斂速度的同時增強全局勘探能力、提升算法精度。

1 標準GWO

GWO將灰狼種群的社會等級分為α、β、δ和ω四種。其中,第一層為α狼,是群體中的領導者,也是最優解;第二層為β狼,協助α狼進行決策,是次優解;第三層為δ狼,負責偵查、看護、放哨等事務,是第三最優解;最底層的為ω狼,聽從前三等級的狼的領導。此外,GWO通過模擬灰狼種群的狩獵過程實現優化搜索的目的。

1.1 包圍獵物

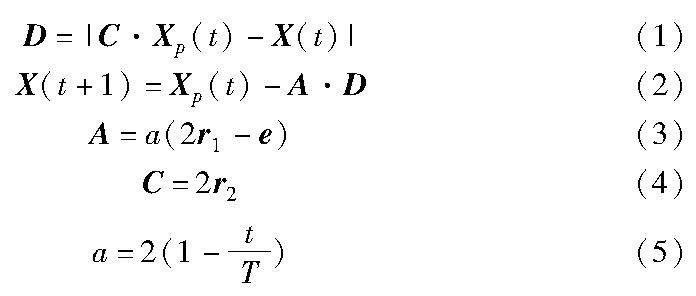

在追蹤目標獵物時,灰狼通過式(1)(2)的位置更新方程圍攻獵物。

其中:D表示獵物與灰狼之間的距離向量;|·|表示兩個位置向量對應分量作差后取絕對值所得的向量;Xp(t)表示獵物的位置;X(t)為第i只灰狼的位置,i∈N,N為種群規模;X(t+1)為t+1時刻第i只灰狼的更新位置,t為當前迭代次數, T為最大迭代次數;A和C為兩個系數向量,共同平衡算法的勘探和開發能力;r1和r2為[0,1]的隨機向量;e為單位向量;收斂因子a又稱為距離控制參數,隨著迭代次數的增加,a從2線性減少到0。

1.2 跟蹤獵殺獵物

為了模擬灰狼的狩獵行為,假設α、β和δ狼更了解獵物的潛在位置。于是保存迄今為止取得的三個最優解決方案,并利用這三者的位置來判斷獵物所在的位置,同時強迫其他灰狼個體依據最優灰狼個體的位置來更新其位置,逐漸靠近獵物。灰狼個體的位置更新公式如下:

其中:Dα、Dβ和Dδ分別代表灰狼個體與α、β和δ狼之間的距離向量;Xα(t)、Xβ(t)、Xδ(t)分別表示α、β、δ狼的當前位置;X1(t)、X2(t)、X3(t)是ω狼分別根據α、β和δ狼的位置生成的指導位置,表示ω狼向α、β和δ狼靠近的方向和步長;Xi(t+1)為第i只灰狼根據α、β和δ狼的指導位置調整后的下一時刻的更新位置;A1、A2和A3的計算同式(3),C1、C2和C3的計算同式(4),表示狼群不同個體的勘探與開發,它們都是系數向量。

1.3 搜索和攻擊獵物

GWO算法設計了A和C兩個系數向量,以平衡勘探和開發能力。當|A|<1時,狼群向獵物發起攻擊(陷入局部最優),當|A|>1時,強迫灰狼與獵物分離,希望找到更合適的獵物(全局最優解)。并且由式(3)可知,A的大小取決于收斂因子a的大小。組件C則用來幫助發現新的解決方案,表示灰狼所在的位置對獵物影響的隨機權重。C>1表示影響權重較大,反之,表示影響權重較小,這有助于GWO算法更隨機地進行搜索,同時可在優化過程中避免陷入局部最優。

GWO算法通過模擬灰狼種群搜索、包圍和攻擊獵物三個階段的狩獵過程實現優化搜索的目的。標準GWO算法的流程如圖1所示。

2 改進的GWO算法

2.1 非線性多收斂因子

GWO算法利用隨機值大于1或小于-1的參數A來迫使灰狼與獵物分離,以模擬種群的分散程度。協調GWO全局勘探能力和局部開發能力的關鍵在于參數A的大小。隨著迭代次數的增加,a從2線性減少到0,其對應的A值也在[-a,a]變化。因此,a的取值決定著算法的全局勘探能力和局部開發能力。然而,灰狼種群的包圍與狩獵過程非常復雜,GWO原有的線性控制參數策略不能很好地模擬這一過程,導致算法易陷入局部最優。先前的研究已證明,使用非線性調整可以更好地平衡GWO的勘探與開發[26]。因此,近年來大多數國內外學者采用非線性控制參數方法進行改進。例如,文獻[27]提出了二次函數控制參數的GWO,文獻[25]提出了余弦控制參數的改進GWO的仿真策略。上述大多數改進都是對單一的收斂因子進行改進,忽略了灰狼種群社會等級制度的靈活性。為使算法的搜索更加靈活,文獻[28]提出一種競爭引導策略來更新個體位置,該策略使用了三種不同的余弦收斂因子。本文受到文獻[28,29]的啟發,提出一種非線性的多收斂因子策略以便更好地提高勘探能力、避免局部最優。具體公式如下:

原算法的線性收斂因子a和本文改進的余弦收斂因子a1對勘探和開發的影響如圖2(a)(b)所示,縱坐標均由式(3)根據對應的收斂因子計算。線性遞減的收斂因子a導致|A|在迭代中期之后保持小于1,這在一定程度上限制了種群在迭代中后期的全局勘探能力;而非線性遞減的a1使|A|在迭代的中后期保持大于1,這意味著使用該非線性余弦收斂因子可以讓種群保持更長時間的勘探能力,并有更多機會跳出局部最優。

另外,考慮到α、β、δ狼所代表的解具有不同程度的優越性,從而對種群位置更新產生不同的影響,本文提出了基于余弦和正弦兩種不同的非線性收斂因子。方式如下:a)對于α和β狼,使用式(13)所示的余弦收斂因子a1,目的是使a1的值和經典GWO收斂因子a的取值一致,從2減小到0,以確保α和β狼在引導狩獵過程中的領導地位;b)對于δ狼,使用式(14)所示的正弦收斂因子a2,以使其取值由1非線性增長到2,對應的|A|便更有可能超出[0,1],效果如圖2(c)所示。種群在更新過程中與δ狼保持距離,δ狼則引導種群進行解空間的大范圍搜索,從而為有效地提高算法的全局勘探能力提供保證。

本文提出的兩種非線性收斂因子與式(5)所示的控制參數隨迭代次數的變化曲線如圖3所示。由圖3可知,在迭代過程中,標準GWO算法的控制參數a從2線性下降到0,而本文設計的兩個控制參數a1和a2的曲線斜率是不斷變化的。其中,a1從2非線性下降到0,迭代前期緩慢,約350代才減小到1。因此更有可能使|A|>1,擴大α、β狼的搜索范圍、增強勘探能力。迭代后期,a1迅速減小以加速收斂、增強局部開發能力。a2則在遵循社會等級制度的前提下,由快到慢地從1非線性增加到2,以使δ狼在某種程度上能夠發現更多獵物,避免局部最優。這兩種收斂因子搭配使用,使得灰狼種群能夠更好地進行勘探和開發,大大減少了陷入局部最優的情況。

2.2 漸進式位置更新策略

標準GWO在求解復雜優化問題時存在后期收斂速度慢的問題。除此之外,在尋優至中后期時,整個灰狼種群均趨向于向α、β、δ狼所在的位置移動。一旦α、β、δ狼困在局部范圍內搜尋目標獵物,整個灰狼種群將無法繼續實現種群的進化[29]。基于此,受文獻[30]中長鼻浣熊狩獵行為的啟發,本文提出了一種漸進式位置更新策略。首先將灰狼種群分為兩組,前一半灰狼種群在α狼的帶領下移動到搜索空間中的不同位置,廣泛搜索并包圍獵物;隨后,后一半灰狼種群根據α、β和δ狼的指導位置快速逼近并攻擊獵物,以加速收斂。該策略通過廣度與深度的結合實現在問題空間上勘探與開發的適當平衡。

2.2.1 包圍策略

在長鼻浣熊的勘探階段[30],群體中的長鼻浣熊兵分兩路,其中一部分浣熊采用的包圍策略可以使長鼻浣熊移動到空間中的不同位置,很好地展現了長鼻浣熊的全局勘探能力[31]。基于此,本文將該策略融入灰狼種群的部分狩獵行為,使得算法在擴大搜索范圍的基礎上提高收斂的速度和精度。數學模型為

Xi(t+1)=Xi(t)+r×(Xbest(t)-I×Xi(t))(15)

其中:r表示各分量取值為[0,1]的隨機實數;I為一個隨機整數,來自集合{1,2};Xi(t)為第i只灰狼個體在t時刻的位置;Xbest(t)為當前種群中最佳個體(即α狼)的位置;Xi(t+1)為第i只灰狼個體在t+1時刻的位置。

每次迭代時,該部分的位置更新過程將不再根據三只頭狼指導位置的平均值確定,而是通過灰狼個體當前位置和α狼的位置進行位置更新。這樣便更靠近最佳個體(α狼)的位置,提高了收斂速度。除此之外,r與I的雙重擾動使得灰狼種群在α狼周圍隨機游蕩,擴大了搜索范圍,避免了局部最優。這可以使種群進一步向著全局最優解方向進化,提高收斂精度。

2.2.2 動態權重因子

若α狼不是全局最優,隨著灰狼個體向三個最優搜索代理位置靠攏時,整個算法也將陷入局部最優,難以找到真正的最優解[32]。因此,本文引入一種基于最優個體位置向量模值的比例權重,通過權重因子的不斷變化,動態調節算法的全局勘探能力和局部開發能力,加速算法收斂。

GWO算法中三只頭狼的位置是動態變化的,則權重因子也應隨著尋優過程非線性調整變化。因此,近年來許多學者根據頭狼的指導位置或利用適應度值對位置更新公式進行了有效改進。比如利用指導位置改進的文獻[19,33]以及利用適應度值改進的文獻[34]等。標準GWO算法通過計算三只頭狼指導位置的平均值來更新灰狼位置,如式(12)所示。本文為了加強當前迭代過程中最優個體的作用,對式(12)進行了改進,如式(19)所示。

其中:‖Xα(t)‖、‖Xβ(t)‖和‖Xδ(t)‖表示t時刻三個最優個體(α、β和δ狼)位置的向量模值;w1(t)、w2(t)和w3(t)為基于步長歐氏距離的比例權重,分別代表其余灰狼個體對α、β和δ狼的學習率,用于控制位置更新時種群個體向α、β和δ狼前進的步長和方向。文獻[35]從理論角度對運用基于步長歐氏距離的比例權重效果進行了研究驗證,表明權重因子在算法的每一次迭代中不斷變化,使得三只頭狼能夠動態地指導狼群前進。由于α狼不一定是全局最優點,易陷入局部最優,本文利用此特點,在文獻[35]的理論基礎上設計了基于最優位置的權重因子w1(t),該權重因子的大小主要取決于α狼的當前位置,而α狼不一定是全局最優,所以每次迭代中的w1(t)也不一定小于w2(t)和w3(t)。同理,w2(t)和w3(t)的大小也在不斷變化。經過不同程度的學習,灰狼個體可以動態調節向頭狼前進的步長和方向至迭代結束。因此,將灰狼個體的位置更新公式改進如式(19)所示,該策略通過引入動態權重解決了算法收斂速度慢以及易陷入局部最優的問題。

綜上,與經典GWO算法的主要區別是:漸進式位置更新策略將灰狼種群分為兩組,且不再全程依照α、β和δ狼的位置更新迭代。種群中一半的灰狼僅隸屬于α狼,而不再受α、β和δ狼的共同領導,因此加快了收斂速度;另一半灰狼則遵循不同的學習率,動態地向獵物逼近,提升了算法的全局尋優性能。此外,在每次迭代過程中,兩組灰狼群體按照不同的更新方式并行前進。又因受動態變化的權重因子w1(t)、w2(t)、w3(t)與隨機擾動因子r、I的影響,使得算法在加快收斂速度的同時避免局部最優,提升了算法的收斂精度。

算法1 PGGWO算法

2.3 復雜度分析

本節對PGGWO算法的計算復雜度進行分析,并用Big-O表示法表示。設灰狼的種群規模為N,問題的維數為D,最大迭代次數為T。對于GWO算法,每次迭代的初始化階段需O(N×D),適應度函數評估需要O(N),α、β、δ三只頭狼的選擇需要O(N),位置更新過程需要O(N×D),總的計算復雜度為O(N×D×T)。而對于PGGWO算法,其每一次迭代,種群初始化需要O(N×D),適應度函數評估需要O(N),α、β、δ三只頭狼的選擇需要O(N),兩階段的位置更新策略各需要O(N×D/2)。因此,每次迭代總的計算復雜度為O(N×D),那么整個迭代的計算復雜度為O(N×D×T)。由此可見,本文PGGWO在整體上并沒有增加計算復雜度,與標準GWO算法的計算復雜度相同。

2.4 收斂性分析

算法的收斂性是指某個算法能否在迭代時間趨于無窮的假設下,最終找到問題的全局最優解。

通過第3章的數值實驗與分析可知,PGGWO算法在絕大多數測試問題上都能收斂到零誤差均值,即找到了全局最優解。為了更直觀地對算法收斂行為進行綜合分析,本節給出了如圖4所示的PGGWO在多峰函數f18(表1)上的搜索歷史、軌跡、平均和最優適應度值收斂曲線圖。

圖4(a)展示了灰狼種群的搜索歷史,可以呈現搜索空間中每個個體的分布。其中黑色的圓點代表種群個體的分布,紅色五角星狀的點代表搜索空間中的全局最佳位置(參見電子版)。可以看出,大多數個體都分布在全局最優解的周圍,說明該算法具有良好的勘探能力,能夠在搜索空間中更準確地確定有希望的搜索區域。為了更直觀地展示搜索空間中個體勘探和開發的順序,本節以第四只狼為例畫出了其軌跡圖,如圖4(b)所示。首先存在突變行為,然后算法逐漸收斂到全局最優,可以擴大迭代中的隨機搜索范圍,保證勘探和開發之間的平衡。從圖4(c)(d)可以看出,PGGWO算法在迭代中一直在收斂,逐漸接近最優解,表明

PGGWO具有良好的收斂能力。幾次收斂停滯表明算法已陷入局部最優,但由于PGGWO的多收斂因子策略,使其又跳出了局部最優,說明該算法具有較好的避免局部最優的能力。

3 數值實驗與分析

為驗證PGGWO的收斂能力與尋優性能,證明其有效性和先進性,本章在24個Benchmark函數上進行數值實驗。如表1所示, f1~f12為單峰函數, f13~f24為多模態函數,其中包含旋轉、噪聲等復雜函數,可以綜合檢驗算法的尋優能力。

首先,通過與經典GWO對比,驗證PGGWO的有效性;其次,將PGGWO分別與OGWO[18]、MSGWO[20]、AGWO[22]和new-GWO[24]四種近幾年的GWO優秀變體進行比較;再次,與鯨魚優化算法(whale optimization algorithm,WOA)[36]、BWO[11]、金豺優化算法(golden jackal optimization,GJO)[37]和蜜獾算法(honey badger algorithm,HBA)[38]四種競爭力較強的新型進化算法對比,以驗證PGGWO的先進性;然后,通過對PGGWO的勘探開發百分占比分析進一步揭示算法性能優劣的真正原因;最后,將PGGWO應用于三個實際工程問題來檢驗算法的實用性。

3.1 實驗設置

本文在Windows 10操作系統中完成,實驗環境是Intel CoreTM i5-8500 CPU@3.00 GHz處理器,實驗平臺是MATLAB R2020a。所有算法的種群規模N均為50,且比較算法的參數均基于原文獻。為避免偶然性,所有算法在每個函數上均獨立運行50次,記錄50次運行結果的誤差均值(mean)和標準差(std),前者反映算法的收斂精度,后者反映算法的穩定性,因此誤差均值是比較的重點。

3.2 PGGWO與標準GWO對比

將PGGWO與標準GWO在迭代次數T=500的條件下分別取D=30、50和100進行對比,實驗結果如表2所示,加粗數據表示最優。可以看出,當D=30、50和100時,PGGWO在24個函數上均獲得了最好結果,且在f1、f3、f5、f6、f8~f14、f17、f19、f22~f24這16個函數上得到了精確解(理論最優值0)。且在f2和f4函數上誤差均值可達-200次方以上。

為了更加直觀地比較PGGWO與GWO在不同基準函數上的收斂精度與收斂速度,繪制出兩個算法在f1、f7、f10、f13、f19、f22這六個基準函數上的收斂曲線,如圖5所示。其中,橫坐標為灰狼種群迭代次數,縱坐標為算法獨立運行50次后求得平均最小誤差再取對數值。從圖5(a)可以看出,在三個維度上,GWO的收斂速度比較緩慢且精度不高,誤差指數約為-35;PGGWO擁有較好的收斂速度和精度,誤差指數可在300次迭代內到達-300以上。在函數f7上,GWO與PGGWO收斂趨勢十分相似,但相比之下PGGWO在迭代初期便迅速收斂,比GWO的誤差均值降低了2個指數級。在函數f13上,當D=50和100時,PGGWO的收斂曲線出現了停滯現象,這表示算法到達局部最優;但在迭代中期,PGGWO可以有效跳出局部最優并快速找到全局最優解。這是因為PGGWO的非線性多收斂因子策略使δ狼化身偵察狼,并在浣熊包圍策略的融入后擴大了種群搜索范圍,增強了全局勘探能力,幫助群體找到更有可能存在最優解的區域并快速收斂。在函數f19上可以發現,當維數從30增加到100時,GWO的收斂速度和收斂精度逐漸變差,而PGGWO的收斂速度和精度一直保持不變,大約在40次迭代以內便可得到精確解。說明PGGWO可以有效提高GWO的收斂性能且具有良好的穩定性。綜上,PGGWO的有效性可被證明。

3.3 PGGWO與近幾年優秀變體對比

將PGGWO與OGWO、MSGWO、AGWO和newGWO這四種先進變體在24個Benchmark函數上進行對比。設置基準函數的維度D=200,最大迭代次數T=1000,運行50次。實驗結果如表3所示,加粗數據表示最優結果。與其他算法相比,PGGWO在21個函數上均為最佳。其中,PGGWO在f1~f6、f8~f14、f16、f17、f19、f22~f24這19個函數上均找到了精確解。OGWO和newGWO雖然在函數f11和f23上得到了理論最優值0,并且在函數f20和f21上優于PGGWO,但是在其余20個函數上都不如PGGWO。稍具競爭力的是AGWO,其誤差均值在函數f10、f11、f13、f19、f22和f23上均為零,并且在函數f18上略優于PGGWO,但都處于同一指數級,幾乎無差別。相比之下,MSGWO更具競爭力,該算法在函數f10、f11、f13、f14、f19、f22和f23上與PGGWO一樣都獲得了精確解,并且在函數f20和f21上優于PGGWO,但在其余的15個函數上仍有較大差異。由此可見,雖然這些GWO變體在低維環境下具有優異的性能,但卻不能有效求解高維全局優化問題,并不適合高維環境。相反,即使當D=200時,PGGWO仍然在19個Benchmark函數上精確地收斂到理論最優值,說明PGGWO具有良好的延展性,適用于高維優化環境。

為了清楚地比較PGGWO與四個變體之間的收斂過程,繪制了它們在不同Benchmark 函數上的收斂曲線。如圖6所示,PGGWO具有最快的收斂速度,在迭代初期便有著明顯的收斂效果,并且不易陷入局部最優。PGGWO在函數f1、f5和f24上的收斂精度及速度均明顯優于其他四種對比算法。在函數f15上,PGGWO與AGWO、MSGWO在500次迭代之后的收斂精度十分接近,但仍能發現PGGWO的精度要優于其他兩種算法,且收斂速度也十分明顯。在函數f22上,PGGWO收斂更加迅速,幾乎看不到收斂曲線。

觀察所有收斂曲線圖不難發現,PGGWO的收斂速度和精度均明顯優于其他對比算法。這是因為在位置更新階段加入了包圍策略,使得前一半的灰狼種群無須綜合三只頭狼的指導位置進行更新,只接受α狼的領導,從而大大提高了算法的收斂精度。顯而易見的是,PGGWO的收斂曲線在迭代前期便急速下降,這正是引入動態權重因子的緣故,使得后半部分的灰狼個體可以動態調節前進的步長和方向,從而加速算法收斂。

僅從誤差均值和標準差這兩個指標出發衡量各算法的優化效果還遠遠不夠,需要進行統計檢驗以證明PGGWO具有顯著的性能優勢[39]。本文采用Wilcoxon秩和檢驗比較PGGWO與其他算法的差異。在5%的顯著性水平下對算法獨立運行50次的誤差均值進行統計檢驗。結果如表3最后一行所示,“w/t/l”表示PGGWO優于/近似于/劣于相應的對比算法。

可以發現,PGGWO在24個函數上的性能明顯優于其他對比算法。并且PGGWO的性能在f1~f9、f12、f15~f18、f20、f21和f24函數上顯著優于四種GWO變體,僅在f18、f20和f21基準函數上稍遜于相應的對比算法,但誤差均值相差不到一個指數級,在其余函數上獲得了相近的結果。由此可見,PGGWO在這24個函數上具有整體有效性。

3.4 PGGWO與其他先進算法對比

將PGGWO與WOA、BWO、GJO和HBA四種近幾年提出的競爭力較強的進化算法在D=200,T=1000上進行對比。類似地,為了避免偶然性,每個算法獨立運行50次,并使用50次計算誤差的平均值和標準差作為評價指標。表4顯示了五種算法的數值實驗結果,加粗數據表示最優結果。可以看出,PGGWO在22個Benchmark函數上獲得了最小的誤差均值,在19個Benchmark函數上獲得了理論最優值,顯然是五種進化算法中綜合性能最好的。WOA在函數f10上也收斂到了與PGGWO相同的精確解,但在其他23個函數上均比PGGWO差;GJO在所有函數上均不如PGGWO,并且其誤差均值沒有一個收斂到零。相比之下,BWO和HBA展現了較強的競爭力,BWO雖然僅在f11上取得了零誤差值,但在函數f20和f21上勝出,優于所有對比算法;HBA則在函數f9、f11、f13、f19和f23上均獲得了零誤差均值。盡管這些先進算法在低維問題上表現出了優異的性能,但在求解高維優化問題時其性能有所下降。相反,即使當D=200時,PGGWO在19個函數上仍然能精確地收斂到理論最優值。因此,本文的改進策略使GWO適用于高維優化環境,算法性能具有良好的延展性。

同樣地,為了更好地評價PGGWO和對比算法,圖7顯示了五種算法在不同Benchmark函數上的部分收斂曲線。觀察可得,PGGWO在不同的Benchmark函數上的收斂速度比其他進化算法更快,且不易陷入局部最優。特別地,對于函數f13、f22,PGGWO收斂迅速,幾乎看不見收斂曲線。此外,可以發現在函數f18上PGGWO曾多次出現停滯現象,但在幾次迭代之后便跳出了局部最優,繼續進化。這是因為PGGWO采用了非線性的多收斂因子策略,使得種群的搜索范圍擴大,全局勘探能力增強。

為了證明PGGWO比其他對比算法具有顯著的性能優勢,采用Wilcoxon秩和檢驗,結果如表4最后一行所示。可以看出,PGGWO的性能在函數f1~f8、f12、f15~f18、f20、f21、f24上顯著優于其他四種進化算法;在函數f9~f11、f13、f14、f19、f22和f23上與對比算法獲得相似的結果;僅在函數f20和f21上劣于對比算法。可見,即使與先進的進化算法對比,PGGWO也表現出了較強的競爭力。

3.5 勘探開發比分析

僅從誤差的均值和標準差進行分析和討論并不能揭示算法性能優劣的真正原因。勘探(exploration)和開發(exploitation)的平衡與否可以描述算法在迭代過程中是否達到最佳性能。勘探的目的是為了使算法具有盡可能多的局部最優解,開發的目的是為了使算法快速收斂到全局最優解。對勘探和開發的評價有助于更好地理解為什么某些算法在優化問題上表現優秀或低劣。為了進一步評估PGGWO,本節對其勘探和開發能力進行了測試,并對結果進行了討論。

目前鮮有研究深入分析GWO的勘探和開發能力,為了提供可靠的理論依據,本節采用文獻[40]提出的維度多樣性測量方法評價勘探和開發。引入式(20):

其中:median(j)表示規模為NP的種群中所有個體第j維變量的中位數。由文獻[40]可知,式(20)被用來檢測維度多樣性。種群內個體維度距離均值的增加代表勘探,減少代表開發。一旦計算出種群多樣性,即可進一步判斷種群在進化過程中的勘探占比和開發占比。勘探或開發的百分比測量可由式(21)定義。

為驗證PGGWO平衡這兩個狀態的能力,并解釋為什么PGGWO是有效的,本節在更為復雜、應用最廣泛的CEC2014測試集上分析了PGGWO的勘探和開發行為。圖8分別顯示了GWO和PGGWO在部分測試函數上的勘探開發占比情況。

GWO在迭代前期就迅速以局部開發為主導,如圖8(a)~(c)所示,這會導致算法前期的全局勘探不足,易陷入局部最優。而PGGWO的多收斂因子策略便較好地克服了這一缺點,使得算法在迭代前期能保持一定的勘探占比,如圖8(d)~(f)所示。可以看出,PGGWO在迭代前期注重全局范圍的搜索,尋找進化方向。迭代中期勘探和開發逐漸交替,迭代后期開發占比快速增加至100%,以加速向目標最優解移動。這是因為包圍策略和動態權重因子可以使種群快速向目標位置移動,使種群在中后期相對接近最優解。這種情況下,不宜在大范圍內進行探索,而應在小范圍內尋找更優的候選解。因此,種群在進化后期傾向于局部開發。仔細觀察便可發現,PGGWO在勘探與開發之間取得了良好的平衡,沒有過度注重勘探,也沒有過度集中于開發。并且從全局勘探到局部開發的過程是分階段的,前期廣泛搜尋獵物,后期快速逼近獵物,這也符合種群演化的特點。因此,該工作有效提高了GWO對勘探與開發的平衡能力。

3.6 工程應用

使用三個工程設計問題,通過與HHO(harris hawk optimization)[41]、AGWO、MSGWO、BWO和GJO比較目標函數是否最小,進一步驗證PGGWO的實用性。PGGWO本身是針對無約束優化問題提出的,因此,求解約束優化問題時,需要對約束條件進行處理。根據進化計算中約束處理方法的研究進展,約束處理方法主要分為罰函數方法、可行性規則方法和多目標方法三類。其中,罰函數因其簡單易實現而最為常用。為了簡單起見,采用一種常見的懲罰方法處理約束條件:

其中:gi(x)是不等式約束,hj(x)是等式約束;p是不等式約束的個數,q是等式約束的個數,并且都是正的常數;η和λ為1或2。對于這種懲罰方法,當候選解違反任何約束時,目標函數值都會增加,將種群從不可行解推入可行域內。

3.6.1 壓力容器設計問題

在該設計問題中,目標函數為壓力容器的總成本,包括材料、成型和焊接成本[42]。如圖9所示,壓力容器的兩端都有蓋子封頂,頭部一端的封蓋為半球狀。該優化問題包括四個決策變量:容器壁的厚度(Ts)、半球頭部的厚度(Th)、內半徑(R)、和圓柱截面的長度(L)。數學模型如式(24)所示。

將PGGWO在30次獨立運行中針對壓力容器設計問題獲得的結果與HHO、AGWO、MSGWO、BWO和GJO五種對比算法比較,測試結果如表5所示。與其他算法相比,PGGWO在求解壓力容器設計問題上獲得了不錯的結果。就最優解而言,PGGWO的優化效果要優于其他五種對比算法。

3.6.2 拉/壓彈簧設計問題

彈簧是工業生產中的重要部件,影響其結構性能的因素很多,如圖10所示。

拉/壓彈簧的設計目的是在滿足最小繞度、震動頻率和剪應力的約束下,最小化拉壓彈簧的重量[43]。該問題由三個連續的決策變量組成,即彈簧線圈直徑(d)、彈簧簧圈直徑(D)和繞線圈數(P)。數學模型表示如下:

式(25)中的目標函數是一個典型的多變量約束優化問題。為了說明PGGWO的設計效果,仍選擇HHO、AGWO、MSGWO、BWO和GJO五種優秀算法應用于目標函數,并對優化結果進行了比較。各算法得到的彈簧設計參數和目標函數結果如表6所示。可以看出,PGGWO在設計拉/壓彈簧問題上所得目標函數值最小,優于其他對比算法。

3.6.3 輪系設計

如圖11所示,該問題的目的是使輪系的傳動比成本最小化[44]。此問題有四個整數變量,其中Ta、Tb、Td和Tf表示四個不同齒輪的齒數。轉動比為(Tb/Ta)·(Td/Tf)。數學模型如下:

表7給出了PGGWO與其他五種對比算法在輪系設計問題上的結果。可以看到,PGGWO的最優設計參數為(51,30,13,53),目標函數值為2.31E-11。結果表明PGGWO在尋找該問題的最優解方面也是非常有效的,并且優于其他對比算法。

綜上所述,在三個復雜的工程設計優化問題上,PGGWO比其他對比算法取得了更好的優化效果。因此,PGGWO是一種值得推廣和應用的先進算法,可以廣泛應用于約束優化問題。

4 結束語

本文通過對經典GWO及其相關改進算法的分析和研究,提出了一種漸進式分組狩獵的灰狼優化算法。首先,設計了非線性多收斂因子策略,提高全局勘探能力、避免局部最優;其次,提出了漸進式位置更新策略,前一半灰狼個體采用浣熊的包圍策略,后一半則根據設計的動態權重因子增強尋優效果。通過深度與廣度的結合,提高了算法的收斂速度和全局尋優性能。通過在24個Benchmark函數上的對比實驗發現,PGGWO的整體性能優于所對比的八種算法。在算法復雜度幾乎不發生變化的同時,PGGWO避免了GWO易陷入局部最優的情況,提高了收斂精度和速度。但是在個別函數上,PGGWO仍然存在收斂精度不高、穩定性不夠好的問題,未來將嘗試在迭代后期加入變異擾動策略等進行改進。此外,在工程設計優化問題中,PGGWO可以獲得較好的設計參數,說明PGGWO具有一定的實際應用價值。在今后的工作中,可以與圖像處理、入侵檢測、車輛路徑、無線傳感器網絡等其他領域更復雜的優化問題相結合。

參考文獻:

[1]Gu Xin,Wang Guan,Li Ning,et al. Application of response surface optimization technology and fluid-structure interaction in the enginee-ring design of torsional flow heat exchangers [J]. Proceedings of the Institution of Mechanical Engineers,Part C: Journal of Mechanical Engineering Science,2022,236(12): 6607-6620.

[2]Kumar R R,Stauvermann P J,Samitas A. An application of portfolio mean-variance and semi-variance optimization techniques: a case of Fiji [J].Journal of Risk and Financial Management,2022,15(5): 190.

[3]Al-Odat Z A,Ali M,Abbas A,et al. Secure hash algorithms and the corresponding FPGA optimization techniques [J]. ACM Computing Surveys,2020,53(5): article No.97.

[4]Sriyakul T,Jermsittiparsert K. Optimal economic management of an electric vehicles aggregator by using a stochastic p-robust optimization technique [J]. Journal of Energy Storage,2020,32(12): 102006.

[5]Su Shen,Qin Yixiao,Yang Kaiyao. Structural optimization of unsymmetrical eccentric load steel box girder based on new swarm intel-ligence optimization algorithm [J]. International Journal of Steel Structures,2022,22(5): 1518-1536.

[6]Holland J H. Genetic algorithms [J]. Scientific American,1992,267(1): 66-73.

[7]Kennedy J,Eberhart R. Particle swarm optimization [C]// Proc of IEEE International Conference on Neural Networks. Piscataway,NJ: IEEE Press,1995: 1942-1948.

[8]Storn R,Price K. Differential evolution-a simple and efficient heuristic for global optimization over continuous spaces [J]. Journal of Global Optimization,1997,11(4): 341-359.

[9]Simon D. Biogeography-based optimization [J]. IEEE Trans on Evo-lutionary Computation,2008,12(6): 702-713.

[10]Mirjalili S,Mirjalili S M,Lewis A. Grey wolf optimizer [J]. Advances in Engineering Software,2014,69: 46-61.

[11]Zhong Changting,Li Gang,Meng Zeng. Beluga whale optimization: a novel nature-inspired metaheuristic algorithm [J]. Knowledge-Based Systems,2022,251(9): 109215.

[12]Seyyedabbasi A,Kiani F. I-GWO and Ex-GWO: improved algorithms of the grey wolf optimizer to solve global optimization problems [J]. Engineering with Computers,2021,37(1): 509-532.

[13]Seyyedabbasi A,Aliyev R,Kiani F,et al. Hybrid algorithms based on combining reinforcement learning and metaheuristic methods to solve global optimization problems [J]. Knowledge-Based Systems,2021,223(7): 107044.

[14]Jiang Jianhua,Zhao Ziying,Liu Yutong,et al. DSGWO: an improved grey wolf optimizer with diversity enhanced strategy based on group-stage competition and balance mechanisms [J]. Knowledge-Based Systems,2022,250(8): 109100.

[15]Sharma I,Kumar V,Sharma S. A comprehensive survey on grey wolf optimization [J]. Recent Advances in Computer Science and Communications,2022,15(3): 323-333.

[16]Banaie-Dezfouli M,Nadimi-Shahraki M H,Beheshti Z. R-GWO: representative-based grey wolf optimizer for solving engineering problems [J]. Applied Soft Computing,2021,106(7): 107328.

[17]王敏,唐明珠. 一種新型非線性收斂因子的灰狼優化算法 [J]. 計算機應用研究,2016,33(12): 3648-3653. (Wang Min,Tang Mingzhu. Novel grey wolf optimization algorithm based on nonlinear convergence factor [J]. Application Research of Computers,2016,33(12): 3648-3653.)

[18]Yu Xiaobing,Xu WangYing,Li ChenLiang. Opposition-based learning grey wolf optimizer for global optimization [J]. Knowledge-Based Systems,2021,226(8): 107139.

[19]Chen Xiaojuan,Zhang Haiyang. Grey wolf optimizer with global search strategy [C]// Proc of International Conference on Electronic Information Engineering and Computer Science. Piscataway,NJ: IEEE Press,2021: 775-779.

[20]Mafarja M,Thaher T,Too J,et al. An efficient high-dimensional feature selection approach driven by enhanced multi-strategy grey wolf optimizer for biological data classification [J]. Neural Computing and Applications,2023,35(1): 1749-1775.

[21]Wang Jing,Lin Dakun,Zhang Yuanzi,et al. An adaptively balanced grey wolf optimization algorithm for feature selection on high-dimensional classification [J]. Engineering Applications of Artificial Intelligence,2022,114(9): 105088.

[22]劉紫燕,吳應雨,梁靜,等. 基于雜交策略的自適應灰狼優化算法 [J]. 計算機應用研究,2022,39(1): 113-117. (Liu Ziyan,Wu Yingyu,Liang Jing,et al. Adaptive gray wolf optimization algorithm based on hybridization strategy [J]. Application Research of Computers,2022,39(1): 113-117.)

[23]李全耀,沈艷霞. 一種基于教與學的混合灰狼優化算法 [J]. 控制與決策,2022,37(12): 3190-3196. (Li Quanyao,Shen Yanxia. A hybrid gray wolf optimization algorithm based on the teaching-learning optimization [J]. Control and Decision,2022,37(12):3190-3196.)

[24]Rao R V,Savsani V J,Vakharia D P. Teaching-learning-based optimization: a novel method for constrained mechanical design optimization problems [J]. Computer-Aided Design,2011,43(3): 303-315.

[25]謝少鵬,吳柏生. 基于改進灰狼優化算法的結構損傷識別 [J/OL]. 計算力學學報. (2023-03-09). http://cjcm.ijournals.net.cn/jslxxb/ch/reader/view_abstract.aspx?flag=2&file_no=202208220000001 & journal_id=jslxxb. (Xie Shaopeng,Wu Baisheng,Zhao Xiuting,et al. Structural damage identification based on improved gray wolf optimization algorithm [J/OL]. Chinese Journal of Computational Mechanics. (2023-03-09). http://cjcm.ijournals.net.cn/jslxxb/ch/reader/view_abstract.aspx?flag=2&file_no=202208220000001 & journal_id=jslxxb.)

[26]Mittal N,Singh U,Sohi B S. Modified grey wolf optimizer for global engineering optimization [J]. Applied Computational Intelligence and Soft Computing,2016,2016: article ID 7950348.

[27]李征南,秦江濤. 基于混合擾動的非線性灰狼優化算法 [J]. 軟件工程,2023,26(7): 34-39. (Li Zhengnan,Qin Jiangtao. Non-linear grey wolf optimization algorithm based on hybrid perturbation [J]. Software Engineering,2023,26(7): 34-39.)

[28]Pan Hongyu,Chen Shanxiong,Xiong Hailing. A high-dimensional feature selection method based on modified gray wolf optimization [J]. Applied Soft Computing,2023,135(3): 110031.

[29]Yang Bo,Zhang Xiaoshun,Yu Tao,et al. Grouped grey wolf optimizer for maximum power point tracking of doubly-fed induction generator based wind turbine [J]. Energy Conversion and Management,2017,133(2): 427-443.

[30]Dehghani M,Montazeri Z,Trojovská E,et al. Coati optimization algorithm: a new bio-inspired metaheuristic algorithm for solving optimization problems [J]. Knowledge-Based Systems,2023,259(1):110011.

[31]Sammen S S,Ehteram M,Khozani Z S,et al. Binary coati optimization algorithm-multi-kernel least square support vector machine-extreme learning machine model (BCOA-MKLSSVM-ELM): a new hybrid machine learning model for predicting reservoir water level [J]. Water,2023,15(8): 1593.

[32]陳敏,陳曄,牛興龍,等. 求解全局優化問題的多策略改進灰狼算法 [J]. 國外電子測量技術,2022,41(11): 22-29. (Chen Min,Chen Ye,Niu Xinglong,et al. Multi-strategy improved grey wolf algorithm for solving the global optimization problem [J]. Foreign Electronic Measurement Technology,2022,41(11): 22-29.)

[33]陳闖,Chellali R,邢尹. 采用動態權重和概率擾動策略改進的灰狼優化算法 [J]. 計算機應用,2017,37(12): 3493-3497. (Chen Chuang,Chellali R,Xing Yin. Improved grey wolf optimizer algorithm using dynamic weighting and probabilistic disturbance strategy [J]. Journal of Computer Applications,2017,37(12): 3493-3497.)

[34]Adhikary J,Acharyya S. Randomized balanced grey wolf optimizer (RBGWO) for solving real life optimization problems [J]. Applied Soft Computing,2022,117(3): 108429.

[35]王秋萍,王夢娜,王曉峰. 改進收斂因子和比例權重的灰狼優化算法 [J]. 計算機工程與應用,2019,55(21): 60-65,98. (Wang Qiuping,Wang Mengna,Wang Xiaofeng. Improved grey wolf optimizer with convergence factor and proportional weight [J]. Computer Engineering and Applications,2019,55(21): 60-65,98.)

[36]Mirjalili S,Lewis A. The whale optimization algorithm [J]. Advances in Engineering Software,2016,95(5): 51-67.

[37]Chopra N,Ansari M M. Golden jackal optimization: a novel nature-inspired optimizer for engineering applications [J]. Expert Systems with Applications,2022,198(7): 116924.

[38]Hashim F A,Houssein E H,Hussain K,et al. Honey badger algorithm: new metaheuristic algorithm for solving optimization problems [J]. Mathematics and Computers in Simulation,2022,192(2):84-110.

[39]左汶鷺,高岳林. 基于隨機鄰域變異和趨優反向學習的差分進化算法 [J]. 計算機應用研究,2023,40(7): 2003-2012. (Zuo Wenlu,Gao Yuelin. Differential evolution algorithm based on random neighborhood mutation and optimal opposition-based learning [J]. Application Research of Computers,2023,40(7): 2003-2012.)

[40]Hussain K,Salleh M N M,Cheng S,et al. On the exploration and exploitation in popular swarm-based metaheuristic algorithms [J]. Neural Computing and Applications,2019,31(11): 7665-7683.

[41]Heidari A A,Mirjalili S,Faris H,et al. Harris hawks optimization: algorithm and applications [J]. Future Generation Computer Systems,2019,97(8): 849-872.

[42]Mohammed H,Rashid T. A novel hybrid GWO with WOA for global numerical optimization and solving pressure vessel design [J]. Neural Computing and Applications,2020,32(9): 14701-14718.

[43]Celik Y,Kutucu H. Solving the tension/compression spring design problem by an improved firefly algorithm [EB/OL].(2018-11-26). https://ceur-ws.org/Vol-2255/paper2.pdf.

[44]Ziat A,Zaghar H,Taleb A A,et al. Reliable and robust optimization of the planetary gear train using particle swarm optimization and Monte Carlo simulation [J]. SAE International Journal of Materials and Manufacturing,2021,15(1): 21-33.