基于雙域交互Transformer 的磁共振圖像重建

李博文 王志文 冉茂松 楊子元 張意

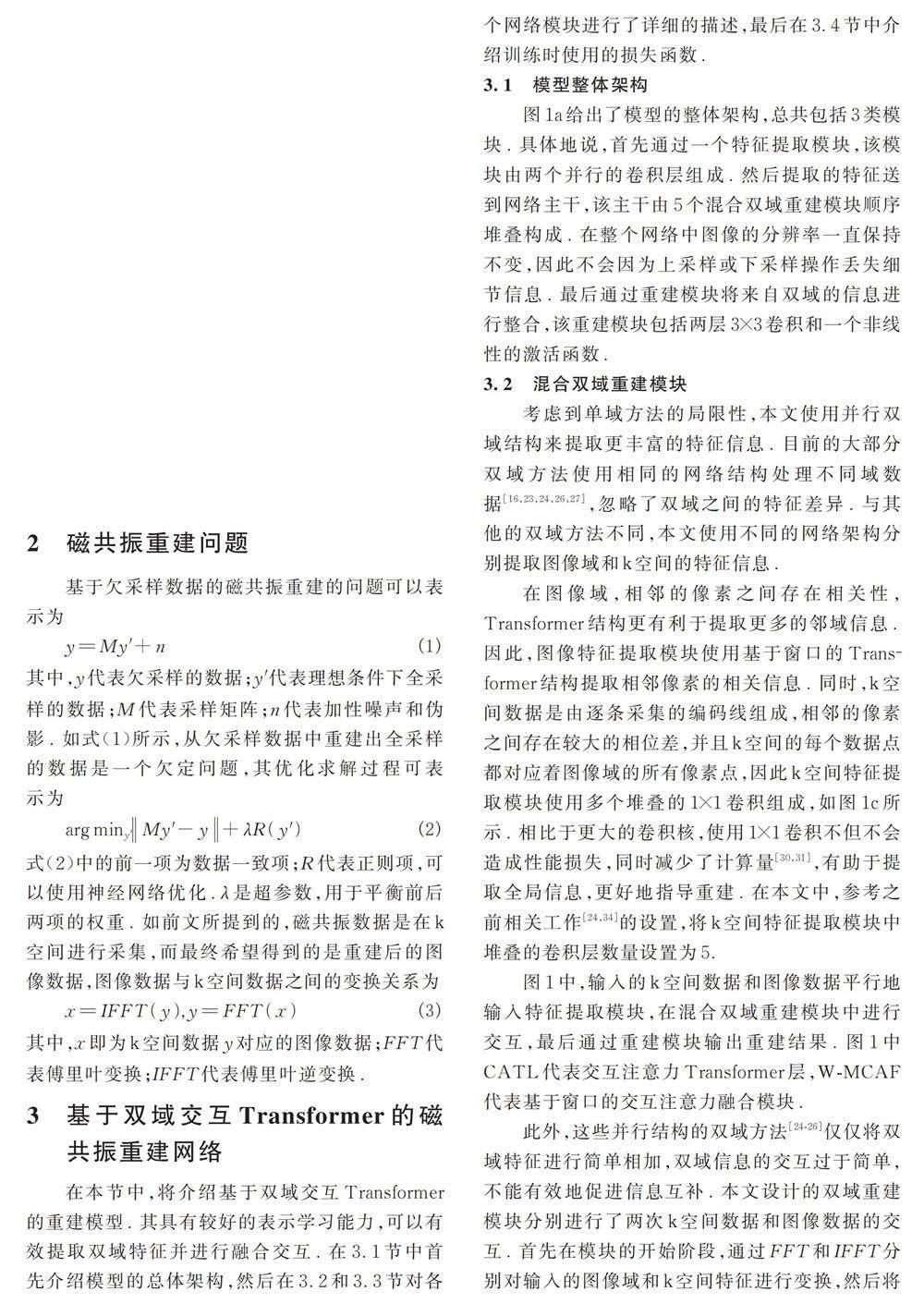

摘 要: 對(duì)k 空間數(shù)據(jù)部分采樣是加速磁共振成像的主要方法. 從欠采樣的數(shù)據(jù)中重建出高質(zhì)量的磁共振圖像,在臨床診斷和研究分析中有著重要的應(yīng)用價(jià)值. 近年來(lái),基于深度學(xué)習(xí)的方法在磁共振重建領(lǐng)域取得了一些進(jìn)展,然而單獨(dú)面向圖像域或頻域的網(wǎng)絡(luò)不能同時(shí)利用雙域特征共同提升重建質(zhì)量. 另外,雖然已有一些雙域重建方法模型,但是缺乏雙域數(shù)據(jù)交互融合限制了重建性能. 針對(duì)以上問(wèn)題,本文提出了一種基于雙域交互Transformer 的磁共振圖像重建網(wǎng)絡(luò)模型,使用Transformer 提取雙域特征,并利用交互注意力引導(dǎo)雙域特征融合,實(shí)現(xiàn)了雙域特征的高效提取和交互. 具體地,首先,由于頻域數(shù)據(jù)每個(gè)點(diǎn)都對(duì)應(yīng)著圖像域的所有像素點(diǎn),因此在k 空間使用1×1 的卷積提取全局特征,同時(shí)使用基于窗口的Transformer 將注意力的計(jì)算限制在了窗口中,減小了計(jì)算負(fù)擔(dān),并且可以有效地對(duì)圖像域特征進(jìn)行表示. 其次,提出了基于交互注意力的Transformer 融合模塊引導(dǎo)雙域特征融合,通過(guò)挖掘雙域特征的相關(guān)性,實(shí)現(xiàn)跨域信息融合. 實(shí)驗(yàn)證明,在公開(kāi)的數(shù)據(jù)集上,本方法相較于其他基線重建方法均能取得更為優(yōu)異的重建效果. 同時(shí),消融實(shí)驗(yàn)證明了本文所提出的網(wǎng)絡(luò)模塊的有效性.

關(guān)鍵詞: 磁共振重建; 卷積神經(jīng)網(wǎng)絡(luò); Transformer; 雙域

中圖分類(lèi)號(hào): TP391. 4 文獻(xiàn)標(biāo)志碼: A DOI: 10. 19907/j. 0490-6756. 2024. 032003

1 引言

磁共振成像(Magnetic Resonance Imaging,MRI)是一種非侵入性的醫(yī)學(xué)成像技術(shù). 相較于其他成像技術(shù)而言,其不需要借助輻射或放射性物質(zhì)的輔助,具有高分辨率和多對(duì)比度成像的特點(diǎn),廣泛應(yīng)用于臨床診斷和化學(xué)分析[1,2]. 然而,MRI較長(zhǎng)的采集時(shí)間限制了它的應(yīng)用場(chǎng)景,不但會(huì)影響患者檢查的舒適性,并且可能會(huì)產(chǎn)生運(yùn)動(dòng)偽影從而導(dǎo)致圖像失真,因此縮短MRI 的采集時(shí)間不但有助于提高患者滿(mǎn)意度、提高成像質(zhì)量,同時(shí)還能為后續(xù)的診斷分析提供良好的輔助. 近十年,國(guó)內(nèi)外研究人員針對(duì)磁共振成像的特點(diǎn)提出了許多加速磁共振算法,取得了一些成果. 這些成果大致可以分為兩類(lèi):一類(lèi)是基于平行成像和壓縮感知(Compressed Sensing,CS)的傳統(tǒng)算法;另一類(lèi)是基于深度學(xué)習(xí)的方法.

平行成像利用接收器表面線圈陣列的空間靈敏度分布,通過(guò)每個(gè)線圈的測(cè)量數(shù)據(jù)共享,減少來(lái)自每個(gè)線圈的測(cè)量數(shù)據(jù),從而減少成像時(shí)間. 為了重建多線圈圖像,提出了一系列平行成像重建算法[3-5]. CS 理論[6,7]的出現(xiàn)從軟件算法層面進(jìn)一步提高了成像效率. 根據(jù)CS 理論,假設(shè)目標(biāo)MRI 圖像是稀疏的,即信號(hào)信息只存在于部分像素中,或者圖像可以變換到另一空間,經(jīng)過(guò)變換的信號(hào)在該空間具有稀疏性,從而可以利用這種稀疏性從較少的采集數(shù)據(jù)中恢復(fù)出高質(zhì)量的圖像. 經(jīng)典的基于CS 理論的方法包括基于全變分[8],曲線小波[9],雙密度復(fù)數(shù)小波[10]以及字典學(xué)習(xí)[11]的重建方法. 然而,由于這類(lèi)方法需要進(jìn)行迭代求解,盡管提高了采樣速度,但重建過(guò)程顯著減慢,使得基于CS 的MRI 重建方法在臨床應(yīng)用中舉步維艱.

近年來(lái)深度學(xué)習(xí)在計(jì)算機(jī)視覺(jué)領(lǐng)域取得了巨大成功. 卷積神經(jīng)網(wǎng)絡(luò)[12](Convolutional NeuralNetwork, CNN)得益于卷積操作的局部性和共享參數(shù)的性質(zhì),隨著網(wǎng)絡(luò)層數(shù)增加,能夠充分提取高維特征. CNN 已經(jīng)在磁共振重建領(lǐng)域中展示了其優(yōu)越性. Wang 等人[13]利用CNN 學(xué)習(xí)欠采樣MR圖像到全采樣MR 圖像之間的映射. ADMMCSNet[14]將ADMM 算法的迭代過(guò)程展開(kāi)成網(wǎng)絡(luò),端到端地學(xué)習(xí)網(wǎng)絡(luò)參數(shù). 在卷積神經(jīng)網(wǎng)絡(luò)的基礎(chǔ)上,對(duì)抗生成模型(Generative Adversarial Network,GAN)因其強(qiáng)大的生成能力也被引入磁共振重建中[15,16].

相較于CNN,Transformer[17]具有更強(qiáng)的遠(yuǎn)距離建模的能力,能有效利用像素之間相關(guān)性進(jìn)行特征提取. 近幾年,Transformer 在自然語(yǔ)言處理領(lǐng)域取得了突破性的進(jìn)展[18],隨后引入了計(jì)算機(jī)視覺(jué)領(lǐng)域[19]. 但是,相較于自然語(yǔ)言,圖像數(shù)據(jù)量大,將Transformer 直接應(yīng)用到視覺(jué)任務(wù)上會(huì)引入巨大的計(jì)算量. Swin Transformer 提出了具有移位窗口方案的分層體系結(jié)構(gòu),通過(guò)在窗口內(nèi)進(jìn)行注意力操作減小了計(jì)算開(kāi)銷(xiāo)[20]. SwinMR 將SwinTransformer 結(jié)構(gòu)應(yīng)用于磁共振重建領(lǐng)域并取得了不錯(cuò)的重建效果[21]. HUMUS-Net 提出了CNN 和Transformer 的混合網(wǎng)絡(luò)結(jié)構(gòu),并且通過(guò)降低輸入Transformer 的圖像分辨率減少了計(jì)算量[22].

以上的方法僅單獨(dú)對(duì)k 空間或圖像域的特征進(jìn)行重建. 由于k 空間和圖像域擁有高度的信息耦合,基于雙域數(shù)據(jù)的方法逐漸成為主流,即從頻域和圖像域同時(shí)提取特征完成重建[23-27]. 然而現(xiàn)有的雙域方法在頻域和圖像域使用相同的網(wǎng)絡(luò)結(jié)構(gòu),而忽略了兩類(lèi)數(shù)據(jù)的差異:k 空間數(shù)據(jù)是由逐條采集的相位編碼線組成的,相鄰的數(shù)據(jù)之間存在較大的相位差,而圖像域之間的像素點(diǎn)在不同尺度上存在相關(guān)性. 另外,在現(xiàn)有的雙域網(wǎng)絡(luò)中,頻域特征與圖像域特征缺乏交互融合,在重建的過(guò)程中不能充分地起到信息互補(bǔ)的作用,重建性能還有進(jìn)一步提高的空間.

本文針對(duì)圖像域和k 空間數(shù)據(jù)的不同特點(diǎn),充分考慮雙域數(shù)據(jù)之間的差異和聯(lián)系,提出了基于雙域交互Transformer 的重建網(wǎng)絡(luò),分別使用兩種不同的網(wǎng)絡(luò)結(jié)構(gòu)提取k 空間數(shù)據(jù)和圖像數(shù)據(jù)的特征. 根據(jù)頻域卷積理論[28,29],k 空間的每一個(gè)單獨(dú)的數(shù)據(jù)點(diǎn)都對(duì)應(yīng)圖像域所有的像素點(diǎn),參考文獻(xiàn)[29-31]在頻域卷積的實(shí)踐,采用1×1 卷積核可以在降低計(jì)算量的同時(shí)提取全局信息,避免相位差干擾,在交互的過(guò)程中為圖像域提供更精準(zhǔn)的信息補(bǔ)充. 同時(shí),在圖像域使用基于窗口的Transformer結(jié)構(gòu),相較于CNN,基于窗口的Transformer有更強(qiáng)大的關(guān)聯(lián)表示能力,可以有效地提取圖像特征[32,33]. 與原始的Transformer 結(jié)構(gòu)相比,在窗口中計(jì)算注意力降低了計(jì)算量,減輕了計(jì)算負(fù)擔(dān). 最后,采用交互注意力的融合模塊將雙域特征進(jìn)行融合. 與簡(jiǎn)單的特征相加不同,該融合模塊通過(guò)交換來(lái)自雙域特征的Query(Q),Key(K)和Value(V)來(lái)表示雙域特征之間的相關(guān)性,實(shí)現(xiàn)跨域融合. 實(shí)驗(yàn)結(jié)果表明,所提出的模型在有效重建磁共振圖像的同時(shí),可以保留解剖細(xì)節(jié),無(wú)論是在定性還是定量的實(shí)驗(yàn)結(jié)果上,都取得了更好的效果.