基于注意力權重機制和引導成本體積激勵的三維重建多視圖立體網絡算法研究

關鍵詞:多視圖立體;三維重建;注意力機制;成本體積

中圖分類號:TP391 文獻標志碼:A

0 引言(Introduction)

多視圖立體重建(MVS)使用多個不同視角的圖像還原場景的三維幾何結構,其作為計算機視覺領域的一個基本問題被廣泛關注和研究了幾十年[1]。

近年來,基于成本體積的深度學習方法已成為利用高分辨率圖像進行MVS的首選技術[2-5]。這些方法在整個深度范圍內對平面均勻采樣構建成本體積,但若初始估計的深度與實際深度相差較大,則誤差會迭代到最終精細層次,導致結果錯誤。

本文針對初始深度估計誤差大的問題,在CVPMVSNET(Cost Volume Pyramid Based Depth Inference for Multi-ViewStereo)[4]的基礎上設計了新的MVS網絡。引入關注感受野的注意力機制[6]到特征提取網絡,有利于后續的注意力加權學習。提出了注意力加權模塊,以更加關注圖像金字塔的多層次細節并計算出更精細的特征圖,同時在三維卷積更深層,引入引導成本體積激勵模塊(GCE)[7]以補充成本體積。通過大量實驗證明,該模型能平滑初始深度估計,在DTU數據集上的表現優于目前大多數先進算法的表現。

1 相關工作(Related work)

1.1 基于學習的MVS算法

采用卷積神經網絡學習從多個視角圖像推斷深度圖,再通過單獨的多視圖融合過程完成三維模型重建。YAO等[8]提出MVSNET(Multi-View Stereo Network)利用圖像的單應性變換和基于方差的成本度量構建成本體積,隨后通過三維卷積進行正則化處理,以獲取深度圖。雖然這種方法的重建效果較好,但是對內存的要求高。為了處理高分辨率圖像,一些循環方法[9-11]使用GRU或者LSTM 以遞歸方式構建成本量,但通常為減少空間需求,會犧牲更多的運行時間。一些研究[12-14]不使用固定分辨率構建成本體積,而是通過從粗到精的多尺度方法迭代深度估計。這些多尺度方法通過在低分辨率下構建粗的成本體積估計深度圖,然后在較高分辨率下構建局部的成本體積優化初始深度圖。也有方法[14]注意到構建成本體積過早決策,但其稀疏體積造成了過多的參數及使用過多的內存。盡管從粗到精的多尺度方法迭代深度估計方式已經取得了較好效果,但是依然面臨空間信息不夠豐富和初始深度圖過早估計的問題。本文引入關注感受野的空間通道注意力解決空間信息不夠豐富的問題。與現有研究[14]不同,本文利用注意力加權和引入引導成本激勵模塊嘗試解決初始深度圖過早估計的問題。

1.2 立體匹配

立體匹配方法通常包括匹配成本計算、成本聚合、優化和視差細化4個過程的全部或部分[15-16]。本文受卷積神經網絡的啟發,引入端到端網絡計算立體匹配和成本聚合,以獲得更好的匹配結果。文獻[17]至文獻[19]嘗試利用多尺度思想進行視差建模優化提升運算速度。文獻[17]和文獻[18]表明,三維卷積在聚合成本體積階段,神經網絡能從數據中捕獲幾何信息,利用空間變化的模塊補充和豐富三維卷積。在文獻[7]中利用引導成本體積激勵方法實現了基于空間依賴的三維操作,提升了關注效率和速度。

1.3 注意力機制

注意力機制已被廣泛應用于自然語言處理中,以捕捉上下文依賴信息[20]。注意力機制在語義分割、圖像字幕和目標分類等計算機領域[21]都得到了應用。卷積神經網絡的核心構建塊是卷積算子,它能使網絡通過每層的局部感受野內融合空間和通道信息構造信息特征。文獻[22]至文獻[24]將重點放在通道關系上,設計出有效的通道注意力,文獻[25]和文獻[26]將通道和空間注意相結合以取得更好的效果。但是,受限于卷積參數共享問題,現有的注意力并沒有專門針對感受野的空間特征,ZHANG等[6]提出的方法很好地解決了上述問題。

2 方法(Method)

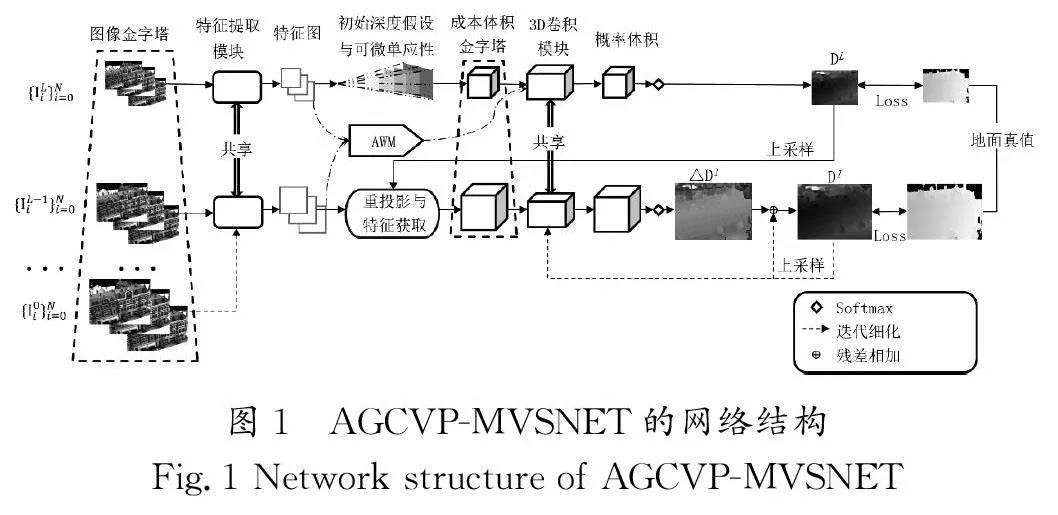

本文提出了多視圖立體推斷方法(AGCVP-MVSNET),其網絡結構設計充分借鑒了立體匹配方法和注意力機制,利用基于由粗到精的方法構建成本體積金字塔,實現深度推斷,AGCVP-MVSNET的網絡結構如圖1所示。

本文對多視圖圖像進行下采樣,形成圖像金字塔,構建了權值共享的特征提取模塊,對每一層進行特征提取。深度推斷從最粗層(L層)開始,使用基于方差的度量構建成本體積,并通過三維卷積層和Softmax操作對成本體積進行正則化,生成初始深度圖。根據初始深度圖和深度殘差假設,迭代地構建部分代價體,以獲得經過優化的更精確的深度圖。本文方法的關鍵在于充分利用圖像金字塔的每一層,生成注意力權重特征圖并應用于正則化生成初始深度圖,以避免迭代估計產生更大誤差的深度估計。

2.1 特征提取網絡

目前,類似于FPN(Feature Pyramid Network)的分層特征提取方法已經取得了不錯的效果。這些模型通過堆疊多個卷積層,使網絡能夠學習到輸入數據的復雜特征。然而,不同層級的卷積特征之間存在通信不暢的限制,導致特征表達能力無法達到理想的效果。

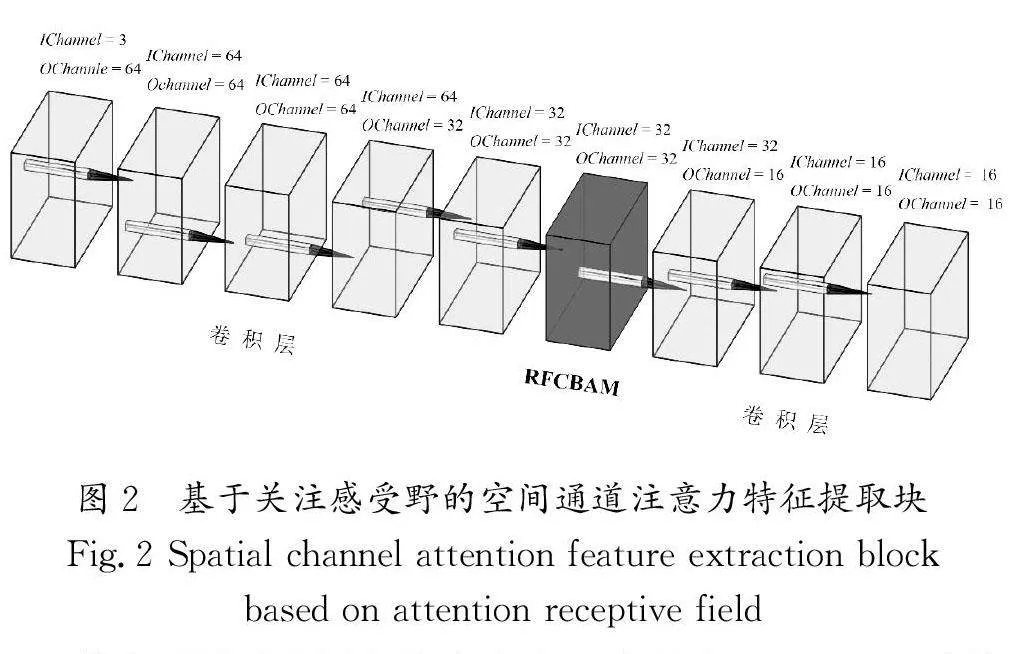

本文將RFCBAM(Receptive Filed Convolutional BlockAttention Module)[6]引入特征提取模塊的中間層,專注于感受野的空間通道注意力機制。特征提取塊由8個卷積層和1個RFCBAM中間層組成,基于關注感受野的空間通道注意力特征提取塊如圖2所示。

其中,所有卷積層的核大小為3,步長為1,IChannel為輸入通道,OChannel為輸出通道,中間層的特征通常包含更多的語義信息,將其放置在此處有助于更好地融合上下層信息,從而使特征提取網絡發揮更好的效果。

關注感受野空間特征的卷積運算。目前,空間注意力機制最大的限制是不能完全解決大卷積核的參數共享問題。空間注意力的每個特征圖上的像素點會對應乘以一個注意力權重。然而進行這樣的卷積運算時,感受野特征重疊,導致注意力權重會在每個感受野特征中進行共享,而感受野注意力(Receptive-Field Attention,RFA)解決了這個問題,并考慮了感受野中每個特征的重要性。RFA通過和卷積操作的相互依賴提出了感受野注意卷積(RFACONV[6]),其是通過分組卷積提取感受野空間特征,計算公式如下:

3 實驗(Experiment)

3.1 數據集

本文采用了DTU數據集和最新發布的BlendedMVS數據集進行實驗驗證。DTU數據集[28]是一個廣泛使用的3D重建基準數據集,其特點是圖像分辨率高,富含豐富的紋理和細節。此數據集涵蓋124個場景,每個場景包含49個不同視角的拍攝,且每個視角均有7種不同亮度的圖像,每張影像的分辨率為1 600×1 200。此外,該數據集包含帶有深度圖真值的訓練影響集,可用于訓練神經網絡。研究人員使用與現有研究[8-9]一樣的訓練集和測試集劃分比例。BlendedMVS數據集[29]是一個包含超過17 000個MVS訓練樣本的大規模合成數據集,涵蓋了113個場景,包括建筑、雕塑和小物體。由于沒有官方評估工具,因此研究人員對其結果進行了比較。

3.2 訓練

本文設計的模型是基于PyTorch 實現的,并在CVPMVSNET代碼的基礎上進行了改進。考慮到本網絡是通過由粗到精的迭代估計深度圖進行構建的,因此可以使用低分辨率的圖像尺寸訓練模型,從而提高訓練速度。

在DTU數據集上使用160×120的圖像尺寸進行訓練,訓練后的權重文件在1600×1200全尺寸的測試集上進行評估。值得注意的是,為了能夠訓練三維卷積網絡,要將圖像尺寸的寬度和高度設置為能被16整除的值。此外,為了使注意力權重模塊能夠更好地工作,研究人員使用5張視圖進行訓練,并且在評估時使用同樣的視圖數量,以保證訓練的權重文件能夠更好地實現推斷,在本文“3.5小節”的消融實驗中展示不同視圖的結果。使用ADAM(Adaptive Moment Estimation)[30]訓練優化模型。網絡在NVIDIA 2080Ti圖形卡上訓練29輪。設置初始學習率為0.001,然后在訓練過程中,分別在完成第10輪、第12輪、第14輪和第20輪迭代之后,將學習率減半。研究人員使用修改過的fusibile工具箱預測深度圖生成密集的點云[8]。對于定量評估DTU 數據集的重建效果,可以通過DTU數據集提供的官方MATLAB腳本計算精度和完整性。其中,精度(Acc.)是指深度圖中估計深度與真實深度的一致程度,Comp.是指重建模型生成的點云與真實的點云之間的完整性,取兩者均值為總體精度(OA),表示為公式(11):

3.3 DTU數據集上的結果

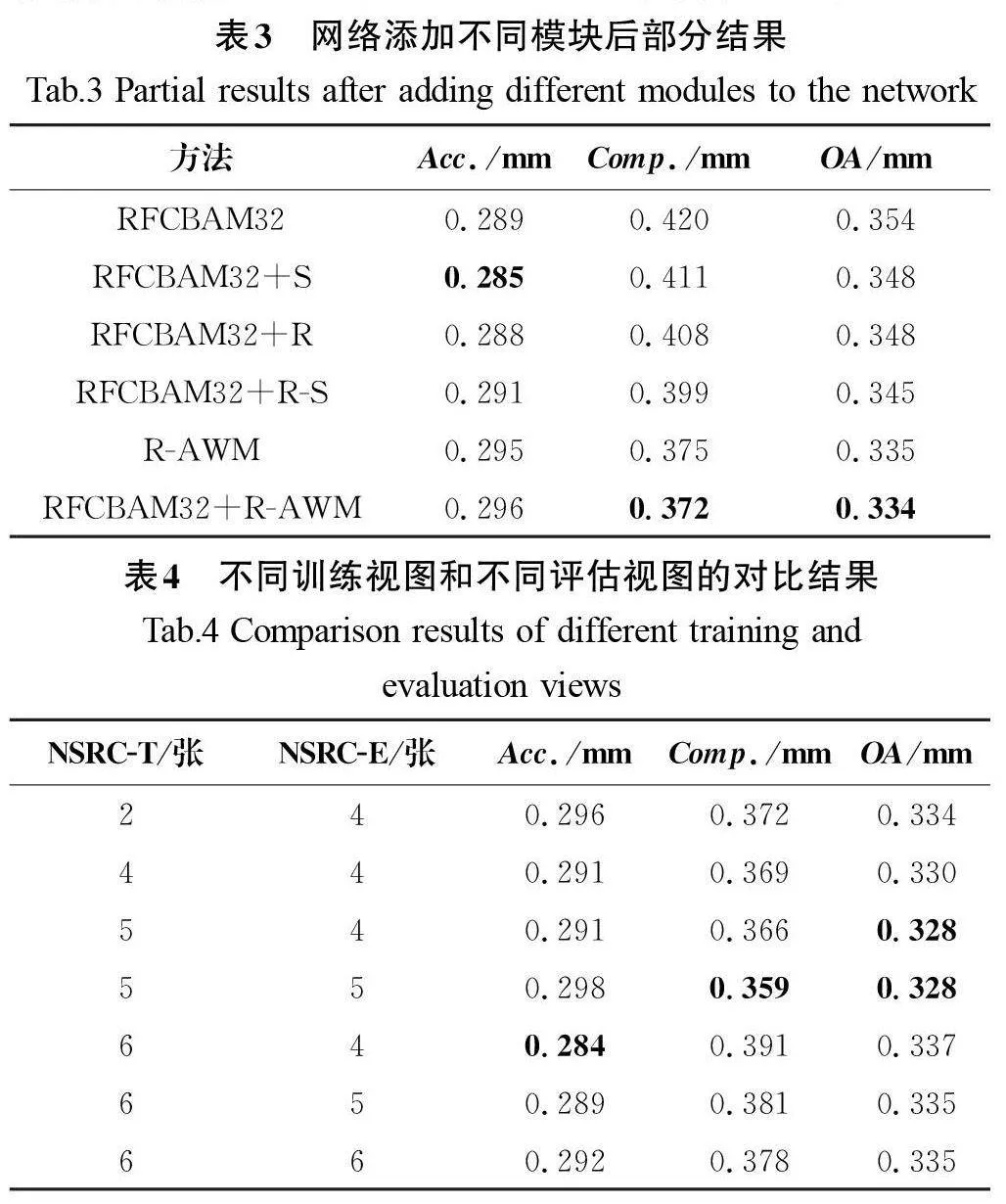

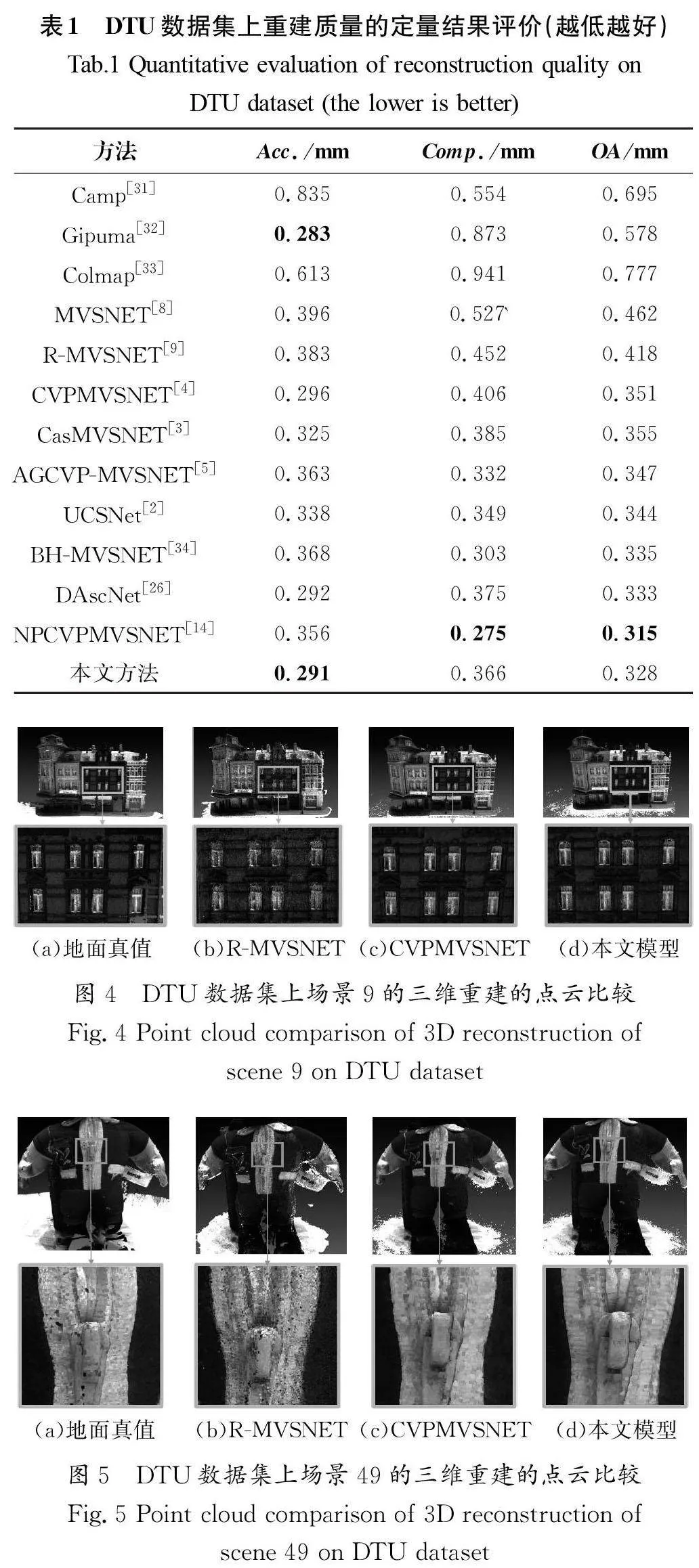

將本文改進的方法與傳統的基于幾何的方法和基于深度學習的方法進行比較。如表1所示,在訓練視圖數量為5、評估視圖為4時,點云融合的精度為0.291,這一結果在目前重建效果中排名第二低,并且達到基于深度學習方法重建的最優水平,而總體精度為0.328,優于大部分其他方法。與初始的CVPMVSNET相比,精度提高了1.68%,完整度提高了9.85%,總體精度提高了6.55%,上述結果表明本文改進方法有效。

為了驗證本文模型重建效果的優異性,在圖4和圖5中對比了2個DTU點云重建結果。圖4展示了幾種方法在DTU數據集場景9的三維重建效果。圖4(c)和圖4(d)都展現出相對較好的完整性,特別是在窗戶部分,與圖4(a)對比,圖4(b)窗戶細節略顯模糊,圖4(d)更關注微小的特征和紋理。

圖5展示了幾種方法在DTU數據集場景49的三維重建效果。與圖5(c)和圖5(d)都展現出相對較好的完整性,特別是在放大的拉鏈和衣領部分,圖5(d)更加平滑和清晰。

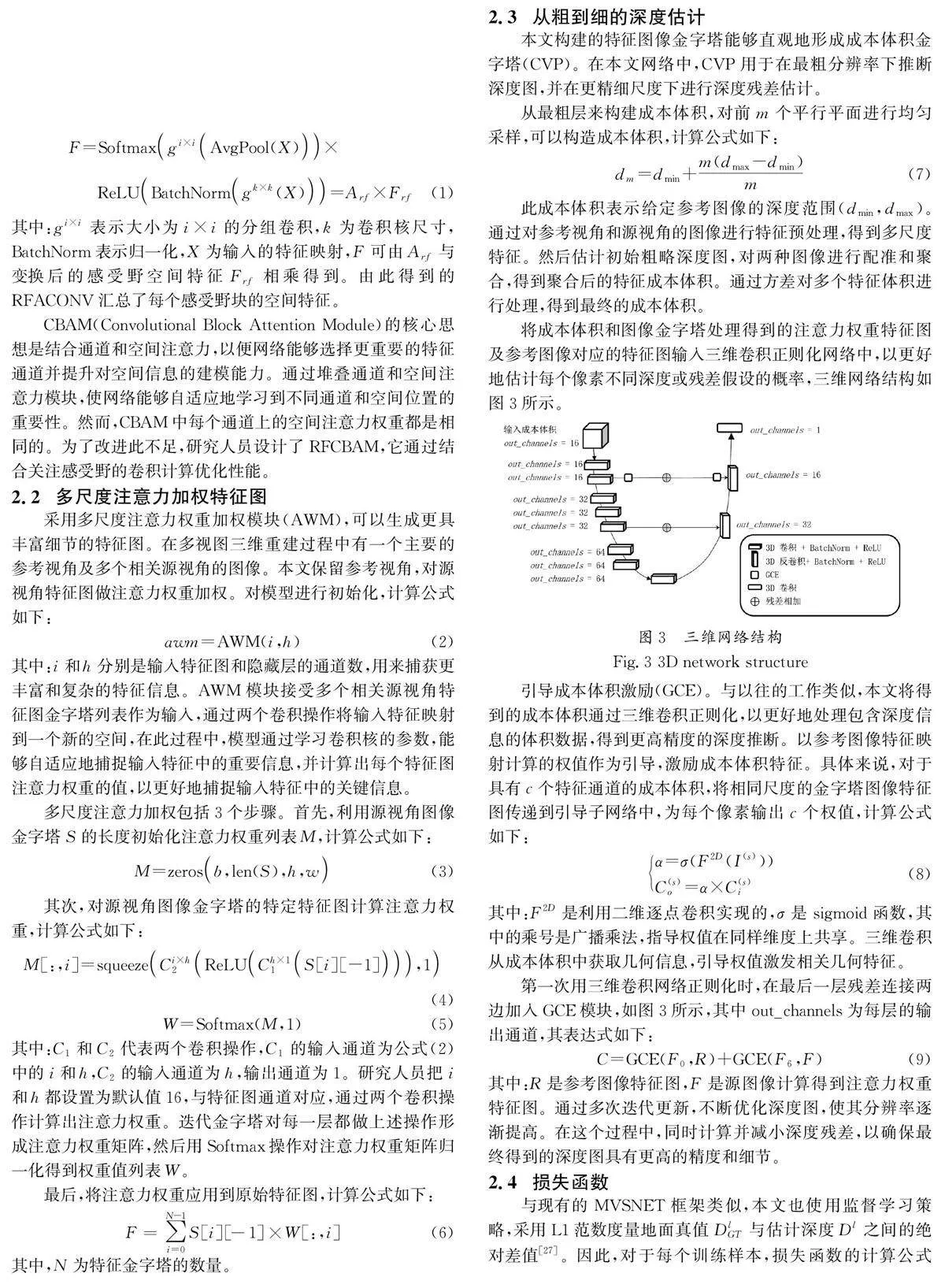

圖6(b)和圖6(c)展示了在DTU數據集的場景49、33及15(順序從上到下)的部分視角的深度圖對比。如圖6(c)所示,與圖6(b)相比,重建結果在邊緣區域的清晰度和平滑度有所提高,如圖6(c)中第一行的嘴巴、第二行兔子的尾巴部分及第三行城堡房頂的窗戶輪廓,有更加高的清晰度和平滑度。

3.4BlendedMVS上的結果

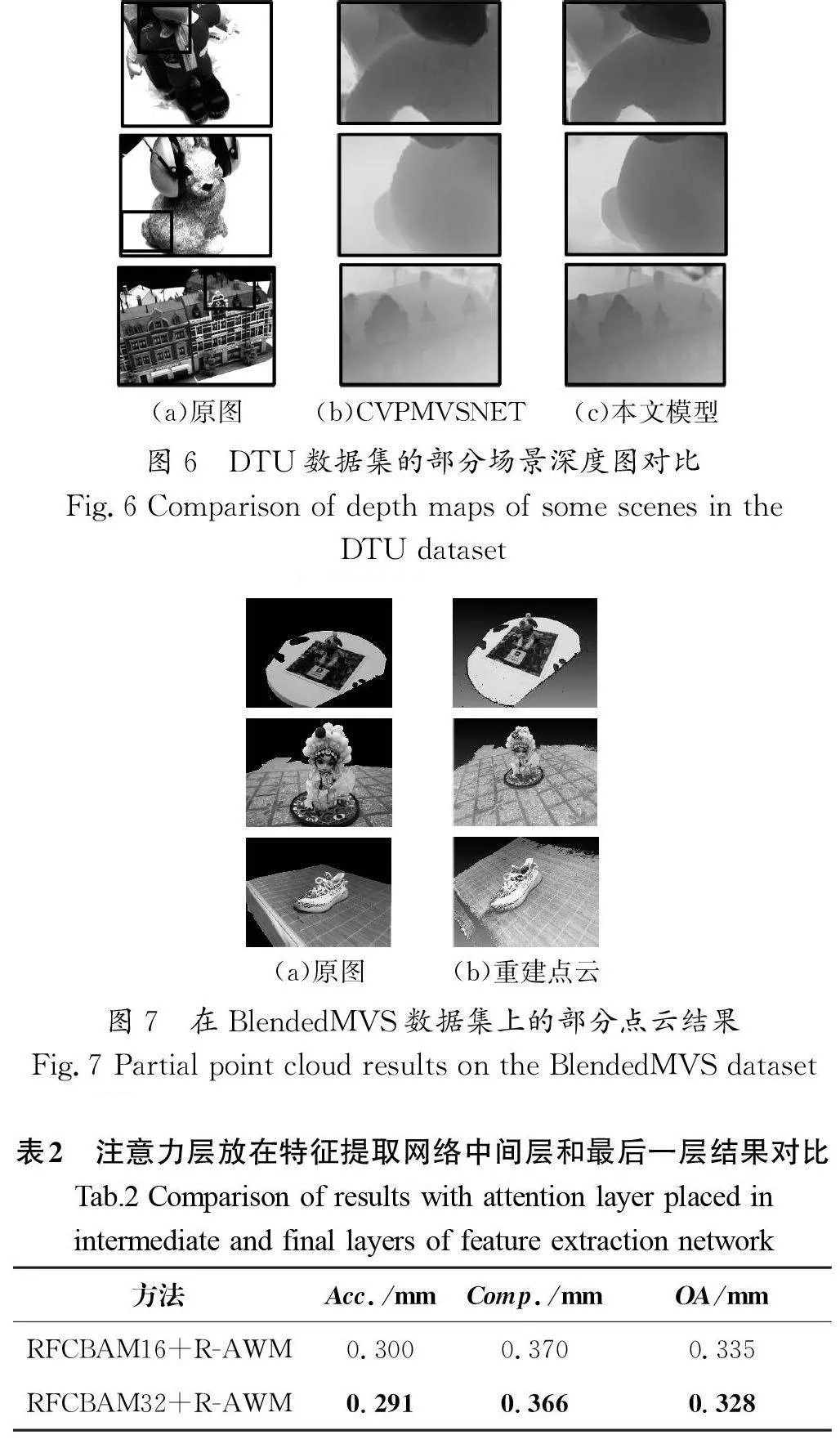

本文繼續在BlendedMVS數據集評估本文方法的泛化能力。由于BlendedMVS數據集不包含官方提供的3D重建結果,因此只展示一些定性結果。本文使用DTU數據集上的訓練視圖為5的訓練權重,依舊采用修改過的fusibile工具箱生成密集的點云及點云融合,在BlendedMVS官方2 048×1 536數據集上重設分辨率為1600×1184進行評估。圖7展示了部分場景的重建結果,其中圖7(a)是多視圖圖像某個視角的原圖。不難看出,本文方法的訓練權重不做任何更改,但在視角不固定的BlendedMVS數據集上依舊有較好的效果。

3.5 消融實驗

對比注意力層放在特征提取網絡中間層和最后一層的結果(表2)。保持和CVPMVSNET相同的訓練參數,使用5張視圖進行訓練,結果顯示RFCBAM 放在中間層時,Acc.、Comp.、OA值更低,對比放在最后一層時,準確度提高了3%,完整度提高了1.08%,總體精度提高了2.08%。上述結果表明注意力層在中間位置更有效。

表3在DTU數據集上對比分析了對CVPMVSNET在訓練視圖為2、評估視圖為4時添加不同模塊的指標對比結果。對比CVPMVSNET,只用注意力層替換特征提取中間層,準確度提高了2.3%,表明注意力層能更好地與地面真值點云的吻合。不添加注意力層,僅在圖3兩邊GCE模塊分別輸入參考視角R和注意力加權特征圖AWM,準確度提高了0.3%,完整性提高了8.2%,表明本文提出的加權特征圖能更好地包含地面真實場景的信息。同時,使用RFCBAM32和R-AWM 的總體精度最低為0.335,比CVPMVSNET提高了4.56%。

此外,表4用表3中性能表現最好的方法,驗證不同的訓練視圖(NSRC-T)和評估視圖(NSRC-E)對DTU結果的影響,研究人員發現評估視圖并不是越多越好。在訓練和評估視圖都為6的情況下,雖然準確度降到了0.284(目前最低為0.283),但是完整度升高導致總體精度下降,而在訓練視圖為5、評估視圖為4時,結果最好。

4 結論(Conclusion)

針對MVS初始構建成本體積存在深度估計誤差大的問題,本文提出了基于感受野的特征提取和注意力權重特征圖匹配代價激勵成本體積的方法。該方法改進了CVPMVSNET,在特征提取階段能夠充分提取像素之間的上下文信息,并且通過在粗層次使用注意力權重特征圖對成本體積進行激勵,避免了早期深度誤差過大并迭代到更細的層次。在兩個具有挑戰性的基準數據集的實驗結果表明,本文方法取得了良好的性能,并優于一些先進的方法,特別是與CVPMVSNET相比,重建的場景邊緣深度更平滑,細節更豐富。未來,研究人員將進一步完善網絡結構和激勵成本體積方法,以降低內存需求,并提升對不同的應用程序的適應性。

作者簡介:

郭曉棟(1998-),男,碩士生。研究領域:深度學習,計算機視覺。

賀平安(1969-),男,博士,教授。研究領域:數學模型,機器學習。

代 琦(1979-),男,博士,教授。研究領域:機器學習,圖像處理,功能基因組分析。本文通信作者。