基于改進 YOLOv8的電梯內電動車識別方法研究

摘 要:針對電梯內電動車識別存在效率低下、精度不佳的問題,提出一種結合AUGMIX圖像增強技術和改進YOLOv8模型的電動車識別方法。將變形卷積層和動態稀疏注意力機制融入YOLOv8,識別更精確和高效。實驗結果表明:改進后算法模型的精確率、召回率和平均精度均值分別達到了94.5%、93%和82.4%,電動車識別準確率達到了95.8%,為電梯內電動車智能識別提供了理論基礎。

關鍵詞:電動車識別;AUGMIX;YOLOv8;變形卷積層;動態稀疏注意力機制

中圖分類號:TP183 文獻標志碼:A 文章編號:1671-5276(2024)04-0219-05

Research on Identification Method of Electric Vehicles in Elevators Based on Improved YOLOv8

LU Chenglong,FENG Yuegui,QING Guangwei

(Nanjing Special Equipment Safety Supervision Inspection and Research Institute, Nanjing 210002, China)

Abstract:A new electric vehicle identification method combining AUGMIX and improved YOLOv8 model is proposed to address the issues of low efficiency and poor accuracy in identifying electric vehicles in elevators. The YOLOv8 model incorporates DCNv3 and BRA to identify electric vehicles with better accuracy and efficiency. The experimental results show that the precision, recall, and mean average precision of the improved algorithm model reach 94.5%, 93%, and 82.4% respectively. And the accuracy of electric vehicle identification reaches 95.8%, providing a theoretical basis for intelligent recognition of electric vehicles in elevators.

Keywords:machine vision; AUGMIX; YOLOv8; DCNv3; Bi-level routing attention

0 引言

隨著我國城市化的快速推進,商場、居民樓及城市軌道交通等場所都安裝了電梯,在帶來了極大乘坐便利的同時,也存在著重大安全隱患。電動車進入電梯轎廂,不僅占用了乘客乘用空間,而且一旦發生自燃會產生大量的火焰和高溫有毒氣體,短時間內充滿整個轎廂,造成人員疏散和逃生困難。此外,電動車進出轎廂如果操作不當,很容易使層轎門碰撞脫軌或者轎廂撞擊變形,造成安全隱患且縮短了電梯的使用壽命[1]。因此,電動車駛入電梯轎廂存在很大的安全隱患。

目前電梯內電動車識別手段主要采用3種方式:人工監控識別、物理阻車和視覺識別[2]。人工監控識別是物業人員通過攝像頭監控轎廂內乘客情況,當發現有電動車進入轎廂時通過語音提醒電動車退出轎廂。物理阻車是在轎廂入口和轎廂內壁設置阻攔欄桿。視覺識別是通過轎廂內攝像頭采集、分析視頻數據,通過計算機視覺技術進行識別。人工監控識別對人力和物力消耗較大,需要相關人員不間斷監控,效率低下且無法及時制止電動車駛入轎廂的行為。物理阻攔方式在阻攔電動車的同時也限制了輪椅、兒童車等工具的駛入,在人流量較大的場所容易產生人員絆倒、摔倒和踩踏事故。視覺識別是基于機器視覺系統的電動車識別系統,根據攝像頭數據信息進行識別,采集電動車圖像信息,進行算法匹配來實現電動車識別[3],具有精度高、響應迅速的優點,具有廣闊的應用前景。

1 整體框架設計

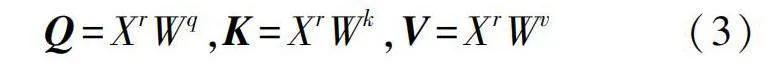

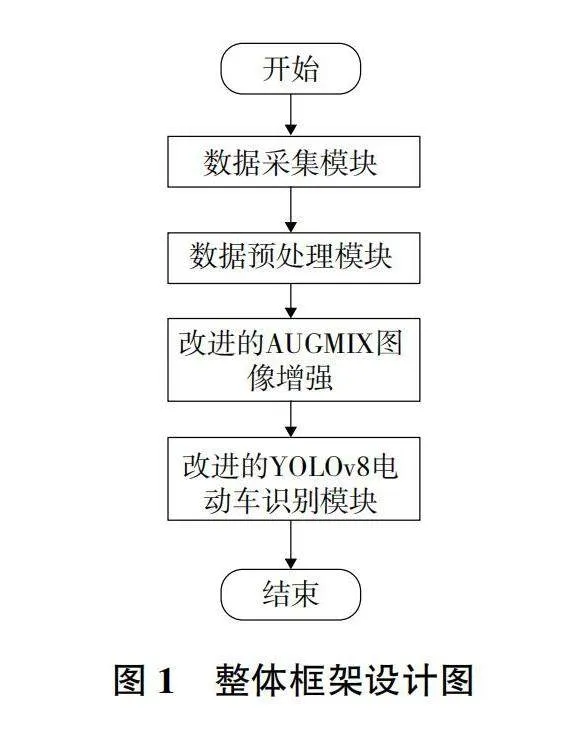

基于AUGMIX和改進YOLOv8的電梯內電動車識別方法,通過在轎廂內安裝或共用現有監控攝像頭采集轎廂內行人、電動車、自行車等圖像信息,進行算法匹配來實現電動車識別。通過AUGMIX技術為電梯轎廂中的電動車識別引入增強的圖像數據集,提高了模型的魯棒性,并通過適應不同情況的變化,顯著降低了過擬合的可能[4]。YOLOv8算法的端到端識別方法與DCNv3的變形卷積層和動態稀疏注意力機制相結合,優化了對電梯轎廂內電動車形狀和結構的適應性,為轎廂式電梯電動車識別提供了實時、精準且計算效率高的識別解決方案。整體框架設計圖如圖1所示。

2 算法設計

2.1 AUGMIX圖像增強算法

AUGMIX結合多種不同的圖像增強技術來生成新的訓練樣本,提高模型在面對自然界圖像分布中共同變形時的泛化能力,從而增加模型訓練數據的多樣性。在AUGMIX中,模型不僅在原始圖像上訓練,而且還要在增強后的圖像上進行訓練。這些增強后的圖像是通過對原始圖像應用一系列隨機選擇的圖像處理操作(稱為“增強操作”)生成的。然后,這些增強操作生成的圖像以一定方式與原始圖像混合,形成最終的訓練樣本。

AUGMIX的關鍵步驟可以概括為以下幾點。

1)選擇原始圖像x,進行k個增強操作,每個增強操作表示為opk。這些操作是針對圖像的特異性變化,例如旋轉、剪切、顏色變換等,本技術中僅對電動車識別率進行改進。

2)將這些操作應用于原始圖像x,生成一組增強圖像{x1,x2,…,xk}。每個增強圖像xi是通過將相應的增強操作opi應用于原始圖像x得到的,即xi=opi(x)。

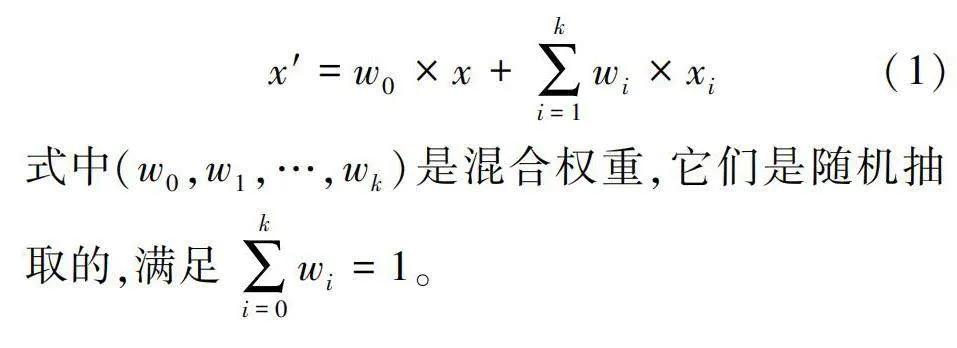

3)將這些增強圖像線性混合,生成最終的訓練樣本。這個混合過程可以表示為以下公式:

式中(w0,w1,…,wk)是混合權重,它們是隨機抽取的,滿足∑ki=0wi=1。

混合后的圖像x′將作為新的訓練樣本。通過這種方式,AUGMIX可以在訓練過程中引入大量的圖像變化,從而提高模型的泛化能力。

2.2 改進的YOLOv8算法介紹

YOLOv8是一種高效的單步目標識別模型,可以實現復雜的目標識別以及定位功能,對圖像框中的多個目標進行標注,得到識別結果[5]。相較于兩步式識別方法,YOLOv8則通過神經網絡一次性提取圖像的特征圖,基于此直接推斷錨框的位置與類別。相較于兩步法,單步識別流程的速度更快,特別是在需要快速響應的實時應用中更顯優勢。

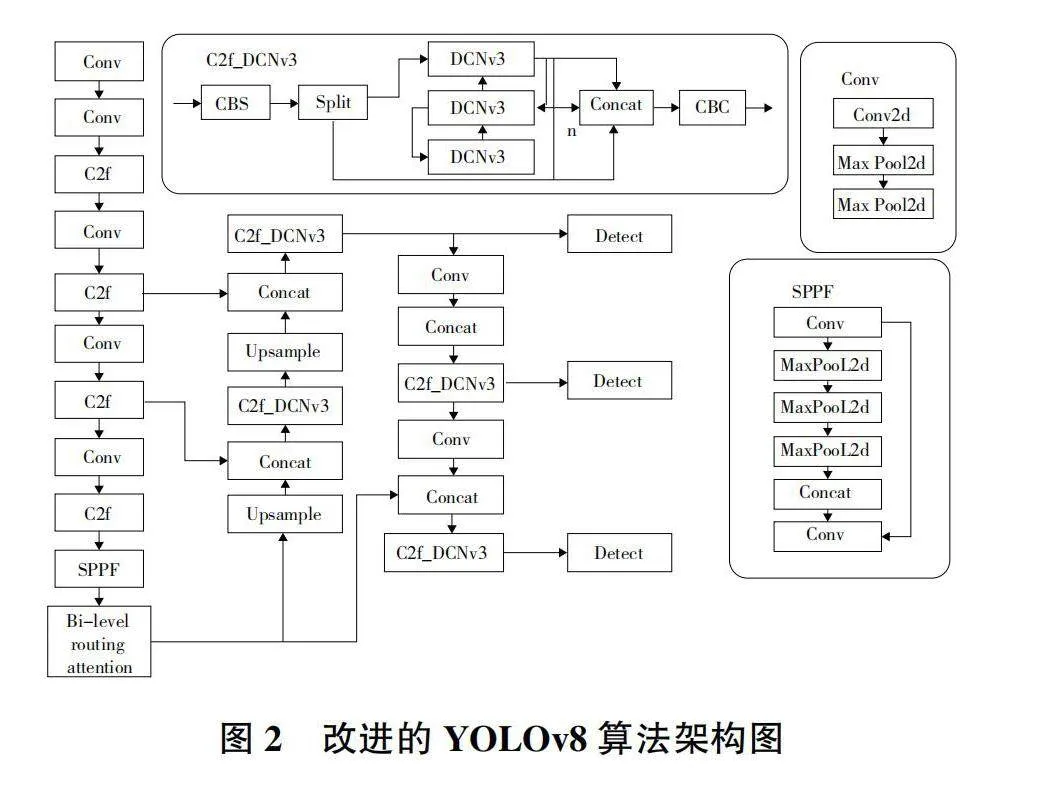

本文基于YOLOv8的改進模型針對電梯轎廂內電動車識別任務進行了針對性改進,改進模型通過應用AUGMIX圖像增強技術提升模型泛化能力,采用端到端的檢測方法簡化系統設計并提高識別效率,實施多尺度檢測策略以增強對不同大小目標的魯棒性。同時,集成DCNv3算子優化了模型對目標形狀的自適應能力,而動態稀疏注意力機制則降低了計算復雜性,使得改進后的YOLOv8不僅識別準確,而且適應實時性和資源受限的應用環境,為電梯轎廂中電動車的精確識別提供了有效的技術支持。改進的YOLOv8算法架構圖如圖2所示。

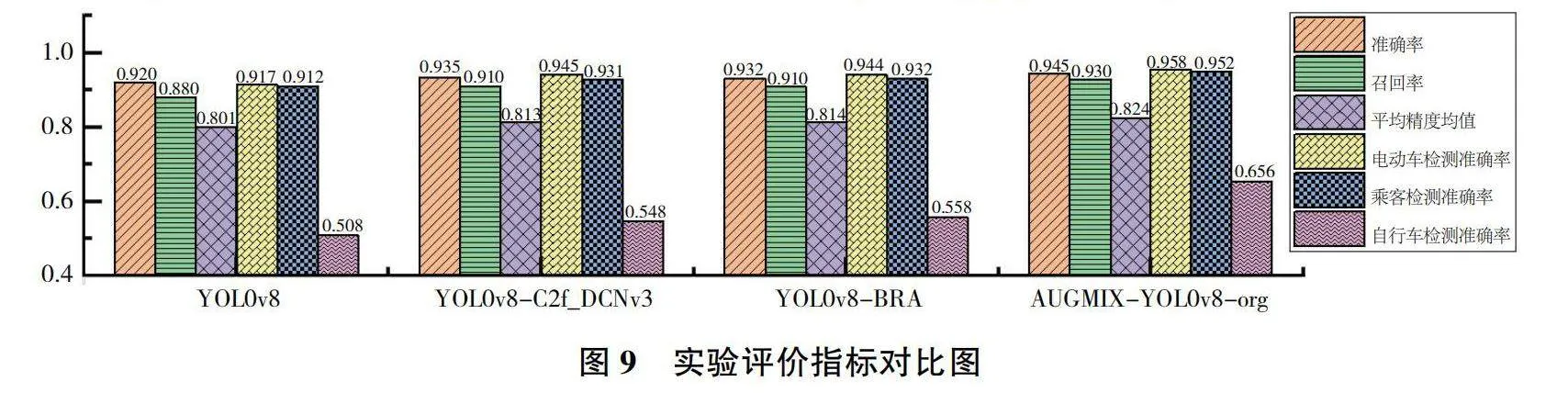

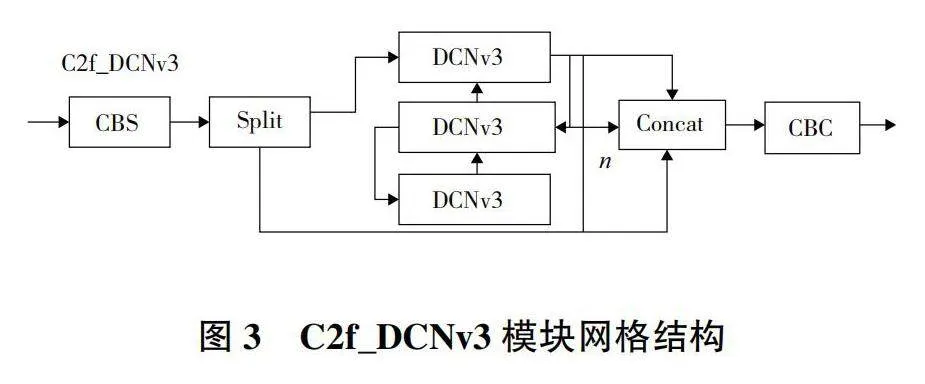

1)結合C2f和可變性卷積網絡的C2f_DCNv3模塊

YOLOv8相較于同系列的其他算法,在主干網絡結構中采用了C2f(cross stagepartial network bottleneck with 2 convolutions)模塊,該模塊能夠有效提高網絡計算速度同時降低計算復雜度。DCNs(deformable convolutional networks)是卷積神經網絡(CNNs)的擴展,引入了可變形卷積層,使得網絡能夠更好地適應圖像中的幾何和形狀變化[6]。這種類型的網絡特別適用于處理圖像中存在的非剛性變形,如姿態變化、視角變換或物體內部的變形等。采用最新的DCNv3對C2f模塊進行擴展,得到C2f_DCNv3模塊,能夠自適應地調整感受野大小,從而更好地符合目標對象的形狀和結構變化,C2f-DCNv3模塊網格結構如圖3所示。

通過引入共享投射權重的策略,將與位置無關的權重代替獨立的投射權重,從而有效減少參數和內存復雜度。此外,采用了多組機制,將空間聚合過程劃分為不同組,每組具有獨立的采樣偏移量,以提高特征的多樣性。為緩解模型容量擴大時的不穩定問題,采用了逐采樣點的Softmax歸一化作為歸一化模式,這不僅提升大規模模型的訓練穩定性,還構建了所有采樣點之間的連接關系。這些改進旨在提高模型效率、降低參數量、增強特征的多樣性,并改善模型訓練的魯棒性,其公式如下所示。

式中:G為聚合組總數;對于第g個組,wg∈RC×C′表示與位置無關的投影權重,其中C′=C/G表示組維度;mgk∈R表示第g個組中第k個采樣點的調制標量,由沿k維的Softmax函數歸一化;xg∈RC′×H×W表示切片后的輸入特征圖;Δpgk為第g組網絡采樣位置pk對應的偏移量。

2)動態稀疏注意力

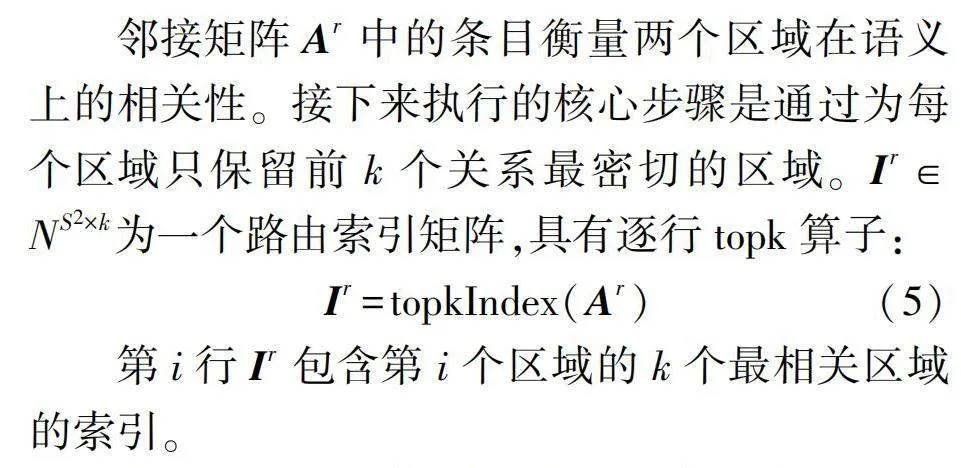

動態稀疏注意力機制作為一種新型注意力機制,通過兩個層次實現輸入的動態稀疏化處理,這樣不僅能過濾掉粗糙區域大部分不相關交互信息,加強有效信息間交互,減弱無效信息間干擾,而且針對細粒度的注意力應用于路由區域的聯合之中,能夠獲取更多有效特征信息。在大幅降低了模型的計算復雜度的同時保持了高水平的性能。相對于其他注意力機制,動態稀疏注意力機制能夠更靈活地調整注意力分布,從而更適應不同尺度和復雜的目標識別,在小目標捕捉中精準度更高。動態稀疏注意力機制作用過程如圖4所示,圖中gather表示基于模型子集的收集/聚集操作,mm表示矩陣乘法(matrix multiptication)。

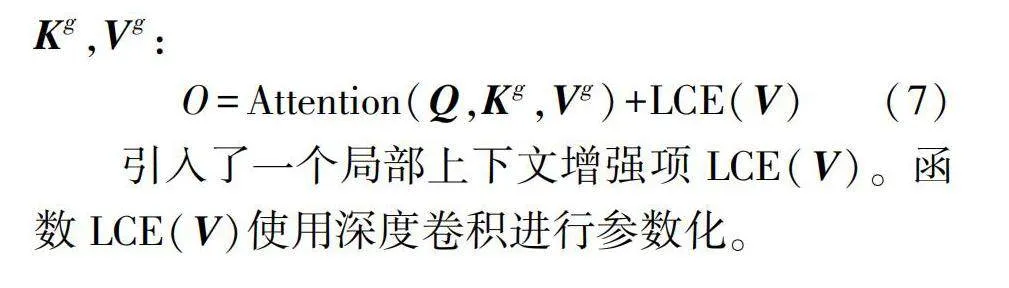

給定一個二維輸入特征映X∈RH×W×C,首先將其劃分為S×S個非重疊區域,使得每個區域包含HW/S2個特征向量。這一步通過reshape X變為X∈RS2×HWS2×C來完成。再經過線性映射得到Q、K、V張量:

Q=XrWq,K=XrWk,V=XrWv(3)

然后,通過有向圖來對區域到區域的注意力關系進行關聯。具體來說,首先通過分別在Q和K上應用每個區域平均值來導出區域級Qr、Kr∈RS2×C。其次,通過Qr和轉置Kr之間的矩陣乘法推導出區域到區域親和度圖的鄰接矩陣Ar∈RS2×S2:

Ar=Qr(Kr)T(4)

鄰接矩陣Ar中的條目衡量兩個區域在語義上的相關性。接下來執行的核心步驟是通過為每個區域只保留前k個關系最密切的區域。Ir∈NS2×k為一個路由索引矩陣,具有逐行topk算子:

Ir=topkIndex(Ar)(5)

第i行Ir包含第i個區域的k個最相關區域的索引。

有了區域到區域路由索引矩陣Ir,在粗粒度過濾了最不相關的令牌,可以應用細粒度的令牌到令牌關注。對于區域i中的每個Q,它將關注以Ir(i,1),Ir(i,2),…,Ir(i,k)為索引的k個最關注的路由區域,并gather這k個區域中所有K和V。因此首先收集K、V張量:

Kg=gather(K,Ir), Vg=gather(V,Ir)(6)

式中Kg、Vg∈RS2×HWS2×C。將注意力應用于收集到的Kg,Vg:

O=Attention(Q,Kg,Vg)+LCE(V)(7)

引入了一個局部上下文增強項LCE(V)。函數LCE(V)使用深度卷積進行參數化。

3 實驗與分析

3.1 數據集介紹

數據集在南京某小區進行,采集周期覆蓋了春夏秋冬四個季節,以確保數據具有時間上的多樣性。此外,考慮到電梯的使用高峰期和非高峰期,在工作日和周末的不同時間段進行了采集,以確保獲得充分的數據集,反映出電梯內電動車出現的各種情況。然后,將收集到的圖片利用AUGMIX圖像增強,共得到9 000張高分辨率照片,部分數據集如圖5所示。

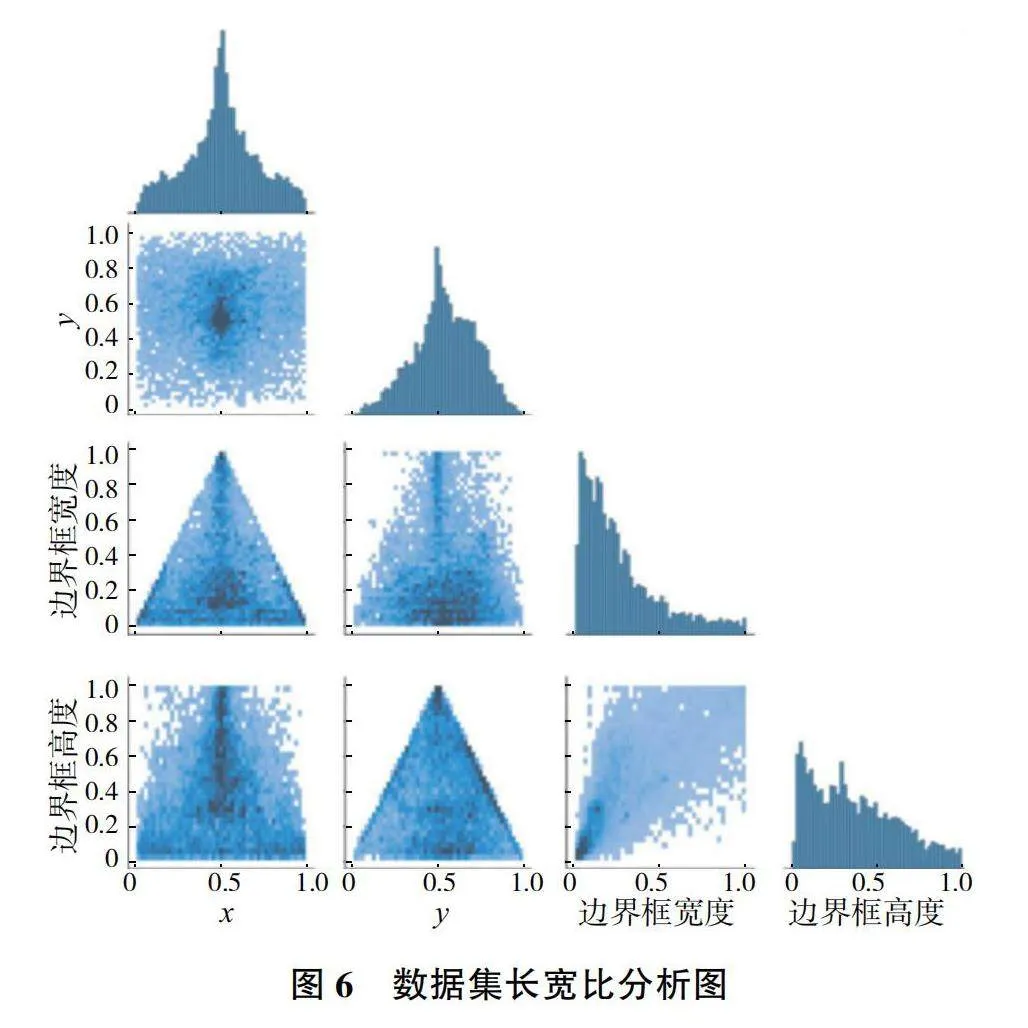

模型訓練期間,模型的迭代曲線和準確性評估將會通過數據可視化工具進行監控,確保訓練的有效進展。測試結果通過混淆矩陣和識別效果圖來展示,從而對模型在實際應用中的表現給予直觀的評價。圖6為本文的數據長寬比分析圖。

3.2 模型測試評估與分析

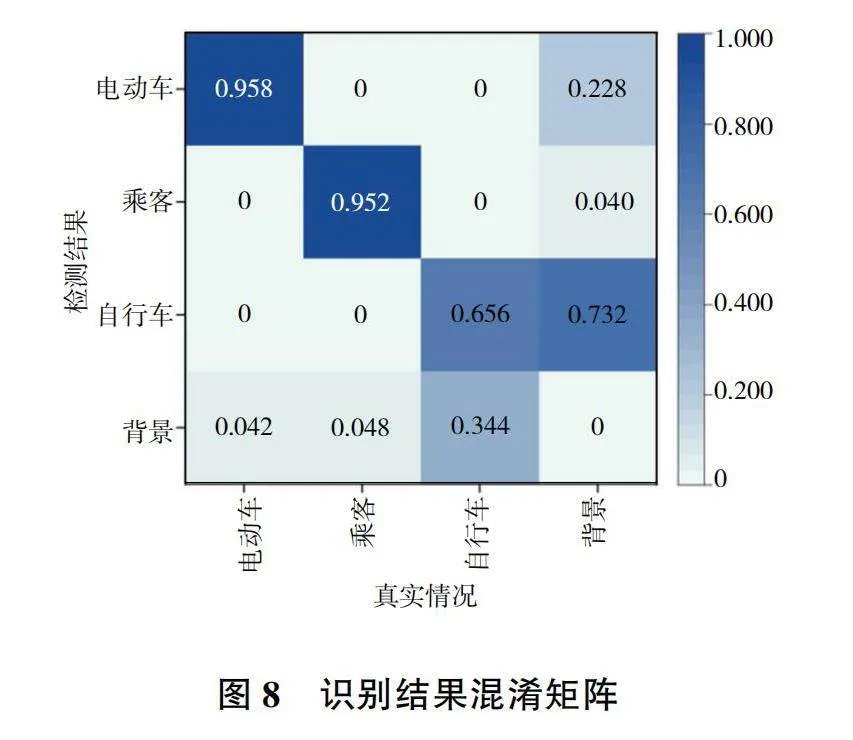

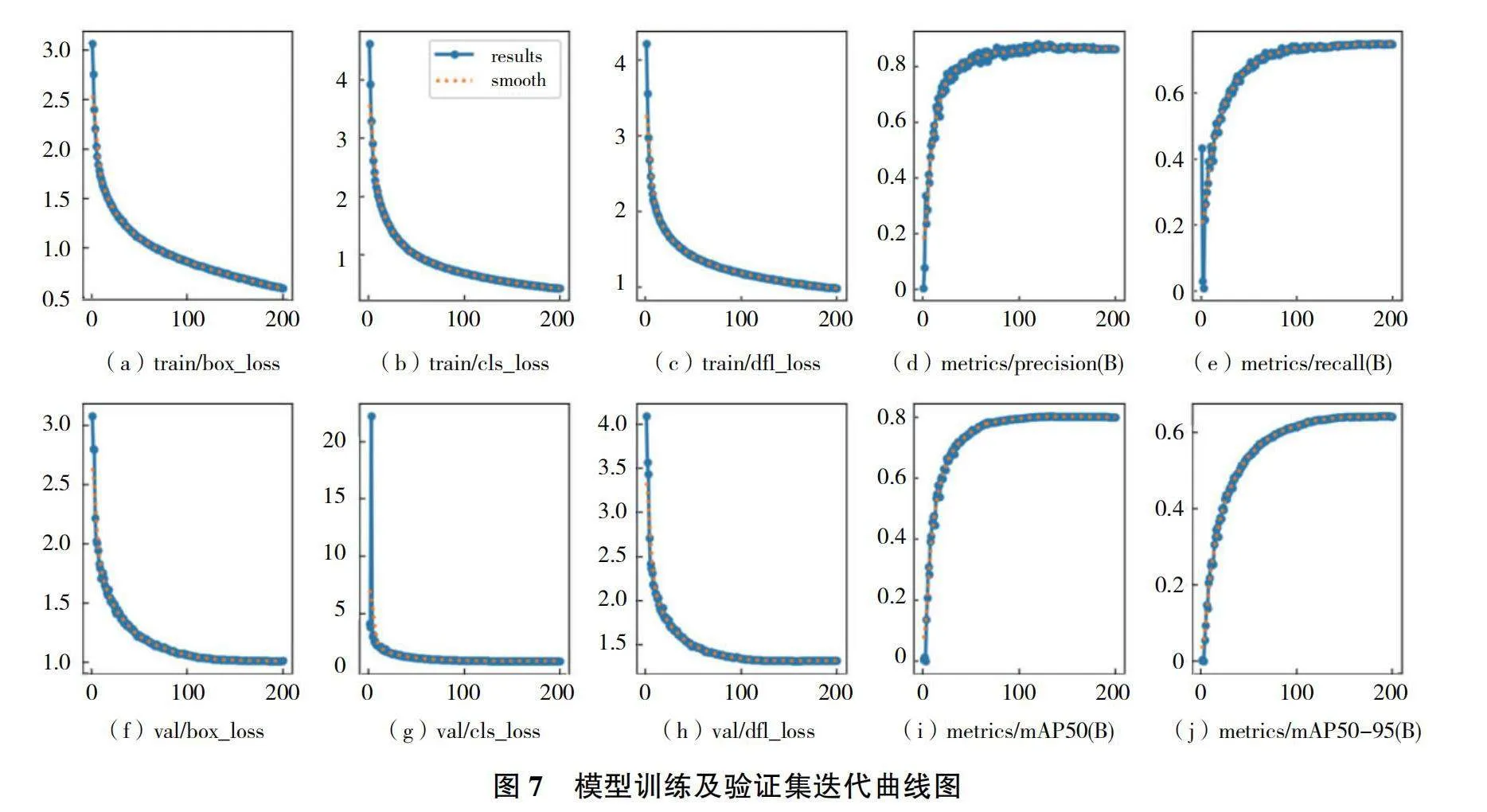

AUGMIX-YOLOv8-org為本文提出的將AUGMIX與改進的YOLOv8相結合的預測模型。利用改進后的算法模型對數據集進行測試,將數據集按8∶1∶1的比例分為訓練集、驗證集和測試集進行實驗。迭代次數200,初始學習率設置為0.001,優化器采用Adam,動量參數值為0.8,置信度閾值為0.5,模型的訓練結果及迭代曲線如圖7所示。實驗選取平均精度均值(mAP)、準確率(precision)、召回率(recall)及單項識別準確率作為評價指標,其照片中包括電動車、乘客、自行車,試驗測試結果混淆矩陣如圖8所示。

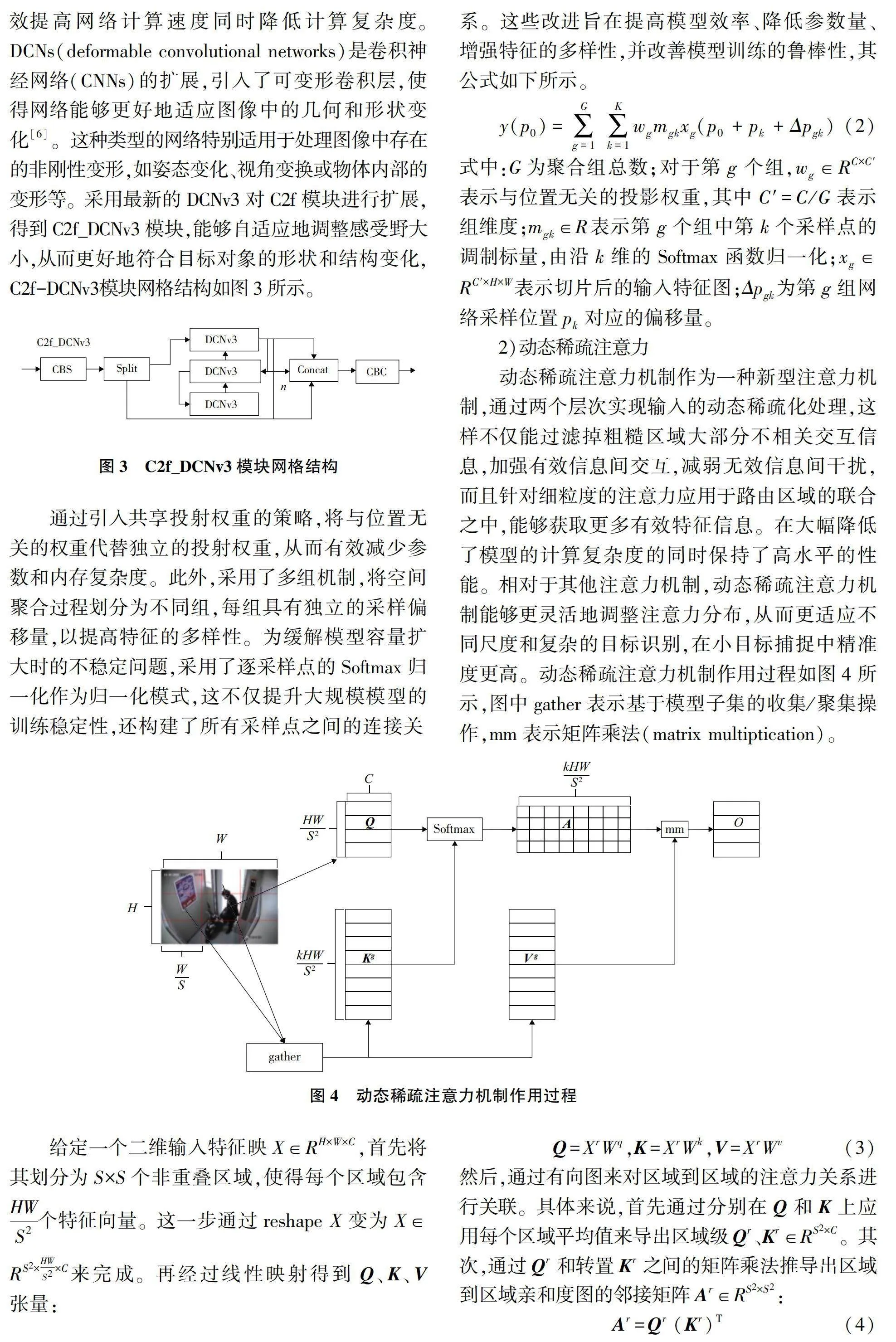

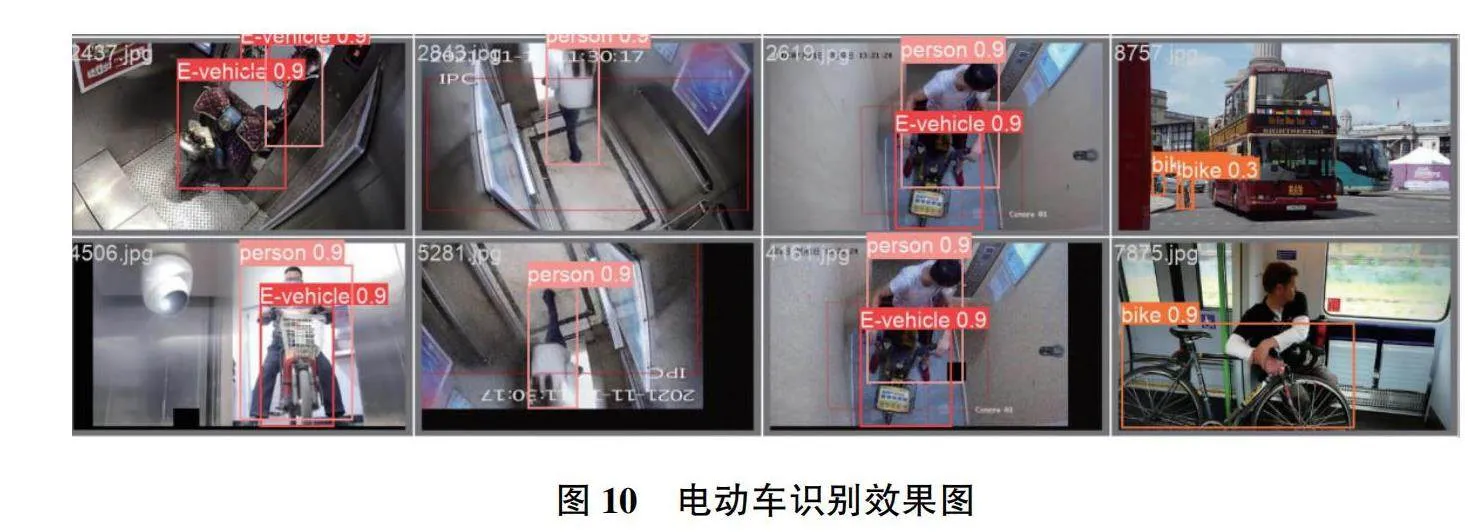

對電動車、乘客和自行車的電梯轎廂識別準確率進行對比,圖9為實驗各項評價指標對比圖。由圖9可知,AUGMIX-YOLOv8-org模型準確率達到了94.5%,召回率達到了93%,平均精度均值達到82.4%,相比原始的YOLOv8模型分別提升了2.5、5.0和2.3個百分點。在具體的識別任務中,電動車、乘客和自行車的識別準確率,AUGMIX-YOLOv8-org分別實現了95.8%、95.2%和65.6%的高水平,與原始YOLOv8模型的91.7%、91.2%和50.8%相比,有顯著的性能提升。這不僅凸顯了AUGMIX技術在提升模型對復雜場景下目標識別能力的有效性,也說明了AUGMIX-YOLOv8-org模型在實際應用中對于確保電梯安全運行的潛在價值。新算法模型識別結果如圖10所示。

4 結語

針對電梯內電動車識別存在精度不佳的問題,基于YOLOv8算法模型提出改進方案。數據預處理階段,利用AUGMIX圖像增強方法引入多樣化的圖像變換,提高了模型的泛化性能,減少了過擬合的風險,為模型的魯棒性訓練提供了有力支持。其次,通過將可變性卷積網絡算子(DCNv3)和動態稀疏注意力融入YOLOv8模型,進一步提升了識別性能。改進后算法模型的精確率、召回率和平均精度均值分別達到了94.5%、93%和82.4%,電動車識別準確率達到了95.8%,為電梯內電動車智能識別提供了理論基礎。算法模型仍有改進空間,未來將考慮在保證精度的前提下,輕量化算法模型,提高識別速度和泛化能力,使算法模型更好地勝任電梯內電動車識別任務。

參考文獻:

[1] 周永強,王萬軍,楊浩,等. 基于圖像識別與信息融合的電梯智能阻車系統研究[J]. 機電工程技術,2023,52(9):141-144.

[2] 李信芳,李艷. 淺析電梯智能阻車系統的加裝屬性[J]. 中國特種設備安全,2022,38(9):46-48,57.

[3] 馬子喻. 基于神經網絡與證據理論的電動車進入轎廂識別研究[D]. 鄭州:鄭州大學,2021.

[4] 王佳寧. 面向自動駕駛的圖像與點云融合及實時性研究[D]. 哈爾濱:哈爾濱工業大學,2021.

[5] 于飛,徐斌,王榮浩,等. 基于改進YOLOv8的旋轉鏈板檢測算法[J]. 制造業自動化,2023,45(9):212-216,220.

[6] 劉奇,趙麗霞,鄭曙光,等. 基于DYOLO神經網絡的超聲圖像腎臟檢測[J]. 計算機工程,2021,47(7):307-313.

收稿日期:2024-02-26