基于車載攝像機移動機器人的模糊神經網絡跟蹤

彭 飛, 王朝立

(上海理工大學光電信息與計算機工程學院,上海 200093)

基于車載攝像機移動機器人的模糊神經網絡跟蹤

彭 飛, 王朝立

(上海理工大學光電信息與計算機工程學院,上海 200093)

針對車載單目攝像機的輪式移動機器人的目標跟蹤問題,提出一種模糊跟蹤控制方案.方案分為兩部分,分別為攝像機控制部分和輪式移動機器人控制部分.攝像機控制部分通過相關特征點之間的連線的夾角設計攝像機云臺控制器,使攝像機能夠實時跟蹤目標,保持目標在圖像平面的期望位置上.輪式移動機器人控制部分通過設計T-S模糊神經網絡控制器使其能夠在視覺伺服反饋下實時調整速度和姿態,實現目標的有效跟蹤.仿真結果表明了本文方法的有效性.

攝像機;輪式移動機器人;模糊神經網絡;跟蹤

近年來,輪式移動機器人(WMR)由于具備良好的機動性、靈活性、可操作性,且能深入到許多人類所不能到達的區域,已經被廣泛應用于工業、農業、醫療、軍事、航天、星際探索等各個領域[1-2].隨著需求量的增加以及需求領域的擴大,對WMR的可靠性、智能程度等方面提出了更高的要求.在計算機視覺技術不斷取得進步的背景下,給WMR安裝攝像機,賦予其類似于人類的視覺功能,其安裝方法主要有兩種:第一種方法是在車體外某個高度安裝固定的攝像機,車體移動而攝像機保持固定,這種方法的局限性在于WMR的可視空間是有限的,但優點是圖像信息相對穩定;第二種方法是在WMR車體上安裝攝像機,攝像機隨車體的移動而移動.第二種方法又分為兩個方向,即攝像機不具有自由度和攝像機具有自由度.不具有自由度的攝像機和WMR保持為一個整體,移動的過程中隨車體的移動而移動;具有自由度的攝像機在隨車體發生移動的過程中能夠產生相對于車體的運動,通過水平和垂直方向的擺動發生姿態的變化.車載攝像機保證了WMR的視覺范圍,極大地擴展了其活動的范圍和空間.基于視覺伺服的控制是WMR發展的主要方向,并且相關的研究已經取得了許多成果.文獻[3]針對在車體上安裝不具有自由度的攝像機的WMR模型,提出了一種基于圖像特征點的控制方法,通過提取環境中特征點進行匹配、識別,使WMR進行有效的追蹤,但不具有自由度的攝像機會影響WMR整體的機動性和靈活性,且存在視覺死角問題.文獻[4]采用了一種多結構體復合控制方案,根據環境信息的變化在不同結構體之間自動切換,保證了WMR的良好性能.這種控制方案使WMR在復雜環境下具備較強的適應能力,但其結構相對比較復雜.文獻[5]對載有具備自由度的攝像機的WMR模型設計一種基于Backstepping的控制律,使WMR能夠可靠到達期望的位姿,但此控制律包含人為預先給定參數,系統性能隨參數的不同而有所差異,對參數設定人員的經驗和水平有所依賴,且在運行過程中不能根據環境信息進行實時動態調節,系統始終保持良好的性能有困難.

針對以上問題,本文對載有攝像機的WMR提出一種控制方案,對攝像機和車體分別進行控制器的設計.攝像機云臺具有兩個自由度,能跟隨目標的變化產生水平和垂直方向的偏角,使攝像機能夠實時根據目標方位變化作出相應的變化,有效地跟蹤目標,在保證良好機動性的同時也能夠克服視覺死角問題.對于WMR的姿態跟蹤控制,采用基于TS模糊神經網絡的控制器,以攝像機獲得的視覺信息作為輸入,運行中根據信息的變化對控制器結構參數實現實時動態調整,保證WMR對目標的有效追蹤,使系統始終具備良好的穩定性和魯棒性.此方案將具有自由度的攝像機和WMR結合為仿生的獨立系統,在WMR的視場下獲取目標的位置,使目標和系統之間的相對位置更加明了,跟蹤任務更加明確,減小了對環境的依賴.

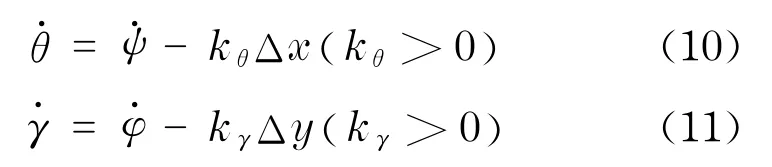

1 攝像機控制

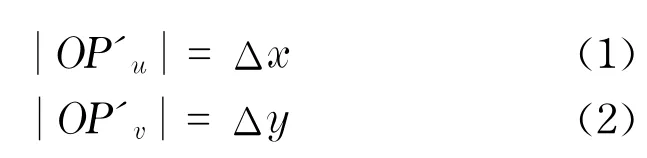

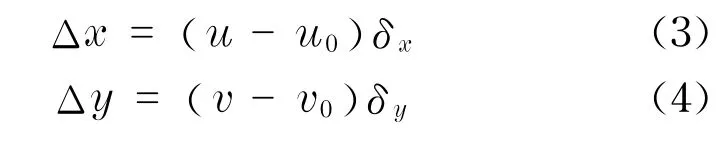

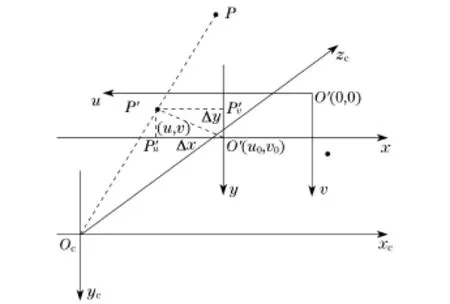

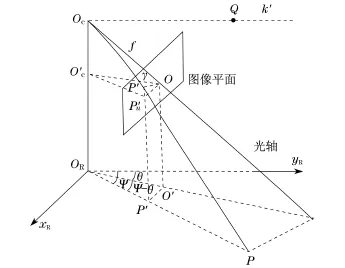

如圖1所示,圖中(x-O-y)為物理尺寸圖像平面坐標系,像素點的水平方向和垂直方向的物理尺寸分別為δx,δy,(u-O′-v)為像素圖像平面坐標系,圖像平面坐標系原點在像素圖像平面坐標系下的坐標為(u0,v0),設此點為攝像機跟蹤的期望位置點.(xc-Oc-yc)為攝像機坐標系,攝像機光軸zc經過圖像平面中心點且垂直該平面,即(u0,v0)為圖像平面的中心點.追蹤目標的中心點P在圖像平面的投影為P′點,P′經過圖像處理之后在像素圖像平面坐標系下的坐標為(u,v),P′點在圖像平面坐標系的坐標軸上的投影分別為和,到O點的距離為Δx,到O點的距離為Δy,即

由幾何運算,得

目前很多方法就是在環境參照下對WMR和目標分別進行定位,這些方法中車體和目標之間的定位對環境有所依賴,因此對WMR的活動空間造成了約束.本文建立WMR坐標系,在此坐標系下進行目標位置的分析和跟蹤,從而使車體和目標之間的定位擺脫環境參照的約束,得到任何時刻目標相對于WMR的準確位置,便于機器人進行及時有效的跟蹤,從而使WMR的應用范圍得到較大的拓展.具體就是在跟蹤過程中WMR坐標系綁定在車體上,隨車體的運動而運動,同時通過攝像機獲得目標在WMR坐標系下的位置,建立目標相對于WMR的系統誤差,這樣WMR和目標構成一獨立跟蹤系統,能夠應用于不同的環境.

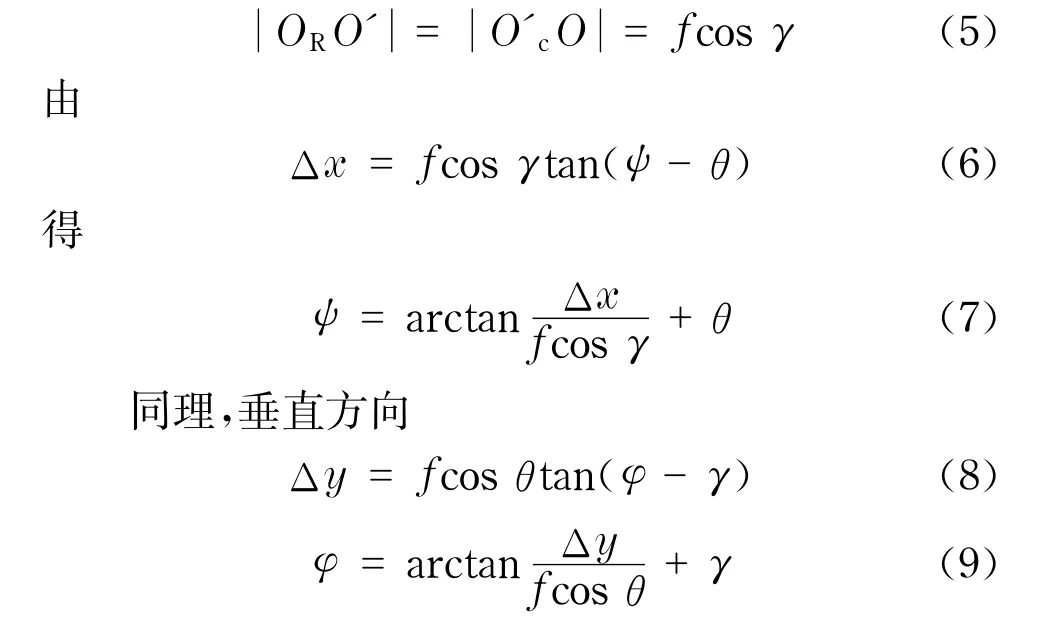

建立以車體底面中心為原點OR,車體正前方為yR(車體行進的方向),水平方向為xR的WMR坐標系(xR-OR-yR).本模型中攝像機光心、WMR幾何中心和OR處于同一鉛垂線上.設攝像機光軸方向與車體正前方在水平方向上的偏角為θ,在垂直方向上的偏角為γ,這兩個角即為攝像機云臺的水平偏角和垂直偏角,通過驅動兩個獨立電機來實現.為了便于分析,取過Oc點且平行yR的射線為k′,且在k′上任取一點Q以便于角度表示.在OcOR之間取一輔助點O′c,使得|Oc′OR|=|OO′|.立體圖如圖2所示.

圖1 圖像平面圖Fig.1 Image plane

圖2 立體分析圖Fig.2 Analysis of the stereo diagram

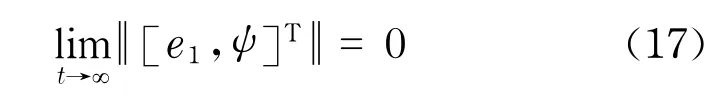

在圖2中,∠POcQ在水平面(xR-OR-yR)上的投影為ψ,在垂直面(Oc-OR-yR)上的投影為φ.∠OOcQ在水平面(xR-OR-yR)上的投影即為云臺的水平方向上的偏角θ,在垂直面(Oc-OR-yR)上的投影即為云臺的垂直方向上的偏角γ(為了讓圖形清晰明了,φ和γ在圖中未畫出).f為攝像機焦距,圖像平面中的O和點在(xR-OR-yR)平面上的投影分別為O′和P″,有以下幾何關系:.經過分析,垂直于平面OOcOc′,因此均為直角.

在Rt△ORO′P″中

文獻[6]中給出了一種ψ和φ的分析方法,本文和其不同之處在于本文是在WMR的坐標系下進行目標和車體之間位置分析,是在一個坐標系系統內部直接得出目標的位置關系,從而分析出云臺控制所需角度關系.而文獻[6]是在借助外界參照坐標系下首先得出目標和車體各自在此坐標系下的位置和姿態,然后進行兩者之間的參數比對,即通過間接方法得出兩者之間的相對位置誤差,再分析出云臺控制所需角度關系.相同之處在于通過分析均得出ψ和φ的表達式關系,因此其控制器在本文可以適用.且文獻[6]中對此控制器進行了實驗,實驗效果很好地說明了此控制器的有效性,故本文攝像機云臺控制器采用文獻[6]控制器.

2 輪式移動機器人控制

2.1 問題描述

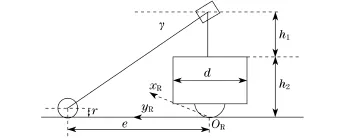

如圖3(見下頁),r為球體目標的半徑,e為目標中心到WMR中心的距離,d為車體前后長度,h1和h2分別為攝像機支架和WMR車體高度.

令

求得車體到目標點距離

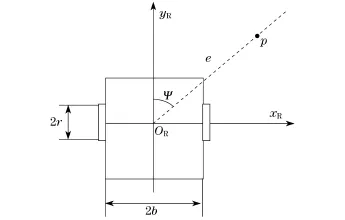

在跟蹤過程中,綁定在WMR上的坐標系(xROR-yR)隨車體的移動而移動,通過e和角ψ可以在跟蹤過程中得到目標在WMR坐標系下的任一時刻的距離和偏角,也就是任何時刻目標相對于WMR的準確位置,便于機器人進行及時有效的跟蹤.如圖4所示.

圖3 模型分析圖Fig.3 Analysis of the model

圖4 WMR坐標系圖Fig.4 WMR coordinate system

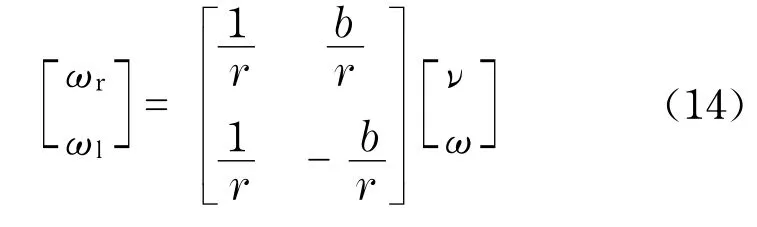

因此,根據攝像機獲取的e和ψ信息,設計控制器,輸出WMR的線速度ν和角速度ω,再經過驅動輪與WMR的線速度和角速度之間的轉換關系得到兩輪的角速度[1]為

式中,ωl和ωr分別為WMR的左輪和右輪的角速度;r為車輪的半徑;2b為車體寬度.在左輪和右輪的角速度的驅動下車體對目標進行跟蹤,使得

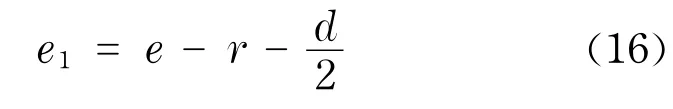

因在跟蹤過程中,OR點和目標中心不可能重合,令

即得

2.2 基于T-S模糊神經網絡的控制器

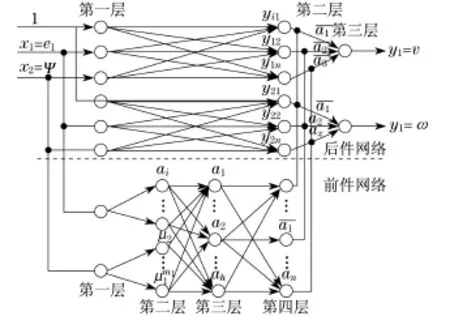

模糊神經網絡起源于20世紀80年代后期的日本[7],其將模糊控制和神經網絡控制有效結合,在許多領域得到廣泛的研究及應用[8-9].T-S模糊神經網絡模型由Takagi-Sugeno首先提出[10].該模型主要分為前件網絡和后件網絡兩大部分,前件網絡主要功能為匹配模糊規則的前件,后件網絡的主要功能為產生模糊規則的后件.

在WMR的跟蹤問題中,智能控制方法應用比較普遍,比如模糊控制.模糊控制存在的問題就是模糊規則數目比較多,從而造成控制器復雜、應變時間長、反應遲鈍,且控制器內部的某些設定的常數對系統影響比較大.T-S模型將模糊控制與神經網絡控制相結合,用線性局域方程代替了結論部分所取的常數,因此可以用少量的模糊規則就能生成相對較復雜的非線性函數,能夠對多變量系統的模糊規則的個數進行有效地減少.T-S網絡最顯著的特征就是對模型的依賴性小,自主學習能力強,魯棒性能好.因此,針對本文的WMR跟蹤問題,設計基于T -S模糊神經網絡的控制器.

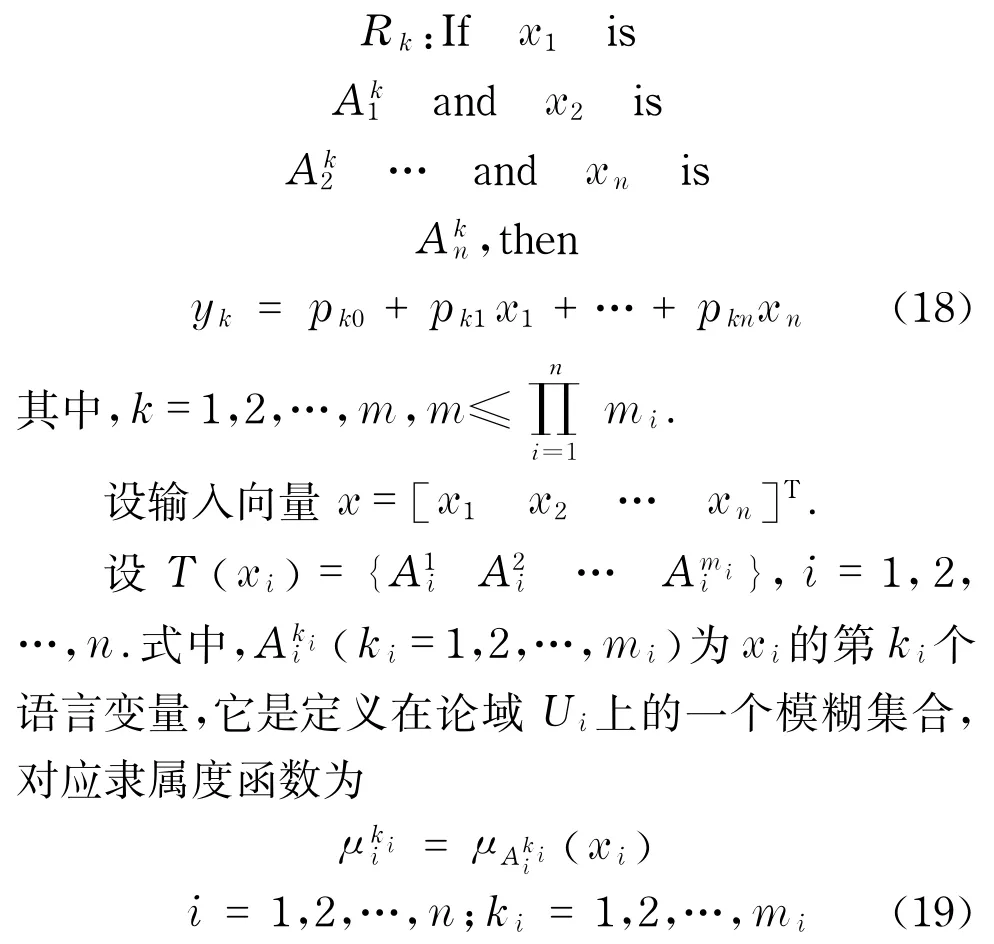

T-S模糊控制規則表示為[11]

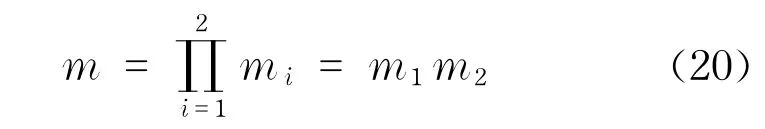

在本文中,根據控制需要,將控制器輸入變量設為兩個,n=2,即x1=e1,x2=ψ.根據經驗,當變量e1和ψ的語言變量均設為7個左右時,對變量的描述比較準確又不過于繁瑣.為不失一般性,本文先設變量e1語言變量個數為m1,變量ψ語言變量個數為m2,在此條件下設計控制器,然后在后面仿真部分根據實際情況選擇合適的語言變量個數.因此共有規則條數

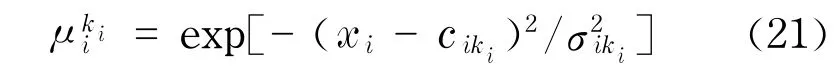

控制器輸入變量采用高斯函數表示的鈴形函數對輸入變量進行劃分,即

式中,i=1,2;ki=1,2,…,mi;ciki,σiki分別為高斯函數的中心和寬度.

因此,本文基于T-S模糊神經網絡的控制器結構圖如圖5所示.

圖5 控制器結構圖Fig.5 Controller structure

控制器主要分為前件網絡和后件網絡兩大部分,前件網絡共有四層.第一層為輸入層,有2個節點,分別對應輸入e1和ψ,即WMR和目標之間的距離和偏角.第二層為網絡的模糊化層,有m1+m2個節點,分別對應各個語言變量值.第三層為網絡的模糊推理層,有m個節點,分別對應每條模糊規則.第四層為網絡的歸一化層,有m個節點,其功能是對結果進行歸一化處理.后件網絡由2個結構相同的并列子網絡組成.每個子網絡均有三層,第一層為網絡的輸入層,共有3個節點,第一個節點給定值為1,以提供模糊規則后件中的常數,后兩個節點分別對應輸入e1和ψ.第二層有m個節點,分別對應m條規則,用來計算每條規則的后件.第三層為網絡的輸出層,每個子網絡有1個輸出節點,因此兩個子網絡產生兩個輸出節點,分別對應控制器的兩個輸出y1和y2.本文將第一個輸出y1設為移動小車的線速度ν,即y1=ν,將第二個輸出y2設為移動小車的角速度ω,即y2=ω.

其中,前件網絡第三層用來對每條規則的適用度進行計算的表達式為

第四層對結果進行歸一化處理的表達式為

誤差函數取為

式中,yd1,yd2為理論計算輸出;y1,y2為實際輸出.

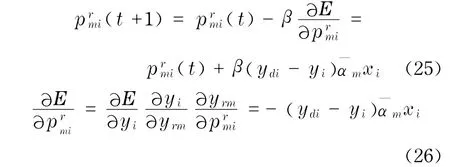

控制器中,變量e1和ψ的模糊分割前面已經確定,需要學習的參數為后件網絡的連接權(i= 0,1,2;r=1,2)和前件網絡隸屬度函數的,.文獻[12]所述算法最大特點是簡潔、計算量少,因此能夠很快地進行學習并進行參數調整,同時可以避免陷入不希望的局部極值從而提高收斂速度[12],本文采用這種學習算法.

式中,i=1,2;學習率β>0. ciki,σiki的學習算法

式中,i=0,1,2;r=1,2.

3 仿真實驗

根據上述結構的模糊神經網絡控制器,分別設定不同的語言變量個數進行仿真,并通過仿真效果分析得出最佳的訓練步驟.

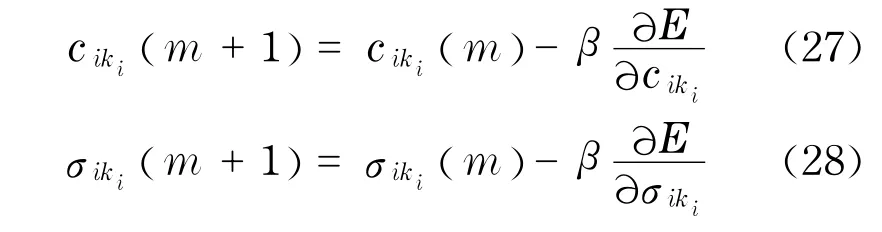

給定曲線為

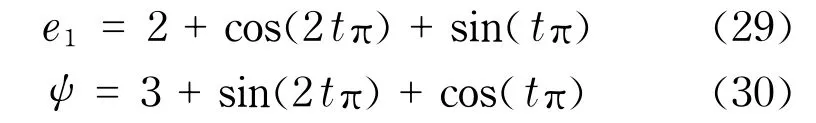

訓練之前并不知道多少步比較合適,故首先任意給定訓練步數,再根據訓練情況取一個比較合適的訓練數值,所以網絡訓練步驟初步設定為200.分別設定語言變量個數m1和m2為:6,7,8,9,10和11個,不同語言變量個數的跟蹤誤差曲線如圖6所示(見下頁).

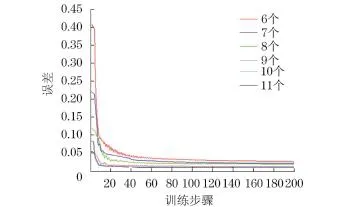

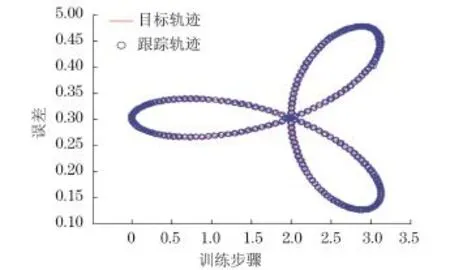

根據仿真誤差曲線圖6可以看出,當語言變量個數為6時,初始響應跟蹤誤差最大,達到0.4,且跟蹤過程中收斂時間比較長且振蕩次數比較多,訓練到160步左右時,不再收斂且誤差比較大.隨著語言變量的不斷增多,當語言變量個數達到10個時,初始響應速度比較快,且初始誤差在0.05以內,隨著訓練步驟的增加誤差收斂過程比較快且平穩,網絡的訓練步驟達到60步左右時,跟蹤誤差已經非常小且已經穩定,再增加訓練步驟已經沒有實際意義且影響系統響應時間,因此實際訓練步驟選為60即可.如果將語言變量個數增加為11個,由圖6可以明顯看出,系統的初始跟蹤誤差又開始增加.因此,根據對比分析,語言變量個數選為10個最恰當,訓練步驟選為60即可.在此條件下,曲線的跟蹤效果如圖7所示.

圖6 跟蹤誤差曲線圖Fig.6 Tracking error curve

圖7 跟蹤曲線圖Fig.7 Tracking curve

4 結論

本文對裝載了具有兩個自由度的攝像機的WMR提出一種控制方案,分別設計了攝像機云臺控制器和基于T-S模糊神經網絡的控制器,使WMR能夠根據攝像機實時采集的圖像信息控制攝像機云臺和WMR車體進行有效的跟蹤,仿真結果表明了該控制器良好的性能.車載的帶有自由度的攝像機能夠極大地擴展WMR的活動空間,增強其機動靈活性;T-S模糊神經網絡的控制器能夠根據環境信息進行自我學習和調整,克服系統性能對人為設定的某些參數的依賴性,增強了對環境的適應能力,具有很強的魯棒性;在WMR的視場下進行定位和跟蹤,使目標的相對位置更加明了,跟蹤效果更好.

[1] 李艷東,王宗義,朱玲,等.非完整移動機器人的神經網絡魯棒自適應控制[J].計算機工程與應用,2010,46(2):211-241.

[2] 廖勤武,王朝立,梅迎春.基于超聲的非完整移動機器人避障控制[J].上海理工大學學報,2009,31(4):402 -405.

[3] Adrian B,Obada M,Vladimir T.An image based visual servoing scheme for wheeled mobile robots[C]∥2011 15th International Conference on System Theory,Control,and Computing,2011:1-5.

[4] Wang Y,Lang H X,Clarence W S.A hybrid visual sereo controller for robust grasping by wheeled mobile robots[J].Transactions on Mechatronics,2010,15(5):757-769.

[5] Wang Z L,Liu H Y.Visual regulation of a nonholonomic wheeled mobile robot with two points using lyapunov functions[C]//IEEE International Conference on Mechatronics and Automation.Xi’an:IEEE,2004:1603-1608.

[6] Francesco C,Luigi F,Marco M,et al.Visual servoing of a wheeled mobile robot for intercepting a moving object[C]∥2005 IEEE/RSJ International Conference on/Intelligent Robots and Systems,2005:2737 -2743.

[7] 伍世虞,徐軍.動態模糊神經網絡——設計與應用[M].北京:清華大學出版社,2008.

[8] 唐柱,丁學明,劉燦.基于引力搜索和粒子群混合優化算法的T-S模型辨識[J].上海理工大學學報,2013,35(4):351-354.

[9] 黃炳強,曹廣益.基于模糊人工勢場的移動機器人路徑規劃[J].上海理工大學學報,2006,28(4):347-350.

[10] 王士同.神經模糊系統及其應用[M].北京:北京航空航天大學出版社,1998.

[11] 張乃堯,閻平凡.神經網絡與模糊控制[M].北京:清華大學出版社,1998.

[12] 孫增圻,徐紅兵.基于T-S模型的模糊神經網絡[J].清華大學學報,1997,3(37):76-80.

(編輯:董 偉)

Camera Based Fuzzy Neural Networ k Tracking for Wheeled Mobile Robots

PENGFei, WANGChao-li

(School of Optical-Electrical and Computer Engineering,University of Shanghai for Science and Technology,Shanghai 200093,China)

Aiming at tracking targets by wheeled mobile robots(WMR)with cameras,a fuzzy neural network control scheme was presented.The scheme includes two parts:one is to control the camera and the other is to control the wheeled mobile robots.In the camera control part,a Pan-Tilt controller was designed by using some angles between related lines connecting feature points so that the feature points on the camera image plane can track the target feature points timely and keep them in the desired positions on the image plane.For the tracking control of the wheeled mobile robots,a tracking controller was proposed by using the T-S fuzzy neural network.The configuration and speed of wheeled mobile robots can be adjusted from by virtue of visual servoing feedback to implement an effective target tracking.The simulation results illustrate the effectiveness of the scheme propvided.

camera;wheeled mobile robots;fuzzy neural network;track

TP 242.6

A

2013-11-11

國家自然科學基金資助項目(61374040);上海市教委科技創新項目(13ZZ115);上海市研究生創新項目(54-13 -302-102)

彭 飛(1983-),男,碩士研究生.研究方向:智能控制、伺服控制、機器人控制.E-mail:robestp@sina.com

王朝立(1965-),男,教授.研究方向:非線性控制、魯棒控制、智能控制、機器人控制、視覺伺服控制.E-mail:clclwang@126.com

1007-6735(2014)04-0385-06

10.13255/j.cnki.jusst.2014.04.016