基于深度學習的茶葉狀態智能識別方法

王 琨,劉大茂

(1.福州大學 陽光學院 電子信息工程系, 福州 350015;2.福州大學 物理與信息工程學院, 福州 350108)

基于深度學習的茶葉狀態智能識別方法

王 琨1,劉大茂2

(1.福州大學 陽光學院 電子信息工程系, 福州 350015;2.福州大學 物理與信息工程學院, 福州 350108)

目前對茶葉狀態的識別主要依賴人工完成,規模化、產業化生產制造較為困難。作為機器學習的一個新興方向,深度學習以其準確性和高效性得到廣泛關注。將深度學習中的卷積神經網絡算法應用于茶葉狀態識別中,根據實際的應用場合對經典的卷積神經網絡算法進一步優化,利用提取到的茶葉圖像集訓練網絡,最終使網絡能夠正確識別茶葉狀態。實驗結果表明:該算法能夠對茶葉狀態的判別標志——茶葉嫩芽進行有效的3D識別,且對于不同的影響因素具有一定的魯棒性。

深度學習;卷積神經網絡;圖像分割;特征提取;3D識別

茶葉采摘方法與其他作物不同,其葉面展開的程度決定了茶葉質量的好壞。長期以來,農作物性狀的測定一直是農技專家、管理人員迫切希望解決的難題。目前,茶葉的狀態參量——嫩芽特征,主要靠人工觀察獲取,其考查速度慢,工作強度大,結果誤差大,使茶樹因苗、因時、因地的科學化管理和智能化栽培技術的推行受到限制。

隨著信息技術與計算機技術的不斷發展,一種基于深度學習的圖像識別技術應運而生,為處理這一難題提供了有效的思路。由Hinton等于2006年提出的深度學習作為機器學習研究中的一個新范疇,其目的在于建立分析學習的神經網絡,模仿人腦機制來解釋數據。深度學習的本質是構建含有多隱層的機器學習模型,利用大量數據進行訓練,得到豐富的更具代表性的特征信息,從而對樣本進行分類和預測,提高分類和預測的精度[1]。深度學習在信號處理中的應用對象主要包括語音[2-3]、圖像、 視頻及文本等。運用深度學習模型不僅能大幅提高識別的精度,同時也能縮短人工特征提取工作耗費的時間,使在線運算效率極大提高。

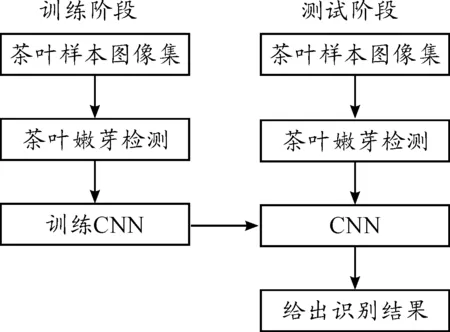

實踐表明:茶葉采摘的時間、位置等都決定了茶葉品質的好壞和茶樹后期的質量。而以往通過經驗或者人工局部的觀察實現采摘易延誤工期。近年來,隨著信息技術的不斷發展,一些新技術在農業領域的應用越來越深入。文獻[4]采用改進的蟻群算法實現了茶葉種植土壤的優化分析;文獻[5]采用BP人工神經網絡算法構建小麥圖像群體特征識別自學習體系,其識別準確率較高;文獻[6]使用顏色識別和區域生長的思路,對茶葉圖像進行分割,能將拍攝角度不同的茶葉嫩芽從茶葉中分離出來,茶葉嫩芽輪廓信息完整。但以上文獻均未涉及茶葉形態的智能識別問題。因此,本文在深入研究深度學習相關算法的基礎上,提出了一種基于深度學習的茶葉形態識別方法。該方法首先通過顏色、區域生長以及形狀等手段有效提取茶葉圖像中的嫩芽,利用基于卷積神經網絡的深度學習方法學習大量茶葉嫩芽的實際樣本,最終達到對茶葉形態及姿態的3D智能識別的目的。識別算法的主要流程如圖1所示。最后,通過實驗表明:本文算法在茶葉嫩芽識別方面實時性較好,識別率較高。同時,針對影響嫩芽識別的不同因素進行分類實驗,給出了不同條件下的茶葉嫩芽識別率。結果表明:本文算法的魯棒性較強,能夠滿足農業生產的需求。

圖1 算法基本流程

1 基于顏色和形狀的茶葉嫩芽檢測

茶葉嫩芽的性狀特征和成熟程度決定了鮮葉的采摘時間,而鮮葉的采摘時間又對成茶的品質有著重要的影響。目前,茶葉的采收依據主要由其嫩芽的生長情況即嫩芽開采面決定,實際中常用的規范有未開面、小開面、中開面、大開面4種情況,大批量、多層次地及時分析辨別出茶葉嫩芽的生長狀態是茶葉智能化生產的根本。

1.1 基于顏色和區域生長的茶葉嫩芽圖像分割

對自然場景中釆集的圖像進行分割是茶葉嫩芽檢測的重要步驟,采用顏色特征和區域特征作為主要參量,將茶葉圖像中的多個嫩芽分割出來。主要過程分為以下步驟:

步驟1 將圖像的RGB顏色模型轉換為HSI顏色模型。RGB顏色模型中的顏色值由三基色所占的相對比例來確定,其優點是處理時不需要進行顏色模型的轉換,適合做實時性處理;而缺點是三基色之間相關性較大,易受外界光線影響,不適合直接進行圖像的分割和分析。HSI顏色模型由色調、飽和度和亮度3個顏色分量組成,3個分量相互獨立,所以可直接進行相關運算,減小了處理和分析的工作量。因此,采用HSI顏色模型進行圖像分割效果較好。

步驟2 區域選取、生長及合并。區域選取的基礎是選取合適的種子區域。其具體原則是:1)量化后的顏色值相同;2)4鄰域連通且像素面積達到一定值。種子區域的具體選取方法見文獻[6]。區域生長是將種子區域周邊與其性質相似的區域加入其中。在茶葉圖像中兩個顏色相近、空間相鄰且鄰域沒有明顯邊界的區域稱為可相連的區域。其顏色距離如公式(1)所示:

(1)

(2)

其中:Pij表示區域邊緣上的像素個數;xm和xn分別表示邊緣兩側的m和n點的位置值。

1.2 基于顏色和形狀的茶葉嫩芽圖像檢測

在實際的茶葉采摘檢測中,發現嫩芽顏色及形狀與其他葉子不同。因此,采用這2項指標作為茶葉嫩芽提取的依據。主要步驟是:① 選取HSI顏色模型中與顏色相關的色調和飽和度分量作為特征參數,根據嫩芽實際顏色選擇相關區域;② 茶葉嫩芽外形與其他葉片有差異。描述形狀的特征有很多,通過實驗,發現嫩芽的面積、中軸長度、平均寬度和彎曲度系數可用來較好地檢測出嫩芽,具體過程見文獻[8]。

2 深度學習模型

深度學習的概念起源于人工神經網絡,由人工神經網絡中含多隱層的多層感知器發展而來。深度學習將低層特征進行組合,以發現數據的分布式特征表示,形成更加抽象的高層表示屬性類別[9]。深度學習方法分為有監督學習方法和無監督學習方法兩類,在此方法下構建了不同的學習模型。典型的深度學習模型有卷積神經網絡(convolutional neural network,CNN)、深度置信網絡( deep belief network,DBN )和堆棧自編碼網絡(stacked auto-encoder network,SAN )等。卷積神經網絡是一種在監督體制下進行的深度學習,其網絡結構與實際的生物神經網絡非常相近,一些實驗證明其在語音識別和視覺圖像識別方面獨具優勢,因此本文采用CNN來建模。

2.1 CNN的基本思想

卷積神經網絡(CNN) 由貓視覺皮層的研究發展而來,是一種多層的監督學習神經網絡。隱含層的卷積層和子釆樣層是實現卷積神經網絡特征提取功能的核心模塊,采用誤差梯度設計并訓練卷積神經網絡,通過頻繁的迭代訓練提高網絡的精度[10]。CNN有3個核心架構:局部區域感知、權重共享和子采樣。

1) 局部區域感知

在卷積神經網絡中,將輸入圖像劃分成局部區域(即局部接受域),從局部接受域中提取圖像的初級視覺特征,如物體的特殊點、邊界和轉角等,后續各層通過組合這些初級特征得到更高層的特征。兩層之間采用局部連接方式,即利用層間局部空間相關性將相鄰每一層的神經元節點只與和它相近的上層神經元節點連接,從而極大地降低了神經網絡架構的參數規模。

2) 權重共享

在卷積神經網絡中,卷積層的每一個卷積濾波器重復地作用于整個感受野中,對輸入圖像進行卷積。卷積結果構成了輸入圖像的特征圖,以達到進一步提取圖像局部特征的目的。由于每個卷積濾波器共享相同的權重矩陣和偏置項,這使得輸出的特征圖和輸入圖像的平移變化相同。由于需要訓練的權重參數數目通過權重共享大幅減少,因此對訓練樣本的需求也極大降低。

3) 子采樣

在獲取圖像的卷積特征后,要通過子采樣方法對卷積特征進行降維。將卷積特征劃分為n×n個不相交區域,用這些區域的最大(或平均)特征來表示降維后的卷積特征。這些降維后的特征更容易分類。子采樣有2個優點:① 減小了計算復雜度;② 采樣單元具有平移不變性,即使圖像有小的位移,提取到的特征依然保持不變。子采樣因其對位移的魯棒性成為一種高效的降低數據維度的采樣方法。

2.2 CNN的整體網絡結構

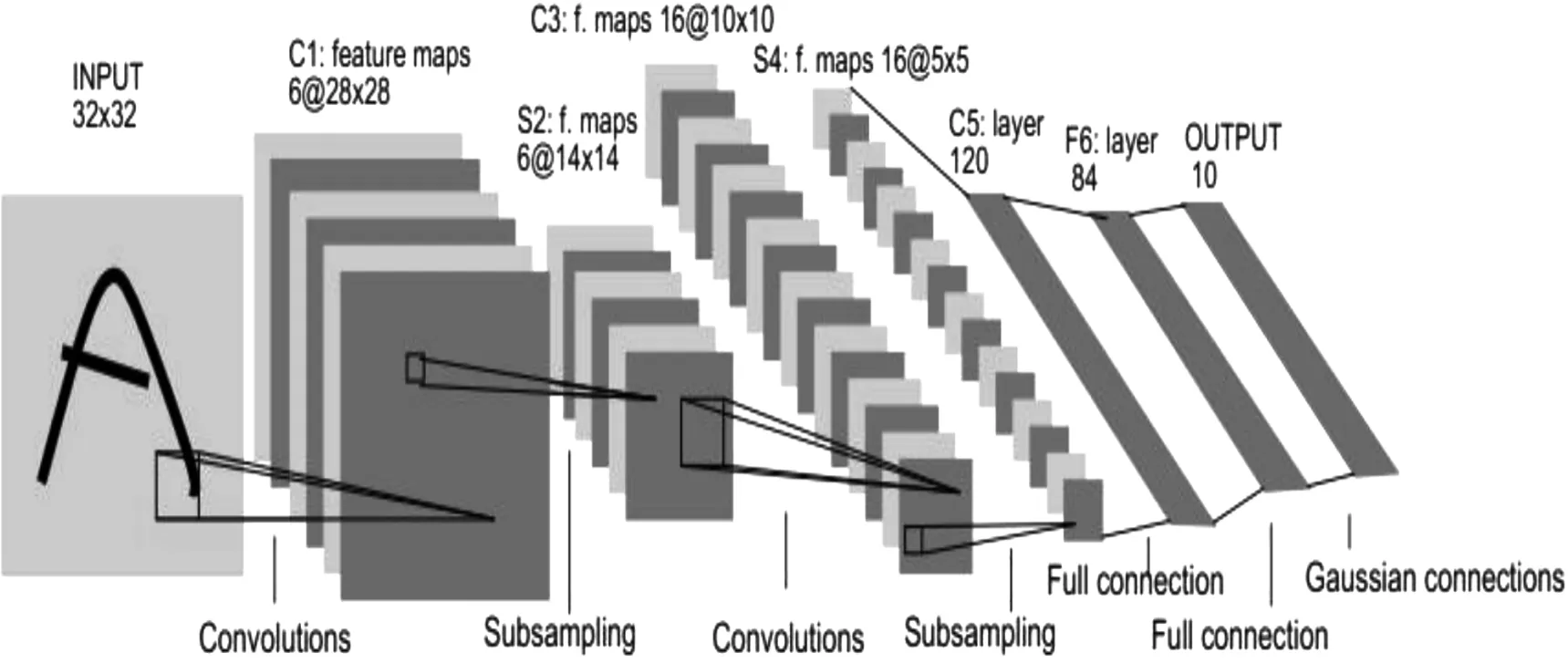

卷積神經網絡由1~3個特征提取階段和1層或2層的傘連接神經網絡分類器構成。卷積神經網絡的典型結構是LeNet-5[11],其最早用于銀行手寫數字識別,實際準確率高,具體結構如圖2所示。

圖2 CNN典型網絡結構

由圖2可知:CNN通過卷積層提取特征,通過子采樣層降低維度,然后以相同的組合形成更加抽象的特征,最終通過全連接層形成對圖象的描述特征。具體構造方法分為3步。

1) 卷積層的構建

卷積層是由多個特征平面組成,每個特征平面又由具有相同連接權重的多個神經元構成。卷積層上的每個神經元都定義了相應的感受野,這些神經元只接受其感受野傳輸的信號,在同一特征平面上的感受野大小相同。如圖2所示,前一層的特征圖與可訓練的卷積核進行卷積,得到的卷積結果再通過激活函數后輸出形成下一個卷積層的特征圖。卷積形式如式(3)所示:

(3)

其中:oij表示第i層的第j個特征圖;oij(x,y)是oij中的元素;tanh( )為雙曲正切函數,bij是特征圖oij的偏置;Kij是與oij相連的上一層的特征圖符號集合;wijk是oij和o(i-1)j的卷積核;Ri是該層卷積核的行數;Ci是該層卷積核的列數。如果第(i-1)層的特征圖大小為n1×n2,卷積核大小為l1×l2,經過卷積后,得到第i層特征圖的大小為(n1-l1+1)×(n2-l2+1)。

2) 采樣層的構造方法

采樣層通過對上一層的相鄰小區域進行聚合統計實現采樣處理。設采樣區域大小為l1×l2,具體采樣方法如式(4)所示:

(4)

其中:gij表示oij增益系數。

3) 分類層的構建

在分類任務中,最后一層通常是一個全連接層,將每一個單像素圖像和輸出層的每一種可能的分類相連接。由于softmax回歸是解決多分類問題的一種方法,是基于邏輯回歸而來[12],因此,本文最后一層的激勵函數使用softmax回歸函數,其中每一個神經元的輸出代表分類結果的可能性。

2.3 CNN的訓練方法

卷積神經網絡的訓練分為2個階段。

1) 前向傳播階段。從樣本集中抽取一個樣本(Xi,Yi),將Xi輸入網絡,經過逐級變換,信息從輸入層傳送到輸出層,實際的輸出如式(5)所示:

(5)

其中:w(n)表示第n層的權值;b(n)表示第n層的偏置;Fn()是第n層的激活函數,一般采用反正切函數或sigmoid函數,本文采用sigmoid函數。

2) 后向傳播階段,也稱為誤差傳播階段。CNN中誤差的反向傳播過程分為輸出層的誤差反向傳播和隱層的誤差反向傳播2個過程。輸出層的誤差反向傳播過程誤差計算如式(6)、(7)所示:

(6)

(7)

其中:Ei是第i個樣本的誤差;Oik是第i個樣本輸出層第k個神經元的輸出;Tik是第i個樣本輸出層第k個神經元的期望輸出。

隱層的誤差反向傳播又包括子采樣層的誤差反向傳播和卷積層的誤差反向傳播。子采樣層的誤差與和輸出層的誤差計算方式類似,即分別計算該層當前神經元的輸出誤差與該神經元的輸出、增益和偏置的偏導,并以此調整相應的增益和偏置。而卷積層的誤差反向傳播過程比較復雜,一般采用文獻[13]的方法解決。

3 實驗結果與分析

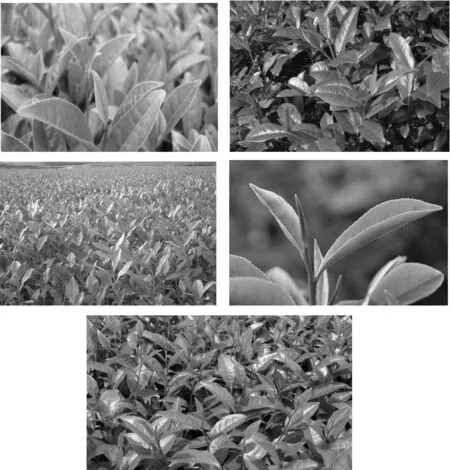

實驗中,選取了4種典型的嫩芽形態以5種不同的姿態(水平面上0~360°每90°為一個姿態類)進行實驗,即共有20種分類結果。在晴天、陰雨天氣及光照不均條件下,從茶葉嫩芽正側面(0°角)、 45°角斜向下和垂直從上往下(90°角)3種不同的角度,以1株特寫、2株特寫以及群拍的方式采集了樣本圖像數據1 000個,具體范例見圖3。其中,每類隨機選取40個,共800個數據作為訓練樣本,剩余200個數據作為測試樣本,其圖像大小都歸一化為48×48。本次實驗在Intel Core i7-3770M3,頻率為3.5 GHz,內存為8GB的CPU平臺上,利用 Matlab 軟件完成。

圖3 不同拍攝因素下的茶葉圖像

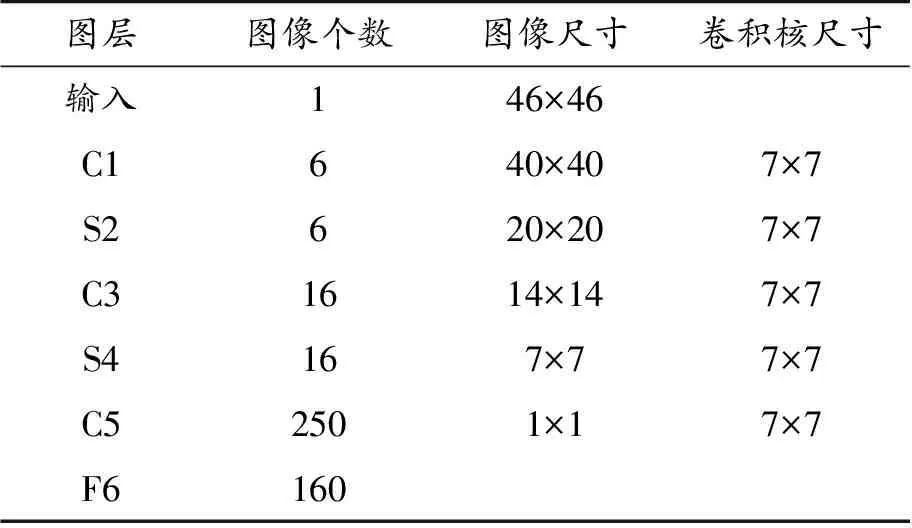

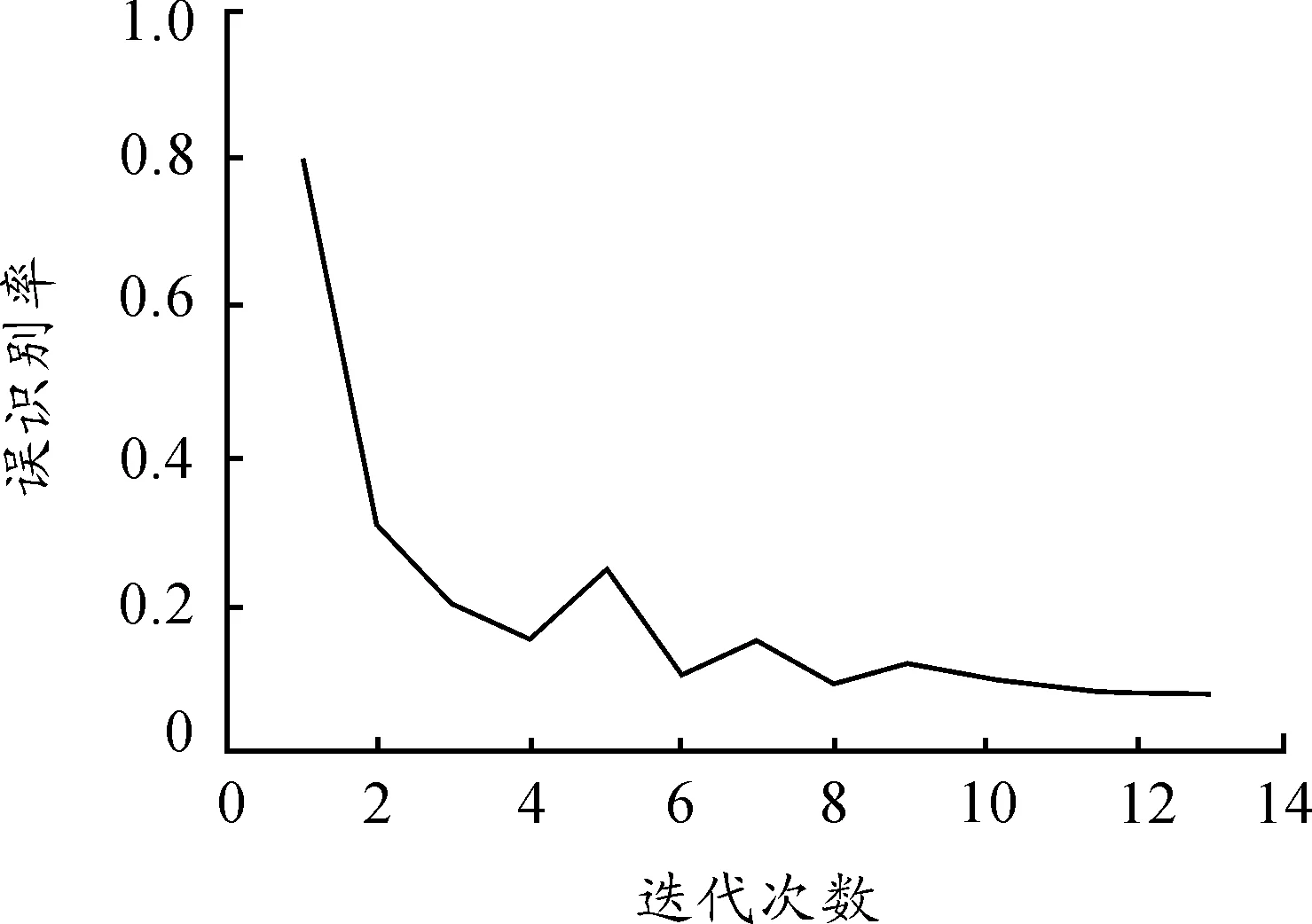

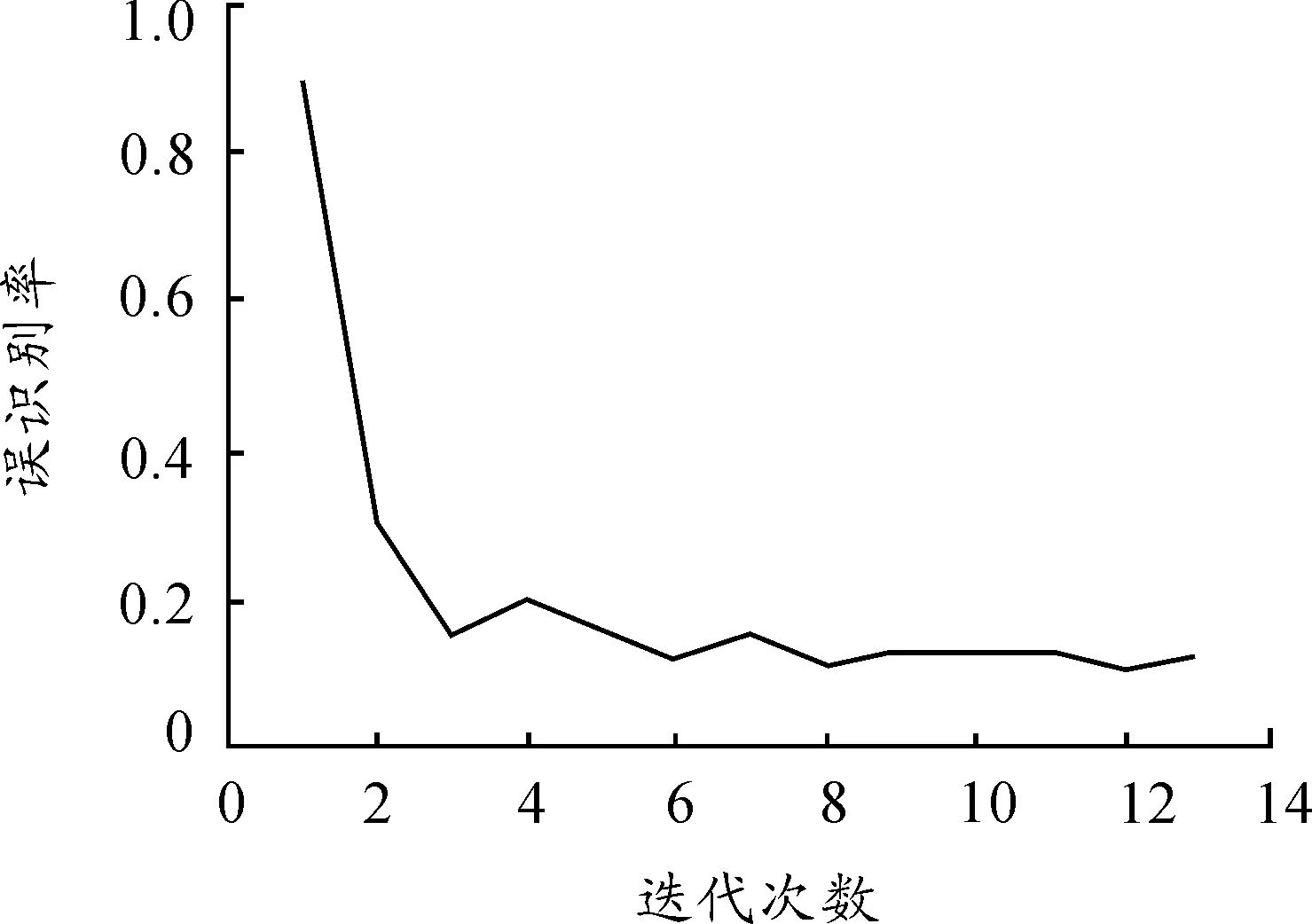

實驗時,由于LeNet-5網絡輸出神經元數較少,僅有10個。因此,本文在此基礎上做以下改進:①改進子采樣層的采樣方式。釆樣方式由區域內4個神經元求平均值變為求最大值;②使用sigmoid函數來替代tanh()函數作為各層的激勵函數;③增加了C5層的特征圖數目和全連接層F6層的神經元個數。改進后的CNN結構參數如表1所示。按照表1所示的參數構建網絡并進行訓練,經過8次迭代訓練后網絡收斂,其誤識別率和迭代次數見圖4。

表1 卷積神經網絡參數

圖4 改進后的CNN網絡模型的誤識別曲線

200張圖像中嫩芽總數為552個,實際識別率為91.3%,總耗時為99.3 s,平均每個嫩芽耗時0.18 s。分析其原因,主要有2個可能的方面:① 在CNN網絡識別前,由于拍攝角度、光照的強弱和取景遠近等因素可能對嫩芽圖像提取造成影響;② CNN網絡自身的結構參數設置可能產生影響。針對這兩方面因素再進行一次相關實驗。

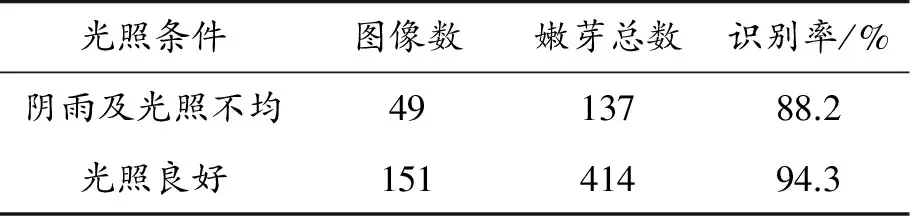

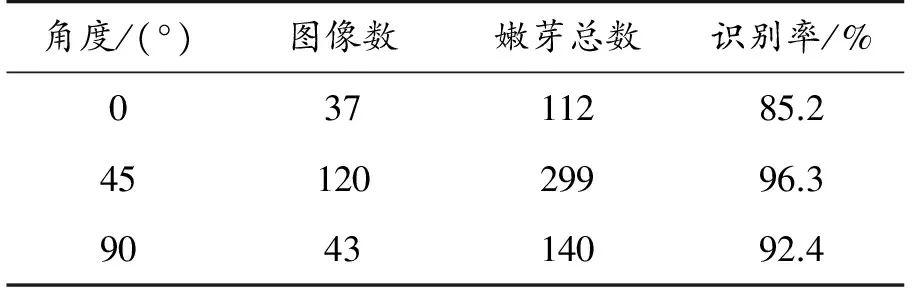

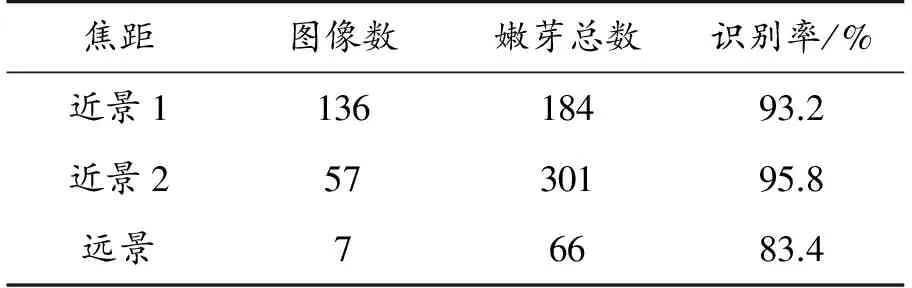

1) 對200張圖像分別按照拍攝角度、光照強弱和取景遠近這3個條件進行分類。對每一類圖像分別用CNN網絡進行識別,其統計結果如表2~4所示。

表2 不同光照條件下茶葉嫩芽識別結果統計

表3 不同取像角度茶葉嫩芽識別結果統計

表4 不同取像遠近角度茶葉嫩芽識別結果統計

其中:近景1表示視野中有1~3個茶葉嫩芽;近景2表示視野中有4~8個茶葉嫩芽;遠景表示視野中有8個以上茶葉嫩芽。由以上實驗結果可以看出:① 在光照條件較好時,由于圖像前期的提取率較高,所以識別率較好;② 取景角度不同導致嫩芽互相遮擋的面積不同,這也會影響識別率,其中以斜向下45°的識別率最高;③ 焦距的不同造成取得的景深和清晰度不同,也會導致不同結果。實驗發現:視野中有4~8個茶葉嫩芽時,其識別率最好。

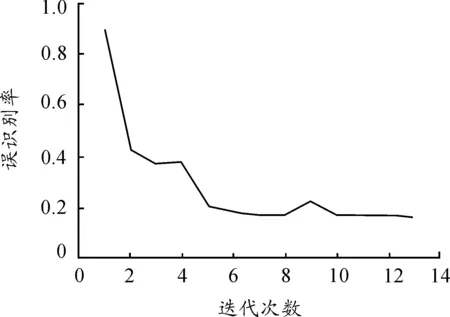

2) 對CNN網絡參數進行2種改動。在原實驗網絡模型的基礎上減少卷積濾波器的數量,形成CNN1網絡。將C1層特征圖像的個數減少為4個,則S2層特征圖像數量也是4個。同樣,將C3層的特征圖像減少為10個,則S4層特征圖像數量也是10個。將C5的特征圖像數量減少為120個,其余部分的構造方式保持不變。CNN1網絡與原網絡相比在卷積層上減少了卷積濾波器和對應的特征圖像的數量,減少了網絡模型需要訓練的參數數量。但與此同時也使得網絡模型能學習到的卷積濾波器數量減少,提取的圖像特征信息也相應減少。其訓練結果見圖5。

在CNN1網絡模型訓練過程中,迭代到第8次開始收斂,此時對應的誤識別率是11.8%。和原網絡模型的訓練結果對比可以看出,CNN1網絡模型的誤識別率有小量的上升。但CNN1在訓練中收斂速度明顯快于原網絡,在第8次迭代后就達到穩定狀態。這是因為隨著CNN1網絡模型各層的卷積濾波器數量的減少,使得網絡需要訓練的權重參數相應減少,網絡訓練時間也隨之減少。該實驗結果表明,減少卷積濾波器的數量,用同樣數量的訓練樣本對網絡進行訓練,網絡依然能很好地提取到輸入圖像的特征數據用于對圖像進行分類。通過這個方法可以減小網絡參數規模,從而減少網絡訓練時間。

圖5 改進后的CNN1網絡模型的誤識別曲線

與CNN1網絡模型相反,CNN2模型在原網絡架構的基礎上增加了卷積濾波器的數量。將C1層的濾波器數量增加到8個,C3層增加到24個,C5層增加到300個。同原網絡相比,CNN2網絡中各層卷積濾波器個數增加,使得需要學習的參數規模大幅增加。卷積濾波器數量的增加雖然能使網絡學習到更多潛在特征,使網絡的特征提取能力得到增強,但同時也使網絡的訓練難度隨之增加,需要更多的樣本數據進行訓練。訓練結果見圖6。

圖6 改進后的CNN2網絡模型的誤識別曲線

由圖6可以看出:在訓練過程中,網絡的誤分類率曲線變化波動較大,比較不穩定。誤分類率在第8次和第12次迭代后趨于收斂,隨后又很快上升。在12次迭代之后取得的16.6%的誤分類率相比其他2種網絡都高。

由以上實驗可知:CNN網絡模型各層的卷積濾波器個數需要適中,卷積濾波器過少可能減少對圖像特征的提取,從而降低識別率;卷積濾波器過多則可能使訓練規模增加、訓練過程變長。

4 結束語

本文著重研究了基于深度學習的茶葉形態智能識別問題,重點對茶葉嫩芽進行識別。在外界光線、拍攝角度、取景遠近及嫩芽數目未知的情況下,利用顏色、區域生長及形狀的圖像等因素對茶葉嫩芽進行檢測,再利用深度學習方法中的卷積神經網絡算法對茶葉嫩芽的形態進行3D識別。通過對不同影響因素的實驗結果表明:將深度學習方法應用于茶葉嫩芽識別可獲得到較優的結果,為后續的進一步3D還原奠定了基礎。

[1] NGIAM J,KHOSLA A,KIM M,et al.Multimodal deep learning[C]//Proceedings of the 28th International Conference on Machine Learning (ICML-11).[S.l.]:[s.n.],2011:689-696.

[2] DAHL G E,YU D,DENG L,et al.Context-Dependent Pre-trained Deep Neural Networks for Large-Vocabulary Speech Recognition[J].IEEE Trans on Audio,Speech and Language Processing,2012,20(1):30-42.

[3] HINTON G,DENG L,YU D,et al.Deep Neural Networks for Acoustic Modeling in Speech Recognition:The Shared Views of Four Research Groups[J].IEEE Signal Processing Magazine,2012,29(6):82-97.

[4] 郝靳.基于改進的蟻群算法實現的茶葉種植分析系統[D].長春:吉林大學,2014.

[5] 肖波,索興梅,白中英.應用神經網絡方法解決小麥高產群體圖像識別[J].計算機應用研究,2004,35(4):240-242.

[6] 汪建.結合顏色和區域生長的茶葉圖像分割算法研究[J].茶葉科學,20l1,3l(1):72-77.

[7] COMANICIU D,MEER P.An algorithm for data—driven bandwidth Selection[J].IEEE Trans PAMI,2003,24(5):28l-288.

[8] 汪建,杜世平.基于顏色和形狀的茶葉計算機識別研究[J].茶葉科學,2008,28(6):420-424.

[9] 孫志軍,薛磊,許陽明,等.深度學習研究綜述[J].計算機應用研究,2012(8):2806-2810.

[10]BENGIO Y.Practical recommendations for gradient-based training of deep architectures[M].Berlin:Springer-Verlag,2012:437-478.

[11]WITTEN I H,FRANK E,HALL M A.Data Mining:Practical Machine Learning Tools and Techniques[M].USA:Elsevier,2011.

[12]ARRIBAS J I,CID-SUEIRO J,ADALI T,et al.Neural architectures for parametric estimation of a posteriori probabilities by constrained conditional density functions[C]//Neural Networks for Signal Processing IX,1999.Proceedings of the 1999 IEEE Signal Processing Society Workshop.USA:IEEE,1999:263-272.

[13]SIMARD P,STEINKRAUS D,PIATT J C.Best Practices for Convolutional Neural Networks Applied to Visual Document Analysis[C]//ICDAR 2003.Scottland:IEEE,2003:958-962.

(責任編輯 楊黎麗)

Intelligent Identification for Tea State Based on Deep Learning

WANG Kun1, LIU Da-mao2

(1.Department of Electronic and Information Engineering, Yango College,Fuzhou University, Fuzhou 350015, China; 2.College of Physics and Information Engineering, Fuzhou University, Fuzhou 350108, China)

Currently the identification of tea state is still done manually, and it is difficult to form a large-scale and industrial production. As a new direction in machine learning, deep learning is getting more attention for its accuracy and efficiency. So the Convolutional Neural Network of deep learning was applied to tea state identification. According to the practical applications, some improvements was made for classical Convolutional Neural Network, using the extracted tea image to train the network, and finally the network can identify the tea state correctly. Experimental results show that the algorithm can make 3D identification for the symbol of tea-tea buds effectively and has robustness for different factors.

deep learning; convolutional neural network; image segmentation; feature extraction; 3D identification

2015-10-09 基金項目:福建省教育廳項目(JA13366)

王琨(1983—),女,河南鄢陵人,講師,主要從事數字圖像處理方面研究。

王琨,劉大茂.基于深度學習的茶葉狀態智能識別方法[J].重慶理工大學學報(自然科學版),2015(12):120-126.

format:WANG Kun, LIU Da-mao.Intelligent Identification for Tea State Based on Deep Learning[J].Journal of Chongqing University of Technology(Natural Science),2015(12):120-126.

10.3969/j.issn.1674-8425(z).2015.12.020

TP391

A

1674-8425(2015)12-0120-07