基于亞像素級角點檢測的雙目視覺距離測量

施聞明,郭星衛(wèi),王文清

(海軍潛艇學院,山東 青島 266042)

基于亞像素級角點檢測的雙目視覺距離測量

施聞明,郭星衛(wèi),王文清

(海軍潛艇學院,山東 青島 266042)

摘要:要提高雙目測距的精度,需要高精度的視差,為此引入亞像素檢測方法。首先,采用Bouguet立體校正算法將左右圖像進行極線校正,以減少匹配計算代價,提高匹配效率;然后,利用Harris角點探測器在一矩形領域內(nèi)尋找一個最強特征點作為待匹配點,再采用最大互相關法對左圖像進行匹配搜索確定匹配點。最后,對已匹配好的點對進行亞像素級檢測,即可得到亞像素級視差。實驗結(jié)果表明,該方法能將角點檢測精度提高到0.001像素,測距精度也相應提高,距離越遠效果越明顯。

關鍵詞:立體匹配;亞像素檢測;雙目測距

0引言

雙目視覺測距技術仿照人類雙眼感知周圍環(huán)境空間深度功能[1],利用2個攝像頭拍攝從不同位置拍攝同一場景,通過各種算法對所拍攝的立體圖像對進行匹配,并計算視差,然后利用三角測量原理實現(xiàn)距離測量。立體匹配是雙目視覺測距的關鍵環(huán)節(jié),也是雙目視覺研究的熱點。近些年來,國內(nèi)外機器視覺領域的學者提出了很多立體匹配的算法[2-7],有些達到了極高的匹配精度,但這些算法要么是針對特定應用提出的,要么是以增加計算量來提高匹配精度,因而不具有通用性。就測距而言,只需知道目標上一些特征點坐標即可達到測距目的,沒有必要進行全圖像匹配。針對此特點,本文提出一種高精度快速匹配策略。首先,在獲取雙目視覺系統(tǒng)內(nèi)外參數(shù)的條件下,采用Bouguet算法將左右圖像校正為極線水平對準狀態(tài),以減少后續(xù)的匹配計算代價;然后,利用Harris角點探測器在右圖像感興趣區(qū)域內(nèi)尋找一個最強特征點作為待匹配點,建立以該特征點為領域的模板,采用最大互相關法對對左圖像進行匹配搜索確定匹配點;然后再對左右圖像中確定的匹配點進行亞像素級檢測,得出各自的亞像素級坐標;利用得出的亞像素級角點坐標結(jié)合雙目視覺測距算法即可得到目標點的距離。本文所用方法相對上述文獻中提出高精度立體匹配算法而言,計算代價更小,效率更高,對于實時性要求很高的場合,如雙目實時測距,具有一定的參考價值。

1雙目測量原理

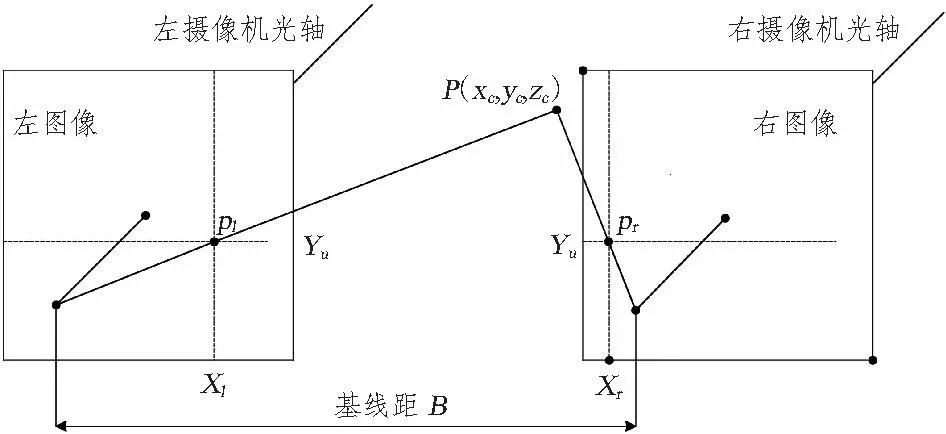

雙目立體視覺測量基于視差原理。圖1所示為簡單的雙目平視立體成像原理圖,2臺攝像機投影中心線的距離,即基線距為B。點P在左右攝像機CCD平面上投影的圖像坐標分別為pl=(Xl,Yl)和pr=(Xr,Yr)。 由三角關系可得

(1)

圖1 雙目立體成像原理Fig.1 Principle of binocular solid imaging

設視差為D=Xl-Xr, 由此計算出特征點P在攝像機坐標系下的三維坐標為

(2)

(3)

(4)

從而可得P點在攝像機坐標系下的距離為

(5)

因此,只要能在左圖像找到與右圖像對應的匹配點,就可以確定出該點的三維坐標,從而實現(xiàn)距離測量。

2圖像立體校正

當2個像平面的極線完全水平對準時,此時的匹配效率最高,視差計算也最簡單。但現(xiàn)實中的2臺攝像機幾乎不可能完全做到水平,即不可能有準確行對準的成像平面,因而需要對立體圖像對進行立體校正,采用一定的數(shù)學方法使立體圖像對完全地行對準到前向平行結(jié)構(gòu)上。本文采用基于標定的Bouguet立體校正算法對圖像進行立體校正[8]。該算法通過對立體標定獲取的攝像機間的旋轉(zhuǎn)矩陣R和平移向量T進行數(shù)學處理,使2幅圖像中的每一副投影次數(shù)最小化,同時使得觀測面積最大化,以達到讓極線水平對準的效果。圖2為校正后左右攝像機對應的2幅圖像,可以看出,校正后的圖像處于極線平行對準狀態(tài)。在后續(xù)的匹配搜索過程中,只需在左右圖像的同一行進行搜索即可找到對應的匹配點,從而達到提高匹配效率的目的。

圖2 校正后的圖像Fig.2 Images after revising

3特征點提取

3.1 角點提取

特征匹配方式是基于抽象的幾何特征(如邊緣輪廓、拐點、幾何基元的形狀及參數(shù)化的幾何模型等),本文采用的特征點為角點。對于角點的定義目前尚未統(tǒng)一,但最普遍的定義是由Harris在文獻[9]中提出的,他定義角點位于圖像二階導數(shù)的自相關矩陣有2個最大特征值的地方,即圖像邊緣的相交處。本文采用文獻[9]提出的角點檢測方法對感興趣點進行角點檢測。例如,擬選取右圖像標定紙右上角作為特征點,先確定一固定大小的矩形領域為角點檢測區(qū)域(大致包含擬選特征點),然后進行角點檢測,測得該點圖像坐標為P(882,251)。照此方法可在右圖像中檢測出若干感興趣的特征點,將這些點作為待匹配點,按照引言中所描述的方法可找出右視圖對應的匹配點。圖3(a)顯示以特征點為中心畫矩形, 圖3(b)顯示矩形區(qū)域內(nèi)角點檢測結(jié)果。

圖3 角點檢測Fig.3 Corner detecting

3.2 亞像素角點提取

上節(jié)所獲得的角點坐標為整數(shù)值,為提高測量精度,需要精度更高的角點即亞像素級角點。文獻[10]介紹了一種計算亞像素級角點的方法,其主要思路如圖4所示。

圖4 亞像素級角點檢測Fig.4 Sub-pixel corner detecting

圖4中,假設q在實際的亞像素角點附近。檢測所有的向量qp,若向量qp的方向與邊緣方向一致,則此邊緣上的p點處的梯度與向量qp正交,如圖4(a)所示;若p點位于均勻區(qū)域,如圖4(b)所示,則p點處的梯度為0,這2種情況下向量qp與p點處的梯度的點積均為0。可在p點周圍找到若干組梯度以及相關的向量qp,令其點積為0,求解方程組,得出的值即為q的亞像素級坐標。

4最大互相關匹配準則

基于灰度的區(qū)域匹配方法,其基本原理是在其中1幅圖像中選取1個子窗口(m×n)圖像,然后在另1幅圖像中的1個區(qū)域內(nèi),根據(jù)某種匹配準則,尋找與子窗口圖像最為相似的子圖像。本文將特征匹配與區(qū)域匹配進行融合,以提取到的特征點為中心選取m×n的窗口作為子窗口,采用最大互相關準則作為約束進行匹配。

考慮到噪聲的影響,定義在某個領域上的灰度相關值C(x,y)來表示灰度的相似性。具體操作方法是將左圖像中的已檢測出的角點q(x,y)為中心的m×n窗口的灰度領域作為范本,在右圖像中以互相關函數(shù)作為2個搜索領域間的相識性測度。搜索具有同樣或相似灰度值分布的對應點領域,實現(xiàn)同名點的匹配。互相關函數(shù)C(x,y)表示如下

當C(x,y)最大時得到右圖像中點p(x,y),此時認為p(x,y)與q(x,y)為最佳匹配點對。

4實驗與分析

采用上節(jié)的最大互相關匹配準則對右圖像所檢測到的若干特征點在左圖像上進行搜索匹配,可得與之對應匹配點。本文在右圖像上任意選取了15個特征點進行匹配,匹配結(jié)果如圖5所示。

圖5 匹配結(jié)果Fig.5 Matching result

對所得到匹配點對再按第3.2節(jié)中的方法進行亞像素角點檢測,本文采用文獻[8]中OpenCV開源計算機視覺庫中提供的函數(shù)cvFindCornerSubPix()進行檢測,得到亞像素級匹配點之后,再計算對應的視差,結(jié)合式(2)~式(5)以及通過攝像機標定得出的攝像機內(nèi)外參數(shù)即可得出特征點的距離,如表1所示。

表1 亞像素檢測及測距結(jié)果

從表1中數(shù)據(jù)可看出,經(jīng)過亞像素檢測以后,特征點的坐標精度有了很大提高,可達到小數(shù)點后3位,這在一定程度上也提高了測距的精度。由于本文中目標距離較近,視差比較大,所以坐標精度的提高對于測距的結(jié)果影響不是很大,但對于遠距離目標來說,視差很小,此時角點測量精度的提高對最終測距精度會產(chǎn)生很大的影響。

5結(jié)語

本文提出了一種基于亞像素角點檢測的方法實現(xiàn)雙目測距,該方法在已匹配點的基礎上進行亞像素檢測,將匹配點的檢測精度精確到0.001像素,這對提高測距精度,尤其是遠距離目標的測距精度有很大作用。由于采用極線校正,使得匹配效率更高,因而本文所用方法適用于實時性要求很高的雙目視覺測距、快速三維重建等場合。

參考文獻:

[1]高文,陳熙霖.計算機視覺算法與系統(tǒng)原理[M].北京:清華大學出版社,1998.

[2]LEVINE M D,HANDLEY O.Computer determination of depth maps[J].Computer Graphics and Image Processing,1972(2):131-150.

[3]ANGELA R,ANTONIO C,JOSE M.A dense disparity map of stereo images[J].Pattern Recognition Letters,1997(18):385-393.

[4]唐麗,吳成柯,劉侍剛.基于區(qū)域增長的立體成像匹配算法[J].計算機學報,2004,27(7):937-944.

TANG Li,WU Cheng-ke,LIU Shi-gang.Matching arithmetic of solid imaging based on zone increasing[J].Computer Transaction,2004,27(7):937-944.

[5]LIM H S,PARK H.A dense disparity estimation method using color segmentation and energy minmiation[C]//Image Processing.IEEE International Conference on,8-11 Oct,2006(s):1033-1036.

[6]王紅梅,張科,李言俊.圖像匹配研究進展[J].計算機工程與應用,2004(19):42-45.

WANG Hong-mei,ZHANG Ke,LI Yan-jun.Research on headway of image matching[J].Computer Project and app,2004(19):42-45.

[7]王軍,張明柱.圖像匹配算法的研究進展[J].大氣與環(huán)境光學學報,2007,2(1):11-15.

WANG Jun,ZHANG Ming-zhu.Research on headway of image matching arithmetic[J].Atmosphere and Atmosphere Optics Transaction,2007,2(1):11-15.

[8]于仕琪,劉瑞禎,譯.學習OpenCV(中文版)[M].北京:清華大學出版社,2009.

[9]HARRIS C,STEPHENS M.A combined corner and edge detector[C]//Proceedings of the 4th Alvey Vison Conference,1988:147-151.

[10]CHEN D,ZHANG G.A new sub-pixel detector for x-corners in camera calibration targets[J].WSCG Short Papers,2005:97-100.

Binocular range measuring based on sub-pixel corner detecting

SHI Wen-ming,GUO Xing-wei,WANG Wen-qing

(Navy Submarine Academy,Qingdao 266042,China)

Abstract:The improvement of the range-measuring accuracy depends on the high precise parallax, so this article introduces a sub-pixel detecting method. At first, it uses bouguet algorithm to rectify the left and right images to make their epipolar line forward-parallel so that decrease the computation and improve the matching efficiency. Then it uses Harris corner detector to find a most characteristic corner as candidate matching point. After that, it uses most cross correlation matching rule to match left image. Finally, it detects the matched points at sub-pixel level to get the sub-pixel parallax .the result shows that, the method used in this article can improve the corner detecting precision to 0.001 pixel, and the range-measuring accuracy be improved accordingly, the farther the targets′ range,the more evidently the improvement of precision.

Key words:stereo matching;sub-pixel detecting;binocular range measuring

作者簡介:施聞明(1982-),男,博士,講師,從事載運工具運用工程研究。

基金項目:海軍預研資助項目

收稿日期:2013-09-29; 修回日期: 2014-03-10

文章編號:1672-7649(2015)02-0107-04

doi:10.3404/j.issn.1672-7649.2015.02.022

中圖分類號:TP273

文獻標識碼:A