基于HSI亮度分量和RGB空間的圖像去霧算法

李慧慧 秦品樂(lè) 梁軍

摘要:圖像去霧技術(shù)處理的目的是消除霧霾對(duì)視頻監(jiān)控圖像的影響,提高霧霾圖像的視覺(jué)效果。目前,一般去霧圖像只是比較去霧后和去霧前的圖像,處理結(jié)果通常失真嚴(yán)重或過(guò)飽和,不能在保證細(xì)節(jié)清晰的同時(shí)保證顏色信息完整。針對(duì)上述問(wèn)題,提出了一種基于大氣散射模型和光學(xué)原理,建立具有散射特性的HIS亮度轉(zhuǎn)換模型,并與RGB空間結(jié)合計(jì)算的圖像復(fù)原方法。該方法通過(guò)分析晴天圖像和霧霾圖像的對(duì)比關(guān)系,結(jié)合HSI空間人眼視覺(jué)最敏感的亮度分量計(jì)算出圖像場(chǎng)景的相對(duì)深度關(guān)系,利用大氣散射模型以及景深比,對(duì)霧霾視頻圖像進(jìn)行清晰復(fù)原和結(jié)果的測(cè)評(píng)。實(shí)驗(yàn)結(jié)果證明,與只從RGB空間計(jì)算的去霧霾方法對(duì)比,所提方法去霧效果更清晰,彩色失真和過(guò)飽和程度更小。

關(guān)鍵詞:視頻監(jiān)控;去霧;大氣散射模型;圖像復(fù)原;景深

中圖分類號(hào):TP752.2 文獻(xiàn)標(biāo)志碼:A

Abstract:The purpose of image defogging is to remove the fog effect from image of surveillance video to improve the fog haze image visual effect. Presently, there is only a comparison between images before and after defogging, and the results are often distorted seriously and oversatuarted. Thereby, it is hard to ensure the clear details and the integrity of color information simultaneously. For tackling above problems, a new optimized method for images recovering was proposed with combination of HIS luminance component and RGB space, which was based on atmosphere scattering model and optical principals. In this method the relative depth relationship of image scene was analyzed by comparing images in fine and haze days with help of the most eyesensitive HSI luminance component. Finally, by utilizing atmosphere scattering model and the comparison of depth of field, the recovering and result evaluation were conducted on the video obtained in haze. The experimental results show that, compared with the defogging methods calculated in RGB space, the proposed method has more clear defogging results and smaller degree of color distortion and oversaturation.

Key words:video surveillance; defogging; atmosphere scattering model; image recovering; depth of field

0 引言

霧霾天氣下,道路監(jiān)控?cái)z像機(jī)的監(jiān)控距離、圖像清晰度下降,導(dǎo)致監(jiān)測(cè)到的車輛、人物等主體的關(guān)鍵細(xì)節(jié)信息丟失,降低了視頻監(jiān)控系統(tǒng)的實(shí)用性, 因此霧天降質(zhì)圖像或視頻的清晰化處理成為了計(jì)算機(jī)視覺(jué)和圖像處理領(lǐng)域的一大研究熱點(diǎn)。目前,較常用的有光學(xué)透霧和電子透霧兩種透霧技術(shù)。光學(xué)透霧是基于光波波長(zhǎng)和霧霾濃度的特征,利用可穿透霧霾的近紅外波段光線進(jìn)行成像,成像效果比較明顯,較好地運(yùn)用在了海事、海洋的相關(guān)科研活動(dòng)中[1]。然而光學(xué)透霧只能得到黑白監(jiān)控畫面,鏡頭延伸有一定的限制,并且需要的鏡頭成本很昂貴。電子透霧技術(shù)主要分為兩類:一類是非模型的圖像增強(qiáng)方法,通過(guò)增強(qiáng)圖像的對(duì)比度,滿足主觀視覺(jué)的要求來(lái)達(dá)到清晰化的目的;另一類是基于物理模型的圖像復(fù)原方法,考察圖像退化原因,將退化過(guò)程進(jìn)行建模,采用逆向處理,最終完成圖像的復(fù)原。將光學(xué)透霧和電子透霧結(jié)合起來(lái)稱為光電透霧,可以均衡兩者的優(yōu)勢(shì),達(dá)到更好的去霧效果。非模型方法只能相對(duì)地提高圖像質(zhì)量,造成圖像部分信息的丟失。

基于物理模型,利用單幅圖像進(jìn)行去霧,取得了一定效果,但是單幅圖像只能對(duì)原霧天圖像和去霧后的圖像進(jìn)行對(duì)比,往往忽略了顏色信息的丟失和過(guò)飽和情況,造成對(duì)監(jiān)控主體特征的錯(cuò)誤判斷。He等[2]提出了暗通道優(yōu)先,利用暗通道優(yōu)先取得了很好的去霧效果,并且得到了深度圖像;但在實(shí)際使用過(guò)程中暗通道優(yōu)先方法有一定的局限性,不能很好處理圖像中灰白色區(qū)域,且大量的計(jì)算使整個(gè)處理過(guò)程耗時(shí)太長(zhǎng),難以應(yīng)用和推廣。基于物理模型,利用多幅圖像對(duì)比進(jìn)行去霧是目前研究的熱點(diǎn),但也有其局限性。如偏振方法去霧[3-7],需要不同拍攝角度或不同拍攝時(shí)間,取得了一定的效果,但這些方法對(duì)數(shù)據(jù)輸入要求較高,普通拍攝難以獲取合適的圖像。Narasimhan等[8]從RGB色彩空間出發(fā),利用多幅霧天圖像計(jì)算出場(chǎng)景的三維結(jié)構(gòu),從而對(duì)場(chǎng)景圖像去霧。該方法近似大氣散射系統(tǒng)和波長(zhǎng)無(wú)關(guān),對(duì)與霧氣顏色接近的圖像部分恢復(fù)效果不理想,且無(wú)法用于動(dòng)態(tài)監(jiān)控視頻場(chǎng)景。陳功等[9]作了相應(yīng)的改進(jìn),但只是從RGB色彩空間進(jìn)行計(jì)算,RGB關(guān)聯(lián)較大,雖然分別對(duì)紅(R)、綠(G)、藍(lán)(B)分量作不同處理,但在計(jì)算場(chǎng)景深度時(shí),以R通道為軸,會(huì)造成較大的色彩失真和飽和度。本文在此基礎(chǔ)上,針對(duì)去霧清晰度、色彩失真度及過(guò)飽和的問(wèn)題,提出了基于大氣物理模型的新的計(jì)算方法,根據(jù)大氣霧霾粒子散射特性及人眼對(duì)紅光、綠光和藍(lán)光的不同敏感度設(shè)計(jì)出新的亮度轉(zhuǎn)換模型,并結(jié)合RGB色彩空間計(jì)算出場(chǎng)景深度與景深比,對(duì)圖像進(jìn)行去霧處理,實(shí)驗(yàn)證明,本文方法得到了更好的去霧效果。

1 大氣散射計(jì)算模型

大氣散射模型是霧天視頻場(chǎng)景圖像降質(zhì)的物理原理,文獻(xiàn)[10-11]中對(duì)大氣散射模型進(jìn)行了詳細(xì)的推導(dǎo)。在光的傳播過(guò)程中,撞上懸浮在空中的霧霾粒子,部分光就會(huì)被這些粒子散射掉,導(dǎo)致光束被削弱。大多數(shù)霧霾天氣主要是由一種較大的氣溶膠顆粒造成,其尺寸小于光波波長(zhǎng)λ的1/10,此時(shí)發(fā)生的是瑞利散射,且不同波長(zhǎng)的光波的散射程度是不同的。由于多次散射,遠(yuǎn)處的光亮度大大降低,最終短波光被散射殆盡,無(wú)法到達(dá)成像設(shè)備,得到不清晰的霧霾視頻圖像。環(huán)境光照則是隨著光程增加逐漸增強(qiáng),所以景深較大的場(chǎng)景點(diǎn)亮度較大,色彩和紋理特征也較模糊。由此,在霧天情況下,散射模型過(guò)程主要由衰減過(guò)程和環(huán)境光照組成。如圖1所示,描述了散射模型的過(guò)程。

2 基于散射特性亮度模型的改進(jìn)算法

2.1 算法流程

本文利用一張晴天參考圖像和霧天參考圖像,通過(guò)參考點(diǎn)選取方法得到的兩個(gè)參考點(diǎn),計(jì)算出部分模型參數(shù),然后借助這些參數(shù),將基于散射特性的HSI(HueSaturationIntensity)空間亮度轉(zhuǎn)換模型和RGB色彩空間近似的紅、綠、藍(lán)光波結(jié)合起來(lái),計(jì)算出各個(gè)場(chǎng)景點(diǎn)相對(duì)于參考點(diǎn)的相對(duì)景深比關(guān)系,并利用計(jì)算得到的相對(duì)景深比計(jì)算出所有模型參數(shù)和場(chǎng)景各點(diǎn)的深度,晴天參考圖像對(duì)去霧結(jié)果圖像的飽和度和顏色信息適當(dāng)?shù)剡M(jìn)行了還原,最后實(shí)現(xiàn)了對(duì)霧天視頻圖像的去霧處理。算法流程如圖2所示。

2.3 參考點(diǎn)選取

利用一張晴天參考圖像和霧天參考圖像,選取兩個(gè)參考點(diǎn),用于之后的參數(shù)計(jì)算,對(duì)光學(xué)成像過(guò)程建模。霧霾天氣下場(chǎng)景物的可見(jiàn)度與場(chǎng)景深度有關(guān),并且可見(jiàn)度較深度是呈指數(shù)下降的。陳功等[9]曾提到一種選取參考點(diǎn)的方法,即先利用先驗(yàn)知識(shí)找?guī)讉€(gè)深度相同的場(chǎng)景點(diǎn)或一個(gè)景深相同的場(chǎng)景小區(qū)域,然后取這些場(chǎng)景點(diǎn)中顏色差異較大的兩個(gè)點(diǎn)。本文利用先驗(yàn)知識(shí)找到景深相同的一個(gè)小矩形區(qū)域,區(qū)域大小選擇要適中,根據(jù)實(shí)際的圖像特征決定,找到最精確景深(AccurateDepth,AccDepth)區(qū)域。然后利用亮度轉(zhuǎn)換式(4)找出場(chǎng)景點(diǎn)中亮度差異最大的兩個(gè)點(diǎn)。

3 實(shí)驗(yàn)結(jié)果及測(cè)評(píng)

3.1 實(shí)驗(yàn)結(jié)果分析比較

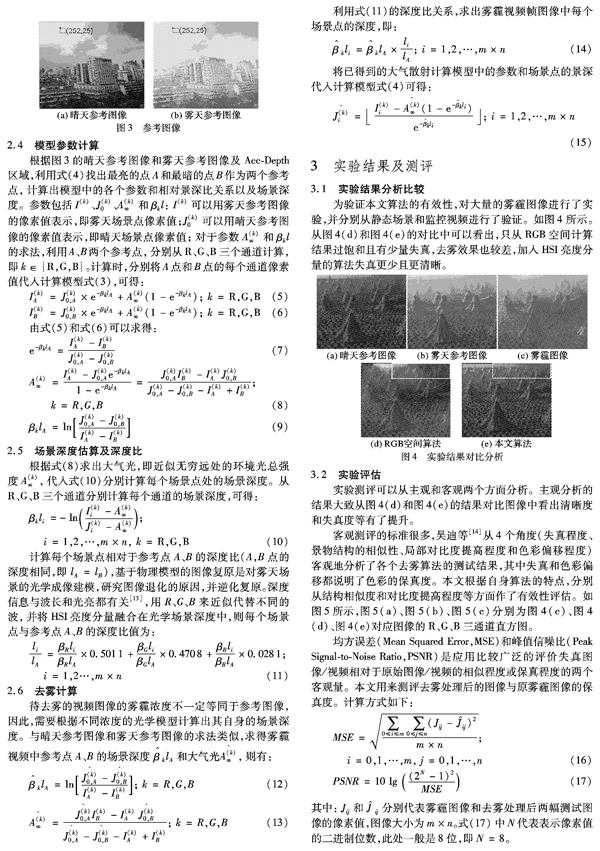

為驗(yàn)證本文算法的有效性,對(duì)大量的霧霾圖像進(jìn)行了實(shí)驗(yàn),并分別從靜態(tài)場(chǎng)景和監(jiān)控視頻進(jìn)行了驗(yàn)證。如圖4所示。從圖4(d)和圖4(e)的對(duì)比中可以看出,只從RGB空間計(jì)算結(jié)果過(guò)飽和且有少量失真,去霧效果也較差,加入HSI亮度分量的算法失真更少且更清晰。

3.2 實(shí)驗(yàn)評(píng)估

實(shí)驗(yàn)測(cè)評(píng)可以從主觀和客觀兩個(gè)方面分析。主觀分析的結(jié)果大致從圖4(d)和圖4(e)的結(jié)果對(duì)比圖像中看出清晰度和失真度等有了提升。

客觀測(cè)評(píng)的標(biāo)準(zhǔn)很多,吳迪等[14]從4個(gè)角度(失真程度、景物結(jié)構(gòu)的相似性、局部對(duì)比度提高程度和色彩偏移程度)客觀地分析了各個(gè)去霧算法的測(cè)試結(jié)果,其中失真和色彩偏移都說(shuō)明了色彩的保真度。本文根據(jù)自身算法的特點(diǎn),分別從結(jié)構(gòu)相似度和對(duì)比度提高程度等方面作了有效性評(píng)估。如圖5所示,圖5(a)、圖5(b)、圖5(c)分別為圖4(c)、圖4(d)、圖4(e)對(duì)應(yīng)圖像的R、G、B三通道直方圖。

均方誤差(Mean Squared Error,MSE)和峰值信噪比(Peak SignaltoNoise Ratio,PSNR)是應(yīng)用比較廣泛的評(píng)價(jià)失真圖像/視頻相對(duì)于原始圖像/視頻的相似程度或保真程度的兩個(gè)客觀量。本文用來(lái)測(cè)評(píng)去霧處理后的圖像與原霧霾圖像的保真度。計(jì)算方式如下:

對(duì)比去霧后的圖像與霧天圖像的差異,對(duì)圖5的直方圖進(jìn)行分析,計(jì)算出實(shí)驗(yàn)數(shù)據(jù),如表1所示。MSE的數(shù)值越小,PSNR的值越大,經(jīng)過(guò)去霧處理后的失真程度就越小。直方圖相關(guān)系數(shù)越大,表明兩幅圖像的相似度越高,將只從RGB空間計(jì)算的算法和本文算法處理后的結(jié)果分別與晴天參考圖像進(jìn)行直方圖相關(guān)系數(shù)計(jì)算,從表1可知,本文算法的系數(shù)值更高,即結(jié)構(gòu)相似度更高。從對(duì)比度比較可得,本文去霧算法結(jié)果圖像的對(duì)比度更好,細(xì)節(jié)更突出,去霧效果圖像更清晰。圖6為以城市建筑圖為例進(jìn)行的實(shí)驗(yàn)結(jié)果對(duì)比分析圖,晴天參考圖像和霧天參考圖像見(jiàn)圖3,表2為對(duì)應(yīng)的數(shù)據(jù)分析比較。同圖4對(duì)比結(jié)果一致,可以看出本文算法去霧效果更優(yōu)。

3.3 監(jiān)控視頻應(yīng)用

監(jiān)控視頻是一個(gè)動(dòng)態(tài)的場(chǎng)景,即場(chǎng)景中同時(shí)存在靜止的背景和運(yùn)動(dòng)的前景。 要使本文去霧算法針對(duì)于監(jiān)控視頻霧霾圖像,必須估算出其前景深度。本文用參考背景圖像的場(chǎng)景深度來(lái)近似等價(jià)于同一位置上前景的深度。由于參考圖像中的前景會(huì)影響去霧效果,為了減少這種影響,首先分別對(duì)霧天和晴天的視頻進(jìn)行背景提取,將得到的晴天和霧天的背景分別作為晴天參考圖像和霧天參考圖像。實(shí)驗(yàn)證明,本文算法對(duì)于視頻圖像同樣有較明顯的去霧效果,如圖7所示。

4 結(jié)語(yǔ)

本文通過(guò)霧霾圖像對(duì)比,對(duì)現(xiàn)有RGB空間去霧算法進(jìn)行分析,用基于散射特性的HSI空間亮度轉(zhuǎn)換模型和RGB空間結(jié)合計(jì)算各個(gè)模型參數(shù),減少失真和過(guò)飽和,并得到更有效的去霧方法。目前,計(jì)算機(jī)視覺(jué)已經(jīng)廣泛地應(yīng)用在交通和安全監(jiān)控系統(tǒng)中,圖像和監(jiān)控視頻的去霧也已經(jīng)成了計(jì)算機(jī)視覺(jué)重要的研究方向之一。現(xiàn)有的去霧霾方法并不能適用于所有的場(chǎng)景,需要?jiǎng)邮终{(diào)整參數(shù)以提升算法的適用能力。然而,交通、安全監(jiān)控等系統(tǒng)都需要一種能夠自動(dòng)調(diào)參的自適應(yīng)能力,這也是未來(lái)需要研究的重要內(nèi)容之一。

參考文獻(xiàn):

[1]鮑永欣. 海事調(diào)查取證系統(tǒng)的研究[D]. 大連:大連海事大學(xué),2014:52-58.(BAO Y X. Research on forensics system for maritime investigation[D]. Dalian: Dalian Maritime University, 2014:52-58.)

[2]HE K, SUN J, TANG X. Single image haze removal using dark channel prior[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(12): 2341-2353.

[3]SCHECHNER Y Y, NARASIMHAN S G, NAYAR S K. Instant dehazing of images using polarization[C]// Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2001, 1: 325-332.

[4]SCHECHNER Y Y, NARASIMHAN S G, NAYAR S K. Polarizationbased vision through haze[J]. Applied Optics, 2003, 42(3):511-525.

[5]NAMER E, SCHECHNER Y Y. Advanced visibility improvement based on polarization filtered images[C]// Proceedings of the 2005 International Society for Optics and Photonics. Bellingham, WA: SPIE, 2005, 5888: 36-45.

[6]SHWARTZ S, NAMER E, SCHECHNER Y Y. Blind haze separation[C]// Proceedings of the 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2006, 2: 1984-1991.

[7]SCHECHNER Y Y, AVERBUCH Y. Regularized image recovery in scattering media[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2007, 29(9): 1655-1660.

[8]NARASIMHAN S G, NAYAR S K. Vision and the atmosphere[J]. International Journal of Computer Vision, 2002, 48(3):233-254.

[9]陳功,王唐,周荷琴.基于物理模型的霧天圖像復(fù)原新方法[J]. 中國(guó)圖象圖形學(xué)報(bào),2008,13(5):888-893.(CHEN G,WANG T,ZHOU H Q. A novel physicsbased method for restoration of foggy day images[J]. Journal of Image and Graphics,2008, 13(5):888-893.)

[10]NAYAR S K, NARASIMHAN S G. Vision in bad weather[C]// Proceedings of the 7th IEEE International Conference on Computer Vision. Piscataway, NJ: IEEE, 1999, 2: 820-827.

[11]NARASIMHAN S G, NAYAR S K. Removing weather effects from monochrome images[C]// Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2001, 2: 186-193.

[12](美)岡薩雷斯, (美)伍茲, (美)艾丁斯. 數(shù)字圖像處理[M]. 3版.阮秋琦,譯.北京:電子工業(yè)出版社,2012: 20-23. (GONZALEZ R C, WOODS R E, EDDINS S L. Digital Image Processing[M]. 3rd Ed. RUAN Q Q, translated. Beijing: Publishing House of Electronics Industry, 2012: 20-23.

[13]NARASIMHAN S G, NAYAR S K. Contrast restoration of weather degraded images[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(6): 713-724.

[14]吳迪,朱青松.圖像去霧的最新研究進(jìn)展[J]. 自動(dòng)化學(xué)報(bào),2015,41(2):221-239.(WU D, ZHU Q S. The latest research progress of image dehazing[J]. Acta Automatica Sinica, 2015,41(2):221-239.)