結合特征篩選與二次定位的快速壓縮跟蹤算法

耿磊 王學彬 肖志濤 張芳 吳駿 李月龍 蘇靜靜

結合特征篩選與二次定位的快速壓縮跟蹤算法

耿磊1,2王學彬1肖志濤1,2張芳1,2吳駿1,2李月龍2蘇靜靜1

針對壓縮跟蹤算法易受遮擋影響和模型更新比較盲目的問題,提出結合特征篩選與二次定位的快速壓縮跟蹤算法(Fast compressive tracking algorithm combining feature selection with secondary localization,FSSL-CT).首先,對全局區域劃分子區域,從中提取壓縮特征,根據正、負樣本估計出各個壓縮特征在正、負類中的分布;然后,使用自適應學習率結合正類更新閾值對分類器模型進行更新;最后,將跟蹤分為兩個階段,每個階段在對應的搜索區域內采集候選樣本,并從全部特征中篩選出部分優質特征加權構建分類器,通過分類候選樣本最終完成目標跟蹤.在8個公共測試序列和4個自制序列中與最近提出的兩個代表性算法進行比較,本文算法在大多數測試序列中都具有最高的跟蹤成功率和最低的平均中心誤差,平均處理速度可以達到3.04毫秒/幀.實驗結果表明,本文算法具有更好的抵抗短時遮擋的能力,更高的準確性和魯棒性,以及良好的實時性.

壓縮跟蹤,特征篩選,二次定位,分布差異,自適應更新

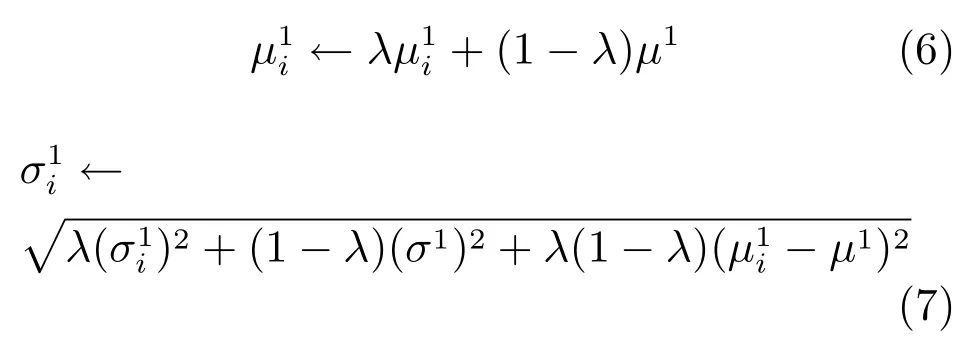

引用格式耿磊,王學彬,肖志濤,張芳,吳駿,李月龍,蘇靜靜.結合特征篩選與二次定位的快速壓縮跟蹤算法.自動化學報,2016,42(9):1421-1431

目標跟蹤在計算機視覺領域有著重要的地位和廣泛的應用,如人機交互、智能安全監控、視覺導航、軍事制導等,是近年來的熱點研究問題.傳統的目標跟蹤方法中,Comaniciu等[1]提出的MeanShift算法,利用顏色直方圖將目標跟蹤問題轉化為一個模式匹配尋優問題,但該算法對顏色變化敏感,而且無法實現運動幅度較大的目標跟蹤.因此,Bradski提出CamShift算法[2],有效克服了MeanShift算法的不足,而且在目標尺寸發生變化時,能夠自適應地調整跟蹤區域,對目標的形狀變化有一定的適應能力,在簡單背景下對單目標的跟蹤效果較好,但當目標與背景顏色相近時,跟蹤效果會變差.Kalman濾波[3]是一種最優化自回歸數據處理算法,廣泛應用于線性系統中目標的預測,但如果模型是非線性的,噪聲是非高斯白噪聲,Kalman濾波方法將不再適用.粒子濾波[4]也是一種廣為應用的跟蹤算法,可以很好地應用于非線性、非高斯模型,但容易受粒子退化現象的影響.王智靈等[5]利用蛙眼視覺特性提出了一種模糊化區域理解的運動目標跟蹤方法,該方法利用蛙眼視覺認知的生理特性和外部特性,設計了一種模糊化區域理解的運動目標跟蹤方法,在復雜背景下取得了良好的跟蹤效果,對目標外觀突變的魯棒性較好.李智勇等[6]基于蛙眼R3細胞感受野模型提出了一種運動濾波方法,利用蛙眼對目標清晰而對背景模糊的特性建立數學模型,對運動目標跟蹤效果良好.劉偉峰等[7]提出了一種基于隨機采樣的多量測目標跟蹤算法,該算法通過建立目標形狀的剛體參數模型,提出采用參數馬爾科夫鏈采樣的方法估計目標的形狀參數,并采用等效量測方法,獲得目標形心點的運動狀態.針對目標個數未知情況,在形狀目標量測滿足泊松分布假設條件下,采用泊松強度比方法獲得目標的個數估計.該方法在目標運動狀態估計方面能夠獲得比較高的估計精度,目標形狀估計能夠比較穩定精確地估計目標形狀的變化,但當目標量測個數較少時,所獲量測很難反映目標的形狀.

基于檢測的跟蹤方法是目前的研究熱點,這類方法將目標跟蹤歸結為一個二元分類問題[8],兩類分別為目標類和背景類,跟蹤是通過用分類器從背景中檢測出目標來實現的.Yang等[9]提出了一種基于超像素的跟蹤算法,該算法根據從超像素中提取的結構信息有效建模,來應對目標尺寸變化、運動、形變和遮擋等具有挑戰性的問題,實驗表明該算法能夠抵抗嚴重遮擋,并在漂移后重新定位目標.但該算法使用了簡單的HSI顏色特征,可以尋求更好的特征提高算法性能.Collins等[10]提出一種基于AdaBoost的在線特征選擇方法,利用在線選擇器選擇最優的顏色特征,再用一個正采樣及少量負采樣來更新分類器,最后達到改善跟蹤效果的目的.但該方法是一種自學習方法,分類器很容易受到噪聲的影響,而且上一幀的跟蹤結果會直接影響到后續處理,容易因累積誤差而導致跟蹤漂移.Babenko等[11]提出了多示例學習跟蹤算法,該算法的訓練樣本以樣本包的形式出現,把有歧義的所有正樣本和負樣本放入包中,樣本的標簽賦給樣本包,并學習鑒別模型,可以實時地訓練具有判決性的分類器,分離前景與背景.當目標被遮擋或者跟蹤出現誤差時,可以通過在線學習在正樣本包中找到較準確的正樣本來更新分類器.但是,該算法的自適應外觀模型都是數據依賴的,而在學習開始時,并沒有充足的數據提供給在線算法,而且如果目標發生嚴重遮擋,分類器更新時仍然會受到遮擋區域的影響,最終因誤差積累而導致跟蹤漂移.

目前,稀疏表示已經成功應用在目標跟蹤領域.Zhang等[12]在粒子濾波框架下提出魯棒的多任務稀疏學習跟蹤算法,將每個粒子的學習作為一個單獨的任務,對嚴重遮擋、劇烈的光照變化和姿態變化有很好的跟蹤效果.Zhong等[13]利用全局模板和局部特征建立稀疏協同模型,能夠有效地處理外觀變化引起的跟蹤漂移.Wang等[14]利用PCA(Principal component analysis)結合稀疏表示提出一種稀疏模型,為了削弱跟蹤漂移,在模型更新時將遮擋和運動模糊因素考慮其中.

Zhang等[15]提出了一種基于壓縮感知理論的實時壓縮跟蹤(Compressive tracking,CT)算法,該算法利用壓縮感知理論提取目標特征,用在線更新的樸素貝葉斯分類器對目標和背景分類,實現了對目標的快速跟蹤.但該算法存在一些缺陷.

首先,壓縮特征的隨機性較強,影響分類器的分類準確性.為此,石武禎等[16]根據特征的正負類條件概率分布的距離,選擇能有效區分目標與背景的特征,構建出更加穩定的分類器.毛征等[17]對樣本劃分子區域,并從中選取置信度高的特征構建分類器,提高分類準確性.

其次,壓縮特征的分布使用固定學習率進行更新,比較盲目,容易引入噪聲,影響抗遮擋性能.鐘權等[18]對相鄰兩幀之間目標的直方圖進行相似性度量,根據相似度動態調整學習率,但更新參數時目標和背景采用相同的學習率,用目標的變化來調整背景的學習率,顯然會影響背景模型對背景的準確表達.羅會蘭等[19]做了進一步改進,采用一種非線性的雙S形函數作為學習率,對目標和背景的每個特征,自適應調節其分布更新時學習速率的大小,當分類器分類錯誤時,可以迅速降低學習當前幀特征分布的速率,防止噪聲對分類準確性的影響.這種方法雖然在目標發生較大變化時迅速降低了其分布模型的更新速率,但仍然會更新,使分布模型隨遮擋時間的長短引入不同程度的噪聲,影響分類結果.而且對于背景變化較大的情況,應該提高而不是降低當前幀分布模型的更新速率,使其能夠時刻反映真實的背景分布.

最后,跟蹤階段用分類器檢測采樣區域內的所有樣本,計算量較大.Zhang等[20]將跟蹤分為兩個階段,每個階段用不同的采樣間隔在不同大小的采樣區域內采集樣本,以減少計算量.而鐘權等[18]則是采集采樣區域的所有樣本,先隨機選取1/5特征構建分類器,篩選出1/3的候選樣本,再用全部特征構建分類器,通過檢測篩選出的1/3候選樣本得到跟蹤目標.兩篇文獻都采用了粗精跟蹤的策略,但在構建分類器時,并不是所有的壓縮特征都具有較好的區分正、負樣本的效果,如果將分類效果差的特征也加入分類器中,會對分類造成不良影響.

針對二元分類的單目標跟蹤問題,本文提出一種結合特征篩選與二次定位的快速壓縮跟蹤算法(Fast compressive tracking algorithm combining feature selection with secondary localization,FSSL-CT).采用劃分子區域的方法分散特征,提高抗遮擋性能.對正、負類中的特征分布,用自適應學習率更新,使更新后的分布更能反映正、負類中特征的真實分布,保證分類器分類的準確性.在更新正類中特征的分布時設定更新閾值,當兩幀間的特征分布變化較大時不做更新,徹底避免噪聲被引入,保證被遮擋的目標重新出現后,分類器能對其重新正確定位.在跟蹤的不同階段,采用不同的采樣半徑和采樣間隔采集樣本,從所有特征中篩選出不同數量的優質特征加權構建分類器,以有效地提高跟蹤速度.

1 壓縮跟蹤算法

1.1基于壓縮感知的多尺度特征壓縮提取

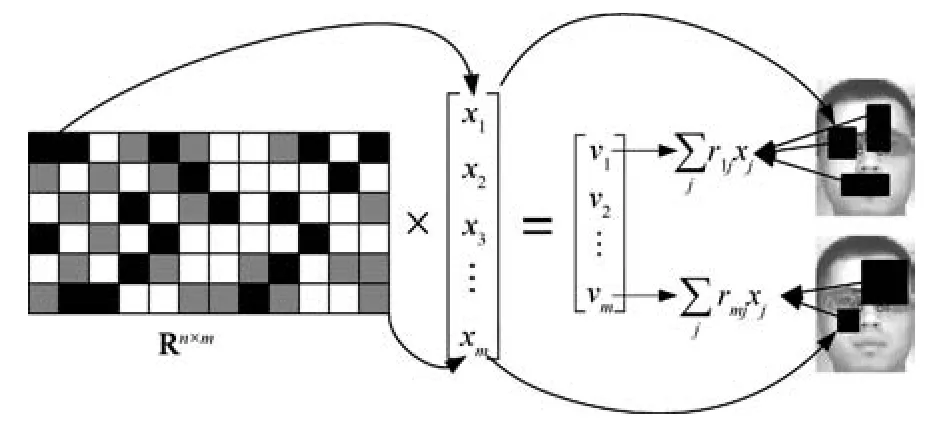

壓縮感知理論指出:對于稀疏信號,可以用一個滿足壓縮等距性(Restricted isometry property,RIP)條件的隨機測量矩陣對其進行隨機采樣,采樣后的信號幾乎保留了原始信號的所有信息.而自然圖像就是稀疏的.CT算法正是應用這一理論對高維的圖像特征進行壓縮,有效地實現了對多尺度特征的降維.降維過程如圖1所示.

圖1 降維示意圖Fig.1The diagram of dimensionality reduction

對于一個樣本圖像Z∈Rw×h其多尺度特征可以通過與一系列不同尺度的矩形濾波器Fi,j卷積得到,Fi,j定義如下:

其中,1≤x≤w和1≤y≤h是矩形濾波器的寬度和高度.

由式(1)可知,樣本圖像的多尺度特征是用w×h個矩形濾波器對其濾波得到的.為了方便降維處理,將每個矩形濾波器的濾波結果都表示為一個維度為w×h的列向量,那么最后樣本圖像特征的高維向量就可以用列向量表示,其維度為m=(wh)2,典型值為106~1010.

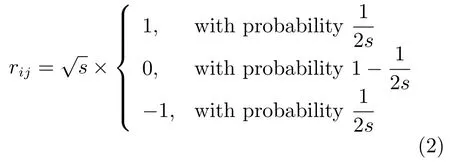

滿足RIP條件的典型的測量矩陣是隨機高斯矩陣,但隨機高斯矩陣很密集,當高維特征的維數很高時,其存儲和計算量都非常大.因此,CT算法中采用一種非常稀疏的矩陣,定義如下:

上述隨機測量矩陣能夠通過隨機數發生器獲得,當s=O(m)時,此矩陣幾乎能夠與隨機高斯矩陣同樣準確,且每一行最多只有4個非零值需要計算,能在很大程度上降低所需的存儲空間,提高算法速度.根據壓縮感知理論,高維特征通過式(2)降到低維,即可得到壓縮特征.

1.2基于樸素貝葉斯分類器的目標檢測

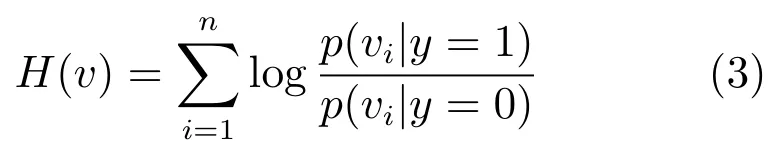

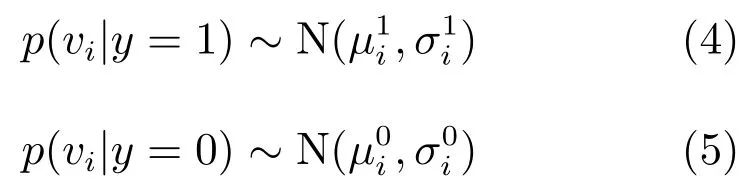

CT算法使用簡單的樸素貝葉斯分類器來建模,為此,需要假設每一個樣本圖像Z∈Rw×h的低維特征向量中的每個向量都是彼此獨立的,且每個樣本是目標和背景的概率相同,則分類器模型如下:

其中,y∈{0,1}為樣本標記,y=1代表正樣本,即目標,y=0代表負樣本,即背景.

壓縮特征的提取就是特征由高維向低維的隨機映射過程,而高維隨機特征的隨機映射幾乎總是服從高斯分布,據此,假設H(v)中的條件分布p(vi|y=1)和p(vi|y=0)都服從高斯分布,即:

跟蹤階段,根據上一幀目標的位置,在半徑為γ的圓形區域內采集與目標大小相同的所有樣本,提取壓縮特征,并用樸素貝葉斯分類器檢測各個樣本,分類器響應最大的樣本即認為是所要跟蹤的目標.

2 特征篩選與二次定位

CT算法中假設壓縮特征服從高斯分布,由于目標和背景存在一定的差異,使特征在正、負類中服從不同的高斯分布.樸素貝葉斯分類器正是利用這種差異來分類的,因此,特征在正、負類中分布差異的大小直接決定了該特征分類能力的強弱.顯然,差異越大,分類能力越強;差異越小,分類能力越弱.

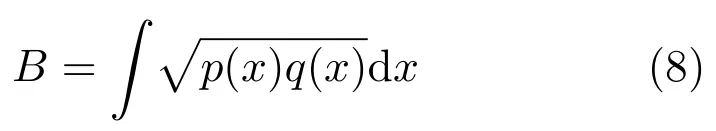

本文采用Bhattacharyya系數[21](以下簡稱巴氏系數)來度量正負類之間特征分布的差異.對于連續分布,其表達式為

其中,B∈[0,1],表示兩個分布之間的重疊度,值越大,表示兩個分布重疊越大,差異越小,對應特征的分類能力也就越弱,當B=1時,兩個分布完全重合;反之,B值越小,表示兩個分布重疊越小,差異越大,對應特征的分類能力則越強.B與分布之間的關系如圖2所示,隨著壓縮特征v1、v2、v3在正、負類中的分布差異逐漸增大,B值越來越小.

2.1劃分子區域

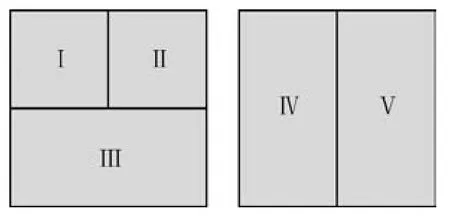

在CT算法中,每個特征都是在全局區域內提取的,當目標被遮擋時,即使是較小區域的遮擋,也可能會有大量的特征受到影響,隨之引入的跟蹤誤差經過不斷積累,會影響后續跟蹤的準確性.為此,本文采取一種基于子區域的特征提取方法.該方法將全局區域劃分為5個子區域,在每個子區域內提取壓縮特征,保證在目標出現較小區域遮擋的情況下,只有被遮擋子區域內的部分特征受到影響,避免因為大量特征受到影響而發生跟蹤漂移.劃分子區域的模板如圖3所示.

圖2 B與分布的關系Fig.2Relationship between B and distribution

圖3 子區域模板Fig.3Sub-region template

2.2自適應學習率與更新閾值

由式(3)可以看出,樸素貝葉斯分類器由若干個分量相加組成,而每個分量都是一個特征在正、負類中分布的概率密度的比值取對數,因此,可以把每個分量看做是一個弱分類器,那么每個弱分類器都對應一個特征.所以樸素貝葉斯分類器的更新就是各個弱分類器的更新,而弱分類器的更新對應特征在正、負類中分布的更新.

CT算法中,分類器參數更新存在兩點不足:1)采用固定學習率更新正、負類中每個特征的分布.同一特征每次在相鄰兩幀之間分布的變化是不同的,在相同的兩幀之間,各個特征的分布變化也是不同的,采用固定學習率很難保證更新后的特征分布能夠有效反映其真實分布,當二者不匹配時,分類器的性能就會下降;2)對正類的所有特征分布都更新.目標跟蹤過程中經常會遇到遮擋的情況,雖然已經劃分了子區域,但當目標被遮擋的區域很大時,仍然會使絕大多數的特征受到影響,此時若繼續更新這些特征的分布,就會使分類器將遮擋物體誤認為是目標,當遮擋物體與目標分離時,跟蹤窗口也會隨之偏離真實的目標.

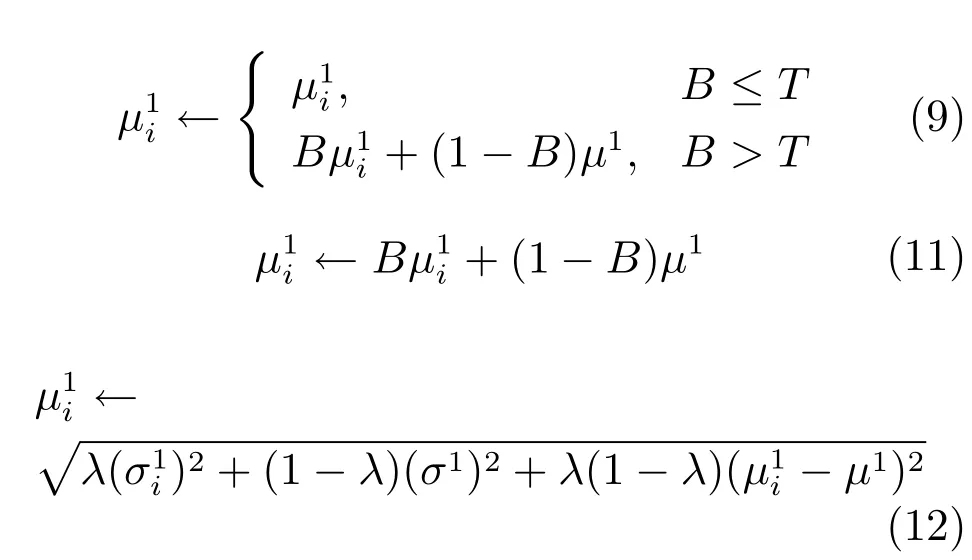

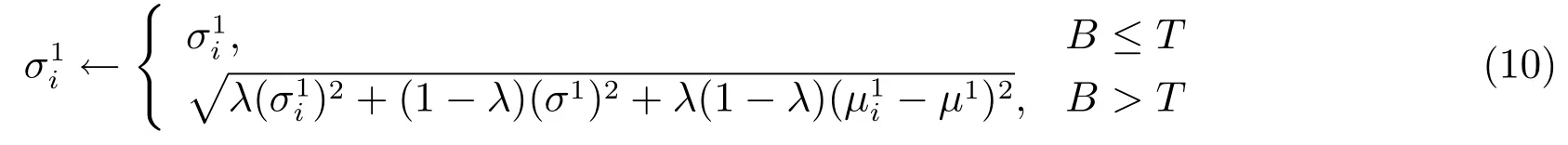

本文提出一種基于自適應學習率和正類更新閾值的策略,將相鄰兩幀之間特征的B值作為更新其分布的學習率,直接更新負類.考慮到遮擋因素的影響,對正類設定一個更新閾值T,只有當B>T時,才更新正類的特征分布,否則保持原有分布不變.特征分布的更新公式如下:

2.3基于加權特征篩選的分類器構建

在構建分類器方面,CT算法存在兩點不足:1)始終用全部壓縮特征來構建分類器,而某些特征對分類的貢獻很小,這樣就增加分類器的計算量;2)構建分類器的所有特征的權值都為1,由于不同特征的分類能力不同,所以采用相同權重無法突出具有較強區分力的特征的重要性.

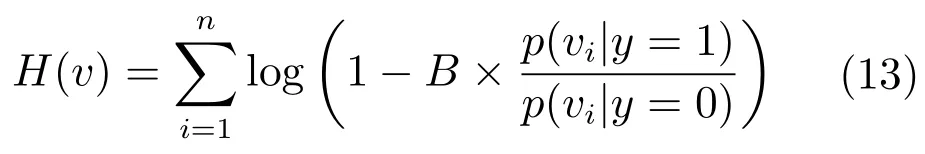

本文在構建分類器時,利用巴氏系數度量正、負類特征分布間的相似性,相似性越小的特征分類效果越好.根據跟蹤階段的需要,從所有特征中篩選出部分優質特征,根據相應的巴氏系數加權構建分類器,使構建出的分類器可以依據權值對各個弱分類器反饋的分類信息區分對待,有效提升自身的分類能力.分類器模型如下:

2.4基于二次定位的跟蹤策略

在跟蹤階段,原CT算法在以上一幀目標為中心的圓形區域內,通過滑動窗口采集該區域與目標大小相同的所有樣本,再用分類器對這些樣本逐一檢測,得到跟蹤目標.這種方法需要檢測的樣本數量較多,會消耗大量的時間.特別是當目標快速移動時,如果搜索半徑設置的過小,會發生跟蹤漂移,如果設置的過大,則會消耗更多的時間.

本文提出一種基于二次定位的跟蹤策略,如圖4所示,該策略分為兩個過程:首先根據上一幀得到的目標gt的位置,在半徑為γ1的圓形區域內用大于1的采樣間隔Δ1等間隔采樣,得到樣本集A1,選取2/5分類能力強的特征構建分類器檢測A1,找出最有可能是目標的樣本S;再根據S的位置,采集半徑為γ2(γ2<γ1)的圓形區域內的所有樣本,得到樣本集A2,選取分類能力較好的4/5特征構建分類器檢測A2,得到最終的跟蹤目標gt+1,完成跟蹤.

2.5算法流程

輸入.正樣本采樣半徑γp,負樣本采樣半徑γN-I、γN-O,跟蹤搜索半徑γ1、γ2,視頻第t幀圖像,第t-1幀圖像中的目標位置It-1.

輸出.第t幀圖像中目標的位置It.

1)采集樣本集A1={s|‖I(s)-It-1‖<γ1},提取壓縮特征F;

2)篩選出2/5優質特征,根據式(13)構建分類器H1,檢測出A1中使H1響應值最大的樣本s1;

3)采集樣本集A2={s|‖I(s)-Is1‖<γ2},提取壓縮特征F;

4)篩選出2/5優質特征,根據式(13)構建分類器H2,檢測出A2中使H2響應值最大的樣本s2,It=s2;

圖4 二次定位示意圖Fig.4The diagram of secondary localization

5)采集正樣本集AP={s|‖It-Is‖<γP}和負樣本集AN={s|γN-I<‖It-Is‖<γN-O},提取壓縮特征F,計算特征在正、負類中的分布PP和PN;

6)根據式(8)~(12)更新PPi和PNi.

3 實驗結果及分析

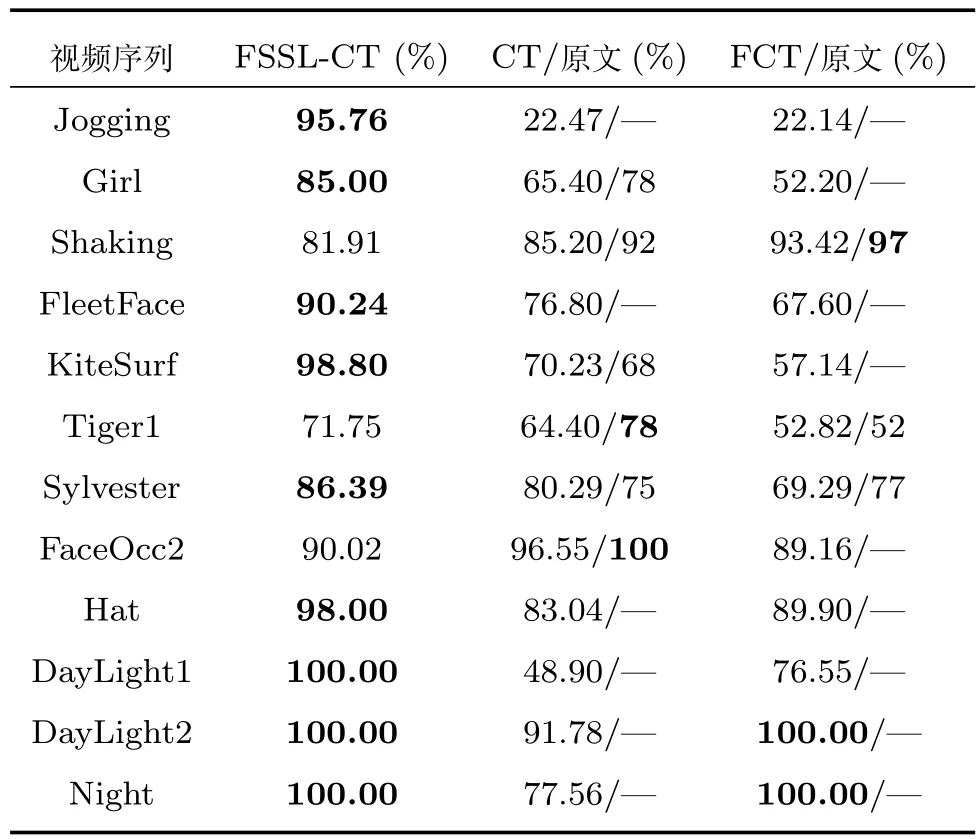

為了驗證本文算法的性能,選取8個公共測試序列[22]和4個自制的紅外測試序列進行結果驗證,這些序列包含光照變化、遮擋和姿態變化等具有挑戰性的因素.本文算法主要應用于駕駛員的臉部跟蹤,因此,根據駕駛員疲勞檢測項目的需要,加入了紅外視頻的測試序列.在所有測試序列中,將本文算法與CT和FCT(Fast compressive tracking)算法進行比較.實驗環境為Intel Core i3雙核處理器,2.53GHz主頻,3GB內存,Windows 7操作系統,開發平臺為VS2010+opencv2.4.9.由于CT[15]和FCT[20]在文獻中給出的參數和在源程序中給出的配置參數不完全相同,所以選取其中效果較好的參數.各算法在每個測試序列上都運行10次,最后取平均值.

3.1準確性比較

成功率是評價算法準確性的重要標準之一.在判斷每一幀是否跟蹤成功時,本文采用文獻[23]中使用的判定準則,其定義如下:

其中,T為跟蹤結果區域,G為目標的實際區域,S為準則的判定值.若S>0.5,則認為跟蹤成功;否則,認為跟蹤失敗,并根據跟蹤成功的幀數與總幀數的比值得到跟蹤的成功率.各個算法在不同測試視頻中的跟蹤成功率如表1所示,每種視頻序列中最高的成功率用粗體標注.從表1中可以看出,FSSLCT算法在大多數的測試序列中跟蹤成功率都是最高的.

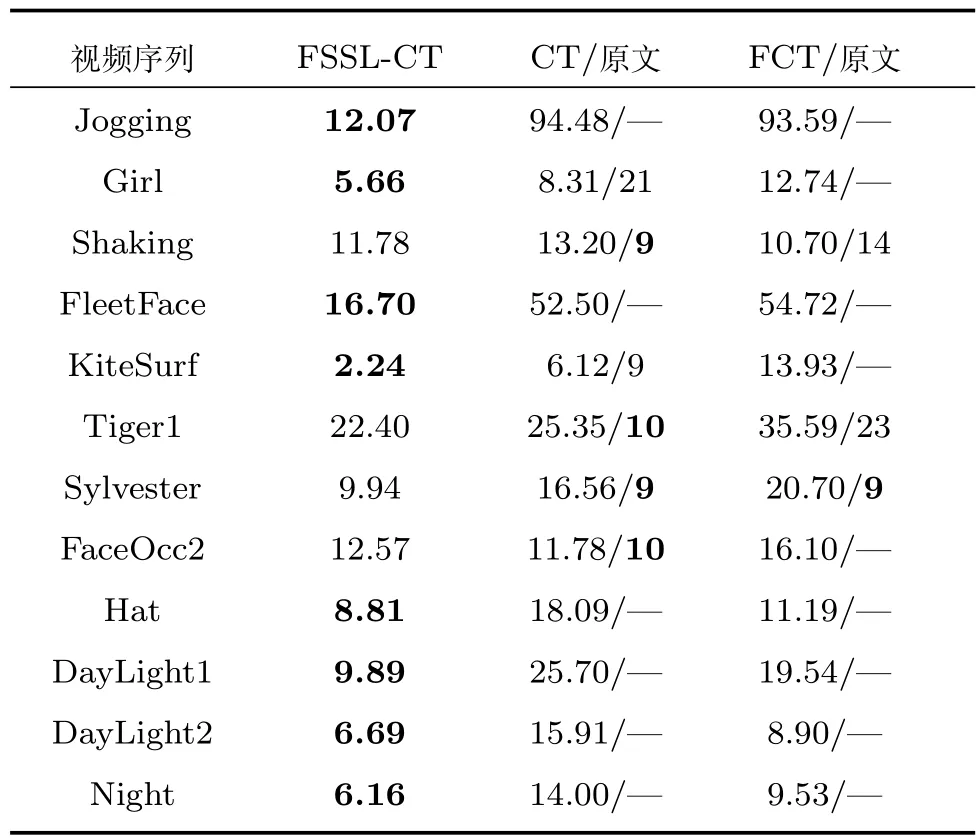

中心位置誤差是評價跟蹤算法準確性的另外一個準則.它表示跟蹤算法得到的目標中心和目標實際中心位置之間的像素的距離,本文采用歐氏距離.各測試序列中算法的平均中心誤差如表2所示,最小平均中心誤差已用粗體標注.

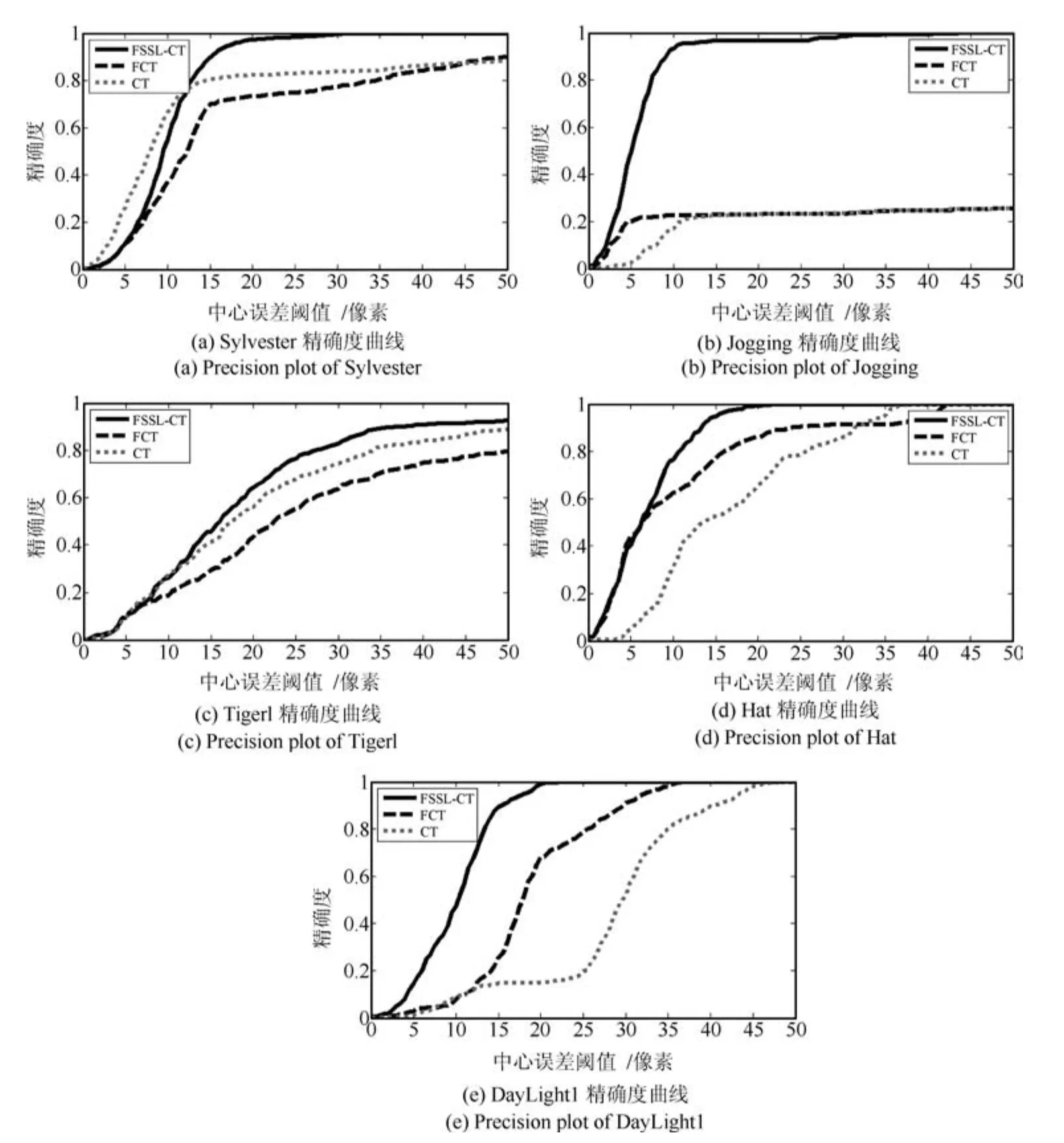

為了進一步體現各個算法的性能,本文給出了部分測試序列的精確度曲線[22],如圖5所示,它表示跟蹤目標與真實目標中心間的歐氏距離在某一閾值范圍內的幀數的百分比,反映了算法在不同閾值下的性能.如在圖5(a)中,當閾值小于12時,CT算法的性能優于FSSL-CT算法,而當閾值大于12時,FSSL-CT算法的性能更優,在圖5(b)~(e)中,FSSL-CT算法幾乎在每個閾值下的性能都優于其他兩種算法.

表1 各算法跟蹤成功率比較Table 1Comparison of the tracking success rate of different algorithms

表2 各算法平均中心誤差比較(像素)Table 2Comparison of mean center error of different algorithms(pixel)

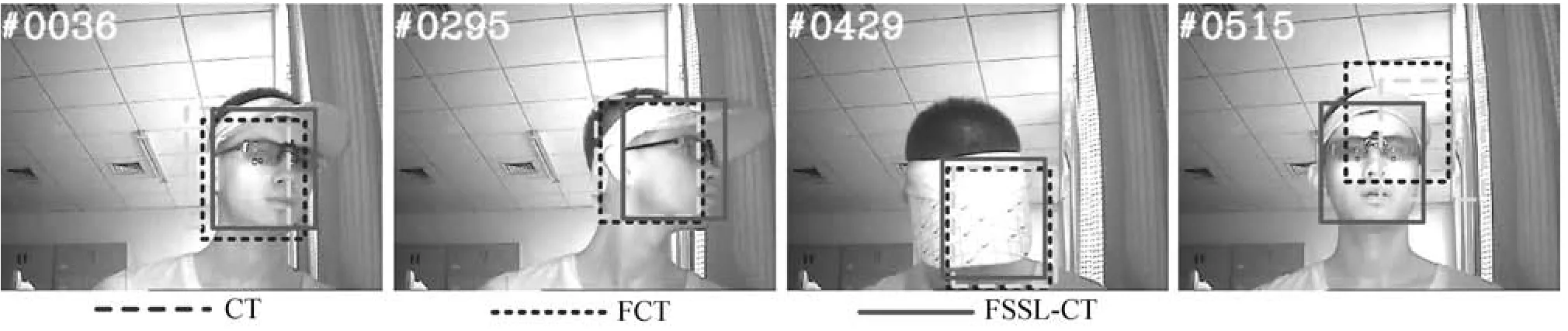

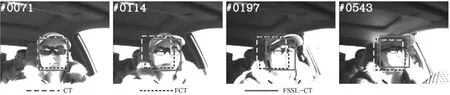

各個算法的跟蹤效果如圖6~圖10所示,CT、FCT和FSSL-CT算法分別用不同線型的矩形框表示,并已在圖中下方注釋.

如圖6第697、1184、1236幀,圖8第64、315幀以及圖10第114、197、543幀,在目標受到光照變化、快速運動等因素的影響時,FSSL-CT算法因為采用自適應學習率,可以根據模型在相鄰兩幀之間的變化來調節模型的更新速度;而CT算法和FCT算法使用固定學習率,致使模型無論變化快慢,都以恒定的速度進行更新,更新較為盲目,影響了算法性能.從圖中可以看出,FSSL-CT算法取得了較好的跟蹤效果,具有一定的跟蹤穩定性.

圖5 精確度曲線Fig.5Precision plot

圖6 Sylvester(第4、697、1184、1236幀)Fig.6Sylvester(Frames 4、697、1184、1236)

在FSSL-CT算法中,子區域的劃分和正類中特征分布更新閾值的設定,在很大程度上增強了算法抗遮擋的性能.如圖7第53幀和第79幀,由于跑步者被完全遮擋后仍然保持移動,導致三種算法在嚴重干擾下暫時未能跟蹤到目標;此時,FSSL-CT通過正類閾值限制了目標模型的更新,而CT和FCT算法始終在對目標模型進行更新,所以當目標重新出現后,FSSL-CT能重新定位目標,而其他兩種算法由于目標模型的誤差積累而導致跟蹤失敗.如圖8第115幀和圖9第515幀,同樣是目標受到遮擋的影響,相比其他兩種算法,FSSL-CT仍然能夠較好地跟蹤目標.

圖7 Jogging(第53、78、79、231幀)Fig.7Jogging(Frames 53、78、79、231)

圖8 Tiger1(第7、64、115、315幀)Fig.8Tiger1(Frames 7、64、115、315)

圖9 Hat(第36、295、429、515幀)Fig.9Hat(Frames 36、295、429、515)

圖10 DayLight1(第71、114、197、543幀)Fig.10DayLight1(Frames 71、114、197、543)

3.2算法速度比較

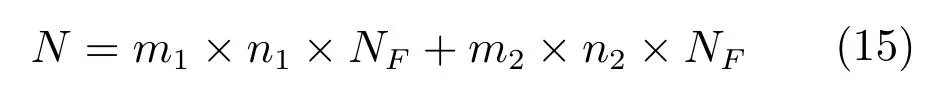

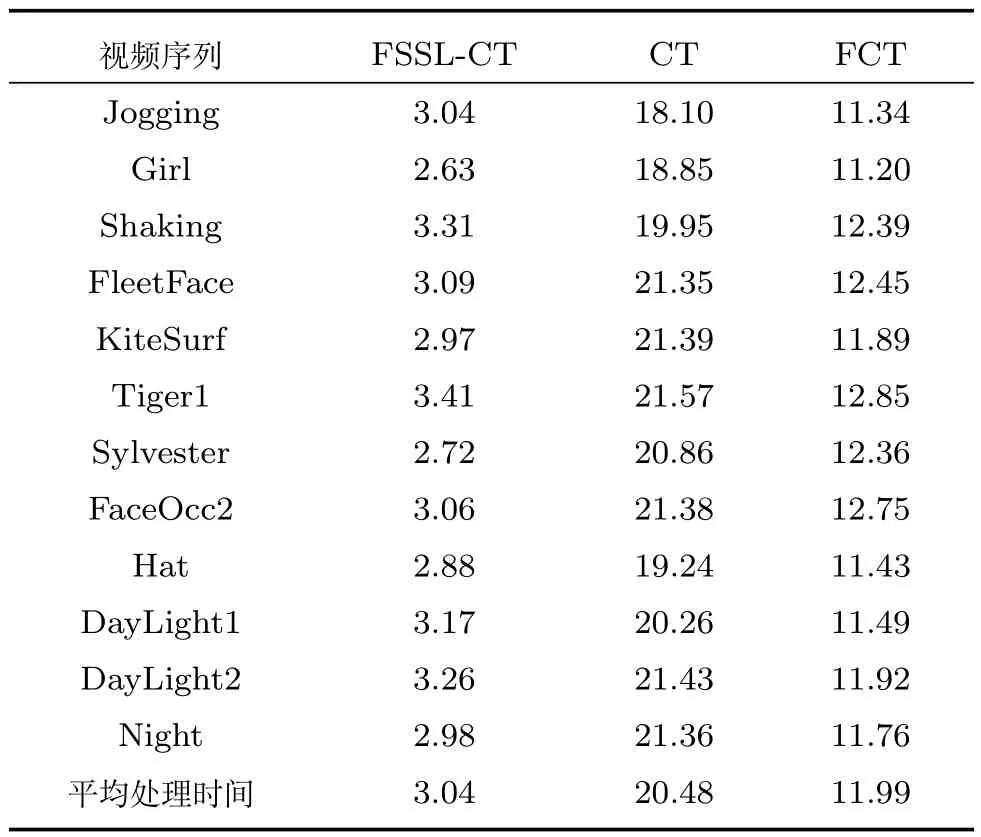

FSSL-CT與CT和FCT在算法復雜度上的差別主要體現在跟蹤階段對候選樣本的檢測部分,該部分的計算次數:其中,m1和n1是第一次定位時的候選樣本數和特征數,m2和n2是第二次定位時的候選樣本數和特征數,NF是分類其中每個特征對應部分所需要的計算次數.三種算法的計算次數如表3所示.

表3 各算法計算次數及相關參數(次)Table 3Calculation times and related parameters of different algorithms(times)

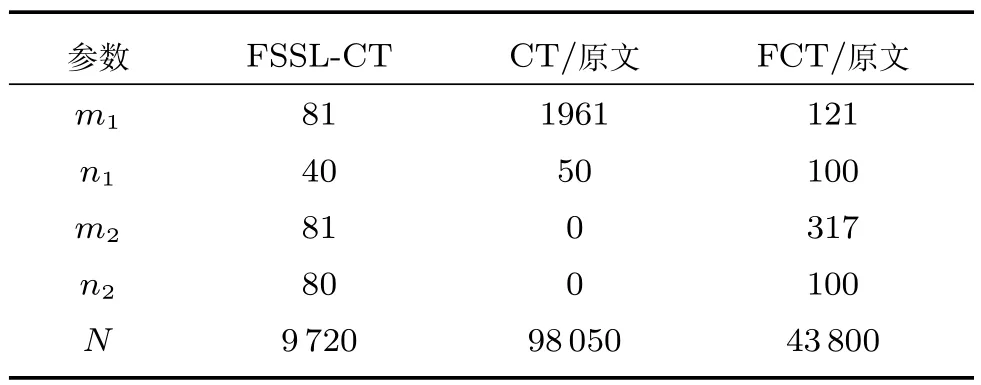

為了直觀地比較各個算法的運行速度,對每個視頻序列測試10次,得出每一幀的平均處理時間,實驗結果如表4所示,FSSL-CT算法對12個測試視頻序列的的平均處理時間能夠達到3.04毫秒/幀.

表4 各算法運行速度比較(毫秒/幀)Table 4Comparison of operation speed of different algorithms(ms/frame)

4 總結

本文提出一種基于特征篩選與二次定位的快速壓縮跟蹤算法(FSSL-CT).針對短時遮擋問題,對每個樣本劃分子區域,從各個子區域中提取壓縮特征,根據正、負樣本集估計出特征在正、負類中的分布,用相鄰兩幀之間特征分布的差異作為學習率,更新特征分布,并對正類設定更新閾值,滿足閾值要求時才更新相應的特征分布.針對跟蹤階段需要檢測的樣本較多的問題,采用一種基于二次定位的跟蹤策略.首次定位采集樣本的圓形區域半徑較大,用大于1的間隔在此區域內等間隔采樣,并用分類器得到其中的最優目標.再以此目標為中心采集較小半徑的圓形范圍內的所有樣本,進行二次定位,用分類器得到最終的跟蹤目標.實驗結果表明,FSSL-CT算法的準確性、穩定性和抗遮擋能力更好,平均處理速度為3.04毫秒/幀,能夠實現實時跟蹤.與原始CT算法一樣,由于跟蹤窗口的尺度依賴于初始化目標,跟蹤時無法根據目標的變化而自適應調整窗口,使得FSSL-CT算法對于尺度發生較大變化的目標跟蹤效果欠佳,這將是本文后續研究的重點.

References

1 Comaniciu D,Ramesh V,Meer P.Kernel-based object tracking.IEEE Transactions on Pattern Analysis and Machine Intelligence,2003,25(5):564-577

2 Bradski G R.Real time face and object tracking as a component of a perceptual user interface.In:Proceedings of the 4th IEEE Workshop on Applications of Computer Vision. Princeton,USA:IEEE,1998.214-219

3 Huang S L,Hong J X.Moving object tracking system based on camshift and Kalman filter.In:Proceedings of the 2011 International Conference on Consumer Electronics,Communications and Networks.Xianning,China:IEEE,2011. 1423-1426

4 Vadakkepat P,Liu J.Improved particle filter in sensor fusion for tracking randomly moving object.IEEE Transactions on Instrumentation and Measurement,2006,55(5):1823-1832

5 Wang Zhi-Ling,Chen Zong-Hai,Xu Xiao-Xiao,Wu Liang.A fuzzy region understanding tactic for object tracking based on frog's vision characteristic.Acta Automatica Sinica,2009,35(8):1048-1054(王智靈,陳宗海,徐蕭蕭,吳亮.基于蛙眼視覺特性的運動目標模糊化區域理解跟蹤方法.自動化學報,2009,35(8):1048-1054)

6 Li Zhi-Yong,He Shuang,Liu Jun-Min,Li Ren-Fa.Motion filtering by modelling R3 cell's receptive field in frog eyes. Acta Automatica Sinica,2015,41(5):981-990(李智勇,何霜,劉俊敏,李仁發.基于蛙眼R3細胞感受野模型的運動濾波方法.自動化學報,2015,41(5):981-990)

7 LiuWei-Feng,ChaiZhong,WenCheng-Lin.Multimeasurement target tracking by using random sampling approach.Acta Automatica Sinica,2013,39(2):168-178(劉偉峰,柴中,文成林.基于隨機采樣的多量測目標跟蹤算法.自動化學報,2013,39(2):168-178)

8 Avidan S.Support vector tracking.IEEE Transactions on Pattern Analysis and Machine Intelligence,2004,26(8):1064-1072

9 Yang F,Lu H C,Yang M H.Robust superpixel tracking.IEEE Transactions on Image Processing,2014,23(4):1639-1651

10 Collins R T,Liu Y X,Leordeanu M.Online selection of discriminative tracking features.IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(10):1631-1643

11 Babenko B,Yang M H,Belongie S.Robust object tracking with online multiple instance learning.IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33(8):1619-1632

12 Zhang T Z,Ghanem B,Liu S,Ahuja N.Robust visual tracking via multi-task sparse learning.In:Proceedings of the 2012 IEEE Conference on Computer Vision and Pattern Recognition.Providence,USA:IEEE,2012.2042-2049

13 Zhong W,Lu H C,Yang M H.Robust object tracking via sparse collaborative appearance model.IEEE Transactions on Image Processing,2014,23(5):2356-2368

14 Wang D,Lu H C,Yang M H.Online object tracking with sparse prototypes.IEEE Transactions on Image Processing,2013,22(1):314-325

15 Zhang K H,Zhang L,Yang M H.Real-time compressive tracking.In:Proceedings of the 2012 European Conference on Computer Vision.Florence,Italy:Springer Berlin Heidelberg,2012.864-877

16 Shi Wu-Zhen,Ning Ji-Feng,Yan Yong-Feng.Feature selection and target model updating in compressive tracking. Journal of Image and Graphics,2014,19(6):932-939(石武禎,寧紀鋒,顏永豐.壓縮感知跟蹤中的特征選擇與目標模型更新.中國圖象圖形學報,2014,19(6):932-939)

17 Mao Zheng,Yuan Jian-Jian,Wu Zhen-Rong,Qu Jin-Song,Li Hong-Yan.Real-time compressive tracking based on online feature selection.Optics and Precision Engineering,2014,22(3):730-736(毛征,袁建建,吳珍榮,曲勁松,李紅巖.基于在線特征選擇的實時壓縮跟蹤.光學精密工程,2014,22(3):730-736)

18 Zhong Quan,Zhou Jin,Wu Qin-Zhang,Wang Hui,Lei Tao.An improved real-time compressive tracking.Opto-Electronic Engineering,2014,41(4):1-8(鐘權,周進,吳欽章,王輝,雷濤.一種改進的實時壓縮跟蹤算法.光電工程,2014,41(4):1-8)

19 Luo Hui-Lan,Zhong Bao-Kang,Kong Fan-Sheng.Object tracking algorithm by combining the predicted target position with compressive tracking.Journal of Image and Graphics,2014,19(6):875-885(羅會蘭,鐘寶康,孔繁勝.結合目標預測位置的壓縮跟蹤.中國圖象圖形學報,2014,19(6):875-885)

20 Zhang K H,Zhang L,Yang M H.Fast compressive tracking.IEEE Transactions on Pattern Analysis and Machine Intelligence,2014,36(10):2002-2015

21 Comaniciu D,Ramesh V,Meer P.Real-time tracking of nonrigid objects using mean shift.In:Proceedings of the 2000 IEEE Conference on Computer Vision and Pattern Recognition.Hilton Head Island,USA:IEEE,2000,2:142-149

22 Wu Y,Lim J,Yang M H.Online object tracking:a benchmark.In:Proceedings of the 2013 IEEE Conference on Computer Vision and Pattern Recognition.Portland,USA:IEEE,2013.2411-2418

23 Everingham M,Van Gool L,Williams C L I,Winn J,Zisserman A.The pascal visual object classes(VOC)challenge. International Journal of Computer Vision,2010,88(2):303-338

耿磊天津工業大學電子與信息工程學院副教授.2012年獲得天津大學精密儀器與光電子工程學院博士學位.主要研究方向為圖像處理與模式識別,智能信號處理技術與系統,DSP系統研發.

E-mail:genglei@tjpu.edu.cn

(GENG LeiAssociate professor at the School of Electronics and Information Engineering,Tianjin Polytechnic University.He received his Ph.D.degree from the School of Precision Instrument and Opto-Electronics Engineering,Tianjin University in 2012.His research interest covers image processing and pattern recognition,intelligent signal processing technology and system,DSP system research and development.)

王學彬天津工業大學電子信息與工程學院碩士研究生.2013年獲得天津工業大學電子信息工程專業學士學位.主要研究方向為模式識別,機器學習.

E-mail:wangxuebin2014@sina.com

(WANG Xue-BinMaster student at the School of Electronics and Information Engineering,Tianjin Polytechnic University.He received his bachelor degree from the School of Electronics and Information Engineering,Tianjin Polytechnic University in 2013.His research interest covers pattern recognition and machine learning.)

肖志濤天津工業大學電子與信息工程學院教授.2003年獲得天津大學電子信息工程學院博士學位.主要研究方向為智能信號處理,圖像處理與模式識別.本文通信作者.

E-mail:xiaozhitao@tjpu.edu.cn

(XIAO Zhi-TaoProfessor at the School of Electronics and Information Engineering,Tianjin Polytechnic University.He received his Ph.D.degree from the School of Electronics and Information Engineering,Tianjin University in 2003.His research interest covers intelligent signal processing,imageprocessing and pattern recognition.Corresponding author of this paper.)

張芳天津工業大學電子與信息工程學院副教授.2009年獲得天津大學精密儀器與光電子工程學院博士學位.主要研究方向為圖像處理與模式識別,光學干涉測量技術.

E-mail:hhzhangfang@126.com

(ZHANG FangAssociate professor at the School of Electronics and Information Engineering,Tianjin Polytechnic University.She received her Ph.D.degree from the School of Precision Instrument and Opto-Electronics Engineering,Tianjin University in 2009.Her research interest covers image processing and pattern recognition,and optical interference measurement technique.)

吳駿天津工業大學電子與信息工程學院副教授.2007年獲得天津大學電子信息工程學院博士學位.主要研究方向為圖像處理與模式識別,人工神經網絡.

E-mail:zhenkongwujun@163.com

(WU JunAssociate professor at the School of Electronics and Information Engineering,Tianjin Polytechnic University.He received his Ph.D.degree from the School of Electronics and Information Engineering,Tianjin University in 2007.His research interest covers image processing and pattern recognition,and artificial neural network.)

李月龍天津工業大學計算機科學與軟件學院副教授.2012年獲得北京大學信息科學技術學院計算機專業博士學位,2015年英國約克大學公派訪問學者.主要研究方向為計算機視覺,模式識別,輪廓提取,人臉識別.

E-mail:liyuelong@pku.edu.cn

(LI Yue-LongAssociate professor at the School of Computer Science and Software Engineering,Tianjin Polytechnic University.He received his Ph.D. degree in computer science from the School of Electronics Engineering and Computer Science,Peking University in 2012.He was an academic visitor in the University of York in 2015.His research interest covers computer vision,pattern recognition,shape extraction,and face recognition.)

蘇靜靜天津工業大學碩士研究生. 2014年獲得北華航天工業學院電子與信息工程專業學士學位.主要研究方向為模式識別,機器學習.

E-mail:1065250074@qq.com

(SU Jing-JingMaster student at the School of Electronics and Information Engineering,Tianjin Polytechnic University.She received her bachelor degree from North China Institute of Aerospace Engineering in 2014.Her research interest covers pattern recognition,and machine learning.)

Manuscript October 8,2015;accepted January 23,2016

Fast Compressive Tracking Algorithm Combining Feature Selection with Secondary Localization

GENG Lei1,2WANG Xue-Bin1XIAO Zhi-Tao1,2ZHANG Fang1,2WU Jun1,2LI Yue-Long2SU Jing-Jing1

As the traditional compressive tracking algorithm fails to track targets stably under occlusive condition and update model accurately,a fast tracking algorithm combining feature selection with secondary localization based on compressive tracking(FSSL-CT)is proposed.Firstly,compressive features are extracted from sub-regions partitioned from the global region,and the distributions of each compressive feature in positive and negative classes are estimated.Secondly,the classifier model is updated utilizing the method of adaptive learning rate and positive class update threshold.Finally,the tracking stage is divided into two procedures.In each procedure,some candidate samples are collected in the given searching region,and partial high quality features are selected from all the features and weighted to construct a classifier,then,the candidate samples are classified by the classifier.After that,the target tracking is achieved.Compared with two state-of-the-art algorithms on 8 public testing sequences and 4 private sequences,the FSSL-CT algorithm is proved to have the highest tracking success ratio and the lowest average central error in most of the sequences,and the average processing speed could achieve 3.04 milliseconds per frame.It is tested that the proposed FSSL-CT algorithm has a better capacity of resisting short-time occlusion and running in real-time,higher accuracy and robustness than the two state-of-the-art algorithms.

Compressive tracking,feature select,secondary localization,distribution difference,adaptive update

10.16383/j.aas.2016.c150603

2015-10-08錄用日期2016-01-23

國家自然科學基金(61302127),高等學校博士學科點專項科研基金(20131201110001),天津市科技支撐計劃重點項目(14ZCZDGX00033)資助

Supported by National Natural Science Foundation of China(61302127),Specialized Research Fund for the Poctoral Program of Higher Education of China(20131201110001),Key Projects of Tianjin Science and Technology Support Program(14ZCZDGX00033)

本文責任編委胡清華

Recommended by Associate Editor HU Qing-Hua

1.天津工業大學電子與信息工程學院天津3003872.天津市光電檢測技術與系統重點實驗室天津300387

1.School of Electronics and Information Engineering,Tianjin Polytechnic University,Tianjin 3003872.Tianjin Key Laboratory of Optoelectronic Detection Technology and Systems,Tianjin 300387

Geng Lei,Wang Xue-Bin,Xiao Zhi-Tao Zhang Fang,Wu Jun,Li Yue-Long,Su Jing-Jing.Fast compressive tracking algorithm combining feature selection with secondary localization.Acta Automatica Sinica,2016,42(9):1421-1431