AVS2幀間預測模式快速判決方法

產小紅,滕國偉,王國中,趙海武,李國平

(上海大學 通信與信息工程學院,上海 200444)

?

AVS2幀間預測模式快速判決方法

產小紅,滕國偉,王國中,趙海武,李國平

(上海大學 通信與信息工程學院,上海 200444)

新一代國家自主音視頻編碼標準AVS2已制定完成,相對于上一代標準其具有更高的編碼效率,但同時編碼復雜度大幅度增加。為了降低編碼器的編碼復雜度以達到實時應用性能,針對編碼單元的預測單元劃分進行深入研究,提出了一種幀間預測模式快速判決方法,該方法利用編碼單元時域與空域的信息再結合編碼單元的紋理信息來預測其劃分方式,從而在幀間編碼過程中避免遍歷所有劃分模式。實驗表明,該算法可以使編碼時間平均下降38%,并且對編碼效率影響很小。

AVS2;幀間預測模式;時空域相關性;紋理特征

新一代國家自主音視頻編碼標準(以下簡稱AVS2)已經制定完成,其壓縮效率相比上一代標準(簡稱AVS1)和國際標準H.264/AVC提高了約一倍,特別在場景視頻編碼方面有更高的性能提升。AVS2能獲得如此優異的壓縮性能是因為它采用了更多先進的編碼技術,最具代表性的是靈活的四叉樹劃分結構和多樣化的預測模式。其中在幀內預測方面,亮度有30個方向預測模式及3個非方向預測模式;在幀間預測方面則添加了雙前向預測等幀間預測模式[1]。

先進的編碼技術使編碼效率提高了,但是編碼過程更加復雜了。例如在采用四叉樹劃分結構進行編碼時,如果最小編碼單元的尺寸為8×8,則每個64×64的塊共有1+174=83 522種可能的劃分方式。而AVS1,每個宏塊有4種劃分方式,16個宏塊是相加的關系,編碼一個64×64的圖像塊只需要64種可能的方式。相比之下,其編碼復雜度提高了許多倍數,其他新技術也有類似情況。因此,研究如何降低AVS2的編碼復雜度,是非常有必要的。

1 AVS2幀間預測相關技術介紹

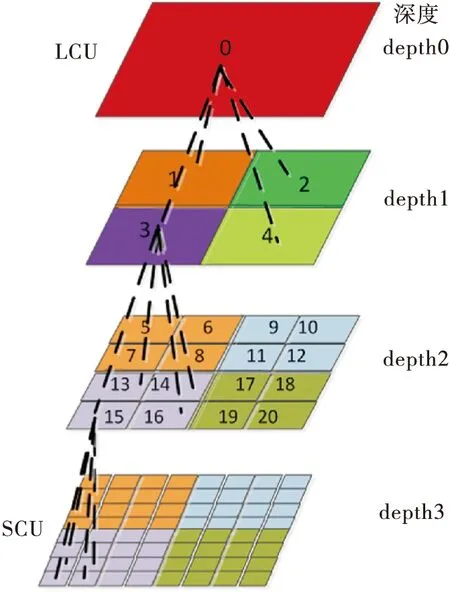

1.1 AVS2的編碼塊結構

為了更加靈活、高效地劃分視頻場景中的不同紋理細節的視頻內容或者視頻對象,AVS2采用了基于編碼單元(Coding Unit,CU)、預測單元(Prediction Unit,PU)和變換單元(Transform Unit,TU)的編碼結構[2]。用CU代替了AVS1中的宏塊,并賦予其更多靈活的功能。CU基于四叉樹結構進行劃分,過程如圖1所示。最大編碼單元LCU (Largest Coding Unit)大小為64×64,深度為0,LCU可以劃分為4個32×32的CU,深度為1,每個32×32的CU又可以劃分為4個16×16的CU,如此遞歸劃分直到CU的大小為8×8,也就是最小編碼單元SCU(Smallest Coding Unit)。在編碼過程中每幅圖像都可被劃分為多個LCU,然后按照上述過程遞歸劃分。

圖1 CU分層

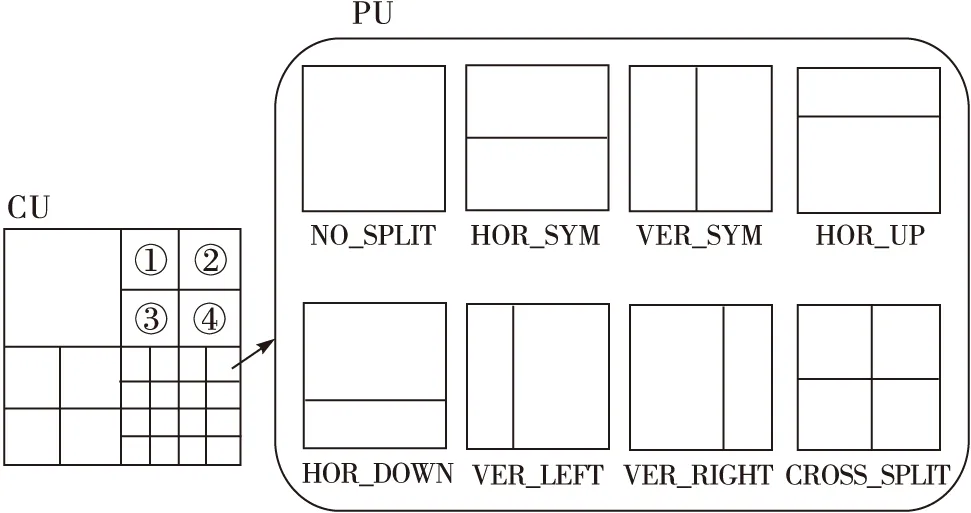

PU是進行預測(包括幀內和幀間預測)的基本單元,由CU劃分而得到。在AVS2中,對于一個大小為2N×2N的CU來說,它可以被劃分成多個PU,AVS2幀間PU的劃分模式如圖2所示。圖2列出了8種幀間CU劃分為PU的模式,其中NO_SPLIT,HOR_SYM,VER_SYM和CROSS_SPLIT是對稱劃分,而HOR_UP,HOR_DOWN,VER_LEFT和VER_RIGHT是非對稱劃分,它們都是幀間的預測模式[2]。除此之外幀間還有與NO_SPLIT劃分尺寸相同的SKIP預測模式,一共有9種幀間預測模式。

圖2 CU與幀間PU的關系

1.2 AVS2幀間預測過程

AVS2進行幀間預測編碼時,將一幅圖像分成若干個LCU。對每個LCU采用類似樹的后續遍歷順序進行編碼,過程如圖1所示。要確定一個LCU的編碼模式需要遍歷LCU下各個深度的CU的所有預測模式。如果最小編碼單元的尺寸為8×8,則每個64×64的LCU理論上需要嘗試預測模式計算:13×(1+4+42+43)=1 105次。對一幅1 920×1 080分辨率的視頻圖像進行率失真模式選擇計算,大約需進行1 105×1 920×1 080÷64÷64≈559 406次,而每種幀間模式需要遍歷參考圖像,進行運動估計和運動補償等計算,可見AVS2的幀間編碼過程極其復雜和耗時,因此優化AVS2的幀間編碼算法對于其實時應用有重大意義。

2 基于時域空域相關性以及紋理特征的預測模式判決方法

目前已有一些降低視頻編碼復雜度的算法。如文獻[3]提出一種幀內預測模式快速決策算法來減小幀內預測模式的數量。文獻[4]提出了一種AVS2幀內快速算法,該算法利用已編碼CU預測上層CU的模式。文獻[5]提出的算法利用相鄰PU的相關性避免遍歷所有的參考圖像,從而提高編碼效率。

2.1 AVS2的模式選擇算法

以往對編碼塊的幀間預測模式研究,較多的是利用時域和空域相關性,如把周圍已編碼圖像塊的預測模式作為候選模式對當前正在編碼的塊進行預測,雖然這些方法對減小當前塊的模式計算有一定效果,但是往往因為信息利用得不全產生誤差,而且誤差會對預測下一編碼單元產生影響。有的算法還會設定一個閾值用于判斷是否進行預測,該閾值設定的精確性非常關鍵,其精確度直接影響模式選擇的效果。本文所提出的算法除利用時域和空域中相鄰的編碼塊,還利用紋理信息進行快速模式判決,可降低外部因素導致的誤差。

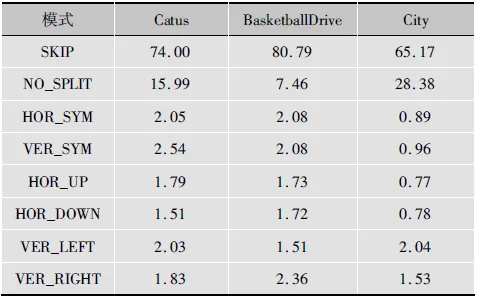

相鄰塊與待編碼塊存在很多相似特征,所以編碼塊的預測模式和時域、空域相鄰的編碼塊的預測模式存在很強的相關性。而就一個編碼塊而言,各種幀間預測模式被選擇的概率存在很大差異。為了分析各幀間預測模式的分布情況,本文選取了幾個序列進行實驗以統計每種預測模式的使用概率。為保證實驗的普適性,所選取的序列擁有不同的分辨率和紋理特征,Catus,BasketballDrive,City序列的分辨率分別為1 920×1 280,1 280×720,832×480。實驗結果如表1所示。

表1 各預測模式使用的概率

從表1可以看出,編碼塊的預測模式中各種模式被選為最佳模式的概率差異很大,其中SKIP模式被選為最佳模式的概率最大,平均達到了70%多。而且對于不同的序列而言,每種預測模式被選為最佳模式的概率差異也較大。從表中還可以看出,當序列中的水平(垂直)對稱模式使用的概率較大時,水平(垂直)非對稱模式也使用得更多。從這些實驗結果不難推斷,編碼塊選擇何種預測模式和序列本身的紋理特性有很大的關系。

AVS2在幀間預測過程中,并沒有考慮序列的紋理特征,都是遍歷嘗試所有的預測模式以找到最佳模式。本文綜合利用預測模式的時域、空域相關性以及編碼塊的紋理特征,提出快速方法加快幀間預測模式判決,同時保證編碼效率。

2.2 時空域相關性以及紋理特征分析

本節在對當前CU進行模式預測之前,可以選取多個時域、空域相鄰塊作為參考塊,并且從參考塊中選取一個和當前編碼塊紋理最接近的參考塊作為最佳參考塊。接著分析當前CU的紋理特性,根據紋理特性判斷進行水平對稱劃分還是進行垂直對稱劃分,同時將最佳參考塊的預測模式作為對比,避免產生差錯。在確定了水平還是垂直劃分之后,進一步分析CU的紋理特征,決定是否進行非對稱劃分。通過該算法可以使幀間預測的復雜度大大減小,而且最佳參考塊的存在保證了算法的準確性。

目前已有較多方法用于檢驗一幅圖片的紋理信息,如文獻[6]使用圖像熵值來判定紋理特征;文獻[7]使用歸一化后的直流交流系數比AC_DC_ratio來表征圖像的紋理復雜度;文獻[8]則使用灰度直方圖的自相關函數來判斷紋理;文獻[9]則采用MAD分析待編碼宏塊水平和垂直方向上的紋理復雜度。

最小均方誤差MSE可以有效反映一組數據的變化程度。如果圖像某個方向上像素的MSE較小,也就是起伏程度較小,那么這個方向上的像素屬于同一對象的概率就較大。因此本文就用MSE來表述圖像的紋理特征。

根據MSE的定義,可以利用式(1)和(2)計算CU垂直方向和水平方向的均方誤差,即

(1)

(2)

式中:MSEVer和MSEHor表示CU垂直方向和水平方向的均方誤差;W和H分別是待編碼CU的寬度和高度(以像素點為單位);α和β是系數值,用于調整不同劃分模式下的水平與垂直方向上的像素點數,計算MSEVer和MSEHor時,α和β的值都為1;p(x,y)表示CU像素點的值;mx和my在計算MSEVer和MSEHor時分別表示當前CU的第x+1行像素點的平均值和第y+1列像素點的平均值。

兩個編碼塊紋理特征的相似度,可以利用水平均方誤差MSEHor和垂直均方誤差MSEVer的絕對誤差的和來表示,如式(3)。abs越小就表示兩個編碼塊的紋理特征越接近。

(3)

若一組像素具有較小的MSE則表明這些像素值比較接近,劃分到同一塊的可能性就比較大。所以如果MSEHor 當然也要考慮一些特殊情況,比如由于光線等其他外部因素的影響可能導致一些并不屬于同一個對象的像素點具有比較接近的像素值。所以本文在進行紋理分析之前選擇一個最佳參考塊,根據最佳參考塊的預測模式就能避免因為外部因素而產生差錯。例如若根據紋理特征判斷應該計算當前CU的水平對稱模式HOR_SYM并且舍棄垂直對稱模式VER_SYM,而最佳參考塊的預測模式是3種垂直劃分模式VER_SYM,VER_LEFT,VER_RIGHT中的1種,這時就有必要計算垂直對稱模式VER_SYM。 由于水平和垂直方向上還有4種非對稱模式,即水平和垂直各有2個非對稱模式,如圖1所示。所以水平對稱模式或垂直對稱模式被確定之后,對水平方向或垂直方向的紋理進一步分析,仍使用式(1)和式(2)對當前深度下非對稱劃分的PU的均方誤差求值。分析水平非對稱的兩種模式HOR_UP和HOR_DOWN時,使用式(2),并用MSEUpUp和MSEUpDown分別代表HOR_UP模式下的上下塊的MSE,α的值都為1,β的值分別為0.25和0.75;用MSEDownUp和MSEDownDown分別代表HOR_DOWN模式下的上下塊的MSE,α的值都為1,β的值分別為0.75和0.25。計算這4個PU的MSE時mx表示當前PU的第x+1行像素點的平均值。分析垂直非對稱的兩種模式VER_LEFT和VER_RIGHT時,使用式(1),并用MSELeftLeft和MSELeftRight分別代表VER_LEFT模式下的左右塊的MSE,α的值分別為0.25和0.75,β的值都為1;用MSERightLeft和MSERightRight分別代表VER_RIGHT模式下的左右塊的MSE,α的值為0.75和0.25,β的值都為1。計算這4個MSE時my表示當前PU第y+1列像素點的平均值。 對于水平和垂直方向上的4種非對稱模式,如果小尺寸PU的均方誤差小于大尺寸PU的均方誤差,那么小尺寸PU中的像素點屬于同一個對象的概率較大,則計算該模式的代價。如對于VER_LEFT模式而言,若MSELeftLeft 2.3 算法流程 根據上述分析,本文提出了一種基于時域空域相關性以及紋理特征的幀間預測模式快速判決方法,算法流程如圖3所示。算法的具體步驟如下: 1)對當前CU進行編碼前,選取前一幀對應位置相同深度的CU,以及同一幀左邊和上邊相鄰位置同一深度的CU作為參考CU。計算當前CU以及3個參考CU的水平均方誤差MSEHor和垂直均方誤差MSEVer。利用式(3)將3個參考CU的紋理與當前CU的紋理進行比較,選擇紋理最接近的CU作為當前CU的最佳參考塊,并且獲得最佳參考塊的預測模式Mode0。 2)計算NO_SPLIT模式的率失真代價,并將當前CU的最佳預測模式BestMode設為NO_SPLIT模式。 3)比較當前CU水平均方誤差MSEHor和垂直均方誤差MSEVer。若MSEHor 4)若Mode0為3種垂直劃分模式VER_SYM、VER_LEFT、VER_RIGHT中的1種,則計算水平對稱模式HOR_SYM和垂直對稱模式VER_SYM的率失真代價,并且與當前最佳模式相比,選擇代價最小的模式作為最佳預測模式BestMode;否則只計算水平對稱模式HOR_SYM的率失真代價,并與當前最佳模式比較得到最佳模式BestMode。 圖3 算法流程圖 5)若Mode0為3種水平劃分模式HOR_SYM、HOR_UP、HOR_DOWN中的1種,則計算垂直對稱模式VER_SYM和水平對稱模式HOR_SYM的率失真代價,并且與當前最佳模式相比,選擇代價最小的模式作為最佳預測模式BestMode;否則只計算垂直對稱模式VER_SYM的率失真代價,并與當前最佳模式比較得到最佳模式BestMode。 6)若經過步驟4)或步驟5)之后最佳模式BestMode為NO_SPLIT模式,則結束后續非對稱模式計算, 跳轉到步驟9)。 7)若經過步驟4)或步驟5)之后最佳模式BestMode為水平對稱模式HOR_SYM,則計算水平非對稱模式HOR_UP(HOR_DOWN)上方位置PU的水平均方誤差MSEUpUp(MSEDownUp)和下方位置PU的水平均方誤差MSEUpDown(MSEDownDown)。若MSEUpUp 8)若經過步驟4)或步驟5)之后最佳模式BestMode為垂直對稱模式VER_SYM,則計算垂直非對稱模式VER_LEFT(VER_RIGHT)左側位置PU的垂直均方誤差MSELeftLeft(MSERightLeft)和右側位置PU的垂直均方誤差MSELeftRight(MSERightRight)。若MSELeftLeft 9)比較其他剩余模式。 由算法的流程圖和具體步驟可知該算法最多可以減少5種模式計算,最少也可以減少3種模式計算,使幀間編碼復雜度大大減小。更重要的是,該算法不需要設定閾值,這樣產生誤差的概率就很小,而且在利用紋理特征進行模式判決時,利用最佳參考塊作比較,這樣進一步保證了算法的準確性。 利用AVS2參考軟件RD12.0作為實驗平臺測試本文提出算法的性能,并且與遍歷所有模式的算法進行比較,實驗條件如表2所示。本文通過式(4)~(6)進行數據分析,測試不同量化參數(QP)、不同序列下的編碼時間time、峰值信噪比PSNR及編碼比特率Bit-rate的變化,從而對算法進行綜合評價。式(4)中,timereference是原始算法在RD12.0上的編碼時間,timeproposed是使用本文提出的快速算法在RD12.0上的編碼時間,Δtime即表示兩種算法編碼時間上的變化。式(5)和(6)中各變量的意義與式(4)類似。 (4) (5) (6) 表2 實驗條件 為了驗證算法的通用性,本文選擇具有不同分辨率、紋理及運動特征的視頻序列進行測試。測試序列的分辨率如下:BasketballDrive與Kimonol為1 920×1 080,City與Crew為1 280×720,PartyScene與RaceHorses為832×480。表3為本文算法與遍歷所有預測模式的算法編碼時間及BD-PSNR和BD-Rate的實驗比較結果。 表3 本文算法與遍歷所有模式方法的實驗比較結果 從表3中可以看出,本文提出的基于時域、空域相關性以及紋理特征的幀間預測模式判決方法,可顯著降低幀間編碼時間,而且編碼性能只有極小的損失。不同QP下平均編碼時間都超過34%的下降,QP為45時,平均編碼時間下降44.67%。特別的對于運動比較平緩的Kimonol序列,下降的編碼時間最多,在QP為45時達到55.11%,而紋理復雜的City序列,其編碼時間平均下降也達到30%多。因為該算法采用相鄰最佳參考塊作比較,進一步降低判斷誤差,對編碼比特率以及PSNR影響非常小。 本文針對AVS2的幀間預測過程中多劃分模式帶來的編碼復雜度增加問題,通過利用時域、空域相關性以及CU的紋理信息,確定PU的最可能劃分方式,選擇可能性較大的模式進行計算,從而避免遍歷計算所有模式。實驗結果表明,本文提出的算法應用于AVS2參考軟件中,可降低編碼時間平均約38%,而編碼性能基本保持不變,有助于其實時實現,可促進AVS2視頻編碼在高清、超高清視頻領域的應用。 [1]黃鐵軍.AVS2標準及未來展望[J]. 電視技術,2014,38(22):7-10. [2]周蕓.AVS2視頻編碼關鍵技術[J]. 廣播電視信息,2015,9(2):18-21. [3]SHEN X, YU L, CHEN J. Fast coding unit size selection for HEVC based on Bayesian decision rule[C]//Proc. Picture Coding Symposium(PCS). California,[s.n.],2012:453-456. [4]趙超,趙海武,王國中,等.快速AVS2幀內預測選擇算法[J]. 計算機應用,2015,35(11):3284-3287. [5]林琪,趙海武,王國中,等.面向AVS2的快速幀間預測算法[J]. 電視技術,2014,38(17):76-84. [6]鄭簫楨.AVS視頻提案AVS_M3012:AMP快速決策機制[EB/OL].[2016-03-10].http://www.avs.org.cn/index.asp?meetingid=65&filetype=proposal. [7]孟慶磊,姚春蓮,宋建斌,等.一種面向H.264/AVC的快速幀內預測選擇算法[J]. 北京航空航天大學學報,2007,33(2):219-223. [8]LIN Y K, CHANG T S. Fast block type decision algorithm for intra prediction in H.264 [C]//Proc. International Conference on Image Processing(ICIP).Genova,Italy:[s.n.], 2005:54-58. [9]沈禮權,張兆揚,劉志,等.一種結合全零塊檢測和紋理特征的快速幀內預測模式選擇算法[J]. 四川大學學報,2007,39(1):134-139. 產小紅(1990— ),碩士生,主研視頻編碼標準、新媒體技術; 滕國偉(1975— ),碩士生導師,主研數字音視頻編解碼技術、智能視頻分析等; 王國中(1962— ),博士生導師,主研視頻編解碼與多媒體通信、圖像處理等; 趙海武(1973— ),碩士生導師,主研數字視頻編解碼技術、轉碼技術等; 李國平(1974— ),碩士生導師,主研數字音視頻編解碼技術、復用技術、網絡傳輸技術等。 責任編輯:薛 京 Fast decision algorithm for AVS2 inter prediction mode CHAN Xiaohong, TENG Guowei, WANG Guozhong, ZHAO Haiwu, LI Guoping (SchoolofCommunicationandInformationEngineering,ShanghaiUniversity,Shanghai200444,China) The new generation of the national independent audio and video coding standard AVS2 has been finalized. It has higher coding efficiency relatives to the previous generation, but it also increases a substantial the encoding complexity. In order to reduce AVS2 encoding complexity to achieve real-time application performance, this paper makes in-depth research on prediction unit of encoding unit and proposes a fast decision algorithm of inter prediction mode. The algorithm utilizes spatio-temporal correlation and the texture feature of coding unit to forecast coding unit’s partition mode, which can avoid iterating over all partition modes. Experiments show that the algorithm can reduce encoding time by 38% on average and the algorithm has only a little impact on encoding efficiency. AVS2; inter prediction mode; spatio-temporal correlation; texture feature 產小紅,滕國偉,王國中,等.AVS2幀間預測模式快速判決方法[J]. 電視技術,2016,40(11):1-6. CHAN X H, TENG G W, WANG G Z, et al.Fast decision algorithm for AVS2 inter prediction mode[J]. Video engineering,2016,40(11):1-6. TN919.81 A 10.16280/j.videoe.2016.11.001 上海市自然科學基金項目(14ZR1415200);上海市“科技創新行動計劃”項目(14511105602) 2016-04-11

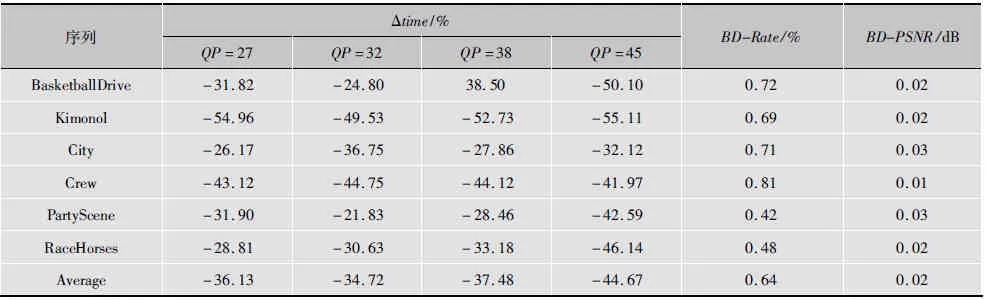

3 實驗結果

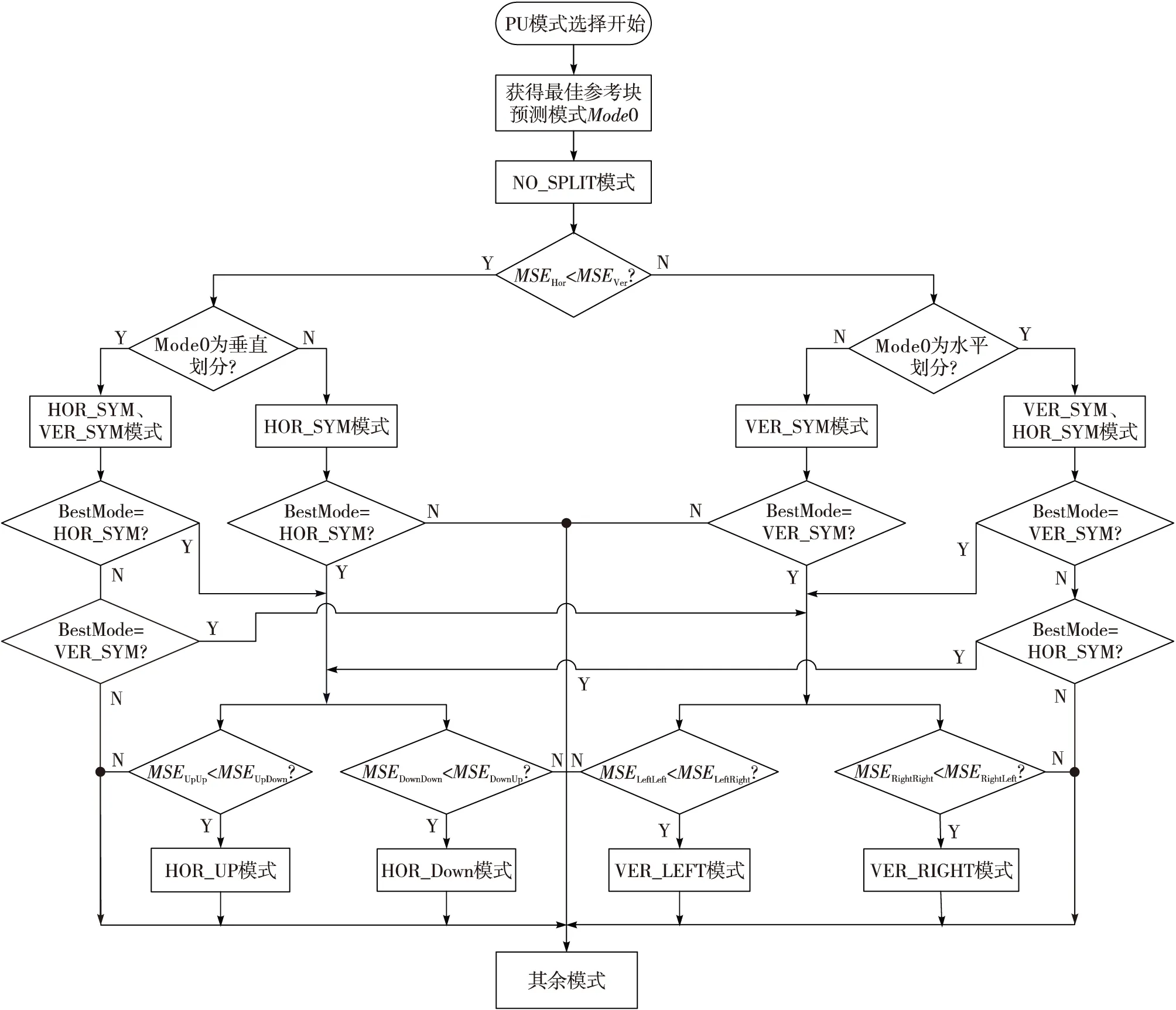

4 結語