深度學習方法研究新進展

劉帥師,程曦,郭文燕,陳奇

(長春工業大學 電氣與電子工程學院,吉林 長春 130000)

?

深度學習方法研究新進展

劉帥師,程曦,郭文燕,陳奇

(長春工業大學 電氣與電子工程學院,吉林 長春 130000)

本文依據模型結構對深度學習進行了歸納和總結,描述了不同模型的結構和特點。首先介紹了深度學習的概念及意義,然后介紹了4種典型模型:卷積神經網絡、深度信念網絡、深度玻爾茲曼機和堆疊自動編碼器,并對近3年深度學習在語音處理、計算機視覺、自然語言處理以及醫療應用等方面的應用現狀進行介紹,最后對現有深度學習模型進行了總結,并且討論了未來所面臨的挑戰。

深度學習;卷積神經網絡;深度信念網絡;深度玻爾茲曼機;堆疊自動編碼器

深度學習是機器學習的一個分支,屬于人工智能的新領域。深度學習的本質是特征提取,即通過組合低層次的特征形成更加抽象的高層表示,以達到獲得最佳特征的目的[1]。它主要通過神經網絡來模擬人的大腦的學習過程,希望實現對現實對象或數據(圖像、語音及文本等)的抽象表達,整合特征抽取和分類器到一個學習框架下[2]。目前,深度學習在許多領域取得了廣泛的關注,成為當今的研究熱點。

2006年,機器學習大師Hinton等[3]在《科學》上發表的一篇論文,開啟了深度學習的浪潮。他提出了深度信念網的概念,成功地利用貪心策略逐層訓練由限制玻爾茲曼機組成的深層架構,解決了以往深度網絡訓練困難的問題。此后,Hinton、Lecun、Bengio等大量科研人員對深度學習的模型構建、訓練方式等做出了杰出的貢獻。文獻[4]對近幾年新興的深度學習的初始化方法、模型結構、學習算法等進行了詳細的分析。2014年余濱等[5]從訓練方式的角度對深度學習進行了總結。文獻[6]依據數據流向對深度學習進行不同分類,本文將重點放在模型結構,以深度學習的核心模型結構而展開。文獻[7]從深度學習結構進行展開,本文大量增加了近3年新的研究成果,因此能夠更準確地反映該領域的最新研究進展。

本文依據模型結構,著重介紹4種典型的深度學習模型,即卷積神經網絡、深度信念網絡、深度玻爾茲曼機、堆疊自動編碼器。下面對這些模型進行描述。

1 深度學習典型模型

1.1 卷積神經網絡

1.1.1 歷史

卷積神經網絡(convolutional neural networks,CNN)最早在20世紀80年代就已被提出,是由于在研究貓腦皮層時受到的啟發。它的典型模型LeNet-5[8]系統,在MNIST上得到了0.9%的錯誤率,并在20世紀90年代就已用于銀行的手寫支票識別[7]。但是,由于在大尺寸圖像上沒有好的效果,一度被人忽視。隨著高效的GPU計算的興起,直到2012年Hinton在ImageNet問題的成功,才使它在近幾年流行起來[9]。如今卷積神經網絡已經成為眾多科學領域的研究熱點之一,特別是在圖像識別領域。由于該網絡避免了對圖像的復雜前期預處理,可以直接輸入原始圖像,因而得到了廣泛的應用。

1.1.2 結構

卷積神經網絡是前饋神經網絡的一種。卷積神經網絡的模型如圖1所示,它是一個多層的神經網絡,每層由多個二維平面組成,而每個平面由多個獨立神經元組成。傳統的神經網絡層與層之間神經元采取全連接方式,而卷積神經網絡采用稀疏連接方式,即每個特征圖上的神經元只連接上一層的一個小區域的神經元連接。

圖1 卷積神經網絡模型

卷積神經網絡的低隱含層是由卷積層和最大池采樣層交替組成,高層通常是全連接層作為分類器使用。

首先,為了降低網絡的復雜性,卷積神經網絡采用權重共享方式,即同一個特征圖,卷積核是一樣的[10];其次,對得到的特征輸入給一個非線性函數,比如ReLU等;最后,再采取下采樣方法,比如最大池化等。下采樣的作用是把語義上相似的特征合并起來,這是因為形成一個主題的特征的相對位置不太一樣[1]。

1.1.3 訓練方式

卷積神經網絡的訓練采用有監督訓練方式。首先是向前傳播,即輸入X經過卷積神經網路后變為輸出O,再將O與標簽進行比較,然后以向后傳播的方式,到將所得誤差傳播到每個節點,根據權值更新公式,更新相應的卷積核權值[4,6]。

此外,以卷積神經網絡為核心的深度學習網絡還有3-D卷積神經網絡(3-D convolutional neural networks,3D-CNN))[11], 光譜網絡(spectral networks,SN)[12],金字塔卷積神經網絡(pyramid convolutional neural networks,PCNN)[13],多級金字塔卷積神經網絡(multi level pyamid convolutional neural networks,MLPCNN)[14]等。

1.2 受限制玻爾茲曼機為核心的深度網絡

受限制玻爾茲曼機為核心的深度網絡有2種:深度信念網和深度玻爾茲曼機。現簡要分析二者的區別。

1.2.1 受限制玻爾茲曼機

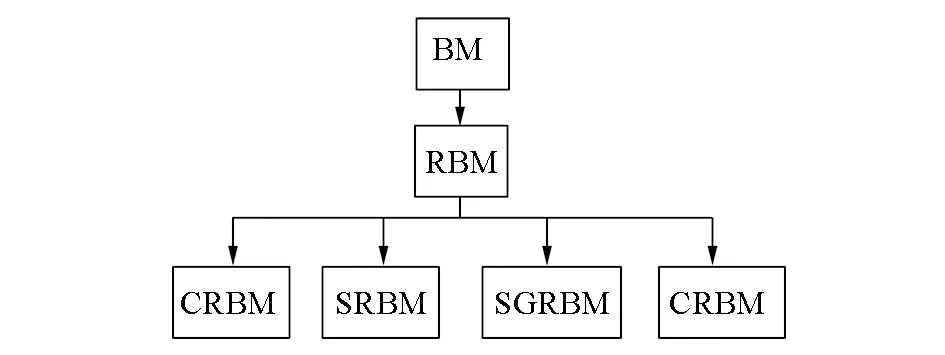

受限制玻爾茲曼機(restricted Boltzmann machine,RBM)是一類無向圖模型[4],由可視層和隱含層組成,與玻爾茲曼機(Boltzmann machine,BM)不同,層內無連接,層間有連接。這種結構更易于計算隱含層單元與可視層單元的條件分布[5]。受限制玻爾茲曼機的訓練方式通常采用對比散度方(contrastive divergence,CD)。常見的玻爾茲曼機的演變模型如圖2所示。

圖2 玻爾茲曼機演變模型

受限制玻爾茲曼機的演變模型有卷積受限制玻爾茲曼機(convolutional restricted Boltzmann machine,CRBM)[15]、稀疏受限制玻爾茲曼機(sparse restricted Boltzmann machine,SRBM)[16]、稀疏組受限制玻爾茲曼機(sparse group restricted Boltzmann machine,SGRBM)[17]、分類受限制玻爾茲曼機(class restricted Boltzmann machine,CRBM)[18]等。更詳細的描述內容參見文獻[19]。

1.2.2 深度信念網絡

深度信念網絡(deep belief networks,DBN)是由多個受限制玻爾茲曼機(RBM)疊加而成的深度網絡。深度信念網絡的典型結構如圖3所示,它通過無監督預訓練和有監督微調來訓練整個深度信念網絡[7]。預訓練時用無標簽數據單獨訓練每一層受限制玻爾茲曼機,通過自下而上的方式,將下層受限制玻爾茲曼機輸出作為上層受限制玻爾茲曼機輸入。當預訓練完成后,網絡會獲得一個較好的網絡初始值,但這還不是最優的[20]。再采用有標簽數據去訓練網絡,誤差自頂向下傳播,一般采用梯度下降法對網絡進行微調。深度信念網絡的出現是深度學習的轉折點,目前深度信念網絡已應用于語音、圖像處理等方面,尤其是在大數據方面[10]。

圖3 深度信念網絡典型結構

深度信念網絡的變種模型有卷積深度信念網(convolutional deep belief networks,CDBN)[21]、稀疏深度信念網(sparse deep belief networks,SDBN)[22]、判別深度信念網(discriminative deep belief networks,DDBN)[23]等。

1.2.3 深度玻爾茲曼機

深度玻爾茲曼機(deep Boltzmann machine,DBM)與深度信念網絡相似,都是以受限制玻爾茲曼機疊加而成。但是,與深度信念網絡不同,層間均為無向連接,省略了由上至下的反饋參數調節。訓練方式也與深度信念網絡相似,先采用無監督預訓練方法,得到初始權值,再運用場均值算法,最后采用有監督微方式進行微調。

1.3 堆疊自動編碼器

1.3.1 自動編碼器

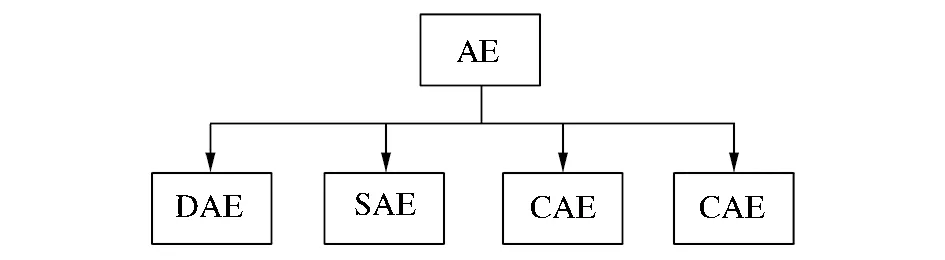

自動編碼器(auto encoder,AE)由編碼器與解碼器組成,其原理如圖4所示。核心思想是將輸入信號進行編碼,使用編碼之后的信號重建原始信號,目的是讓重建信號與原始信號相比重建誤差最小[24]。編碼器將輸入數據映射到特征空間,解碼器將特征映射回數據空間,完成對輸入數據的重建。

圖4 自動編碼器原理圖

自動編碼器演化的模型如圖5所示,自動編碼器演化的模型有去噪自動編碼器(denoising auto encoder,DAE)[25]、稀疏自動編碼器(sparse auto encoder,SAE)[26]、收縮自動編碼器(contractive auto encoder,CAE)[27]、卷積自動編碼(convolutional auto encoder,CAE)[28]等。更詳細的描述內容參見文獻[29-31]。

圖5 自動編碼器的演變模型

1.3.2 堆疊自動編碼器原理

堆疊自動編碼器(stacked auto encoders,SAE)與深度信念網絡類似,其結構如圖6所示,都是由簡單結構疊加起來的深層網絡。簡單來說,就是將DBN中的RBM替換成AE就得到了SAE。自動編碼器的訓練過程也是使用貪心逐層預訓練算法,但因為是通過重構誤差來進行訓練,相比較而言比受限制玻爾茲曼機訓練容易[7]。

以自動編碼器及其變種模型的為核心的深度網絡稱之為深度自動編碼(deep auto encoders,DAE)。文獻[32]對深度自動編碼器進行了詳細的描述。堆疊自動編碼器就是一種典型的深度自動編碼。類似的還有堆疊去噪自動編碼器(stacked denoising auto-encoders,SDAE)[25]、堆疊稀疏自動編碼器(stacked sparse auto encoders,SSAE)[33]等。

圖6 堆疊自動編碼器結構

2 深度學習應用2.1 語音處理

長期以來,語音識別技術普遍采用的是聲學模型混合高斯模型。但這種混合高斯模型本質上是一種淺層網絡建模,不能充分描述特征的狀態空間分布[34]。2011年微軟[35]將深度學習引入語音識別領域,提出深度神經網絡DNN,本質上是把混合高斯模型替換成了深度神經網絡模型大大提高識別率。該模型在Switchboard標準數據集上的識別錯誤率比最低錯誤率降低了33%。2014年Van等[36]在網絡音樂平臺Spotify使用深度卷積神經網絡做基于內容的音樂推薦,以及實現依靠音頻信號預測聽眾的收聽喜好,然后采用WMF(weighted matrix factorization)模型進行評分預測。百度的深度學習語音識別系統DeepSpeech[37]可以在飯店等嘈雜環境下實現將近 81% 的辨識準確率。2015年Chan等[38]提出了LAS( listen, attend and spell )系統。該系統利用金字塔式雙向的RNN網絡。不同于傳統的模型,不需要完整的端對端的CTC(connectionist temporal classification),實現跳過音素直接把語音識別為字符,合成了約4萬小時音頻。當不依賴語音詞典和語言模型時在谷歌語音搜索任務詞錯率達到14.2%,當結合語言模型時詞錯率達到11.2%。

2.2 計算機視覺

2012年Hinton[39]和他的2個學生在著名的ImageNet問題上用更深的卷積神經網絡取得世界最好結果,贏得了冠軍,使得圖像識別大踏步前進。隨后,深度學習在圖像處理方面取得突破性進展,如物體定位[40]、臉部識別[41]和人體姿勢估計[42]等。2015年深海團隊[43]利用卷積神經網絡對3萬個例子進行121種浮游生物分類。Denton等[44]利用卷積神經網絡通過用戶的性別、年齡、城市和圖片等特征進行整合。在Facebook上對用戶上傳的圖片進行標簽、分類。

2.2.1 圖像語義分割

圖像包括很多層信息,例如這幅圖像是否有特定的物體(如汽車)。所謂的圖像語義分割,就是描述圖片中包含哪些物體、包括街頭的場景分割、三維掃描、對3-D人體解剖分割定位等。因為是基于像素分類方法,所以這個問題會帶來巨大的計算量。2015年Long等[45]提出了利用全卷積網絡 (fully convolutional networks,FCN,)的概念去進行圖像語義分割。同年Behnke等[46]提出了語義RGB-D感知器的概念,使得基于深度學習的圖像語義分割得到進一步發展。

2.2.2 人臉識別

Linkface 開發了基于深度學習的人臉檢測創新算法 。無論場景中是單人還是多人,是側臉、半遮擋還是模糊等情景中,均能進行精準檢測。據全球最具權威的人臉檢測評測平臺 FDDB 最新數據,Linkface 的人臉檢測算法達到了世界領先的水平。2014年Facebook開發一種叫DeepFace[41]技術。其貢獻在于對人臉對齊和人臉表示環節的改進。通過革新的3-D人臉建模勾勒出臉部特征,然后通過顏色過濾做出一個刻畫特定臉部元素的平面模型。Facebook 建立了一個來自于4 030個人的440萬張標簽化的人臉池,Facebook 稱這是迄今為止最大規模的人臉池。它是一個擁有9層的深度卷積神經網絡,網絡有超過1.2億個參數。該技術在LFW數據集上取得了97.25%的平均精度,已經接近人類的識別水平。2015年Google提出FaceNet[47]進行人臉驗證。它直接學習圖像到歐式空間上點的映射,然后基于這個編碼再做人臉識別、人臉驗證和人臉聚類等。其中兩張圖像所對應的特征歐式空間上的點之間的距離直接對應著兩個圖像是否相似。FaceNet并沒有像DeepFace和DeepID那樣需要對齊。FaceNet得到最終表示后不用像DeepID那樣需要再訓練模型進行分類,直接計算距離就可以,簡單而有效。在Youtube數據集上測試準確率為95.12%。

目前,傳統人臉識別技術主要集中在可見光譜的范疇,對于跨模態人臉識別問題尚無好的解決方法。2015年Sarfraz等[48]利用深度神經網絡,成功將紅外熱圖像與可見光圖像進行匹配,實現了跨模態人臉匹配。該網絡可以在短短35 ms的時間內,能夠將紅外熱圖像匹配到其可見光圖像,可以實現實時運行。

2.2.3 表情識別

目前,大部分研究者把卷積神經網絡應用在表情識別上。例如,2013年Liu等[49]提出了構建一個新的深層結構(AU-aware deep networks,AUDN),基于卷積神經網絡進行特征提取,連接SVM做表情分類器。2014年Ouellet等[50]使用卷積神經網絡對電腦前的游戲玩家進行實時表情識別。Song等[51]利用了一種5層卷積神經網絡,實現了每幅圖像在服務器的預測時間為50 ms,每個圖像的往返時間小于100 ms,在智能手機上實現實時表情識別。Ijjina等[52]用Kinect深度傳感器得到的圖片作為表情識別的對象,并在卷積神經網絡進行表情識別取得了較好的效果。Byeon等[53]使用3D卷積神經網絡去識別視頻人臉表情。文獻[54]證明在實時表情識別系統,卷積神經網絡比深層神經網絡具有更好的效果。

還有一部分研究者利用其他深度學習模型進行表情識別。例如,McLaughlin等[55]提出一種基于深度信念網絡的實時表情識別系統,但只能檢測4種表情。2013年He等[56]利用深度玻爾茲曼機對紅外熱圖像進行表情識別。

此外,一些研究者們將多種深度學習模型結合起來進行表情識別。例如,2014年LYU等[57]將深度信念網絡與自編碼器相結合來進行識別。2015年Jung等[58]將卷積神經網絡與深度神經網絡合起來。Kahou等[59]提出一種視頻表情識別系統EmoNets。卷積神經網絡捕捉視頻信息,檢測人臉。深度信念網絡捕捉音頻信息,自編碼器捕捉人肢體行為。該理論贏得了2013 EmotiW 挑戰賽,在2014的數據集上準確率達到47.67%。

2.3 自然語言處理

Sashihithlu等[60]采用遞歸自編碼方法(recursive auto encoders,RAE)來解決較為復雜的情感分析問題。Johnson等[61]提出一種基于卷積神經網絡直接在詞袋模型(BoW)上用做文本分類任務。2015年谷歌的Good等利用深度神經網絡開發了字鏡頭(word lens)實時視頻翻譯性能和通話實時翻譯功能。它可以實現拿著手機攝像頭對著實物,實物中的文字就可被即時識別出,并被翻譯成目標語言,目前該技術可支持20多種語言的即時視覺翻譯。更重要的是即使它在不聯網的狀態下也能進行工作,所有深度學習的龐大計算都是在手機上完成的。李婷等[62]利用堆疊去噪自動編碼器(stack denoising auto encoder,SDAE)識別盲文。

2.4 醫療應用

Deep Genomics公司開始把基因組和深度學習結合起來,Deep Genomics 已經推出了他們的第一款產品 SPIDEX。只需將測試結果和細胞類型導入,SPIDEX 便可分析出某一變異對 RNA 剪切的影響,并計算出該變異與疾病之間的關系。Koziol等[63]利用一種受限玻爾茲曼機用于肝細胞癌的分類。2015年Fauw等[64]利用20多層的卷積神經網絡檢測糖尿病視網膜病變的眼底圖像。

3 模型總結及面臨的挑戰

3.1 深度學習模型

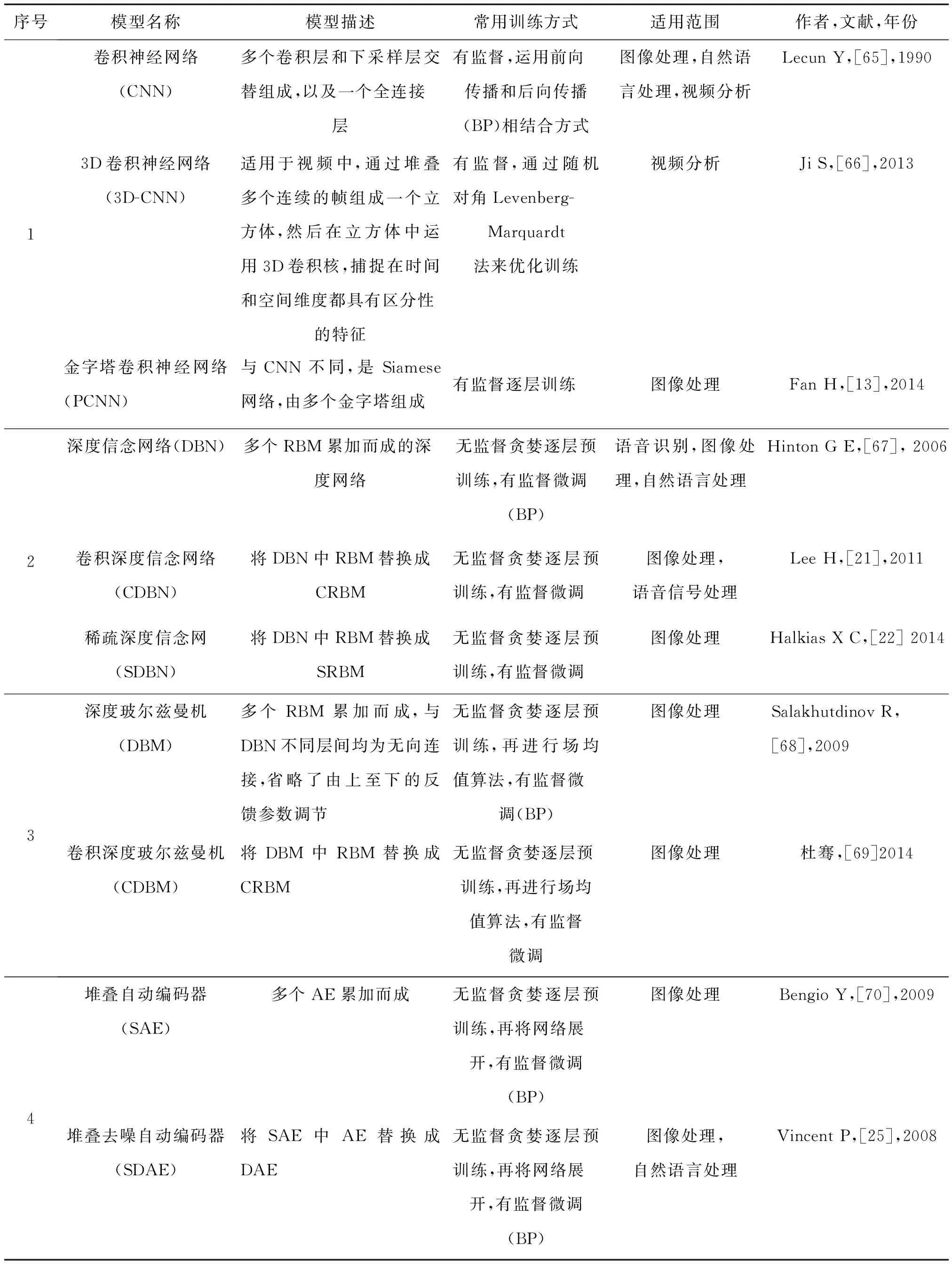

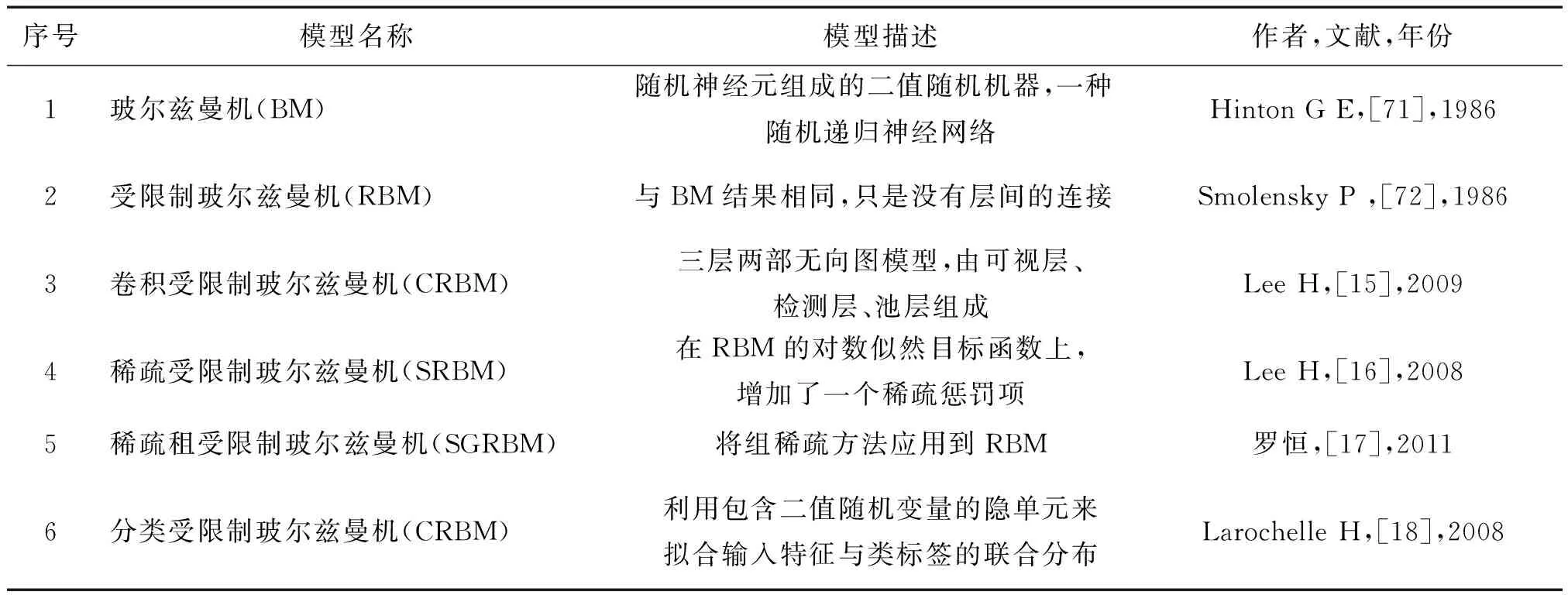

本文對深度學習模型進行分類、概括,在此以模型的結構為序,對深度學習模型進行總結如表1~表3所示。

1)模型結構。目前,大部分的深度學習模型都是以卷積神經網絡、深度信念網絡、深度玻爾茲曼機、堆疊自動編碼器等幾種基本模型為基礎演變而來。除此之外,還有像遞歸神經網絡(recurrentneural networks,RNN)[74]、深度凸形網絡(deep convex net,DCN)[75]等其他類型的新型深度模型。

2)訓練方式。深度學習模型的訓練方式主要有有監督學習和無監督學習2種。訓練方式因模型結構而異,一般以卷積神經網絡為核心的模型一般采取有監督訓練方式。而以受限制玻爾茲曼機與自動編碼器為核心的模型,大部分采用無監督學習方式預訓練,配合有監督微調模式進行參數訓練。

表1 典型深度學習模型

表2 玻爾茲曼機及其演化模型

表3 自動編碼器及其演化模型

3)應用領域。深度學習在語音處理、計算機視覺的應用已十分廣泛,許多技術已用于商用。但是,在自然語言處理的應用尚不成熟[1]。一些研究者嘗試用遞歸神經網絡去解決這一問題。文獻[74-78]對遞歸神經網絡在文本生成和機器翻譯的應用做出了詳細的描述。目前,遞歸神經網絡的變種模型長短時記憶模型 (long short-term memory,LSTM)被證明比傳統的遞歸神經網絡更加有效[79]。

3.2 面臨的挑戰

1)模型結構創新。自Hinton提出深度學習的思想以來,已經涌現出大量的深度學習模型,然而大部分的模型的構建依舊停留在以簡單模型(如AE,RBM等)疊加而成的深度網絡,或是幾種深度學習模型簡單相疊加,來構建深度學習模型。這種形式的模型往往不能發揮深度學習的優勢,是否存在其他有效的深度學習模型,是否可以讓深度學習與其他方法進行融合,這是今后要研究的問題。

2)訓練方式的改進。深度學習已經在各個領域取得了突破性的成果,大部分深度學習模型均采用無監督學習方式。但是,離完全的無監督學習還有一定的距離。目前的深度學習模型在無監督預訓練后,仍然需要有監督的微調,并沒有做到完全意義上的無監督學習。因此,如何做到完全意義上的無監督學習是未來研究的重點。

3)減少訓練時間。當待解決的問題過于復雜,使深度學習模型參數增加時,會導致模型的訓練時間逐漸上升,是否可以在不改變硬件性能的條件下,對算法進行改進,在保證精度的同時,提高訓練速度。所以,減少訓練時間,仍是深度學習需要努力的研究方向。

4)實現在線學習。目前,深度學習的算法大多采用無監督預訓練與有監督微調配合的方式進行。然而,一旦在線環境下引入全局微調,會使結果陷入局部最小值。因此,這種訓練算法不利于在線學習。是否可以改進算法進而將深度學習應用于在線環境,這是未來要思考的問題。

5)克服對抗樣本。通過稍微修改實際樣本,而構造出的合成樣本,會使一個分類器以高置信度認為它們屬于錯誤的分類,這就是深度學習對抗樣本問題[80-82]。研究如何克服它們可以幫助我們避免潛在的安全問題。然而,目前為止并沒有好的方法出現。一些研究人員嘗試使用常見的正則化方法(包括均化多重模型、均化圖像多采樣觀測等)去解決這一問題,但是并沒有取得良好的進展。因此,深度學習的對抗樣本問題仍然是待解決的難題之一。

4 結束語

本文詳細描述了幾種典型的深度學習模型的構造原理,以及訓練方法。并且,對近3年深度學習在各個領域的應用進行了概括。最后,在現有深度學習模型的基礎上討論了深度學習面臨的挑戰。

深度學習自提出以來已經在許多領域取得了突破性的進展。但是,在深度學習實際應用的過程中,往往為了要構造合適的深度學習模型而大費周章。因為目前的深度學習模型大部分是為了解決某一特定問題,而量身定做的。如果用于解決其他問題,效果往往不盡如人意。今后研究者們能否通過改進結構與算法,研究出一種可以應對大部分問題深度學習算法,這是未來要思考的難題。

[1]LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436-444.

[2]林妙真. 基于深度學習的人臉識別研究[D]. 大連: 大連理工大學, 2013. LIN Miaozhen. Research on face recognition based on deep learning[D]. Dalian, China: Dalian University of Technology, 2013.

[3]HINTON G E, SALAKHUTDINOV R R. Reducing the dimensionality of data with neural networks[J]. Science, 2006, 313(5786): 504-507.

[4]劉建偉, 劉媛, 羅雄麟. 深度學習研究進展[J]. 計算機應用研究, 2014, 31(7): 1921-1930, 1942. LIU Jianwei, LIU Yuan, LUO Xionglin. Research and development on deep learning[J]. Application research of computers, 2014, 31(7): 1921-1930, 1942.

[5]余濱, 李紹滋, 徐素霞, 等. 深度學習: 開啟大數據時代的鑰匙[J]. 工程研究-跨學科視野中的工程, 2014, 6(3): 233-243. YU Bin, LI Shaozi, XU Suxia, et al. Deep learning: a key of stepping into the era of big data[J]. Journal of engineering studies, 2014, 6(3): 233-243.

[6]尹寶才, 王文通, 王立春. 深度學習研究綜述[J]. 北京工業大學學報, 2015, 41(1): 48-59. YIN Biaocai, WANG Wentong, WANG Lichun. Review of deep learning[J]. Journal of Beijing university of technology, 2015, 41(1): 48-59.

[7]張建明, 詹智財, 成科揚, 等. 深度學習的研究與發展[J]. 江蘇大學學報: 自然科學版, 2015, 36(2): 191-200. ZHANG Jianming, ZHAN Zhicai, CHENG Keyang, et al. Review on development of deep learning[J]. Journal of Jiangsu university: natural science editions, 2015, 36(2): 191-200.

[8]LECUN Y, JACKEL L D, BOTTOU L, et al. Learning algorithms for classification: a comparison on handwritten digit recognition[M]//OH J H, KWON C, CHO S. Neural Networks: The Statistical Mechanics Perspective. Singapore: World Scientific, 1995: 261-276.

[9]陳先昌. 基于卷積神經網絡的深度學習算法與應用研究[D]. 杭州: 浙江工商大學, 2014. CHEN Xianchang. Research on algorithm and application of deep learning based on convolutional neural network[D]. Hangzhou, China: Zhejiang Gongshang University, 2014.

[10]李衛. 深度學習在圖像識別中的研究及應用[D]. 武漢: 武漢理工大學, 2014. LI Wei. The research and application of deep learning in image recognition[D]. Wuhan: Wuhan University of Technology, 2014.

[11]JI Shuiwang, XU Wei, YANG Ming, et al. 3D convolutional neural networks for human action recognition[J]. IEEE transactions on pattern analysis and machine intelligence, 2013, 35(1): 221-231.

[12]BRUNA J, ZAREMBA W, SZLAM A, et al. Spectral networks and locally connected networks on graphs[EB/OL].Eprint Arxiv: Arxiv,2013. [2014-10-10] http://120.52.73.79/arxiv.org/pdf/1312.6203v3.pdf.

[13]FAN Haoqiang, CAO Zhimin, JIANG Yuning, et al. Learning deep face representation[EB/OL]. Eprint Arxiv: Arxiv, 2014. [2014-10-10] http://120.52.73.80/arxiv.org/pdf/1403.2802v1.pdf.

[14]王冠皓, 徐軍. 基于多級金字塔卷積神經網絡的快速特征表示方法[J]. 計算機應用研究, 2015, 32(8): 2492-2495. WANG Guanhao, XU Jun. Fast feature representation method based on multi-level pyramid convolution neural network[J]. Application research of computers, 2015, 32(8): 2492-2495.

[15]LEE H, GROSSE R, RANGANATH R, et al. Convolutional deep belief networks for scalable unsupervised learning of hierarchical representations[C]//Proceedings of the 26th Annual International Conference on Machine Learning. New York, NY, USA, 2009: 609-616.

[16]LEE H, EKANADHAM C, NG A Y. Sparse deep belief net model for visual area V2[C]//Advances in Neural Information Processing Systems 20: 21st Annual Conference on Neural Information Processing Systems. Vancouver, British Columbia, Canada, 2007: 873-880.

[17]羅恒. 基于協同過濾視角的受限玻爾茲曼機研究[D]. 上海: 上海交通大學, 2011. LUO Heng. Restricted Boltzmann machines: a collaborative filtering perspective[D]. Shanghai, China: Shanghai Jiao Tong University, 2011.

[18]LAROCHELLE H, BENGIO Y. Classification using discriminative restricted Boltzmann machines[C]//Proceedings of the 25th International Conference on Machine Learning. New York, NY, USA, 2008: 536-543.

[19]張春霞, 姬楠楠, 王冠偉. 受限波爾茲曼機[J]. 工程數學學報, 2015, 32(2): 159-173. ZHANG Chunxia, JI Nannan, WANG Guanwei. Restricted Boltzmann machines[J]. Chinese journal of engineering mathematics, 2015, 32(2): 159-173.

[20]劉銀華. LBP和深度信念網絡在非限制條件下人臉識別研究[D]. 江門: 五邑大學, 2014. LIU Yinhua. The research of face recognition under unconstrained condition via LBP and deep belief network[D]. Jiangmen: Wuyi University, 2014.

[21]LEE H, GROSSE R, RANGANATH R, et al. Unsupervised learning of hierarchical representations with convolutional deep belief networks[J]. Communications of the ACM, 2011, 54(10): 95-103.

[22]HALKIAS X C, PARIS S, GLOTIN H. Sparse penalty in deep belief networks: using the mixed norm constraint[EB/OL]. [2014-05-08]. http://arxiv.org/pdf/1301.3533.pdf.

[23]LIU Yan, ZHOU Shusen, CHEN Qingcai. Discriminative deep belief networks for visual data classification[J]. Pattern recognition, 2011, 44(10/11): 2287-2296.

[24]鄭胤, 陳權崎, 章毓晉. 深度學習及其在目標和行為識別中的新進展[J]. 中國圖象圖形學報, 2014, 19(2): 175-184. ZHENG Yin, CHEN Quanqi, ZHANG Yujin. Deep learning and its new progress in object and behavior recognition[J]. Journal of image and graphics, 2014, 19(2): 175-184.

[25]VINCENT P, LAROCHELLE H, BENGIO Y, et al. Extracting and composing robust features with denoising autoencoders[C]//Proceedings of the 25th International Conference on Machine Learning. New York, NY, USA, 2008: 1096-1103.

[26]BENGIO Y, LAMBLIN P, POPOVICI D, et al. Greedy layer-wise training of deep networks[C]//Advances in Neural Information Processing Systems 19: 20th Annual Conference on Neural Information Processing Systems. Vancouver, British Columbia, Canada, 2006: 153-160.

[27]RIFAI S, VINCENT P, MULLER X, et al. Contractive auto-encoders: explicit invariance during feature extraction[C]//Proceedings of the 28th International Conference on Machine Learning. Bellevue, WA, USA, 2011.

[28]MASCI J, MEIER U, CIREAN D, et al. Stacked convolutional auto-encoders for hierarchical feature extraction[C]//Proceedings of the 21st International Conference on Artificial Neural Networks, Part I. Berlin Heidelberg, Germany, 2011: 52-59.

[29]王雅思. 深度學習中的自編碼器的表達能力研究[D]. 哈爾濱: 哈爾濱工業大學, 2014. WANG Yasi. Representation ability research of auto-encoders in deep learning[D]. Harbin: Harbin Institute of Technology, 2014.

[30]李遠豪. 基于深度自編碼器的人臉美麗吸引力預測研究[D]. 江門: 五邑大學, 2014. LI Yuanhao. A study for facial beauty attractiveness prediction based on deep autoencoder[D]. Jiangmen: Wuyi University, 2014.

[31]林洲漢. 基于自動編碼機的高光譜圖像特征提取及分類方法研究[D]. 哈爾濱: 哈爾濱工業大學, 2014. LIN Zhouhan. Hyperspectral image feature extraction and classification based on autoencoders[D]. Harbin: Harbin Institute of Technology, 2014.

[32]曲建嶺, 杜辰飛, 邸亞洲, 等. 深度自動編碼器的研究與展望[J]. 計算機與現代化, 2014(8): 128-134. QU Jianling, DU Chenfei, DI Yazhou, et al. Research and prospect of deep auto-encoders[J]. Jisuanji yu xiandaihua, 2014(8): 128-134.

[33]林少飛, 盛惠興, 李慶武. 基于堆疊稀疏自動編碼器的手寫數字分類[J]. 微處理機, 2015(1): 47-51. LIN Shaofei, SHENG Huixing, LI Qingwu. Handwritten digital classification based on the stacked sparse autoencoders[J]. Microprocessors, 2015(1): 47-51.

[34]陳碩. 深度學習神經網絡在語音識別中的應用研究[D]. 廣州: 華南理工大學, 2013. CHEN Shuo. Research of deep learning neural networks applications in speech recognition[D]. Guangzhou, China: South China University of Technology, 2013.

[35]郭麗麗, 丁世飛. 深度學習研究進展[J]. 計算機科學, 2015, 42(5): 28-33. GOU Lili, DING Shifei. Research progress on deep learning[J]. Computer science, 2015, 42(5): 28-33.

[36]VAN DEN OORD A, DIELEMAN S, SCHRAUWEN B. Deep content-based music recommendation[M]//Advances in Neural Information Processing Systems 26: 27th Annual Conference on Neural Information Processing Systems. Lake Tahoe, 2013: 2643-2651.

[37]HANNUN A, CASE C, CASPER J, et al. Deep speech: scaling up end-to-end speech recognition[EB/OL]. Eprint Arxiv: Arxiv, 2014.[2014-12-19] https://arxiv.org/pdf/1412.5567v2.pdf.

[38]余凱, 賈磊, 陳雨強. 深度學習的昨天、今天和明天[J]. 計算機研究與發展, 2013, 50(9): 1799-1804. YU Kai, JIA Lei, CHEN Yuqiang. Deep learning: yesterday, today, and tomorrow[J]. Journal of computer research and development, 2013, 50(9): 1799-1804.

[39]GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, 2014: 580-587.

[40]TAIGMAN Y, YANG Ming, RANZATO M A, et al. DeepFace: closing the gap to human-level performance in face verification[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, 2014: 1701-1708.

[41]TOSHEV A, SZEGEdY C. DeepPose: human pose estimation via deep neural networks[C]//Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, 2014: 1653-1660.

[42]DIELEMAN S. Classifying plankton with deep neural networks[EB/OL]. (2015-03-17)[2015-05-30]. http://benanne.github.io/2015/03/17/plankton.html.

[43]DENTON E, WESTON J, PALURI M, et al. User conditional hashtag prediction for images[C]//Proceedings of the 21th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York, NY, USA, 2015: 1731-1740.

[44]LONG J, SHELHAMER E, DARRELL T Fully convolutional networks for semantic segmentation[J]. IEEE Conference on Computer Vision & Pattern Recognition. 2015, 79(10):1337-1342.

[45]SCHWARA M, SCHULZ H, BEHNKE S. RGB-D object recognition and pose estimation based on pre-trained convolutional neural network features[C]//Proceedings of the 2015IEEE International Conference on Robotics and Automation.Seattle, WA, 2015: 1329-1335.

[46]SCHROFF F, KALENICHENKO D, PHILBIN J. FaceNet: A unified embedding for face recognition and clustering[C]// Computer Vision and Pattern Recognition (CVPR), Boston,USA,2015:815-823.

[47]SARFRAZ M S, STIEFELHAGEN R. Deep perceptual mapping for thermal to visible face recognition.[EB/OL] Eprint Arxiv: Arxiv,2015.[2015-12-23].http://120.52.73.80/arxiv.org/pdf/1507.02879v1.pdf.

[48]LIU Mengyi, LI Shaoxin, SHAN Shiguang, et al. Au-aware deep networks for facial expression recognition[C]//Proceedings of the 2013 10th IEEE International Conference and Workshops on Automatic Face and Gesture Recognition. Shanghai, China, 2013: 1-6.

[49]OUELLET S. Real-time emotion recognition for gaming using deep convolutional network features[EB/OL]. Eprint Arxiv: Arxiv,2014.[2014-7-16].https://arxiv.org/pdf/1408.3750v1.pdf.

[50]SONG I, KIM H J, JEON P B. Deep learning for real-time robust facial expression recognition on a smartphone[C]//Proceedings of the 2014 IEEE International Conference on Consumer Electronics. Las Vegas, NV, 2014: 564-567.

[51]IJJINA E P, MOHAN C K. Facial expression recognition using kinect depth sensor and convolutional neural networks[C]//Proceedings of the 2014 13th International Conference on Machine Learning and Applications. Detroit, MI, 2014: 392-396.

[52]BYEON Y H, KWAK K C. Facial expression recognition using 3D convolutional neural network[J]. International journal of advanced computer science and applications, 2014, 5(12): 107-112.

[53]JUNG H, LEE S, PARK S, et al. Development of deep learning-based facial expression recognition system[C]// Frontiers of Computer Vision (FCV), 2015 21st Korea-Japan Joint Workshop on 2015:1-4.

[54]MCLAUGHLIN T, MAI L, BAYANBAT N. Emotionrecognition with deep-belief networks[EB/OL].2008 http://cs229.stanford.edu/proj2010/McLaughlinLeBayanbat-RecognizingEmotionsWithDeepBeliefNets.pdf.

[55]HE Shan, WANG Shanfei, LAN Wuwei, et al. Facial expression recognition using deep Boltzmann machine from thermal infrared images[C]//Proceedings of the 2013 Humaine Association Conference on Affective Computing and Intelligent Interaction. Geneva, 2013: 239-244.

[56]LV Yadan, FENG Zhiyong, XU Chao. Facial expression recognition via deep learning[C]//Proceedings of the 2014 International Conference on Smart Computing. Hong Kong, China, 2014: 303-308.

[57]JUNG H, LEE S, PARK S, et al. Deep temporal appearance-geometry network for facial expression recognition[EB/OL] .Eprint Arxiv: Arxiv,2015.[2015-6-5].http://120.52.73.75/arxiv.org/pdf/1503.01532v1.pdf.

[58]KAHOU S E, BOUTHILLIER X, LAMBLIN P et al. EmoNets: Multimodal deep learning approaches for emotion recognition in video[J]. Journal on Multimodal User Interfaces, 2015, 10(2):1-13.

[59]SASHIHITHLU S, SOMAN S S. Complex sentimentanalysis using recursive autoencoders[EB/OL]. Core.ac.Uk: CiteSeerX,2013.[2015-9-30].https://core.ac.uk/display/23426251.

[60]JOHNSON R, ZHANG Tong. Effective use of word order for text categorization with convolutional neural networks[EB/OL]. Eprint Arxiv: Arxiv,2014.[2014-10-10]. http://120.52.73.79/arxiv.org/pdf/1412.1058.pdf.

[61]李婷. 基于深度學習的盲文識別方法[J]. 計算機與現代化, 2015(6): 37-40. LI Ting. A deep learing method for braille recognition[J].Jisuanji yu xiandaihua, 2015(6): 37-40.

[62]KOZIOL J A, TAN E M, DAI Liping, et al. Restricted Boltzmann machines for classification of hepatocellular carcinoma[J]. Computational biology journal, 2014, 2014: 418069.

[63]FAUW J D. Detecting diabetic retinopathy in eye images[EB/OL]. 2015[2015-07-28]. http://jeffreydf.github.io/diabetic-retinopathy-detection.

[64]CUN Y L, BOSER B, DENKER J S, et al. Handwritten digit recognition with a back-propagation network[C]//Advances in Neural Information Processing Systems 2. San Francisco, CA, USA, 1990: 396-404.

[65]JI Shuiwang, XU Wei, YANG Ming, et al. 3D convolutional neural networks for human action recognition[J]. IEEE transactions on pattern analysis and machine intelligence, 2013, 35(1): 22l-231.

[66]HINTON G E, OSINDERO S, TEH Y W. A fast learning algorithm for deep belief nets[J]. Neural computation, 2006, 18(7): 1527-1554.

[67]SALAKHUTDINOV R, HINTON G E. Deep Boltzmann machines[C]//Proceedings of the 12th International Conference on Artificial Intelligence and Statistics. Clearwater, Florida, USA, 2009: 448-455.

[68]杜騫. 深度學習在圖像語義分類中的應用[D]. 武漢: 華中師范大學, 2014. DU Qian. Application of deep learning in image semantic classification[D]. Wuhan: Central China Normal University, 2014.

[69]BENGIO Y. Learning deep architectures for AI[J]. Foundations and trendse in machine learning, 2009, 2(1): 1-127.

[70]HINTON G E, SEJNOWSKI T J. Learning and relearning in Boltzmann machines[M]//Parallel Distributed Processing: Explorations in the Microstructure of Cognition. Cambridge, MA, USA: MIT Press, 1986.

[71]SMOLENSKY P. Information processing in dynamical systems: foundations of harmony theory[M]//Parallel Distributed Processing: Explorations in the Microstructure of Cognition. Cambridge, MA, USA: MIT Press, 1986.

[72]RUMELHART D E, HINTON G E, WILLIAMS R J. Learning representations by back-propagating errors[J]. Nature, 1986, 323(6088): 533-536.

[73]MIKOLOV T, KARAFIT M, BURGET L, et al. Recurrent neural network based language model[C]//Proceedings of the Interspeech 2010 11th Annual Conference of the International Speech Communication Association. Makuhari, Chiba, Japan, 2010: 1045-1048.

[74]DENG Li, YU Dong. Deep convex net: a scalable architecture for speech pattern classification[C]//Proceedings of the 12th Annual Conference of the International Speech Communication Association. Florence, Italy, 2011: 2296-2299.

[75]MIKOLOV T, KOMBRINK S, BURGET L. Extensions of recurrent neural network language model[C]//Proceedings of the 2011 IEEE International Conference on Acoustics, Speech and Signal Processing.Prague, 2011: 5528-5531.

[76]LIU Shujie, YANG Nan, LI Mu, et al. A recursive recurrent neural network for statistical machine translation[C]//Proceedings of the 52nd Annual Meeting of the Association for Computational Linguistics. Baltimore, Maryland, USA, 2014: 1491-1500.

[77]SUTSKEVER I, VINYALS O, LE Q V. Sequence to sequence learning with neural networks[EB/OL]. 2014. [2014-10-12].http://120.52.73.79/arxiv.org/pdf/1409.3215v3.pdf.

[78]GRAVES A, MOHAMED A R, HINTON G. Speech recognition with deep recurrent neural networks[C]//Proceedings of the 2013 IEEE International Conference on Acoustics, Speech and Signal Processing. Vancouver, BC, 2013: 6645-6649.

[79]SZEGEDY C, ZAREMBA W, SUTSKEVER I, et al.Intriguing properties of neural networks[EB/OL]. Eprint Arxiv: Arxiv,2014.[2014-10-12]. http://120.52.73.78/arxiv.org/pdf/1312.6199v4.pdf.

[80]NGUYEN A, YOSINSKI J, CLUNE J Deep neural networks are easily fooled: High confidence predictions for unrecognizable images[C]// Computer Vision and Pattern Recognition. IEEE, Boston,USA,2015:427-436.

[81]LIPTON Z C. (Deep learning’s deep flaws)’s deep flaws[EB/OL]. [2015-07-28]. http://www.kdnuggets.com/2015/01/deep-learning-flaws-universal-machine-learning.html.

劉帥師,女,1981年生,講師,博士,主要研究方向為模式識別、計算機視覺。

程曦,男,1989年生,碩士研究生,主要研究方向為模式識別、機器學習。

郭文燕,女,1991年生,碩士研究生,主要研究方向為模式識別、機器學習。

Progress report on new research in deep learning

LIU Shuaishi, CHENG Xi, GUO Wenyan, CHEN Qi

(College of Electrical and Electronic Engineering, Changchun University of Technology, Changchun 130000, China)

Deep learning has recently received widespread attention. Using a model structure, this paper gives a summarization and analysis on deep learning by describing and reviewing the structure and characteristics of different models. The paper firstly introduces the concept and significance of deep learning, and then reviews four typical models: a convolutional neural network; deep belief networks; the deep Boltzmann machine; and an automatic stacking encoder. The paper then concludes by reviewing the applications of deep learning as regards speech processing, computer vision, natural language processing, medical science, and other aspects. Finally, the existing deep learning model is summarized and future challenges discussed.

deep learning; convolutional neural network; deep belief networks; deep Boltzmann machine; automatic stacking encoder

2015-11-27.

日期:2016-07-15.

吉林省科技廳青年科研基金項目(20140520065JH,20140520076JH);長春工業大學科學研究發展基金自然科學計劃項目(2010XN07).

. E-mail:劉帥師. E-mail:liu-shuaishi@126.com.

TP18

A

1673-4785(2016)05-0567-10

10.11992/tis.201511028

http://www.cnki.net/kcms/detail/23.1538.TP.20160715.1353.002.html

劉帥師,程曦,郭文燕,等.深度學習方法研究新進展[J]. 智能系統學報, 2016, 11(5): 567-577.

英文引用格式:LIU Shuaishi, CHENG Xi, GUO Wenyan, et al. Progress report on new research in deep learning[J]. CAAI transactions on intelligent systems, 2016,11(5):567-577.