基于特征加權的快速壓縮感知跟蹤

趙 端 謝 琦

(鄭州大學信息工程學院 河南 鄭州 450001)

基于特征加權的快速壓縮感知跟蹤

趙 端 謝 琦

(鄭州大學信息工程學院 河南 鄭州 450001)

基于壓縮感知的目標跟蹤算法具有簡單、實時、高效的特點。快速壓縮感知目標跟蹤算法FCT(Fast Compressive Tracking)生成目標高維特征未考慮不同尺度濾波器生成特征的有效性,目標與候選樣本之間的相似性度量僅考慮簡單疊加,在目標受到光照、遮擋等外界因素的影響下易使跟蹤結果出現偏差。針對這些問題,提出一種基于特征加權的快速壓縮感知跟蹤算法。該算法根據濾波器尺度,自適應地分配權值,生成目標高維特征。算法將候選樣本各維壓縮特征分類為目標壓縮特征的可能性與貝葉斯分類器輸出相乘,作為目標與候選樣本之間的相似性度量。實驗結果表明,提出的方法在目標受到光照、遮擋等外界因素的影響下具有更強的魯棒性。

目標跟蹤 壓縮感知 實時 特征加權

0 引 言

視覺目標跟蹤是機器視覺領域研究的熱點問題,已經被廣泛應用于眾多領域,如:機器人、智能視頻監控、軍用導航等,有著極高的研究價值和廣闊的應用發展前景[1]。

傳統的視覺目標跟蹤算法大致包含三個部分:一個外觀模型,一個運動模型和一個相似性度量策略。近些年來,視覺目標跟蹤算法得到眾多的關注和研究。例如,文獻[2]提出一種新穎的跟蹤框架(TLD),即將跟蹤任務分解為跟蹤、學習和檢測,該算法結合檢測和跟蹤方法,建立新的在線學習機制,從而使得跟蹤結果更加準確。文獻[3]利用稠密的時空上下文來進行跟蹤,具有簡單、快速及魯棒的優點。算法在貝葉斯框架下,通過目標位置在上一幀的先驗信息來計算置信圖,有效地減輕了目標位置的模糊。此外,還有CSK[4]、LSS[5]等算法。雖然目標跟蹤已經得到廣泛的關注和研究,但目標外觀易因目標受到光照[6]、遮擋[7-8]等外界因素的影響時發生變化,目標跟蹤仍然是一個具有挑戰性的問題。

壓縮感知理論[9-10]用投影矩陣得到信號的壓縮測量值,然后通過重構算法重構出原始信號,因其具有簡單、高效等優點,在跟蹤領域得到廣泛的使用。文獻[11]提出一種基于壓縮感知理論的目標跟蹤算法,該算法證明了利用壓縮感知技術獲得的低維壓縮信號基本保留原有信號的全部特性,進而在不降低計算精度的前提下大大提高運算效率。文獻[12]提出一種簡單高效地基于壓縮感知的目標跟蹤算法(FCT)。該算法利用符合壓縮感知RIP條件的隨機感知矩陣對多尺度圖像特征進行降維,然后采用簡單的樸素貝葉斯分類器在降維后的特征上進行分類。該跟蹤算法非常簡單,并具有較高的準確性。但算法中獲取樣本的高維特征描述具有一定的盲目性。該算法通過樣本與濾波器的卷積獲取樣本的高維特征,但是沒有考慮到隨著濾波器尺寸的增大,濾波后產生的有效特征逐漸減少。同時算法中目標與候選樣本之間的相似性度量僅考慮簡單疊加,處理策略過于簡單,當跟蹤目標在受到光照、遮擋等外界因素的影響下易使跟蹤結果出現偏差。本文針對這些問題提出了改進的特征加權跟蹤算法。該算法根據濾波器尺度,自適應給多尺度濾波器濾波得到的特征分配權值,生成目標高維特征。算法將候選樣本各維壓縮特征分類為目標壓縮特征的可能性與貝葉斯分類器輸出相乘,作為目標與候選樣本之間的相似性度量。實驗表明,本文提出的算法能在目標發生遮擋以及光照等變化的情況下準確地跟蹤目標。

1 FCT算法

FCT算法最主要的特點就是實時高效,它是一種基于分類的跟蹤算法。該算法和大多數分類模型一樣,利用壓縮特征訓練分類器,然后在上一幀目標周圍采樣,通過分類器對所有候選樣本進行分類,得到分類器響應最大值對應的目標區域即為當前幀中跟蹤目標的位置。

1.1 壓縮感知理論

壓縮感知,又稱壓縮采樣、壓縮傳感,它是信號領域誕生的一個新的采樣理論。通過開發信號的稀疏特性,壓縮感知可以在遠小于Nyquist采樣率的條件下,利用隨機采樣獲取信號的離散樣本,然后通過非線性重建算法完美的重建信號。所謂壓縮感知,最核心的理論在于不降低精度的條件下試圖減少對一個信號進行測量的成本。對于文獻[12]中提出的FCT算法,最直觀的應用即是用壓縮感知來提取目標特征,實現高維信號向低維的轉變。具體表現形式為:

V=ΦX

(1)

通常,滿足受限等距屬性(RIP)的矩陣為隨機高斯矩陣R∈m×n,其中ri,j~N(0,1)。但是由于隨機高斯矩陣是稠密矩陣,當n的取值較大時,內存和計算量仍然很大。因此,在FCT算法中采用了一個非常稀疏的隨機投影矩陣Φ ,定義如下:

(2)

其中,當s的取值為1或3時,此矩陣滿足RIP屬性。在FCT算法中,s=n/algn ,此時隨機投影矩陣的精確性幾乎接近于傳統高斯矩陣。

1.2 壓縮特征

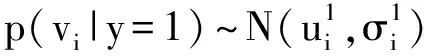

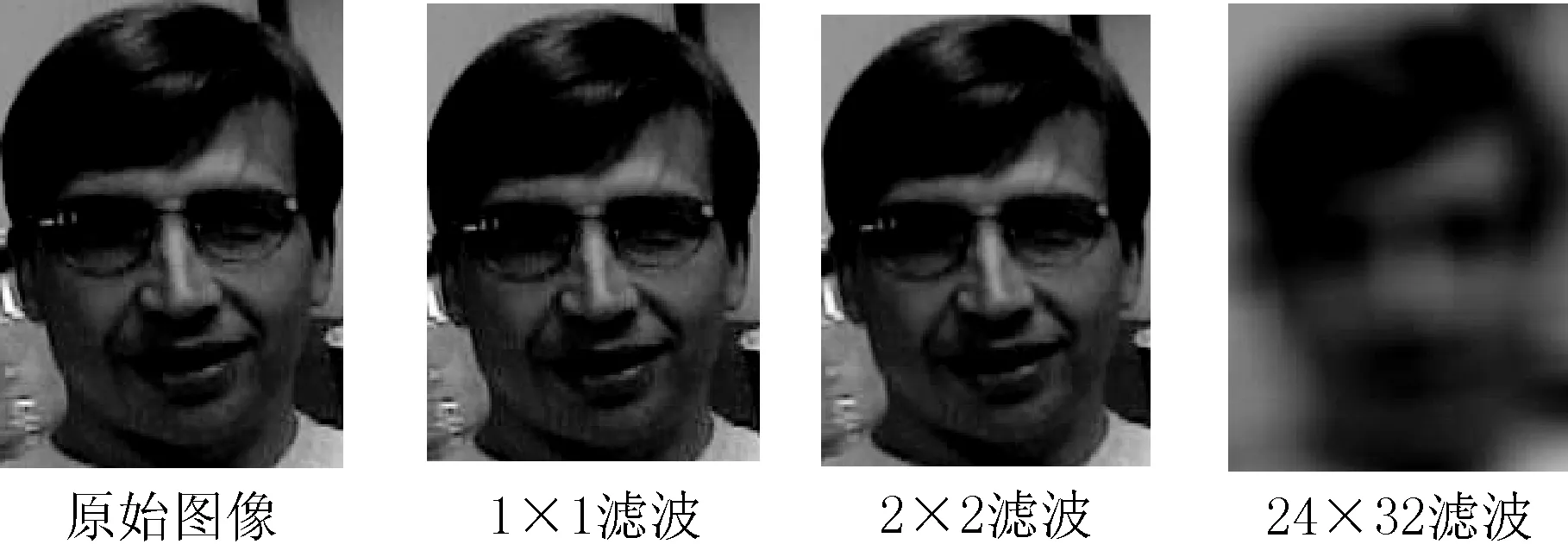

圖1 樣本高維特征描述

矩形濾波器構造如下:

(3)

其中,1≤i≤w,1≤j≤h,w和h分別為目標的寬度和高度。

獲取樣本的高維特征以后,我們通過上文提及的隨機投影矩陣Φ,利用式(1)即可得樣本的壓縮低維特征。

1.3 分類器的創建與更新

(4)

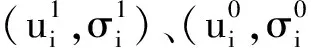

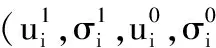

其中,假定先驗概率p(y=1)=p(y=0),且y∈{0,1}是一個二值變量,它分別表示負樣本和正樣本。由文獻[15]可得,高維隨機向量的投影幾乎總是呈現高斯分布,因此,式(4)中的條件概率p(vi|y=1)和p(vi|y=0)可被假設為符合以下高斯分布。即:

(5)

(6)

1.4 由粗到精的搜索策略

FCT算法采用一種由粗到精的搜索策略來提高算法的速度和性能。在粗跟蹤階段,選取一個較大的搜索半徑和搜索步長,依據文獻[12]中的算法,確定一個粗糙的跟蹤位置。在細跟蹤階段,以粗跟蹤階段獲取的目標位置為中心,在一個小的搜索半徑內,選取較小的搜索步長進行搜索,得到目標的最終跟蹤位置。

2 基于特征加權的壓縮跟蹤算法

本文在兩個方面對快速壓縮感知跟蹤(FCT)算法進行改進,使得算法在目標受到光照、遮擋等外界因素的影響時具有更強的魯棒性。

2.1 特征加權

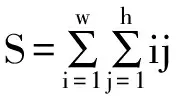

由圖1可知,文獻[12]通過一組多尺度矩形濾波器{F1,1,…,Fw,h}來得到樣本的高維特征描述。對于樣本Z∈w×h,通過與濾波器進行卷積處理,可得到(wh)2維的高維特征。但是,由一系列的實驗不難得到,隨著濾波器尺寸的不斷增大,我們獲得樣本的有效特征越來越少,這對于提高跟蹤效果并不明顯(如圖2所示)。

圖2 多尺度濾波結果圖像

因此,本文提出了基于特征加權的方法來解決這一問題。文中采用一定的權值分配機制,分別將通過小尺度濾波器獲得的有效特征賦予較大權值,同時將較小的權值分配給通過大尺度濾波器獲取的特征。具體方法如下:

(7)

(8)

xt=wt×(Fi,j?Zw×h)

(9)

X=(x1,x2,…,xwh)T

(10)

其中,i和j為濾波器的寬度和高度,且1≤i≤w,1≤j≤h,w和h為樣本Z的寬度和高度,1≤t≤wh,wh為濾波器的個數,X為獲得的加權高維特征描述。然后,通過式(1)即可得到樣本的壓縮低維特征。

與文獻[12]獲取的高維特征相比,改進的方法通過權值分配機制,提高了濾波獲得的有效特征的比重,能夠取得更好的跟蹤效果。

2.2 相似性度量

由式(4)可得,在FCT算法中目標與候選樣本之間的相似性度量僅考慮簡單的疊加和,并選取分類器響應最大值對應的區域作為目標區域,但這種方法具有一定的缺陷。由式(4)可得:

(11)

hi(v)=log(p(vi|y=1))-log(p(vi|y=0))

(12)

T=count(hi(v)>0) (i=1,2,…,m)

(13)

P=T/m

(14)

C(v)= P×H(v)=

(15)

其中,T表示hi(v)>0的個數,m為壓縮特征的個數。然后,選取C(v)的最大響應值對應的候選區域作為跟蹤的目標區域。經實驗證明,本文提出的相似性度量方法具有更強的適應性,且可有效地避免樣本中個別壓縮特征過度擬合引起的跟蹤誤差。

3 算法流程

本文在對文獻[12]中的算法改進的基礎上,提出了基于特征加權的壓縮跟蹤算法,主要算法流程如下所示:

算法流程:

輸入:視頻序列F。

輸出:視頻序列F中每一幀的跟蹤位置。

1. 初始化參數。

a) 手動選取跟蹤目標的位置[x,y,w,h],其中(x,y)為矩形框左上角坐標,w和h分別為矩形框的寬度和高度。在此以It表示t幀時跟蹤目標的位置;

b) 選取正負樣本集,根據式(10)獲取樣本高維特征,然后由式(1)獲得壓縮低維特征后按照式(6)初始化分類器。

2. 粗跟蹤。對于第t幀(t≥2),以αc為半徑選取正樣本集Dc={z|‖I(z)-It-1‖≤αc},由式(10)獲取樣本高維特征后通過式(1)得到低維壓縮特征;

6. 輸出跟蹤結果,若t不是最后一幀,返回步驟2。

4 實驗結果與分析

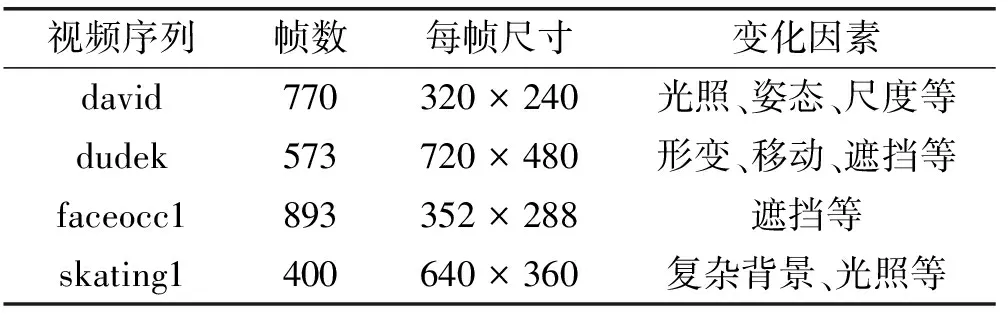

為了驗證本文算法的有效性,在此用4個標準視頻進行實驗驗證,視頻數據的詳細信息如表1所示。本文算法分別與文獻[12]和文獻[16]中算法進行了對比。所有算法在Window 7系統下MATLAB R2014a運行,計算機配置是Intel(R) Core(TM) i3-2130 CPU,主頻3.40 GHz,4.00 GB內存。

表1 視頻詳細信息

參數設置如下:手動標記第一幀目標位置,正樣本集搜索半徑α=4,隨機選取45個正樣本,負樣本集搜索內外半徑分別為β=8,γ=30,隨機選取50個負樣本,粗跟蹤階段的搜索半徑為25,搜索步長為4,細跟蹤階段的搜索半徑為10,搜索步長為1,壓縮低維特征的個數m=100,學習速率λ=0.85。

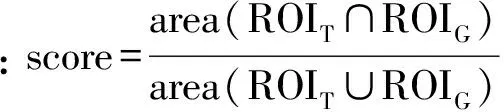

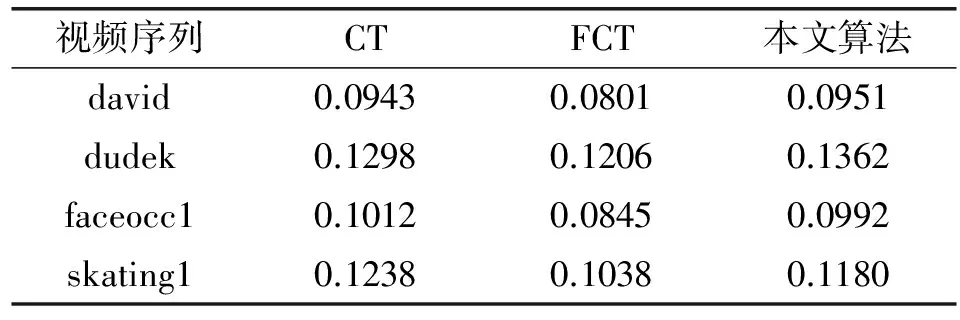

表2 跟蹤成功率 %

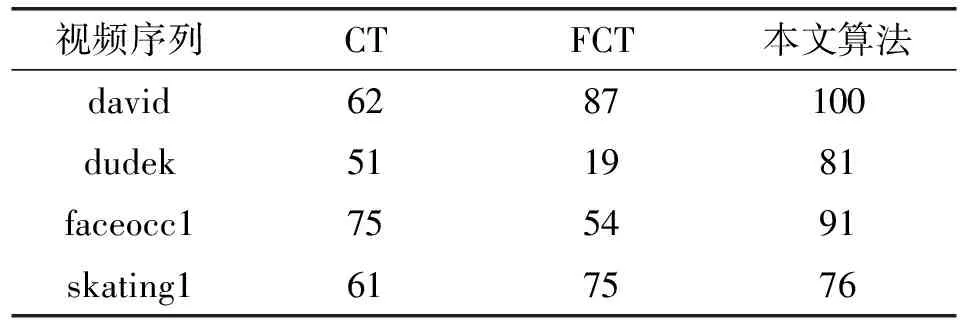

表3 平均中心位置誤差 像素

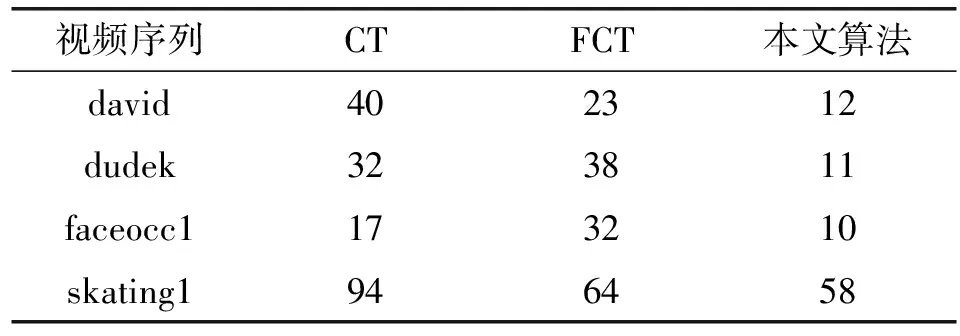

圖3 david序列跟蹤結果

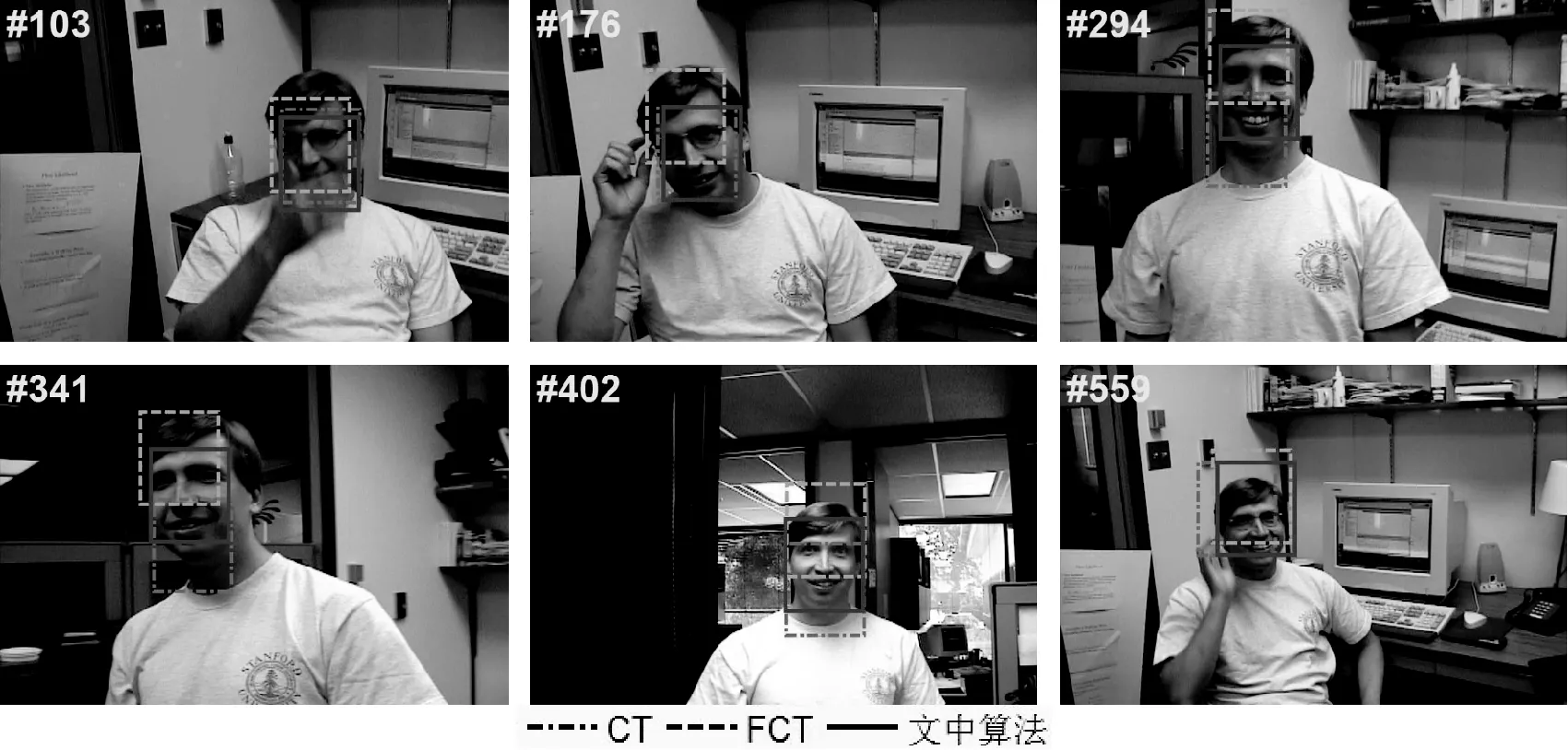

圖4 dudek序列跟蹤結果

圖5 faceocc1序列跟蹤結果

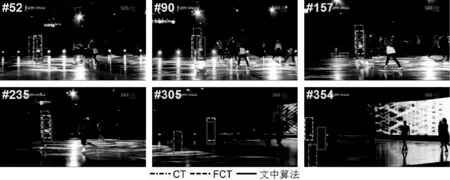

圖6 skating1序列跟蹤結果

圖7 david序列跟蹤誤差曲線圖

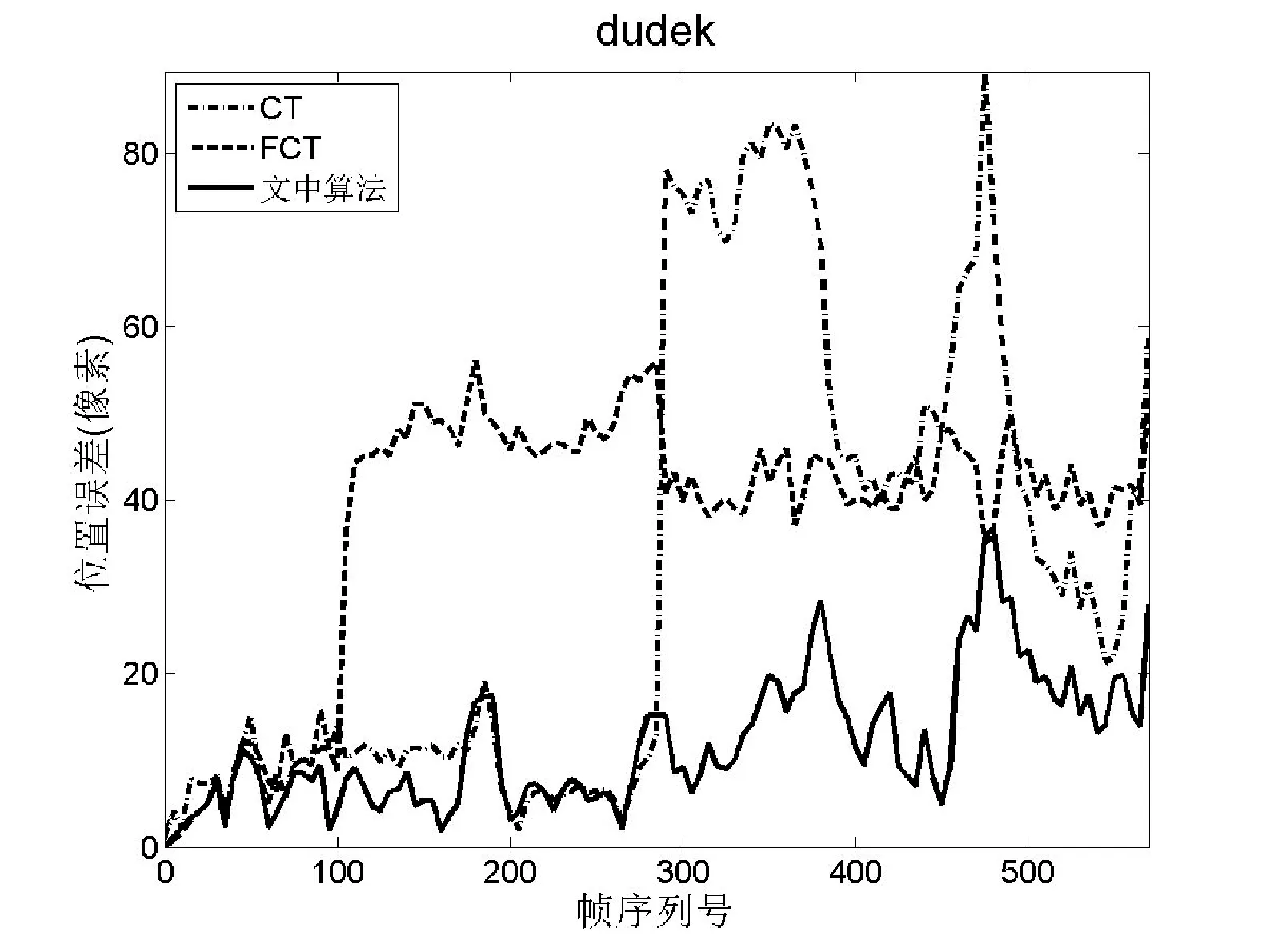

圖8 dudek序列跟蹤誤差曲線圖

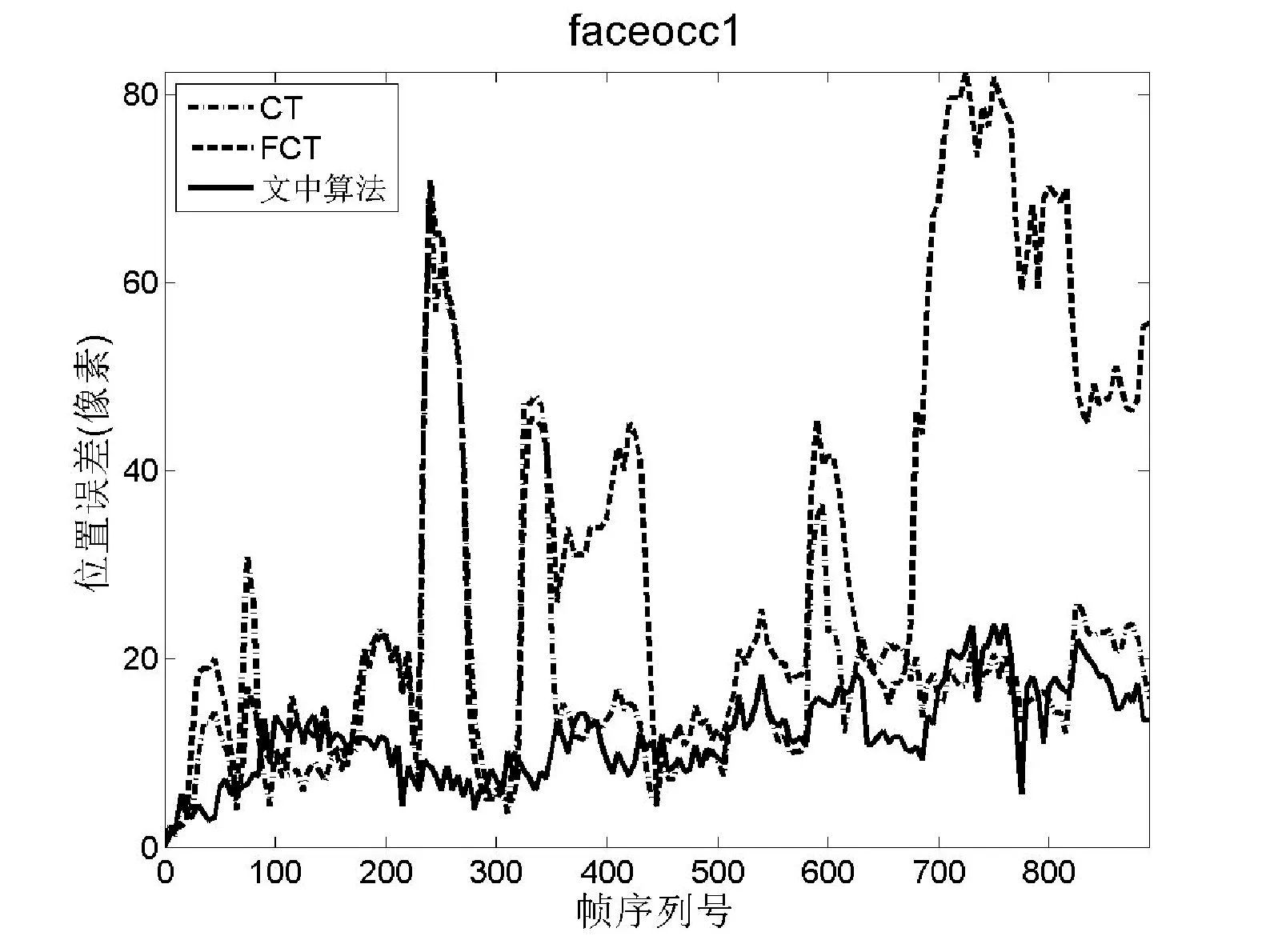

圖9 faceocc1序列跟蹤誤差曲線圖

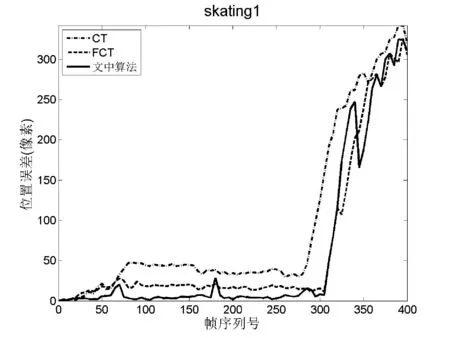

圖10 skating1序列跟蹤誤差曲線圖

表4給出了三種算法每幀的平均時耗對比。本文的改進算法在生成目標高維特征描述及度量目標與候選樣本之間相似性時增加了較少的計算量,使得改進的算法在時間上增加的開銷很小。由表4的時耗對比可得,三種算法均能達到實時的要求。

表4 平均時間 s/幀

對于david視頻序列,最主要的難題就是光照變化,同時還有形變及尺度變化等問題。對于CT算法,當目標的光照變化和紋理變化不大的情況下跟蹤較為準確,但視頻序列在第130幀左右時目標姿態發生變化,CT的跟蹤結果開始偏移。在第336幀左右時發生光照變化,此時跟蹤結果偏移加劇,甚至在549~654幀發生漂移。之后,當目標再次進入跟蹤框以后又跟蹤到目標(如圖3所示)。FCT算法在第336幀附近視頻序列發生光照變化時,跟蹤也不是很穩定(如圖3所示)。本文針對這一問題,進行了改進。在文中提出的算法中,通過獲取高效的高維特征描述,從而得到更加有效的低維壓縮特征用于分類。同時采用改進的相似性度量方法,當視頻序列中發生光照變化時,仍可以獲得準確的跟蹤結果(如圖3所示)。

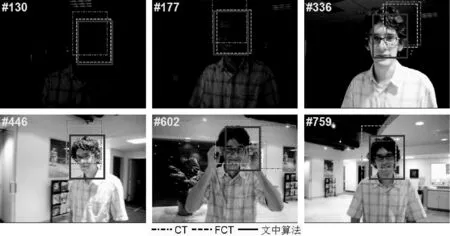

對于遮擋問題,dudek視頻序列和faceocc1視頻序列都體現了這一難題。dudek視頻序列在第103幀左右時發生遮擋,由跟蹤結果可以看到CT和FCT算法均發生偏移(如圖4所示)。對于本文的算法,由跟蹤結果(如圖4所示)可以看到改進的算法對于遮擋現象具有更強的魯棒性。faceocc1視頻序列最主要的挑戰就是遮擋。在視頻序列中,當目標發生遮擋時,由跟蹤結果易觀察到CT和FCT算法的跟蹤均不穩定,而改進的算法跟蹤結果仍很準確(如圖5所示)。同時,dudek視頻序列挑戰了形變和移動等問題。在第176幀和第286幀左右時目標發生了形變和移動,我們可以看到CT和FCT算法的跟蹤結果在后續視頻幀中均發生了大的偏移,本文算法則有效地抑制了這一現象,確保了跟蹤的準確性(如圖4所示)。

對于skating1視頻序列挑戰的難題有復雜背景和光照等。對于CT算法,在第75幀左右時目標背景和光照發生變化,其跟蹤結果有所偏移。同時,視頻序列從第282幀開始背景和目標差別不太明顯,此時CT算法跟蹤結果出現誤差,并發生漂移(如圖6所示)。對于FCT算法和文中的改進算法,在305幀之前的視頻序列中均實現了跟蹤目標的魯棒性(如圖6所示),但是對于跟蹤目標的精確性,本文的算法效果更好。在305幀以后的視頻序列中,由于目標和背景較為相似,在跟蹤結果中開始出現誤差,并發生漂移。因此,對于復雜背景下目標和背景差別不大的情況,本文算法仍具有一定的局限性,沒有達到很好的效果。

綜上,相對于CT算法和FCT算法,本文提出的改進算法獲得了良好的跟蹤結果。隨著濾波器尺寸的增大,通過濾波獲取的圖像的有效特征越少,這對于跟蹤過程很不利,極易在目標受到遮擋、光照等因素影響時引入誤差。因此,本文在生成目標高維特征時,采用自適應的權值分配機制,考慮不同尺度濾波器生成特征的有效性,獲取高效的特征描述。同時,算法在度量目標與候選樣本之間相似性時,不僅考慮疊加和,還計算各維壓縮特征被分類為目標壓縮特征的可能性,由兩者共同決定跟蹤結果。通過以上實驗證明,提出的改進算法在目標受到遮擋、光照、形變等因素的影響時,仍能獲得準確、穩定的跟蹤結果,相比較另兩種算法具有明顯的優勢。

5 結 語

本文針對文獻[12]中FCT算法中存在的問題,提出了特征加權的快速壓縮感知跟蹤算法。算法通過一定的權值分配機制,將不同尺度濾波器卷積獲得的特征賦予不同的權值,從而獲取高效的高維特征描述。同時算法在原分類器簡單疊加的基礎上,統計每個弱分類器分類結果為正樣本的個數,由兩者共同決定跟蹤結果,有效提高了目標跟蹤的準確性。對不同視頻序列的跟蹤結果表明,文中提出的改進算法在目標發生遮擋以及光照等變化時能夠獲得更準確的跟蹤結果。但是當跟蹤目標和背景較為相似時,文中算法仍具有一定的局限性,同時本文沒有提出針對尺度變化的解決方案,如何有效地解決這些問題,是本文后續的研究重點。

[1] 高文,朱明,賀柏根,等.目標跟蹤技術綜述[J].中國光學,2014,7(3):365-375.

[2] Kalal Z,Mikolajczyk K,Matas J.Tracking-learning-detection[J].IEEE Transactions on Pattern Analysis & Machine Intelligence,2012,34(7):1409-1422.

[3] Zhang K,Zhang L,Liu Q,et al.Fast visual tracking via dense spatio-temporal context learning[C]//13th European Conference on Computer Vision.Springer International Publishing,2014:127-141.

[4] Henriques J F,Caserio R,Martins P,et al.Exploiting the circulant structure of tracking-by-detection with kernels[C]//12th European Conference on Computer Vision,2012:702-715.

[5] Wang D,Lu H,Yang M H.Least soft-thresold squares tracking[C]//2013 IEEE Conference on Computer Vision and Pattern Recognition,2013:2371-2378.

[6] 袁雪,宋永端.目標跟蹤算法在光照突變條件下的應用[J].應用科學學報,2011,29(6):592-597.

[7] 許曉航,肖剛,云霄,等.復雜背景及遮擋條件下的運動目標跟蹤[J].光電工程,2013,40(1):23-30.

[8] 張彥超,許宏麗.遮擋目標的分片跟蹤處理[J].中國圖象圖形學報,2014,19(1):92-100.

[9] 尹宏鵬,劉兆棟,柴毅,等.壓縮感知綜述[J].控制與決策,2013,28(10):1441-1445,1453.

[10] 任越美,張艷寧,李映.壓縮感知及其圖像處理應用研究進展與展望[J].自動化學報,2014,40(8):1563-1575.

[11] Li H,Shen C,Shi Q.Real-time visual tracking using compressive sensing[C]//2011 IEEE Conference on Computer Vision and Pattern Recognition,2011:1305-1312.

[12] Zhang K,Zhang L,Yang M H.Fast compressive tracking[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2014,36(10):2002-2015.

[13] Achlioptas D.Database-friendly random projections:Johnson-Lindenstrauss with binary coins[J].Journal of Computer and System Sciences,2003,66(4):671-687.

[14] Baraniuk R,Davenport M,DeVore R,et al.A simple proof of the restricted isometry property for random matrices[J].Constructive Approximation,2008,28(3):253-263.

[15] Diaconis P,Freedman D.Asymptotics of graphical projection pursuit[J].The Annals of Statistics,1984,12(3):793-815.

[16] Zhang K,Zhang L,Yang M H.Real-time compressive tracking[C]//Proceedings of the 12th European Conference on Computer Vision.Springer,2012:864-877.

FAST COMPRESSIVE SENSING TRACKING BASED ON FEATURE WEIGHTING

Zhao Duan Xie Qi

(SchoolofInformationEngineering,ZhengzhouUniversity,Zhengzhou450001,Henan,China)

The target tracking algorithm based on compressive sensing is simple, real-time and efficient. Fast compressive tracking algorithm (FCT) generates high dimensional features of the target without considering the effectiveness of different scale filter generation features, and the similarity measure between target and candidate sample only considers simple superposition. It is easy to make the tracking result deviate under the influence of external factors such as illumination and occlusion. Aiming at these problems, a fast compressive sensing tracking algorithm based on feature weighting is proposed. The algorithm adaptively assigns weights according to the filter scale, and generates high dimensional features of the target. The likelihood of the algorithm to classify each dimension compression feature of the candidate sample as the target compression feature is multiplied by the Bayesian classifier output, which is used as a measure of similarity between the target and the candidate sample. The experimental results show that the proposed method is more robust to the influence of external factors such as illumination and occlusion.

Object tracking Compressive sensing Real time Feature weighting

2016-05-10。趙端,碩士生,主研領域:目標跟蹤。謝琦,教授。

TP3

A

10.3969/j.issn.1000-386x.2017.06.036