結(jié)合卷積神經(jīng)網(wǎng)絡(luò)和模糊系統(tǒng)的腦腫瘤分割*

師冬麗,李 鏘,關(guān) 欣

天津大學(xué) 微電子學(xué)院,天津 300072

1 引言

腦腫瘤分為良性腫瘤和惡性腫瘤兩類,良性腫瘤在通過手術(shù)治療后一般能夠恢復(fù)健康,惡性腫瘤因其頑固性難以治愈,又被稱為腦癌。調(diào)查顯示,美國(guó)僅2015年被診斷的腦腫瘤人數(shù)新增23 000人[1]。腦腫瘤已嚴(yán)重危害人類生命健康,如何更好地對(duì)其進(jìn)行診斷和治療十分重要。核磁共振成像(magnetic resonance imaging,MRI)具有非侵入性,能在患者不接受高電離輻射的情況下提供形狀、大小及位置等信息,且具有良好的軟組織對(duì)比度[2],因此在腦腫瘤的診斷、治療和手術(shù)引導(dǎo)中越來(lái)越受到人們的關(guān)注[3]。

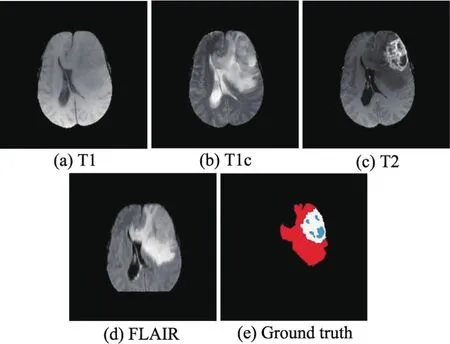

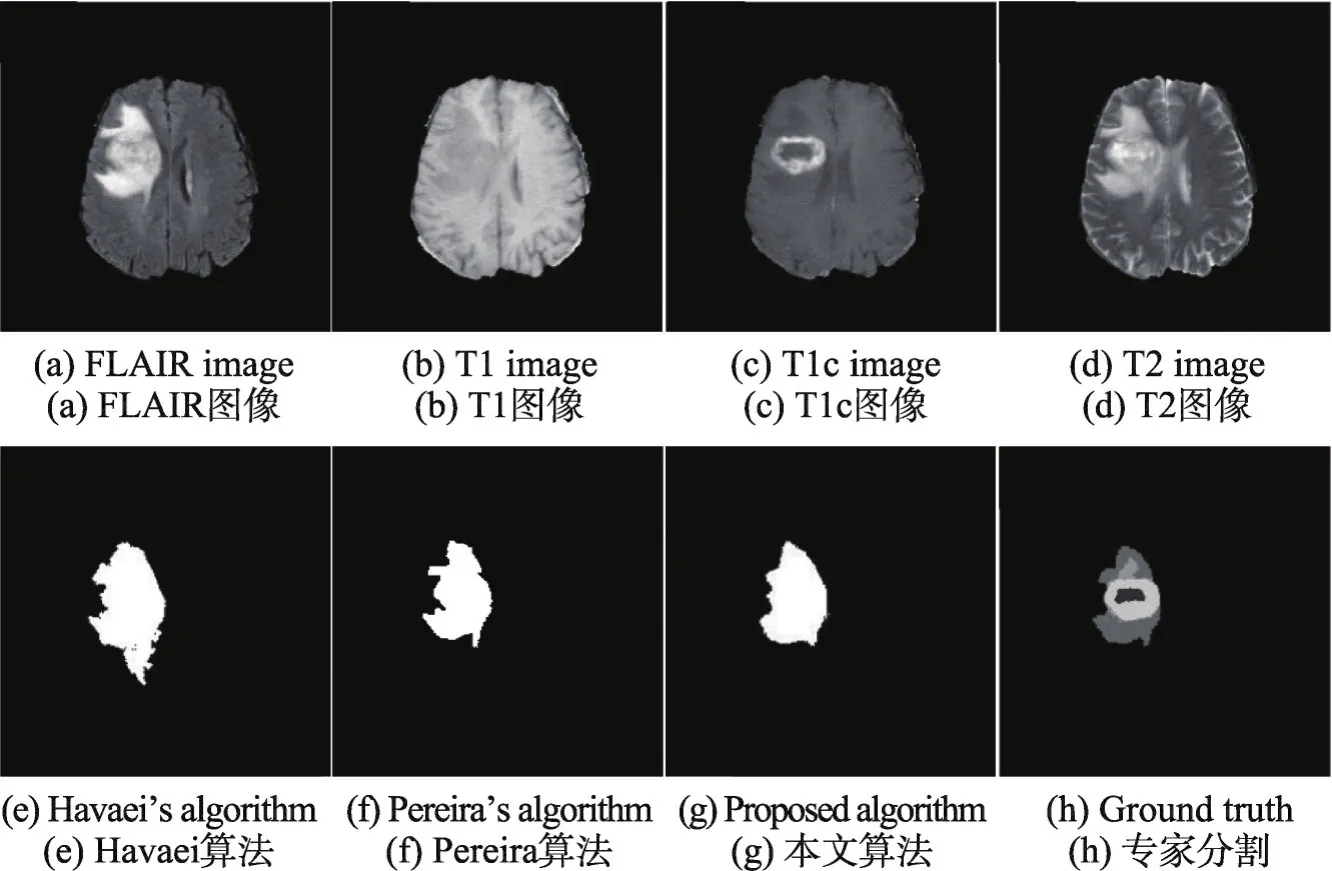

腦腫瘤患者的MRI成像是三維多波段成像,通常包括T1、T2、T1c和FLAIR等,不同的成像方式可以提供不同的腦腫瘤信息[4]。圖1顯示了同一患者腦部的4種MRI成像類型及其對(duì)應(yīng)的專家分割結(jié)果,其中藍(lán)色區(qū)域?yàn)槟[瘤,白色區(qū)域?yàn)槟易儯t色區(qū)域?yàn)樗[。腦腫瘤分割的目的是從包括灰質(zhì)、白質(zhì)和腦脊液的正常腦組織中分割出包含腫瘤、囊變和水腫等非正常腦組織區(qū)域[5]。圖1(a)是T1成像,因其操作簡(jiǎn)單,常用于腦腫瘤的結(jié)構(gòu)分析,但成像質(zhì)量差,無(wú)法提供更為詳盡的腫瘤特征信息。圖1(b)是T1c成像,由于增生性腦腫瘤區(qū)血腦屏障破壞導(dǎo)致造影劑積聚,使得T1c成像中的腦腫瘤邊界變得更明亮,很容易區(qū)分出腫瘤和囊變。圖1(c)是T2成像,水腫區(qū)域相比其他成像方式更加明亮,缺點(diǎn)是腦脊液和腫瘤的像素特征難以區(qū)分。圖1(d)是FLAIR成像,水腫區(qū)域邊界明顯,因此是目前分割腦腫瘤最有效的成像方式。

目前,針對(duì)MRI腦腫瘤的分割方法主要分為以下幾類:基于區(qū)域的分割方法、基于模糊聚類的分割方法和卷積神經(jīng)網(wǎng)絡(luò)方法等。

Fig.1 Four types of brain tumors and expert segmentation result圖1 4種類型腦腫瘤患者M(jìn)RI圖像及專家分割結(jié)果

基于區(qū)域生長(zhǎng)的分割方法首先在目標(biāo)區(qū)域選中一個(gè)種子點(diǎn),再將周圍具有相同性質(zhì)的像素點(diǎn)合并至種子區(qū)域,直到?jīng)]有相似性質(zhì)的像素點(diǎn)聚集為止。Weglinski等人[6]提出了利用區(qū)域生長(zhǎng)法來(lái)進(jìn)行腦腫瘤圖像的分割,并通過中值濾波減少噪聲對(duì)區(qū)域生長(zhǎng)法的影響。Deng等人[7]提出了在區(qū)域生長(zhǎng)法的基礎(chǔ)上,利用邊界的平均梯度和類內(nèi)方差的特征信息,在生長(zhǎng)過程中不斷調(diào)整生長(zhǎng)閾值以達(dá)到更好的分離精度。然而,對(duì)于區(qū)域生長(zhǎng)法而言,普遍存在對(duì)圖像陰影區(qū)域分割不理想的問題。

模糊聚類的分割方法是對(duì)圖像像素按其相似度進(jìn)行分類,使得同類個(gè)體間的距離較小而不同類個(gè)體間的距離較大。Khotanlou等人[8]采用模糊聚類方法進(jìn)行腦腫瘤的檢測(cè)與分割。Gopal等人[9]采用粒子群優(yōu)化算法選擇聚類中心。Logeswari等人[10]采用分級(jí)自組織映射選擇聚類中心。Havaei等人[11]根據(jù)一些最低限度的用戶交互信息,使用k近鄰的機(jī)器學(xué)習(xí)方法,結(jié)合簡(jiǎn)單的特征向量得到較好的腦腫瘤分割結(jié)果。然而,對(duì)于聚類算法而言,通常僅考慮每個(gè)像素點(diǎn)的獨(dú)立信息而忽略像素點(diǎn)之間的空間信息,最后導(dǎo)致算法受噪聲影響較大,且無(wú)法得到連續(xù)區(qū)域的分割結(jié)果。

1998年,Lecun等人[12]將卷積神經(jīng)網(wǎng)絡(luò)(convolution neural network,CNN)首次應(yīng)用于圖像識(shí)別領(lǐng)域,該網(wǎng)絡(luò)可以通過直接輸入原始圖像識(shí)別視覺上的規(guī)律,避免對(duì)圖像復(fù)雜的前期預(yù)處理。近年來(lái),CNN在腦腫瘤分割中得到了廣泛應(yīng)用。Zhao等人[13]提出了一種多尺度CNN模型,該模型可以自動(dòng)檢測(cè)圖像的最優(yōu)尺寸信息,并組合不同尺度區(qū)域周圍的像素信息。Havaei等人[14]使用級(jí)聯(lián)的體系結(jié)構(gòu),將第一個(gè)CNN模型的輸出作為一個(gè)額外的信息源提供給下一個(gè)CNN模型。Pereira等人[15]在CNN模型中使用較小尺寸的卷積核以提高神經(jīng)網(wǎng)絡(luò)的速度,更有利于提取圖像的特征。此外,它還有助于防止過擬合并減少網(wǎng)絡(luò)中權(quán)重參數(shù)的數(shù)目。然而,上述方法將多種類型腦腫瘤圖像同時(shí)作為模型輸入,沒有充分利用各類型腦腫瘤圖像自身的特征信息,最終使得輸入過多的冗余信息,進(jìn)而影響分割精確度。

模糊推理系統(tǒng)是以模糊集為基礎(chǔ),最終可以實(shí)現(xiàn)復(fù)雜的非線性映射的一種方法。2012年,Sharma等人[16]提出了一種將人工神經(jīng)網(wǎng)絡(luò)與模糊推理系統(tǒng)相結(jié)合的方法用于腦腫瘤圖像的檢測(cè)。

為了充分利用不同類型圖像的特性來(lái)提高腦腫瘤圖像的分割精度,本文提出了一種結(jié)合卷積神經(jīng)網(wǎng)絡(luò)和模糊推理系統(tǒng)的全自動(dòng)腦腫瘤MRI圖像分割算法。首先選取FLAIR和T2兩種成像方式,分別對(duì)其建立CNN模型來(lái)預(yù)測(cè)腫瘤概率。然后根據(jù)預(yù)測(cè)錯(cuò)誤樣本點(diǎn)建立非線性映射。最后將兩類圖像像素點(diǎn)的映射結(jié)果作為模糊推理系統(tǒng)的輸入,預(yù)測(cè)該像素點(diǎn)是否屬于腫瘤區(qū)域。

本文組織結(jié)構(gòu)如下:第2章簡(jiǎn)要回顧了卷積神經(jīng)網(wǎng)絡(luò)和模糊推理系統(tǒng)的基本原理;第3章提出了結(jié)合卷積神經(jīng)網(wǎng)絡(luò)和模糊推理系統(tǒng)的全自動(dòng)腦腫瘤MRI圖像分割算法;第4章進(jìn)行仿真實(shí)驗(yàn)并分析實(shí)驗(yàn)結(jié)果;第5章總結(jié)全文。

2 基本理論

2.1 卷積神經(jīng)網(wǎng)絡(luò)

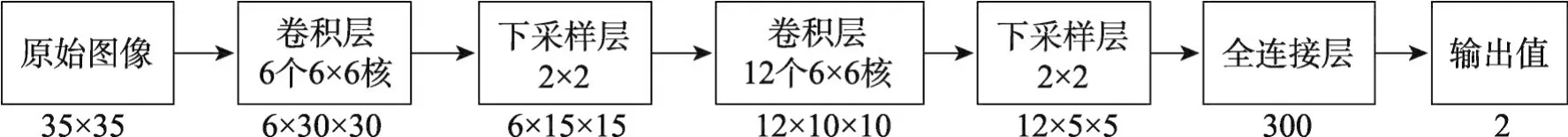

卷積神經(jīng)網(wǎng)絡(luò)是一種多層神經(jīng)網(wǎng)絡(luò),每層由多個(gè)二維平面組成,每個(gè)平面由多個(gè)獨(dú)立神經(jīng)元組成。CNN通過結(jié)合局部感知區(qū)域、共享權(quán)重、空間或者時(shí)間上的下采樣來(lái)充分利用數(shù)據(jù)本身包含的局部性等特征,優(yōu)化網(wǎng)絡(luò)結(jié)構(gòu),并且保證在一定程度上對(duì)位移、縮放和其他形式扭曲的不變性。一個(gè)經(jīng)典的卷積神經(jīng)網(wǎng)絡(luò)LeNet-5的結(jié)構(gòu)如圖2所示。卷積神經(jīng)網(wǎng)絡(luò)一般包括輸入層、卷積層、子采樣層、全連接層和輸出層。

卷積層又稱為特征映射層,網(wǎng)絡(luò)的每個(gè)計(jì)算層由多個(gè)特征映射組成,每個(gè)特征映射是一個(gè)平面,平面上所有神經(jīng)元的權(quán)值相等。在卷積層,前一層的特征圖和一個(gè)可學(xué)習(xí)的核進(jìn)行卷積,卷積結(jié)果經(jīng)過激活函數(shù)后得到這一層的特征圖。一般地,卷積層的形式如下:

式中,Mj為神經(jīng)元j對(duì)應(yīng)的局部感受野;是第l層的神經(jīng)元i的第j個(gè)輸入對(duì)應(yīng)的權(quán)值;為l層的第i個(gè)偏置量;為l-1層神經(jīng)元i的輸出;為l層神經(jīng)元j的輸出。

Fig.2 Structure chart of convolution neural network圖2 卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)圖

子采樣層又稱為特征提取層,每個(gè)神經(jīng)元的輸入與前一層的局部接受域相連,并提高該局部的閾值。如果輸入的特征圖為n個(gè),則經(jīng)過子采樣層后特征圖的數(shù)目不變,尺寸變小。子采樣層的形式如下:

式中,down()為下采樣;βl、bl分別為可訓(xùn)練參數(shù)和可訓(xùn)練偏置。

全連接層是與上一層全連接,將上一層輸出結(jié)果與權(quán)重向量相乘,再加上偏置項(xiàng),并將這一結(jié)果傳送給sigmoid函數(shù)或者tanh函數(shù)進(jìn)行計(jì)算。全連接層的形式如下:

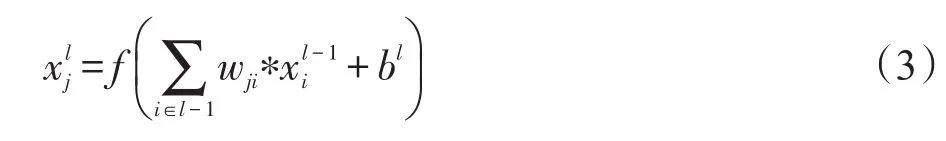

式中,wji為網(wǎng)絡(luò)中第l-1層的第i個(gè)輸入到第l層的第j個(gè)輸出的連接權(quán)重;bl為第l層的可訓(xùn)練偏置。

輸出層用于計(jì)算輸入樣本屬于各類別的概率,輸入樣本歸屬于所屬概率最大的類別,完成分類任務(wù)。

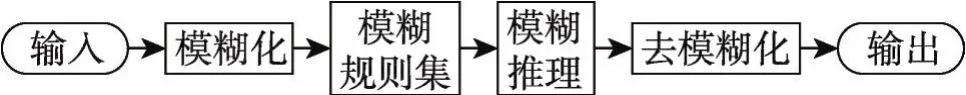

2.2 模糊推理系統(tǒng)

模糊推理系統(tǒng)作為智能計(jì)算的重要分支,以模糊集合為基礎(chǔ),引入模糊邏輯后以一定的程度值描述某一事件,從而體現(xiàn)事件更真實(shí)的情況,最終實(shí)現(xiàn)復(fù)雜的非線性映射關(guān)系。

模糊集是用來(lái)表達(dá)模糊性概念的集合。根據(jù)模糊集指定的規(guī)則稱為模糊規(guī)則,對(duì)于一個(gè)模糊系統(tǒng)而言,所有的模糊規(guī)則共同組成了該系統(tǒng)的模糊規(guī)則集。模糊推理系統(tǒng)框圖如圖3所示。

Fig.3 Flow chart of fuzzy inference system圖3 模糊推理系統(tǒng)框圖

首先,將輸入信息進(jìn)行模糊化,即將輸入從精確的數(shù)值根據(jù)輸入變量的模糊集轉(zhuǎn)化為模糊值。其次,根據(jù)建立好的模糊規(guī)則進(jìn)行匹配,從而進(jìn)行邏輯推理。根據(jù)邏輯推理,可以得到一個(gè)輸出結(jié)果的模糊值。最終,通過輸出變量的模糊集可以將輸出的模糊值進(jìn)行去模糊化,得到的結(jié)果為一個(gè)精確的輸出數(shù)值。去模糊化的計(jì)算公式如下:

式中,μ(?)表示該模糊變量的隸屬度函數(shù)。

3 本文算法原理

3.1 CNN模型

本文采用如圖2所示的CNN模型。

將每幅FLAIR和T2圖像以像素點(diǎn)為中心切分為若干個(gè)尺寸為35×35的圖像作為原始輸入。輸入圖像首先經(jīng)過由6個(gè)6×6鄰域的卷積核組成的卷積層后得到6個(gè)30×30的特征圖,再經(jīng)過下采樣得到6個(gè)15×15的特征圖;再經(jīng)過由12個(gè)6×6鄰域的卷積核組成的卷積層得到12個(gè)10×10的特征圖,并通過下采樣得到12個(gè)5×5的特征圖;然后通過全連接層將得到的特征圖轉(zhuǎn)化為一維特征;最后,在輸出層中得到輸入樣本是否屬于腫瘤的概率。

3.2 非線性映射

通過卷積神經(jīng)網(wǎng)絡(luò)得到的概率結(jié)果通常集中在0和1,然而在大樣本情況下這種過于集中的概率分布并不能較好地體現(xiàn)出概率相似的像素點(diǎn)之間的差異性。因此,需要通過非線性映射將錯(cuò)誤樣本點(diǎn)的概率均勻分布在0到1之間。

實(shí)驗(yàn)過程中,找出模型訓(xùn)練中所有腫瘤誤判為非腫瘤的樣本,將其預(yù)測(cè)概率從小到大排列并等分為10份,令其邊界值分別對(duì)應(yīng)于0,0.05,0.10,…,0.50。同理,找出訓(xùn)練樣本中所有非腫瘤誤判為腫瘤的訓(xùn)練樣本,并將其預(yù)測(cè)概率從小到大排列并等分為10份,令其邊界值分別對(duì)應(yīng)于0.50,0.55,0.60,…,1.00。最終,對(duì)邊界值和映射點(diǎn)進(jìn)行分段線性擬合得到非線性映射函數(shù)。

3.3 模糊推理系統(tǒng)

針對(duì)其他方法無(wú)法充分利用不同圖像特征信息的缺陷,本文根據(jù)不同類型成像方式的特點(diǎn),選取FLAIR和T2兩種模態(tài)圖像構(gòu)建模糊推理系統(tǒng)。通過對(duì)FLAIR和T2圖像的處理,可以得到每個(gè)像素點(diǎn)由單獨(dú)圖片預(yù)測(cè)的屬于腫瘤區(qū)域的概率p1和p2。模糊系統(tǒng)以p1和p2作為輸入,輸出則為最終的腫瘤概率。

對(duì)比FLAIR和T2圖像可以發(fā)現(xiàn),F(xiàn)LAIR的水腫區(qū)域邊界更為明顯,即在分割過程中,得到的結(jié)果相比T2圖像置信度更高。因此,在模糊系統(tǒng)中,希望以FLAIR圖像的結(jié)果作為基準(zhǔn),并利用T2圖像進(jìn)行調(diào)整。

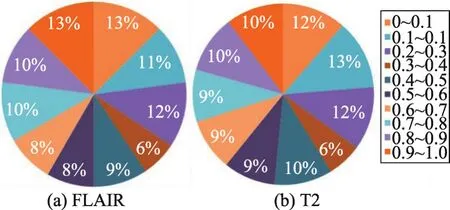

Fig.4 Input of fuzzy inference system圖4 模糊推理系統(tǒng)的輸入

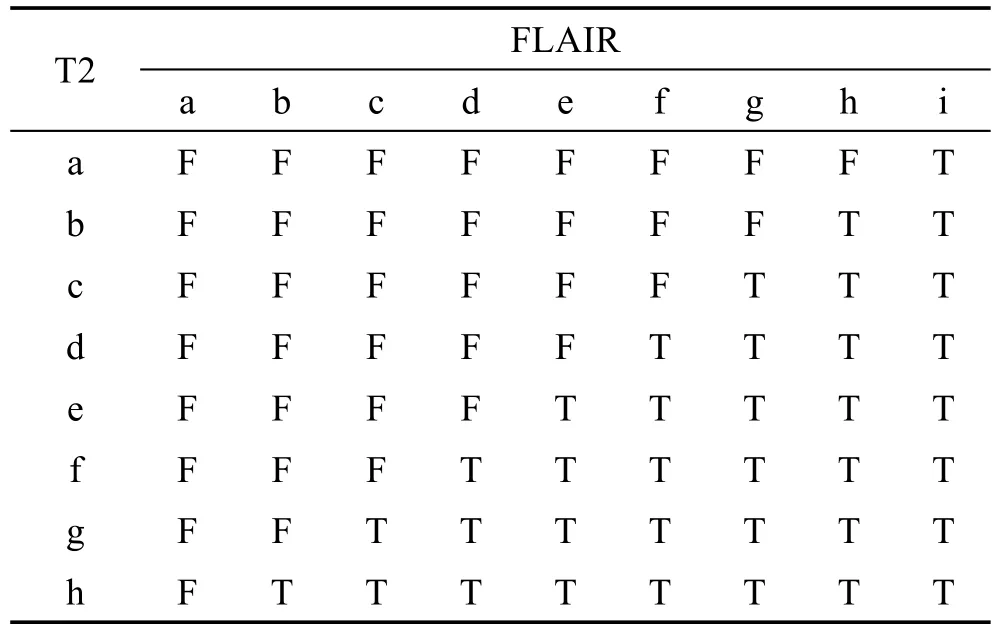

由于模糊推理系統(tǒng)有兩個(gè)輸入,分別存在9種和8種狀態(tài),從而模糊規(guī)則共分為9×8=72種情況。通過對(duì)訓(xùn)練集樣本進(jìn)行分析,得到具體的推理規(guī)則,如表1所示。

Table 1 Fuzzy rule表1 模糊規(guī)則

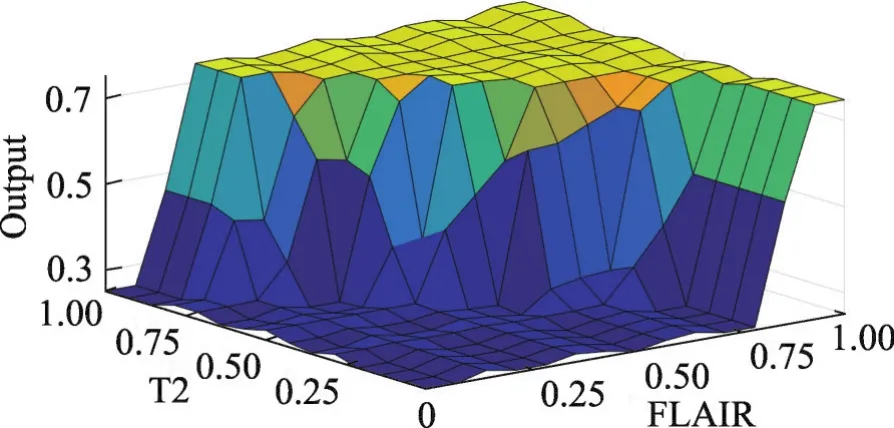

Fig.5 Relationship graph of input and output圖5 輸入輸出關(guān)系圖

該模糊系統(tǒng)的輸出為最終的非腫瘤概率。當(dāng)輸出結(jié)果小于0.50時(shí),則認(rèn)為該圖像對(duì)應(yīng)像素點(diǎn)屬于非腫瘤區(qū)域;而當(dāng)輸出結(jié)果大于0.50時(shí),則認(rèn)為該圖像對(duì)應(yīng)像素點(diǎn)屬于腫瘤區(qū)域。

3.4 算法流程

在利用本文算法進(jìn)行腦腫瘤分割時(shí),原始腦腫瘤圖像的對(duì)比度低,導(dǎo)致腫瘤區(qū)域分割困難,因此,首先需要對(duì)原始圖像進(jìn)行預(yù)處理。本文使用強(qiáng)度歸一化方法,將每幅圖像的灰度值均勻拉伸至0~255以增強(qiáng)圖像對(duì)比度。

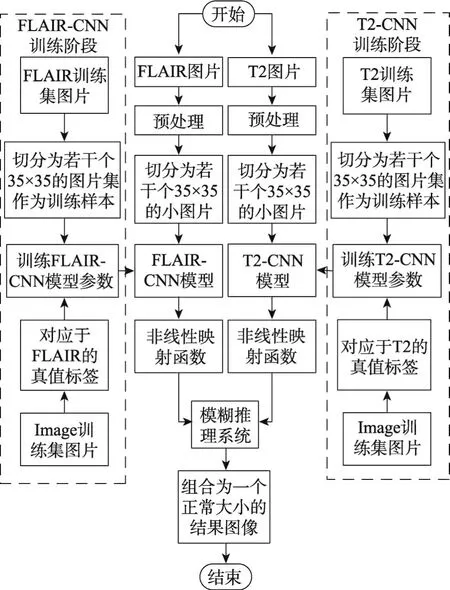

整體算法分為兩階段:訓(xùn)練階段和預(yù)測(cè)階段,如圖6所示。

Fig.6 Flow chart of algorithm圖6 算法流程圖

在訓(xùn)練階段,將選擇好的FLAIR和T2類型的腦腫瘤圖像經(jīng)過預(yù)處理后分割為若干個(gè)35×35的圖片集作為訓(xùn)練樣本,并將其對(duì)應(yīng)的專家分割結(jié)果圖的像素點(diǎn)作為該訓(xùn)練樣本的真值標(biāo)簽。然后,分別針對(duì)FLAIR和T2圖像分割出的圖片集進(jìn)行訓(xùn)練,得到FLAIR-CNN模型和T2-CNN模型。最后,分別針對(duì)FLAIR和T2圖像進(jìn)行非線性映射。

在預(yù)測(cè)階段,將FLAIR圖像和T2圖像經(jīng)過預(yù)處理后切分為35×35的圖像塊,對(duì)于每個(gè)圖像塊,分別利用對(duì)應(yīng)的CNN模型進(jìn)行預(yù)測(cè)得到初始預(yù)測(cè)概率。然后,將初始預(yù)測(cè)概率經(jīng)過非線性映射函數(shù)作為模糊推理系統(tǒng)的輸入,當(dāng)模糊推理系統(tǒng)的輸出大于0.50時(shí),認(rèn)為該點(diǎn)屬于腫瘤區(qū)域,否則屬于非腫瘤區(qū)域。最后,通過對(duì)所有圖像塊的處理,將結(jié)果組合成為一個(gè)正常大小的預(yù)測(cè)圖像,其中白色表示腫瘤區(qū)域,黑色表示非腫瘤區(qū)域。

4 實(shí)驗(yàn)結(jié)果與分析

為了驗(yàn)證本文方法的正確性和有效性,分別與卷積神經(jīng)網(wǎng)絡(luò)應(yīng)用于單模態(tài)和多模態(tài)圖像時(shí)腦腫瘤的分割結(jié)果進(jìn)行對(duì)比實(shí)驗(yàn)。實(shí)驗(yàn)所用的MRI圖像來(lái)自在線圖庫(kù)BRATS(brain tumor image segmentation benchmark,https://www.smir.ch/BRATS/Start2015),該圖庫(kù)由Menze、Jakab、Bauer等人組建,由包括ETH Zurich、University of Bern、University of Debreen 和University of Utah在內(nèi)的機(jī)構(gòu)提供完全匿名的患者數(shù)據(jù)[17]。圖庫(kù)中包含神經(jīng)膠質(zhì)瘤患者的4種已配準(zhǔn)圖像FLAIR、T1、T1c和T2。實(shí)驗(yàn)中從圖庫(kù)選取50例患者圖像數(shù)據(jù)用于訓(xùn)練,另選取10例患者圖像數(shù)據(jù)用于測(cè)試。實(shí)驗(yàn)機(jī)器采用Intel Core i7 3.5 GHz處理器,并搭載Nvidia GeForce GTX1070的GPU。

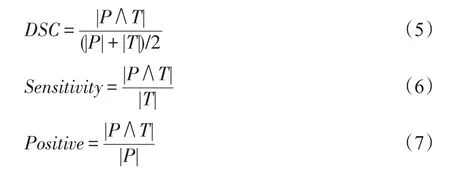

為了定量評(píng)估新算法的性能,本文選用相似性系數(shù)(dice similarity coefficient,DSC)、靈敏度(sensitivity)和陽(yáng)性預(yù)測(cè)率(predictive positivity value,PPV)[18]作為腦腫瘤分割結(jié)果的評(píng)價(jià)技術(shù)指標(biāo)。其中,DSC相似性系數(shù)描述實(shí)驗(yàn)分割結(jié)果和真值腫瘤之間的重疊程度[19];靈敏度表示正確分割的腫瘤點(diǎn)占真值腫瘤的比例;PPV陽(yáng)性預(yù)測(cè)率表示分割正確的腫瘤點(diǎn)占分割結(jié)果為腫瘤點(diǎn)的比例。定義如下:

其中,P表示模型預(yù)測(cè)結(jié)果的腫瘤區(qū)域;T表示專家標(biāo)定的腫瘤區(qū)域。

4.1 模型訓(xùn)練與非線性映射函數(shù)的確定

實(shí)驗(yàn)中,從圖庫(kù)選取50例患者圖像數(shù)據(jù)進(jìn)行訓(xùn)練。

首先,分別對(duì)FLAIR和T2圖像進(jìn)行切分,并將切分后的35×35大小的圖像塊作為卷積神經(jīng)網(wǎng)絡(luò)的訓(xùn)練集。訓(xùn)練完成后分別得到針對(duì)FLAIR圖像的FLAIR-CNN模型和針對(duì)T2圖像的T2-CNN模型。

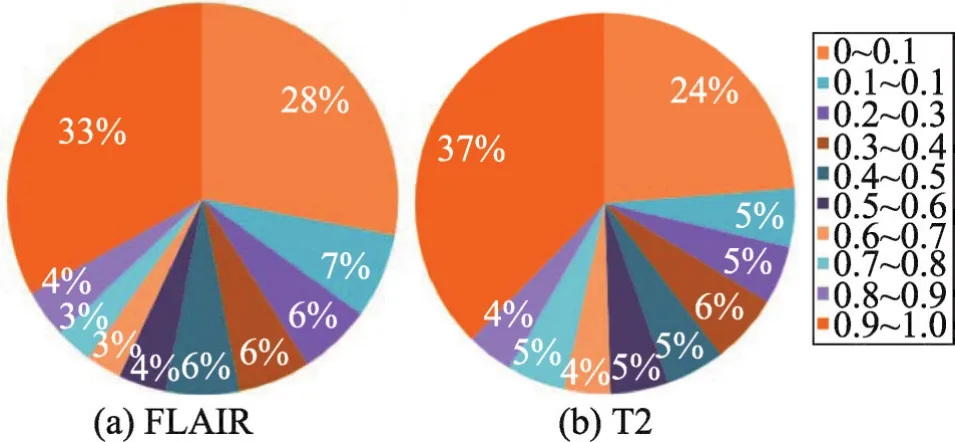

然后,分別將針對(duì)FLAIR圖像和T2圖像的訓(xùn)練集作為FLAIR-CNN模型和T2-CNN模型的輸入,對(duì)比模型預(yù)測(cè)值和真實(shí)值,并統(tǒng)計(jì)出所有錯(cuò)誤預(yù)測(cè)點(diǎn)的預(yù)測(cè)概率分布。對(duì)于FLAIR-CNN模型和T2-CNN模型而言,預(yù)測(cè)錯(cuò)誤點(diǎn)的預(yù)測(cè)分布概率如圖7所示。

Fig.7 Error prediction point distribution圖7 錯(cuò)誤預(yù)測(cè)點(diǎn)概率分布圖

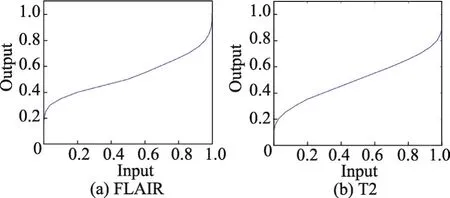

圖7(a)表示對(duì)于FLAIR-CNN模型所有預(yù)測(cè)錯(cuò)誤點(diǎn)的概率分布圖,圖7(b)表示對(duì)于T2-CNN模型所有預(yù)測(cè)錯(cuò)誤點(diǎn)的概率分布圖。從圖7中可以發(fā)現(xiàn),絕大部分的預(yù)測(cè)錯(cuò)誤點(diǎn)的概率集中在0~0.1區(qū)域和0.9~1.0區(qū)域。過于集中的概率分布并不利于針對(duì)不同概率來(lái)建立模糊推理系統(tǒng)進(jìn)行推斷。因此,本文分別對(duì)通過FLAIR-CNN模型和T2-CNN模型得到的預(yù)測(cè)概率進(jìn)行非線性映射,并將其結(jié)果作為模糊推理系統(tǒng)的輸入。為了將如圖7所示的概率分布進(jìn)行均衡化,使得其在每個(gè)區(qū)域的概率相似,構(gòu)建了如圖8所示的非線性映射函數(shù)。

Fig.8 Nonlinear mapping function圖8 非線性映射函數(shù)

圖8(a)表示針對(duì)FLAIR-CNN模型的非線性映射函數(shù),圖8(b)表示針對(duì)T2-CNN模型的非線性映射函數(shù)。經(jīng)過非線性映射后,F(xiàn)LAIR-CNN模型和T2-CNN模型所有錯(cuò)誤預(yù)測(cè)點(diǎn)的分布圖如圖9所示。

Fig.9 Error prediction point distribution after nonlinear mapping圖9 經(jīng)過非線性映射后錯(cuò)誤預(yù)測(cè)點(diǎn)分布圖

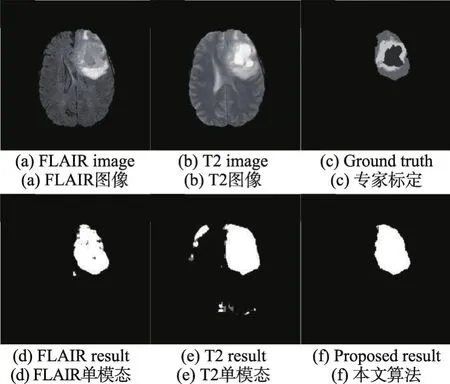

4.2 與單模態(tài)MRI圖像分割的比較

核磁共振為患者提供4種模式的腦腫瘤成像,不同模態(tài)成像側(cè)重的信息有很大區(qū)別。對(duì)于包括水腫在內(nèi)的腦腫瘤分割,F(xiàn)LAIR圖像和T2圖像的輪廓更為明顯。為了驗(yàn)證本文算法的有效性,將其與單獨(dú)使用FLAIR圖像或T2圖像訓(xùn)練得到的單模態(tài)腦腫瘤MRI分割模型進(jìn)行對(duì)比,實(shí)驗(yàn)結(jié)果如圖10所示。

Fig.10 Compared with single mode MRI segmentation method圖10 與單模態(tài)MRI圖像分割方法比較結(jié)果圖

圖10中,(a)為患者的FLAIR成像,(b)為同一患者的T2成像,(c)和(d)分別表示單獨(dú)使用FLAIR圖像和T2圖像得到的訓(xùn)練模型的分割結(jié)果,(e)為專家標(biāo)定的分割結(jié)果,(f)為本文算法的分割結(jié)果。從圖中可看出,單獨(dú)使用FLAIR分割得到的結(jié)果基本輪廓清晰,精確度較高,但是預(yù)測(cè)腫瘤內(nèi)部有多個(gè)漏判點(diǎn),且在非腫瘤區(qū)域也存在部分較為集中的錯(cuò)判區(qū)域。而單獨(dú)使用T2圖像進(jìn)行訓(xùn)練得到的模型分割結(jié)果雖然腫瘤區(qū)域分割良好,但在非腫瘤區(qū)域存在多處錯(cuò)誤判別區(qū)域。本文結(jié)合兩種單模態(tài)圖像的訓(xùn)練模型分割結(jié)果,一方面克服了非腫瘤區(qū)域過多的錯(cuò)判點(diǎn),另一方面避免了腫瘤區(qū)域內(nèi)部的漏判,最終達(dá)到了更好的分割結(jié)果。

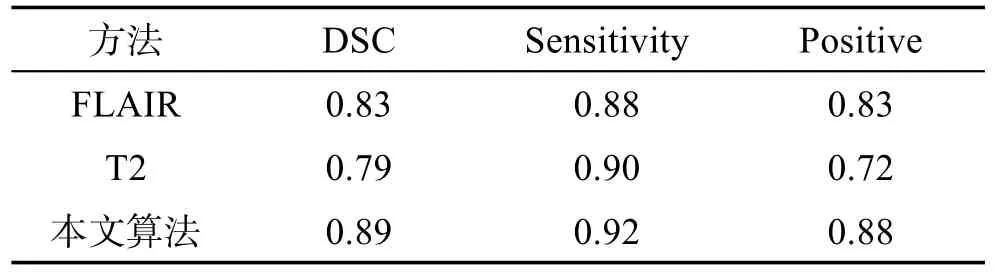

FLAIR和T2兩種單模態(tài)分割方法和本文算法的分割比較結(jié)果如表2所示。

Table 2 Compared with single mode segmentation method表2 與單模態(tài)分割方法比較結(jié)果

從表2中可以看出,相比T2,單獨(dú)使用FLAIR圖像預(yù)測(cè)的分割精確度和陽(yáng)性預(yù)測(cè)率更高,而靈敏度略差。對(duì)比FLAIR和T2兩種單模態(tài)MRI圖像分割結(jié)果可以看出,本文算法在相似性指數(shù)、靈敏度和陽(yáng)性預(yù)測(cè)率上都有很大提升。

4.3 與多模態(tài)MRI圖像分割的比較

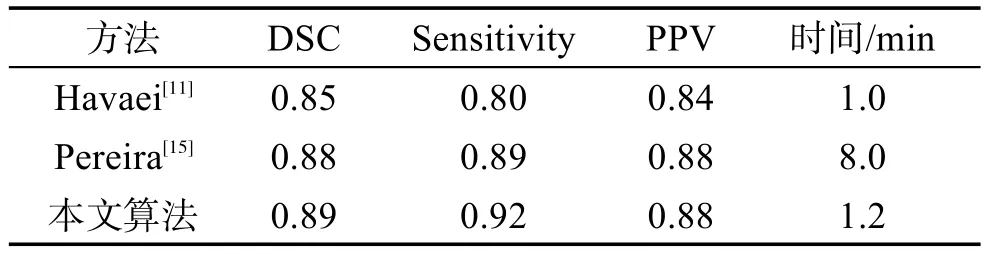

為了定量評(píng)估算法的性能,將本文算法同Havaei[11]和Pereira[15]所提算法分別進(jìn)行比較,分割結(jié)果如圖11所示。

Fig.11 Compared with multi-modal MRI segmentation method圖11 與多模態(tài)MRI圖像分割方法比較結(jié)果圖

圖11中,(a)、(b)、(c)、(d)分別為腦腫瘤MRI圖像的FLAIR、T1、T1c和T2圖像。(e)為k近鄰機(jī)器學(xué)習(xí)方法分割結(jié)果,(f)為小卷積核下的卷積神經(jīng)網(wǎng)絡(luò)方法分割結(jié)果,(g)為本文算法的腦腫瘤分割結(jié)果,(h)為專家標(biāo)定的腦腫瘤分割結(jié)果。對(duì)比圖(e)、(f)、(g)可以看出,(e)的分割結(jié)果相對(duì)較差,而(f)和(g)的分割結(jié)果相對(duì)較好。

為了進(jìn)一步定量比較3種不同腦腫瘤分割算法的分割性能,針對(duì)10例測(cè)試圖像,分別用3種腦腫瘤分割算法進(jìn)行分割,并用10例測(cè)試圖像的DSC、Sensitivity和PPV的平均值來(lái)評(píng)估算法性能,結(jié)果如表3所示。

Table 3 Segmentation performance evaluation of 3 segmentation methods表3 3種分割方法的分割性能評(píng)估

本文算法分割一幅完整腦腫瘤圖像平均時(shí)間約1.2 min。對(duì)比Havaei的算法結(jié)果,盡管耗時(shí)略長(zhǎng),但在Sensitivity指標(biāo)上提高了12%,DSC和PPV也同時(shí)提高了4%,使最終分割結(jié)果有了顯著提升。對(duì)比Pereira提出的算法,本文降低了神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)的復(fù)雜度,使得分割速度提升近7倍。此外,通過引入模糊推理系統(tǒng)對(duì)FLAIR和T2圖像特征的結(jié)合,使得分割結(jié)果相比Pereira提出的算法在DSC和Sensitivity指標(biāo)上分別提升1%和3%。

5 總結(jié)

針對(duì)MRI腦腫瘤圖像分割,本文提出一種結(jié)合卷積神經(jīng)網(wǎng)絡(luò)和模糊推理系統(tǒng)的全自動(dòng)腦腫瘤MRI圖像分割算法。本文算法首先通過卷積神經(jīng)網(wǎng)絡(luò)分別處理FLAIR和T2圖像,然后將預(yù)測(cè)概率經(jīng)過非線性變換作為模糊推理系統(tǒng)的輸入,最后對(duì)其輸出以0.50為閾值得到像素點(diǎn)分類結(jié)果,并將全部像素點(diǎn)組合完成腦腫瘤分割。本文算法充分利用了腦腫瘤不同類型圖像的特性。實(shí)驗(yàn)結(jié)果證明,本文算法在分割性能上相比傳統(tǒng)方法有了一定程度的提升。

[1]álvarez J M,Gevers T,Lecun Y,et al.Road scene segmentation from a single image[C]//LNCS 7578:Proceedings of the 12th European Conference on Computer Vision,Florence,Oct 7-13,2012.Berlin,Heidelberg:Springer,2012:376-389.

[2]Liang Zhipei,Lauterbur P C.Principles of magnetic resonance imaging:a signal processing perspective[M].Washington:SPIE,2000.

[3]Wen PY,Macdonald D R,Reardon D A,et al.Updated response assessment criteria for high-grade gliomas:response assessment in neuro-oncology working group[J].Journal of Clinical Oncology:Official Journal of the American Society of Clinical Oncology,2010,28(11):1963-1972.

[4]Liu Jin,Li Min,Wang Jianxin,et al.A survey of MRI-based brain tumor segmentation methods[J].Tsinghua Science and Technology,2014,19(6):578-595.

[5]Corso J J,Sharon E,Dube S,et al.Efficient multilevel brain tumor segmentation with integrated Bayesian model classification[J].IEEE Transactions on Medical Imaging,2008,27(5):629-640.

[6]Weglinski T,Fabijanska A.Brain tumor segmentation from MRI data sets using region growing approach[C]//Proceedings of the 7th International Conference on Perspective Technologies and Methods in MEMS Design,Polyana,May 11-14,2011.Piscataway:IEEE,2011:185-188.

[7]Deng Wankai,Xiao Wei,Deng He,et al.MRI brain tumor segmentation with region growing method based on the gradients and variances along and inside of the boundary curve[C]//Proceedings of the 3rd International Conference on Biomedical Engineering and Informatics,Yantai,Oct 16-18,2010.Piscataway:IEEE,2010:393-396.

[8]Khotanlou H,Colliot O,Atif J,et al.3D brain tumor segmentation in MRI using fuzzy classification,symmetry analysis and spatially constrained deformable models[J].Fuzzy Sets&Systems,2009,160(10):1457-1473.

[9]Gopal N N,Karnan M.Diagnose brain tumor through MRI using image processing clustering algorithms such as fuzzy C means along with intelligent optimization techniques[C]//Proceedings of the 2010 IEEE International Conference on Computational Intelligence and Computing Research,Coimbatore,Dec 28-29,2010.Piscataway:IEEE,2010:1-4.

[10]Logeswari T,Karnan M.An improved implementation of brain tumor detection using segmentation based on soft computing[J].Journal of Cancer Research and Experimental Oncology,2010,2(1):6-14.

[11]Havaei M,Jodoin P M,Larochelle H.Efficient interactive brain tumor segmentation as within-brainkNN classification[C]//Proceedings of the 22nd International Conference on Pattern Recognition,Stockholm,Aug 24-28,2014.Washington:IEEE Computer Society,2014:556-561.

[12]Lécun Y,Bottou L,Bengio Y,et al.Gradient-based learning applied to document recognition[J].Proceedings of the IEEE,1998,86(11):2278-2324.

[13]Zhao Liya,Jia Kebin.Multiscale CNNs for brain tumor segmentation and diagnosis[J].Computational&Mathematical Methods in Medicine,2016(7):8356294.

[14]Havaei M,Davy A,Warde-Farley D,et al.Brain tumor segmentation with deep neural networks[J].Medical Image Analysis,2017,35:18-31.

[15]Pereira S,Pinto A,Alves V,et al.Brain tumor segmentation using convolutional neural networks in MRI images[J].IEEE Transactions on Medical Imaging,2016,35(5):1240-1251.

[16]Sharma M,Mukharjee S.Artificial neural network fuzzy inference system(ANFIS)for brain tumor detection[EB/OL].(2012-10).https://arxiv.org/abs/1212.0059v1.

[17]Menze B H,Jakab A,Bauer S,et al.The multimodal brain tumor image segmentation benchmark(BRATS)[J].IEEE Transactions on Medical Imaging,2015,34(10):1993-2024.

[18]Lyksborg M,Puonti O,Agn M,et al.An ensemble of 2D convolutional neural networks for tumor segmentation[C]//LNCS 9127:Proceedings of the 19th Scandinavian Conference on Image Analysis,Copenhagen,Jun 15-17,2015.Berlin,Heidelberg:Springer,2015:201-211.

[19]Dice L R.Measures of the amount of ecologic association between species[J].Ecology,1945,26(3):297-302.