智能視覺感知與理解研究態勢分析

張 迪,魯 寧,李宜展,滕 飛,王 麗

1.中國科學院 文獻情報中心,北京 100190

2.中國科學院大學,北京 100190

3.中國科學院 自動化研究所,北京 100190

1 引言

視覺感知與理解是客觀事物通過人的視覺在人腦中形成的直接反映,以及進一步的理解和認識。智能視覺感知與理解研究利用計算機系統解釋視覺圖像,實現類似人類或其他高等生物視覺系統理解外部世界的行為,是當前計算機領域的研究熱點和難點。從1966年學科建立(Summer Vision Project,MIT)至今,盡管智能視覺感知與理解領域仍有大量難以理解,尚待解決的問題,該技術還是取得了長足的進步,尤其是隨著視頻內容的井噴發展,智能視覺感知與理解研究獲得了大量的數據支撐,同時也獲得了重要的應用場景。智能視覺感知與理解開始在智慧交通、智能安防、醫療影像分析、自動駕駛、機器人等領域獲得重要的應用,各國也進行了相應的規劃制定和項目部署,數據量的增加使大范圍視覺感知和理解以及無人平臺的視覺感知與理解成為重要的研究方向,行業各相關公司也都推出了重要的視覺感知與理解相關產品。

2 政策規劃與項目部署

2.1 政策規劃

視覺感知與理解技術是人工智能、智慧城市、智慧交通、智能安防等領域的重要研究內容。在人工智能、智慧城市、智慧交通、智能安防相關的規劃部署文件中,都不同程度地提到對視覺感知設備和理解方法的研發需求和培育要求。

人工智能是信息時代的尖端科技,各國政府皆不遺余力的推進一系列人工智能戰略和產業規劃。美國在人工智能方面起步較早,科研機構、企業和軍方為人工智能貢獻了大量的技術和應用。智能視覺感知作為人工智能的主要研究領域,國家組織了大量的力量進行研究攻關,其中,2015年底,美國國家科學基金會(NSF)“國家機器人計劃第四輪”聯合國防部(DOD)、國防部高級研究計劃局(DARPA)、國家航空航天局(NASA)、國立衛生研究院(NIH)、農業部(USDA)等聯邦機構部門宣布,將投資3 700萬美元用于推動協作機器人(corobots)的開發與使用,其中感知和理解方面,就涉及傳感器/生物傳感器系統和網絡,針對特定目標的高空間分辨率和高時間分辨率的實時環境感知系統,各種光照條件下的目標識別感知系統和增強智能感知的策略等。2016年12月,白宮發布了一份名為《人工智能、自動化和經濟》[1]報告,提出了聯邦政府對智能監控方面的需求。韓國也非常重視人工智能領域的研究,韓國投資了引人矚目的人工智能計劃“Deep View”,該項目就是一項計算機視覺相關項目。我國人工智能雖然起步較晚,但政府也一直努力推進人工智能的研究,《“十三五”國家科技創新規劃》明確人工智能作為發展新一代信息技術的主要方向,在圍繞新一代信息技術等十大領域構建現代產業技術體系中明確指出“發展自然人機交互技術,重點是智能感知與認知、虛實融合與自然交互、語義理解和智慧決策”[2]。2016年8月26日,國家發展改革委發布《關于請組織申報“互聯網+”領域創新能力建設專項的通知》[3],批準建立了由百度、清華大學、北京航空航天大學等組成的“深度學習國家隊”,該國家隊將在聽覺、視覺感知和語言理解三個人工智能基礎領域實現技術突破。發改委推出的機器人產業發展規劃(2016—2020年)[4]提出重點圍繞人工智能、感知與識別、機構與驅動、控制與交互等方面開展基礎和共性關鍵技術研究。除了美國、韓國和中國之外,歐盟發起的“藍腦計劃”“人類大腦工程”也引領了人工智能前沿技術的發展,英國的“數字英國戰略”、日本的“機器人新戰略”、人工智能產業化路線圖,都在國家層面對人工智能領域進行了部署。這些人工智能項目都涉及感知與理解的相關研究和部署。

智慧城市方面,日本“第5期科技基本規劃”,提出名為“超級智能社會”[5]的未來社會構想,要最大限度應用物聯網、機器人、人工智能、大數據等信息通訊技術,建設繼狩獵社會、農耕社會、工業社會、信息社會之后的超智慧社會(社會5.0)。美國國家科學基金會(NSF)利用“產業與高校合作研究中心項目”(IUCRC)[6]鼓勵以產研結合的方式加強物聯網平臺、智慧城市、交通及其管理系統方面的研究。智慧城市的建設離不開感知與理解技術的研發。

智慧交通方面,2017年2月,我國國務院印發了《“十三五”現代綜合交通運輸體系發展規劃》[7],在提升交通發展智能化水平方面,提出了檢測設備與交通設施同步建設,建立網絡平臺,形成動態感知、全面覆蓋、泛在互聯的交通運輸運行監控體系。美國的《智能交通系統(ITS)戰略規劃2015—2019年》[8]提出包括實時監測、探測區域性交通流運行狀況,快速收集各種交通流運行數據,及時分析交通流量運行特征、預測變化,制訂最佳應變措施和方案,將遠程信息處理網絡連入車載裝置等感知理解相關內容。

智能安防方面,我國《關于加強公共安全視頻監控建設聯網應用工作的若干意見》[9]提出截止2020年,相關部門將加大安防視頻監控力度,使用人工智能等技術實現全網覆蓋、全網監控,建立公共安全視頻監控網和視頻分析平臺的指示。《中國安防行業“十三五”(2016—2020年)發展規劃》[10]提出用視頻結構化描述技術改造傳統的視頻監控系統,使之形成新一代的視頻監控系統智慧化、語義化、情報化的語義視頻監控系統,同時開展有關視頻結構化描述數據的應用服務模式研究,針對典型應用環境制定視頻結構化應用的系統及解決方案。

綜合人工智能、智慧城市、智慧交通、智能安防方向的政策部署來看,視覺感知與理解都將在其中扮演重要的角色,政策著力點大多在于基礎設置的建設以及相關感知與理解技術的研發。

2.2 項目部署

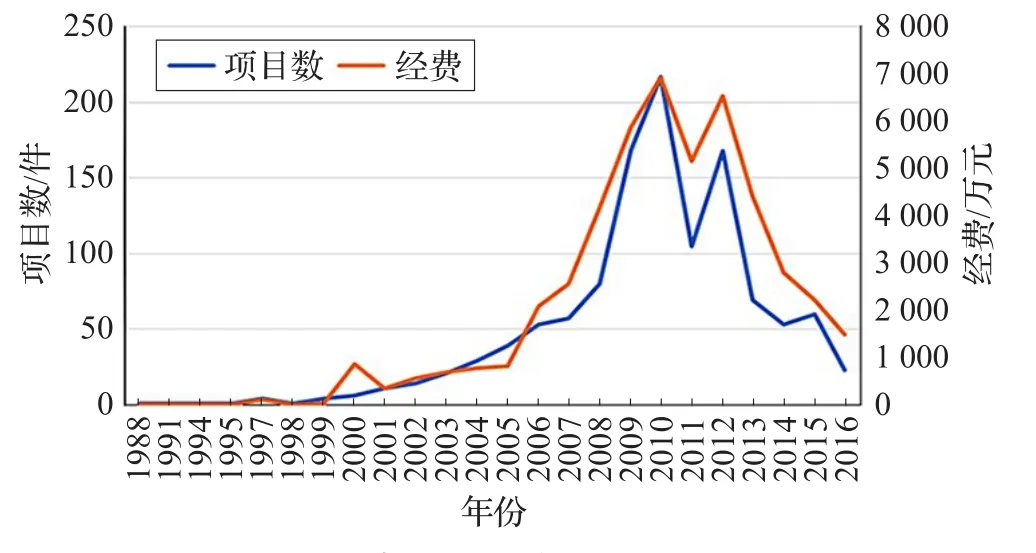

利用國家自然科學基金NSFC數據庫數據對我國視覺感知與理解相關的項目進行分析,可以看出我國國家自然科學基金對該領域的項目支持力度是非常大的,截止2016年(由于數據庫收錄2016年之前數據),項目數量1 186項,經費近5億。資助的項目從1988年開始,數量在2010年達到峰值。從項目類型來看,面上項目、青年科學基金項目、重大研究計劃項目和重點項目的經費超過總額的85%。覆蓋面也是較為廣泛的,除主要的面上項目、青年科學基金項目外,還支持了專項基金項目、聯合基金項目、地區科學基金項目、國際合作交流項目等,如圖1和表1所示。

圖1 國家自然科學基金項目資助趨勢

表1 國家自然科學基金資助項目類型分布

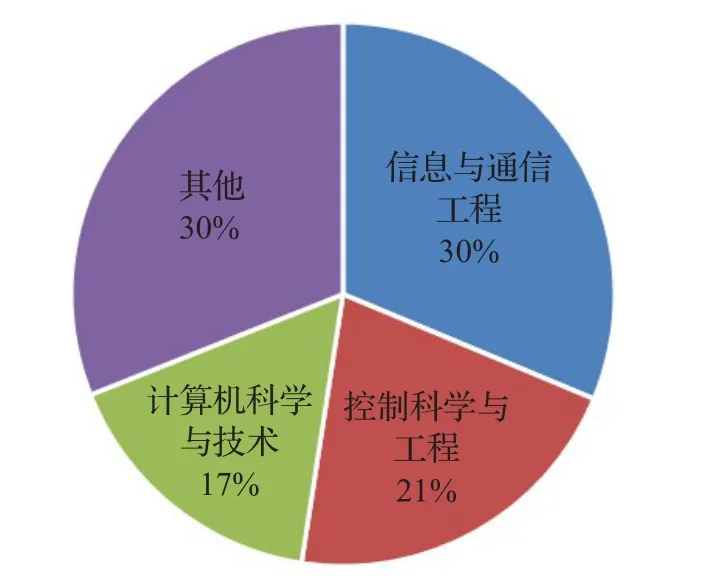

從項目所屬的學科來看(圖2),信息與通信工程、控制科學與工程、計算機科學與技術三大領域的項目數量最多,分別占總量的31%、21%和17%。在其他類型中,包含了地理學、生物、交通運輸、管理工程、海洋等多個學科。從此也可以看出,視覺感知與理解領域的技術應用前景廣闊。

圖2 國家自然科學基金資助項目所屬學科分布

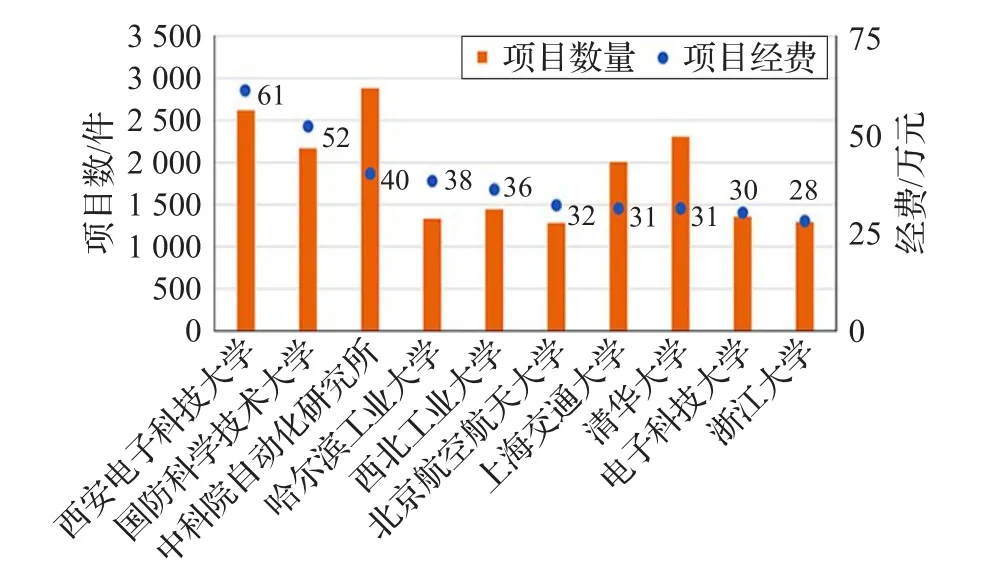

從項目申請的機構來看(圖3),西安電子科技大學以61個科研項目排名第一,經費為2 614萬元。中科院自動化研究所申請科研項目40項,雖然項目數不及西安電子科技大學,但經費數量2 885萬元,排名第一。

圖3 國家自然科學基金資助項目申請量TOP10機構

3 大范圍視頻視覺感知與理解研究態勢

隨著數字視頻監控技術的發展和國際安全形勢的日趨嚴峻,世界各國部署的視頻監控系統越來越密集,攝像頭等設備數量上的增加帶來了大范圍視覺采集的可能,通過人工處理這些海量的視頻數據,變得很不現實的。基于計算機視覺的大范圍視頻內容識別和理解,就成為了大范圍視頻解析平臺必不可少的核心技術。

黃凱奇等綜述認為[11]基于視頻的視覺識別與解析理解技術方法主要包括目標檢測、目標分類、目標跟蹤和行為分析四個方面,涉及特征選擇與提取、特征降維、融合增強、姿態識別、個體識別、行為識別、事件分析等眾多技術分支。單言虎[12]等綜述了人的視覺識別行為研究,認為更為真實的使用場景,深度學習在時序數據中的應用,新型傳感器數據將為視覺識別帶來契機。姜丹[13]等綜述了視頻處理在智能交通中的應用現狀及發展趨勢,對基于內容的視頻分析與檢索視頻檢索系統進行了介紹。

本文通過對Web of Science數據庫收錄的大范圍視頻視覺感知與理解論文的計量分析,也可以觀察近年來大范圍視頻視覺感知與理解的研究動態和應用情況。

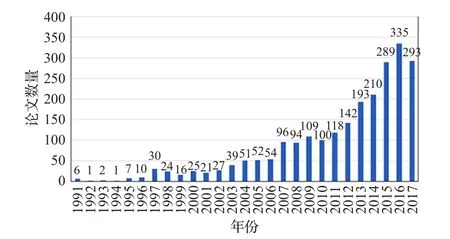

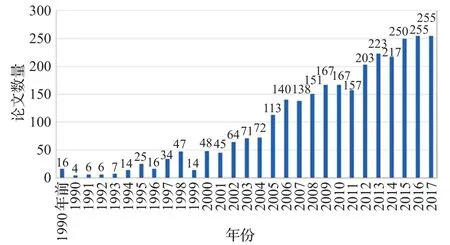

從圖4可以看出,在20世紀90年代已經出現涉及大范圍視頻視覺感知與理解技術的研究,近年來的年發文量增長顯著,尤其是在2013年之后,每年的增長量都在50篇左右(2017年數據不完整,僅供參考)。這說明視頻視覺感知與理解的研究成果越來越多,研究受到了越來越多的關注。

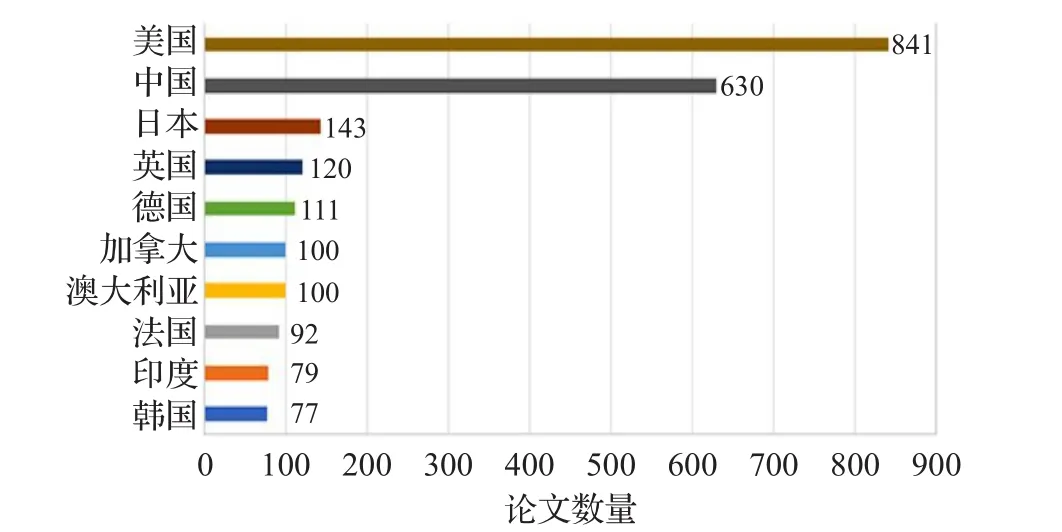

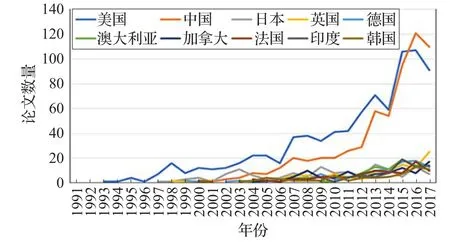

從發文國家來看(圖5),美國和中國的產出較多,分別占總量的35%和26%,其后是日本、英國、德國、加拿大、澳大利亞、法國、印度和韓國。從美、中兩國年度發文趨勢來看(圖6),美國的年發文量基本維持在年發文總量的30%~40%,而中國自2012年以來快速增長,出現明顯的趕超趨勢,其他國家的發文量保持緩慢增長的趨勢。

圖4 大范圍視頻視覺感知與理解方向發文趨勢

圖5 大范圍視頻視覺感知與理解方向論文國家分布

圖6 大范圍視頻視覺感知與理解方向各國發文趨勢

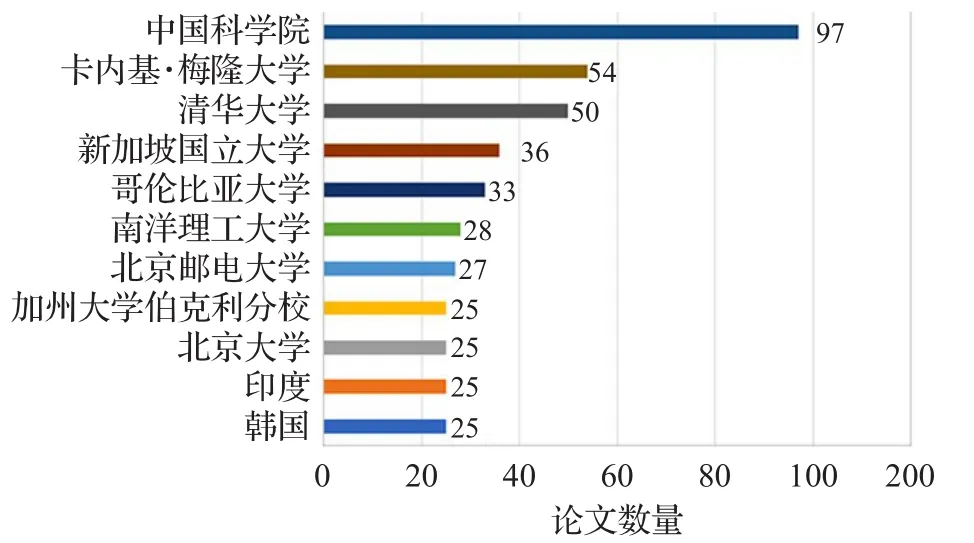

對發表論文的主要機構進行分析(圖7),可以看出,大范圍視頻視覺感知與理解方面重要的研究機構是中國科學院、卡內基-梅隆大學、清華大學、新加坡國立大學、哥倫比亞大學、南洋理工大學、北京郵電大學、香港大學、微軟亞洲研究院、北京大學和加州大學伯克利分校。

圖7 大范圍視頻視覺感知與理解論文發表主要機構

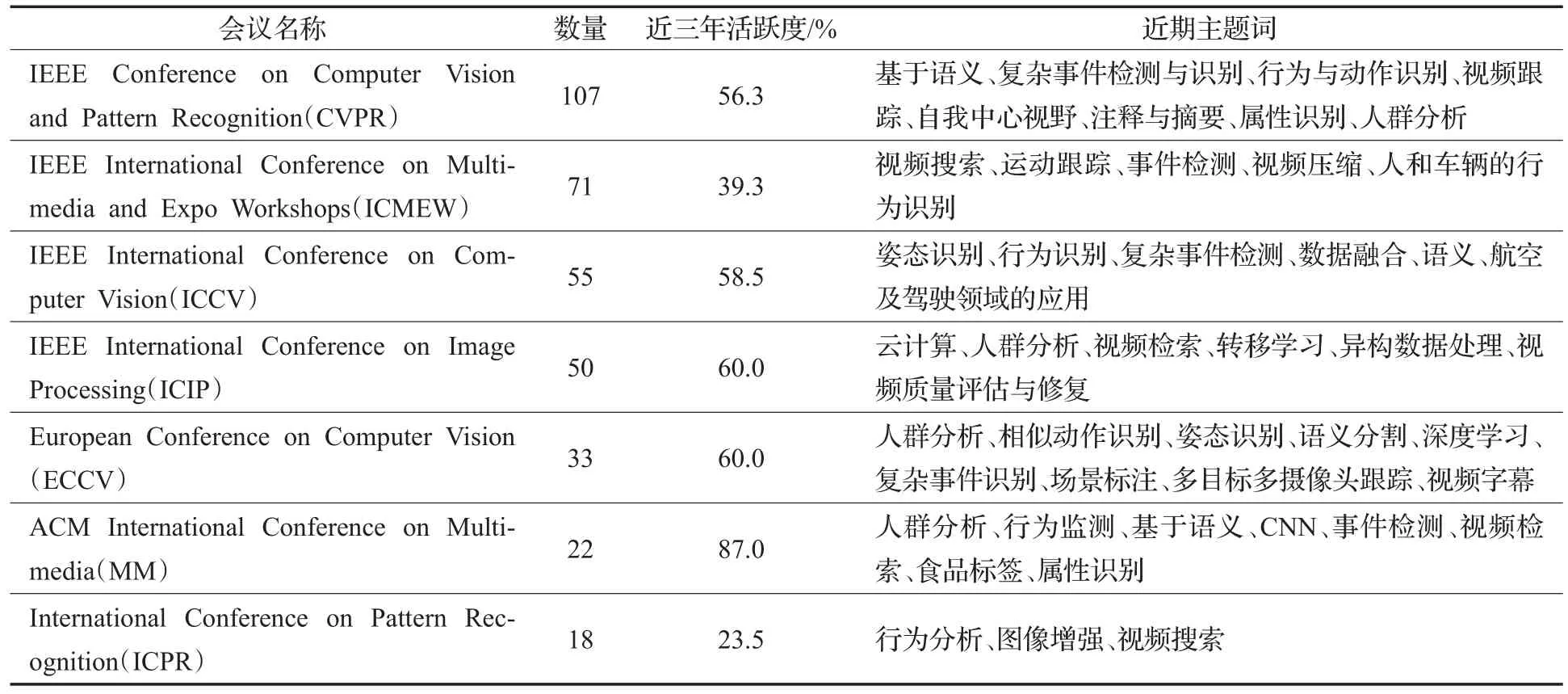

基于此次構建的數據集分析,該領域的相關工作約有三分之二(1 616/2 383)發布在國際級的學術會議上,表2是排名前7的會議及其近期主題詞。從這些會議的主題詞的變化歷程來看,研究內容和熱點從目標檢測與跟蹤等底層算法向高層的行為分析技術轉變,近年在復雜事件識別與分析、社會行為分析、人群分析等技術方向的研究熱度頗高。另外,面部識別、相似行為(跑步與慢跑)等的識別也對算法提出了更為精細化的要求。同時,隨著視頻數據獲取越來越容易,視頻資源越來多豐富,針對大型數據的,基于語義的快速檢索、去冗余、視頻注釋、摘要、字幕的生成技術也受到關注,在這些技術中也涉及到對圖片、音頻、屬性的靈活應用,測試數據集也更為豐富和多元化,如Youtube、Google等。

從涉及的方法來看,對卷積神經網絡(CNN)算法在精度、效率、新的輔助信息上的改進較多,另外深度學習、學習轉移等方法在時序數據中的應用研究成為熱點。

表2 大范圍視頻視覺感知與理解重要會議發文與主題分布

在應用來看,會議中報道了與大范圍視覺感知相關的利用人的服裝細粒度屬性識別失蹤人口[14];基于運動信息語義、建筑物的車輛檢測[15];基于人群分析的報警系統與誤報控制[16];利用網絡視頻重構近地尺度的圖像以替代衛星數據[17];基于3D重建技術的航空廣域運動分析[18];利用無人機視頻分析以彌合地面和航空影像之間的差距[19];基于對象和場景解析技術的自動駕駛案例[20];基于行為分析的烹飪、外科手術的監控和評估[21]等等。可以看出,智能視頻監控的應用領域也在快速地擴展。

4 無人平臺視覺感知與理解研究態勢

在攝影測量或遙感方面,原本需要靠高精度的地面控制點才能精確解算出影像的姿態信息和位置,隨著定位精度和IMU靈敏性的提高,無人平臺能夠在不利用地面控制點的情況下獲取精確的影像姿態位置信息[22];在偵查領域方面,可進行現場照片、指紋識別、手跡識別、印章識別等進行處理和辨識模糊人像等。此外,在智能汽車[23]、消防救援[24]、在產品質量檢測、生產過程的自動控制、CAD/CAM等方面都有應用[25]。無人平臺圖像分析水平的高低直接決定了無人平臺應用水平的高下,開發無人平臺影像高效、自動化處理系統,建立無人平臺圖像信息深度挖掘體系,是目前關注的熱點和研究的難點[26]。

如圖8,揭示了無人平臺視覺感知與理解技術Web of Science(2 997篇)收錄論文數量的年度統計情況,可以看該技術呈現遞增趨勢。引用率高達887次的無人平臺視覺識別技術出現在2007年,Davison等人在IEEE Transactions on Pattern Analysis and Machine Intelligence發表的“MonoSLAM:Real-time single camera SLAM”[27],該論文提出了一種實時算法,是依靠一個單一控制相機的移動機器人在純視覺SLAM方法領域的首次成功應用,實現了從結構到運動方法的實時但無漂移的性能。主要創新點包括運用主動的方法來映射和測量,使用一般的運動模型、平滑的攝像機運動、單眼特征初始化和特征方向估計提供解決方案,目前的主要應用有實時三維定位。

圖8 無人平臺視覺感知與理解技術論文發表趨勢

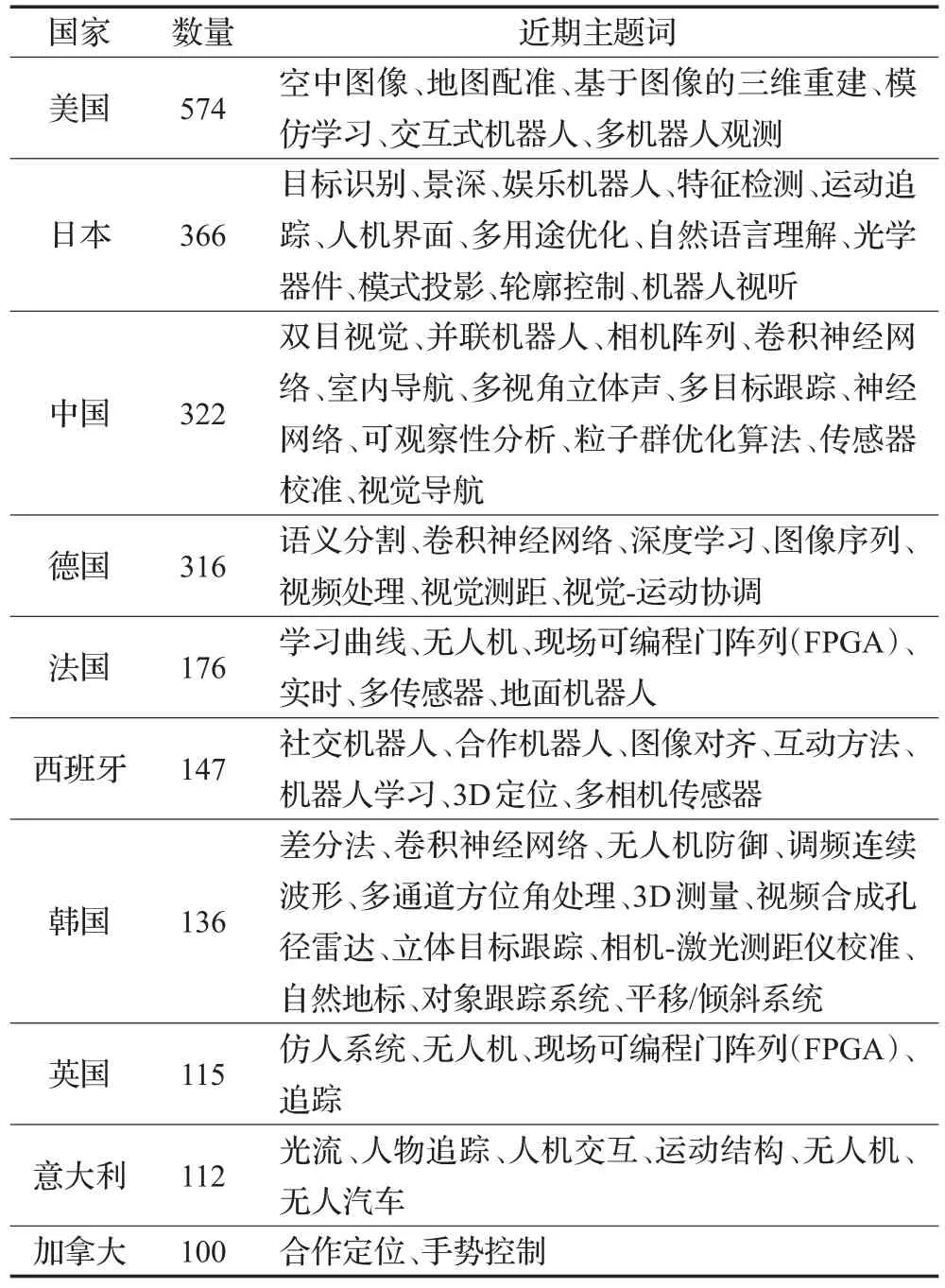

無人平臺的視覺感知與理解技術主要研發國家是美國、日本、中國和德國,美國處于絕對領先地位,日本、中國和德國研發量相當。法國、西班牙、韓國、英國、意大利和加拿大緊隨其后,如表3所示。對主題分析可以看出,近年來,無人平臺視覺感知與理解的對象包括空中圖像和地面對象,靜態圖像和動態圖像;應用目標主要是靜態或動態目標的檢測、識別、追蹤和分析,從而實現視覺導航和人機交互等功能;方法層面,差分法、光流法和統計學習模型依然是常用的方法,卷積神經網絡算法的不斷改進、語義理解和仿生視覺研究的加入也為無人機視覺感知與理解注入活力,3D定位和3D測量、3D目標跟蹤等3D視覺技術在無人平臺研究熱點較高。形式層面,無人機、無人車、交互式機器人、并聯機器人、娛樂機器人、社交機器人、合作機器人等無人平臺形式拓寬了應用的同時為視覺感知和理解提出了更高的要求。

表3 無人平臺視覺感知與理解技術論文發表國家分布情況(TOP10)

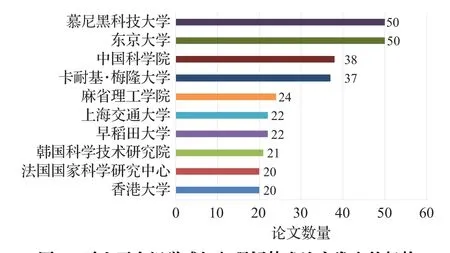

如圖9,揭示了無人平臺視覺感知與理解技術主要研究機構。排名前10位的分別是慕尼黑理工大學、東京大學、中國科學院、卡耐基梅隆大學、麻省理工學院、上海交通大學、早稻田大學、韓國科學技術研究院、法國國家科研中心和香港大學。

圖9 無人平臺視覺感知與理解技術論文發表的機構(TOP10)分布

5 產業應用

智能視覺感知與理解在智慧城市、智能交通、智能安防方面已經取得了一些好的應用案例,如韓國松島智慧互聯城市[28]利用思科統一的服務平臺進行,核心技術組件是思科相關視頻技術,這些嵌入街道和建筑物的傳感器,可以檢測從溫度、濕度到道路交通條件等問題,幫助城市提高反應速度和運行效率。智能交通方面,智能視覺感知與理解技術為智能交通系統提供了更為直觀方便的分析手段,可以在交通監控系統、交通指揮與誘導系統、自動駕駛與導航系統、輔助駕駛系統、智能收費系統、交通違章系統等方面開展應用。上海平安浦東視頻聯網監控[29]、蘇州工業園自適應交通管控[30]、香港交通監控[31]、倫敦交通[32]、東京交通[33]都已經采用了智慧交通的理念。智能安防方面,波士頓爆炸案[34]中,社交媒體監視、互聯網通訊分析、案發現場圖像視頻檢索分析、監控攝像頭硬件供應等技術發揮了強大的作用。

公司方面,大量行業相關公司研發或者布局了相關的技術和產品,表4舉例介紹了典型的大范圍視覺感知與理解和無人平臺視覺感知與理解相關公司產品。

大范圍視覺感知與理解方面,IBM公司[35]的Watson視覺識別圖像分類器(Watson Visual Recognition)使用深度學習算法來分析場景、對象、臉和其他內容的圖像,可以通過訓練自定義分類器創建專門類,其采用了圖形處理器(GPUs)的分布式網絡,將所有信息融合到具有數萬標簽的卷積神經網絡,并研發出利用語義推理優化圖片描述的新推論方法。IBM智能視頻分析可與Genetec、Milestone、Cisco、Acti和Pelco等視頻管理軟件和網絡視頻錄制解決方案相集成,可輕松地集成其他支持Microsoft Direct Show Filter的解決方案,支持活動搜索、交叉關聯和趨勢分析,目前可以進行移動攝像分析、高級人臉檢測與識別、支持CJIS密碼政策、權限管理和視頻文件的攝入。中國亦有大量公司推出相關的產品和服務,華為視頻云[36]解決方案通過VCN和OceanStor兩種方案實現城市監控視頻的整體存儲、跨域共享,保護視頻數據安全,并支持彈性建設,平滑擴容。華為VCN平臺將視頻接入、流媒體轉發、視頻存儲管理、錄像點播、設備業務管理、錄像備份、磁盤陣列各硬件設備單元合為一體,單臺支持最高256路視頻接入,并支持堆疊。不同警局單位的VCN節點可以通過網絡組成監控云,最高支持20萬路視頻接入。華為OceanStor 9000視頻云存儲系統提供視頻流整合、智能預取、IO直通等技術,使視頻圖像檢索效率得到顯著提升,支持4∶1存儲讀寫比例。另外系統具有支持上千路視頻并行分析處理的能力,可以對來自前端數千個高清攝像機的并發視頻數據做到負載均衡、動態管理。針對原始視頻、分析過程視頻或圖片、涉案事件視頻或圖片的信息關聯管理,提供分布式并行檢索與關聯分析,讓刑偵辦案處于更有序的管理狀態,幫助公安客戶高效快速進行事件過濾篩選。華為智能分析云平臺產品有VCM5020和VCM5010兩種型號。VCM5020單機支持816路并發智能分析,實現千倍速視頻采集摘要,視頻快速搜索,車牌識別,行為分析,視頻增強修復等豐富功能。VCM5010關鍵特征與VCM5020類似,單機支持96路并發智能分析。華為eLTE寬帶集群解決方案,基于最先進的LTE無線寬帶技術,上行吞吐量可達50 Mb/s,下行吞吐量達100 Mb/s。一網支持多媒體集群語音、視頻調度,高清無線視頻監控,遠程數據采集和移動辦公業務。目前,華為視頻云解決方案已運用于敦煌安全旅游城市、信息科技下的平安龍崗、上海嘉定高清平安城市等項目中。

無人平臺視覺感知與理解方面,行業領軍的Google無人駕駛視覺技術借助了美國工業知覺公司的3D視覺系統[37],通過用OpenCV(計算機視覺和機器學習庫)等分析由激光傳感器等收集的圖像,例如追蹤物體的動態、物體識別、圖像縫合、抓取風景提供虛擬現實功能等,來判斷安全行駛路線,實現自動駕駛汽車上的圖像識別和深度分析;Google通過與Jetpac公司在圖像識別技術上的融合,對行駛道路上的目標障礙物的檢測和識別匹配得到改進,體現在匹配識別時間的縮短和相關識別復雜程度的提升,并解決了在檢測圖像質量不佳的情況下提升其道路標示的可確定性,同時還增加了對行駛天氣環境的感知,進一步獲取更多行蹤條件信息;對檢測部件的改進體現在計算點陣、電控線路等方面。百度全資收購了專注于機器視覺軟硬件解決方案的美國科技公司xPerception[38],面向機器人、AR/VR、智能導盲等行業客戶提供以立體慣性相機為核心的機器視覺軟硬件產品,其核心技術是慣性視覺定位與構圖(Visual Inertial SLAM),其智能感知計算模塊,集成了感知、定位、避障和導航技術,為第三方手機、VR設備、機器人等提供包括定位、識別、3D重建等功能在內的軟硬件一體化解決方案。美國3D Robotics公司與索尼和Autodesk等公司合作[39],推出了直觀、功能強大、開放的空中分析平臺Site Scan,通過無人駕駛飛機提供易于執行、高分辨率的現實捕捉,網站提供了掃描數據的一鍵采集、處理和分析,易于商業用戶從現場獲得高保真的數據。美國Knightscope公司的機器人K5[40],可以使用其傳感器在指定區域收集車牌、面部識別和人的運動等實時現場數據,分析數據時使用來自商界和政府的數據集作為參考,從而決定何時提醒社會和當局的關注。一旦警報響起,K5將打開所有的傳感器,為整個社區審查數據和提供實時信息。Aeryon Labs公司的AeryonLive[41]是一個實時視頻&遙感和機隊管理的無人機系統平臺,它是一個集成解決方案,可以保障Aeryon SkyRanger的現場視頻和飛機遙測通過一個安全、可靠的結蜂窩網絡進行在線傳輸,該公司的Vector?可用于實時高效的視頻處理,其基于NVDIA TK1(提供一個四核2.2 GHz處理器和專用GPU)芯片搭建,嵌入于Aeryon的payload系列產品中,其圖像處理功能提供運動目標的自動識別和跟蹤。跟蹤算法可實時鎖定目標,即使目標位置變化或被其它對象阻礙視線,操作者可以在視場內直觀地標注10個移動物體,顯示器自動高亮顯示目標,同時數字圖像穩定。MotionDSP公司的Ikena ISR[42]是一款實時視頻增強與二維繪圖軟件,ISR的圖像處理算法,解決了震動、灰霾、照明等帶來的問題,盡可能全部實時地獲取無人機和安全攝像頭的視頻,操作者可以實時進行空中視頻流的處理和增強,幾分鐘內從視頻創建二維地圖,檢測和跟蹤移動物體的精確到1~2像素。主要用于軍事和公共安全領域。優必選公司的機器人產品Cruzr[43],可以通過SLAM算法,自主規劃路徑移動到目標位置,并能夠實時避障。系統可以應用在視頻監控領域,能夠對運動物體進行檢測,還可以對異常情況進行拍照或錄影取證,并發送警報信息。另外,可以“行走”的機器人也能夠實現動態的巡邏功能。

表4 智能視覺感知與理解典型公司與產品

6 總結與展望

智能視覺感知與理解技術作為人工智能、智慧城市、智慧交通、智能安防等領域的重要內容,具有重大的戰略意義,近年來一直是戰略部署以及項目支持的重要方向,預計隨著智能社會的發展,其戰略地位將進一步提升。

從學術角度來看,大范圍視頻視覺感知與理解的學術研究量呈現逐年增加的趨勢,研究內容和熱點從目標檢測與跟蹤等底層算法向高層的行為分析技術轉變,針對大型數據的、基于語義的快速檢索、去冗余、視頻注釋、摘要、字幕的生成技術也受到關注。理論方法方面,對卷積神經網絡(CNN)算法在精度、效率、新的輔助信息上的改進較多,另外深度學習、學習轉移等方法在時序數據中的應用研究成為熱點。同時,亦可以看出應用領域的快速擴展,如失蹤人口識別、車輛檢測、烹飪、手術監控等。研究開始加速提高洞悉大數據的能力,追求更高水平的數據細節,對于科學家而言仍然是一個挑戰,也將成為重要的突破方向。無人平臺視覺感知與理解的學術研究量也呈現逐年增加的趨勢,主題方面,差分法、光流法、統計學習模型一直在尋求改進,與此同時,卷積神經網絡算法、語義理解、仿生視覺研究成為無人機視覺感知與理解研究的熱點方法,3D視覺技術、無人機或機器人之間的交互協作成為熱點技術方向。然而,無人平臺視覺感知與理解的精確度、實時度、效率的提高依然需要探索的腳步。基于視覺技術的無人平臺減少人為干預,實現多個無人設備之間的自主決策協同工作將是重要的發展目標。

從產業角度來看,大量智能視覺感知與理解的應用場景和公司產品促進了行業的繁榮,基于大規模數據的視頻視覺感知與理解,以及無人平臺的視覺感知與理解也成為產業應用的重要領域。大規模的深層學習和基于語義層面的可視化建模促進了視覺識別能力的提高,云平臺等集成的產品形態和應用模式,綜合的系統架構促進了應用向更深更廣方向上的突破。無人平臺技術和視覺感知理解技術的進一步融合,進一步拓寬了應用領域。然而,應用場景和產品用戶的不同,硬件設備改造、軟件集成以及本地計算設施的部署要求就不同,呈現一定的個性化定制特征,算法、技術的實際功效均是建立在對客戶真實業務場景深層理解之上的針對性開發,開發成本高。缺乏標注數據是幾乎所有應用場景普遍存在的挑戰。雖然,將智能視覺感知與理解相關技術從實驗室擴展到工業化應用的過程本身依然面臨很大的挑戰,但相信隨著技術的改進,集成解決方案的發展,產業鏈的進一步成熟,智能視覺感知與理解產業將催生出更多深入消費者市場內部的優秀產品。