基于生成對抗網絡的信息隱藏方案

王耀杰,鈕 可,楊曉元

(1.武警工程大學 密碼工程學院,西安 710086;2.網絡與信息安全武警部隊重點實驗室(武警工程大學),西安 710086)(*通信作者電子郵箱wangyaojie0313@163.com)

0 引言

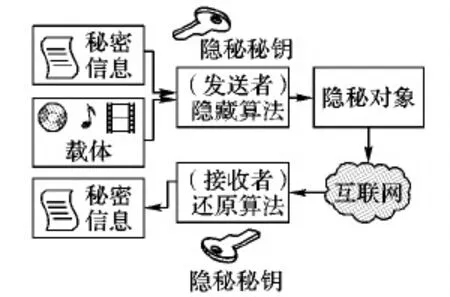

信息隱藏是將秘密信息以不可見的方式隱藏在一個宿主信號中,并在需要時將秘密信息提取出來,以達到隱蔽通信和版權保護等目的[1]。它主要用于特定雙方的秘密通信,特別是在快速增長的社交網絡中,有豐富的圖像和視頻作為載體,這為信息隱藏提供了更多的機會和挑戰。圖1是信息隱藏的典型模型。

當前常用的圖像信息隱藏方法主要包括空域和變換域的信息隱藏方法。空域隱藏方法如圖像最低有效位(Least Significant Bit, LSB)隱藏方法[2]、自適應LSB隱藏方法[3]、空域通用小波相對失真(Spatial-UNIversal WAvelet Relative Distortion, S-UNIWARD)方法[4]、HUGO(Highly Undetectable steganography)[5]、WOW(Wavelet Obtained Weights)[6]等;變換域方法如離散傅里葉變換(Discrete Fourier Transform, DFT)隱藏方法[7]、離散余弦變換(Discrete Cosine Transform, DCT)隱藏方法[8]、離散小波變換(Discrete Wavelet Transform, DWT)隱藏方法[9]等。

圖1 信息隱藏的典型模型Fig. 1 Typical model of information hiding

傳統信息隱藏方法都是通過修改載體來嵌入秘密信息,含密載體總會留有修改痕跡,導致含密載體難以從根本上抵抗基于統計的信息隱藏分析算法的檢測。當人們設計隱寫算法時,通常會考慮到隱寫分析。例如,秘密信息應該嵌入到圖像的噪聲和紋理區域中,這樣更加安全。但現有的隱寫模式通常要求載體信息的先驗概率分布,在實際中很難獲得,也就是說抵抗隱寫分析的設計未能在應用中很好地實現。因此,如何設計安全的隱寫方案使含密載體從根本上抵抗基于統計的隱寫分析算法的檢測是研究人員面臨的難題,也是研究的熱點之一。

生成對抗網絡(Generative Adversarial Network, GAN)[10]的特點是提取總結真實樣本的特征,由噪聲驅動來生成豐富多樣的圖像樣本,這為信息隱藏的研究提供了新方向。在SGAN(Steganographic GAN)[11]和SSGAN(Secure Steganography based on GAN)[12]的啟發下,本文提出了一種基于生成對抗網絡的安全隱寫方案,通過生成更合適的載體信息來保證信息隱藏的安全性。該方案首先用GAN中的生成模型(generative model)以噪聲為驅動生成原始載體信息,其次將使用±1嵌入算法,將消息嵌入到生成的載體信息中,然后將含密信息與真實樣本作為生成對抗網絡判別模型D(discriminator D)的輸入,對于判別性網絡進行重構,同時使用判別模型S(discriminator S)來檢測圖像是否存在隱寫操作。

本文的主要工作歸納如下:

1)提高含密信息的安全性。在本文中,將含密信息(steg(G(z)))與真實圖像(χdata)作為生成對抗網絡判別模型(discriminative model)的輸入,對于判別性網絡進行重構,從而使含密信息的安全性顯著提高。與SGAN和SSGAN相比,本文方案使得攻擊者在隱寫分析正確性上分別降低了13.1%和6.4%。

2)生成的載體圖像更豐富。本文改進原始GAN的框架,同時要通過調節式(5)參數α的值,使生成對抗網絡和隱寫分析檢測達到均衡,從而更好評估生成圖像的特性,使生成的圖像更豐富。與對比方案相比,生成的載體圖像更適合嵌入。

1 預備知識

1.1 生成對抗網絡

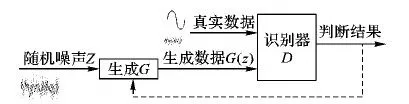

GAN是 Goodfellow等[10]在2014年提出的一種生成模型, 其思想來源于博弈論中的二人零和博弈, GAN的結構如圖2所示。主要由一個生成器和一個判別器組成,任意可微分的函數都可用來表示GAN的生成器G和判別器D[13]。

圖2 GAN的結構Fig. 2 Structure of GAN

GAN從2014年提出后主要應用在無監督學習上,它能從輸入數據動態地采樣并生成新的樣本。GAN通過同時訓練以下兩個神經網絡進行學習(設輸入分別為真實數據x和隨機變量z):

1)生成模型G:以噪聲z的先驗分布pnoise(z)作為輸入,生成一個近似于真實數據分布pdata(x)的樣本分布pG(z)。

2)判別模型D:判別目標是真實數據還是生成樣本。如果判別器的輸入來自真實數據,標注為1;如果輸入樣本為G(z),標注為0。

GAN的優化過程是一個極小極大博弈(Minimax game)問題:判別器D盡可能正確地判別輸入的數據是來自真實樣本(來源于真實數據x的分布)還是來自偽樣本(來源于生成器的偽數據G(z));而生成器G則盡量去學習真實數據集樣本的數據分布,并盡可能使自己生成的偽數據G(z)在D上的表現D(G(z))和真實數據x在D上的表現D(x)一致,這兩個過程相互對抗并迭代優化,使得D和G的性能不斷提升,最終當G與D二者之間達到一個納什平衡,D無法正確判別數據來源時,可以認為這個生成器G已經學到了真實數據的分布[13]。

因此在GAN的訓練過程中解決了以下優化問題:

L(D,G)=Ex~pdata(x)[logD(x)]+

(1)

其中:D(x)代表x是真實圖像的概率;G(z)是從輸入噪聲z產生的生成圖像。

通過交替訓練G與D實現聯合優化式(1):在每個mini-batch隨機梯度優化的迭代過程中,本文首先對D進行梯度上升,然后對G作梯度下降。如果用θM表示神經網絡M的參數,那么更新規則為:

1)保持G不變,通過θD←θD+γD▽DL更新D:

Ez~pnoise(z)[log(1-D(G(z,θG),θD))]}

(2)

2)保持D不變,通過θG←θG-γG▽GL更新G:

(3)

GAN模型存在著無約束、不可控、噪聲信號z很難解釋等問題。近年來,在此基礎上衍生出很多GAN的衍生模型。文獻[14]中將GAN的思想擴展到深度卷積生成對抗網絡(Deep Convolutional GAN, DCGAN)中,將其專門用于圖像生成,還論述了對抗訓練在圖像識別和生成方面的優點,提出了構建和訓練DCGAN的方法。Conditional GAN[15]能生成指定類別的目標。InfoGAN(interpretable representation learning by Information maximizing GAN)[16]被OPENAI稱為2016年的五大突破之一,它實現了對噪聲z的有效利用,并將z的具體維度與數據的語義特征對應起來,由此得到一個可解釋的表征。

1.2 Wasserstein GAN

WGAN(Wasserstein GAN)[17]是GAN的衍生模型,主要從損失函數的角度對GAN作了改進。原始GAN采用交叉熵(JS散度)衡量生成分布和真實分布之間的距離,導致GAN在訓練過程出現模型崩塌(mode-collapse)的問題。WGAN在理論上給出了GAN訓練不穩定的原因,即交叉熵(JS散度)不適合衡量不相交分布之間的距離,接著使用Wassertein距離去衡量生成數據分布和真實數據分布之間的距離,主要理論貢獻為:

1)定義了可以明確計算的損失函數,徹底解決 GAN訓練不穩定的問題,不再需要小心平衡生成器和判別器的訓練,基本解決了模型崩塌(mode-collapse)問題,確保了生成樣本的多樣性。

2)使用Wasserstein方法對 G&D 的距離給出了明確的數學定義。Wasserstein距離也稱為轉移度量或者E距離,它表示從一個分布轉移成另一個分布所需的最小代價。

WGAN采用Wasserstein距離代替交叉熵(JS散度)[10]作為損失函數(loss function)。但在實際中直接計算Wasserstein距離是很困難的,因此使用Wasserstein距離的Kantorovich-Rubinstein對偶形式:

(4)

也就是說,Wasserstein距離實際上需要考慮所有的1-Lipschitz函數。如果考慮的是K-Lipschitz函數[18],則Wasserstein距離變為原來的K倍。一般來說,可以假定GAN的判別器D是K-Lipschitz函數,即優化D實際上是在某個K-Lipschitz函數集{fw}w∈W上尋找合適的函數(其中w為f的參數)。WGAN通過數學變換將Wasserstein距離寫成可求解的形式,利用一個參數數值范圍受限的判別器神經網絡來最大化這個形式,就可以近似Wasserstein距離。在此近似最優判別器下優化生成器使得Wasserstein距離縮小,就能有效拉近生成數據分布與真實數據分布。

WGAN對原始GAN的具體改進為:1)判別器最后一層去掉 sigmoid;2)生成器和判別器的loss不取 log;3)每次更新判別器D之后,把D中參數的絕對值截斷到一個固定常數;4)采用RMSProp(Root Mean Square prop)[19]、SGD(Stochastic Gradient Descent)替換基于動量的優化算法 momentum和Adam(Adaptive moment estimation)。

WGAN既解決了訓練不穩定的問題,也提供了一個可靠的訓練進程指標,而且該指標確實與生成樣本的質量高度相關。但是采用WGAN模型生成的圖片離現實圖片還有差距,后續還需要進一步研究。

2 本文方案模型

在SGAN和SSGAN工作的啟發下,本文引入一個新的基于WGAN信息隱藏(Steganography based on GAN, Stego-WGAN)方案,包含一個生成網絡和兩個判別網絡。具體功能為:

生成器網絡G:以噪聲為驅動,通過機器學習生成近似真實數據樣本的圖像作為載體信息。

判別器網絡D:與SGAN和SSGAN方案不同,該方案為將含密信息(steg(G(z)))與真實樣本作為判別模型D的輸入,對輸入的樣本鑒別真偽。

判別器網絡S:與SSGAN方案相同,本文也使用復雜的GNCNN(Gaussian-Neuron Convolutional Neural Network)[20]來評估生成的圖像的合適性,同時確定被檢圖像是否存在隱寫操作。本文Stego-WGAN模型如圖3所示。

圖3 Stego-WGAN模型Fig. 3 Stego-WGAN model

本文用S(x)代表判別模型S的輸出,用Stego(x)表示將一些秘密消息嵌入到載體信息x中的結果。

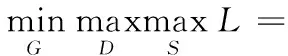

為了使生成模型G生成可用于信息隱藏的逼真圖像,本文迫使生成模型G與判別模型D和S相互競爭,不斷迭代優化。該模型數學表達式如下所示:

α(Ex~Pdata(x)[logD(x)]+

Ez~Pnoise(z)[log(1-D(Stego(G(z)))])+

(1-α)Ez~Pnoise(z)[logS(Stego(G(z)))+

log(1-S(G(z)))]

(5)

本文將D和S兩者組成凸函數,并由參數α∈[0,1]調控生成圖像的真實性和隱寫分析準確性。初步實驗結果表明,對于α≤0.7時,生成的圖像是視覺質量很差,與噪聲相似[11]。

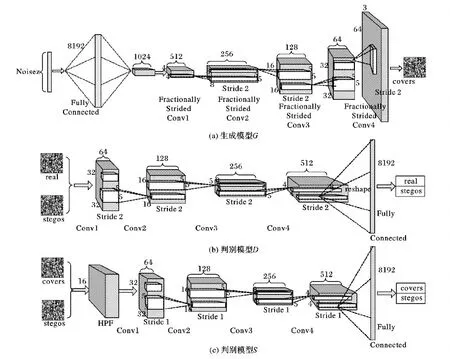

2.1 網絡結構

對于生成網絡G,它用于生成安全的載體信息。 本文使用一個全連接層和四個卷積層,然后是雙曲正切函數作為激勵層。G網絡結構如圖4(a)所示。

對于判別網絡D,它用于評估含密圖像的質量特性。 本文使用四個卷積層和一個全連接層。D網絡結構如圖4(b)所示。

對于判別網絡S,它用于評估生成圖像的適用性。本文首先使用預定義的高通濾波器進行濾波操作,主要用于隱寫分析;然后是四個卷積層,用于特征提取;最后進行判別分類,分類的結構里也包含一個全連接。S網絡結構如圖4(c)所示。

2.2 更新規則

本文采用SGD[21]更新規則,具體步驟如下。

a)對于生成模型G:ωG←ωG-rG▽GL,它由式(6)計算:

b)對于判別模型D:ωD←ωD+rD▽GL,它由式(7)計算:

Ez~Pnoise(z)[log(1-D(Stego(G(z,ωG)),ωD))]}

(7)

c)對于判別模型S:ωS←ωS+rS▽SL,它由式(8)計算:

log(1-S(G(z,ωG),ωS))]

(8)

更新G不僅使判別模型D的錯誤率最大化,而且使判別器D和S的線性組合的差錯率最大化。

圖4 模型網絡架構Fig. 4 Model network architecture

3 實驗結果與分析

3.1 實驗數據準備

在本文實驗中,使用公開可用的CelebA(CelebFaces Attribute)人臉數據集(Ziwei Liu&Tang,2015),其中包含200 000張圖像;輸入的隨機噪聲z為(-1,1)上的均勻分布。實驗平臺為谷歌的人工智能學習系統Tensorflow v0.12,計算顯卡為NVIDIA1080。

為了進行隱寫分析,首先對數據集進行預處理,將所有圖像裁剪為64×64像素,將90%的數據作為訓練集,并將其余的作為測試集,訓練集由A表示,而測試集由B表示。使用Stego(x)來表示將一些秘密消息嵌入到載體信息x中的結果,那么嵌入秘密信息后得到訓練集A+Stego(A)和測試集B+Stego(B),即得到380 000張用于隱寫分析的訓練樣本,并將剩余的20 000張作為測試樣本。

同時,使用±1嵌入的隱寫算法,有效載荷大小為每像素0.4位,本文隨機選擇文章作為嵌入的文本信息。

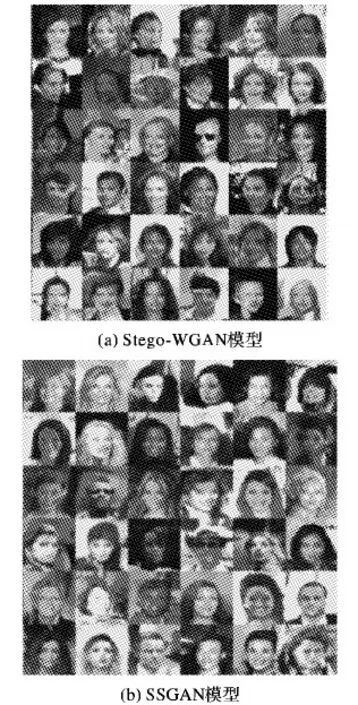

本文使用了所有200 000張裁剪樣本用于訓練Stego-WGAN模型。 圖5為經過7個訓練周期后,Stego-WGAN模型和SSGAN模型產生的圖像。

圖5 Stego-WGAN和SSGAN模型生成的人臉圖像Fig. 5 Generated face images by Stego-WGAN and SSGAN

實驗結果表明,本文提出的Stego-WGAN模型生成的圖像的視覺質量相同,但人物多樣性更豐富,明顯優于對比方案。

3.2 實驗設置

在本節中,將描述Stego-WGAN模型結構。由C2D-BN-LR表示卷積神經網絡的以下結構塊:Conv2d→Batch Normalization→Leaky ReLU。

判別模型D和判別模型S具有相似的結構:4個C2D-BN-LR層→1個全連接層(1個神經元)→Sigmoid函數(用來計算一個輸出)。生成模型G結構是:1個全連接層(8 192個神經元)→4個C2D-BN-LR的反卷積層→tan(x)函數層(計算正則化輸出)。

對Stego-WGAN模型進行訓練,采用基于Adam的優化算法,學習率為0.000 2,更新變量β1=0.5,β2=0.999。在每次訓練中,先更新一次判別器D的權重,再更新兩次生成器G的權重[12]。

實驗中,除了steganalyserS之外,本文還使用一個獨立的steganalyserS*。定義了一個專用于隱寫分析應用的濾波器F(0)[11]如下:

(9)

本文也使用RMSProp優化算法訓練steganalyserS*,學習率為5×10-6,并更新變量β1=0.5,β2=0.999。以二進制交叉熵的形式來表示損失函數。

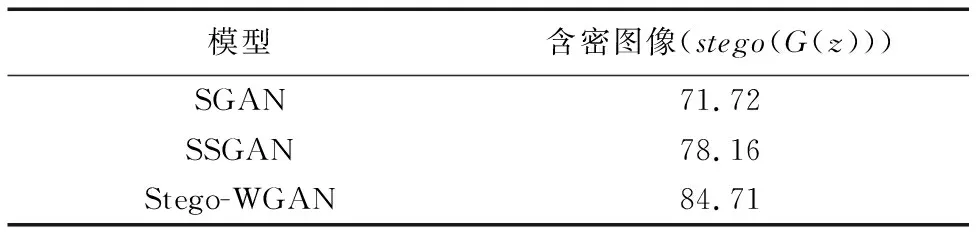

3.3 實驗結果分析

在第一個實驗中,本文比較生成圖像與真實圖像作為信息載體的安全性。首先將秘密信息嵌入到真實的圖像中,使用steganalyserS*分類器進行分類;然后將秘密信息嵌入到生成圖像中,也使用相同參數的steganalyserS*分類器進行分類。

實驗結果如表1所示,在抗隱寫分析方面,與真實圖像隱寫分析正確率88.37%相比,含密圖像的表現明顯優于真實圖像;與SGAN和SSGAN相比,本文方案使得隱寫分析正確性分別降低了13.1%和6.4%。可以得出本文方案生成的圖像更加安全,更適合成為信息隱藏的安全載體。

表1 在生成圖像上steganalyser S*的準確性 %Tab. 1 Accuracy of steganalyser S* trained on generated images %

在第二個實驗中,為進一步驗證生成樣本的安全性,本文使用Qian網絡結構,設置不同的先驗噪聲分布作為輸入,然后用steganalyserS*分類器對各自的生成圖像進行實驗。具體實驗設置如下:

1)使用相同的先驗噪聲分布;

2)使用一些隨機選擇的先驗噪聲分布;

3)使用與2)相同的先驗噪聲分布,同時改變WGAN周期數。

實驗結果表明:實驗條件1)下對生成的圖像訓練結果準確率為82.3%;條件2)下準確率為77.5%;條件3)下準確率為74.9%。通過改變不同的噪聲輸入和訓練周期,可以使檢測的準確性分別降低4.8%和2.6%。輸入不同噪聲分布,改變訓練周期,本文方案生成的圖像安全性進一步提高,可以更有效抵抗隱寫分析。

經過對比可得:Stego-WGAN模型生成的圖像更合適作為載體信息,同時更加豐富,視覺質量進一步提高。實驗結果表明,新的信息隱藏方案在抗隱寫分析和安全性指標上明顯優于對比方案。

4 結語

本文提出了基于生成對抗網絡的Stego-WGAN信息隱藏方案,為信息隱藏生成更合適、更安全的載體信息,基本上解決含密載體會留有修改痕跡的問題。使用CelebA數據集評估了Stego-WGAN方案的性能,實驗結果表明Stego-WGAN方案在抗隱寫分析、安全性上有良好表現,能夠生成更高視覺質量的圖像,有效抵抗隱寫分析算法的檢測。同時,本文首次改變了生成對抗網絡的原始基本架構,為生成對抗網絡在信息隱藏領域的應用提供了新思路。而如何改進生成模型G的結構,提高生成圖像的性能,是下一步的重點研究工作。