基于形狀索引的DoG特征結合GPRT的人臉關鍵點檢測算法

(商丘職業技術學院,河南 商丘 476100)

0 引言

人臉關鍵點檢測就是對面部特征進行精確定位,如面部圖像中的眼角、鼻尖、嘴角和下巴。準確且魯棒地人臉對齊有利于實現各種涉及人臉的目標應用,如人臉識別[1-2]、面部表情識別[3-4]等。但是由于人臉形狀本身具有多變性,以及光照、姿態、遮擋等因素的影響,準確且魯棒的人臉關鍵點檢測還具有相當的難度。

近年來,級聯形狀回歸模型在特征點定位上取得了重大突破。形狀回歸是一種人臉對齊框架[5],其具有準確性、魯棒性及快速性等特點。在形狀回歸中,臉部形狀是一個連接的面部基準坐標,其通過一連串分類與回歸樹(Classification and Regression Tree,CRT)實現原始迭代更新。每一個樹基于當前的形狀評估對形狀增量進行估量,最終的形狀評估由原始評估的輸出樹累計加和而來。目前,已經在形狀回歸中考慮了不同種的正則化方法以便降低過度擬合,獲取更好的泛化性能。文獻[7]通過對一個人臉圖像生成多個初始形狀估計來增強訓練數據,這一數據加強的方法已經在后續的研究中應用。文獻[8]將收縮和平均作為正則化方法,在梯度推進學習過程中,學習率參數乘以每一個回歸樹或獨立學習和平均樹。文獻[9]將學習過程分為兩個步驟:(1)學習二進制映射函數(2)學習現行回歸矩陣。二進制映射函數包括一組局部的二進制映射函數,該函數由單面部基準點的方法從獨立學習樹中誘導。接著通過平方損失最小化函數,獲取線性回歸矩陣。然而這些算法易陷入局部極值并且魯棒性不強。

本文使用高斯過程回歸樹(Gaussian Process Regression Tree,GPRT)來代替梯度推進。GPRT通過一種特殊的內核簡化預測過程中的計算,在相同的預測時間內比CRT的泛化性能高。GPRT的預測平均值為樹輸出的總和,這一方法的預測時間相同但是提高了泛化性能。此處將GPRT的預測平均值設計成正比于預測變量(來自于GPRT集合)的值,由此引出GPRT的貪婪分布式學習方法。在參考形狀評估的局部視網膜模式中,計算高斯函數的差分(Difference of Gaussian,DoG)特征來確定GPRT的輸入特征。提取DoG特征,首先,在不同尺度條件下使用高斯濾波器平滑面部圖像從而降低噪音敏感性。然后從高斯光滑面部圖像中提取像素值,利用局部視網膜抽樣模式、形狀評估和光滑尺度把圖像編入索引內。最后計算提取像素值的差異。每一個局部視網膜抽樣點的光滑尺度與采樣點和中心點之間的距離呈正比。因此,遠距離采樣點比附近的采樣點涉及的區域面積大,對形狀評估誤差的穩定性也較好,識別能力也更強。

1 高斯過程回歸樹

1.1 回歸樹模型

CRT中考慮了一組樹,并將形狀回歸看作成一種加法級聯形式的樹,如下所示:

(1)

(2)

(3)

其中:Nt,b是葉子b上下降的訓練數據點。用分割函數和回歸函數改進的公式(1)為:

1.2 GPRT的過程

GPRT由許多GPRT組成,每一個GPRT都有一個由樹組定義的內核。在GPRT中,輸出和輸入之間的關系由回歸函數f(x)表示,該回歸函數是一個有獨立加性噪音εi的高斯過程:

si=f(xi)+εi,i=1,...,N

(4)

f(x)~GP(0,k(x,xt))

(5)

(6)

給定一個測試輸入x,在預測變量f*上的分布為:

(7)

(8)

(9)

(10)

(11)

(12)

(13)

(14)

(15)

(16)

其中的逆運算為O((BM)3),Kr=QTQ+σr2IBM是BM×BM矩陣。

(17)

在GPRT中,輸入量f*的預測變量x*是高斯隨機變量,其預測均值和變量分別由公式(10)和(9)提供。公式(10)的計算參考函數O(N)。但是下述方法更高效:

(18)

通過公式(18),在O(MlogB)中計算預測平均值,該值的計算框架與CRT中的預測相同。級聯GPRT包含T個GPRT,并結合GPRT:

(19)

(20)

(21)

2 形狀索引的DoG特征的提取與學習

提取DoG特征的過程如下:

1)對目標圖像進行高斯過濾[11-12],得到模糊的光滑圖像如圖1所示。

2)計算相似性變換,將平均形狀映射給形狀評估。

3)將相似性變換應用到局部視網膜采樣模式,如圖2所示。

4)使用變換后的局部視網膜抽樣模式并參考形狀評估來計算全局坐標。

5)在高斯光滑圖像的全局坐標中提取像素值,從而對應于每一個采樣點的尺度參數,提取高斯濾波器響應。

圖1 高斯模糊效果

圖2 局部視網膜采集模式過程

提取出來的兩個高斯濾波器響應之間的差異體現在形狀索引的DoG特征上,然后計算預定義的DoG過濾的響應。將相似性轉換應用到局部視網膜采樣模式,形狀索引的DoG特征計算并不包含整個圖像的轉換,只轉換稀疏的坐標[5]。另外,獲取高斯光滑圖像的計算復雜性并不高,因為光滑過程只有一次,且在學習過程之前。

用單一的面部坐標來學習GPRT樹,由隨機采樣閾值和參考第l面部坐標的DoG特征獲取樹的分割函數。為了獲取更有識別力的分割函數,測試了一些分割函數并選取了性能最佳者。而分割函數的性能由第l面部坐標的平方損失來衡量。這一過程僅學習了樹的分割函數,而回歸輸出由GPRT學習。每一個樹基于當前的形狀評估對形狀增量進行估量,最終的形狀評估由原始評估的輸出樹累計加和而來。形狀回歸中影響預測性能的兩個關鍵因素,分別是學習CRT的梯度推進和形狀檢索特征。從梯度推進得來的GPRT通常過度擬合。在梯度推進中,每一個階段以貪婪分步實施方式,迭代性地擬合訓練數據,該過程減少了回歸殘差,這些殘差的定義由地面真實形狀與形狀評估之間的差異來完成。在學習和預測的過程中存在擬合率之間的差異時,便會出現過度擬合,在一些階段中擬合訓練數據的速度太快,可能會導致較差的泛化性能,在預測過程中也會出現不精準的形狀評估。

最初階段的學習樹傾向于使用形狀索引的DoG特征,這些特征由距離較遠的采樣點計算得來,而處于后期的樹傾向于使用從附近的采樣點計算得來的特征。這是因為較遠的采樣點設計更大的區域,對于形狀評估誤差來說更穩定。附近的采樣點穩定性差一點,但是當形狀評估準確時識別力高。因此,在學習階段,形狀索引的DoG特征允許每一個樹根據實際需要自由選擇更穩定的特征。

3 實驗結果與分析

本實驗的目的有:(1)將使用了形狀索引的DoG特征的GPRT與最先進的方法進行比較。(2)證實本文方法的關鍵因素:GPRT和形狀索引DoG特征。

3.1 LFPW數據庫

本文大部分實驗結果都基于LFPW數據庫[10],它是知名的目前最先進最具挑戰性的數據庫。LFPW數據庫包含1132個訓練圖像和300個測試圖像,其能提供鏈接到圖像的URL。本文收集了778個訓練圖像和216個測試圖像。LFPW人臉數據庫部分截圖如圖3所示。

圖3 LFPW人臉數據庫部分截圖

將形狀評估誤差看作是內目鏡距離的一部分,該距離是經瞳孔距離標準化后的地面實際情況和形狀評估間距離。所有的實驗結果都選取平均值(超過10次的實驗)以便降低隨機性的影響。

3.2 實驗設置

為了獲取訓練數據,首先使用面部檢測邊界框來裁剪人臉圖像。接著,形狀評估初始化成隨機采樣的真實形狀,該形狀來自其他訓練數據點。在訓練階段,每一個面部圖像的初始化過程要重復二十次。預測過程中使用來自訓練數據點的平均形狀進行初始化。

本文考慮兩種構型配置:(1)“GPRT”配置,具有較低的平均誤差但是預測也較慢;(2)“GPRTfast”配置,預測較快但是平均誤差大。在GPRT配置中,每一個GPRT的樹數量和GPRT的數量分別為M=10和T=500。GPRT由兩種層次的級聯GPRT組成,第一層級的階段數和第二層級的階段數分別為100和5。在GPRTfast配置中,每個GPRT的樹數量和GPRT的數量分別設置為M=10,T=100。第一層次的級聯階段數和第二層次的級聯階段數都設為10。對兩個配置而言,樹的深度設為5。每一個分割函數都要經過200次試驗,光滑尺度設為8。每一個光滑尺度中視網膜采樣點數為6,因此每一個面部坐標的采樣點數為6×7+1=43。所以試驗的操作系統為:配備單核i5-3570、3.40 Hz CPU的PC機。

3.3 與先進算法之間的比較

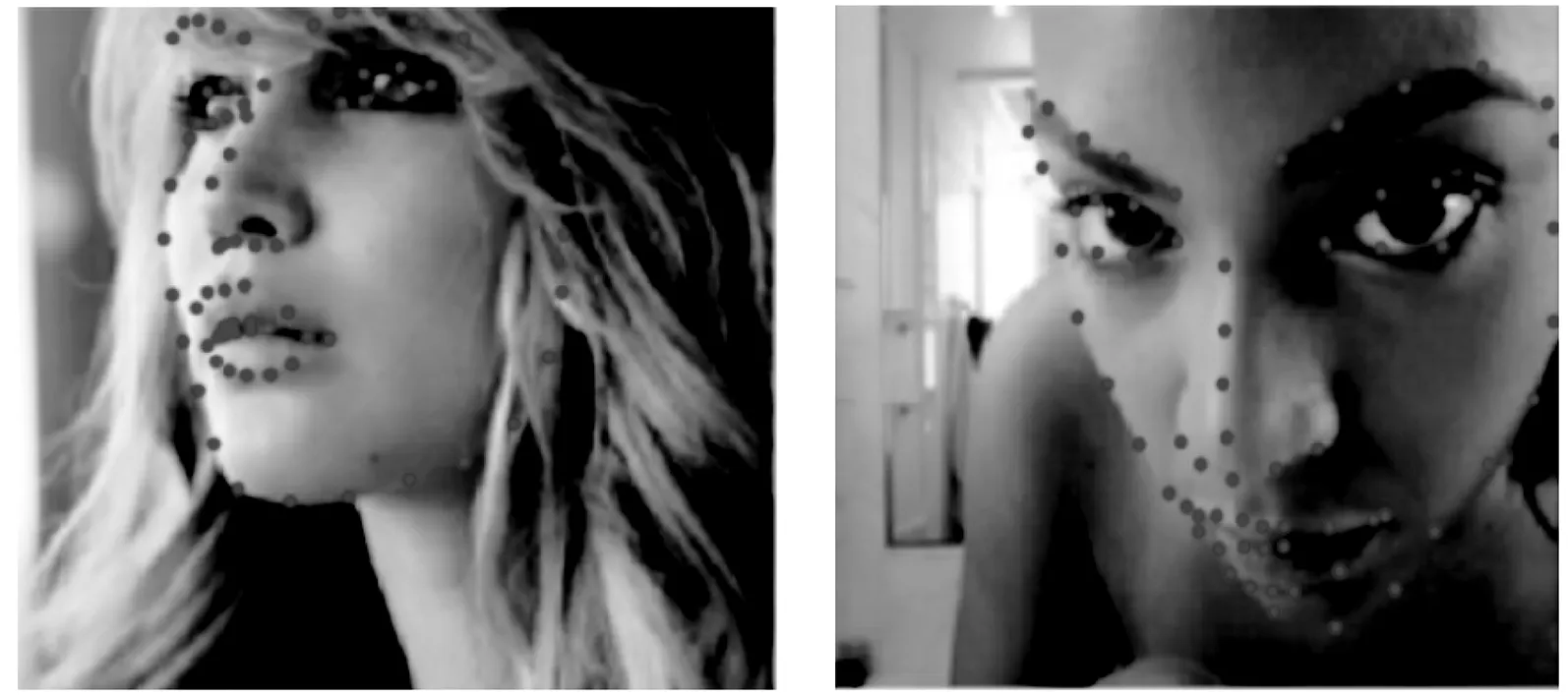

在這一節,將使用了形狀索引的DoG特征的GPRT與以下最先進的方法進行比較:形狀回歸(ESR)[13],魯棒的級聯構成回歸[14]、堿度下降法(SDM)[15-16]。其中文獻[13]提出一種形狀到形狀的顯式形狀回歸方法,利用豐富的幾何形狀先驗定位人臉特征點。并且引入一種射影不變量—特征數(CN)去描述和刻畫人臉固有的幾何形狀結構。提出一種魯棒、有效的特征點檢測器。通過構建特征數與形狀之間的映射關系,建立從局部到全局的形狀回歸模型。LFPW人臉關鍵點部分檢測結果如圖4所示。文獻[14]重點對魯棒關鍵點定位技術進行了對比研究,并設計實現了一個綜合魯棒表情關鍵點定位演示系統。文獻[15]提出了基于人眼拓撲結構的人眼特征點跟蹤。在LFPW人臉數據集進行試驗,對比幾種方法,結果如表1所示。

圖4 LFPW人臉關鍵點檢測

方法準確率(100%)形狀回歸(ESR)77.64魯棒的級聯構成回歸74.46堿度下降法(SDM)68.68本文方法84.93

從表1可以看出,本文方法取得了84.93%的準確率,而其他幾種方法均低于80%。LFPW數據庫的實驗結果表明GPRT的性能明顯優于其他方法。當使用形狀檢索特征時,過度擬合會更重要。形狀檢索特征與形狀評估緊密相關:形狀檢索特征決定了形狀評估,而形狀檢索特征又是從基于圖像評估的像素坐標中提取出來。擬合率之間的差異導致預測過程中提取出來的形狀檢索特征都不相關,進而導致提取出的特征更不相關。其中文獻[13]提出的基于形狀回歸(ESR)的方法以及文獻[15]提出的基于堿度下降法(SDM)的方法均依賴于建立模型,對于存在遮擋或者模糊狀態下的面部圖像往往難以建立準確的模型,制約了方法的使用。而文獻[14]提出的基于魯棒的級聯構成回歸的方法,在定位魯棒關鍵點時,易受到算法本身計算成本過高的干擾,對于復雜場景中的面部圖像準確率還有待進一步提升。

4 結論

本文提出了一種基于形狀索引的DoG特征與GPRT相結合的人臉關鍵點檢測算法。GPRT由GPRT集合組成,并以一種貪婪分布式方法學習。GPRT的預測均值可在CRT框架中計算,泛化性能更佳。而且,本文也描述了形狀索引DoG特征。參考形狀評估,在局部視網膜模式上計算高斯濾波響應差異,并由此來設計上述的形狀索引DoG特征。使用該特征的GPRT在LFPW數據庫獲得最佳性能。為了驗證本文方法的有效性,將其與現有的幾種方法進行比較,實驗結果證明了本文方法的有效性。未來希望對該算法做出進一步完善。