局部自主遙操作中的抓取構型識別研究

韓 冬,黃攀峰,齊志剛

(1.西北工業大學航天學院智能機器人研究中心,西安710072;2.西北工業大學航天飛行動力學技術重點實驗室,西安710072;3.山西師范大學物理與信息工程學院,臨汾041000)

1 引言

隨著載人航天技術的不斷發展與太空探索的不斷深入,航天員的空間作業任務也不斷增加,如空間站的在軌維護、空間實驗的有效開展以及艙外設備的安裝與巡檢等。航天員完成這類操作固然效率較高,但代價昂貴且安全性也無法有效保障,采用空間機器人代替航天員完成各種復雜任務成為各國研究的熱點[1-2]。目前的空間機器人尚不具備完全自主能力,通過操作者在地面進行遙操作完成復雜作業是當前的主要形式。時延是影響遙操作系統穩定性、透明性的關鍵因素,空間機器人遙操作面臨著大時延與有限帶寬問題[3],因此采用操作者給出操作目標,機器人在視覺引導下進行局部自主遙操作成為解決該問題的有效途徑[4]。

不同于機器人的自主操作,局部自主遙操作需要人機合作完成任務,因此既需要完成目標的檢測與標定為人提供操作依據,又要識別抓取構型為機器人完成抓取任務提供必要條件。抓取構型的選取可分為分析法和經驗法[5]。分析法包含力閉合法[6]和形閉合法[7],聚焦于如何穩定的抓住目標,但其無法完成對目標的標定。自2014年后,由于人工智能的發展,經驗法迅速發展起來,其中深度學習發展尤為迅速,深度學習方法可以學習大量抓捕經驗,從而訓練出來一組模型參數,但由于魯棒性差且需采取離線訓練的方法,因此不適合空間機器人遙操作。

針對這些問題,國內外學者提出通過圖像識別來實現目標檢測與標定并確定抓取構型的方法[8]。皮思遠等[9]提出了改進的全卷積深度學習模型用于可抓取物品識別,應用插值方式進行反池化操作,提高了分類結果的準確率。但該方法將特征提取與分類采用了分層方法,特征提取不全面,耗時較長。Saxena等[10]采用降維處理算法,利用二維圖像數據信息學習“好的抓取點”與“壞的抓取點”,并通過實驗驗證該方法的有效性,但由于獲得圖像信息的非完整性,在實際場合應用比較困難。Rusu等[11]采用視角區域特征直方圖法識別抓取構型。Papazov等[12]利用RGB-D傳感器在復雜場景下獲得物體的三維信息,對抓取區域進行重構。Kumra等[13]利用深度卷積神經網絡在RGB-D圖片中提取特征,并采用淺卷積神經網絡對感興趣的物體進行抓取構型解算。以上方法由于圖像處理網絡與識別網絡信息不共享,導致其處理速度較慢,在大時延多任務條件下可能造成系統不穩定。

針對上述方法存在的識別目標速度慢、準確性低的問題,本文提出一種基于改進Faster RCNN[14]的目標檢測與抓取構型識別方法。為滿足識別要求,對抓取構型進行參數化處理,提出最優的五維參數描述。在深度卷積神經網絡對目標區域進行特征提取的基礎上,通過區域生成網絡(Regional Proposal Network,RPN)進行目標檢測,利用Anchor法完成抓取構型參數提取,最后通過線性回歸與分類網絡實現修正,進一步提高目標檢測與構型識別的準確性。

2 目標檢測與抓取構型估計算法

2.1 抓取構型參數化

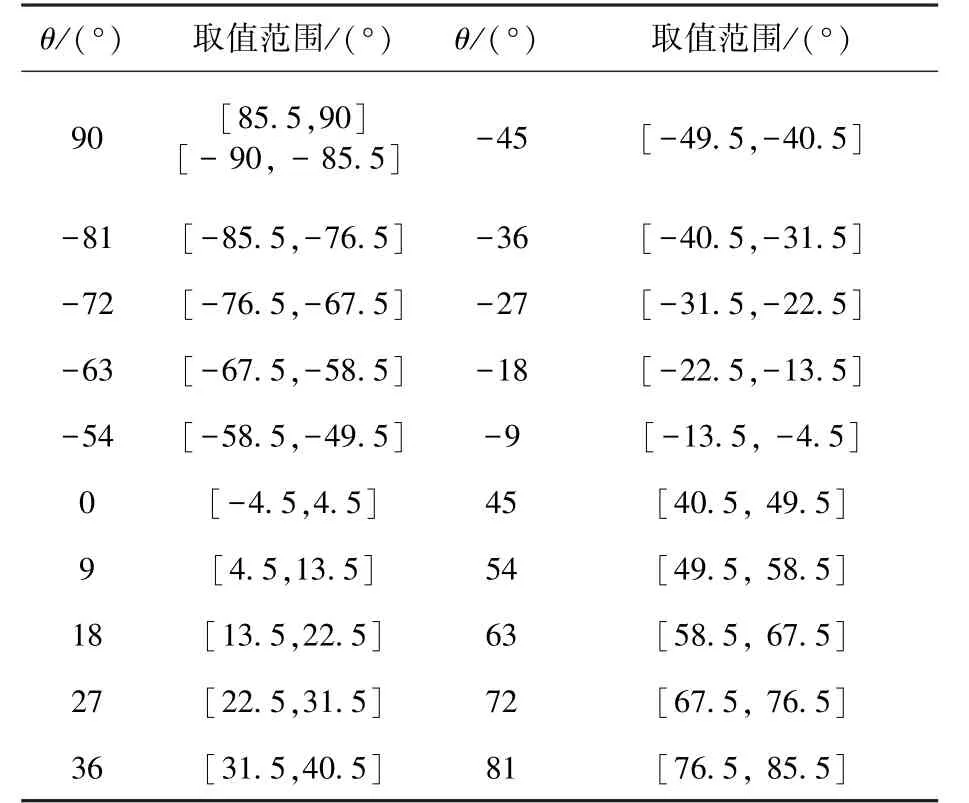

為實現目標的成功抓取,需要估計出目標位姿并轉換為機械臂末端的抓取構型。不失一般性,設計抓取位置為物體頂部,因此可以簡化Jiang等[15]的七維參數抓取構型方法,采用五維參數描述,具體如圖1所示。該圖可以表示抓取構型在圖像中的位置和機械臂末端夾持器的狀態,綠色邊框代表夾持器二指的位置,并且二指與綠邊平行,藍色邊長度代表夾持器張開的長度,藍邊與水平方向的夾角代表夾持器旋轉的角度,矩形框的中心為夾持器抓取的位置,本文用g表示機器人成功抓取物體的抓取構型參數,表達式見式(1)。

式中(x,y)代表抓取構型的中心位置,(w,h)分別代表抓取構型的寬和高,θ代表矩形框相對于水平方向旋轉的角度,設定順時針旋轉為負,逆時針旋轉為正,由于方向的對稱性,抓取角度區間取 [-90°,90°]。

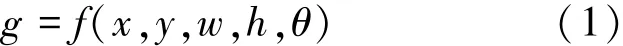

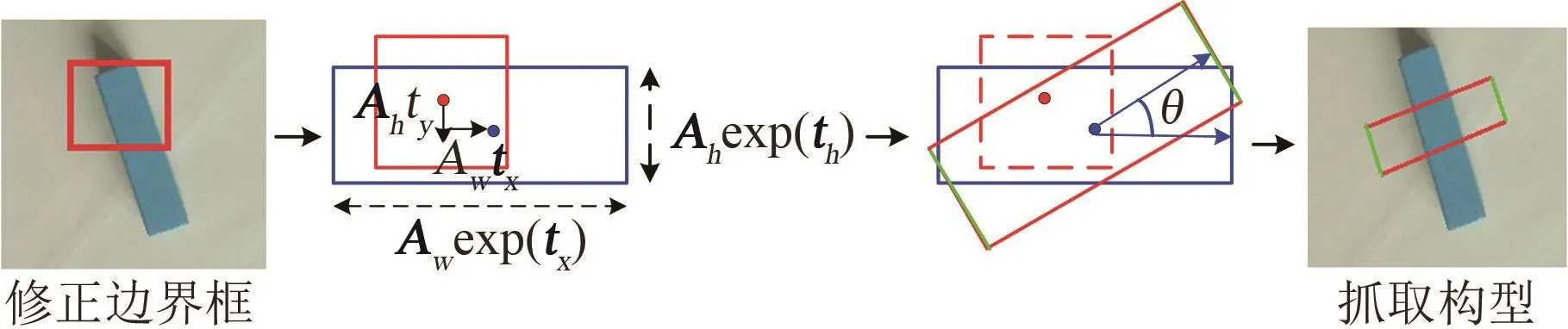

為了使目標抓取具備更強的魯棒性,將抓取角度參數θ的取值分為20種,因夾持器為二指構型,因此其旋轉正負90°后構型相同,每個抓取角對應的區間如表1所示。

圖1 抓取構型示意圖Fig.1 Schematic diagram of grasp configuration

表1 抓取角度對應區間Table 1 Corresponding regions of grasp angle

2.2 目標檢測與抓取構型估計

目標檢測是在圖像中檢測并識別目標,從而為操作者提供指示并確定機械臂末端抓取構型。本文在Faster R-CNN的基礎上,利用RPN對目標進行識別,通過滑動窗口和Anchor機制先確定抓取構型的(x,y,w,h)參數,然后將對應的區域特征輸入到全連接層,得到的目標識別結果輸出到線性回歸網絡和分類網絡,線性回歸網絡進一步對抓取構型進行修正,提高抓取構型的精度。分類網絡根據抓取區域特征確定抓取構型參數θ的大小,確定抓取角度。

本算法的神經網絡框架如圖2所示,該框架是由3部分組成:第1部分完成圖像特征提取,第2部分實現抓取構型中與目標位姿相關參數的識別,第3部分對參數進行修正并確定抓取角度。

圖2 抓取構型識別算法流程圖Fig.2 Flow chart of recognition algorithm for grasp configuration

第1部分是由特征提取網絡構成,采用經典的VGG16網絡[16],該網絡是 Image Net ILSVRC 2014競賽模型,其網絡層比常用網絡結構擴展了2倍,對特征提取更加豐富,為后期的目標檢測和抓取構型估計提供輸入。該部分與Faster R-CNN算法所采用的特征提取網絡一致,首先輸入高為H、寬為W像素的圖像,然后采用VGG16神經網絡架構進行特征提取,得到的特征圖像高寬分別為H/16、W/16。 在卷積層,采用卷積核為3×3,步長為1,填充(Padding)參數為補零(SAME)的卷積方式,輸出特征圖。

第2部分是由RPN網絡組成,該部分采用上一部分輸出的特征圖,通過Anchor方法檢測到目標,識別目標位姿,并用修正邊界框標識,網絡輸出修正邊界框與抓取概率。

第3部分完成抓取構型識別,通過將修正邊界框的特征值輸入到全連接層,然后分別輸出抓取構型對應20種角度的抓取概率。

2.2.1 生成修正邊界框

1)特征提取。通過512通道,3×3卷積核將特征提取后得到的特征圖像進行卷積,輸出為(512,H/16,W/16)大小的特征圖像,再通過 2 個并行的1×1卷積核進行卷積,通道數分別為18和36。輸出特征圖像保持高、寬不變。

2)參考邊界框提取。以特征圖像的每個像素為中心,按不同尺度和長寬比產生矩形框,由于夾持器張開角度限制,尺度選取應適當。為滿足識別出不同尺度不同形狀的目標,選取尺度為[2,4,8],長寬比采用[1 ∶2,1 ∶1,2 ∶1]的 3 種比率,共9個區域。由于尺度選取對應的是特征圖像,實際操作中需把參考邊界框映射到原始圖像,考慮到基礎尺度為16,因此映射到原始圖像后,每個參考邊界框的尺度為[322,642,1282],每個尺度對應的長寬比率如圖3所示。

圖3 特征圖與參考邊界框Fig.3 Feature maps and bounding boxes with reference

為了解決參考邊界框重疊問題,采用了非極大值抑制(Non-maximum suppression)方法,通過利用不同的尺寸和比例將產生的所有參考候選框與已標定的真實抓取構型進行比較,把與標定抓取構型的交并比(Io U)大于設定閾值的邊界框定義為參考邊界框,交并比的計算方法見式(2)。

式中,A∩G代表真實抓取構型與預測抓取構型面積的交集,A∪G代表真實抓取構型與預測抓取構型面積的并集,如圖4所示。

3)RPN網絡回歸。由卷積核(36,1,1)卷積得到(36,H/16,W/16)預測偏移值,其中每一個位置對應36通道,每4個通道的數值對應每個參考邊界框的中心位置(x,y)和高寬(H,W)的偏移值,由于每個位置對應9個參考邊界框,因此每個位置有36通道,分別對應9個參考邊界框的偏移值,然后通過Reshape函數將預測偏移值轉換成為(9×H/16×W/16,4)結構的邊界框偏移值。

圖4 交并比示意圖Fig.4 Schematic diagram of Io U

4)修正邊界框生成。將生成為(9×H/16×W/16,4)的邊界框偏移值與參考邊界框相加,即可得到修正邊界框。考慮到抓取構型與目標姿態有關,為了使修正邊界框滿足抓取要求,采用2次線性回歸方法, A=(Ax,Ay,Aw,Ah) 代表 Anchor的中心位置與長寬參數, G=(Gx,Gy,Gw,Gh) 代表目標在圖像中的真實區域, G′=(G′x,G′y,G′w,G′h)代表經過線性回歸所得到的區域,可得G′≈G。根據泰勒展開定理,當Anchor區域與目標真實區域相距較近時,兩者的關系可近似表示為線性關系,該線性關系可表示為式(3):

式中,φ(A)為特征向量,w為待學習的權重參數, d(A)= [dx(A),dy(A),dw(A),dh(A)]為線性關系表達式,具體表示為式(4):

為了使回歸后的區域值與真實區域值偏差最小,設計修正網絡損失函數為式(5):

式中, t= [tx,ty,tw,th], 各分量表示為式(6):

修正邊界框到抓取構型的回歸過程如圖5所示。其中紅色為修正邊界框,藍色為對修正邊界框線性回歸后的結果,在對其進行角度修正后,可獲得目標的抓取構型。

圖5 修正邊界框線性回歸過程Fig.5 Linear regression of bounding boxes with revise

5)修正邊界框篩選。舍去超出圖像的修正邊界框和長寬比太小的修正邊界框;根據每個修正邊界框的抓取分數,選取前6000個高分數修正邊界框;利用非最大值抑制(Non-Maximum Suppression)方法,從6000個修正邊界框中選出300個修正邊界框。

2.2.2 生成邊界框抓取概率

1)將RPN網絡生成的特征圖通過二分類網絡由卷積核(18,1,1)卷積得到(18, H/16,W/16)結構的特征圖,由于每一個位置對應9個候選邊界框,因此其通過卷積得到的18通道分別對應每個候選邊界框的可抓取分數和不可抓取分數。

2)將得到每個區域的得分通過非線性映射函數Softmax映射到[0,1]區間,得到每個候選邊界框可抓取概率和不可抓取概率,然后得到每個修正邊界框的抓取概率。

2.2.3 生成抓取構型參數

將2.2.1節步驟5中篩選出來的300個修正邊界框進行區域池化(RoI Pooling)處理,生成固定大小為(7,7,512)的特征值,輸入到全連接層,預測出每個修正邊界框對應每個抓取角度的概率,同時對位置和大小進一步進行修正,最后得到抓取構型參數。

2.2.4 設計損失函數

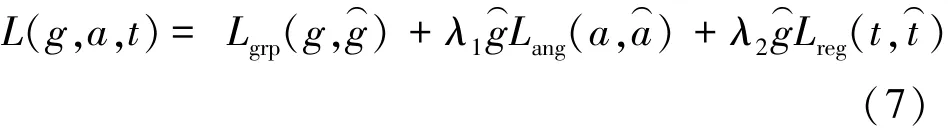

考慮到抓取任務的需求,按照多任務要求設計最小化損失函數,如式(7)所示。

式中,g代表參考抓取構型的可抓取分數,a代表旋轉角度類別,t代表參考抓取構型線性回歸參數,當修正邊界框與標定的真實抓取構型交并比超過設定閾值時,值取1,否則值取0,為預測抓取構型參數A與真實抓取構型參數G的差值,λ1、λ2為平衡參數,Lgrp,Lang采用Softmax損失函數,Lreg采用L1損失函數。采用L1損失函數,可以有效的使訓練模型收斂,提高訓練效率[17]。

3 神經網絡模型訓練

神經網絡模型訓練采用了隨機梯度下降法,在損失函數收斂后,完成神經網絡模型訓練。

3.1 模型訓練

在訓練模型過程中,訓練數據的準備、超參數的選取對訓練的模型至關重要,其對訓練模型的精度和魯棒性起決定性作用。

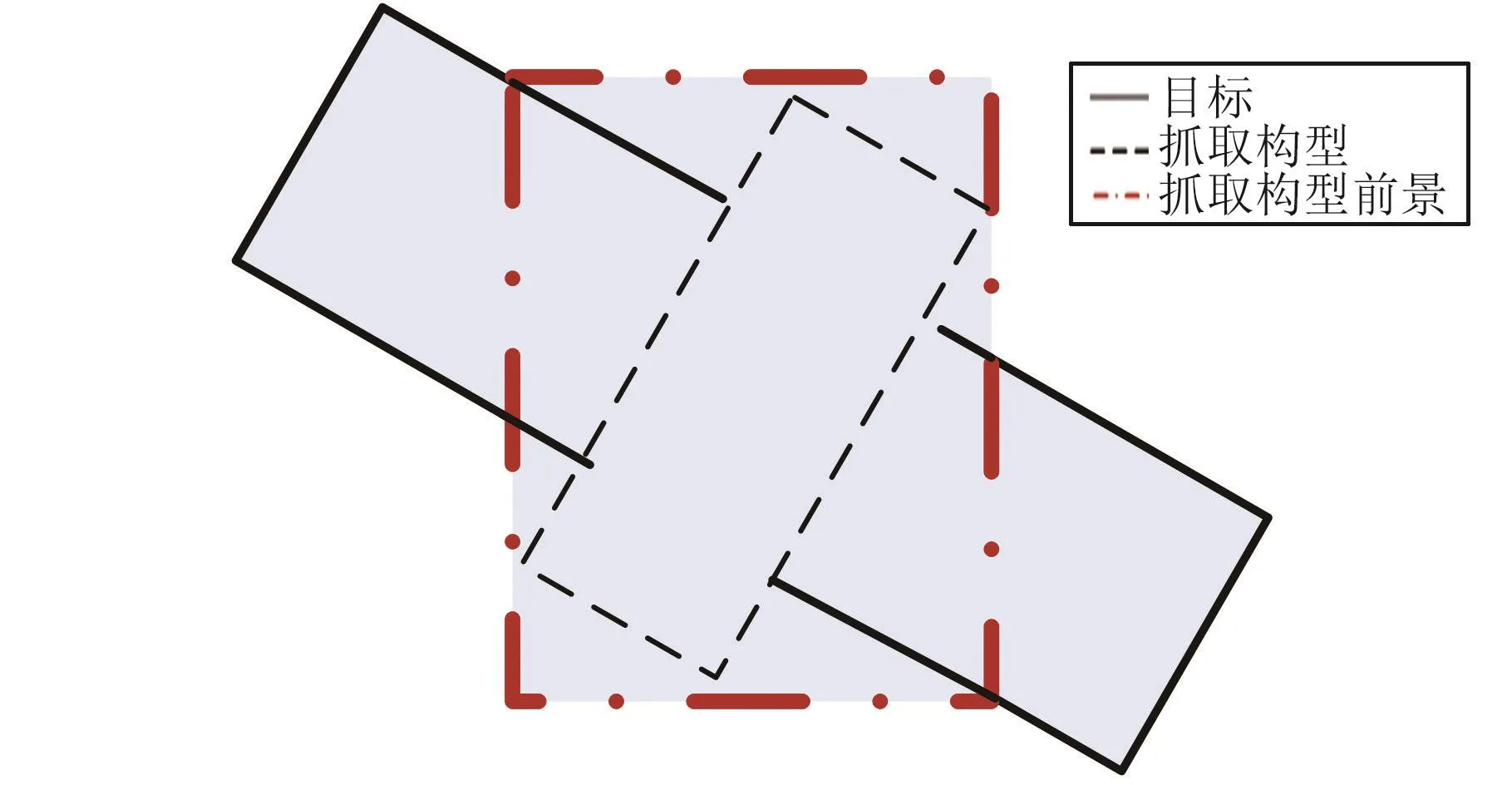

首先讀取Cornell Grasp Detection數據集的pcdxxxxcpos.txt文件,根據每4行數據,計算標注的抓取構型參數,利用前2行位置坐標計算抓取構型參數(h,θ),其中h為兩點之間的距離,θ為兩點直線與水平線之間的夾角,利用表1找到對應區間的代表角度,并將標注抓取構型標記為對應類型θ,最后根據位置坐標計算出抓取構型的中心位置(x,y)。 為提供較多的特征數據和訓練數據的魯棒性,把覆蓋標注的抓取構型最小區域設置為前景,稱其為“抓取構型前景”,前景區域如圖6所示,其中實線矩形代表抓取物體,虛線矩形代表標注抓取構型,點畫線矩形代表“抓取構型前景”。采用標注抓取構型參數與預測候選框的參數差值進行線性回歸,將與前景區域交并比大于0.7的預測候選框設置為正樣本,小于0.3的預測候選框設置為負樣本,其他情況的舍去,不參與模型訓練。通過篩選,每張圖片中的正負樣本總共個數為256個。

將原始圖像根據縮放比例k進行放大,其中k值計算方法見式(8),將圖像去中心化,即每個像素3通道值減去[102,115,122],得到去中心化的圖像數據作為訓練樣本,為提高訓練出來模型的魯棒性,通過水平翻轉的方法將訓練數據量擴展到1倍。

圖6 前景區域示意圖Fig.6 Schematic diagram of foreground region

在訓練模型時,采用整體訓練的方法,同時利用ImageNet訓練好的參數進行初始化網絡參數。Epochs參數為1000,學習率為 0.001,Weight Decay參數設置為0.0001,Minibatch參數選擇為1,即每一張圖片作為一個Batch進行訓練;在將RoI區域向全連接層輸入特征時,采用的固定尺寸為(7,7),并在訓練時,全連接層失活率(Dropout)采用0.5。

經過 Fine-Tuning訓練后,通過 Tensorboard得到的損失函數收斂過程如圖7所示,從結果可知,損失函數收斂。

圖7 損失函數收斂過程Fig.7 Convergence process of loss function

3.2 模型測試

將訓練得到模型用于測試,測試時每張圖片得到300個抓取構型,每個構型對應20種類別得分,即20種角度得分,每種類別對應4個抓取構型修正參數[tx,ty,tw,th]。 把每個構型最高分對應的類別作為構型抓取角度,通過采用非極大值抑制方法得到若干個抓取構型,經過排序后,把最高得分的構型視為抓取構型。若檢測得抓取構型與標注的抓取構型交并比大于設定閾值,則視為抓取構型檢測成功。

4 測試結果

4.1 網絡識別測試

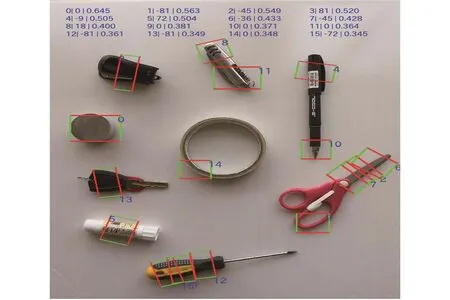

對多目標抓取構型檢測結果如圖 8所示。每個目標標識前3個概率最大的抓取構型,其中綠色邊框為夾持器的兩指所在位置,紅色邊框長度為夾持器張開寬度,紅色邊框與水平線的夾角為抓取構型相對于水平面旋轉角度,每個抓取構型標有序號,序號越小代表預測的抓取構型概率越高,即抓取物體成功率越高。

圖8 多目標抓取構型檢測結果示意圖Fig.8 Grasp configuration detection of multiple objects

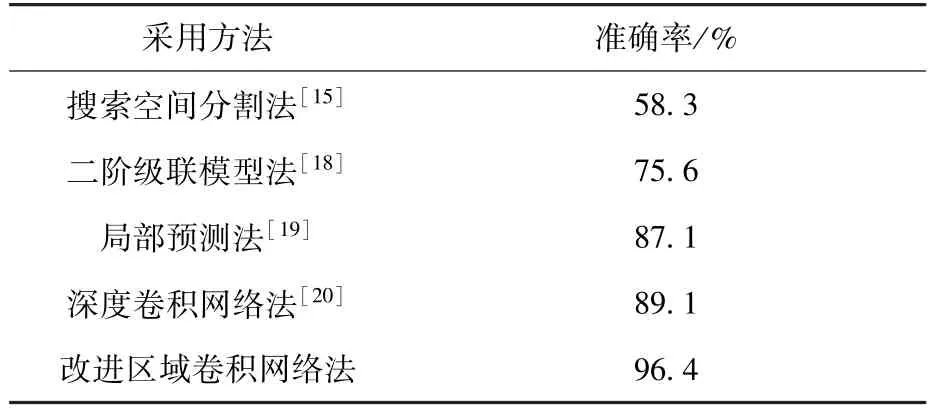

利用Cornell Grasp Detection測試數據對訓練得到的模型進行測試,測試集共有圖片1034張,統一像素為640×480,訓練文件為9個,測試文件為1個,神經網絡訓練框架為tensorflow,GPU為GTX2080Ti。相同測試條件下,與4種已有識別方法準確率比較如表2所示。Jiang等[15]改進抓取點檢測為抓取矩形區域檢測并提出搜索空間分割算法,提高了檢測速度,但由于空間的分割使得特征提取不完整,因此降低了檢測準確率。Lenz等[18]為解決多目標檢測問題,提出了二階級聯網絡方法,特征提取通過多級網絡完成,提高了檢測速度,但初級特征提取選擇了淺層網絡,導致準確率較低。針對單個目標的多邊界框選取問題,Redmon等[19]提出了局部預測方法,對多邊界框給出了抓捕成功率的預測值,提高了抓捕成功率,但其采用了單次回歸方法,導致邊界框的修正不夠精確。Guo等[20]采用了深度卷積網絡對抓捕構型進行識別,并建立了具有觸覺傳感器的機器人實驗平臺,證實了抓捕構型識別的準確性。

表2 識別準確率比較Table 2 Comparison of recognition accuracy

改進區域卷積網絡算法采用級聯深度卷積網絡,由表2可知,本文提出的算法識別準確率高于其他方法,識別準確率為96.4%,這源于算法在以下3方面的改進:

1)采用VGG16深層網絡進行特征提取,比常用的網絡結構擴展了2倍,其他幾種算法采用6層淺層網絡進行特征提取,本文算法提取特征信息更加豐富,與其他算法相比具有一定的優越性;

2)采用2次線性回歸的方法對抓取構型進行修正,在有限時間增加的條件下,顯著提高了識別準確率;

3)優化了特征區域選取方法,將覆蓋抓取構型的最小矩形區域設為前景進行學習,這樣可以更加充分的學習抓取構型區域特征,提高識別準確率。

在抓取構型識別的同時,為給操作者提供必要的指示信息,算法會將抓取構型進行編號,并提供不同構型抓取成功概率,操作者可以根據信息輔助操作與決策。標記結果如圖9所示,其中圖片上方標注16組數據,每組數據對應圖片中每個抓取構型參數,由豎線分隔。第1列代表抓取構型標號,其與檢測候選框標號一一對應;第2列代表抓取構型相對于水平面旋轉角度;第3列代表對應抓取構型的抓取成功概率,根據抓取成功概率的不同,選擇適當的抓取構型以及抓取位置。

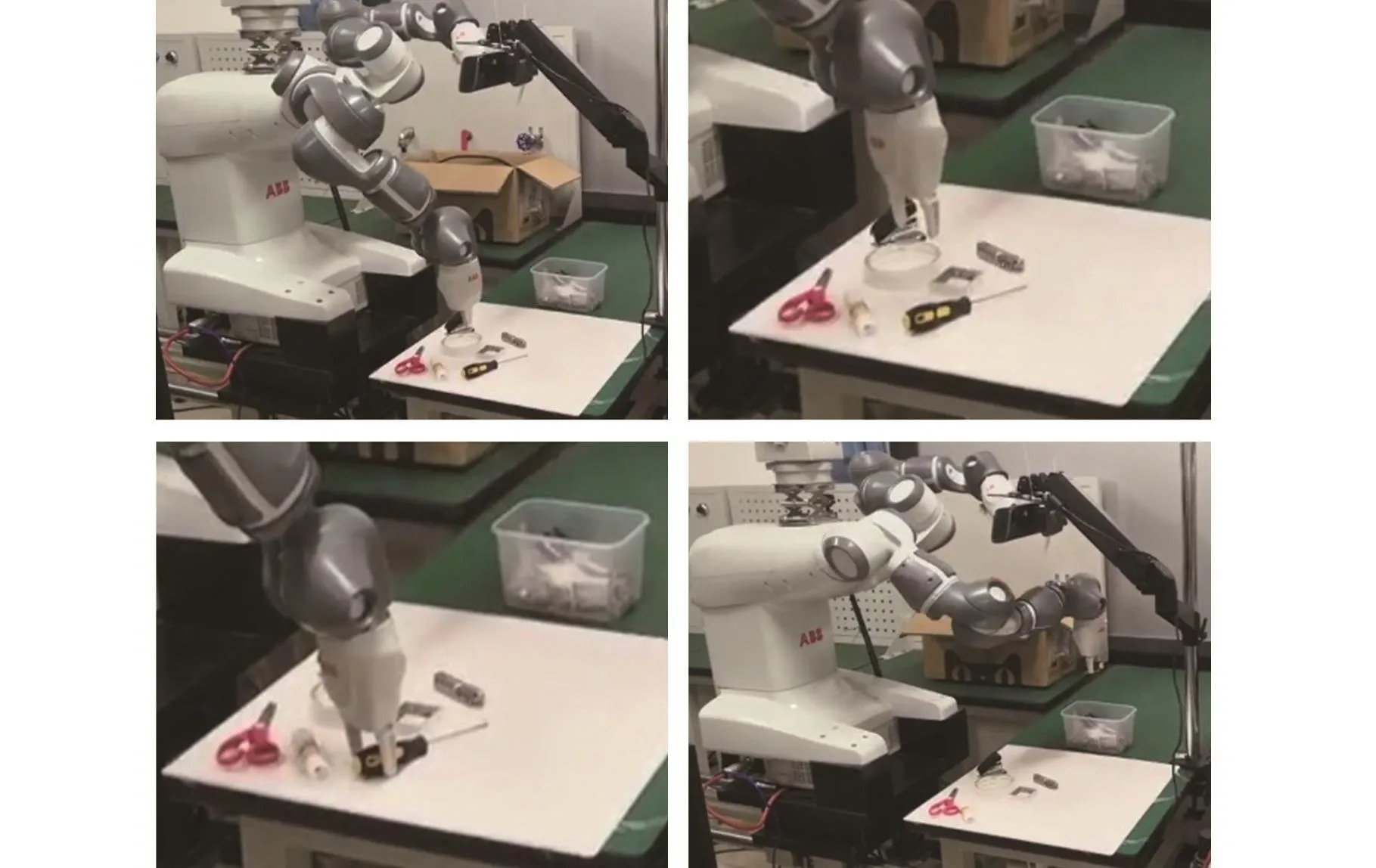

4.2 實驗平臺測試

為驗證算法的有效性與準確性,設計了機器人試驗平臺,該平臺由包含二指結構夾持器的ABB14000機器人以及圖像獲取設備Kinect構成,Kinect可以準確檢測目標的深度信息,如圖10所示。圖像信息由的Kinect傳感器采集,通過網絡傳輸到機器人中控計算機進行處理,在識別出抓捕構型后,機械臂按參數(x,y)運動到目標上方,通過機器人末端關節旋轉來調整夾持角度θ,夾持器張開長度由參數w給出,機械臂根據深度信息向下運動h距離。

圖9 復雜幾何體抓取構型檢測結果示意圖Fig.9 Grasp configuration detection of complicated geometrical bodies

圖10 算法驗證試驗平臺Fig.10 Fabricated setup for verification experiments

圖11 展示了試驗過程的4個階段,分別為機械臂水平運動到抓取位置上方,旋轉機械臂末端關節角并張開夾持器,垂直運動到目標物體上方并完成夾持,轉移物體到放置盒內。通過機械臂夾持物體試驗驗證了本文算法對抓取構型識別的準確性。

5 結論

圖11 驗證試驗4個階段Fig.11 Four snapshots of the verification experiment

本文針對局部自主遙操作過程中識別目標速度慢、準確率低的問題,提出了一種基于改進快速區域卷積神經網絡(faster R-CNN)的抓取構型識別方法。該算法采用VGG16深度卷積神經網絡對圖像進行特征提取,2次線性回歸的方法進行修正,并改進了前景特征區域的選取,使抓取構型更加精確,進一步提高識別的準確率。考慮到末端夾持器的特點,提出了復合損失函數,提高了訓練效率。通過Cornell Grasp Detection測試數據對訓練得到的模型進行測試,算法識別準確率測試結果為96.4%,性能優于同類相關算法。機器人試驗平臺測試結果表明,在簡單場景下,通過該方法可以完成機器人對目標的抓取任務。