半監(jiān)督單樣本深度行人重識別方法①

單 純,王 敏

(河海大學(xué) 計算機(jī)與信息學(xué)院,南京 211100)

1 引言

行人重識別又稱行人再識別[1,2].當(dāng)人臉識別失效時,行人重識別就成為了一個非常重要的替代技術(shù).簡單而言就是給定一個監(jiān)控行人的圖像,從資料庫中檢索該行人的圖像[3].但是由于不同照相機(jī)的參數(shù)、位置不同,行人的姿態(tài)變化、光照、遮擋等諸多因素,行人重識別的研究仍面臨著許多的挑戰(zhàn).

隨著深度學(xué)習(xí)的發(fā)展,卷積神經(jīng)網(wǎng)絡(luò)已經(jīng)被證實在許多計算機(jī)視覺任務(wù)中具有十分出眾的表現(xiàn).卷積神經(jīng)網(wǎng)絡(luò)模型在行人重識別任務(wù)中的潛力也逐漸被發(fā)掘出來.相較于傳統(tǒng)的行人重識別方法,基于深度卷積神經(jīng)網(wǎng)絡(luò)的行人重識別方法,對于個體圖片提取的特征具有更好的描述能力以及更強(qiáng)的魯棒性.當(dāng)今基于深度學(xué)習(xí)的行人重識別方法主要可以分為相似度學(xué)習(xí)以及特征表示兩大類,第一類主要是在端到端的深度神經(jīng)網(wǎng)絡(luò)中,通過不同的驗證損失學(xué)習(xí)特征,第二類則是將不同ID的圖片放入到深度神經(jīng)網(wǎng)絡(luò)中,通過ID損失學(xué)習(xí)生成一個分類器.目前,絕大部分的行人重識別方法是基于監(jiān)督式學(xué)習(xí)方法.Li等[4]利用空洞卷積進(jìn)行多尺度特征提取,并融合局部特征與全局特征.Wojke等[5]對傳統(tǒng)Softmax分類器簡單再參數(shù)化,優(yōu)化了余弦相似度,進(jìn)而實現(xiàn)對特征空間的學(xué)習(xí).然而基于監(jiān)督學(xué)習(xí)的行人重識別需要大量標(biāo)注的訓(xùn)練數(shù)據(jù),并且這些數(shù)據(jù)要求來自不同攝像頭以及不同的視角.當(dāng)數(shù)據(jù)集不斷擴(kuò)大,大量的人工標(biāo)注數(shù)據(jù)需要耗費大量的人力和時間,這使得監(jiān)督式行人重識別方法的實際應(yīng)用價值大大降低.當(dāng)攝像頭數(shù)量大幅增加時,大量人工標(biāo)注的數(shù)據(jù)會對產(chǎn)生很多負(fù)面影響,從而影響了行人重識別的應(yīng)用.為了解決上述的困難,研究人員開始逐漸嘗試?yán)梦礃?biāo)注的數(shù)據(jù),越來越多的半監(jiān)督式和無監(jiān)督式行人重識別方法開始出現(xiàn).Huang等人[6]提出了一種將正則化標(biāo)簽賦予生成數(shù)據(jù),并將其作為訓(xùn)練樣本補充數(shù)據(jù)的方法.Kipf等人[7]提出了通過直接利用神經(jīng)網(wǎng)絡(luò)模型進(jìn)行圖形結(jié)構(gòu)編碼,在一個有監(jiān)督目標(biāo)上,為所有帶有標(biāo)注的節(jié)點進(jìn)行訓(xùn)練.Liu等人[8]提出了一種半監(jiān)督式耦合字典學(xué)習(xí)方法,主要是在訓(xùn)練階段,從已標(biāo)注和未標(biāo)注的圖片中,聯(lián)合學(xué)習(xí)兩個耦合字典.半監(jiān)督學(xué)習(xí)方法的優(yōu)勢十分明顯[9–11],能夠充分利用有限的數(shù)據(jù),將標(biāo)注數(shù)據(jù)與未標(biāo)注數(shù)據(jù)的優(yōu)勢相結(jié)合,從而更好的解決行人重識別任務(wù).

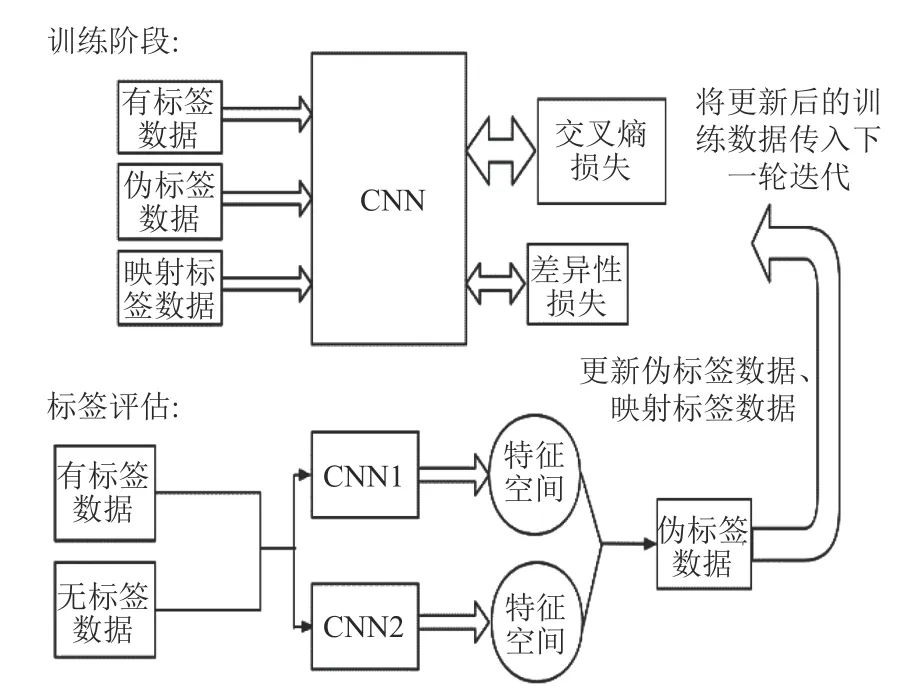

在實際應(yīng)用中,為大量跨鏡頭的數(shù)據(jù)標(biāo)注需要花費大量的精力.在本文中,為每個行人ID僅提供一個樣本,這樣的設(shè)置在解決實際問題時更具有意義.為了能夠充分利用有限的標(biāo)注數(shù)據(jù),訓(xùn)練過程中,將訓(xùn)練集劃分為3個部分:有標(biāo)簽數(shù)據(jù)、偽標(biāo)簽數(shù)據(jù)、映射標(biāo)簽數(shù)據(jù).特別地,選調(diào)偽標(biāo)注數(shù)據(jù)的規(guī)模是漸進(jìn)式不斷擴(kuò)大,利用兩個同時訓(xùn)練的卷積神經(jīng)網(wǎng)絡(luò)對于偽標(biāo)簽進(jìn)行又一輪篩選,再依據(jù)不相似代價從這些偽標(biāo)注數(shù)據(jù)篩選出Nk個最優(yōu)項,并加入到下一輪的ID分類訓(xùn)練中去.通過這樣的方式,可以進(jìn)一步提升偽標(biāo)簽精度,從而能夠更好地優(yōu)化模型.下面將具體介紹本文所提出的行人重識別方法.

2 半監(jiān)督式單樣本深度行人重識別

圖1為本文提出方法的總體框架,通過多種數(shù)據(jù)的聯(lián)合學(xué)習(xí)、多模型聯(lián)合訓(xùn)練和不斷擴(kuò)大偽標(biāo)簽數(shù)據(jù)規(guī)模的漸進(jìn)式學(xué)習(xí)方式來逐步優(yōu)化行人重識別模型,下面將具體介紹該方法.

圖1 總體框架

2.1 聯(lián)合學(xué)習(xí)方法

首先來介紹模型的更新步驟,在第k次迭代時,使用有標(biāo)簽數(shù)據(jù)L={(x1,y1),···,(xnl,ynl)}、從偽標(biāo)簽數(shù)據(jù)Pk和映射標(biāo)簽數(shù)據(jù)Ik共同訓(xùn)練模型.特別地,映射標(biāo)簽數(shù)據(jù)是沒有被賦予偽標(biāo)簽的無標(biāo)注數(shù)據(jù),將對應(yīng)的數(shù)據(jù)索引作為標(biāo)簽,從而生成映射標(biāo)簽數(shù)據(jù):

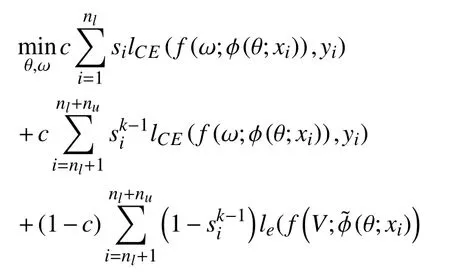

利用標(biāo)注數(shù)據(jù)和選調(diào)出的偽標(biāo)簽數(shù)據(jù)進(jìn)行ID分類學(xué)習(xí).但對于映射標(biāo)簽數(shù)據(jù)而言,被賦予了對應(yīng)索引值的映射標(biāo)簽,顯然將映射標(biāo)簽數(shù)據(jù)加入到ID分類訓(xùn)練中會損害模型.為了充分利用這些映射標(biāo)簽數(shù)據(jù),我們采納文獻(xiàn)[12]提出的差異性損失,利用索引標(biāo)注數(shù)據(jù)來優(yōu)化卷積神經(jīng)網(wǎng)絡(luò)模型:

其中,V作為一個查詢列表存儲了所有的映射標(biāo)注數(shù)據(jù)的特征xi,通過這樣的設(shè)置,避免了在每次迭代時都要重復(fù)從所有的數(shù)據(jù)中提取特征的復(fù)雜運算.τ控制樣本概率分布.在前向傳播過程中,計算xi與其他所有數(shù)據(jù)的余弦相似度,在反向傳播過程中,對vi進(jìn)行更新:

并通過L2歸一化,將其轉(zhuǎn)化為單位向量后傳入V中,以實現(xiàn)對V中第i列元素的更新.通過這種差異性損失,模型能夠?qū)W習(xí)區(qū)分不同輸入圖片而不是學(xué)習(xí)分類ID,從而使得學(xué)習(xí)到的表征會獲得更多關(guān)于輸入ID的信息.在此過程中,盡管這些樣本沒有任何的標(biāo)注,但是模型可以獲取更多的樣本,并且這些樣本可以通過學(xué)習(xí)不同行人圖片間的差異性來為模型提供微弱的監(jiān)督信息.對于有正確標(biāo)簽ID的數(shù)據(jù)集L,依照[10]方法來訓(xùn)練re-id模型,以下是目標(biāo)方程:

其中,f(ω;·)表示ID分類器,這個分類器能夠?qū)⑻崛〕龅奶卣鞣诸惖終維的置信估計中(K表示ID數(shù)量),lCE表示預(yù)測標(biāo)簽與真實ID標(biāo)簽之間的交叉熵?fù)p失.同樣的,可以采用相類似的方式利用偽標(biāo)簽數(shù)據(jù)集P來優(yōu)化模型:

對于偽標(biāo)簽數(shù)據(jù)的使用,這里的方法與有標(biāo)簽數(shù)的方法基本類似,不同的是在這里加入一個判別器Si{0,1},判別器的值由上一步的變遷估計決定,判別器將決定所挑選出的偽標(biāo)注數(shù)據(jù)能否加入到ID分類訓(xùn)練中.考慮到訓(xùn)練數(shù)據(jù)有三部分組成,第一部分是在標(biāo)注數(shù)據(jù)集L的ID分類損失,第二部分是用于抽選出的偽標(biāo)簽數(shù)據(jù)Pk的ID分類損失,第三部分則是用于映射標(biāo)注數(shù)據(jù)集Ik的差異性損失.采用以下的目標(biāo)方程來進(jìn)行迭代:

k表示第k次迭代,c為調(diào)整交叉熵?fù)p失與差異性損失所占權(quán)重的參數(shù).

2.2 抽樣策略與標(biāo)簽估計

在解決單樣本類型的任務(wù)時,分類器容易對單樣本數(shù)據(jù)過擬合,從而進(jìn)一步影響了分類器對于ID分類的魯棒性.為了解決過擬合的問題,著眼于提高選調(diào)偽標(biāo)簽精度的方式,從獲取偽標(biāo)簽的數(shù)據(jù)中挑選出更優(yōu)的偽標(biāo)簽數(shù)據(jù),將它們加入到ID分類的訓(xùn)練中,因此,選擇一個合適的抽樣策略顯得十分關(guān)鍵.

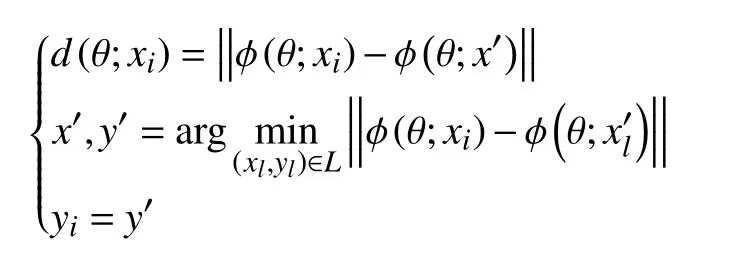

本方法采用特征空間上的距離作為衡量偽標(biāo)簽的方式.對于無標(biāo)簽數(shù)據(jù)的標(biāo)簽評估,使用最鄰近分類器,最鄰近分類器會在特征空間上為每一個無標(biāo)簽數(shù)據(jù)查找到與其距離最近的有標(biāo)簽數(shù)據(jù),將查找到的有標(biāo)簽數(shù)據(jù)的標(biāo)簽作為偽標(biāo)簽賦給無標(biāo)簽.特別地,在特征空間上的距離會作為標(biāo)簽評估的置信度,從偽標(biāo)簽數(shù)據(jù)中進(jìn)行選調(diào).為了充分獲得并利用這些數(shù)據(jù),在每一輪的迭代中,從每個模型中選調(diào)的偽標(biāo)簽數(shù)據(jù)Nk的規(guī)模是不斷擴(kuò)大.具體的,通過以下方法為無標(biāo)簽數(shù)據(jù)進(jìn)行標(biāo)簽估計:

d(φ;xi)看作是提取特征向量的不相似代價,用于估計樣本標(biāo)簽.通過上一步,可以從兩個模型中各自挑選出Nk個置信度較高的偽標(biāo)簽數(shù)據(jù).但是,這樣的偽標(biāo)簽的數(shù)據(jù)標(biāo)簽精確度仍然有限,為此,將兩個模型挑選出的2Nk個偽標(biāo)簽數(shù)據(jù)共同進(jìn)行進(jìn)一步的篩選,將特征索引相同的偽標(biāo)簽數(shù)據(jù)挑選出來,從而完成了為標(biāo)簽數(shù)據(jù)精度的再一次提升:

2.3 總體迭代策略

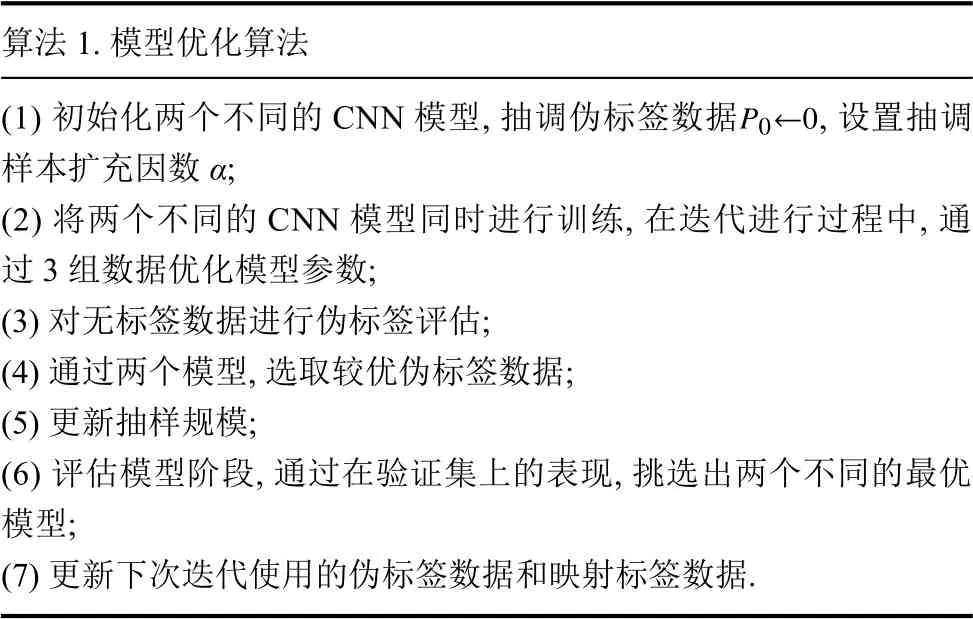

通過上面提出抽樣方法,充分保證了所選調(diào)的偽標(biāo)簽數(shù)據(jù)的可靠性.在最初階段,模型訓(xùn)練僅僅使用很小一部分的偽標(biāo)簽數(shù)據(jù)樣本,隨著迭代的進(jìn)行,再逐漸擴(kuò)充偽標(biāo)簽樣本的比例.特別地,在第一次迭代開始時,所有的無標(biāo)簽數(shù)據(jù)均沒有偽標(biāo)簽,模型的優(yōu)化通過(1)在有標(biāo)簽數(shù)據(jù)上,進(jìn)行ID分類訓(xùn)練;(2)對所有的無標(biāo)簽數(shù)據(jù),通過差異性損失來進(jìn)行無監(jiān)督訓(xùn)練.在之后的迭代過程中,逐漸增加選調(diào)偽標(biāo)簽數(shù)據(jù)的規(guī)模,Nt=Nt+α·nu,α ∈(0,1)作為迭代過程中控制擴(kuò)大選調(diào)偽標(biāo)速度的參數(shù),α參數(shù)決定了訓(xùn)練代價與模型精度,一個較小的參數(shù),意味著更多的迭代次數(shù)以及訓(xùn)練時間,但是,這樣會獲得更加可靠的偽標(biāo)簽數(shù)據(jù),從而獲得更加精確的模型.本方法采用多模型共同訓(xùn)練,選調(diào)的偽標(biāo)簽數(shù)據(jù)為各自模型中估計不相似代價最小的Nt個偽標(biāo)簽,這樣可以保障被賦予偽標(biāo)簽的數(shù)據(jù)具有相對較高的可靠性,因此,本方法在迭代的過程中會選擇一個相對較大的參數(shù)α,從而平衡了模型精度與訓(xùn)練代價.

算法1.模型優(yōu)化算法(1)初始化兩個不同的CNN模型,抽調(diào)偽標(biāo)簽數(shù)據(jù) ,設(shè)置抽調(diào)樣本擴(kuò)充因數(shù)α;(2)將兩個不同的CNN模型同時進(jìn)行訓(xùn)練,在迭代進(jìn)行過程中,通過3組數(shù)據(jù)優(yōu)化模型參數(shù);(3)對無標(biāo)簽數(shù)據(jù)進(jìn)行偽標(biāo)簽評估;(4)通過兩個模型,選取較優(yōu)偽標(biāo)簽數(shù)據(jù);(5)更新抽樣規(guī)模;(6)評估模型階段,通過在驗證集上的表現(xiàn),挑選出兩個不同的最優(yōu)模型;(7)更新下次迭代使用的偽標(biāo)簽數(shù)據(jù)和映射標(biāo)簽數(shù)據(jù).P0←0

3 實驗與分析

3.1 實驗數(shù)據(jù)與評價標(biāo)準(zhǔn)

本文所使用的數(shù)據(jù)集,是當(dāng)前數(shù)據(jù)量較大的行人重識別數(shù)據(jù)集:MARS[13].該數(shù)據(jù)集總共包含了1261個行人ID,分別在6個攝像頭下進(jìn)行收集.其中訓(xùn)練集總計包含了625個行人ID,8298小段行人軌跡,共509 914張圖片.測試集包含636個行人ID,12 180小段行人軌跡.MARS數(shù)據(jù)集是提供序列信息的大規(guī)模行人重識別數(shù)據(jù)集.

當(dāng)前對行人重識別識別率的標(biāo)準(zhǔn)主要有以下兩種:(a)rank-n:給定查詢集中的一張圖片,計算它與圖庫中所有圖片的相似度,從高到低排列,如果前n項中有相同的行人,則識別正確.在這樣的評價標(biāo)準(zhǔn)中,rank-1的準(zhǔn)確率最為重要,rank-5與rank-10最為輔助參考(b)mAP:強(qiáng)調(diào)的是查全率與查準(zhǔn)率之間的平衡,也是先對相似度進(jìn)行排序,然后從高到低統(tǒng)計從第一項到最后一項相同行人圖片間正確識別的比率.

需要說明的是,同一攝像頭連續(xù)拍攝的兩幅圖像中,同一行人往往是比較相似的,評價標(biāo)準(zhǔn)中排除了所有這些情況,只統(tǒng)計一個攝像頭中的行人在其他攝像頭拍攝的圖像中查詢到的結(jié)果,一定程度抑制了數(shù)據(jù)本身不平衡可能對結(jié)果造成的影響.

3.2 實驗環(huán)境及參數(shù)配置

本算法使用深度學(xué)習(xí)框架Pytorch實現(xiàn),在配有1080tiGPU上進(jìn)行實驗?zāi)P陀?xùn)練和測試評估.對于模型選擇,使用InceptionV3[14]和在Imagenet上預(yù)訓(xùn)練過的Resnet50[15]兩個模型.

3.3 實驗比較

對于不同的選調(diào)偽標(biāo)簽擴(kuò)展因數(shù)α?xí)绊憘螛?biāo)簽數(shù)據(jù)的可靠性,因此,在實驗進(jìn)行的過程中,使用不同的α,以充分了解其對于模型的影響.

從表1中可以看到選擇一個較小的α使得模型性能更優(yōu),由于擴(kuò)充因數(shù)α決定了標(biāo)簽更新速度,因此選擇較小的α?xí)黾訒r間代價.

表1 不同樣本擴(kuò)充因數(shù)α下模型性能

為了驗證方法的有效性,使用Mars數(shù)據(jù)集,分別與當(dāng)前基于監(jiān)督式、半監(jiān)督式的行人重識別方法進(jìn)行比較.

從表2中可以看出:通過本文提出的行人重識別方法,在單樣本設(shè)置下,模型rank-1=65.3,mAP=45.6這是一個不遜于基于監(jiān)督學(xué)習(xí)方法的效果.與當(dāng)前先進(jìn)的行人重識別方法相比較,本文提出的方法更少地依賴標(biāo)簽數(shù)據(jù),進(jìn)一步提升行人重識別的現(xiàn)實應(yīng)用價值.當(dāng)然,單樣本的設(shè)置會使得模型優(yōu)化遠(yuǎn)不及多樣本,且當(dāng)模型的樣本輸入從單樣本輸入設(shè)置為多樣本輸入時,總體的識別率會得到顯著提升,比如:當(dāng)標(biāo)注率提升為40%,rank-1=83.8,mAP=64.9.實驗結(jié)果表明本文提出的方法的有效性.

表2 與當(dāng)前先進(jìn)算法的性能比較

4 結(jié)論

本文提出的方法中,對于每個ID訓(xùn)練僅只提供一個有正確標(biāo)簽的樣本,在這樣的設(shè)置下,模型的學(xué)習(xí)會受到限制.為了應(yīng)對單樣本設(shè)置下行人重識別任務(wù),設(shè)計了一種多個卷積神經(jīng)網(wǎng)絡(luò)聯(lián)合訓(xùn)練的方法.對于每個卷積神經(jīng)網(wǎng)絡(luò),并且采用了漸進(jìn)式訓(xùn)練框架,使用標(biāo)簽數(shù)據(jù)、偽標(biāo)簽數(shù)據(jù)、映射標(biāo)簽數(shù)據(jù)聯(lián)合訓(xùn)練的方式.在標(biāo)簽評估階段,利用兩個模型聯(lián)合選調(diào)出較為精確的偽標(biāo)簽數(shù)據(jù),對偽標(biāo)簽數(shù)據(jù)集進(jìn)行更新.雖然我們的方法呈現(xiàn)出了一個可以與多樣本設(shè)置相媲美的效果,但是,解決單樣本設(shè)置下的行人重識別任務(wù)還面臨諸多挑戰(zhàn),未來仍有很多工作有待去解決.