基于CNN的艦船高分辨距離像目標(biāo)識(shí)別

(1. 海軍工程大學(xué)電子工程學(xué)院, 湖北武漢 430033; 2. 中國人民解放軍91245部隊(duì), 遼寧葫蘆島 125000)

0 引言

高分辨距離像(HRRP)在雷達(dá)自動(dòng)目標(biāo)識(shí)別(RATR)領(lǐng)域具有重要的軍事意義,其圖像的尖峰和起伏代表了目標(biāo)的精細(xì)結(jié)構(gòu)信息,反映了目標(biāo)散射特性沿雷達(dá)視線方向(RLOS)的分布,同時(shí)具有易獲取、易處理的特點(diǎn),因此在目標(biāo)識(shí)別領(lǐng)域具有廣闊的應(yīng)用前景[1-5]。目前國內(nèi)外學(xué)者對(duì)基于HRRP的目標(biāo)識(shí)別進(jìn)行了大量的研究,模板匹配法[3]、SVM[4]和PCA[5]是比較常見的目標(biāo)識(shí)別方法,但以上對(duì)于HRRP的目標(biāo)識(shí)別方法均基于特征提取這一關(guān)鍵步驟,很難挖掘目標(biāo)數(shù)據(jù)中的深層特征,且泛化性能不強(qiáng)[6-11]。

近年來深度學(xué)習(xí)(DL)發(fā)展迅速,成為各個(gè)領(lǐng)域的研究熱點(diǎn),同樣在雷達(dá)領(lǐng)域也可以通過深度學(xué)習(xí)算法實(shí)現(xiàn)信號(hào)與信息處理[12]。目前已有國內(nèi)外學(xué)者將深度學(xué)習(xí)應(yīng)用于HRRP-RATR領(lǐng)域中,文獻(xiàn)[8]分別將SVM、NN(Neural Network)與SAE方法進(jìn)行區(qū)分,通過比對(duì)實(shí)驗(yàn)發(fā)現(xiàn)SAE的識(shí)別率最高。西安電子科技大學(xué)雷達(dá)信號(hào)處理國家重點(diǎn)實(shí)驗(yàn)室的馮博團(tuán)隊(duì)在文獻(xiàn)[13]中提出SCAE(stacked corrective autoencoder)方法,對(duì)SAE進(jìn)行了改進(jìn),提升了HRRP的識(shí)別效果。文獻(xiàn)[14]應(yīng)用SAE和極限學(xué)習(xí)機(jī)相結(jié)合的方法進(jìn)行分類,識(shí)別速度快。文獻(xiàn)[15]采用RNN中長短時(shí)記憶循環(huán)神經(jīng)網(wǎng)絡(luò)(LSTM)對(duì)HRRP進(jìn)行分類。文獻(xiàn)[16]應(yīng)用了深度置信網(wǎng)絡(luò)(DBN)進(jìn)行HRRP目標(biāo)識(shí)別,該文獻(xiàn)提出對(duì)樣本進(jìn)行t分布隨機(jī)鄰域插入處理,擴(kuò)充了相應(yīng)類型樣本量。文獻(xiàn)[17]利用CNN進(jìn)行HRRP的目標(biāo)識(shí)別,該文獻(xiàn)對(duì)比了CNN和DBN對(duì)不同目標(biāo)的識(shí)別準(zhǔn)確率,CNN的準(zhǔn)確率大于10%。

CNN作為一種端對(duì)端的識(shí)別方式,無需人工特征提取且不需要角度的先驗(yàn)信息,一般用于對(duì)圖像數(shù)據(jù)的處理,其魯棒性和抗干擾性較強(qiáng)。針對(duì)傳統(tǒng)目標(biāo)識(shí)別方法人工提取特征難以挖掘到數(shù)據(jù)深層次特征,且易丟失數(shù)據(jù)信息的問題,本文提出了將CNN應(yīng)用于HRRP的目標(biāo)識(shí)別方法;針對(duì)HRRP數(shù)據(jù)是一維的問題,本文提出了將HRRP序列重新排列,將一維數(shù)據(jù)變?yōu)槎S數(shù)據(jù)進(jìn)行輸入,其具體方法為:將一維HRRP向量分為若干列向量形成“偽二值圖像”,即二維矩陣,作為網(wǎng)絡(luò)的輸入數(shù)據(jù)。由于CNN網(wǎng)絡(luò)對(duì)平移、扭曲、縮放具有不變性[18],因此將一維數(shù)據(jù)轉(zhuǎn)化為二維數(shù)據(jù)并不會(huì)增加或減少數(shù)據(jù)所包含的信息量,并且基于此優(yōu)越特性,解決了HRRP的平移敏感性。并在各層將數(shù)據(jù)可視化,可以更加直觀地看出網(wǎng)絡(luò)的訓(xùn)練過程;針對(duì)網(wǎng)絡(luò)中參數(shù)的選擇問題,本文詳細(xì)討論了網(wǎng)絡(luò)中的參數(shù)對(duì)識(shí)別性能的影響并進(jìn)行了優(yōu)化。另外本文通過對(duì)數(shù)據(jù)集減半和添加噪聲的方式驗(yàn)證了CNN具有較高的魯棒性和較高的識(shí)別率。

1 基于卷積神經(jīng)網(wǎng)絡(luò)的高分辨距離像目標(biāo)識(shí)別

1.1 高分辨距離像(HRRP)

HRRP是目標(biāo)散射點(diǎn)子回波沿雷達(dá)視線方向的投影向量和,其生成示意圖如圖1所示。早期的雷達(dá)目標(biāo)識(shí)別主要是通過窄帶雷達(dá)對(duì)目標(biāo)的有效散射截面積(RCS)進(jìn)行研究的,隨著帶寬的增大,雷達(dá)的分辨能力增強(qiáng),當(dāng)雷達(dá)的帶寬大到使雷達(dá)的距離分辨率遠(yuǎn)小于目標(biāo)的尺寸時(shí),目標(biāo)的各等效散射中心在雷達(dá)視線上被分開,目標(biāo)回波占據(jù)了多個(gè)距離單元,形成HRRP,它包含了目標(biāo)的結(jié)構(gòu)、大小、形狀等重要信息[19],因此如何有效地獲取并利用這些信息在目標(biāo)識(shí)別領(lǐng)域中顯得尤為重要。

1.2 CNN模型結(jié)構(gòu)

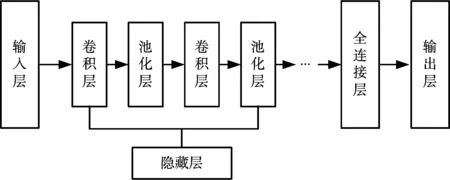

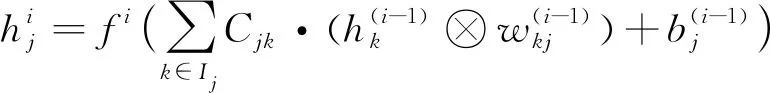

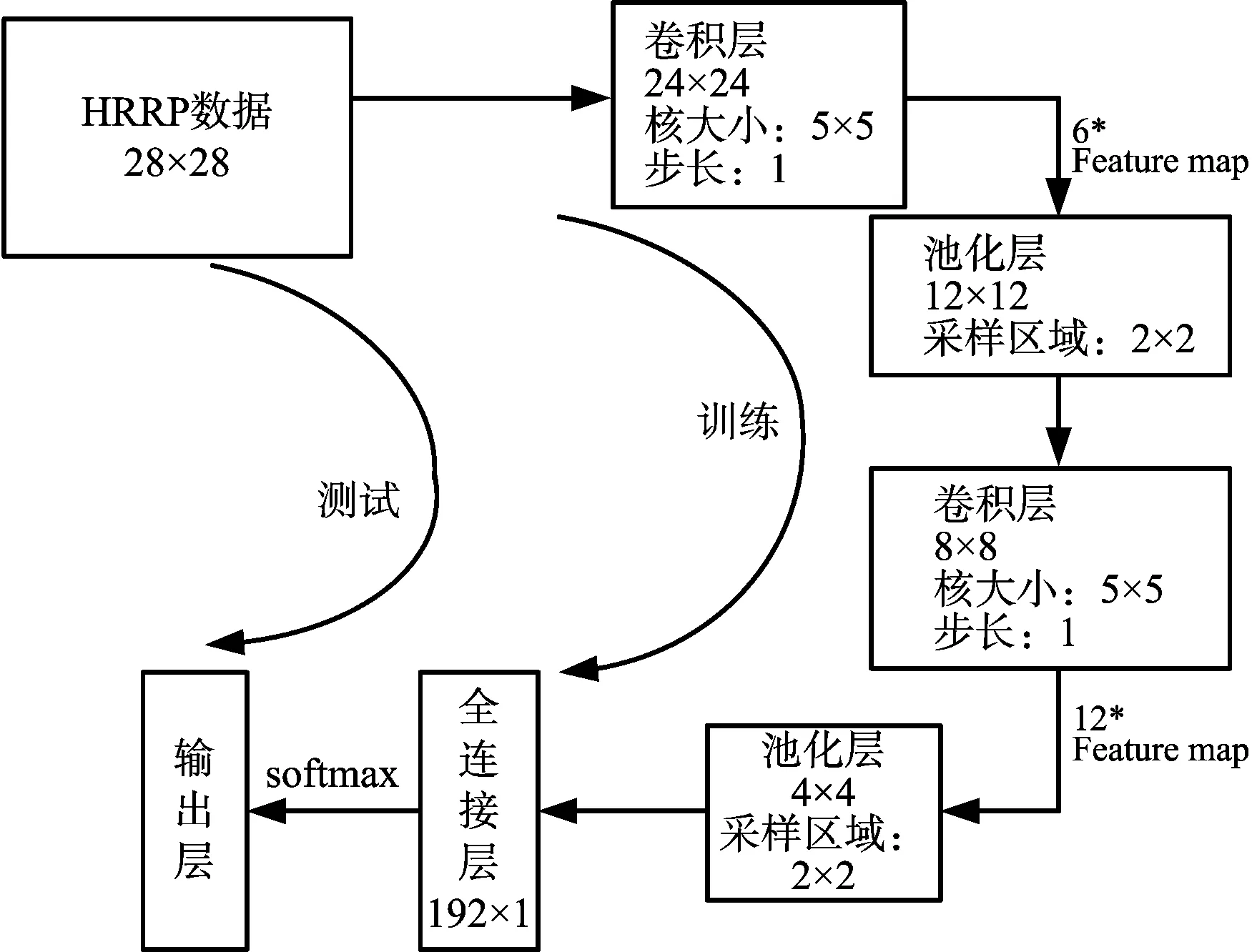

CNN是一類特殊的前饋神經(jīng)網(wǎng)絡(luò),最早始于20世紀(jì)60年代Hubel和Wiesel等人通過對(duì)貓和猴的視覺皮層細(xì)胞研究,發(fā)現(xiàn)其獨(dú)特的網(wǎng)絡(luò)結(jié)構(gòu)可以有效地降低反饋神經(jīng)網(wǎng)絡(luò)的復(fù)雜性,提出了感受野(receptive field)的概念,繼而提出了CNN[20]。近年來,CNN被廣泛應(yīng)用于各個(gè)領(lǐng)域,在語音識(shí)別、人臉識(shí)別、通用物體識(shí)別、運(yùn)動(dòng)分析、自然語言處理等方面均有突破,它的基本結(jié)構(gòu)如圖2所示。

圖2 CNN基本結(jié)構(gòu)圖

從圖2可以看出,CNN與普通的人工神經(jīng)網(wǎng)絡(luò)相比在結(jié)構(gòu)上多了卷積層和池化層,即“特征抽取器”,通過數(shù)據(jù)訓(xùn)練出的卷積核對(duì)于特定的特征才會(huì)有較大的激活值。卷積操作是利用卷積核對(duì)輸入圖片或者上一隱層的數(shù)據(jù)進(jìn)行處理,更深層次的卷積層可以學(xué)習(xí)到更深層次的特征,其核心是可以減少不必要的權(quán)值連接,權(quán)值共享可以大大減少網(wǎng)絡(luò)的參數(shù)量并且提高計(jì)算速度,每一個(gè)卷積層包含了若干個(gè)特征映射圖(feature map),其表達(dá)式如下:

(1)

hi=pooling(hi-1)

(2)

池化操作包括最大池化、平均池化等,本文采用最大池化。在全連接層輸出的每個(gè)神經(jīng)元都和上一層每一個(gè)神經(jīng)元連接。在輸出層一般用softmax分類器進(jìn)行分類,損失函數(shù)為

(3)

式中,Y為網(wǎng)絡(luò)的輸出,后一項(xiàng)為正則項(xiàng),目的是為了防止過擬合,權(quán)重衰減系數(shù)λ可以控制過擬合程度,λ值過小可能會(huì)導(dǎo)致過擬合,反之可能會(huì)導(dǎo)致欠擬合。

1.3 步驟方法

由于HRRP是一維數(shù)據(jù),因此本文考慮將HRRP數(shù)據(jù)重新排列轉(zhuǎn)化為二維數(shù)據(jù)再進(jìn)行輸入。實(shí)驗(yàn)步驟分為數(shù)據(jù)預(yù)處理、訓(xùn)練網(wǎng)絡(luò)、測試網(wǎng)絡(luò)。

數(shù)據(jù)預(yù)處理:一般情況下初始HRRP都是復(fù)值數(shù)據(jù),首先對(duì)復(fù)值數(shù)據(jù)進(jìn)行取模運(yùn)算,然后進(jìn)行能量歸一化,最后將一維數(shù)據(jù)重新排列轉(zhuǎn)化為二維數(shù)據(jù)。

訓(xùn)練網(wǎng)絡(luò):在網(wǎng)絡(luò)進(jìn)行訓(xùn)練之前搭建CNN網(wǎng)絡(luò),初始化網(wǎng)絡(luò)參數(shù),本文采用標(biāo)準(zhǔn)初始化(normalized initialization)方法初始超參數(shù),即

(4)

式中,U代表均勻分布,m為類別數(shù),n為輸出的全連接維度。將處理后的二維數(shù)據(jù)作為網(wǎng)絡(luò)的輸入,利用式(1)、式(2)進(jìn)行前向傳播計(jì)算,獲得網(wǎng)絡(luò)各卷積層和池化層的特征圖h1,h2,…,根據(jù)得到的損失函數(shù)式(3)利用反向傳播算法(BP)來實(shí)現(xiàn)網(wǎng)絡(luò)中參數(shù)的更新學(xué)習(xí),最終得到每一類樣本的網(wǎng)絡(luò)參數(shù)w和b并保存。

測試網(wǎng)絡(luò):將測試數(shù)據(jù)輸入到訓(xùn)練好的網(wǎng)絡(luò)模型中并與實(shí)際標(biāo)簽進(jìn)行對(duì)比,計(jì)算網(wǎng)絡(luò)的準(zhǔn)確率。

2 實(shí)驗(yàn)結(jié)果與討論

2.1 數(shù)據(jù)集

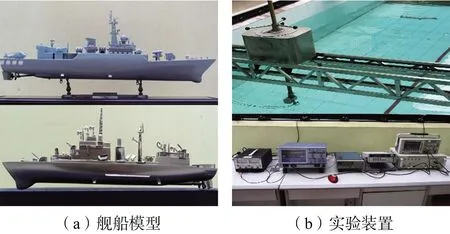

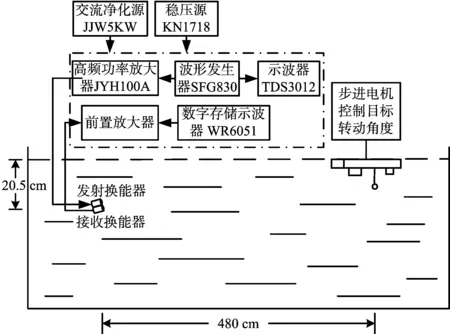

本文采用的數(shù)據(jù)是某實(shí)驗(yàn)室通過水聲試驗(yàn)測量的艦船模型HRRP數(shù)據(jù)[21],艦船模型與實(shí)驗(yàn)裝置如圖3所示,實(shí)驗(yàn)示意圖如圖4所示。

圖3 艦船模型與實(shí)驗(yàn)裝置

圖4 實(shí)驗(yàn)示意圖

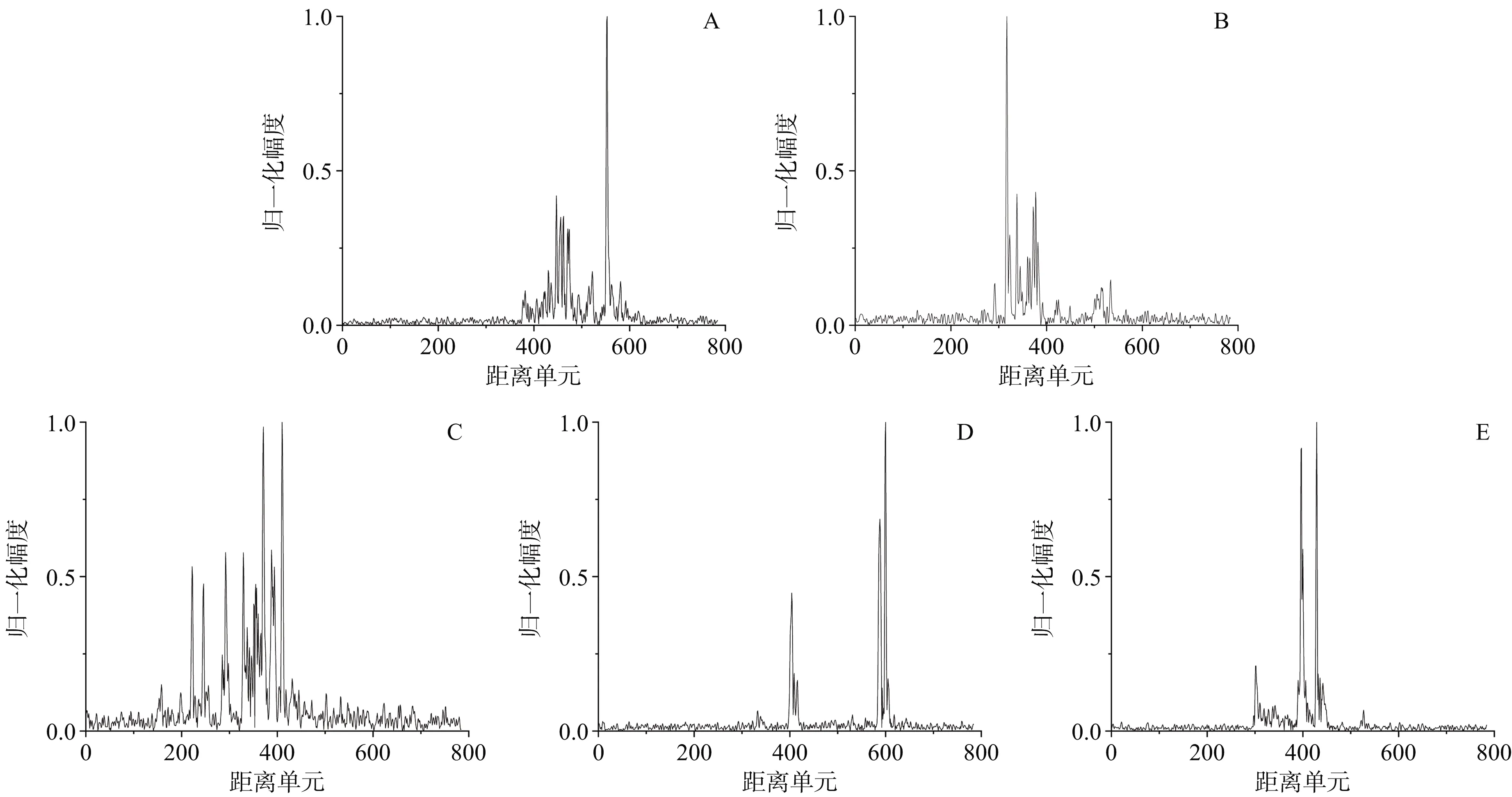

實(shí)驗(yàn)共測得5類艦船在不同角度下的HRRP數(shù)據(jù),5類艦船目標(biāo)編號(hào)為目標(biāo)A~E,其中A~C為軍用艦船,D為漁政船,E為巴拿馬型貨船。每一類包含2 400個(gè)樣本,平均覆蓋180°姿態(tài)角,圖5給出了5類目標(biāo)在姿態(tài)角為0°時(shí)的歸一化HRRP。

圖5 5類艦船實(shí)測數(shù)據(jù)的HRRP

本文所采用的網(wǎng)絡(luò)模型如圖6所示。

圖6 卷積神經(jīng)網(wǎng)絡(luò)模型

實(shí)驗(yàn)隨機(jī)抽取80%的數(shù)據(jù)進(jìn)行訓(xùn)練網(wǎng)絡(luò),剩余數(shù)據(jù)測試網(wǎng)絡(luò)。設(shè)測試數(shù)據(jù)為Ptest,這里Ptest=2 400,測試數(shù)據(jù)中預(yù)測正確的樣本數(shù)量為N,由于5類艦船數(shù)據(jù)量相同,具有對(duì)稱性,因此本文定義目標(biāo)識(shí)別率為

(5)

2.2 實(shí)驗(yàn)結(jié)果

實(shí)驗(yàn)基于MATLAB中的DeepLearn Toolbox,具體運(yùn)行環(huán)境為Intel (R) Core(TM) i5-7500 CPU @ 3.4 GHz(8 G內(nèi)存)。為了更加清楚直觀地觀察網(wǎng)絡(luò)訓(xùn)練的過程,圖7給出了可視化訓(xùn)練結(jié)果。

圖7為某類樣本在一次訓(xùn)練過程中的特征圖,其中包括第一個(gè)卷積層的6張?zhí)卣鲌D和第二個(gè)卷積層的12張?zhí)卣鲌D(圖中特征圖的縱軸均為歸一化幅度),網(wǎng)絡(luò)層數(shù)越高代表了學(xué)習(xí)到更深層次的特征。由于sigmoid函數(shù)在信號(hào)的空間映射上有良好的效果,因此實(shí)驗(yàn)選取sigmoid作為激活函數(shù),對(duì)應(yīng)的公式為

(6)

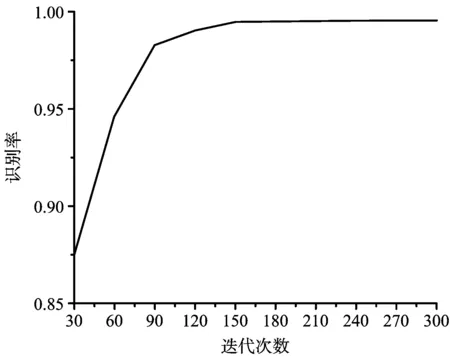

在實(shí)驗(yàn)中,取學(xué)習(xí)率α=1,batches=50,采用批量隨機(jī)梯度下降法訓(xùn)練網(wǎng)絡(luò),在不同的迭代次數(shù)下目標(biāo)識(shí)別率如圖8所示。

圖8 CNN在不同迭代次數(shù)下的識(shí)別率

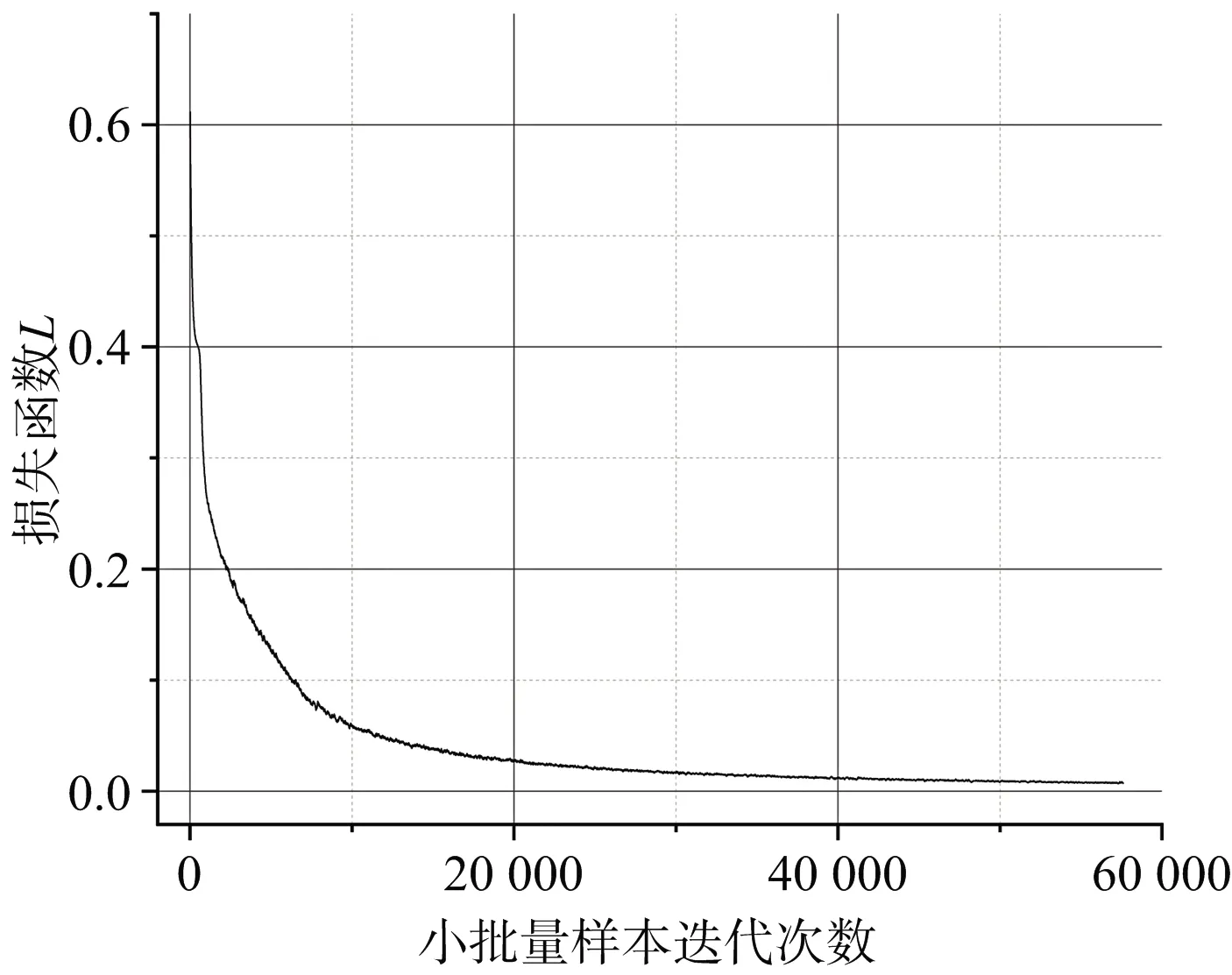

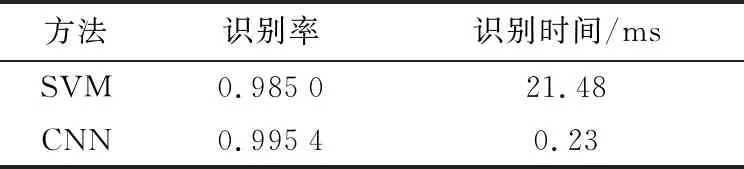

由圖8可以看出,在迭代次數(shù)超過150時(shí)網(wǎng)絡(luò)基本可以學(xué)習(xí)到數(shù)據(jù)的全部特征,訓(xùn)練損失曲線如圖9所示。同時(shí)為了驗(yàn)證CNN方法對(duì)穩(wěn)健特征提取與目標(biāo)識(shí)別的有效性,文章將CNN與SVM進(jìn)行比較,在SVM實(shí)驗(yàn)中,核函數(shù)取徑向基函數(shù)(RBF),通過網(wǎng)格搜索算法對(duì)懲罰系數(shù)C和σ進(jìn)行尋優(yōu),訓(xùn)練數(shù)據(jù)與測試數(shù)據(jù)完全相同,CNN迭代次數(shù)為300,識(shí)別率與識(shí)別時(shí)間如表1所示。

圖9 訓(xùn)練損失曲線

表1 CNN與SVM的目標(biāo)識(shí)別結(jié)果

從表1可知,CNN的識(shí)別性能在準(zhǔn)確率與識(shí)別時(shí)間上都優(yōu)于SVM,識(shí)別率可達(dá)到99.54%,并且識(shí)別速度較快,無需人工特征提取且無需了解姿態(tài)角的先驗(yàn)信息。

3 泛化性能

由上一節(jié)可知,在數(shù)據(jù)量充足的情況下CNN可達(dá)到較高的識(shí)別率,但由于艦船非合作目標(biāo)的缺陷,往往會(huì)造成數(shù)據(jù)庫角度數(shù)據(jù)的不足,數(shù)據(jù)集缺失,回波數(shù)據(jù)被噪聲干擾等情況,本節(jié)將進(jìn)一步探討在訓(xùn)練數(shù)據(jù)不足且添加噪聲的情況下CNN的識(shí)別性能。

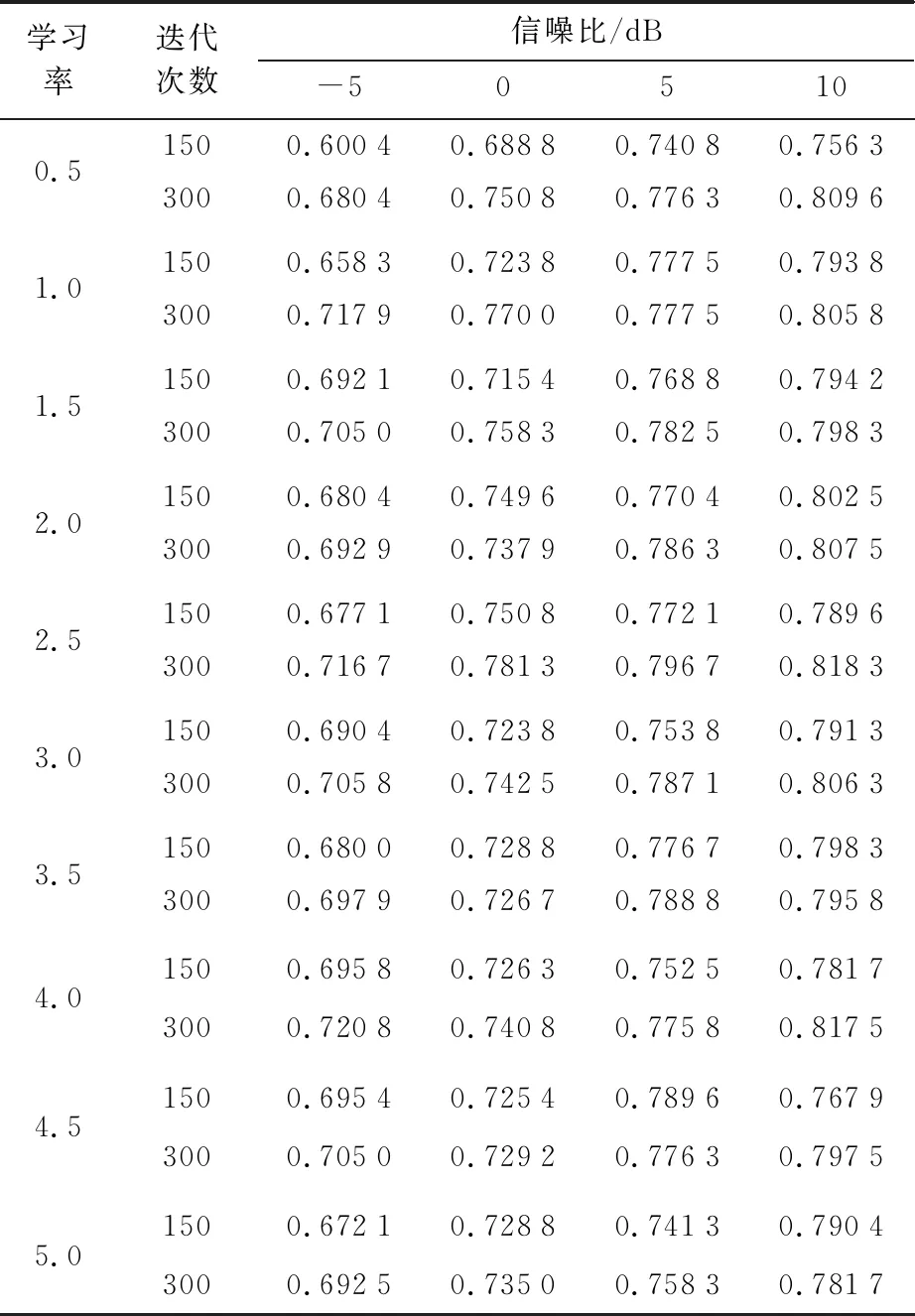

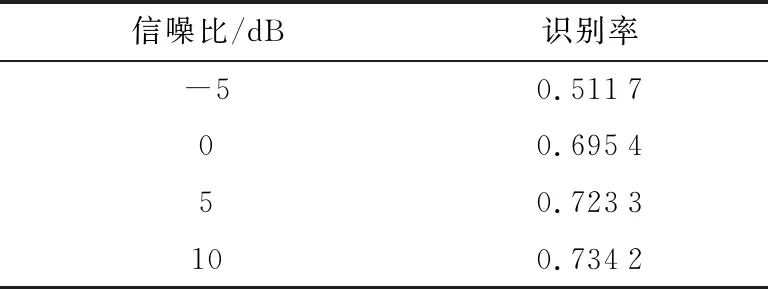

取數(shù)據(jù)集中姿態(tài)角度為30°~60°,90°~120°,150°~180°扇形區(qū)間內(nèi)的數(shù)據(jù),訓(xùn)練集從中隨機(jī)選取80%,即將數(shù)據(jù)集與訓(xùn)練集減少一半,測試集不變,仍從全數(shù)據(jù)集中隨機(jī)選取20%,這樣測試集中會(huì)有大約50%的數(shù)據(jù)沒有在訓(xùn)練數(shù)據(jù)的扇形區(qū)間內(nèi)。在此基礎(chǔ)上,對(duì)數(shù)據(jù)加入高斯白噪聲,使得處理后數(shù)據(jù)信噪比范圍為-5~10 dB,CNN在不同的信噪比、學(xué)習(xí)率、迭代次數(shù)下識(shí)別結(jié)果如表2所示, 與此同時(shí)將實(shí)驗(yàn)測得SVM在相同數(shù)據(jù)集與信噪比環(huán)境下的識(shí)別率如表3所示,兩種方法的識(shí)別結(jié)果如圖10所示。

表2 CNN在不同條件下的識(shí)別結(jié)果

表3 SVM在不同信噪比情況下的識(shí)別結(jié)果

圖10 CNN與SVM在不同信噪比情況下的識(shí)別率

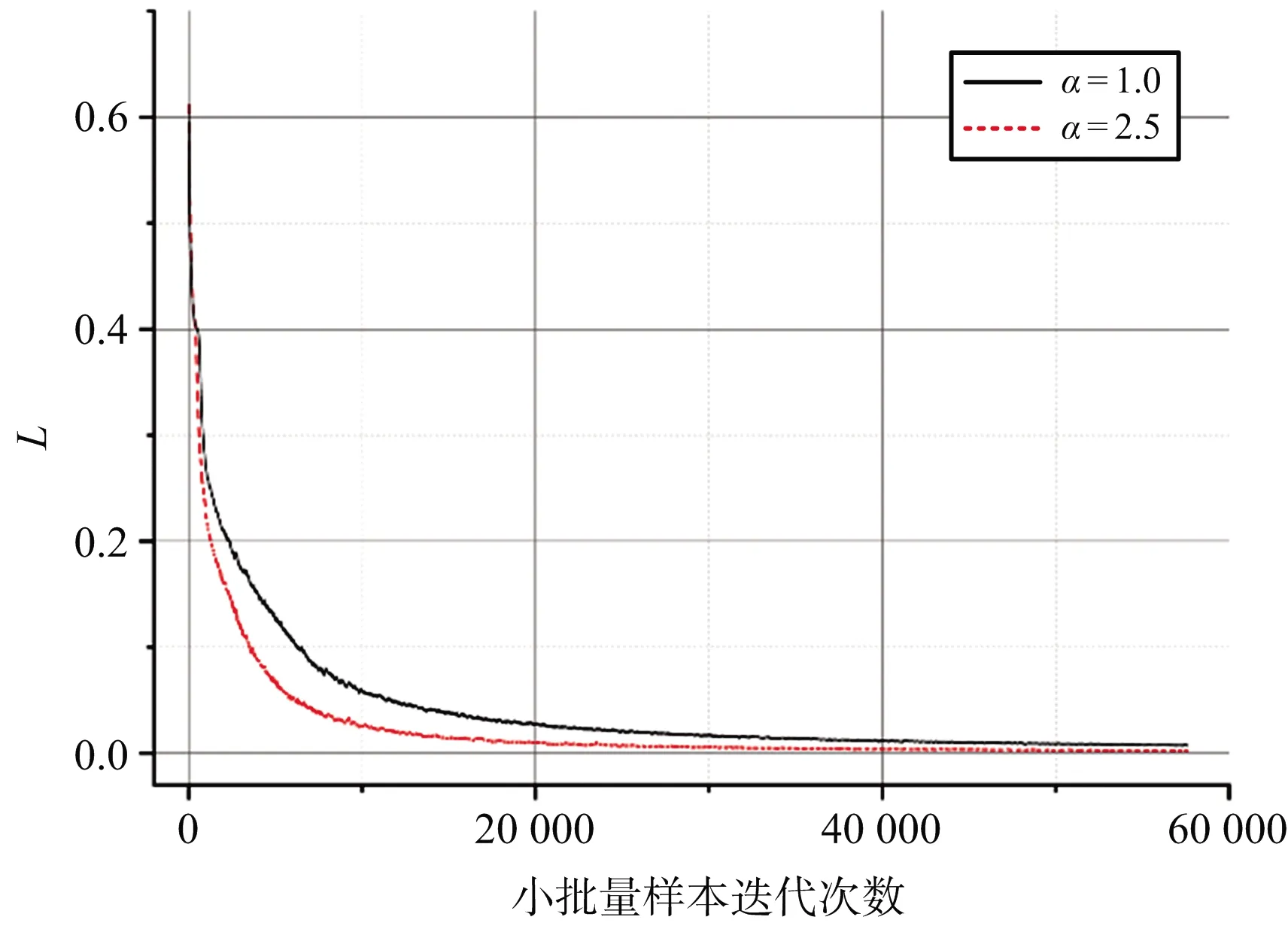

從圖10可以看出,在添加噪聲并且測試集中有一半的數(shù)據(jù)集沒有經(jīng)過訓(xùn)練的情況下CNN仍有較高的識(shí)別率,信噪比為10 dB,訓(xùn)練數(shù)據(jù)減半時(shí)最高識(shí)別率可達(dá)到81.83%。學(xué)習(xí)率是深度學(xué)習(xí)中重要的參數(shù),其取值對(duì)于梯度下降法有重要的影響,值過大可能會(huì)導(dǎo)致陷入局部極值甚至無法收斂,值過小可能導(dǎo)致收斂過程十分緩慢,因此學(xué)習(xí)率是決定目標(biāo)函數(shù)是否能夠收斂與何時(shí)收斂的重要因素。往往在訓(xùn)練深度網(wǎng)絡(luò)的過程中學(xué)習(xí)率的取值多數(shù)憑經(jīng)驗(yàn)選取,比如1等值,而適當(dāng)?shù)膶W(xué)習(xí)率的選擇會(huì)提高目標(biāo)識(shí)別的準(zhǔn)確率,在圖10中當(dāng)信噪比大于0時(shí),α=2.5時(shí)識(shí)別率最高,平均識(shí)別率可提高1.0個(gè)百分點(diǎn)。當(dāng)學(xué)習(xí)率分別為1和2.5時(shí)網(wǎng)絡(luò)的訓(xùn)練損失如圖11所示。從圖11可以看出,當(dāng)α=2.5比α=1時(shí)網(wǎng)絡(luò)會(huì)更加快速的收斂。

圖11 不同學(xué)習(xí)率下的訓(xùn)練損失曲線

4 結(jié)束語

本文將卷積神經(jīng)網(wǎng)絡(luò)應(yīng)用于高分辨距離像的目標(biāo)識(shí)別中,將一維數(shù)據(jù)轉(zhuǎn)化為二維數(shù)據(jù),解決了在傳統(tǒng)目標(biāo)識(shí)別的過程中人工提取特征很難挖掘到數(shù)據(jù)深層次特征的問題。在數(shù)據(jù)量充足的情況下可以達(dá)到近百分之百的識(shí)別率,然后對(duì)網(wǎng)絡(luò)的泛化性能進(jìn)行了討論,并與SVM進(jìn)行了對(duì)比,驗(yàn)證了CNN的魯棒性較強(qiáng),最后對(duì)不同的學(xué)習(xí)率進(jìn)行了對(duì)比,以往由于深度網(wǎng)絡(luò)訓(xùn)練時(shí)間較長等原因,學(xué)習(xí)率的選擇往往是易被忽視的一點(diǎn),而本文提出的合適學(xué)習(xí)率的選擇可以提高識(shí)別率,對(duì)雷達(dá)自動(dòng)目標(biāo)識(shí)別具有重要的意義。